神经网络优化计算.50页PPT

合集下载

神经网络计算PPT课件

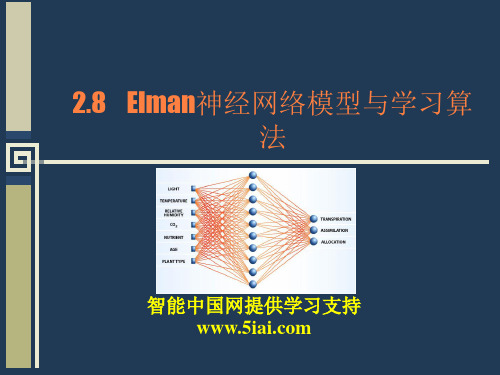

函数名 newelm() trains() traingdx() learngdm() 功 能 生成一个Elman神经网络 根据已设定的权值和阈值对网络进行顺序训 练 自适应学习速率动量梯度下降反向传播训练 函数 动量梯度下降权值和阈值学习函数

2.8.3 Elman神经网络学习算法的MATLAB实现

n

1

w3 (t )

1 n

netn ( t 1)

w2 (t )

1 2

i A B

w i ( t ) i ( t )

un ( t ) i (t ) xcn ( t ) r w2 w (t ) 3 w

i

if i A if i B if i A f iB

netn ( t )

i A B

w ( t 1) i ( t 1)

i

Input u

xc ( t ) h( netn ( t ))

2.8.2 Elman神经网络学习算法

Elman神经网络学习算法采用BP算法

判断算法是否结束的误差函数为:

E [ y (k ) d (k )]

上下文单元

输出

Hale Waihona Puke 输入 隐层单元 输入单元 输出单元

2.8.2 Elman神经网络学习算法

Elman神经网络各层输入输出公式 如果输入向量 u 为 r 维向量,输出向量 y 为 m 维,隐含层输出向量 x 为 n 维,承接 层输出向量 x c为 n 维, w , w , w 分别为隐含 层到输出层、输入层到隐含层、承接层到 隐含层的连接权值。g()为输出神经元的激 活函数,是隐含层输出的线性组合。f() 为隐 h()为承接层的海派 含层神经元的激活函数, net ()表示某层的净输入,用A表示输入 函数, 层,用B表示承接层,t 表示迭代次序则各 层之间的表达式如下图所示。

2.8.3 Elman神经网络学习算法的MATLAB实现

n

1

w3 (t )

1 n

netn ( t 1)

w2 (t )

1 2

i A B

w i ( t ) i ( t )

un ( t ) i (t ) xcn ( t ) r w2 w (t ) 3 w

i

if i A if i B if i A f iB

netn ( t )

i A B

w ( t 1) i ( t 1)

i

Input u

xc ( t ) h( netn ( t ))

2.8.2 Elman神经网络学习算法

Elman神经网络学习算法采用BP算法

判断算法是否结束的误差函数为:

E [ y (k ) d (k )]

上下文单元

输出

Hale Waihona Puke 输入 隐层单元 输入单元 输出单元

2.8.2 Elman神经网络学习算法

Elman神经网络各层输入输出公式 如果输入向量 u 为 r 维向量,输出向量 y 为 m 维,隐含层输出向量 x 为 n 维,承接 层输出向量 x c为 n 维, w , w , w 分别为隐含 层到输出层、输入层到隐含层、承接层到 隐含层的连接权值。g()为输出神经元的激 活函数,是隐含层输出的线性组合。f() 为隐 h()为承接层的海派 含层神经元的激活函数, net ()表示某层的净输入,用A表示输入 函数, 层,用B表示承接层,t 表示迭代次序则各 层之间的表达式如下图所示。

神经网络介绍PPT详解课件

1940s

1960s

1980s

2000s

MP 模型 阈值加和 模型 Hebb学习 规则

感知器模型 自适应线性单元

Hopfield网络 Boltzman 机 BP算法

深度网络 DBN

CNN DBM

LeCun 98 Deep CNN RNN

低谷

低谷

人工神经网络发展历程

Deep Learning, Science 2006 (vol. 313, pp. 504-507)

网络模型

LeNet

网络结构的改进

NIN

AlexNet

网络深度的增加

VGGNet

GoogLeNet (Inception)

ResNet

Inception ResNet 图2:深度卷积神经网络发展图

图3:ILSVRC图像分类竞赛近年结果。

LeNet

最早的深度卷积神经网络模型,用于字符识别。网络具有如下特点:

AlexNet

AlexNet在LeNet基础上进行了更宽更深的网络设计,首次在CNN中引入了ReLU、 Dropout和Local Response Norm (LRN)等技巧。网络的技术特点如下:

➢ 使用ReLU (Rectified Linear Units)作为CNN的激活函数,并验证其效果在较深的网络超 过了Sigmoid,成功解决了Sigmoid在网络较深时的梯度弥散问题,提高了网络的训练速率。

人工神经网络发展历程

• 发展基础:

✓ 数据爆炸:图像数据、文本数据、语音数 据、社交网络数据、科学计算等

✓ 计算性能大幅提高

• 为什么有效

– 浅层神经网络可以近似任意函数,为何多层?

✓深层网络结构中,高层可以综合应用低层信息。 ✓低层关注“局部”,高层关注“全局”、更具有语

神经网络学习PPT课件

d ||X1 X 2|| ( X1 X 2 )( X1-X 2 )T

摘自《Talking Nets: An Oral History of Neural Networks》封面

2008-2009学年第1学期

1

神经网络基础

公元前400年左右,柏拉图和亚里士多德就曾对 人类认知、记忆、思维进行过研究;

19世纪末,出现了神经元学说;美国生物学家W. James在《Physiology》一书中提到,“人脑中 两个基本单元靠得较近时,一个单元的兴奋会传 到另一个单元;

2008-2009学年第1学期

16

“感知器”无法解决线性不可分问题;

1969年,Minsky和Papert指出了“感知器”的 这种局限性,例如,“感知器”无法实现“异或”

逻辑。

逻辑“与”

逻辑“异或”

x1

x2

y

x1

x2

y

0

0

0

0

0

0

0

1

0

0

1

1

1

0

0

1

0

1

1

1

1

1

1

0

2008-2009学年第1学期

输入一个实际例子,让ANN分析并给出结果。

2008-2009学年第1学期

12

“感知器”是怎么训练的呢?

假设每个样本含 n 个属性,用向量(x1, x2, …, xn)表示;若 X 为样本变量, X∈Rn;

wij 是 xi 到神经元 j 的连接权值, Wj 是神经元 j 的输入连 接的权值向量,即Wj =(w1j , w2j , …, wnj );

第i层神经元netij层神经元的数目20082009学年第1学神经网络学习bp算法中的前向计算ijijnetijij特征函数必须是有界连续可微的如sigmoid函数20082009学年第1学期神经网络学习bp算法中的反向计算ijkijkijkijkijk输出层神经元j的状态误差ijk的调整量20082009学年第1学期神经网络学习bp算法中的反向计算续ikik神经网络学习bp学习算法的特点对于n层网络结构学习后可得到n1个超曲面组成复合曲面从而实现复杂的分类任务

深度学习之神经网络(CNN-RNN-GAN)算法原理+实战课件PPT模板可编辑全文

8-1图像生成文本问题引入入

8-5showandtell模型

8-2图像生成文本评测指标

8-4multi-modalrnn模型

8-6showattendandtell模型

8-10图像特征抽取(1)-文本描述文件解析

8-8图像生成文本模型对比与总结

8-9数据介绍,词表生成

8-7bottom-uptop-downattention模型

第6章图像风格转换

06

6-1卷积神经网络的应用

6-2卷积神经网络的能力

6-3图像风格转换v1算法

6-4vgg16预训练模型格式

6-5vgg16预训练模型读取函数封装

6-6vgg16模型搭建与载入类的封装

第6章图像风格转换

单击此处添加文本具体内容,简明扼要的阐述您的观点。根据需要可酌情增减文字,与类别封装

06

7-12数据集封装

第7章循环神经网络

7-13计算图输入定义

7-14计算图实现

7-15指标计算与梯度算子实现

7-18textcnn实现

7-17lstm单元内部结构实现

7-16训练流程实现

第7章循环神经网络

7-19循环神经网络总结

第8章图像生成文本

08

第8章图像生成文本

02

9-9文本生成图像text2img

03

9-10对抗生成网络总结

04

9-11dcgan实战引入

05

9-12数据生成器实现

06

第9章对抗神经网络

9-13dcgan生成器器实现

9-14dcgan判别器实现

9-15dcgan计算图构建实现与损失函数实现

9-16dcgan训练算子实现

9-17训练流程实现与效果展示9-14DCGAN判别器实现9-15DCGAN计算图构建实现与损失函数实现9-16DCGAN训练算子实现9-17训练流程实现与效果展示

8-5showandtell模型

8-2图像生成文本评测指标

8-4multi-modalrnn模型

8-6showattendandtell模型

8-10图像特征抽取(1)-文本描述文件解析

8-8图像生成文本模型对比与总结

8-9数据介绍,词表生成

8-7bottom-uptop-downattention模型

第6章图像风格转换

06

6-1卷积神经网络的应用

6-2卷积神经网络的能力

6-3图像风格转换v1算法

6-4vgg16预训练模型格式

6-5vgg16预训练模型读取函数封装

6-6vgg16模型搭建与载入类的封装

第6章图像风格转换

单击此处添加文本具体内容,简明扼要的阐述您的观点。根据需要可酌情增减文字,与类别封装

06

7-12数据集封装

第7章循环神经网络

7-13计算图输入定义

7-14计算图实现

7-15指标计算与梯度算子实现

7-18textcnn实现

7-17lstm单元内部结构实现

7-16训练流程实现

第7章循环神经网络

7-19循环神经网络总结

第8章图像生成文本

08

第8章图像生成文本

02

9-9文本生成图像text2img

03

9-10对抗生成网络总结

04

9-11dcgan实战引入

05

9-12数据生成器实现

06

第9章对抗神经网络

9-13dcgan生成器器实现

9-14dcgan判别器实现

9-15dcgan计算图构建实现与损失函数实现

9-16dcgan训练算子实现

9-17训练流程实现与效果展示9-14DCGAN判别器实现9-15DCGAN计算图构建实现与损失函数实现9-16DCGAN训练算子实现9-17训练流程实现与效果展示

神经网络ppt课件

神经元层次模型 组合式模型 网络层次模型 神经系统层次模型 智能型模型

通常,人们较多地考虑神经网络的互连结构。本 节将按照神经网络连接模式,对神经网络的几种 典型结构分别进行介绍

12

2.2.1 单层感知器网络

单层感知器是最早使用的,也是最简单的神经 网络结构,由一个或多个线性阈值单元组成

这种神经网络的输入层不仅 接受外界的输入信号,同时 接受网络自身的输出信号。 输出反馈信号可以是原始输 出信号,也可以是经过转化 的输出信号;可以是本时刻 的输出信号,也可以是经过 一定延迟的输出信号

此种网络经常用于系统控制、 实时信号处理等需要根据系 统当前状态进行调节的场合

x1

…… …… ……

…… yi …… …… …… …… xi

再励学习

再励学习是介于上述两者之间的一种学习方法

19

2.3.2 学习规则

Hebb学习规则

这个规则是由Donald Hebb在1949年提出的 他的基本规则可以简单归纳为:如果处理单元从另一个处

理单元接受到一个输入,并且如果两个单元都处于高度活 动状态,这时两单元间的连接权重就要被加强 Hebb学习规则是一种没有指导的学习方法,它只根据神经 元连接间的激活水平改变权重,因此这种方法又称为相关 学习或并联学习

9

2.1.2 研究进展

重要学术会议

International Joint Conference on Neural Networks

IEEE International Conference on Systems, Man, and Cybernetics

World Congress on Computational Intelligence

复兴发展时期 1980s至1990s

通常,人们较多地考虑神经网络的互连结构。本 节将按照神经网络连接模式,对神经网络的几种 典型结构分别进行介绍

12

2.2.1 单层感知器网络

单层感知器是最早使用的,也是最简单的神经 网络结构,由一个或多个线性阈值单元组成

这种神经网络的输入层不仅 接受外界的输入信号,同时 接受网络自身的输出信号。 输出反馈信号可以是原始输 出信号,也可以是经过转化 的输出信号;可以是本时刻 的输出信号,也可以是经过 一定延迟的输出信号

此种网络经常用于系统控制、 实时信号处理等需要根据系 统当前状态进行调节的场合

x1

…… …… ……

…… yi …… …… …… …… xi

再励学习

再励学习是介于上述两者之间的一种学习方法

19

2.3.2 学习规则

Hebb学习规则

这个规则是由Donald Hebb在1949年提出的 他的基本规则可以简单归纳为:如果处理单元从另一个处

理单元接受到一个输入,并且如果两个单元都处于高度活 动状态,这时两单元间的连接权重就要被加强 Hebb学习规则是一种没有指导的学习方法,它只根据神经 元连接间的激活水平改变权重,因此这种方法又称为相关 学习或并联学习

9

2.1.2 研究进展

重要学术会议

International Joint Conference on Neural Networks

IEEE International Conference on Systems, Man, and Cybernetics

World Congress on Computational Intelligence

复兴发展时期 1980s至1990s

《神经网络优化计算》PPT课件

l k

1

y

l j

y

l j

l j

f

' (v)

k k

k

l k

1

[(dk Ok ) f '(vk )]

f '(vk )

O

d O d

前向计算

反向传播

智能优化计算

3.3 反馈型神经网络

一般结构 各神经元之间存在相互联系

分类 连续系统:激活函数为连续函数 离散系统:激活函数为阶跃函数

3.2 多层前向神经网络

3.2.1 一般结构 3.2.2 反向传播算法

3.3 反馈型神经网络

3.3.1 离散Hopfield神经网络 3.3.2 连续Hopfield神经网络 3.3.3 Hopfield神经网络在TSP中的应用

智能优化计算

3.1 人工神经网络的基本概念

3.1.1 发展历史

“神经网络”与“人工神经网络” 1943年,Warren McCulloch和Walter Pitts建立了

ym 输出层

智能优化计算

3.1 人工神经网络的基本概念

3.1.3 网络结构的确定

网络的拓扑结构

前向型、反馈型等

神经元激活函数

阶跃函数

线性函数

f (x) ax b

Sigmoid函数

f

(

x)

1

1 e

x

f(x)

+1

0

x

智能优化计算

3.1 人工神经网络的基本概念

3.1.4 关联权值的确定

智能优化计算

第三章 神经网络优化计算

数学建模-神经网络算法ppt课件

• 1943年,心理学家W.S.McCulloch和数学家W.Pitts提出了描述脑 神经细胞动作的数学模型,即M-P模型(第一个神经网络模型)。

• 1949年,心理学家Hebb实现了对脑细胞之间相互影响的数学描述, 从心理学的角度提出了至今仍对神经网络理论有着重要影响的Hebb 学习法则。

• 1958年,E.Rosenblatt提出了描述信息在人脑中贮存和记忆的数学 模型,即著名的感知机模型(Perceptron)。

ppt课件完整

6

2. 人工神经网络的基本功能

• (1)联想记忆功能

– 由于神经网络具有分布 存储信息和并行计算的 性能,因此它具有对外 界刺激信息和输入模式 进行联想记忆的能力。

– 联想记忆有两种基本形 式

• 自联想记忆

• 异联想记忆

ppt课件完整

7

• 自联想记忆

– 网络中预先存储(记忆)多种模式信息

ppt课件完整

20

3. 神经网络的发展历史(续)

• (4) 新连接机制时期(1986-现在) – 神经网络从理论走向应用领域,出现了神经网络芯片 和神经计算机。 – 神经网络主要应用领域有

• 模式识别与图象处理(语音、指纹、故障检测和图象压缩等) • 控制与优化 • 预测与管理(市场预测、风险分析) •等

均为常数。

ppt课件完整

29

假设1:多输入单输出

ppt课件完整

• 正如生物神经元 有许多激励输入 一样,人工神经 元也应该有许多 的输入信号

• 图中,每个输入 的大小用确定数 值xi表示,它们同 时输入神经元j, 神经元的单输出 用oj表示。

30

假设2:输入类型——兴奋性和抑制性

• 生物神经元具有不同的突 触性质和突触强度,其对 输入的影响是使有些输入 在神经元产生脉冲输出过 程中所起的作用比另外一 些输入更为重要。

• 1949年,心理学家Hebb实现了对脑细胞之间相互影响的数学描述, 从心理学的角度提出了至今仍对神经网络理论有着重要影响的Hebb 学习法则。

• 1958年,E.Rosenblatt提出了描述信息在人脑中贮存和记忆的数学 模型,即著名的感知机模型(Perceptron)。

ppt课件完整

6

2. 人工神经网络的基本功能

• (1)联想记忆功能

– 由于神经网络具有分布 存储信息和并行计算的 性能,因此它具有对外 界刺激信息和输入模式 进行联想记忆的能力。

– 联想记忆有两种基本形 式

• 自联想记忆

• 异联想记忆

ppt课件完整

7

• 自联想记忆

– 网络中预先存储(记忆)多种模式信息

ppt课件完整

20

3. 神经网络的发展历史(续)

• (4) 新连接机制时期(1986-现在) – 神经网络从理论走向应用领域,出现了神经网络芯片 和神经计算机。 – 神经网络主要应用领域有

• 模式识别与图象处理(语音、指纹、故障检测和图象压缩等) • 控制与优化 • 预测与管理(市场预测、风险分析) •等

均为常数。

ppt课件完整

29

假设1:多输入单输出

ppt课件完整

• 正如生物神经元 有许多激励输入 一样,人工神经 元也应该有许多 的输入信号

• 图中,每个输入 的大小用确定数 值xi表示,它们同 时输入神经元j, 神经元的单输出 用oj表示。

30

假设2:输入类型——兴奋性和抑制性

• 生物神经元具有不同的突 触性质和突触强度,其对 输入的影响是使有些输入 在神经元产生脉冲输出过 程中所起的作用比另外一 些输入更为重要。

神经网络算法的ppt课件

神经网络的反向分散学习算法

神经网络的反向分散学习算法

神经网络的反向分散学习算法

神经网络的反向分散学习算法

神经网络的反向分散学习算法

动态网络——Hopfield网络

假设按照神经网络运转过程中的信息流向来分类, 那么一切网络都可分为前馈式网络和反响式网络,在前 一章中,主要引见了前馈式网络经过许多具有简单处置 才干的神经元的复协作用使整个网络具有复杂的非线性 映射才干。在那里,着重分析了网络学习算法,研讨的 重点是怎样尽快地得到网络的整体非线性处置才干。在 本章中,我们将集中讨论反响式网络,经过网络神经元 形状的变化而最终稳定于某一形状而得到联想存贮或神 经计算的结果。在这里,主要关怀的是网络稳定性的问 题,研讨的重点是怎样得到和利用稳定的反响式网络。

联想的定义

首先思索x类方式向量集合 (x1, x2, … , xp〕 及y类方式向量集合 (y1, y2, … , yp), 其中 xi=(x1i, x2i,… , xni ) , xi {-1, +1}n yi=(y1i, y2i,… , ymi ) , yi {-1, +1}m

联想的定义

定义3 吸引子的吸引域 对于某些特定的初始形状,网络按 一定的运转规那么最后能够都稳定在同一吸引子v(t)上。称可 以稳定在吸引子v(t)的一切初始形状集合为v(t)的吸引域。

Hopfield网络的联想原理

E= mc2 Newt

Newy

Einstan Newton

Newyear

Hopfield网络的联想原理

f1(x) = f2 (x) = … = fn (x) = sgn (x) 为以后分析方便,我们选各节点门限值相等,且等于0 ,即有 1= 2 = … = n = 0 同时,x = (x1, x2, …, xn ), x {-1, +1}n 为网络的输出, y = (y1, y2, …, yn ), y {-1, +1}n 为网络的输出 v (t) = (v1(t1), v2(t2), …, vn(tn)), v (t) {-1, +1}n 为网络在时辰 t的形状, 其中t (0,1,2,…)为离散时间变量,Wij为从Ni到Nj的衔接 权值, Hopfield网络是对称的,即Wij = Wji ,i, j {1,2, …, n} 。