3第3章信息论课件

(信息论)第3章离散信源

k = 1, 2, L, N

② 连续无记忆信源 若在 N 维随机矢量 X 中,每个随机变量 X k 是连续随 机变量,且相互独立,则 N 维随机矢量 X 的联合概率密 度函数为

p (X ) = ∏ p k

k =1 N

6

有记忆信源

{

无限记忆信源

有限记忆信源

有限记忆信源可用有限状态马尔可夫链来描述。当信 源记忆长度为 m+1 时,也就是信源每次发出的符号仅与前 m 个符号有关,与更前面的符号无关。这样的信源称为 m 阶马尔可夫信源。此时可用条件概率分布描述信源的统计 特性。

H (X ) = E[I (xi )] = −∑ p(xi ) log p(xi )

i =1

q

(3.7)

信源熵 是从平均意义上表征信源总体统计特征的一个 量,是信源的统计平均不确定性的描述。

10

例:设信源符号集

1 率分别为 p ( x1 ) = , 2

X = {x1 , x2 , x3 , x4 }

k

或 a 2 的概率。

14

2、离散无记忆二进制信源 X 的三次扩展信源 、

N X 3 = ( X 1 , X 2 , X 3 ) 共输出 q 个消息 三次扩展信源

符号,q=2, N=3。所以二进制三次扩展信源的符号序列 共有8个, ai , i = 1, 2, L, 8。它可等效为一个具有8个消息 符号的新信源 X 。同时每个消息符号具有如下的概率分 布

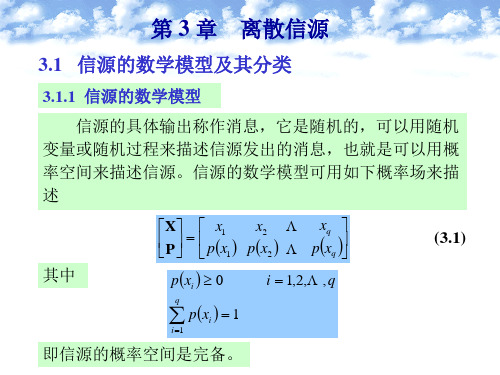

(3.1)

其中

p ( xi ) ≥ 0

i = 1,2,L, q

∑ p(x ) = 1

i =1 i

q

即信源的概率空间是完备。

1

① 离散信源的数学模型 其数学模型为离散型的概率空间:

信息论讲义-第三章(8讲)

2006-11-61信息理论基础第8讲北京航空航天大学201教研室陈杰2006-11-62当前状态u l =(a l1, a l2, a l3, …, a lm )当前输出X l =a l1.信源状态S={S 1, S 2 ,…S J }, J =q m⎧⎪⎪⎨⎪⎪⎩()12|m q i j S S S p S S ⎡⎤⎢⎥⎢⎥⎣⎦()112|m mi i i i p a a a a + 状态转移概率p (S i |S j )由条件符号概率确定u lu l+1X l =a l新状态u l+1=(a l2, a l3, …, a lm ,a l )2.状态空间2006-11-633.极限熵当时间足够长时,遍历的m 阶马尔可夫信源可视为平稳信源()121lim |N N N H H X X X X ∞−→∞= ()112|m m H X X X X += 1m H +=()()|jj j s p S H X S =∑H (X|S j )是信源处于状态S j 时的条件熵()()()||log |jj i j i j S H X S p a S p a S =∑()()|log |ji j i j S p S S p S S =∑2006-11-64例3.7一阶马尔可夫信源的状态如例题图所示,信源X 的符号集为{0,1,2}。

(1)求平稳后的信源的概率分布;(2)求信源熵H ∞(3)求当p =0或p =1时信源的熵12pppppp2006-11-65解(1)状态转移矩阵令信源的平稳分布为则0 00 p p p p p p ⎡⎤⎢⎥=⎢⎥⎢⎥⎣⎦P []012 W W W =W 0011120121W pW pW W pW pW W W W =+⎧⎪=+⎨⎪++=⎩2006-11-66整理得,平稳后信源的概率分布(2)求信源熵H ∞。

根据平稳分布01213W W W ===()()jj k j s H p S H a S ∞=∑1113[lo g lo g ]3p p p p =×+11log logp p p p=+2006-11-67(3)p =0时p =1时∞→→=+=−=0311lim [loglog]lim ()log 0p p H p p ppp e∞→→=+=−=0311lim [loglog]lim ()log 0P P H p p ppp e3.5.3 马尔可夫信源解释:•信源熵表示的是信源的平均不确定性。

信息论-第三章PPT课件

一般简单的单符号离散信道的数学模型可以用概率空

间[X,p(y|x),Y]来描述。

a1

b1

X

P (b j | ai )

Y

ar

2021/6/7

bs

6

第一节 信道的数学模型及分类

表示成矩阵形式:

…

y1

y2

… x1 p(y1/x1) p(y2/x1)

[P]=

…

x2 p(y1/x2) p(y2/x2)

2021/6/7

27

第四节 信道容量及其一般计算方法

(3)无噪有损信道

x1

x2

y1

x3

x4

y2

x5

此时信道疑义度为0,而信道噪声熵不为0,从而

C=max{I(X;Y)}=max{H(Y)-H(Y/X)}=max{H(Y)}=logs

2021/6/7

28

第四节 信道容量及其一般计算方法

2、对称离散信道的信道容量

y1

y2

…

x1

p(y1/x1)

p(y2/x1)

…

[P]= x2

p(y1/x2)

p(y2/x2)

…

…

…

…

…

xn

p(y1/xn)

p(y2/xn)

…

ym p(ym/x1) p(ym/x2)

… p(ym/xn)

2021/6/7

10

第一节 信道的数学模型及分类

为了表述简便,可以写成 P(bj /ai)pij

因为H(X),表示传输前信源的不确定性,而H(X/Y)表示

收到一个符号后,对信源尚存的不确定性,所以二者之

差信道传递的信息量。

第3章-信息组织的原理与方法

❖ (3)圣西门和黑格尔的分类思想

•信息组织>>>第 3 章信息组织的原理与方法

21

Logo

3.1 信息组织的原理

❖3.1.4 知识分类原理 ❖ (4)恩格斯的分类思想 ❖恩格斯把科学分为:数学、力学和天文学、

❖3.1.1 系统原理

❖ 在信息组织系统中,如果将大量的、分散的、杂 乱的信息组织成一个系统,建立起内在的关联, 那么信息系统的整体功能将大于各个信息单元的 功能之总和。也就是说,这将能充分发挥信息资 源的价值和作用。不仅如此,在信息组织活动中, 类目体系的展开、主题词族的编制、信息的分析 等都体现着系统的思想。基于这一原理,信息组 织的目标是要建立一个有效的方便检索的信息系 统。

物理学、化学、地学、生物学、社会科学 和关于人类思维规律的科学。

•信息组织>>>第 3 章信息组织的原理与方法

22

Logo

3.1 信息组织的原理

❖3.1.4 知识分类原理 ❖ (5)毛泽东的分类思想

❖毛泽东同志在《整顿党的作风》一文中说 过:“什么是知识?自从有阶级的社会存 在以来,世界上的知识只有两门,一门叫 做生产斗争知识,一门叫做阶级斗争知识。 自然科学、社会科学就是这两门知识的结 晶,哲学则是自然知识和社会知识的概括 和总结。”

3.1 信息组织的原理

❖3.1.3 逻辑学原理

❖ 信息组织是一种智力活动,离不开人的逻辑思维, 信息组织本身是思维的一种表现形式,概念是思 维的元素,逻辑则是思维的规则。所以信息组织 自然包含相应的逻辑学问题。实践证明,逻辑思 维越强的信息组织者其信息组织工作也越好。事 实上,信息组织是对信息对象的各个元素(按内部 特征和外部特征划分),经过从事物到概念再到语 言的层层递进的分析之后,运用科学思维使之序 化的一个复杂的过程。

信息论PPt(叶中行)

• 信道编码:是以提高信息传输的可靠性为目的的编 码。通常通过增加信源的冗余度来实现。采用的一 般方法是增大码率/带宽。与信源编码正好相反。

• 信源编码理论是信息论的一个重要分支,其理论基础 是信源编码的两个定理。 –无失真信源编码定理:是离散信源/数字信号编码 的基础; –限失真信源编码定理:是连续信源/模拟信号编码 的基础。 • 信源编码的分类:离散信源编码、连续信源编码和相 关信源编码三类 –离散信源编码:独立信源编码,可做到无失真编码; –连续信源编码:独立信源编码,只能做到限失真信 源编码; –相关信源编码:非独立信源编码。

*

3.5 通用信源编码

本节将主要介绍 • LZ算法, • 改进的LZ-Welcn 算法 • Kieffer-Yang算法, • LZ算法基于符号串匹配的算法,而LZWelcn 算法是基于字典的算法,它们都是 利用信源输出符号自身的信息来进行压缩 编码。Kieffer-Yang算法(简称YK算法)则 兼顾了字符串匹配和算术码结构的优点。

0 11 00 11

0 10 00 01

1 10 100 1000

1 01 001 0001

6 、同价码: 每个码字占相同的传输时间

7.码的N 次扩展: 若码C :{W1 , W2 ,..., Wq },B :{Bi (Wi1Wi 2 ...WiN )},则 码B称为码C的N 次扩展码

8、唯一可译码: 若码的任意一串有限长的码符号序列只能被唯一的译成 所对应的信源符号序列,则称此码为唯一可译码。 9、即时码(瞬时编码):没有一个码字是其他码字的前缀 的唯一可译码称为~。 10、码分类

信源

信源编码器

等效信源 等效信宿

信道编码器

等效干扰 信道

信 道

第三章 信息论基础知识(Part2)

信息论基础知识主要内容:信源的数学模型 信源编码定理 信源编码算法 信道容量 通信的容限第 1 页 2011-2-21引言一、信息论的研究范畴 信息论是研究信息的基本性质及度量方法,研究信息的获取、传输、存储和处理的一般规律的科学。

狭义信息论:通信的数学理论,主要研究信息的度量方 法,各种信源、信道的描述和信源、信道的编码定理。

实用信息论:信息传输和处理问题,也就是狭义信息 论方法在调制解调、编码译码以及检测理论等领域的应用。

广义信息论,包括信息论在自然和社会中的新的应用, 如模式识别、机器翻译、自学习自组织系统、心理学、生物 学、经济学、社会学等一切与信息问题有关的领域。

第 2 页 2011-2-21二、信息论回答的问题通信信道中,信息能够可靠传 输的最高速率是多少?噪声信道编码定理 噪声信道编码定理信息进行压缩后,依然可以从已压 缩信息中以无差错或低差错恢复的 最低速率是多少?香农信源编码理论 香农信源编码理论最佳系统的复杂度是多少?第 3 页2011-2-21三、香农的贡献香农(Claude Elwood Shannon,1916~2001年), 美国数学家,信息论的创始人。

创造性的采用概率论的方法来研究通信中的问题,并且对 信息给予了科学的定量描述,第一次提出了信息熵的概念。

1948年,《通信的数学理论》(A mathematical theory of communication ) 以及1949年,《噪声下的通信》标志了信息论的创立。

1949年,《保密通信的信息理论》,用信息论的观点对信息保密问题做了 全面的论述,奠定了密码学的基础。

1959年,《保真度准则下的离散信源编码定理》,它是数据压缩的数学基 础,为信源编码的研究奠定了基础。

1961年发表“双路通信信道”,开拓了多用户信息理论(网络信息论)的研 究;第 4 页 2011-2-21四、信息论发展历史1924年 奈奎斯特(Nyquist,H.)总结了信号带宽和信息速率之 间的关系。

信息论-第3章+信道的数学数学模型及分类

信道传递概率不同,平均互信息量不同 一定存在一种信道,使平均互信息量最小(0)

第3章 离散信道 及其信息容量

3.1 信道的数学模型及分类 3.2 平均互信息及平均条件互信息 3.3 平均互信息的特性

3.4 信道容量及其一般计算方法 3.5 离散无记忆扩展信道及其信道容量 3.6 独立并联信道及其信道容量 3.7 串联信道的互信息和数据处理定理 3.8 信源与信道的匹配

单用户(两端)信道

一个输入端、一个输出端 必须是单向通信 例:对讲机

多用户(多端)信道

输入输出至少有一端有两个以上用户 可以是双向通信 例:计算机网络

3.1.1 信道的分类 —— 按输入输出的关联分

无反馈信道

输出端无信号反馈到输入端 例:无线电广播

反馈信道

3.4.1 离散无噪信道的信道容量 —— 无损(有噪)信道

H(X)

H(X Y):损失熵

信道

I ( X ;Y )

H (Y )

H(Y X ) :噪声熵

H (X Y ) 0 ,H (YX ) 0

I(X ;Y ) H (X ) H ( Y )

C m { I ( X a ;Y )x } m { H ( X a ) x } lo r g

传递矩阵:

b1

b2

bs

a1 P(b1 a1) P(b2 a1) P(bs a1)

a2 P(b1 a2) P(b2 a2) P(bs a2)

ar P(b1 ar ) P(b2 ar ) P(bs ar )

3.2.1 信道疑义度 —— 先验熵

信源

X

信道

信息论基础第3章离散信道及其信道容量

《信息论基础》

3.6 多符号离散信道及其信道容量

【例】求图所示的二元无记忆离散对称信道的二次 扩展信道的信道容量。

【例】 已知两个独立的随机变量 X、Y 的分布律如下。

X P(x)

a1 0.5

a2 0.5

,

Y P( y)

b1 0.25

b2 b3 0.25 0.5

计算 H X , H Y , H XY , H X |Y , H Y | X , I X ;Y 。

《信息论基础》

3.4 信道容量的定义

I (ai ) 减去已知事件 bj 后对 ai 仍然存在的不确定性 I (ai | bj ) ,实际就是事件

bj 出现给出关于事件 ai 的信息量。

【例】 甲在一个16 16 的方格棋盘上随意放一枚棋

子,在乙看来棋子放入哪一个位置是不确定的。如果甲 告知乙棋子放入棋盘的行号,这时乙获得了多少信息 量?

《信息论基础》

第3章 离散信道及其信道容量

通信系统的基本功能是实现信息的传递,信道是信息 传递的通道,是信号传输的媒质。一般而言,信源发出的 消息,必须以适合于信道传输的信号形式经过信道的传输, 才能被信宿接收。

从信源的角度看,信源发出的每个符号承载的平均信 息量由信源熵来定量描述;而从信宿的角度看,信宿收到 的每个符号平均能提供多少信息量由平均互信息来定量描 述。在信息论中,信道问题主要研究在什么条件下,信道 能够可靠传输的信息量最大,即信道容量问题。

《信息论基础》

3.7 信源与信道的匹配

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

干扰信道。

以下我们只研究无反馈、固定参数的单用户离散信道。

9

信道分类

信息论与编码

第

三 章

❖ 按输入/输出信号之间的关系是否是确定关系:

❖ 无干扰信道:

信 道 与

▪ 输入/输出符号之间有确定的一一对应关系 ❖ 有干扰信道:

信 ▪ 输入/输出之间关系是一种统计依存的关系

道 ❖ 输入/输出的统计关系:

容 量

与 ➢根据输入端和输出端的关联:

信 无反馈信道:输出端信号对输入端信号无影响、无作用。

道 容

有反馈信道:输出端信号会影响输入端信号变化。

量 ➢根据输入输出随机变量个数的多少:

单符号信道:输入和输出端都只用一个随机变量表示。

多符号信道:输入和输出端用随机变量序列/随机矢量表示。

7

信道分类

第 三 ➢根据信道参数与时间的关系: 章 固定参数信道:信道的统计特性不随时间变化而变化。

第

三 ❖信道的功能:以信号形式传输和存储信息。

章 ❖信道传输信息的速率:与物理信道本身的特性、

信 载荷信息的信号形式和信源输出信号的统计特性

道 与

有关。

信 ❖信道容量研究内容:在什么条件下,通过信道的

道 信息量最大。

容

量

2020/11/24

4

信息论与编码

第

三 章

3.1 信道数学模型和分类

信

道

与 信

a r

bs

14

第 三

条件概率p(bj/ai)表示成矩阵形式:

章

信

…

道

b1

b2

bm

与

信

a1 p(b1/a1) p(b2/a1) … p(bm/a1)

道 容

[P]= a2 p(b1/a2) p(b2/a2) … p(bm/a2)

量

……

…… …

an p(b1/an) p(b2/an) … p(bm/an)

3第3章信息论课件

第三章

信道与信道容量

信息论与编码

内容

信息论与编码

第

三

第三章

章 信 3.1 信道数学模型和分类 A

信道与信道容量

道

与 3.2 平均互信息

B

信

道

3.3 离散单个符号信道及其容量

容

C

量

3.4 离散序列信道及其容量

3.5 信源于信道的匹配 D

2020/11/24

3

结束

重点

信息论与编码

3.1.2 信道数学模型

道

容

量

3.1.1 信道分类

2020/11/24

5

信道

信息论与编码

第

三 ❖信道:信息传输的通道

章 ▪ 在通信中,信道按其物理组成常被分成微波信

信

道、光纤信道、电缆信道等。信号在这些信

道

道中传输的过程遵循不同的物理规律, 通信技

与

术必须研究信号在这些信道中传输时的特性

信 道

▪ 信息论不研究信号在信道中传输的物理过程,

p

rs

p11

P

p21

...

pr1

p12 p22

pr2

... ...

...

p1s

p

2

s

...

p rs

18

3.2平均互信息

信息论与编码

第

三 章

❖设有两个随机事件X和Y ,X取值于信源发出的离

❖ 离散无记忆信道:

▪ 用条件概率矩阵来描述。

❖ 离散有记忆信道:

▪ 可像有记忆信源中那样引入状态的概念。

2020/11/24

10

无干扰(无噪声)信道

信息论与编码

第

三 章

❖ 无干扰(无噪声)信道

信 道

▪ 信道的输出信号Y与输入信号X之间有确定的 关系Y=f (X),已知X后就确知Y

与 ▪ 转移概率:

道 与

0 21

信

P 0 p 1 p 0

道 容

1

0

1 q

q

量

0

p

Байду номын сангаас

0

1-p

1-q

2

1

q

1

17

第 三

由此可见,一般单符号离散信道的传递概率可以用矩阵表示:

章

信

道

与 信

b1 b2

道 容

P

a1 a2

p11 p 21

p12 p 22

量

ar

pr1

pr2

bs

... ...

...

p1s

p

2

s

P(bj /ai)pij

道

容

量

2020/11/24

13

3.1.2 信道参数

第 三

单符号离散信道的数学模型

章

信 道

❖ 设输入X∈{a1 … an} ❖ 输出 Y∈{b1 … bm}

与 ❖ 信道转移概率/信道传递概率:条件概率p(bj /ai)。

信 ❖ 其信道模型如图所示。

道

容

a1

b1

量

a

2

b

2

P (b j | ai )

容

并假定信道的传输特性已知,这样信息论就可

量

以抽象地将信道用下图所示的模型来描述。

输入量X (随机过程)

p(Y|X) 信道

输出量Y (随机过程)

2020/11/24

6

3.1.1信道分类

第

三 章

➢ 根据信道用户的多少:

单用户信道:只有一个输入端和一个输出端。

信 道

多用户信道:至少有一端有两个以上的用户,双向通信。

信 道

时变参数信道:信道的统计特性随时间变化而变化。

与 ➢根据信道输入和输出的关系:

信 离散信道:输入、输出随机变量都取离散值。

道 容

连续信道:输入、输出随机变量都取连续值。

量

半离散半连续信道:输入变量取离散值而输出变量取连续值, 或反之。

波形信道

8

信道分类

第

三 ➢根据信道上有无记忆关系: 章 无记忆信道:输出仅与当前输入有关,而与过去输入无关

15

第

三

章 [例1] 二元对称信道(BSC)

信

X={0,1}; Y={0,1}; p(0/0)=p(1/1)=1-p; p(0/1)=p(1/0)=p;

道 与

01

信

P 0 1 p p

道 容

1

p

1

p

量

0 1-p 0

p p

1

1-p 1

16

第

三

章 [例2] 二元删除信道(BEC)

信 X={0,1}; Y={0,2,1}。

道 容

❖ 有干扰无记忆信道可分为:

量

▪ 二进制离散信道

▪ 离散无记忆信道

▪ 离散输入、连续输出信道

▪ 波形信道

2020/11/24

12

信息论与编码

第

三 ❖有干扰有记忆信道

章

一般情况都是如此,例如实际得数字信

信 道 与 信

道中,当信道特性不理想,存在码间干扰时,输 入信号不但与当前得输入信号有关,还和以前的 输入信号有关。

信 的信道。 道 有记忆信道:信道输出不仅与当前输入有关,还与过去输

与 入和(或)过去输出有关。

信 ➢根据信道上有无干扰关系:

道 容 量

有干扰信道:存在干扰或噪声或两者都有的信道。实际 信道一般都是有干扰信道。 无干扰信道:不存在干扰或噪声,或干扰和噪声可忽略

不计的信道。计算机和外存设备之间的信道可看作是无

信

道 容 量

p(Y| X)01,,

Yf(X) Yf(X)

2020/11/24

11

信息论与编码

第

三 ❖有干扰无记忆信道

章 ▪ 信道的输出信号Y与输入信号X之间没有确定

信

的关系,但转移概率满足:

道

与 信

p ( Y |X ) p ( y 1 | x 1 ) p ( y 2 | x 2 ) p ( y L | x L )