信息论试题1

信息论基础理论与应用考试题及答案

信息论基础理论与应用考试题一﹑填空题(每题2分,共20分)1.信息论研究的目的就是要找到信息传输过程的共同规律,以提高信息传输的 (可靠性)﹑(有效性)﹑XX 性和认证性,使信息传输系统达到最优化。

(考点:信息论的研究目的)2.电视屏上约有500×600=3×510个格点,按每点有10个不同的灰度等级考虑,则可组成531010⨯个不同的画面。

按等概计算,平均每个画面可提供的信息量约为(610bit /画面)。

(考点:信息量的概念与计算)3.按噪声对信号的作用功能来分类信道可分为 (加性信道)和 (乘性信道)。

(考点:信道按噪声统计特性的分类)4.英文电报有32个符号(26个英文字母加上6个字符),即q=32。

若r=2,N=1,即对信源S 的逐个符号进行二元编码,则每个英文电报符号至少要用 (5)位二元符号编码才行。

(考点:等长码编码位数的计算)5.如果采用这样一种译码函数,它对于每一个输出符号均译成具有最大后验概率的那个输入符号,则信道的错误概率最小,这种译码规则称为(最大后验概率准则)或(最小错误概率准则)。

(考点:错误概率和译码准则的概念)6.按码的结构中对信息序列处理方式不同,可将纠错码分为(分组码)和(卷积码)。

(考点:纠错码的分类)7.码C={(0,0,0,0),(0,1,0,1),(0,1,1,0),(0,0,1,1)}是((4,2))线性分组码。

(考点:线性分组码的基本概念)8.定义自信息的数学期望为信源的平均自信息量,即(11()log ()log ()()q i i i i H X E P a P a P a =⎡⎤==-⎢⎥⎣⎦∑)。

(考点:平均信息量的定义)9.对于一个(n,k)分组码,其最小距离为d,那么,若能纠正t个随机错误,同时能检测e(e≥t)个随机错误,则要求(d≥t+e+1)。

(考点:线性分组码的纠检错能力概念)10.和离散信道一样,对于固定的连续信道和波形信道都有一个最大的信息传输速率,称之为(信道容量)。

(完整word版)信息论习题集

信息论习题集第一章、判断题1、信息论主要研究目的是找到信息传输过程的共同规律,提高信息传输的可靠性、有效性、保密性和认证性,以达到信息传输系统的最优化。

(√)2、同一信息,可以采用不同的信号形式来载荷;同一信号形式可以表达不同形式的信息。

(√)3、通信中的可靠性是指使信源发出的消息准确不失真地在信道中传输;(√)4、有效性是指用尽量短的时间和尽量少的设备来传送一定量的信息。

(√)5、保密性是指隐蔽和保护通信系统中传送的消息,使它只能被授权接收者获取,而不能被未授权者接收和理解。

(√)6、认证性是指接收者能正确判断所接收的消息的正确性,验证消息的完整性,而不是伪造的和被窜改的。

(√)7、在香农信息的定义中,信息的大小与事件发生的概率成正比,概率越大事件所包含的信息量越大。

(×)第二章一、判断题1、通信中获得的信息量等于通信过程中不确定性的消除或者减少量。

(√)2、离散信道的信道容量与信源的概率分布有关,与信道的统计特性也有关。

(×)3、连续信道的信道容量与信道带宽成正比,带宽越宽,信道容量越大。

(×)4、信源熵是信号符号集合中,所有符号的自信息的算术平均值。

(×)5、信源熵具有极值性,是信源概率分布P的下凸函数,当信源概率分布为等概率分布时取得最大值。

(×)6、离散无记忆信源的N次扩展信源,其熵值为扩展前信源熵值的N倍。

(√)7、互信息的统计平均为平均互信息量,都具有非负性。

(×)8、信源剩余度越大,通信效率越高,抗干扰能力越强。

(×)9、信道剩余度越大,信道利用率越低,信道的信息传输速率越低。

(×)10、信道输入与输出之间的平均互信息是输入概率分布的下凸函数。

(×)11、在信息处理过程中,熵是不会增加的。

(√)12、熵函数是严格上凸的。

(√)13、信道疑义度永远是非负的。

(√)14、对于离散平稳信源,其极限熵等于最小平均符号熵。

信息论与编码期末考试题

信息论与编码期末考试题信息论与编码期末考试题(一)一、判断题.1.当随机变量和相互独立时,条件熵等于信源熵.()2.由于构成同一空间的基底不是唯一的,所以不同的基底或生成矩阵有可能生成同一码集.()3.一般情况下,用变长编码得到的平均码长比定长编码大得多.()4.只要信息传输率大于信道容量,总存在一种信道编译码,可以以所要求的任意小的误差概率实现可靠的通信.()5.各码字的长度符合克拉夫特不等式,是唯一可译码存在的充分和必要条件.()6.连续信源和离散信源的熵都具有非负性.()7.信源的消息通过信道传输后的误差或失真越大,信宿收到消息后对信源存在的不确定性就越小,获得的信息量就越小.8.汉明码是一种线性分组码.()9.率失真函数的最小值是.()10.必然事件和不可能事件的自信息量都是.()二、填空题1、码的检、纠错能力取决于.2、信源编码的目的是;信道编码的目的是.3、把信息组原封不动地搬到码字前位的码就叫做.4、香农信息论中的三大极限定理是、、.5、设信道的输入与输出随机序列分别为和,则成立的条件..6、对于香农-费诺编码、原始香农-费诺编码和哈夫曼编码,编码方法惟一的是.7、某二元信源,其失真矩阵,则该信源的= .三、计算题.1、某信源发送端有2种符号,;接收端有3种符号,转移概率矩阵为.(1)计算接收端的平均不确定度;(2)计算由于噪声产生的不确定度;(3)计算信道容量以及最佳入口分布.2、一阶马尔可夫信源的状态转移图如右图所示,信源的符号集为.(1)求信源平稳后的概率分布;(2)求此信源的熵;(3)近似地认为此信源为无记忆时,符号的概率分布为平稳分布.求近似信源的熵并与进行比较.3、设码符号为,信源空间为试构造一种三元紧致码.4、设二元线性分组码的生成矩阵为.(1)给出该码的一致校验矩阵,写出所有的陪集首和与之相对应的伴随式;(2)若接收矢量,试计算出其对应的伴随式并按照最小距离译码准则试着对其译码.(二)一、填空题1、信源编码的主要目的是,信道编码的主要目的是2、信源的剩余度主要来自两个方面,一是,二是3、三进制信源的最小熵为,最大熵为4、无失真信源编码的平均码长最小理论极限制为5、当时,信源与信道达到匹配。

信息论考试题(填空简答)

一.填空题(每空1分,共20分)1.香农信息论的三个基本概念分别为_______________ 、_____________ 、 ____________ 。

2•对离散无记忆信源来说,当信源呈_______________ 分布情况下,信源熵取最大值。

3•写出平均互信息的三种表达公式________________ 、_____________ 、 ____________ 。

4.若连续信源输出的平均功率和均值被限定,则其输出信号幅度的概率密度函数为______________ 时,信源具有最大熵值;若连续信源输出非负信号的均值受限,则其输出信号幅度呈____________ 分布时,信源具有最大熵值。

5. ________________________________ 信道容量是为了解决通信的_________________________ 问题,而信息率失真函数是为了解决通信的___________ 问题。

6. ______________________________________________________ 费诺编码比较适合于的信源。

7•无记忆编码信道的每一个二元符号输出可以用多个比特表示,理想情况下为实数,此时的无记忆二进制信道又称为__________________________ 。

&差错控制的4种基本方式是:_________________ 、_____________ 、 ____________ 、______________ 。

9 . (n,k)线性码能纠t个错误,并能发现I个错误(l>t),码的最小距离为:10.循环码码矢的i次循环移位等效于将码多项式乘___________________ 后再模______________ 。

二.简答题(每小题5分,共30分)1 •分别说明平均符号熵与极限熵的物理含义并写出它们的数学表达式。

2•写出二进制均匀信道的数学表达式,并画出信道容量C与信道转移概率 p的曲线图。

信息论与编码试卷及答案1

二、综合题(每题10分,共60分)1.黑白气象传真图的消息只有黑色和白色两种,求:1)黑色出现的概率为0.3,白色出现的概率为0.7。

给出这个只有两个符号的信源X的数学模型。

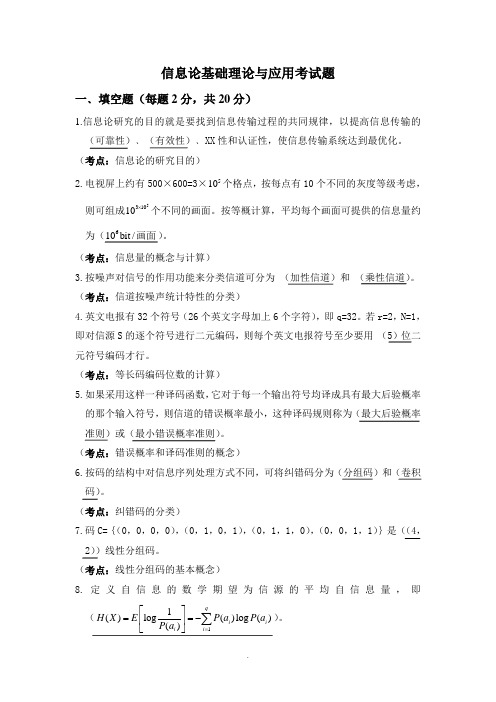

假设图上黑白消息出现前后没有关联,求熵;2)假设黑白消息出现前后有关联,其依赖关系为:,,,,求其熵;2.二元对称信道如图。

;1)若,,求和;2)求该信道的信道容量和最佳输入分布。

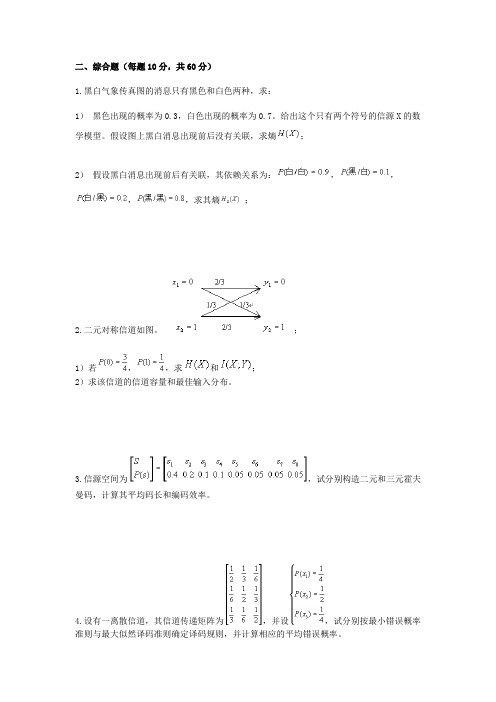

3.信源空间为,试分别构造二元和三元霍夫曼码,计算其平均码长和编码效率。

4.设有一离散信道,其信道传递矩阵为,并设,试分别按最小错误概率准则与最大似然译码准则确定译码规则,并计算相应的平均错误概率。

5.已知一(8,5)线性分组码的生成矩阵为。

求:1)输入为全00011和10100时该码的码字;2)最小码距。

6.设某一信号的信息传输率为5.6kbit/s,在带宽为4kHz的高斯信道中传输,噪声功率谱NO=5×10-6mw/Hz。

试求:(1)无差错传输需要的最小输入功率是多少?(2)此时输入信号的最大连续熵是多少?写出对应的输入概率密度函数的形式。

二、综合题(每题10分,共60分)1.答:1)信源模型为2)由得则2.答:1)2),最佳输入概率分布为等概率分布。

3.答:1)二元码的码字依序为:10,11,010,011,1010,1011,1000,1001。

平均码长,编码效率2)三元码的码字依序为:1,00,02,20,21,22,010,011。

平均码长,编码效率4.答:1)最小似然译码准则下,有,2)最大错误概率准则下,有,5.答:1)输入为00011时,码字为00011110;输入为10100时,码字为10100101。

2)6.答:1)无错传输时,有即则2)在时,最大熵对应的输入概率密度函数为信息论习题集二、填空(每空1分)(100道)1、在认识论层次上研究信息的时候,必须同时考虑到形式、含义和效用三个方面的因素。

2、1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

信息论期末考试试题1.doc

安徽大学2011-2012学年第1学期《信息论》考试试卷(AB合卷)院/系____________ 年级_________ 专业______________ 姓名 _______________ 学号 ____________一、填空题1、接收端收到y后,获得关于发送的符号是的信息量是_______________________ 。

2、香农信息的定义_________________________________________________________ o3、在已知事件zeZ的条件下,接收到y后获得关于事件%的条件互信息/U;>,|z)的表达式为_______________________________________ O4、通信系统模型主要分成五个部分分别为:___________________________________ 。

5、研究信息传输系统的目的就是要找到信息传输过程的共同规律,以提高信息传输的可靠性、有效性、_________ 和 _________,使信息传输系统达到最优化。

6、某信源S共有32个信源符号,其实际熵氏= 1.4比特/符号,则该信源剩余度为________________ o7、信道固定的情况下,平均互信息/(x;r)是输入信源概率分布PU)的_型凸函数。

信源固定的情况下,平均互信息是信道传递概率P(y|x)的_型凸函数。

8、当信源与信道连接时,若信息传输率达到了信道容量,则称此信源与信道达到匹配。

信道剩余度定义为________________________ O9、己知信源X的熵H(X)=0.92比特/符号,则该信源的五次无记忆扩展信源X5的信息嫡H(X5)= _____________ o10、 __________________________________________________________________ 将儿,H b, //0, H4, A从大到小排列为_______________________________________________ 。

最新《信息论》试题及答案

期终练习一、某地区的人群中,10%是胖子,80%不胖不瘦,10%是瘦子。

已知胖子得高血压的概率是15%,不胖不瘦者得高血压的概率是10%,瘦子得高血压的概率是5%,则“该地区的某一位高血压者是胖子”这句话包含了多少信息量。

解:设事件A :某人是胖子; B :某人是不胖不瘦 C :某人是瘦子 D :某人是高血压者根据题意,可知:P (A )=0.1 P (B )=0.8 P (C )=0.1 P (D|A )=0.15 P (D|B )=0.1 P (D|C )=0.05而“该地区的某一位高血压者是胖子” 这一消息表明在D 事件发生的条件下,A 事件的发生,故其概率为P (A|D )根据贝叶斯定律,可得:P (D )=P (A )* P (D|A )+P (B )* P (D|B )+P (C )* P (D|C )=0.1 P (A|D )=P (AD )/P (D )=P (D|A )*P (A )/ P (D )=0.15*0.1/0.1=0.15 故得知“该地区的某一位高血压者是胖子”这一消息获得的多少信息量为: I (A|D ) = - logP (A|D )=log (0.15)≈2.73 (bit ) 二、设有一个马尔可夫信源,它的状态集为{S 1,S 2,S 3},符号集为{a 1,a 2,a 3},以及在某状态下发出符号集的概率是(|)k i p a s (i ,k=1,2,3),如图所示(1)求图中马尔可夫信源的状态极限概率并找出符号的极限概率(2)计算信源处在某一状态下输出符号的条件熵H(X|S=j) (j=s 1,s 2,s 3) (3)求出马尔可夫信源熵H ∞解:(1)该信源达到平稳后,有以下关系成立:13212312123()()31()()()4211()()()42()()()1Q E Q E Q E Q E Q E Q E Q E Q E Q E Q E Q E =⎧⎪⎪=+⎪⎨⎪=+⎪⎪++=⎩可得1232()73()72()7Q E Q E Q E ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩3111322133313()()(|)72()()(|)73()()(|)7i i i i i i i i i p a Q E p a E p a Q E p a E p a Q E p a E =========∑∑∑(2)311113222133331(|)(|)log (|) 1.5bit/(|)(|)log (|)1bit/(|)(|)log (|)0bit/k k k kk k k k k H X S p a S p a S H X S p aS p a S H X S p a S p a S ====-==-==-=∑∑∑(符号)(符号)(符号)(3)31()(|)2/7*3/23/7*12/7*06/7iii H Q E H X E ∞==⨯=++=∑(比特/符号)三、二元对称信道的传递矩阵为0.60.40.40.6⎡⎤⎢⎥⎣⎦(1)若P(0)=3/4,P(1)=1/4,求H (X ),H (X|Y )和I (X ;Y )(2)求该信道的信道容量及其最大信道容量对应的最佳输入分布 解:⑴()H X =21()log ()iii p x p x ==-∑=0.75log 750.25log 25--≈0.811(比特/符号)1111212()()(|)()(|)p y p x p y x p x p y x =+=0.75*0.6+0.25*0.4=0.55 2121222()()(|)()(|)p y p x p y x p x p y x =+=0.75*0.4+0.25*0.6=0.45()0.55log0.550.45log0.45H Y =--=≈0.992(比特/符号)122(|)()(|)()(|)0.75(0.6,0.4)0.25(0.4,0.6)(0.6log 0.60.4log 0.4)0.971/H Y X p x H Y x p x H Y x H H =+=⨯+⨯=-+≈(比特符号)(|)()()()(|)()H X Y H XY H Y H X H Y X H Y =-=+-≈0.811+0.971-0.992=0.79 (比特/符号)I (X ;Y )=H (X )-H (X =0.811-0.79=0.021(比特/符号)(2)此信道为二元对称信道,所以信道容量为C=1-H(p)=1-H(0.6)=1-0.971=0.029(比特/符号) 当输入等概分布时达到信道容量四、求信道22042240p p p p εεεεεε⎡⎤-- ⎢⎥-- ⎢⎥⎣⎦的信道容量,其中1p p =-。

(完整word版)信息论试卷

一、选择题1、下列那位创立了信息论.(C)A.牛顿B.高斯C.香农D.哈夫曼2、下列不属于消息的是。

(B)A.文字B.信号C.图像D.语言3、同时扔两个正常的骰子,即各面呈现的概率都是1/6,若点数之和为2,则得到的自信息量为(B)。

A.-log36 bitB.log36 bitC.-log18 bitD.log18 bit4、下列说法不正确的是(C)A.异字头码肯定是唯一可译的B.逗点码是唯一可译的C.唯一可译码不必满足Kraft 不等式D.无逗点码可以唯一可译5、下述编码中那个可能是任何概率分布对应的Huffman编码(A)A.{0,10,11}B.{00,01,10,110}C.{01,10}D.{001,011,100,101}6、下列物理量不满足非负性的是(D)A.H(X)B.I(X;Y)C.H(Y|X)D.I(x j;y j)7、信源的输出与信道的输入匹配的目的不包括(D)A.符号匹配B.信息匹配C.降低信道剩余度D.功率匹配8、在串联系统中,有效信息量的值(B)A.趋于变大B.趋于变小C.不变D.不确定二、判断题1、信息论研究的主要问题是在通信系统设计中如何实现信息传输、存储和处理的有效性和可靠性。

(T)2、信息是先验概率和后验概率的函数,信息量是事件数目的指数函数。

(F)提示:对数函数3、两个事件之间的互信息量可正,可负,也可能为0。

(T)4、在通讯系统中,无论对接收到的信息怎样处理,信息只会减少,绝不可能增加。

(T )5、Huffman 编码是唯一的.(F)提示:不唯一6、概率大的事件自信息量大。

(F )提示:小7、在事件个数相同条件下,事件等概率出现情况下的熵值最大。

(T)8、平稳的离散无记忆信道不可用一维概率描述。

(F)提示:可以三、填空题1、必然事件的自信息是 0 .2、根据码字所含的码元的个数,编码可分为 等长 编码和 不等长 编码。

3、不等长D 元码,码字最长限定为N,则至多有 D(D N - 1)/(D — 1) 个码字。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

一、填空题(本大题共10小空,每小空1分,共20分)1.按信源发出符号所对应的随机变量之间的无统计依赖关系,可将离散信源分 为 和2.一个八进制信源的最大熵为3.有一信源X ,其概率分布为⎥⎥⎦⎤⎢⎢⎣⎡=⎥⎦⎤⎢⎣⎡414121321x x x P X ,其信源剩余度为 ;若对该信源进行十次扩展,则每十个符号的平均信息量是 。

4.若一连续消息通过放大器,该放大器输出的最大瞬间电压为b ,最小瞬时电压为a 。

若消息从放大器中输出,则该信源的绝对熵是 ;其能在每个自由度熵的最大熵是 ;若放大器的最高频率为F ,则单位时间内输出的最大信息量是 .5. 若某一 信源X ,其平均功率受限为16w ,其概率密度函数是高斯分布时,差熵的最大值为 ;与其熵相等的非高斯分布信源的功率为6、信源编码的主要目的是 ,信道编码的主要目的是 。

7、无失真信源编码的平均码长最小理论极限制为 .8、当 时,信源与信道达到匹配。

9、根据是否允许失真,信源编码可分为 和 。

10、在下面空格中选择填入数学符号“,,,=≥≤〉”或“〈”(1)当X和Y相互独立时,H(XY) H(X)+H(X/Y)。

(2)假设信道输入用X表示,信道输出用Y表示。

在无噪有损信道中,H(X/Y) 0, H(Y/X) 0,I(X;Y) H(X)。

二、(8分)掷两粒骰子,各面出现的概率都是1/6,计算信息量:1.当点数和为3时,该消息包含的信息量是多少?2.当点数和为7是,该消息包含的信息量是多少?3.两个点数中没有一个是1的自信息是多少?三、(12分)设X、Y是两个相互统计独立的二元随机变量,其取-1或1的概率相等。

定义另一个二元随机变量Z,取Z=YX(一般乘积)。

试计算:1.H(Y)、H(Z);2.H(XY)、H(YZ);3.I(X;Y)、I(Y;Z);四、(15分)如图所示为一个三状态马尔科夫信源的转移概率矩阵P=1122 110 22111 424⎛⎫ ⎪ ⎪ ⎪ ⎪ ⎪ ⎪ ⎪⎝⎭1.绘制状态转移图;2.求该马尔科夫信源的稳态分布;3.求极限熵;五、(12分)在干扰离散对称信道上传输符号1和0,已知P(0)=1/4,P(1)=3/4,试求:1. 该信道的转移概率矩阵P2. 信道疑义度H (X|Y )3. 该信道的信道容量以及其输入概率分布六、(10分)某信道的转移矩阵⎥⎦⎤⎢⎣⎡=1.006.03.001.03.06.0P 试求:该信道的信道容量及其最佳输入概率分布。

七、(13分)信源符号X 有六种字母,概率为0.32,0.22,0.18,0.16,0.08,0.04。

用赫夫曼编码法编成二进制变长码,写出编码过程并计算其平均码长、编码后的信息传输率和编码效率。

八、(10分)设在平均功率受限的高斯可加波形信道中,信道带宽为3KHz ,又设信噪比为101.试计算该信道传达的最大信息率(单位时间);2.若功率信噪比降为5dB,要达到相同的最大信息传输率,信道带宽是多少?《信息论基础》答案一、填空题(本大题共10小空,每小空1分,共20分)1.按信源发出符号所对应的随机变量之间的无统计依赖关系,可将离散信源分为有记忆信源和无记忆信源两大类。

2.一个八进制信源的最大熵为3bit/符号3.有一信源X,其概率分布为123x x xX111P244⎛⎫⎡⎤ ⎪=⎢⎥ ⎪⎣⎦⎝⎭,其信源剩余度为94.64%;若对该信源进行十次扩展,则每十个符号的平均信息量是15bit。

4.若一连续消息通过放大器,该放大器输出的最大瞬间电压为b,最小瞬时电压为a。

若消息从放大器中输出,则该信源的绝对熵是∞;其能在每个自由度熵的最大熵是log(b-a)bit/自由度;若放大器的最高频率为F,则单位时间内输出的最大信息量是2Flog (b-a)bit/s.5.若某一信源X,其平均功率受限为16w,其概率密度函数是高斯分布时,差熵的最大值为1log32e2π;与其熵相等的非高斯分布信源的功率为16w≥6、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。

7、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r(S))。

8、当R=C或(信道剩余度为0)时,信源与信道达到匹配。

9、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。

10、在下面空格中选择填入数学符号“,,,=≥≤〉”或“〈”(1)当X和Y相互独立时,H(XY)=H(X)+H(X/Y)。

(2)假设信道输入用X表示,信道输出用Y表示。

在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y)<H(X)。

二、掷两粒骰子,各面出现的概率都是1/6,计算信息量:1.当点数和为3时,该消息包含的信息量是多少?2.当点数和为7是,该消息包含的信息量是多少?3.两个点数中没有一个是1的自信息是多少?解:1.P(“点数和为3”)=P(1,2)+ P(1,2)=1/36+1/36=1/18则该消息包含的信息量是:I=-logP(“点数和为3”)=log18=4.17bit2.P(“点数和为7”)=P(1,6)+ P(6,1)+ P(5,2)+ P(2,5)+ P(3,4)+ P(4,3)=1/36⨯6=1/6则该消息包含的信息量是:I=-logP(“点数和为7”)=log6=2.585bit3.P(“两个点数没有一个是1”)=1-P(“两个点数中至少有一个是1”)=1-P(1,1or1,jori,1)=1-(1/36+5/36+5/36)=25/36则该消息包含的信息量是:I=-logP(“两个点数中没有一个是1”)=log25/36=0.53bit三、设X、Y是两个相互统计独立的二元随机变量,其取-1或1的概率相等。

定义另一个二元随机变量Z,取Z=YX(一般乘积)。

试计算:1.H(Y)、H(Z);2.H(XY)、H(YZ);3.I(X;Y)、I(Y;Z);解:1.2i11111H Y P y logP y log log2222ii=⎡⎤=-+⎢⎥⎣⎦∑()=-()()=1bit/符号Z=YX而且X和Y相互独立∴1(1)(1)(1)P P X P Y P X⋅=+=-⋅=-(Z=1)=P(Y=1)= 111 22 222⨯+⨯=2(1)(1)(1)P P X P Y P X⋅=-+=-⋅=(Z=-1)=P(Y=1)= 111 22 222⨯+⨯=故H(Z)= i2i1(z )log (z )i P P =-∑=1bit/符号2.从上式可以看出:Y 与X 的联合概率分布为:H(YZ)=H(X)+H(Y)=1+1=2bit/符号 3.X 与Y 相互独立,故H(X|Y)=H(X)=1bit/符号∴I (X;Y )=H(X)-H(X|Y)=1-1=0bit/符号I(Y;Z)=H(Y)-H(Y|Z)=H(Y)-[H(YZ)-H(Z)]=0 bit/符号四、如图所示为一个三状态马尔科夫信源的转移概率矩阵P=1102211022111424⎛⎫ ⎪ ⎪ ⎪ ⎪ ⎪ ⎪ ⎪⎝⎭4. 绘制状态转移图;5. 求该马尔科夫信源的稳态分布;6. 求极限熵;解:1.状态转移图如右图 2.由公式31()()(|)j iji i p E P E P EE ==∑,可得其三个状态的稳态概率为:1123223313123111()()()()22411()()()2211()()()24()()()1P E P E P E P E P E P E P E P E P E P E P E P E P E ⎧=++⎪⎪⎪=+⎪⎨⎪=+⎪⎪⎪++=⎩1233()72()72()7P E P E P E ⎧=⎪⎪⎪⇒=⎨⎪⎪=⎪⎩3.其极限熵:3i i 13112112111H = -|E =0+0+72272274243228=1+1+ 1.5=bit/7777i P H H H H ∞=⨯⨯⨯⨯⨯⨯∑(E )(X )(,,)(,,)(,,)符号五、在干扰离散对称信道上传输符号1和0,已知P (0)=1/4,P(1)=3/4,试求:4. 该信道的转移概率矩阵P5. 信道疑义度H (X|Y )6. 该信道的信道容量以及其输入概率分布解:1.该转移概率矩阵为 P=0.90.10.10.9⎡⎤⎢⎥⎣⎦2.根据P (XY )=P (Y|X )⋅P (X ),可得联合概率由P (X|Y )=P(X|Y)/P(Y)可得H(X|Y)=-i jiji j(x y )log x |y =0.09+0.12+0.15+0.035=0.4bit/P P∑,()符号 3.该信道是对称信道,其容量为:C=logs-H=log2-H (0.9,0.1)=1-0.469=0.531bit/符号这时,输入符号服从等概率分布,即0111()22X P X ⎡⎤⎡⎤⎢⎥=⎢⎥⎢⎥⎣⎦⎣⎦六、某信道的转移矩阵⎥⎦⎤⎢⎣⎡=1.006.03.001.03.06.0P试求:该信道的信道容量及其最佳输入概率分布。

解:该信道是准对称信道,分解为两个互不相交的子信道矩阵0.60.30.30.6⎡⎤⎢⎥⎣⎦0.1000.1⎡⎤⎢⎥⎣⎦ 这里110.90.9N M == 220.10.1N M == ∴C=logr-H(P 的行矢量)-2k 1log 1(0.6.3.1)0.9log 0.9-0.1log 0.1KK NM H ==--⨯⨯∑,0,0=0.174bit/符号这时,输入端符号服从等概率分布,即()X P X ⎡⎤⎢⎥⎣⎦=011122⎡⎤⎢⎥⎢⎥⎣⎦七、信源符号X 有六种字母,概率为0.32,0.22,0.18,0.16,0.08,0.04。

用赫夫曼编码法编成二进制变长码,写出编码过程并计算其平均码长、编码后的信息传输率和编码效率。

解:该信源在编码之前的信源熵为:6i i 1()(x )log x i H S P P ==-∑()=0.526+0.481+0.445+0.423+0.292+0.186=2.353bit/符号编码后的平均码长:(0.320.220.18)20.163(0.080.04)4L =++⨯+⨯++⨯=2.4码元/信源符号编码后的信息传输率为:() 2.3530.982.4H S R L===bit/码元编码效率为:max ()0.98log R H S R L rη=== 八、设在平均功率受限的高斯可加波形信道中,信道带宽为3KHz ,又设信噪比为101.试计算该信道传达的最大信息率(单位时间);2.若功率信噪比降为5dB ,要达到相同的最大信息传输率,信道带宽是多少? 解:1. 10d SNR B = 10SNR ∴=故:该信道传送的最大信息速率为:3t 4=log +log =bit/s C W ⨯⨯⨯(1SNR )=310(11)1.04102.若SNR=5dB ,则,在相同t C 情况下1.04410⨯=Wlog (1+SNR )=Wlog4.162⇒W=5.04⨯310Hz。