图像灰度化

处理灰度照片的方法

处理灰度照片的方法

处理灰度照片的方法有以下几种:

1. 灰度化:将彩色照片转换为灰度图像。

可以使用公式将彩色图像的RGB通道值进行加权平均,或者使用专门的灰度转换算法,如使用YUV颜色空间中的亮度分量进行灰度化。

2. 对比度调整:可以通过直方图均衡化或对比度拉伸等方法来增强图像的对比度。

直方图均衡化是一种常用的方法,它通过重新分配图像的灰度级来增强图像的对比度。

3. 滤波处理:可以使用各种滤波器对图像进行平滑或锐化处理。

常用的滤波器包括均值滤波器、高斯滤波器、中值滤波器等。

4. 边缘检测:可以使用边缘检测算法,如Sobel算子、Canny算子等,来提取图像中的边缘信息。

5. 图像修复:可以使用图像修复算法来修复灰度图像中的缺失或损坏的部分。

常用的图像修复算法包括基于纹理合成、基于图像修复模型等方法。

6. 图像增强:可以使用各种图像增强算法来增强图像的细节和清晰度,如锐化、增强边缘等。

以上是一些常用的处理灰度照片的方法,具体选择哪种方法取决于具体的应用需求和图像处理的目标。

彩色图像的灰度化处理

第1章绪论1.1数字图像数字图像,又称数码图像或数位图像,是二维图像用有限数字数值像素的表示。

数字图像是由模拟图像数字化得到的、以像素为基本元素的、可以用计算机或数字电路存储和处理的图像。

像素(或像元,Pixel)是数字图像的基本元素,像素是在模拟图像数字化时对连续空间进行离散化得到的。

每个像素具有整数行(高)和列(宽)位置坐标,同时每个像素都具有整数灰度值或颜色值。

通常,像素在计算机中保存为二维整数数阻的光栅图像,这些值经常用压缩格式进行传输和储存。

数字图像可以许多不同的输入设备和技术生成,例如数码相机、扫描仪、坐标测量机、seismographic profiling、airborne radar等等,也可以从任意的非图像数据合成得到,例如数学函数或者三维几何模型,三维几何模型是计算机图形学的一个主要分支。

数字图像处理领域就是研究它们的变换算法。

1.2设计平台本次设计采用的平台是MATLAB 7.0。

MATLAB编程语言被业界称为第四代计算机语言,它允许按照数学推导的习惯编写程序。

MATLAB7.0的工作环境包括当前工作窗口、命令历史记录窗口、命令控制窗口、图形处理窗口、当前路径选择菜单、程序编辑器、变量查看器、模型编辑器、GUI编辑器以及丰富的函数库和MATLAB附带的大量M文件。

MATLAB是由美国Math Works公司生产的一个为科学和工程计算专门设计的交互式大型软件,是一个可以完成各种计算和数据处理的、可视化的、强大的计算工具。

它集图示和精确计算于一身,在应用数学、物理、化工、机电工程、医药、金融和其他需要进行复杂计算的领域得到了广泛应用。

MATLAB作为一种科学计算的高级语言之所以受欢迎,就是因为它有丰富的函数资源和工具箱资源,编程人员可以根据自己的需要选择函数,而无需再去编写大量繁琐的程序代码,从而减轻了编程人员的工作负担,被称为第四代编程语言。

在MATLAB设计环境中,图像处理工具箱提供一套全方位的参照标准算法和图形工具,用于进行图像处理、分析、可视化和算法开发。

彩色图像多尺度融合灰度化算法

2021574彩色图像灰度化是图像处理和计算机视觉领域的基本课题和重要前提,是将三维通道信息转换为一维灰度数据的过程。

为了节约成本,人们仍使用黑白打印,并且许多出版物的大部分图片是灰度图像。

生活中还存在很多更有艺术效果的黑白图像,由此衍生了灰度图像在艺术美学方面的应用,如中国水墨画渲染、黑白摄影等[1]。

为了减少输入图像的信息量或者减少后续的运算量,都需要将彩色图像进行灰度化处理,其在图像预处理等方面有很多应用,如边缘检测[2-3]、特征提取[4-5]等。

为了使灰度化后的图像更好地保留彩色图像特征,许多方法被相继提出。

根据算法中映射函数是否可应用于整幅图像的所有像素,常见的灰度化算法大致可以分为两类:全局映射法和局部映射法。

在局部映射法中,灰度值随着空间位置而改变,将不同的灰度值赋给相同的颜色以增强灰度图像局部对比度,容易受相邻像素的影响。

2004年,Bala等人[6]将高频色度信息引入亮度通道,局部保留了相邻颜色之间的差异。

Smith等人[7]使用拉普拉斯金字塔提取图像多层特征,根据彩色与灰度图像色对比度比例来调整拉普拉斯各分层灰度值,增强不明显的边缘,进行对比度调整。

卢红阳等人[8]提出一种基于最大加权投影求解的算法,建立最大化的加权局部保留投影模型,提出最大加权投影的目标优化函数。

局部映射法试图找出颜色在三维的局部差异,通过控制像素的亮度值,从而精确地保留图像的局部特征,但无法保证全局颜色的一致性,把一个整体图像转换为非齐次的,最终求出的灰度图像彩色图像多尺度融合灰度化算法顾梅花,王苗苗,李立瑶,冯婧西安工程大学电子信息学院,西安710600摘要:为了使彩色图像灰度化后能够保留更多的原始特征,提出了一种新的基于多尺度图像融合的灰度化算法。

将彩色图像分解为R、G、B三个通道图像,采用基于高斯-拉普拉斯金字塔的多尺度图像融合模型进行灰度化,并引入梯度域导向图像滤波(Gradient Domain Guided Image Filter,GGIF)来消除多尺度融合可能产生的伪影。

人脸识别技术中图像处理的关键步骤分析

人脸识别技术中图像处理的关键步骤分析人脸识别技术是一种利用计算机视觉和模式识别技术来识别和验证人脸的技术。

它已经被广泛应用于各个领域,包括安全监控、人机交互、金融服务等。

而在人脸识别技术中,图像处理是实现准确识别的关键步骤之一。

本文将分析人脸识别技术中图像处理的关键步骤。

1. 图像灰度化人脸识别的第一步是将输入的彩色图像转换成灰度图像。

这是因为灰度图像只包含亮度信息,而不包含颜色信息。

相比于彩色图像,灰度图像在计算上更加简单,并且能够减小计算量,提高识别的效率。

通过将彩色图像的红、绿、蓝三个通道的像素值按照一定比例进行加权求和,可以得到灰度图像。

2. 图像对齐由于拍摄条件的不同,人脸图像可能存在旋转、倾斜等问题,这将影响人脸识别的准确性。

因此,图像对齐是人脸识别中的一项重要步骤。

图像对齐的主要目的是将输入的人脸图像进行旋转、平移和缩放等操作,使得人脸的位置和大小在整个图库中保持相对一致。

常见的方法包括通过检测人脸关键点进行对齐,或者使用基于几何变换的方法进行对齐。

通过图像对齐,可以保证在后续的特征提取和匹配过程中,人脸的位置和姿态保持一致,提高识别的准确率。

3. 人脸检测在人脸识别中,首先需要确定图像中是否存在人脸。

因此,人脸检测是人脸识别的关键步骤之一。

人脸检测算法通过分析图像中的像素值和纹理信息,识别出可能是人脸的区域。

常见的人脸检测算法包括基于特征的方法和基于机器学习的方法。

其中,基于特征的方法利用人脸的几何和纹理特征进行检测,而基于机器学习的方法通过训练大量的人脸和非人脸样本,构建分类器来进行人脸检测。

人脸检测的准确性和速度将直接影响到后续的人脸识别效果。

4. 人脸对齐在人脸检测的基础上,对检测到的人脸进行进一步处理,使得人脸在图像中的位置和姿态尽可能一致。

人脸对齐的目标是将图像中检测到的人脸对齐到一个标准位置和大小。

通过对检测到的人脸进行旋转、平移和缩放等操作,使得人脸的轮廓和关键点位置在整个图库中保持一致。

AVIZO图像处理

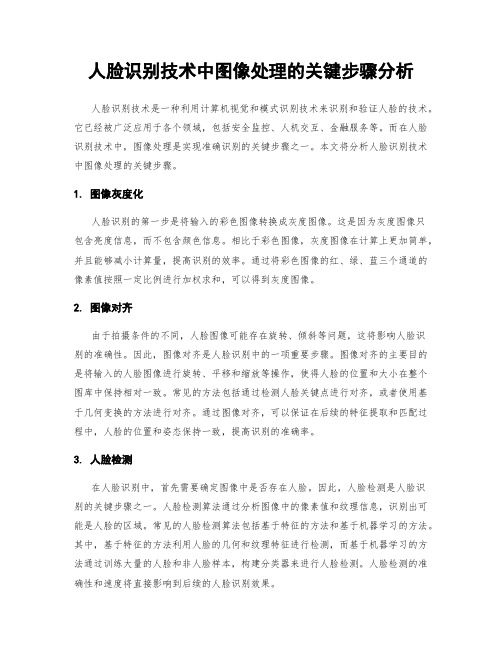

将彩色图像转化成为灰度图像的过程成为图像的灰度化处理。

彩色图像中的每个像素的颜色由R、G、B三个分量决定,而每个分量有255个值可取,这样一个像素点可以有1600多万(255*255*255)的颜色的变化范围。

而灰度图像是R、G、B三个分量相同的一种特殊的彩色图像,其一个像素点的变化范围为255种,所以在数字图像处理种一般先将各种格式的图像转变成灰度图像以使后续的图像的计算量变得少一些。

灰度图像的描述与彩色图像一样仍然反映了整幅图像的整体和局部的色度和亮度等级的分布和特征。

图像的灰度化处理:求出每个像素点的R、G、B三个分量的平均值,然后将这个平均值赋予给这个像素的三个分量。

将原来的RGB(R,G,B)中的R,G,B统一用Gray替换,形成新的颜色RGB(Gray,Gray,Gray),用它替换原来的RGB(R,G,B)就是灰度图了。

人的眼睛看到的颜色有两种:⒈一种是发光体发出的颜色,比如计算机显示器屏幕显示的颜色;⒉另一种是物体本身不发光,而是反射的光产生的颜色,比如看报纸和杂志上的颜色。

我们又知道任何颜色都是由三种最基本的颜色叠加形成的,这三种颜色称为“三原色”。

⒈对于上面提到的第一种颜色,即发光体的颜色模式,又称为“加色模式”,三原色是“红”、“绿”、“蓝”三种颜色。

加色模式又称为“RGB模式”;⒉而对于印刷品这样的颜色模式,又称为“减色模式”,它的三原色是“青”、“洋红”、“黄”三种颜色。

减色模式又称为“CMY”模式。

在网页上要指定一种颜色,就要使用RGB模式来确定,方法是分别指定R/G/B,也就是红/绿/蓝三种原色的强度,通常规定,每一种颜色强度最低为0,最高为255,并通常都以16进制数值表示,那么255对应于十六进制就是FF,并把三个数值依次并列起来,以#开头。

例如,颜色值“#FF0000”为红色,因为红色的值达到了最高值FF(即十进制的255),其余两种颜色强度为0。

在例如“#FFFF00”表示黄色,因为当红色和绿色都为最大值,且蓝色为0时,产生的就是黄色。

图像处理:数字图像的灰度直方图均衡化

图像处理:数字图像的灰度直方图均衡化简介在数字图像处理中,灰度直方图均衡化是一种常用的图像增强技术。

它通过重新分配图像中各个灰度级的像素值,使得最终的灰度直方图呈现出更均匀分布的特点,从而提高图像的对比度和视觉效果。

原理灰度直方图是描述一幅图像中每个灰度级出现频次的统计直方图。

在灰度直方图均衡化过程中,首先需要计算原始图像的累积概率密度函数(CDF),然后利用CDF进行线性变换将原始像素值映射到新的像素值上。

这个线性变换可以通过以下公式表示:G' = (G_max - G_min) \times CDF(G) + G_min其中G'是新的像素值,G是原始的像素值,G_max和G_min分别为像素值范围最大和最小值,而CDF(G)则是原始图像中小于或等于G的累积概率密度函数。

实现步骤1.读取待处理的数字图像。

2.将彩色或多通道图转化为灰度图。

3.计算原始灰度图像的像素值的频次统计,得到原始灰度直方图。

4.计算原始灰度直方图的累积概率密度函数。

5.根据累积概率密度函数进行线性变换,将原始像素值映射到新的像素值上。

6.生成处理后得到的均衡化后的图像。

7.输出均衡化后的图像。

应用场景灰度直方图均衡化在许多领域都有广泛应用,例如医学影像分析、计算机视觉和数字摄影等。

其主要作用是增强图像对比度、改善细节和提升视觉效果。

同时,该技术也能够在一些特定场景下帮助识别和检测对象。

总结通过使用灰度直方图均衡化技术,可以使得数字图像中各个灰度级的像素值更加均匀分布,从而提高图像对比度和视觉效果。

这种方法在数字图像处理中具有广泛的应用,并且简单易实现。

然而,需要注意的是,在某些特定情况下,采用该方法可能会产生过度增强或引入噪声等问题,因此在实际应用中需要谨慎使用并结合其他处理方法进行综合处理。

(3)图像处理-24位真彩色图像灰度化

图像灰度化令gray=0.299*Red+0.587*Green+0.114*Blue再令每个像素点的三个颜色分量均等于对应的gray,即完成了图像灰度化具体代码如下:void CDipView::Gray(){CDipDoc*pDoc=GetDocument();if(!(pDoc->m_pBmi&&pDoc->m_pBmData)){MessageBox(_T("No Object"),MB_OK);}else{int i_top=pDoc->m_pBmi->bmiHeader.biHeight;//图像高度int j_top=pDoc->m_pBmi->bmiHeader.biWidth*3;//图像每行有效字节数int w=pDoc->m_pBmi->bmiHeader.biSizeImage/i_top;//图像每行总字节数for(int i=0;i<i_top;i++){for(int j=0;j<j_top;j+=3){BYTE gray=(BYTE)(pDoc->m_pBmData[i*w+j+2]*0.299+pDoc->m_pBmData[i*w+j+1]*0.587+pDoc->m_pBmData[i*w+j]*0.114);pDoc->m_pBmData[i*w+j]=gray;pDoc->m_pBmData[i*w+j+1]=gray;pDoc->m_pBmData[i*w+j+2]=gray;}}Invalidate();}}若图像为标准规格图像则可将上述循环改为int i_top=pDoc->m_pBmi->bmiHeader.biHeight*pDoc->m_pBmi->bmiHeader.biWidth*3;for(int i=0;i<i_top;i+=3){BYTE gray=(BYTE)(pDoc->m_pBmData[i+2]*0.299+pDoc->m_pBmData[i+1]*0.587+pDoc->m_pBmData[i]*0.114);pDoc->m_pBmData[i]=gray;pDoc->m_pBmData[i+1]=gray;pDoc->m_pBmData[i+2]=gray;}注:如无特殊说明,以后各处理是对24位真彩色图像的处理。

灰度图像二值化处理

内蒙古科技大学本科毕业论文二〇一二年四月摘要本文介绍了图像及数字图像处理技术的一些概念和相关知识;还介绍了灰度图像和图像二值化的概念及其表示形式;对图像灰度化和图像二值化的优缺点作了简单的的介绍;重点介绍了灰度图像的二值化方法研究,其包括的内容有二值化研究动态和研究方法;对全局阈值法;局部阈值法这两种方法进行了研究讨论。

关键字:图像处理、二值化、图像、阈值AbstractThis paper introduces the image and digital image processing technology of some concepts and related knowledge; also introduced the gray-scale image and the images of the two values of the concept and its representation; grayscale images and images of the two values of the advantages and disadvantages to make simple introduction; mainly introduces two gray image binarization method, its includes the contents of two values of research and research methods; the global threshold method; local threshold method, the two methods are discussed. Keywords:image processing, image, threshold value of two,目录引言 (5)1.灰度图像与二值图像 (6)1.1图像 (6)1.2数字图像 (6)1.2.1彩色图像 (6)1.2.2灰度图像 (7)1.2.3二值图像 (7)2.灰度图像二值化方法研究 (8)2.1全局阈值法 (8)2.1.1全局阈值法的概念 (8)2.1.2全局阈值法的方法 (9)2.1.3全局阈值法的优缺点介绍及阈值选取 (11)2.2局部阈值法 (11)2.2.1局部阈值法的概念 (11)2.2.2局部阈值法的方法 (12)2.2.3局部阈值法的优缺点介绍 (12)3.灰度图像二值化的应用 (12)结束语 (14)参考文献 (15)致谢 (16)引言图像二值化是图像处理中的一项基本技术,也是很多图像处理技术的预处理过程。

数字图像处理基本操作及灰度调整实验报告

数字图像处理基本操作及灰度调整实验报告实验目的1.掌握数字图像处理的基本概念和原理。

2.学会使用Python编程语言进行图像处理。

3.理解并实现图像灰度调整的方法。

4.分析实验结果,讨论图像处理方法的优缺点。

2.1 数字图像处理概述数字图像处理(Digital Image Processing,DIP)是一门研究使用计算机对图像进行处理的技术。

它的目的是改善图像的质量,使之更适合人类或计算机对图像进行观察和分析。

数字图像处理涉及到图像采集、存储、传输、分析以及图像的恢复等方面。

2.2 图像的表示和描述数字图像由图像元素(像素)组成,每个像素有一个对应的灰度值。

灰度值表示像素的亮度,通常用8位二进制数表示,其范围为0~255。

像素的灰度值越高,亮度越高。

数字图像可以表示为一个矩阵,矩阵中的每个元素对应一个像素的灰度值。

彩色图像通常采用RGB颜色模型,每个像素包含三个分量,分别对应红色、绿色和蓝色通道的亮度。

2.3 图像灰度调整图像灰度调整是指调整图像像素的灰度值,以改善图像的质量。

常用的图像灰度调整方法有:1.线性灰度变换:通过线性映射关系改变图像灰度值,可以实现图像亮度的调整和对比度的拉伸。

2.直方图均衡化:通过调整图像的灰度直方图,使其均匀分布,可以提高图像的对比度。

•操作系统:Windows 10•编程语言:Python 3.8•图像处理库:OpenCV 4.5.2•集成开发环境:Visual Studio Code4.1 图像读取和显示首先,我们需要使用OpenCV库读取和显示图像。

以下是读取和显示图像的Python代码:4.2 图像灰度化为了便于后续的灰度调整操作,我们需要将彩色图像转换为灰度图像。

以下是图像灰度化的Python代码:4.3 灰度调整接下来,我们将对图像进行灰度调整。

首先,实现线性灰度变换。

以下是线性灰度变换的Python代码:4.4 图像直方图均衡化直方图均衡化是一种能够提高图像对比度的方法。

【数字图像处理】灰度图像二值化

【数字图像处理】灰度图像⼆值化灰度图像每副图像的每个像素对应⼆维空间中⼀个特定的位置,并且有⼀个或者多个与那个点相关的采样值组成数值。

灰度图像,也称为灰阶图像,图像中每个像素可以由0(⿊)到255(⽩)的亮度值(Intensity)表⽰。

0-255之间表⽰不同的灰度级。

灰度图像⼆值化⼆值化:以⼀个值(阈值)为基准,⼤于(等于)这个值的数全部变为是1(或者0),⼩于等于这个数的就全部将他们变为0(或1)。

⼆值化算法处理飞思卡尔赛道思路:设定⼀个阈值valve,对于图像矩阵中的每⼀⾏,从左⾄右⽐较各像素值和阈值的⼤⼩,若像素值⼤于或等于阈值,则判定该像素对应的是⽩⾊赛道;反之,则判定对应的是⿊⾊的⽬标引导线。

记下第⼀次和最后⼀次出现像素值⼩于阈值时的像素点的列号,算出两者的平均值,以此作为该⾏上⽬标引导线的位置。

摄像头的⼆值化的代码:Void image_binaryzation(){for(int i=0;i{for(int j=0;j{if(Image[i][j] >= Threshold)Image_new[i][j]=1;elseImage_new[i][j]=0;}}}Row是对应采集到的⾏数,Col是列数,Image[i][j]是摄像头采集未⼆值化的数据存放的数组,Img[i][j]是新建的存放⼆值化后的数组。

合适的阈值在阈值⼆值化中,最主要的是选取合适的阈值,这也是⼆值化的难点所在。

常⽤的⼆值化阈值选取⽅法有双峰法、p参数法、⼤律法(Otsu法)、最⼤熵阈值法、迭代法等。

⼤律法(Otsu法)Otsu⽅法⼜名最⼤类间差⽅法,通过统计整个图像的直⽅图特性来实现全局阈值T的⾃动选取,其算法步骤为:1) 先计算图像的直⽅图,即将图像所有的像素点按照0~255共256个bin,统计落在每个bin的像素点数量2) 归⼀化直⽅图,也即将每个bin中像素点数量除以总的像素点3) i表⽰分类的阈值,也即⼀个灰度级,从0开始迭代4) 通过归⼀化的直⽅图,统计0~i 灰度级的像素(假设像素值在此范围的像素叫做前景像素) 所占整幅图像的⽐例w0,并统计前景像素的平均灰度u0;统计i~255灰度级的像素(假设像素值在此范围的像素叫做背景像素) 所占整幅图像的⽐例w1,并统计背5) 计算前景像素和背景像素的⽅差 g = w0*w1*(u0-u1) (u0-u1)6) i++;转到4),直到i为256时结束迭代7)将最⼤g相应的i值作为图像的全局阈值缺陷:OSTU算法在处理光照不均匀的图像的时候,效果会明显不好,因为利⽤的是全局像素信息。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

图像灰度化图像灰度化原理:关于YUV空间的彩色图像,其Y的分量的物理意义本身就是像素点的亮度,由该值反映亮度等级,因此可根据RGB和YUV颜色空间的变化关系建立亮度Y与R、G、B三个颜色分量的对应:Y=0.299R+0.587G+0.114B,以这个亮度值表达图像的灰度值图像处理结果:程序代码:char *pmydata; //定义一个指针用来指向位图图像数据在内存中的存储区域//long wide, high;BITMAP bm;pbmp->GetBitmap(&bm);pmydata=new char[bm.bmWidthBytes*bm.bmHeight]; //根据位图的高度宽度初始化一下pbmp->GetBitmapBits(bm.bmWidthBytes*bm.bmHeight,pmydata); //将位图对象的数据COPY到pmydata指向的区域,m_bm是位图对象,bm是位图结构,可参考上一篇文章的定义for(int i=0;i<bm.bmWidthBytes*bm.bmHeight;i+=4) //因为一个像素有4个字节,故i+=4{ char Y=0;Y=(pmydata[i]*0.299+pmydata[i+1]*0.5876+pmydata[i+2]*0.114);pmydata[i]=Y;//Rpmydata[i+1]=Y;//Gpmydata[i+2]=Y;//B}pbmp->SetBitmapBits(bm.bmWidthBytes*bm.bmHeight,pmydata); //将处理后的数据COPY进位图对象DrawBmp();图像均值化图像均值化原理:图通常是最能说明问题的东西,非常明显的,这个3*3区域像素的颜色值分别是5,3,6,2,1,9,8,4,7那么中间的1这个像素的过滤后的值就是这些值的平均值,也就是前面的计算方法:(5+3+6+2+1+9+8+4+7)/9=5,图像处理结果:程序代码:void CMyDIPView::OnMenuitem32778(){// TODO: Add your command handler code here CMyDIPDoc* pDoc = GetDocument();//设定模板参数double tem[9]={1,1,1,1,1,1,1,1,1};//设定模板系数double xishu = 1.0/9.0;//进行模板操作pDoc->m_hDIB =Template(pDoc->m_hDIB,tem ,3,3, xishu);//调用Template函数,对图像进行模板操作)Invalidate(TRUE);}HDIB Template(HDIB hDIB,double * tem ,int tem_w,int tem_h,double xishu) {//统计中间值double sum;//指向图像起始位置的指针BYTE *lpDIB=(BYTE*)::GlobalLock((HGLOBAL) hDIB);//指向象素起始位置的指针BYTE *pScrBuff =(BYTE*)::FindDIBBits((char*)lpDIB);//获取图像的颜色信息int numColors=(int) ::DIBNumColors((char *)lpDIB);//如果图像不是256色返回if (numColors!=256){//解除锁定::GlobalUnlock((HGLOBAL) hDIB);//返回return(hDIB);}//将指向图像象素起始位置的指针,赋值给指针变量BYTE* oldbuf = pScrBuff;//循环变量int i,j,m,n;int w, h, dw;//获取图像的宽度w = (int) ::DIBWidth((char *)lpDIB);//获取图像的高度h = (int) ::DIBHeight((char *)lpDIB);//计算图像每行的字节数dw = (w+3)/4*4;//建立一个和原图像大小相同的25色灰度位图HDIB newhDIB=NewDIB(w,h,8);//指向新的位图的指针BYTE *newlpDIB=(BYTE*)::GlobalLock((HGLOBAL) newhDIB);//指向新的位图的象素起始位置的指针BYTE *destBuf = (BYTE*)FindDIBBits((char *)newlpDIB);//将指向新图像象素起始位置的指针,赋值给指针变量BYTE *newbuf=destBuf;//对图像进行扫描//行for(i=0;i<h;i++){//列for(j=0;j<w;j++){//为统计变量赋初始值sum=0;//对于图像的4个边框的象素保持原灰度不变if( j<((tem_w-1)/2) || j>(w-(tem_w+1)/2) || i<((tem_h-1)/2) || i>(h-(tem_h+1)/2) )*(newbuf+i*dw+j)=*(oldbuf+i*dw+j);//对于其他的象素进行模板操作else{//将点(i,j)点作为模板的中心for(m=i-((tem_h-1)/2);m<=i+((tem_h-1)/2);m++){for(n=j-((tem_w-1)/2);n<=j+((tem_w-1)/2);n++)//将以点(i,j)为中心,与模板大小相同的范围内的象素与模板对用位置的系数//进行相乘并线形叠加sum+=*(oldbuf+m*dw+n)*tem[(m-i+((tem_h-1)/2))*tem_w+n-j+((tem_w-1)/2)];}//将结果乘上总的模板系数sum=(int)sum*xishu;//计算绝对值sum = fabs(sum);//如果小于0,强制赋值为0if(sum<0)sum=0;//如果大于255,强制赋值为255if(sum>255)sum=255;//将计算的结果放到新的位图的相应位置*(newbuf+i*dw+j)=sum;}}}//解除锁定::GlobalUnlock((HGLOBAL)hDIB);//返回新的位图的句柄return(newhDIB);}图像的锐化图像处理结果:程序代码:能:* 现图像的梯度锐化*说明:* 只能对2值图像进行处理,如果图像本身边缘较细,可能造成信息的损失********************************************************************* */void GradientSharp(HDIB hDIB){// 指向DIB的指针LPSTR lpDIB=(LPSTR) ::GlobalLock((HGLOBAL)hDIB); // 指向DIB象素指针LPSTR lpDIBBits;// 找到DIB图像象素起始位置lpDIBBits = ::FindDIBBits(lpDIB);//获取图像的宽度LONG lWidth=::DIBWidth ((char*)lpDIB);//获取图像的长度LONG lHeight=::DIBHeight ((char*)lpDIB);// 阈值BYTE bThre = 2;// 调用GradSharp()函数进行梯度板锐化// 指向源图像的指针unsigned char* lpSrc;unsigned char* lpSrc1;unsigned char* lpSrc2;// 循环变量LONG i;LONG j;// 图像每行的字节数LONG lLineBytes;// 中间变量BYTE bTemp;// 计算图像每行的字节数lLineBytes = WIDTHBYTES(lWidth * 8);// 每行for(i = 0; i < lHeight; i++){// 每列for(j = 0; j < lWidth; j++){// 指向DIB第i行,第j个象素的指针lpSrc = (unsigned char*)lpDIBBits + lLineBytes * (lHeight - 1 - i) + j;// 指向DIB第i+1行,第j个象素的指针lpSrc1 = (unsigned char*)lpDIBBits + lLineBytes * (lHeight - 2 - i) + j;// 指向DIB第i行,第j+1个象素的指针lpSrc2 = (unsigned char*)lpDIBBits + lLineBytes * (lHeight - 1 - i) + j + 1;//计算梯度值bTemp = abs((*lpSrc)-(*lpSrc1)) + abs((*lpSrc)-(*lpSrc2));// 判断是否小于阈值if (bTemp < 255){// 判断是否大于阈值,对于小于情况,灰度值不变。

if (bTemp >= bThre){// 直接赋值为bTemp*lpSrc = bTemp;}}else{// 直接赋值为255*lpSrc = 255;}}}//最后还要处理一下图像中最下面那行for(j = 0; j < lWidth; j++){//指向最下边一行,第j个象素的指针lpSrc = (unsigned char*)lpDIBBits + lLineBytes * 0 + j;//将此位置的象素设置为255,即白点*lpSrc=255;}//解除锁定::GlobalUnlock ((HGLOBAL)hDIB);}。