BP神经网络模型简介及相关优化案例

BP神经网络步骤及应用实例

1、数据归一化2、数据分类,主要包括打乱数据顺序,抽取正常训练用数据、变量数据、测试数据3、建立神经网络,包括设置多少层网络(一般3层以内既可以,每层的节点数(具体节点数,尚无科学的模型和公式方法确定,可采用试凑法,但输出层的节点数应和需要输出的量个数相等),设置隐含层的传输函数等。

关于网络具体建立使用方法,在后几节的例子中将会说到。

4、指定训练参数进行训练,这步非常重要,在例子中,将详细进行说明5、完成训练后,就可以调用训练结果,输入测试数据,进行测试6、数据进行反归一化7、误差分析、结果预测或分类,作图等数据归一化问题归一化的意义:首先说一下,在工程应用领域中,应用BP网络的好坏最关键的仍然是输入特征选择和训练样本集的准备,若样本集代表性差、矛盾样本多、数据归一化存在问题,那么,使用多复杂的综合算法、多精致的网络结构,建立起来的模型预测效果不会多好。

若想取得实际有价值的应用效果,从最基础的数据整理工作做起吧,会少走弯路的。

归一化是为了加快训练网络的收敛性,具体做法是:1 把数变为(0,1)之间的小数主要是为了数据处理方便提出来的,把数据映射到0~1范围之内处理,更加便捷快速,应该归到数字信号处理范畴之内。

2 把有量纲表达式变为无量纲表达式归一化是一种简化计算的方式,即将有量纲的表达式,经过变换,化为无量纲的表达式,成为纯量比如,复数阻抗可以归一化书写:Z = R + jωL = R(1 + jωL/R) ,复数部分变成了纯数量了,没有量纲。

另外,微波之中也就是电路分析、信号系统、电磁波传输等,有很多运算都可以如此处理,既保证了运算的便捷,又能凸现出物理量的本质含义。

神经网络归一化方法:由于采集的各数据单位不一致,因而须对数据进行[-1,1]归一化处理,归一化方法主要有如下几种,供大家参考:1、线性函数转换,表达式如下:复制内容到剪贴板代码:y=(x-MinVal ue)/(MaxVal ue-MinVal ue)说明:x、y分别为转换前、后的值,MaxVal ue、MinVal ue分别为样本的最大值和最小值。

贝叶斯优化的bpnn模型python代码-概述说明以及解释

贝叶斯优化的bpnn模型python代码-概述说明以及解释1.引言1.1 概述在这个部分,你可以描述贝叶斯优化和BP神经网络模型的基本概念和背景。

可以简要介绍贝叶斯优化是一种基于概率和贝叶斯理论的优化方法,用于在给定的限制条件下寻找最优解。

同时也可以介绍BP神经网络是一种常用的人工神经网络模型,用于解决分类和回归等问题。

你可以讨论贝叶斯优化和BP神经网络在不同领域的应用,以及它们之间结合起来的潜在优势。

可以指出这种结合可以帮助优化神经网络的超参数,提高训练效率和准确性。

最后,可以强调本文旨在探讨如何使用贝叶斯优化优化BP神经网络的参数,以提高其性能和应用范围。

1.2文章结构1.2 文章结构本文主要分为引言、正文和结论三部分。

具体结构安排如下:引言部分将会首先概述贝叶斯优化和BP神经网络,并介绍本文的研究目的。

正文部分主要分为三个小节。

首先是贝叶斯优化简介,介绍这一优化方法的原理和应用场景;接着是BP神经网络模型概述,解释BP神经网络的基本原理和结构;最后是结合贝叶斯优化和BP神经网络的优势,探讨将两者结合应用的好处和可行性。

结论部分将总结贝叶斯优化在BP神经网络中的应用情况,展望未来研究方向,并对整个文章进行总结概括。

1.3 目的:本文旨在探讨贝叶斯优化在BP神经网络中的应用,并分析结合两者的优势。

通过对贝叶斯优化和BP神经网络的简介,以及它们各自的优势进行论述,旨在为读者提供一个全面的了解和认识。

同时,本文也将总结贝叶斯优化在BP神经网络中的实际应用和未来研究方向,为相关领域的研究者和从业者提供参考和启发。

通过本文的阐述,希望能够为贝叶斯优化和BP神经网络的进一步研究和应用提供一定的指导和帮助。

2.正文2.1 贝叶斯优化简介:贝叶斯优化是一种通过在可能的目标函数空间中建立高斯过程来优化目标函数的方法。

其主要思想是在探索和利用之间进行权衡,通过不断地试验目标函数来找到最优解。

贝叶斯优化通常用于处理黑箱函数,即目标函数的具体形式未知,只能通过输入输出的对应关系进行观测。

(整理)基于BP神经网络的信用评级模型.

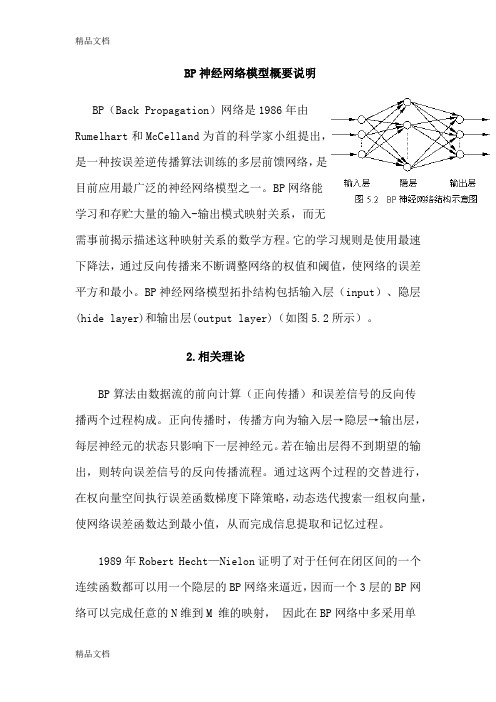

BP神经网络模型概要说明BP(Back Propagation)网络是1986年由Rumelhart和McCelland为首的科学家小组提出,是一种按误差逆传播算法训练的多层前馈网络,是目前应用最广泛的神经网络模型之一。

BP网络能学习和存贮大量的输入-输出模式映射关系,而无需事前揭示描述这种映射关系的数学方程。

它的学习规则是使用最速下降法,通过反向传播来不断调整网络的权值和阈值,使网络的误差平方和最小。

BP神经网络模型拓扑结构包括输入层(input)、隐层(hide layer)和输出层(output layer)(如图5.2所示)。

2.相关理论BP算法由数据流的前向计算(正向传播)和误差信号的反向传播两个过程构成。

正向传播时,传播方向为输入层→隐层→输出层,每层神经元的状态只影响下一层神经元。

若在输出层得不到期望的输出,则转向误差信号的反向传播流程。

通过这两个过程的交替进行,在权向量空间执行误差函数梯度下降策略,动态迭代搜索一组权向量,使网络误差函数达到最小值,从而完成信息提取和记忆过程。

1989年Robert Hecht—Nielon证明了对于任何在闭区间的一个连续函数都可以用一个隐层的BP网络来逼近,因而一个3层的BP网络可以完成任意的N维到M 维的映射,因此在BP网络中多采用单隐层网络。

下面我们以三层神经网络为例来说明BP 网络的标准学习算法。

BP 算法信号的正向传播设定BP 网络的输入层有n 个神经元,隐含层有p 个神经元,输出层有q 个神经元,输入层与隐层之间的权值为 ki ν,隐层与输出层之间的权值为 jk ω。

隐层的传递函数为f 1(·),输出层的传递函数为f 2(·),则隐层节点的输出为10()1,2,....n k ki i i z f x k ν===∑输出层节点的输出为:20()1,2,....q j jk k k y f z j ω===∑至此BP 网络就完成了n 维空间向量对m 维空间的近似映射。

BP神经网络实例分析

j1

a1(i)f(u1(i))=

1 1exp(u1(i))

i 1,2

同理,输出神经元

3

u2 (1) w2 (1, j)a1 ( j) j 1

1 a2 (1) 1 exp( u2 (1))

(3) 训练输出单元的权值

PS:利用输出层各神经元的误差项 2(1)和隐含层 各神经元的输出来修正权值。

PS:利用隐含层各神经元的误差项 各神经元的输入来修正权值。

1(p1)(i)

和输入层

1 (p 1 )(i)f'[u 1(i)]2 (p 1 )(1 )W 2 (p 1 )(1 ,i)

a 1(iቤተ መጻሕፍቲ ባይዱ1 [a 1(i)]2 (p 1 )(1 )W 2 (p 1 )(1 ,i)

W 1 ( p 1 ) ( i ,j ) W 1 ( p ) ( i ,j ) 1 ( p 1 ) ( i ) a 0 ( p 1 ) ( j )

取激励函数

f

(x)

1 1ex

则 f'(x)(1 ee xx)2f(x)1 [f(x)]

2 ( 1 ) (t( 1 ) a 2 ( 1 )f') (u 2 ( 1 ))

( t ( 1 ) a 2 ( 1 ) e ) u x 2 ( 1 ) / p 1 ) ( e ( u x 2 ( 1 )2 p )) (

二、具体训练步骤如下:

令p=0,p为样本编号 (1) 网络初始化

给各连接权值分别赋一个区间(0,1)内的随机数,设定

误差函数E,给定计算精度值 和最大学习次数M。

W 1 w w 1 1((1 2,,1 1 ))

w 1(1,2) w 1(2,2)

w 1(1,3) w 1(2,3)

BP神经网络PPT全文

输出层与隐含层的激活函数可以不同,并且输出层

各单元的激活函数可有所区别

2024/8/16

26

2 多层网络的表达能力

按照Kolmogorov定理,任何一个判决均可用 前式所示的三层神经网络实现。

即: 只要给定足够数量的隐含层单元、适 当的非线性函数、以及权值, 任何由输入向输 出的连续映射函数均可用一个三层前馈神经网络 实现。

神经网络的计算通过网络结构实现;

不同网络结构可以体现各种不同的功能;

网络结构的参数是通过学习逐渐修正的。

2024/8/16

7

(1)基本的人工神经元模型

McCulloch-Pitts神经元模型

输入信号;链接强度与权向量;

信号累积

2024/8/16

激活与抑制

8

人工神经元模型的三要素 :

一组连接 一个加法器 一个激励函数

➢ 树突(dendrites), 接收来自外接的信息 ➢ 细胞体(cell body), 神经细胞主体,信息加工 ➢ 轴突(axon), 细胞的输出装置,将信号向外传递,

与多个神经元连接 ➢突触 (synapsse), 神经元经突触向其它神经元(胞体 或树突)传递信号

2024/8/16

5

(2)生物神经元的基本特征

5 假定:第l层为当前处理层;

其前一层l 1、当前层l、后一层l 1的计算单元序号为i, j,k;

位于当前层第j个计算单元的输出为Olj,j 1,..., nl

前层第i个单元到本层第j个单元的连接权值为ilj , i 1,..., nl1

本层第j个单元到后层第k个单元的连接权值为

l 1 jk

,

连接权值,突触连接强度

BP神经网络算法预测模型

BP神经网络算法预测模型

BP神经网络(Back Propagation Neural Network,BPNN)是一种常

用的人工神经网络,它是1986年由Rumelhart和McClelland首次提出的,主要用于处理有结构的或无结构的、离散的或连续的输入和输出的信息。

它属于多层前馈神经网络,各层之间存在权值关系,其中权值是由算法本

身计算出来的。

BP神经网络借助“反向传播”(Back Propagation)来

实现权值的更新,其核心思想是根据网络的输出,将错误信息以“反馈”

的方式传递到前面的每一层,通过现行的误差迭代传播至输入层,用来更

新每一层的权值,以达到错误最小的网络。

BP神经网络的框架,可以有输入层、隐含层和输出层等组成。

其中

输入层的节点数即为输入数据的维数,输出层的节点个数就是可以输出的

维数,而隐含层的节点数可以由设计者自由设定。

每一层之间的权值是

BP神经网络算法预测模型中最重要的参数,它决定了神经网络的预测精度。

BP神经网络的训练步骤主要有以下几步:首先,规定模型的参数,

包括节点数,层数,权值,学习率等;其次,以训练数据为输入,初始化

权值,通过计算决定输出层的输出及误差;然后,使用反向传播算法,从

输出层向前,层层地将误差反馈到前一层。

BP神经网络模型应用实例

BP神经网络模型第1节基本原理简介近年来全球性的神经网络研究热潮的再度兴起,不仅仅是因为神经科学本身取得了巨大的进展.更主要的原因在于发展新型计算机和人工智能新途径的迫切需要.迄今为止在需要人工智能解决的许多问题中,人脑远比计算机聪明的多,要开创具有智能的新一代计算机,就必须了解人脑,研究人脑神经网络系统信息处理的机制.另一方面,基于神经科学研究成果基础上发展出来的人工神经网络模型,反映了人脑功能的若干基本特性,开拓了神经网络用于计算机的新途径.它对传统的计算机结构和人工智能是一个有力的挑战,引起了各方面专家的极大关注.目前,已发展了几十种神经网络,例如Hopficld模型,Feldmann等的连接型网络模型,Hinton等的玻尔茨曼机模型,以及Rumelhart等的多层感知机模型和Kohonen的自组织网络模型等等。

在这众多神经网络模型中,应用最广泛的是多层感知机神经网络。

多层感知机神经网络的研究始于50年代,但一直进展不大。

直到1985年,Rumelhart等人提出了误差反向传递学习算法(即BP算),实现了Minsky的多层网络设想,如图34-1所示。

BP 算法不仅有输入层节点、输出层节点,还可有1个或多个隐含层节点。

对于输入信号,要先向前传播到隐含层节点,经作用函数后,再把隐节点的输出信号传播到输出节点,最后给出输出结果。

节点的作用的激励函数通常选取S 型函数,如Qx e x f /11)(-+=式中Q 为调整激励函数形式的Sigmoid 参数。

该算法的学习过程由正向传播和反向传播组成。

在正向传播过程中,输入信息从输入层经隐含层逐层处理,并传向输出层。

每一层神经元的状态只影响下一层神经输入层 中间层 输出层 图34-1 BP 神经网络模型元的状态。

如果输出层得不到期望的输出,则转入反向传播,将误差信号沿原来的连接通道返回,通过修改各层神经元的权值,使得误差信号最小。

社含有n 个节点的任意网络,各节点之特性为Sigmoid 型。

bp网络

一、简介

BP(Back propagation)神经网络又称为 BP( propagation) 多层前馈神经网络, 多层前馈神经网络,为三层前馈神经网 络的拓扑结构。它是当前最为广泛的一 络的拓扑结构。它是当前最为广泛的一 种人工神经网络,可用于语言综合、识 别和自适应控制等系统。这种神经网络 别和自适应控制等系统。这种神经网络 模型的特点是:结构简单,工作状态稳 模型的特点是:结构简单,工作状态稳 定,易于硬件实现;各层神经元仅与相 定,易于硬件实现;各层神经元仅与相 邻层神经元之间有连接;各层内神经元 之间无任何连接;各层神经元之间无反 馈连接。输入信号先向前传播到隐结点,

经过变换函数之后,把隐结点的输 出信息传播到输出结点,再给出输 出结果。结点的变换函数通常选取 Sigmoid型函数。 Sigmoid型函数。

图1 BP网络 BP网络

BP算法的原理 BP算法的原理

BP算法是用于前馈多层网络的学习算法, BP算法是用于前馈多层网络的学习算法, 前馈多层网络的结构如图1 前馈多层网络的结构如图1所示。它包含 有输入层、输出层以及处于输入输出层 之间的中间层。中间层有单层或多层, 由于它们和外界没有直接的联系,故也 称隐层。在隐层中的神经元也称隐单元; 隐层虽然与外界不连接,但它们的状态 影响输入输出之间的关系。也就是说, 改变隐层的权系数,可以改变整个多层 神经网络的性能。

BP算法的数学描述 BP算法的数学描述

BP算法实质是求取误差函数的最小值问 BP算法实质是求取误差函数的最小值问 题,这种算法采用最速下降法,按误差 函数的负梯度方向修改权系数。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

华东理工大学 2016-2017学年第2学期

研究生《石油化工单元数学模型》课程论文2017年6月

开课学院:化工学院任课教师:欧阳福生

考生姓名:丁桂宾学号:Y45160205 成绩:

BP 神经网络模型简介及相关优化案例

一、神经网络模型简介

现代神经生理学和神经解剖学的研究结果表明,人脑是极其复杂的,由约1010个神经元交织在一起,构成一个网状结构。

它能完成诸如智能、思维、情绪等高级精神活动,被认为是最复杂、最完美、最有效的一种信息处理系统。

人工神经网络(Artificial Neural Networks ,以下简写为 NN )是指模拟人脑神经系统的结构和功能,运用大量的处理部件,通过数学方法,由人工方式构造的网络系统[1]。

图1表示作为 NN 基本单元的神经元模型,它有三个基本要素[2]: (1) 一组连接权(对应于生物神经元的突触),连接强度由各连接上的权值表示,权值为正表示激励,为负表示抑制。

(2) 一个求和单元,用于求取各输入信息的加权和(线性组合)。

(3) 一个非线性激励函数,起非线性映射作用并限制神经元输出幅度在一定的范围内(一般限制在[0,1]或[−1,+1]之间)。

图1 神经元模型

此外还有一个阈值k θ(或偏置

k

k b θ-=)。

以上作用可以用数学式表达为:

∑=

=P

j kj k j

x w u ;

k k k u θν-=;

)

(k k v y ϕ=

式中

P

x x x x ,...,,,321为输入信号,

kP k k k w w w w ,...,,,321为神经元k 的权值,

k

u 为

线性组合结果,

k θ为阈值。

(.)ϕ为激励函数,k y 为神经元k 的输出。

神经网络理论突破了传统的、串行处理的数字电子计算机的局限,是一个非线性动力学系统,并以分布式存储和并行协同处理为特色,虽然单个神经元的结构和功能极其简单有限,但是大量的神经元构成的网络系统所实现的行为却是极其丰富多彩的。

二、BP 神经网络模型

BP 网络(Back-Propagation Network),即反向传播网络,是一种将W-H 学习规则一般化,对非线性可微分函数进行权值训练的多层网络权值的调整采用反向传播(Back-propagation )的学习算法。

它是一种多层前向反馈神经网络,其神经元的变换函数是S 型函数输出量为0到1之间的连续量,它可实现从输入到输出的任意的非线性映射。

当一对学习样本提供给网络后,神经元的激活值从输入层经各中间层向输出层传播,在输出层的各神经元获得网络的输入响应。

接下来,按照减少目标输出与实际误差的方向,从输出层经过各中间层逐层修正各连接权值。

最后回到输入层,这种算法称为“误差逆传播算法”,即BP 算法。

随着这种误差逆的传播修正不断进行,网络对输入模式响应的正确率但不断上升

[3]。

BP 神经网络模型如图2

图2 BP 神经网络模型

典型的BP 神经网络包含3 层:输入层、隐含层、输出层,是一种前向阶层型神经网络[4]。

每一层由若干神经元(节点) 组成,每一个神经元的作用是计算该神经元所有输入的权重和,并通过特定的输出函数-激励函数输出。

激励函数一般是非减和可微函数,最常用的激励函数是S 函数和线性函数,S 函数方程式为:

x

e

x f -+=

11

)(

以一个隐含层的BP 网络为例,从输人到输出的映射过程为:

j h nin

i i ij j in b x w h ,1,)(+=∑=

)(,,j in j out h S h =

k y nhid

j j out jk k in b h w y ,1

,,)(+=∑=

)(,k in k y S y =

式中,x ——输入信号;

in h 和

out

h ——分别是隐含层节点的输入值和输出值;

in

y ——输出层节点的输入值;

y ——输出信号;

w ——节点之间的连接权重;

b ——节点的阈值;

nhid nin ,——分别为输入层和隐含层的节点数。

BP 神经网络的学习过程是由信息的正向传播和误差的反向传播两个过程组成的。

外界的输入信息通过输入层、隐含层和输出层的计算后得到实际结果,当实际结果和期望结果不符时,按误差梯度下降的方式修正各层权值,并向隐含层和输入层反向传播。

不断反复的信息正向传播和误差反向传播过程是各层权值不断调整的过程,也是神经网络不断学习的过程,直到网络输出与实际输出误差达到精度以内或者是网络学习达到预先设定的学习次数为止[5]。

三、优化案例

3.1BP神经网络在MIP工艺过程产品分布优化中的运用[6]

以某炼油厂1.0Mt/a的MIP装置反应-再生系统为研究对象,选取包括原料油性质、再生剂性质、操作条件的19个变量为神经网络模型的输入变量,液化气、汽油、柴油、焦炭收率为输出变量,建立19-24-4结构的BP神经网络,在此基础上考察原料油预热温度、第一反应区(一反)出口温度、第二反应区(二反)出口温度、反应压力对产品分布的影响,并采用遗传算法得到使汽油收率最优的操作条件。

32组模型验证样本的相对误差统计见表1。

由表1可知:液化气、柴油收率和焦炭产率的相对误差只有4组样本大于10%,而小于5%的样本占多数;汽油收率的相对误差较小,除1组样本大于5%外,其余样本的相对误差都在5%以内;液化气、汽油、柴油收率和焦炭产率的平均相对误差都小于5%,说明所建立的神经网络模型的外推性较好。

表1. 32组验证样本的相对误差统计

产品误差小于5%的

样本数

误差5%~10%的

样本数

误差大于10%

的样本数

平均相对误

差,%

液化气23 7 2 4.18

汽油31 1 0 1.49

柴油25 6 1 3.58

焦炭23 8 1 3.50

通过建立的BP神经网络,分别考察原料油预热温度,反应温度以及反应压力对产品分布的影响情况,模拟结果与实际情况拟合良好,说明此模型可靠性比较高。

在此基础之上,利用遗传算法进行优化,获得较好的汽油收率下的反应-再生系统操作条件。

3.2以BP-ANN模型为基础的操作优化[7]

以建立FCC分馏塔的粗汽油干点模型为例,选取了7个输入参数:反应-再生系统的原料油流量和反应温度、分馏塔顶温度和压力、顶循环抽出量和抽出温度、气提蒸汽量。

其中,原料油流量和反应温度对于分馏系统来说是不可调控的,为操作工况,其余为操作条件;1个输出参数,即粗汽油的干点;1个隐含层,

包含8个隐节点;从厂方提供的实际数据中选取了10组样本对网络模型进行训练,厂方要求模型预测的干点值与实际化验值之间的偏差小于2℃,经过训练,模型对这10组样本的预测效果均达到要求。

在实际生产中,粗汽油干点一般保持在195℃和205℃之间,而当干点控制在205℃时,油收率最大,经济效益最高。

通过已经建立的BP-ANN模型,确定优化的目标函数为:

2

min-

t

=y

(

)

205

在所用的100组样本中选取合适的初值点,利用梯度搜索法进行计算得到最佳的操作条件,如下表2

表2 最佳操作条件

输入输出参数生产条件1 生产条件2 生产条件3 分馏塔顶温/℃113.043 114.435 116.106

分馏塔顶压/kPa 140.754 123.100 126.618

185.476 193.427 177.694 顶循环抽出量/

(t/h)

定循环抽出温度/℃163.007 154.487 150.605

气提蒸汽量/(t/h) 3.24341 4.54363 2.94378

四、结论

神经网络模型可以对庞大的化工实验数据进行处理,寻找到隐藏在大量数据之下的化工生产规律,其中又以BP网络应用最广泛。

BP神经网络模型实现了一个从输入到输出的映射功能,而数学理论已证明它具有实现任何复杂非线性映射的功能。

这使得它特别适合于求解内部机制复杂的问题并且网络能通过学习带正确答案的实例集自动提取“合理的”求解规则,即具有自学习能力。

同时BP网络具有一定的外推能力。

参考文献:

[1]周春光, 梁艳春. 计算智能:人工神经网络·模糊系统·进化计算-第3版[M]. 吉林大学出版社, 2009.

[2]王汉林. 灰色神经网络模型的建立及其在复杂非线性预测问题中的应用[D]. 吉林大学, 2004.

[3]吕砚山, 赵正琦. BP神经网络的优化及应用研究[J]. 北京化工大学学报(自然科学版), 2001, 28(1):67-69.

[4]姚晓丽. 人工神经网络在石油化工过程优化操作中的应用研究[D]. 北京: 清华大学,1992.

[5]史忠植. 神经网络[M]. 北京: 高等教育出版社,2009:48-56.

[6]欧阳福生, 方伟刚, 唐嘉瑞,等. 以BP神经网络为基础的MIP工艺过程产品分布优化[J]. 石油炼制与化工, 2016, 47(5):95-100.

[7]周祥, 何小荣, 陈丙珍. 基于BP-ANN模型的化工过程操作优化[C]// 中国系统工程学会2001过程系统工程年会. 2001.。