Hadoop大数据平台构建与应用 第4章 Hadoop的伪分布式安装与使用

伪分布式安装core-site.xml和hdfs-site.xml配置文件

伪分布式安装core-site.xml和hdfs-site.xml配置⽂件hadoop的伪分布式安装流程如下所⽰:其中core-site.xml和hdfs-site.xml是两个很重要的配置⽂件。

core-site.xml<configuration><property><name>hadoop.tmp.dir</name><value>file:/usr/local/hadoop/tmp</value><description>Abase for other temporary directories.</description></property><property><name>fs.defaultFS</name><value>hdfs://localhost:9000</value></property></configuration>hadoop.tmp.dir⽤来存放hadoop运⾏过程中临时⽂件的⽬录,⽬录指定为/usr/local/hadoop/tmp,如果不设置这个⽬录,那么当hadoop关闭后某些系统临时⽬录会被清空,当下⼀次需要启动hadoop时需要重新进⾏初始化。

所以这⾥⼈⼯指定⽬录可以避免被清空。

df.defaultFS设置好逻辑名称,当我们下次需要访问分布式⽂件系统的时候,⽤localhost:9000就可以访问了。

hdfs-site.xml<configuration><property><name>dfs.replication</name><value>1</value></property><property><name>.dir</name><value>file:/usr/local/hadoop/tmp/dfs/name</value></property><property><name>dfs.datanode.data.dir</name><value>file:/usr/local/hadoop/tmp/dfs/data</value></property></configuration>dfs.replication表⽰副本的数量,伪分布式要设置为1。

Hadoop应用开发与案例实战课后习题参考答案1-10章全书章节练习题答案题库

习题一、选择题1.下列有关 Hadoop 的说法正确的是( ABCD )。

A .Hadoop 最早起源于 NutchB .Hadoop 中HDFS 的理念来源于谷歌发表的分布式文件系统( GFS )的论文C .Hadoop 中 MapReduce 的思想来源于谷歌分布式计算框架 MapReduce 的论文D.Hadoop 是在分布式服务器集群上存储海量数据并运行分布式分析应用的一个开源的软件框架2.使用 Hadoop 的原因是( ABCD )。

A.方便:Hadoop 运行在由普通商用机器构成的大型集群上或者云计算服务上B.稳健:Hadoop 致力于在普通商用硬件上运行,其架构假设硬件会频繁失效,Hadoop 可以从容地处理大多数此类故障C .可扩展:Hadoop 通过增加集群节点,可以线性地扩展以处理更大的数据集D.简单:Hadoop 允许用户快速编写高效的并行代码3.Hadoop 的作者是( B )。

A .Martin FowlerB .Doug CuttingC .Kent BeckD .Grace Hopper4.以下关于大数据特点的描述中,不正确的是( ABC )。

A .巨大的数据量B .多结构化数据C .增长速度快D .价值密度高二、简答题1.Hadoop 是一个什么样的框架?答:Hadoop 是一款由Apache 基金会开辟的可靠的、可伸缩的分布式计算的开源软件。

它允许使用简单的编程模型在跨计算机集群中对大规模数据集进行分布式处理。

2.Hadoop 的核心组件有哪些?简单介绍每一个组件的作用。

答:核心组件有 HDFS 、MapReduce 、YARN 。

HDFS ( Hadoop Distributed File Sy,st doop 分布式文件系统)是 Hadoop 的核心组件之一,作为最底层的分布式存储服务而存在。

它是一个高度容错的系统,能检测和应对硬件故障,可在低成本的通用硬件上运行。

Hadoop伪分布式安装

Hadoop伪分布式安装1.安装Hadoop(伪分布式)

上传Hadoop

将hadoop-2.9.2.tar.gz 上传到该目录

解压

ls

将Hadoop添加到环境变量

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

保存并退出vim

验证环境变量是否正确hadoop version

修改配置文件hadoop-env.sh

保存并退出vim

修改配置文件core-site.xml

保存并退出vim

修改配置文件hdfs-site.xml

</property>

保存并退出vim

格式化HDFS

hdfs namenode -format

格式化成功的话,在/bigdata/data目录下可以看到dfs目录

启动NameNode

启动DataNode

查看NameNode管理界面

在windows使用浏览器访问http://bigdata:50070可以看到HDFS的管理界面

如果看不到,(1)检查windows是否配置了hosts;

位于C:\Windows\System32\drivers\etc\hosts

关闭HDFS的命令

2.配置SSH免密登录生成密钥

回车四次即可生成密钥

复制密钥,实现免密登录

根据提示需要输入“yes”和root用户的密码

新的HDFS启停命令

免密登录做好以后,可以使用start-dfs.sh和stop-dfs.sh命令启停HDFS,不再需要使用hadoop-daemon.sh脚本

stop-dfs.sh

注意:第一次用这个命令可能还是需要输入yes,按提示输入即可。

《大数据技术》Hadoop安装和HDFS常见的操作实验报告

《大数据技术》Hadoop安装和HDFS常见的操作实验报告

三、实验过程与结论:(经调试正确的源程序(核心部分)和程序的运行结果)

1.熟悉常用的Hadoop操作

(1)使用hadoop用户登录Linux系统,启动Hadoop(Hadoop的安装目录为“/usr/local/hadoop”),为hadoop用户在HDFS中创建用户目录“/user/hadoop”

(2)接着在HDFS的目录“/user/hadoop”下,创建test文件夹,并查看文件列表

(3)将Linux系统本地的“~/.bashrc”文件上传到HDFS的test文件夹中,并查看test

(4)将HDFS文件夹test复制到Linux系统本地文件系统的“/usr/local/hadoop”目录下

2. 编程实现以下功能,并利用Hadoop提供的Shell命令完成相同任务:

(1)

(2)

(3)

(4)

(5)

(6)

(7)

(8)

(9)

(10)

3.编程实现一个类“MyFSDataInputStream”

四、实验总结:(实验中遇到的问题及解决方法,心得体会等)

通过本次实验的学习,我对什么是大数据,大数据在做什么有了初步的了解,同时也激发起了我对大数据学习的兴趣。

在今后的学习中我会更加努力,本章知识也为我后面章节的学习奠定了基础。

让我有明确的目标去学习这门课程。

《Hadoop大数据技术原理与应用》课程教学大纲

《Hadoop大数据技术原理与应用》课程教学大纲课程编号:3250578学分:4学分学时:72学时(其中:讲课学时36 上机学时:36)先修课程:《Linux基础》、《关系数据库基础》、《程序设计基础》、《Java面向对象编程》后续课程:Spark,《Python编程基础》、《Python数据分析与应用》适用专业:大数据应用技术一、课程的性质与目标《大数据应用开发》本课程是软件技术专业核心课程,大数据技术入门课程。

通过学习课程使得学生掌握大数据分析的主要思想和基本步骤,并通过编程练习和典型应用实例加深了解;同时对Hadoop平台应用与开发的一般理论有所了解,如分布式数据收集、分布式数据存储、分布式数据计算、分布式数据展示。

开设本学科的目的是让学生掌握如何使用大数据分析技术解决特定业务领域的问题。

完成本课程学习后能够熟练的应用大数据技术解决企业中的实际生产问题。

二、教学条件要求操作系统:Center OSHadoop版本:Hadoop2.7.4开发工具:Eclipse三、课程的主要内容及基本要求第1章初识Hadoop第2章构建Hadoop集群第3章 HDFS分布式文件系统第4章 MapReduce分布式计算系统第5章 Zookeeper分布式协调服务第6章 Hadoop2.0新特性第7章 Hive数据仓库第8章 Flume日志采集系统第9章 Azkaban工作流管理器第10章 Sqoop数据迁移第11章综合项目——网站流量日志数据分析系统四、学时分配五、考核模式与成绩评定办法本课程为考试课程,期末考试采用百分制的闭卷考试模式。

学生的考试成绩由平时成绩(30%)和期末考试(70%)组成,其中,平时成绩包括出勤(5%)、作业(5%)、上机成绩(20%)。

六、选用教材和主要参考书本大纲是参考教材《Hadoop大数据技术原理与应用》所设计的。

七、大纲说明本课程的授课模式为:课堂授课+上机,其中,课堂主要采用多媒体的方式进行授课,并且会通过测试题阶段测试学生的掌握程度;上机主要是编写程序,要求学生动手完成指定的程序设计或验证。

《Hadoop》实验教学大纲(大数据)

《H a d o o p》实验教学大纲课程代码:实验学时:16先修课程:《大数据导论》一、目的要求目的:使学生能够掌握大数据平台Hadoop的基本概念,并根据Hadoop处理大批量数据集的存储与分析计算,掌握调试程序的基本技巧,初步了解大数据开发所要经历的阶段,为学生从事大数据开发和数据处理工作打下坚实的基础。

要求:熟悉Linux系统和Java se编程,根据实验内容和要求,认真完成程序编写、上机调试、运行结果分析,书写实验报告。

二、实验项目内容及学时分配实验一、Linux及虚拟机安装搭建(3学时)1.实验目的要求(1)安装VMware虚拟机;(2)通过VMware虚拟机编译、安装Linux CentOS系统。

2.实验主要内容通过在计算机系统上编译和安装Linux系统环境,为Hadoop软件安装和搭建提供工作环境。

3.实验类别:基础4.实验类型:验证5.实验要求:必做6.主要仪器:微型计算机实验二、Hadoop的安装搭建(3学时)1.实验目的要求掌握大数据核心框架Hadoop的安装和部署,包括伪分布式集群的安装部署和完全分布式的安装和部署。

2.实验主要内容通过上机在Linux系统环境进行Hadoop平台的安装和部署,完成大数据分布式处理平台的搭建。

3.实验类别:基础4.实验类型:验证5.实验要求:必做6.主要仪器:微型计算机实验三、HDFS Shell应用(3学时)1.实验目的要求(1)掌握分布式文件存储与管理系统hdfs的数据上传与下载命令;(2)掌握hdfs文件增删改查等操作命令;(3)掌握分布式系统hdfs的运行原理。

2.实验主要内容(1)hdfs hadoop put get mkdir ls 等命令的使用(2)NameNode datanode的作用及原理3.实验类别:基础4.实验类型:设计5.实验要求:必做6.主要仪器:微型计算机实验四、MapReduce编程(3学时)1.实验目的要求(1)正确使用MapReduce编程;(2)MapReduce编程的编程格式;(3)“WC”编程;2.实验主要内容(1)MapReduce固定格式语法编程,map编程、reduce编程(2)自定义函数编程,UDF、UDAF等函数编程3.实验类别:专业基础4.实验类型:设计5.实验要求:必做6.主要仪器:微型计算机实验五、MapReduce数据倾斜等优化(4学时)1.实验目的要求(1)掌握MapReduce编程的优化;(2)熟练掌握数据倾斜等MapReduce任务问题的优化。

hadoop环境配置以及hadoop伪分布式安装实训目的

Hadoop环境配置以及Hadoop伪分布式安装是用于学习和实践大数据处理和分析的重要步骤。

下面将详细解释配置Hadoop环境以及安装Hadoop伪分布式的目的。

一、Hadoop环境配置配置Hadoop环境是为了在实际的硬件或虚拟机环境中搭建Hadoop集群,包括安装和配置Hadoop的各个组件,如HDFS(Hadoop分布式文件系统)、MapReduce(一种编程模型和运行环境)等。

这个过程涉及到网络设置、操作系统配置、软件安装和配置等步骤。

通过这个过程,用户可以了解Hadoop的基本架构和工作原理,为后续的学习和实践打下基础。

二、Hadoop伪分布式安装Hadoop伪分布式安装是一种模拟分布式环境的方法,它可以在一台或多台机器上模拟多个节点,从而在单机上测试Hadoop的各个组件。

通过这种方式,用户可以更好地理解Hadoop 如何在多台机器上协同工作,以及如何处理大规模数据。

安装Hadoop伪分布式的主要目的如下:1. 理解Hadoop的工作原理:通过在单机上模拟多个节点,用户可以更好地理解Hadoop如何在多台机器上处理数据,以及如何使用MapReduce模型进行数据处理。

2. 练习Hadoop编程:通过在单机上模拟多个节点,用户可以编写和测试Hadoop的MapReduce程序,并理解这些程序如何在单机上运行,从而更好地理解和学习Hadoop编程模型。

3. 开发和调试Hadoop应用程序:通过在单机上模拟分布式环境,用户可以在没有真实数据的情况下开发和调试Hadoop应用程序,从而提高开发和调试效率。

4. 为真实环境做准备:一旦熟悉了Hadoop的伪分布式环境,用户就可以逐渐将知识应用到真实环境中,例如添加更多的实际节点,并开始处理实际的大规模数据。

总的来说,学习和实践Hadoop环境配置以及Hadoop伪分布式安装,对于学习和实践大数据处理和分析具有重要意义。

它可以帮助用户更好地理解和学习Hadoop的工作原理和编程模型,为将来在实际环境中应用和优化Hadoop打下坚实的基础。

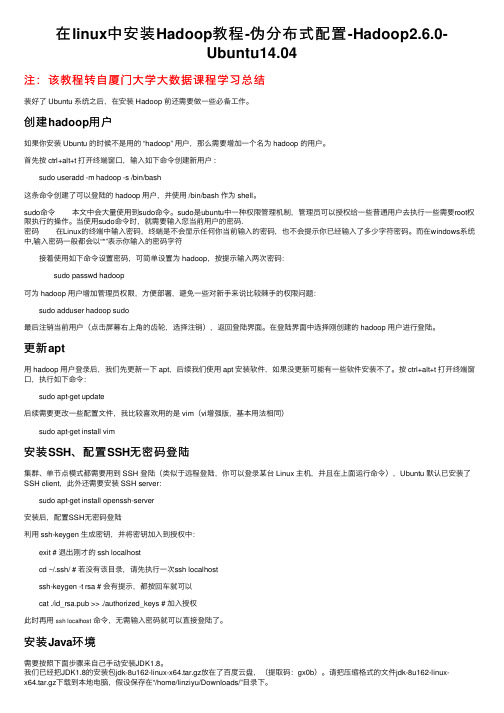

在linux中安装Hadoop教程-伪分布式配置-Hadoop2.6.0-Ubuntu14.04

在linux中安装Hadoop教程-伪分布式配置-Hadoop2.6.0-Ubuntu14.04注:该教程转⾃厦门⼤学⼤数据课程学习总结装好了 Ubuntu 系统之后,在安装 Hadoop 前还需要做⼀些必备⼯作。

创建hadoop⽤户如果你安装 Ubuntu 的时候不是⽤的 “hadoop” ⽤户,那么需要增加⼀个名为 hadoop 的⽤户。

⾸先按 ctrl+alt+t 打开终端窗⼝,输⼊如下命令创建新⽤户 : sudo useradd -m hadoop -s /bin/bash这条命令创建了可以登陆的 hadoop ⽤户,并使⽤ /bin/bash 作为 shell。

sudo命令 本⽂中会⼤量使⽤到sudo命令。

sudo是ubuntu中⼀种权限管理机制,管理员可以授权给⼀些普通⽤户去执⾏⼀些需要root权限执⾏的操作。

当使⽤sudo命令时,就需要输⼊您当前⽤户的密码.密码 在Linux的终端中输⼊密码,终端是不会显⽰任何你当前输⼊的密码,也不会提⽰你已经输⼊了多少字符密码。

⽽在windows系统中,输⼊密码⼀般都会以“*”表⽰你输⼊的密码字符 接着使⽤如下命令设置密码,可简单设置为 hadoop,按提⽰输⼊两次密码: sudo passwd hadoop可为 hadoop ⽤户增加管理员权限,⽅便部署,避免⼀些对新⼿来说⽐较棘⼿的权限问题: sudo adduser hadoop sudo最后注销当前⽤户(点击屏幕右上⾓的齿轮,选择注销),返回登陆界⾯。

在登陆界⾯中选择刚创建的 hadoop ⽤户进⾏登陆。

更新apt⽤ hadoop ⽤户登录后,我们先更新⼀下 apt,后续我们使⽤ apt 安装软件,如果没更新可能有⼀些软件安装不了。

按 ctrl+alt+t 打开终端窗⼝,执⾏如下命令: sudo apt-get update后续需要更改⼀些配置⽂件,我⽐较喜欢⽤的是 vim(vi增强版,基本⽤法相同) sudo apt-get install vim安装SSH、配置SSH⽆密码登陆集群、单节点模式都需要⽤到 SSH 登陆(类似于远程登陆,你可以登录某台 Linux 主机,并且在上⾯运⾏命令),Ubuntu 默认已安装了SSH client,此外还需要安装 SSH server: sudo apt-get install openssh-server安装后,配置SSH⽆密码登陆利⽤ ssh-keygen ⽣成密钥,并将密钥加⼊到授权中: exit # 退出刚才的 ssh localhost cd ~/.ssh/ # 若没有该⽬录,请先执⾏⼀次ssh localhost ssh-keygen -t rsa # 会有提⽰,都按回车就可以 cat ./id_rsa.pub >> ./authorized_keys # 加⼊授权此时再⽤ssh localhost命令,⽆需输⼊密码就可以直接登陆了。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

✎ 4.1深入了解Hadoop

4.1.1 Hadoop发行版本介绍

本教材使用Apache Hadoop版本,又称Apache社区版本。该版本分为两 代,我们将第一代Hadoop称为Hadoop 1.0,第二代Hadoop称为Hadoop 2.0。第一代已基本淘汰,第二代Hadoop包含两个版本,分别是0.23.x和 2.x,它们完全不同于Hadoop 1.0,是一套全新的架构,均包含HDFS Federation联邦机制和YARN资源管理两个系统。本教材使用2.x版本搭建 平台。

场景1:数据分析平台 场景2:推荐系统 场景3:业务系统的底层存储系统 场景4:业务监控系统

✎ 4.2安装JAVA环境(JDK)

4.2.1 第一种安装方式(离线安装)

(1)解压JDK包 (2)查看JDK目录并复制安装路径 (3)修改环境变量JDK)

✎ 4.1深入了解Hadoop

4.1.2 Hadoop核心架构

Hadoop是apache基金会组织的一个顶级项目,其核心为HDFS和 MapReduce,HDFS为海量的数据提供存储,而MapReduce为海量的数据 提供计算。

✎ 4.1深入了解Hadoop

4.1.3 Hadoop的主要应用场景

✎

第4章 Hadoop的伪分布式安装 与使用

·HADOOP简介 ·安装JAVA环境(JDK)

·安装HADOOP

✎ 目录页

4.1 HADOOP简介 4.1.1 Hadoop发行版本介绍 4.1.2 Hadoop核心架构 4.1.3 Hadoop的主要应用场景 4.2 安装JAVA环境(JDK) 4.2.1 第一种安装方式(离线安装) 4.2.2 第二种安装方式(在线安装) 4.3 安装HADOOP 4.3.1 下载Hadoop安装文件并解压 4.3.2 配置Hadoop环境变量 4.3.3 伪分布式模式配置 4.3.4 Hadoop无法正常启动和使用的解决方法

4.2.2 第二种安装方式(在线安装)

检查联网正常,执行命令如下: $ sudo apt-get install default-jre default-jdk 下载安装结束以后,需要找到相应的安装路径,这个路径是用于配置 JAVA_HOME 环境变量的。经过此在线安装,JDK的安装路径为: /usr/lib/jvm/default-java。 配置JAVA_HOME环境变量。

✎ 4.3 安装Hadoop

4.3.1 下载Hadoop安装文件并解压

安装Hadoop就是解压的过程: 安装运行Hadoop之前,一定要确保已经安装SSH。 解压hadoop-2.7.3.tar.gz 查看Hadoop安装成功。

✎ 4.3 安装Hadoop

4.3.3 伪分布式模式配置

伪分布式需要修改2个配置文件 core-site.xml 和 hdfs-site.xml 。具体配置 实现过程为: 1、修改配置文件 core-site.xml 2、修改配置文件 hdfs-site.xml 3、NameNode格式化 4、开启和关闭 NameNode 和 DataNode 守护进程

1、NameNode能启动,DataNode不能启动 2、错误现象:Name node is in safe mode. 3、出现其他错误可通过上网查找解决方案。

✎ 4.3 安装Hadoop

4.3.4 Hadoop无法正常启动和使用的解决方法

1、NameNode能启动,DataNode不能启动 2、错误现象:Name node is in safe mode. 3、出现其他错误可通过上网查找解决方案。

✎ 4.3 安装Hadoop

4.3.4 Hadoop无法正常启动和使用的解决方法