基于支持向量机的分类方法

如何使用支持向量机进行多类别分类

如何使用支持向量机进行多类别分类支持向量机(Support Vector Machine,SVM)是一种常用的机器学习算法,广泛应用于分类和回归问题。

在分类问题中,SVM可以有效地处理二分类任务。

但在面对多类别分类问题时,需要采取一些特殊的策略来适应多类别情况。

本文将介绍如何使用支持向量机进行多类别分类。

1. 一对多(One-vs-Rest)策略一对多策略是最常用的多类别分类方法之一。

它将多类别问题转化为多个二分类问题。

对于有N个类别的问题,我们需要训练N个SVM模型,每个模型都将一个类别作为正例,其他类别作为负例。

在预测时,将样本输入到这N个模型中,选择输出概率最高的类别作为最终的分类结果。

这种策略的优点是简单易懂,容易实现。

同时,由于每个模型只需要区分一个类别和其他类别,相对于直接使用多类别分类模型,计算量较小。

然而,这种方法可能会出现类别不平衡的问题,即某些类别的样本数量较少,导致模型对这些类别的预测效果较差。

2. 一对一(One-vs-One)策略一对一策略是另一种常用的多类别分类方法。

它将多类别问题转化为多个二分类问题,每个二分类问题只涉及两个类别。

对于有N个类别的问题,我们需要训练N*(N-1)/2个SVM模型,每个模型都将两个类别作为正例和负例。

在预测时,将样本输入到这些模型中,通过投票或者加权投票的方式确定最终的分类结果。

相对于一对多策略,一对一策略的优点是可以避免类别不平衡的问题。

每个模型只需要区分两个类别,相对于直接使用多类别分类模型,计算量较小。

然而,这种方法的缺点是需要训练大量的模型,计算复杂度较高。

当类别数量较多时,训练时间和内存消耗可能会成为问题。

3. 多类别扩展除了以上介绍的一对多和一对一策略,还有一些其他方法可以用于多类别分类。

例如,多类别扩展方法将多类别问题转化为二分类问题,但是通过一些技巧将多个二分类模型组合起来。

常见的多类别扩展方法有Error-Correcting Output Codes (ECOC)和Directed Acyclic Graph(DAG)等。

基于支持向量机语义分类的两种图像检索方法

收 稿 日期 : 0 90 — 0 2 0 — 91

降低 分类 的难 度 , 在每一 级分 类 时 , 采取 贝 叶斯分类 的

方法 . 们假设 图像类 别 是 固 定 的 而且 每 类 图像 的先 他

基 于 支 持 向 量 机 语 义 分 类 的 两 种 图像 检 索 方 法

廖绮 绮 , 李翠 华

( f大 学 信 息 科 学 与 技 术 学 院 , 建 厦 f 6 0 5 厦 - 1 福 -3 10 ) 1

摘 要 :为了更好 的解决 基于内容的 图像检 索 问题 , 出 了 2种 基 于语 义的 图像检 索 方法. 1种 是基 于支持 向量 机 提 第

使用支持向量机解决多类别分类问题的方法

使用支持向量机解决多类别分类问题的方法支持向量机(Support Vector Machine,SVM)是一种常用的机器学习算法,适用于解决多类别分类问题。

它的优点是能够处理高维数据和非线性数据,并且在训练过程中能够最大化分类边界的间隔,提高分类的准确性。

本文将介绍使用支持向量机解决多类别分类问题的方法。

一、支持向量机的基本原理支持向量机的基本原理是通过找到一个超平面来将不同类别的数据分开。

这个超平面被称为最优分类超平面,它能够最大化不同类别数据之间的间隔。

在二维空间中,最优分类超平面就是一条直线,而在多维空间中,它是一个超平面。

二、支持向量机的多类别分类方法支持向量机最初是为二分类问题设计的,但是它也可以用于解决多类别分类问题。

有两种常用的方法可以实现多类别分类:一对一(One-vs-One)和一对其余(One-vs-Rest)。

1. 一对一方法一对一方法将多类别分类问题转化为多个二分类问题。

对于N个类别,我们需要训练N*(N-1)/2个分类器。

每个分类器只关注两个类别,将这两个类别的数据作为正例和负例进行训练。

在测试时,将测试样本分别送入这些分类器中,最终通过投票的方式确定测试样本所属的类别。

2. 一对其余方法一对其余方法将多类别分类问题转化为N个二分类问题。

对于每个类别,我们需要训练一个分类器,将该类别的数据作为正例,而将其他所有类别的数据作为负例进行训练。

在测试时,将测试样本送入这些分类器中,最终选择分类器输出最高的类别作为测试样本的类别。

三、支持向量机的优化方法支持向量机的目标是找到一个最优的超平面,使得分类边界的间隔最大化。

为了实现这个目标,需要定义一个优化问题,并通过求解这个优化问题来找到最优的超平面。

1. 凸优化问题支持向量机的优化问题是一个凸优化问题,可以通过凸优化算法来求解。

常用的凸优化算法包括梯度下降法、共轭梯度法等。

2. 核函数支持向量机可以通过引入核函数来处理非线性数据。

使用支持向量机进行文本分类任务

使用支持向量机进行文本分类任务支持向量机(Support Vector Machine,SVM)是一种常用的机器学习算法,广泛应用于文本分类任务。

本文将介绍SVM的基本原理,以及如何使用SVM进行文本分类。

一、支持向量机的基本原理支持向量机是一种二分类模型,其基本原理是找到一个超平面,将不同类别的样本分开。

在二维空间中,这个超平面就是一条直线;在多维空间中,这个超平面就是一个超平面。

支持向量机的目标是找到一个最优的超平面,使得离该超平面最近的样本点到该超平面的距离最大化。

具体来说,SVM通过将样本映射到高维特征空间,将低维线性不可分的问题转化为高维线性可分的问题。

然后,通过求解约束最优化问题,找到一个最优的超平面。

在这个过程中,只有一部分样本点被称为支持向量,它们离超平面最近。

二、文本分类任务文本分类是将文本按照一定的标准划分到不同的类别中。

在实际应用中,文本分类任务非常常见,如情感分析、垃圾邮件识别等。

文本分类任务的关键是将文本表示成机器学习算法可以处理的形式。

常用的文本表示方法有词袋模型(Bag-of-Words)和词向量(Word Embedding)。

词袋模型将文本看作是一个词的集合,忽略了词序和语法结构。

词向量则将每个词映射到一个实数向量,可以保留一定的语义信息。

三、使用支持向量机进行文本分类在使用支持向量机进行文本分类时,首先需要将文本表示成机器学习算法可以处理的形式。

常见的方法是使用词袋模型或词向量。

1. 词袋模型词袋模型将文本表示为一个固定长度的向量,向量中的每个维度表示一个词的出现频率或权重。

可以使用TF-IDF等方法对词的重要性进行加权。

2. 词向量词向量将每个词映射到一个实数向量。

常见的词向量模型有Word2Vec和GloVe等。

词向量可以保留一定的语义信息,更适合表示文本的语义特征。

在将文本表示成机器学习算法可以处理的形式后,可以使用支持向量机进行分类。

具体步骤如下:1. 划分训练集和测试集将标记好类别的文本数据集划分为训练集和测试集,通常采用交叉验证的方法。

如何使用支持向量机进行多标签分类(Ⅰ)

支持向量机(Support Vector Machine, SVM)是一种强大的机器学习算法,它在分类和回归问题中都有着广泛的应用。

在分类问题中,支持向量机可以用于对数据进行二分类或多分类。

同时,支持向量机也可以用于解决多标签分类问题,即一个样本可以属于多个标签。

本文将介绍如何使用支持向量机进行多标签分类,并讨论一些相关的技术和应用。

一、支持向量机简介支持向量机是一种监督学习算法,其基本思想是寻找一个超平面,将不同类别的样本分开。

在二分类问题中,这个超平面可以被表示为w·x+b=0,w是超平面的法向量,b是偏置项。

支持向量机的目标是找到一个超平面,使得不同类别的样本距禓超平面的间隔最大化。

这个间隔被称为“间隔最大化”。

支持向量机在解决二分类问题时非常有效,但是在处理多分类问题和多标签分类问题时也可以发挥作用。

在多标签分类问题中,每个样本可以同时属于多个标签。

支持向量机可以通过一些技巧和改进来解决这类问题。

二、使用支持向量机进行多标签分类在支持向量机中,通常使用“one-vs-rest”或“one-vs-one”策略来解决多类别分类问题。

对于多标签分类问题,我们可以将其转化为多类别分类问题。

具体来说,可以使用“one-vs-rest”策略来处理多标签分类问题。

假设有N个不同的标签,对于每个标签,我们可以将其与其他标签合并为一个新的二分类问题。

这样就可以将多标签分类问题转化为N个二分类问题。

接着,我们可以利用支持向量机来处理每个二分类问题,从而得到N个分类器。

对于一个新的样本,我们可以使用这N个分类器来进行预测,得到N个预测结果。

最后,我们可以根据这些预测结果来判断样本属于哪些标签。

这种方法可以很好地处理多标签分类问题,而且支持向量机在处理二分类问题时具有良好的性能,因此也可以在多标签分类问题中发挥作用。

三、支持向量机的改进技术在实际应用中,支持向量机可能会面临一些问题,比如处理大规模数据集时的效率问题、处理高维数据时的性能问题等。

测绘技术的遥感影像分类方法介绍

测绘技术的遥感影像分类方法介绍简介:遥感影像分类是测绘技术中的一项重要任务,通过对遥感影像进行分类,可以获得地表的信息,为土地利用规划、资源管理和环境监测提供重要依据。

本文将介绍几种常见的遥感影像分类方法,并对其原理和应用进行分析。

一、基于像元的遥感影像分类方法基于像元的遥感影像分类方法是最常见和最基础的分类方法之一。

在这种方法中,将遥感影像中的每个像元视为一个独立的单元,根据其反射率、光谱特征等属性进行分类。

1. 基于最大似然法的分类方法最大似然法是一种经典的统计学方法,在遥感影像分类中得到了广泛应用。

该方法通过计算每个像元属于每个类别的概率,选择具有最高概率的类别作为其分类结果。

应用案例:以土地利用分类为例,将遥感影像中的像元分为农田、城市、森林等类别,可以利用最大似然法计算每个像元在不同类别下的概率,并将其分配给概率最高的类别。

2. 基于支持向量机的分类方法支持向量机是一种机器学习方法,在遥感影像分类中也被广泛应用。

该方法通过构建一个超平面,将不同类别的样本点分开。

应用案例:以植被分类为例,可以利用支持向量机构建一个分类边界,将遥感影像中的植被和非植被分开。

通过训练一个支持向量机模型,可以对新的遥感影像进行分类。

二、基于对象的遥感影像分类方法基于对象的遥感影像分类方法相比于基于像元的方法,考虑了像元之间的空间关系,更能反映地物的形状和结构特征。

1. 基于区域生长的分类方法区域生长是一种基于灰度的图像分割方法,同时也可以应用于遥感影像的分类。

该方法通过选择种子点,并考虑像素之间的相似度,将相邻的像素聚合成一个区域。

应用案例:以水体提取为例,可以在遥感影像中选择几个已知的水体像素作为种子点,然后通过区域生长算法将其他相似的像素归为水体类别。

2. 基于对象特征的分类方法基于对象特征的分类方法是一种较为复杂的方法,它通过提取对象的形状、纹理、空间关系等特征,更准确地描述地物的属性。

应用案例:以建筑物分类为例,可以通过提取建筑物的纹理特征、形状特征等,结合机器学习方法进行分类。

如何使用支持向量机进行时间序列分类

支持向量机(Support Vector Machine, SVM)是一种强大的机器学习算法,其在时间序列分类中的应用越来越受到关注。

时间序列是一种按照时间顺序排列的数据,例如股票价格、气温变化等。

时间序列分类是指根据时间序列的特征将其分为不同的类别或标签。

在本文中,我们将探讨如何使用支持向量机进行时间序列分类,并结合实际案例进行说明。

SVM算法的基本原理是找到一个最佳的超平面,将不同类别的数据点分开,并且使得两侧的间隔最大化。

在时间序列分类中,我们可以将时间序列的特征提取出来,然后作为输入数据,利用SVM算法进行分类。

下面我们将详细介绍如何使用SVM进行时间序列分类的步骤。

第一步是数据预处理。

在进行时间序列分类之前,我们需要对原始数据进行预处理,包括去除噪声、平滑数据、标准化等。

这样可以提高分类的准确性和稳定性。

例如,如果我们要对股票价格进行分类,可以先对原始股票价格数据进行平滑处理,然后再提取特征进行分类。

第二步是特征提取。

在进行时间序列分类时,特征提取是非常重要的一步。

特征提取可以将原始的时间序列数据转换为具有代表性的特征向量,从而方便进行分类。

常用的特征提取方法包括傅里叶变换、小波变换、自相关系数等。

在实际操作中,我们可以根据具体的时间序列数据选择合适的特征提取方法,并将提取出来的特征作为SVM算法的输入。

第三步是模型训练和调参。

在进行时间序列分类时,我们需要将数据集划分为训练集和测试集,然后利用训练集对SVM模型进行训练。

在训练过程中,我们还需要进行一些参数的调优,例如选择合适的核函数、正则化参数等。

通过交叉验证等方法,找到最优的模型参数,从而提高分类的准确性和泛化能力。

第四步是模型评估和应用。

在训练好SVM模型之后,我们需要利用测试集对模型进行评估,计算分类的准确率、召回率等指标。

如果模型的性能达到了要求,我们就可以将其应用到实际的时间序列数据中,进行分类预测。

例如,我们可以利用训练好的SVM模型对未来一段时间内的股票价格进行分类预测,从而辅助投资决策。

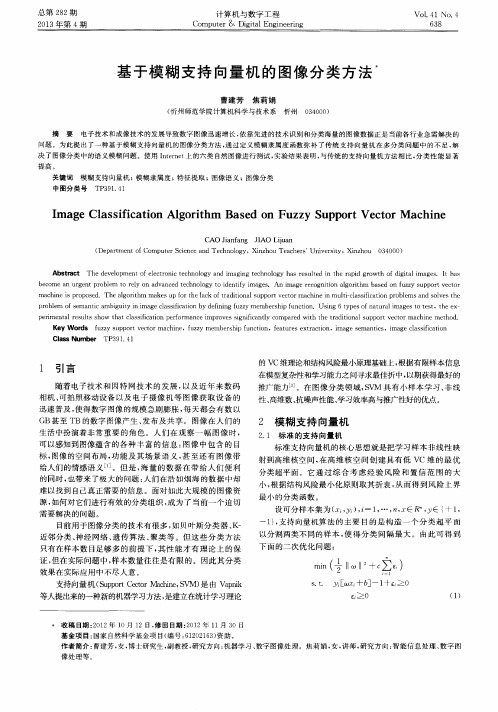

基于模糊支持向量机的图像分类方法

计算机与数字工程

Co mp u t e r& Di g i t a l E n g i n e e r i n g

Vo 1 . 4 1 No . 4

63 8ห้องสมุดไป่ตู้

基 于 模 糊 支 持 向量 机 的 图像 分 类 方 法

曹建芳 焦 莉 娟

提高 。

关键词

模 糊支持 向量机 ;模糊隶属度 ; 特征提取 ;图像语义 ;图像分类

T P 3 9 1 . 4 1

中图 分 类 号

I ma g e Cl a s s i f i c a t i o n Al g o r i t h m Ba s e d o n Fu z z y S u p p o r t Ve c t o r Ma c h i n e

ma c h i n e i s p r o p os e d .Th e a l go r i t h m ma k e s u p f o r t h e l a c k o f t r a d i t i o n a 1 s u p p o r t v e c t o r ma c hi ne i n mu l t i — c l a s s i f i c a t i o n p r ob l e ms a n d s o l v e s t he

Abs t r ac t The d e v e l o p me nt o f e l e c t r o ni c t e c h no l o gy a n d i ma g i n g t e c h n o l o gy ha s r e s ul t e d i n t h e r a p i d gr o wt h o f d i g i t a l i ma g e s .I t h a s b e c o me a n u r g e n t pr o b l e m t o r e l y o n a d v a n c e d t e c h n o l o g y t o i de n t i f y i ma g e s .An i ma g e r e c o g n i t i o n a l g o r i t h m b a s e d o n f u z z y s u p p o r t v e c t o r

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

基于支持向量机的分类方法

摘要:本文首先概述了支持向量机的相关理论,引出了支持向量机的基本模型。

当训练集的两类样本点集重合区域很大时,线性支持向量分类机就不适用了,由此介绍了核函数相关概念。

然后进行了核函数的实验仿真,并将支持向量机应用于实例肿瘤诊断,建立了相应的支持向量机模型,从而对测试集进行分类。

最后提出了一种支持向量机的改进算法,即根据类向心度对复杂的训练样本进行预删减。

1、支持向量机

给定训练样本集1122{[,],[,],

,[,]}()l l l T a y a y a y Y =∈Ω⨯L ,其中n i a R ∈Ω=,Ω是输入空间,每一个点i a 由n 个属性特征组成,{1,1},1,,i y Y i l ∈=-=L 。

分类

就是在基于训练集在样本空间中找到一个划分超平面,将不同的类别分开,划分超平面可通过线性方程来描述:

0T a b ω+=

其中12(;;;)d ωωωω=K 是法向量,决定了超平面的方向,b 是位移项,决定

了超平面与原点之间的距离。

样本空间中任意点到超平面的距离为||

||||

T a b r ωω+=。

支持向量、间隔:

假设超平面能将训练样本正确分类,即对于[,]i i a y T ∈,若1i y =+,则有

0T i a b ω+>,若1i y =-,则有0T i a b ω+<。

则有距离超平面最近的几个训练样本点使得

11

11

T i i T

i i a b y a b y ωω⎧+≥+=+⎨+≤-=-⎩ 中的等号成立,这几个训练样本点被称为支持向量;两个异类支持向量到超平面

的距离之和2

||||

r ω=被称为间隔。

支持向量机基本模型:

找到具有最大间隔的划分超平面,即

,2max

||||..()1,1,2,...,b T i i s t y a b i m

ωωω+≥= 这等价于

2

,||||min 2..()1,1,2,...,b T i i s t y a b i m

ωωω+≥= 这就是支持向量机(SVM )的基本模型。

支持向量机问题的特点是目标函数2

||||2

ω是ω的凸函数,并且约束条件都是

线性的。

可以将其转换为对偶问题进行求解,引入Lagrange 函数

2

1

1(,,)||||{1[()]}2l

i i i i L b y a b ωαωαω==+-⨯+∑

根据对偶的定义,对原问题中各变量的偏导置零可得:

0,0L L b ω∂∂==∂∂推出 11

,0l l

i i i i i i i y a y ωαα====∑∑ 代入Lagrange 函数化为原问题的Lagrange 对偶问题:

1111

1max ()20..0,1,,l l

l

i j i j i j i i j i l

i i i i

y y a a y s t i l αααααα====-⨯+⎧=⎪⎨⎪≥=⎩∑∑∑∑K 求解上述最优化问题,得到最优解***1[,,]T l ααα=L ,计算

*

*1

l

i i i i y a ωα==∑

由KKT 互补条件知

***{1[()]}0i i i y a b αω-⨯+=

可知当i a 为支持向量时,对应的*i α才为正,否则都为0。

选择*α的一个正分量*j α,同时计算 *

*1()l

j i i i j i b y y a a α==-⨯∑

因此构造分类超平面**()0x b ω⨯+=,并由此求得决策函数

**1()()l

i i i i g x y a x b α==⨯+∑

得到分类函数

**1()sgn[()]l

i i i i f x y a x b α==⨯+∑

从而对未知样本进行分类。

2、核函数

当训练集T 的两类样本点集重合区域很大时,线性支持向量分类机就不适用了,这是需要通过引进输入空间Ω到另一个高维的Hilbert 空间H 的变换()x x ψ→,将原输入空间Ω的训练集

1122{[,],[,],,[,]}()l l l T a y a y a y Y =∈Ω⨯L 转化为Hilbert 空间H 中新的训练集

112211{[,],[,],,[,]}{[

(),],,[(),]}l l l l T a y a y a y a y a y ψψ==%%%%L L 使其在Hilbert 空间H 中线性可分,然后在空间H 上求得超平面[()]0x b ωψ⨯+=,

这个超平面可以硬性划分训练集T %,原问题则转化为 2

1min ||||2

..{[()]}1,1,,i i s t y a b i l

ωωψ⨯+≥=L

采用核函数K 满足

(,)[()()]i j i j K a a a a ψψ=g

将避免在高维特征空间进行复杂的运算,不同的核函数形成不同的算法。

主要的核函数有:

(1) 线性内核函数:(,)()i j i j K a a a a =g (2) 多项式核函数:(,)[()1]q i j i j K a a a a =+g (3) 径向基核函数:2

2

||||(,)exp{}i j i j a a K a a δ

-=-

(4) S 形内核函数:(,)tanh[()]i j i j K a a v a a c =+g

(5) 傅里叶核函数: 2

2

11(,)2[12cos()]

n

i j k ik jk q K a a q a a q =-=--+∑ 因此同理可得其Lagrange 对偶问题,求解此最优化问题,得到最优解,构造分类函数,从而对未知样本进行分类。

3、实验仿真:

3.1 核函数仿真 随机构造数据集,使用不同的核函数对不同的数据集进行分类。

得到结果如下图。

图1 采用线性内核函数的SVM 图2 采用平方核函数的SVM

图3 采用高斯内核函数的SVM 图4 采用指数内核函数的SVM

图5 采用多层感知机核函数的SVM

从图中可以看出,不同的核函数使用于不同的数据集,对于不同的数据集,应选择合适的核函数,进行支持向量机分类。

3.2 基于支持向量机的肿瘤癌诊断

3.2.1 问题提出:

现有肿瘤数据cancerdata.txt 来自于确诊的500个病例,每个病例的一组数据包括采样细胞中10个特征量的平均值、标准差和最坏值共30个数据,即这500个病例为训练集。

另有69个病例,同样每个病例都包括采样细胞中10个特征量的数据,但不知道这69个病例是否真正患病。

要求使用支持向量机对其进行分类研究。

3.2.2模型建立:

记130,,x x L 分别表示30个指标变量,已知观测样本为[,]i i a y (1,,500i L ),。