多元线性回归模型基于spss分析

SPSS—回归—多元线性回归结果分析

SPSS—回归—多元线性回归结果分析(二),最近一直很忙,公司的潮起潮落,就好比人生的跌岩起伏,眼看着一步步走向衰弱,却无能为力,也许要学习“步步惊心”里面“四阿哥”的座右铭:“行到水穷处”,”坐看云起时“。

接着上一期的“多元线性回归解析”里面的内容,上一次,没有写结果分析,这次补上,结果分析如下所示:结果分析1:由于开始选择的是“逐步”法,逐步法是“向前”和“向后”的结合体,从结果可以看出,最先进入“线性回归模型”的是“price in thousands"建立了模型1,紧随其后的是“Wheelbase"建立了模型2,所以,模型中有此方法有个概率值,当小于等于0.05时,进入“线性回归模型”(最先进入模型的,相关性最强,关系最为密切)当大于等0.1时,从“线性模型中”剔除结果分析:1:从“模型汇总”中可以看出,有两个模型,(模型1和模型2)从R2 拟合优度来看,模型2的拟合优度明显比模型1要好一些(0.422>0.300)2:从“Anova"表中,可以看出“模型2”中的“回归平方和”为115.311,“残差平方和”为153.072,由于总平方和=回归平方和+残差平方和,由于残差平方和(即指随即误差,不可解释的误差)由于“回归平方和”跟“残差平方和”几乎接近,所有,此线性回归模型只解释了总平方和的一半,3:根据后面的“F统计量”的概率值为0.00,由于0.00<0.01,随着“自变量”的引入,其显著性概率值均远小于0.01,所以可以显著地拒绝总体回归系数为0的原假设,通过ANOVA方差分析表可以看出“销售量”与“价格”和“轴距”之间存在着线性关系,至于线性关系的强弱,需要进一步进行分析。

结果分析:1:从“已排除的变量”表中,可以看出:“模型2”中各变量的T检的概率值都大于“0.05”所以,不能够引入“线性回归模型”必须剔除。

从“系数a” 表中可以看出:1:多元线性回归方程应该为:销售量=-1.822-0.055*价格+0.061*轴距但是,由于常数项的sig为(0.116>0.1) 所以常数项不具备显著性,所以,我们再看后面的“标准系数”,在标准系数一列中,可以看到“常数项”没有数值,已经被剔除所以:标准化的回归方程为:销售量=-0.59*价格+0.356*轴距2:再看最后一列“共线性统计量”,其中“价格”和“轴距”两个容差和“vif都一样,而且VIF 都为1.012,且都小于5,所以两个自变量之间没有出现共线性,容忍度和膨胀因子是互为倒数关系,容忍度越小,膨胀因子越大,发生共线性的可能性也越大从“共线性诊断”表中可以看出:1:共线性诊断采用的是“特征值”的方式,特征值主要用来刻画自变量的方差,诊断自变量间是否存在较强多重共线性的另一种方法是利用主成分分析法,基本思想是:如果自变量间确实存在较强的相关关系,那么它们之间必然存在信息重叠,于是就可以从这些自变量中提取出既能反应自变量信息(方差),而且有相互独立的因素(成分)来,该方法主要从自变量间的相关系数矩阵出发,计算相关系数矩阵的特征值,得到相应的若干成分。

基于SPSS多元线性回归分析的案例

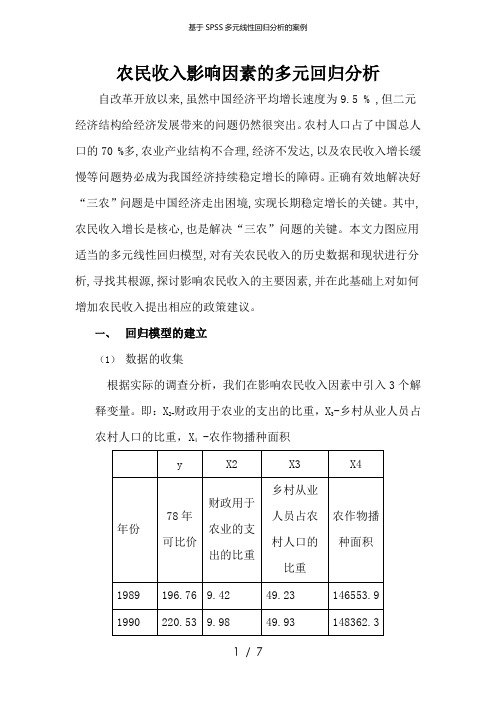

农民收入影响因素的多元回归分析自改革开放以来,虽然中国经济平均增长速度为9.5 % ,但二元经济结构给经济发展带来的问题仍然很突出。

农村人口占了中国总人口的70 %多,农业产业结构不合理,经济不发达,以及农民收入增长缓慢等问题势必成为我国经济持续稳定增长的障碍。

正确有效地解决好“三农”问题是中国经济走出困境,实现长期稳定增长的关键。

其中,农民收入增长是核心,也是解决“三农”问题的关键。

本文力图应用适当的多元线性回归模型,对有关农民收入的历史数据和现状进行分析,寻找其根源,探讨影响农民收入的主要因素,并在此基础上对如何增加农民收入提出相应的政策建议。

一、回归模型的建立(1)数据的收集根据实际的调查分析,我们在影响农民收入因素中引入3个解释变量。

即:X2-财政用于农业的支出的比重,X3-乡村从业人员占农村人口的比重,X4 -农作物播种面积1991223.2510.2650.92149585.8 1992233.1910.0551.53149007.1 1993265.679.4951.86147740.7 1994335.169.252.12148240.6 1995411.298.4352.41149879.3 1996460.688.8253.23152380.6 1997477.968.354.93153969.2 1998474.0210.6955.84155705.7 1999466.88.2357.16156372.8 2000466.167.7559.33156299.9 2001469.87.7160.62155707.9 2002468.957.1762.02154635.5 2003476.247.1263.721524152004499.399.6765.64153552.6 2005521.27.2267.59155487.7(1)回归模型的构建Y i=1+2X2+3X3+4X4+u i二、回归模型的分析(1)多重共线性检验系数a(2)模型异方差的检验异方差产生的原因有:数据质量原因、模型设定原因。

多元线性回归分析spss

多元线性回归分析spss

多元线性回归分析是一种常用的统计分析技术,用于对各因素之间的相互关系进行研究。

使用多元线性回归分析,可以检验一个或多个自变量对因变量具有统计学显著性的影响,从而推断出实际世界存在的不同因素可能带来的影响。

在spss中,我们使用下拉菜单选择“分析”>“回归”>“多元”来开始多元线性回归分析。

在多元线性回归窗口中,我们可以在右边的“可用变量”列中选择变量,拖拽到“因变量”和“自变量”栏中。

接下来,我们可以选择要使用的模型类型,其中包括多元线性回归,截距,变量中心以及相关的其他预测结果。

在进行模型拟合之前,我们可以在“多重共线性”复选框中对共线性进行调整,进行预测和显著性检验,并调整“参数估计”和“残差”复选框,自由地绘制结果。

在运行了多元线性回归分析之后,在spss中,我们可以在输出窗口中查看多元回归方程的系数和检验的结果,以及它们对回归系数的影响,残差分布情况,多重共线性分析和其他一些输出参数。

总而言之,spss中多元线性回归分析是一种有效的统计分析方法,可以用来检验多个自变量对回归方程的影响。

它具有许多内置功能,可以容易地针对回归系数和其他参数进行各种分析,提供了可信的结果,帮助人们深入了解各类因素对研究结果的影响。

SPSS实验多元线性回归分析12

这里我们以总成绩作为因变量Y,平时成绩和期中成绩分别作为自变量X1,X2,建立的多元回归模型为:

Байду номын сангаас2,估计参数,建立回归预测模型

利用SPSS可得一下结果:

Variables Entered/Removedb

Model

Variables Entered

Variables Removed

1183.800

19

a. Predictors: (Constant),期中成绩,平时成绩

b. Dependent Variable:总成绩

注释:从表中可得拟合方程的F统计量值为7.586,相应的P值为0.000说明,拟合方程是显著的。是具有统计意义的。

Coefficientsa

Model

Unstandardized Coefficients

Method

1

期中成绩,平时成绩a

.

Enter

a. All requested variables entered.

b. Dependent Variable:总成绩

注释:根据这个表的结果我们可以初步的知道,经过检验自变量X1,X2是可以加入到准备估计的回归方程中作为变量的。

Model Summaryb

Standardized Coefficients

t

Sig.

95% Confidence Interval for B

Correlations

Collinearity Statistics

B

Std. Error

Beta

Lower Bound

Upper Bound

Zero-order

spss多元线性回归分析结果解读

spss多元线性回归分析结果解读SPSS多元线性回归分析结果解读1. 引言多元线性回归分析是一种常用的统计分析方法,用于研究多个自变量对因变量的影响程度及相关性。

SPSS是一个强大的统计分析软件,可以进行多元线性回归分析并提供详细的结果解读。

本文将通过解读SPSS多元线性回归分析结果,帮助读者理解分析结果并做出合理的判断。

2. 数据收集与变量说明在进行多元线性回归分析之前,首先需要收集所需的数据,并明确变量的含义。

例如,假设我们正在研究学生的考试成绩与他们的学习时间、家庭背景、社会经济地位等因素之间的关系。

收集到的数据包括每个学生的考试成绩作为因变量,以及学习时间、家庭背景、社会经济地位等作为自变量。

变量说明应当明确每个变量的测量方式和含义。

3. 描述性统计分析在进行多元线性回归分析之前,我们可以首先对数据进行描述性统计分析,以了解各个变量的分布情况。

SPSS提供了丰富的描述性统计方法,如均值、标准差、最小值、最大值等。

通过描述性统计分析,我们可以获得每个变量的分布情况,如平均值、方差等。

4. 相关性分析多元线性回归的前提是自变量和因变量之间存在一定的相关性。

因此,在进行回归分析之前,通常需要进行相关性分析来验证自变量和因变量之间的关系。

SPSS提供了相关性分析的功能,我们可以得到每对变量之间的相关系数以及其显著性水平。

5. 多元线性回归模型完成了描述性统计分析和相关性分析后,我们可以构建多元线性回归模型。

SPSS提供了简单易用的界面,我们只需要选择因变量和自变量,然后点击进行回归分析。

在SPSS中,我们可以选择不同的回归方法,如逐步回归、前向回归、后向回归等。

6. 回归结果解读在进行多元线性回归分析后,SPSS将提供详细的回归结果。

我们可以看到每个自变量的系数、标准误差、t值、显著性水平等指标。

系数表示自变量与因变量之间的关系程度,标准误差表示估计系数的不确定性,t值表示系数的显著性,显著性水平则表示系数是否显著。

多元回归分析SPSS案例

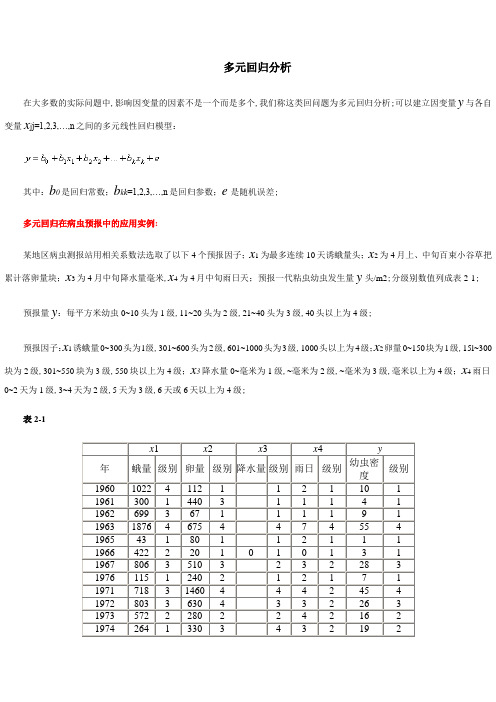

多元回归分析在大多数的实际问题中,影响因变量的因素不是一个而是多个,我们称这类回问题为多元回归分析;可以建立因变量y与各自变量x j j=1,2,3,…,n之间的多元线性回归模型:其中:b0是回归常数;b k k=1,2,3,…,n是回归参数;e是随机误差;多元回归在病虫预报中的应用实例:某地区病虫测报站用相关系数法选取了以下4个预报因子;x1为最多连续10天诱蛾量头;x2为4月上、中旬百束小谷草把累计落卵量块;x3为4月中旬降水量毫米,x4为4月中旬雨日天;预报一代粘虫幼虫发生量y头/m2;分级别数值列成表2-1;预报量y:每平方米幼虫0~10头为1级,11~20头为2级,21~40头为3级,40头以上为4级;预报因子:x1诱蛾量0~300头为l级,301~600头为2级,601~1000头为3级,1000头以上为4级;x2卵量0~150块为1级,15l~300块为2级,301~550块为3级,550块以上为4级;x3降水量0~毫米为1级,~毫米为2级,~毫米为3级,毫米以上为4级;x4雨日0~2天为1级,3~4天为2级,5天为3级,6天或6天以上为4级;表2-1x1 x2 x3 x4 y年蛾量级别卵量级别降水量级别雨日级别幼虫密度级别1960 1022 4 112 1 1 2 1 10 1 1961 300 1 440 3 1 1 1 4 1 1962 699 3 67 1 1 1 1 9 1 1963 1876 4 675 4 4 7 4 55 4 1965 43 1 80 1 1 2 1 1 1 1966 422 2 20 1 0 1 0 1 3 1 1967 806 3 510 3 2 3 2 28 3 1976 115 1 240 2 1 2 1 7 1 1971 718 3 1460 4 4 4 2 45 4 1972 803 3 630 4 3 3 2 26 3 1973 572 2 280 2 2 4 2 16 2 1974 264 1 330 3 4 3 2 19 2数据保存在“”文件中;1准备分析数据在SPSS数据编辑窗口中,创建“年份”、“蛾量”、“卵量”、“降水量”、“雨日”和“幼虫密度”变量,并输入数据;再创建蛾量、卵量、降水量、雨日和幼虫密度的分级变量“x1”、“x2”、“x3”、“x4”和“y”,它们对应的分级数值可以在SPSS数据编辑窗口中通过计算产生;编辑后的数据显示如图2-1;图2-1或者打开已存在的数据文件“”;2启动线性回归过程单击SPSS主菜单的“Analyze”下的“Regression”中“Linear”项,将打开如图2-2所示的线性回归过程窗口;图2-2 线性回归对话窗口3 设置分析变量设置因变量:用鼠标选中左边变量列表中的“幼虫密度y”变量,然后点击“Dependent”栏左边的向右拉按钮,该变量就移到“Dependent”因变量显示栏里;设置自变量:将左边变量列表中的“蛾量x1”、“卵量x2”、“降水量x3”、“雨日x4”变量,选移到“IndependentS”自变量显示栏里;设置控制变量: 本例子中不使用控制变量,所以不选择任何变量;选择标签变量: 选择“年份”为标签变量;选择加权变量: 本例子没有加权变量,因此不作任何设置;4回归方式本例子中的4个预报因子变量是经过相关系数法选取出来的,在回归分析时不做筛选;因此在“Method”框中选中“Enter”选项,建立全回归模型;5设置输出统计量单击“Statistics”按钮,将打开如图2-3所示的对话框;该对话框用于设置相关参数;其中各项的意义分别为:图2-3 “Statistics”对话框①“Regression Coefficients”回归系数选项:“Estimates”输出回归系数和相关统计量;“Confidence interval”回归系数的95%置信区间;“Covariance matrix”回归系数的方差-协方差矩阵;本例子选择“Estimates”输出回归系数和相关统计量;②“Residuals”残差选项:“Durbin-Watson”Durbin-Watson检验;“Casewise diagnostic”输出满足选择条件的观测量的相关信息;选择该项,下面两项处于可选状态:“Outliers outside standard deviations”选择标准化残差的绝对值大于输入值的观测量;“All cases”选择所有观测量;本例子都不选;③其它输入选项“Model fit”输出相关系数、相关系数平方、调整系数、估计标准误、ANOVA表;“R squared change”输出由于加入和剔除变量而引起的复相关系数平方的变化;“Descriptives”输出变量矩阵、标准差和相关系数单侧显著性水平矩阵;“Part and partial correlation”相关系数和偏相关系数;“Collinearity diagnostics”显示单个变量和共线性分析的公差;本例子选择“Model fit”项;6绘图选项在主对话框单击“Plots”按钮,将打开如图2-4所示的对话框窗口;该对话框用于设置要绘制的图形的参数;图中的“X”和“Y”框用于选择X轴和Y轴相应的变量;图2-4“Plots”绘图对话框窗口左上框中各项的意义分别为:•“DEPENDNT”因变量;•“ZPRED”标准化预测值;•“ZRESID”标准化残差;•“DRESID”删除残差;•“ADJPRED”调节预测值;•“SRESID”学生氏化残差;•“SDRESID”学生氏化删除残差;“Standardized Residual Plots”设置各变量的标准化残差图形输出;其中共包含两个选项:“Histogram”用直方图显示标准化残差;“Normal probability plots”比较标准化残差与正态残差的分布示意图;“Produce all partial plot”偏残差图;对每一个自变量生成其残差对因变量残差的散点图;本例子不作绘图,不选择;7 保存分析数据的选项在主对话框里单击“Save”按钮,将打开如图2-5所示的对话框;图2-5 “Save”对话框①“Predicted Values”预测值栏选项:Unstandardized 非标准化预测值;就会在当前数据文件中新添加一个以字符“PRE_”开头命名的变量,存放根据回归模型拟合的预测值;Standardized 标准化预测值;Adjusted 调整后预测值;. of mean predictions 预测值的标准误;本例选中“Unstandardized”非标准化预测值;②“Distances”距离栏选项:Mahalanobis: 距离;Cook’s”: Cook距离;Leverage values: 杠杆值;③“Prediction Intervals”预测区间选项:Mean: 区间的中心位置;Individual: 观测量上限和下限的预测区间;在当前数据文件中新添加一个以字符“LICI_”开头命名的变量,存放预测区间下限值;以字符“UICI_”开头命名的变量,存放预测区间上限值;Confidence Interval:置信度;本例不选;④“Save to New File”保存为新文件:选中“Coefficient statistics”项将回归系数保存到指定的文件中;本例不选;⑤“Export model information to XML file”导出统计过程中的回归模型信息到指定文件;本例不选;⑥“Residuals” 保存残差选项:“Unstandardized”非标准化残差;“Standardized”标准化残差;“Studentized”学生氏化残差;“Deleted”删除残差;“Studentized deleted”学生氏化删除残差;本例不选;⑦“Influence Statistics” 统计量的影响;“DfBetas”删除一个特定的观测值所引起的回归系数的变化;“Standardized DfBetas”标准化的DfBeta值;“DiFit” 删除一个特定的观测值所引起的预测值的变化;“Standardized DiFit”标准化的DiFit值;“Covariance ratio”删除一个观测值后的协方差矩隈的行列式和带有全部观测值的协方差矩阵的行列式的比率;本例子不保存任何分析变量,不选择;8其它选项在主对话框里单击“Options”按钮,将打开如图2-6所示的对话框;图2-6 “Options”设置对话框①“Stepping Method Criteria”框用于进行逐步回归时内部数值的设定;其中各项为:“Use probability of F”如果一个变量的F值的概率小于所设置的进入值Entry,那么这个变量将被选入回归方程中;当变量的F值的概率大于设置的剔除值Removal,则该变量将从回归方程中被剔除;由此可见,设置“Use probability of F”时,应使进入值小于剔除值;“Ues F value”如果一个变量的F值大于所设置的进入值Entry,那么这个变量将被选入回归方程中;当变量的F值小于设置的剔除值Removal,则该变量将从回归方程中被剔除;同时,设置“Use F value”时,应使进入值大于剔除值;本例是全回归不设置;②“Include constant in equation”选择此项表示在回归方程中有常数项;本例选中“Include constant in equation”选项在回归方程中保留常数项;③“Missing Values”框用于设置对缺失值的处理方法;其中各项为:“Exclude cases listwise”剔除所有含有缺失值的观测值;“Exchude cases pairwise”仅剔除参与统计分析计算的变量中含有缺失值的观测量;“Replace with mean”用变量的均值取代缺失值;本例选中“Exclude cases listwise”;9提交执行在主对话框里单击“OK”,提交执行,结果将显示在输出窗口中;主要结果见表2-2至表2-4;10 结果分析主要结果:表2-2表2-2 是回归模型统计量:R 是相关系数;R Square 相关系数的平方,又称判定系数,判定线性回归的拟合程度:用来说明用自变量解释因变量变异的程度所占比例;Adjusted R Square 调整后的判定系数;Std. Error of the Estimate 估计标准误差;表2-3表2-3 回归模型的方差分析表,F值为,显著性概率是,表明回归极显著;表2-4分析:建立回归模型:根据多元回归模型:把表6-9中“非标准化回归系数”栏目中的“B”列系数代入上式得预报方程:预测值的标准差可用剩余均方估计:回归方程的显著性检验:从表6-8方差分析表中得知:F统计量为,系统自动检验的显著性水平为;F,4,11值为,F,4,11 值为,F,4,11 值为;因此回归方程相关非常显著;F值可在Excel中用FINV 函数获得;回代检验需要作预报效果的验证时,在主对话框图6-8里单击“Save”按钮,在打开如图3-6所示对话框里,选中“Predicted Values”预测值选项栏中的“Unstandardized”非标准化预测值选项;这样在过程运算时,就会在当前文件中新添加一个“PRE_1”命名的变量,该变量存放根据回归模型拟合的预测值;然后,在SPSS数据窗口计算“y”与“PRE_1”变量的差值图2-7,本例子把绝对差值大于视为不符合,反之则符合;结果符合的年数为15年,1年不符合,历史符合率为%;图2-7多元回归分析法可综合多个预报因子的作用,作出预报,在统计预报中是一种应用较为普遍的方法;在实际运用中,采取将预报因子和预报量按一定标准分为多级,用分级尺度代换较大的数字,更能揭示预报因子与预报量的关系,预报效果比采用数量值统计方法有明显的提高,在实际应用中具有一定的现实意义;。

线性回归分析的SPSS操作(多元线性回归)

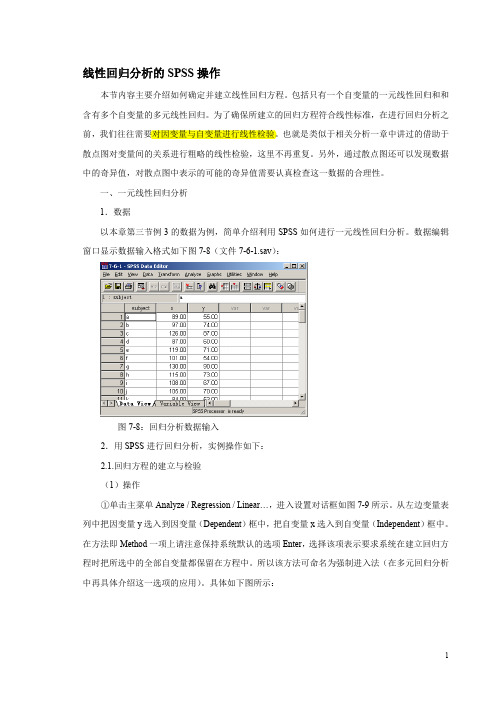

线性回归分析的SPSS操作本节内容主要介绍如何确定并建立线性回归方程。

包括只有一个自变量的一元线性回归和和含有多个自变量的多元线性回归。

为了确保所建立的回归方程符合线性标准,在进行回归分析之前,我们往往需要对因变量与自变量进行线性检验。

也就是类似于相关分析一章中讲过的借助于散点图对变量间的关系进行粗略的线性检验,这里不再重复。

另外,通过散点图还可以发现数据中的奇异值,对散点图中表示的可能的奇异值需要认真检查这一数据的合理性。

一、一元线性回归分析1.数据以本章第三节例3的数据为例,简单介绍利用SPSS如何进行一元线性回归分析。

数据编辑窗口显示数据输入格式如下图7-8(文件7-6-1.sav):图7-8:回归分析数据输入2.用SPSS进行回归分析,实例操作如下:2.1.回归方程的建立与检验(1)操作①单击主菜单Analyze / Regression / Linear…,进入设置对话框如图7-9所示。

从左边变量表列中把因变量y选入到因变量(Dependent)框中,把自变量x选入到自变量(Independent)框中。

在方法即Method一项上请注意保持系统默认的选项Enter,选择该项表示要求系统在建立回归方程时把所选中的全部自变量都保留在方程中。

所以该方法可命名为强制进入法(在多元回归分析中再具体介绍这一选项的应用)。

具体如下图所示:图7-9 线性回归分析主对话框②请单击Statistics…按钮,可以选择需要输出的一些统计量。

如Regression Coefficients(回归系数)中的Estimates,可以输出回归系数及相关统计量,包括回归系数B、标准误、标准化回归系数BETA、T值及显著性水平等。

Model fit项可输出相关系数R,测定系数R2,调整系数、估计标准误及方差分析表。

上述两项为默认选项,请注意保持选中。

设置如图7-10所示。

设置完成后点击Continue返回主对话框。

图7-10:线性回归分析的Statistics选项图7-11:线性回归分析的Options选项回归方程建立后,除了需要对方程的显著性进行检验外,还需要检验所建立的方程是否违反回归分析的假定,为此需进行多项残差分析。

多元线性回归spss

多元线性回归是一种用于描述一个或多个变量(自变量)之间关系的统计学方法。

多元线性回归可以用来预测或估计一个自变量(也称为解释变量)的值,基于一组其他的自变量(也称为预测变量)的值。

SPSS是一款专业的统计分析软件,可以用来进行多元线性回归分析。

使用SPSS进行多元线性回归的步骤如下:

1.准备数据:在SPSS中,你需要准备待分析的数据,包括自变量和因变量。

2.执行回归分析:在SPSS中,可以使用“分析”菜单中的“回归”选项,在此菜单中选择“多元线性回归”,并确定自变量和因变量。

3.分析结果:多元线性回归的结果将会显示在一个表格中,包括拟合参数,R方值,F 检验等。

通过对这些结果的分析,可以了解自变量对因变量的影响程度。

4.模型检验:SPSS也可以用于检验多元线性回归模型的合理性,包括残差分析、多重共线性检验、异方差性检验等。

多元线性回归分析是一项重要的数据分析技术,SPSS是一款功能强大的统计分析软件,提供了多元线性回归分析的完整功能,可以帮助研究者更好地探索数据的内在规律,从而更好地理解和把握数据的特点。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

多元线性回归模型

SPSS分

析

学院:数信学院

姓名:唐姣

学号:20124668

班级:统计3班

1.数据生成

根据给定回归模型Y=β0+β1*x1+β2*x2+err

生成100个生成数组(见附表格),其中=105、=0.5,、

=-0.3、err~N(50,6).

建立散点图

由图得知y与x1的线性关系为

由图得知y与x2的线性关系为

综合以上各个变量与y的关系可以综合得知各个x与y的关系为:Y=β0+β1*x1+β2*x2+err

其中:y~被解释变量(因变量)、x1, x2、x3~解释变量(回

归变量, 自变量)b、~回归系数e~随机误差(均值为零的正态分布随机变量)

2.模型拟合概述

列出模型的R、R2、调整的R2和估计标准差,R2

越大反应了两变量的共变量比率越高,模型与数据的拟合程度越好。

Model Summary b

Model R R Square Adjusted R Square Std. Error of the Estimate

1 1.000a 1.000 1.000 .000000179752611

a. Predictors: (Constant), err, x1, x2

本例所用数据拟合结果显示:所考察的自变量和因变量之间的相关系数为1.000,拟合线性回归的确定性系数为 1.000,经调整后的确定性系数为 1.000,估计标准差0.000000179752611。

3.方差分析表

列出了变异源、自由度、均方、F值及对F的显著性检验

ANOVA b

Model

Sum of

Squares df

Mean

Square F Sig.

1 Regressio

n

4705.011 3 1568.337 . .000a Residual .000 97 .000

Total 4705.011 100

a. Predictors: (Constant), err, x1, x2

b. Dependent Variable: y

本例中回归方程显著性检验结果表明:回归平方和为4705.011,残差平方和0.000,总平方和为4705.011,对应的F统计量的值为0.000,显著性水平小于0.05,可以认为所建立的回归方程有效。

4.回归系数表

Coefficients a

Model Unstandardized

Coefficients

Standardized

Coefficients

t Sig.

95% Confidence

Interval for B B

Std.

Error Beta

Lower

Bound

Upper

Bound

1 (Constant) 105.000 .000 1.559E8 .000 105.000 105.000 x1 .500 .000 .303 1.118E8 .000 .500 .500 x

2 -.300 .000 -.13

3 -4.885E7 .000 -.300 -.300

err 1.000 .000 .950 3.502E8 .000 1.000 1.000 a. Dependent Variable:

y

本例中因变量Y对两个自变量x1和X2的回归的非标准化回归系数分别0.500和-0.300;对应的显著性检验的t值分别为1.118E8和-4.885E7,两个回归系数B的显著性水平Sig.=0.000均小于0.05,可以认为自变量X1和X2对因变量Y均有显著影响。

本例回归分析得到的回归方程为:

y=105.000+0.500*x1-0.300*x2+err

5.正态性

6.残差分析

残差直方图

残差PP图

标准化预测值和标准化残差散点图

从图可以看出,标准化残差呈正态分布,残差均为0水平线上,说明变量之间没有线性关系。

所以可以推断回归方程不满足线性关系。

7.用Q-Q图进行参数分析

由以上Q-Q图检验得知y皆服从正态分布,所以上面所得数据在接收域中,故参数方程为Y=105+0.5*x1-0.3*x2+err

8.回归预测和区间估计

Residuals Statistics a

Minimum Maximum Mean Std. Deviation N

Predicted Value 1.63230819

702148E2 1.98899398

803711E2

1.8173296

9123264E2

6.859308482998

477E0

101

Std. Predicted Value -2.697 2.503 .000 1.000 101 Standard Error of Predicted

Value

.000 .000 .000 .000 101 Adjusted Predicted Value . . . . 0

Residual .000000000

000007 .000000000

000079

.00000000

0000044

.0000000000000

16

101

Std. Residual .000 .000 .000 .000 101 Stud. Residual . . . . 0 Deleted Residual . . . . 0 Stud. Deleted Residual . . . . 0 Mahal. Distance .057 10.587 2.970 2.344 101 Cook's Distance . . . . 0 Centered Leverage Value .001 .106 .030 .023 101 a. Dependent Variable: y

预测值的解释。