matlab 2011b 神经网络工具箱函数汇总

Matlab工具箱中地BP与RBF函数

Matlab工具箱中的BP与RBF函数Matlab神经网络工具箱中的函数非常丰富,给网络设置适宜的属性,可以加快网络的学习速度,缩短网络的学习进程。

限于篇幅,仅对本章所用到的函数进展介绍,其它的函数与其用法请读者参考联机文档和帮助。

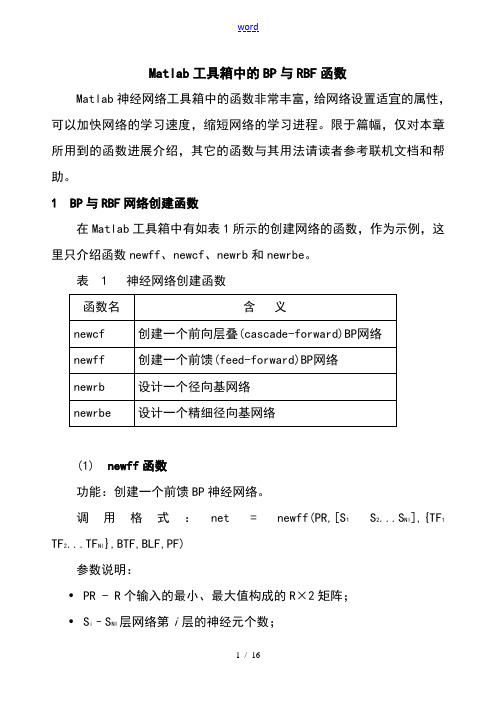

1 BP与RBF网络创建函数在Matlab工具箱中有如表1所示的创建网络的函数,作为示例,这里只介绍函数newff、newcf、newrb和newrbe。

表 1 神经网络创建函数(1) newff函数功能:创建一个前馈BP神经网络。

调用格式:net = newff(PR,[S1S2...S Nl],{TF1 TF2...TF Nl},BTF,BLF,PF)参数说明:•PR - R个输入的最小、最大值构成的R×2矩阵;•S i–S NI层网络第i层的神经元个数;•TF i - 第i层的传递函数,可以是任意可导函数,默认为 'tansig',可设置为logsig,purelin等;•BTF -反向传播网络训练函数,默认为 'trainlm',可设置为trainbfg,trainrp,traingd等;•BLF -反向传播权值、阈值学习函数,默认为 'learngdm';•PF -功能函数,默认为'mse';(2) newcf函数功能:创建一个N层的层叠(cascade)BP网络调用格式:net = newcf(Pr,[S1 S2...SNl],{TF1 TF2...TFNl},BTF,BLF,PF)参数同函数newff。

(3) newrb函数功能:创建一个径向基神经网络。

径向基网络可以用来对一个函数进展逼近。

newrb函数用来创建一个径向基网络,它可以是两参数网络,也可以是四参数网络。

在网络的隐层添加神经元,直到网络满足指定的均方误差要求。

调用格式:net = newrb(P,T,GOAL,SPREAD)参数说明:•P:Q个输入向量构成的R×Q矩阵;•T:Q个期望输出向量构成的S×Q矩阵;•GOAL:均方误差要求,默认为0。

MATLAB神经网络中各函数用法及一些要点(一)

MATLAB神经网络中各函数用法及一些要点(一)MATLAB神经网络中各函数用法及一些要点(一)1.网络建立函数MATLAB中的`feedforwardnet`函数用于建立前向神经网络。

它可以定义网络的结构,包括输入层、隐藏层和输出层的节点数、激活函数等。

例如,以下代码定义了一个具有10个输入、20个隐藏和1个输出节点的网络:```matlabnet = feedforwardnet([20]);```2.数据准备函数在训练网络之前,我们需要将输入数据和目标数据进行适当的格式转换。

`con2seq`函数可将连续数据转换为一个序列对象,`tonndata`函数则可以将数据转换为网络所需的格式。

例如:```matlabinputs = tonndata(input_data,false,false);targets = tonndata(target_data,false,false);```3.网络训练函数网络训练是神经网络的核心部分。

`train`函数用于训练网络,可采用不同的训练算法,如`trainlm`(Levenberg-Marquardt算法)或`traingdx`(自适应学习率的梯度下降算法)。

以下是训练网络的示例代码:```matlabnet.trainFcn = 'trainlm';net = train(net,inputs,targets);```4.网络仿真函数训练完成后,我们可以使用网络进行仿真和预测。

`sim`函数可用于进行网络仿真。

以下是使用已训练网络进行仿真的示例代码:```matlaboutputs = sim(net,inputs);```5.性能评估函数在训练和测试网络时,了解网络的性能表现是很重要的。

MATLAB提供了许多性能评估函数,如`mse`(均方误差)和`perform`(性能度量)。

例如:```matlabperf = mse(targets,outputs);```6.提取网络权重和偏差有时候我们需要访问网络的权重和偏差参数。

Matlab神经网络工具箱介绍与数值试验

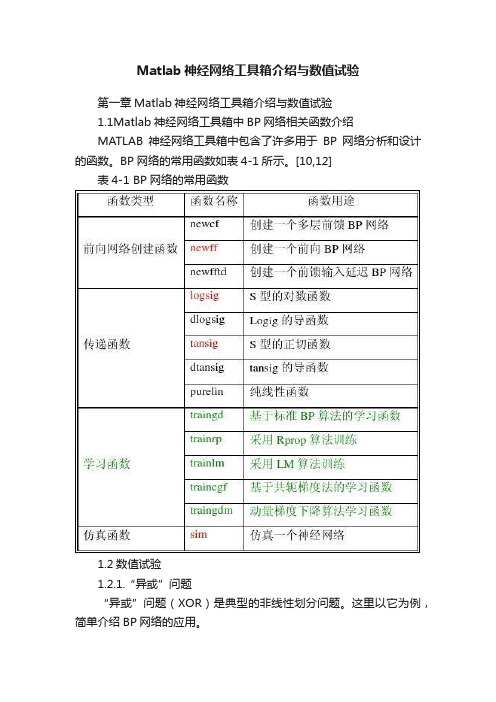

Matlab神经网络工具箱介绍与数值试验第一章Matlab神经网络工具箱介绍与数值试验1.1Matlab神经网络工具箱中BP网络相关函数介绍MATLAB神经网络工具箱中包含了许多用于BP网络分析和设计的函数。

BP网络的常用函数如表4-1所示。

[10,12]表4-1 BP网络的常用函数1.2数值试验1.2.1.“异或”问题“异或”问题(XOR)是典型的非线性划分问题。

这里以它为例,简单介绍BP网络的应用。

在Matlab7.0环境下,建立一个三层的BP神经网络,其中输入层和隐层分别各有两个神经元,输出层有一个神经元。

现要求训练这一网络,使其具有解决“异或”问题的能力。

“异或”问题的训练输入和期望输出如表5-1。

表5-1 异或问题的训练输入和期望输出1)基于标准BP 算法结果如下及图5.1所示:横轴表示迭代次数,纵轴表示误差。

迭代到第240次时达到预设精度。

迭代停止时,误差为9.97269e-005,此时的梯度为0.00924693。

5010015020010-410-310-210-110101240 EpochsT r a i n i n g -B l u e G o a l -B l a c kPerformance is 9.97269e-005, Goal is 0.0001图5.1 基于标准BP 算法的“异或”问题2)基于共轭梯度法结果如下及图5.2所示:横轴表示迭代次数,纵轴表示误差。

迭代到第16次时达到预设精度。

迭代停止时,误差为9.0770e-005,此时的梯度为0.00318592。

024681012141610-410-310-210-11010116 EpochsT r a i n i n g -B l u e G o a l -B l a c k Performance is 9.07705e-005, Goal is 0.0001图5.2 基于共轭梯度法的“异或”问题3)基于LM 算法结果如下及图5.3所示:横轴表示迭代次数,纵轴表示误差。

matlab神经网络工具箱简介和函数及示例

目前,神经网络工具箱中提供的神经网络模型主 要应用于:

函数逼近和模型拟合 信息处理和预测 神经网络控制 故障诊断

神经网络实现的具体操作过程:

• 确定信息表达方式; • 网络模型的确定; • 网络参数的选择; • 训练模式的确定; • 网络测试

• 确定信息表达方式:

将领域问题抽象为适合于网络求解所能接受的 某种数据形式。

函数类型 输入函数

其它

函数名 称

netsum netprcd concur dotprod

函数用途

输入求和函数 输入求积函数 使权值向量和阈值向量的结构一致 权值求积函数

BP网络的神经网络工具箱函数

函数类型

函数名称 函数用途

前向网络创建 函数

传递函数

学习函数

函数类型 性能函数 显示函数

函数名 函数用途 称

三、BP网络学习函数

learngd 该函数为梯度下降权值/阈值学习函数,通过神经 元的输入和误差,以及权值和阈值的学习速率, 来计算权值或阈值的变化率。

调用格式; [dW,ls]=learngd(W,P,Z,N,A,T,E,gW,gA,D,LP,LS)

二、神经元上的传递函数

传递函数是BP网络的重要组成部分,必须是连续可 微的,BP网络常采用S型的对数或正切函数和线性函数。

• Logsig 传递函数为S型的对数函数。 调用格式为: • A=logsig(N)

N:Q个S维的输入列向量; A:函数返回值,位于区间(0,1) 中

② info=logsig(code)

问题形式的种类:

数据样本已知; 数据样本之间相互关系不明确; 输入/输出模式为连续的或者离散的; 输入数据按照模式进行分类,模式可能会 具有平移、旋转或者伸缩等变化形式; 数据样本的预处理; 将数据样本分为训练样本和测试样本

第2章MATLAB神经网络工具箱函数

表2-1 神经网络的通用函数和功能

函数名

功能

init( )

初始化一个神经网络

initlay( ) 层-层结构神经网络的初始化函数

initwb( ) 神经网络某一层的权值和偏值初始化函数

initzero( ) 将权值设置为零的初始化函数

train( )

神经网络训练函数

adapt( )

神经网络自适应训练函数

b=[0;-1];q=3;

%权值向量和一致化所需要的长度

Z=concur(b,q)

%计算一致化了的矩阵

X1=netsum(Z1,Z2),X2=netprod(Z1,Z2) %计算向量的和与积

结果显示:

Z= 0 0 0

-1 -1 -1

X1 = 0 4 6

-2 -2 2

X2 = -1 4 8

-15 -24 1

11

7. 权值点积函数dotprod( ) 网络输入向量与权值的点积可得到加权输入。函数

dotprod ( )的调用格式为: Z=dotprod (W,X)

式中,W为SR维的权值矩阵;X为Q组R维的输入向量; Z为Q组S维的W与X 的点积。 8. 网络输入的和函数netsum( )

网络输入的和函数是通过某一层的加权输入和偏值相 加作为该层的输入。调用格式:

第2章 MATLAB神经网络 工具箱函数

2.1 MATLAB神经网络工具箱函数 2.2 MATLAB神经网络工具箱的图形用户界面

1

利用神经网络能解决许多用传统方法无法解 决的问题。神经网络在很多领域中都有应用,以 实现各种复杂的功能。这些领域包括商业及经济 估算、自动检测和监视、计算机视觉、语音处理、 机器人及自动控制、优化问题、航空航天、银行 金融业、工业生产等。而神经网络是一门发展很 快的学科,其应用领域也会随着其发展有更大的 拓宽。

matlab myneuralnetworkfunction整理成公式

matlab myneuralnetworkfunction整理成公式【原创实用版】目录1.MATLAB 与神经网络简介2.MATLAB 中的神经网络函数3.将 MATLAB 神经网络函数整理成公式正文1.MATLAB 与神经网络简介MATLAB 是一款广泛应用于科学计算、数据分析和可视化的编程语言。

在机器学习和深度学习领域,神经网络是一种重要的算法。

MATLAB 为神经网络的构建、训练和模拟提供了丰富的函数和工具箱。

2.MATLAB 中的神经网络函数在 MATLAB 中,我们可以使用神经网络工具箱(Neural Network Toolbox)中的函数来构建、训练和模拟神经网络。

常用的神经网络函数有:- create:创建神经网络对象- train:训练神经网络- simulate:模拟神经网络- 网络结构参数设置:如输入层神经元个数、隐藏层神经元个数等- 激活函数:如 sigmoid、tanh 等- 学习算法:如梯度下降、牛顿法等3.将 MATLAB 神经网络函数整理成公式为了方便理解和使用神经网络,我们可以将 MATLAB 神经网络函数整理成公式。

以一个简单的前馈神经网络为例:假设输入层神经元个数为 n,隐藏层神经元个数为 h,输出层神经元个数为 m,激活函数为 f(x),学习算法为梯度下降法,则可以得到以下公式:- 输入层到隐藏层:隐藏层神经元的输出值为输入层各神经元输出值的加权和,再经过激活函数 f(x) 处理,即:z_i = ∑w_ij * x_j + b_i,其中 w_ij 为权重,b_i 为偏置。

- 隐藏层到输出层:输出层神经元的输出值为隐藏层各神经元输出值的加权和,再经过激活函数 f(x) 处理,即:y_j = ∑w_hj * z_i + b_j,其中 w_hj 为权重,b_j 为偏置。

- 学习算法:权重 w 和偏置 b 的更新公式为:w_ij = w_ij - α * (z_i - y_j) * x_j,b_i = b_i - α * (z_i - y_j),其中α为学习率。

MATLAB神经网络之各函数介绍

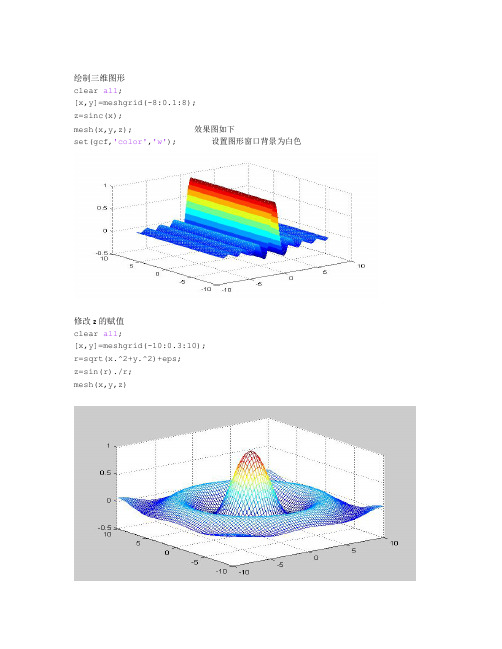

绘制三维图形clear all;[x,y]=meshgrid(-8:0.1:8);z=sinc(x);mesh(x,y,z);效果图如下set(gcf,'color','w');设置图形窗口背景为白色修改z的赋值clear all;[x,y]=meshgrid(-10:0.3:10);r=sqrt(x.^2+y.^2)+eps;z=sin(r)./r;mesh(x,y,z)初始化函数clear all;net=newp([0,1;-2,2],1);disp('³õʼ»¯Ö®Ç°µÄȨֵÊÇ£º')w1=net.iw{1,1}disp('³õʼ»¯Ö®Ç°µÄ·§ÖµÎª')b1=net.b{1}net.iw{1,1}=[5,6];disp('¡£¡£¡£È¨ÖµÎª')w2=net.iw{1,1}net.b{1}=7;disp('·§ÖµÎª')b2=net.b{1}net=init(net);利用网络初始化复原网络权值和阀值w3=net.iw{1,1}b3=net.b{1}例子:利用init函数将网络输入的权值与阀值改变为随机数>>clear all;net=newp([0,1;-2,2],1);net.inputweights{1,1}.initFcn='rands';net.biases{1}.initFcn='rands';net=init(net);检验权值和阀值w=net.iw{1,1}b=net.b{1}w=0.8116-0.7460b=0.6294>>plotpv函数:用于在坐标中绘制给定的样本点及其类别plotpc函数:用于绘制感知器分界线clear all;p=[-0.5,-0.5,0.3,-0.1,-0.8;-0.5,0.5,-0.5,1.0,0.0]; t=[1,1,0,0,0];plotpv(p,t);绘制样本节点net=newp([-40,1;-1,50],1);hold onlinehandles=plotpc(net.IW{1},net.b{1});net.adaptParam.passes=3;linehandle=plotpc(net.IW{1},net.b{1});for a=1:25[net,y,e]=adapt(net,p,t);linehandle=plotpc(net.iw{1},net.b{1},linehandle);drawnow;endtitle('the kind of xiangliang')在matlab中提供了sim函数,对于神经网络进行仿真,格式:[y,pf,af,perf]=sim(net,p,pi,ai,t)[y,pf,af]=sim(net,{q ts},pi,ai)设计一个输入为二维向量的感知器网络,其边界值已定。

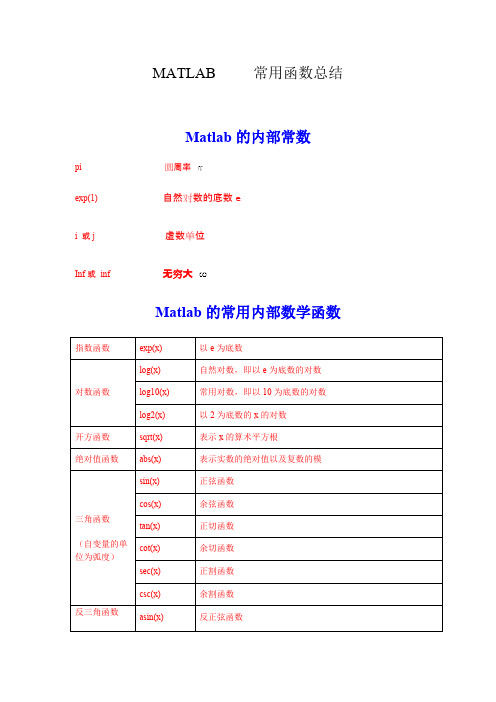

(完整版)MATLAB常用函数总结,推荐文档

MATLAB 常用函数总结Matlab 的内部常数pi 圆周率exp(1)自然对数的底数ei 或j虚数单位Inf 或 inf无穷大Matlab 的常用内部数学函数指数函数exp(x)以e 为底数log(x)自然对数,即以e 为底数的对数log10(x)常用对数,即以10为底数的对数对数函数log2(x)以2为底数的x 的对数开方函数sqrt(x)表示x 的算术平方根绝对值函数abs(x)表示实数的绝对值以及复数的模sin(x)正弦函数cos(x)余弦函数tan(x)正切函数cot(x)余切函数sec(x)正割函数三角函数(自变量的单位为弧度)csc(x)余割函数反三角函数asin(x)反正弦函数acos(x)反余弦函数atan(x)反正切函数acot(x)反余切函数asec(x)反正割函数acsc(x)反余割函数sinh(x)双曲正弦函数cosh(x)双曲余弦函数tanh(x)双曲正切函数coth(x)双曲余切函数sech(x)双曲正割函数双曲函数csch(x)双曲余割函数asinh(x)反双曲正弦函数acosh(x)反双曲余弦函数atanh(x)反双曲正切函数acoth(x)反双曲余切函数asech(x)反双曲正割函数反双曲函数acsch(x)反双曲余割函数求角度函数atan2(y,x)以坐标原点为顶点,x轴正半轴为始边,从原点到点(x,y)的射线为终边的角,其单位为弧度,范围为(,]gcd(a,b)两个整数的最大公约数数论函数lcm(a,b)两个整数的最小公倍数排列组合函数factorial(n)阶乘函数,表示n的阶乘real(z)实部函数imag(z)虚部函数复数函数abs(z)求复数z的模angle(z)求复数z 的辐角,其范围是( ,]conj(z)求复数z 的共轭复数ceil(x)表示大于或等于实数x 的最小整数floor(x)表示小于或等于实数x 的最大整数求整函数与截尾函数round(x)最接近x 的整数max([a ,b ,c ,...])求最大数最大、最小函数min([a ,b ,c ,..])求最小数符号函数sign(x)Matlab 中的数学运算符a+b 加法 a./b 数组右除a-b 减法 a.\b 数组左除a*b 矩阵乘法a^b 矩阵乘方a.*b 数组乘法 a.^b 数组乘方a/b 矩阵右除-a负号a\b矩阵左除' 共轭转置.'一般转置Matlab 的关系运算符 ==等于<小于>大于<=小于或等于>=大于或等于~=不等于如何用matlab求阶乘factorial(n) 求n的阶乘如何用matlab进行多项式运算(1)合并同类项 syms 表达式中包含的变量 collect(表达式,指定的变量)(2)因式分解 syms 表达式中包含的变量 factor(表达式)(3)展开syms 表达式中包含的变量 expand(表达式)(4)化简syms 表达式中包含的变量simplify(表达式) 如何用matlab进行复数运算 a+b*i 或 a +b*j表示复数a+bi 或 a+bjreal(z)求复数z的实部imag(z)求复数z的虚部abs(z)求复数z的模angle(z)求复数z的辐角,conj(z)求复数z的共轭复数exp(z)复数的指数函数,表示e^z如何用Matlab求集合的交集、并集、差集和补集 union(A,B)求集合A和B的并集intersect(A,B)求集合A和B的交集setdiff(A,B)求集合A和B的差集A-Bsetdiff(U,A)求集合A关于全集U的补集如何用matlab排序sort(v) 将向量v的元素从小到大排列(升序排列)sort(v,dim,’descend or ascend’)当dim=1时矩阵按列排序,descend or ascend用来控制升序还是降序当dim=2时矩阵按行排序,descend or ascend用来控制升序还是降序如何用Matlab求极限(1)极限:syms xlimit(f(x), x, a)求f(x)关于x趋于a时的极限(2)单侧极限:左极限:syms x limit(f(x), x, a,’left’)求f(x)关于x趋于a时的左极限右极限:syms x limit(f(x), x, a,’right’)求f(x)关于x趋于a时的右极限如何用Matlab求导数diff('f(x)') diff('f(x)','x') 求f(x)关于x的导数或者:syms x diff(f(x))syms x diff(f(x), x)如何用Matlab求高阶导数如何用Matlab求高阶导数diff('f(x)',n) diff('f(x)','x',n)求f(x)关于x的n阶导数syms x diff(f(x),n)syms x diff(f(x), x,n)如何用Matlab求不定积分int('f(x)') int ('f(x)','x')求f(x)关于x的积分syms x int(f(x))syms x int(f(x), x)如何用Matlab求定积分、广义积分int('f(x)',a,b) int ('f(x)','x',a,b)求f(x)关于x的积分,区间为a到b syms x int(f(x),a,b)syms x int(f(x), x,a,b)如何用Matlab展开级数syms x taylor(f(x), x, n,)a如何在Matlab中进行积分变换syms s tlaplace( f(t), t, s ) 拉普拉斯变换ilaplace( F(s), s, t ) 拉普拉斯变换的逆变换 syms t ωfourier( f(t), t, ω)傅立叶变换ifourier( F(ω), ω, t ) 傅立叶变换的逆变换 syms n zztrans( f(n), n, z) Z变换iztrans( F(z), z, n ) Z变换的逆变换 如何用Matlab解微分方程dsolve('微分方程','自变量')dsolve('微分方程','初始条件或边界条件','自变量') dsolve('D2x+2*x+x=sin(t)','x(0)=1','Dx(0)=1','t')如何用matlab求多变量函数的极限 以两个变量为例说明,多于两个变量的函数极限可以依次类推。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Graphical user interface functions.nnstart - Neural Network Start GUInctool - Neural network classification toolnftool - Neural Network Fitting Toolnntraintool - Neural network training toolnprtool - Neural network pattern recognition toolntstool - NFTool Neural Network Time Series Toolnntool - Neural Network Toolbox graphical user interface.view - View a neural network.Network creation functions.cascadeforwardnet - Cascade-forward neural network.competlayer - Competitive neural layer.distdelaynet - Distributed delay neural network.elmannet - Elman neural network.feedforwardnet - Feed-forward neural network.fitnet - Function fitting neural network.layrecnet - Layered recurrent neural network.linearlayer - Linear neural layer.lvqnet - Learning vector quantization (LVQ) neural network.narnet - Nonlinear auto-associative time-series network.narxnet - Nonlinear auto-associative time-series network with external input.newgrnn - Design a generalized regression neural network.newhop - Create a Hopfield recurrent network.newlind - Design a linear layer.newpnn - Design a probabilistic neural network.newrb - Design a radial basis network.newrbe - Design an exact radial basis network.patternnet - Pattern recognition neural network.perceptron - Perceptron.selforgmap - Self-organizing map.timedelaynet - Time-delay neural network.Using networks.network - Create a custom neural network.sim - Simulate a neural network.init - Initialize a neural network.adapt - Allow a neural network to adapt.train - Train a neural network.disp - Display a neural network's properties.display - Display the name and properties of a neural networkadddelay - Add a delay to a neural network's response.closeloop - Convert neural network open feedback to closed feedback loops.formwb - Form bias and weights into single vector.getwb - Get all network weight and bias values as a single vector. noloop - Remove neural network open and closed feedback loops. openloop - Convert neural network closed feedback to open feedback loops. removedelay - Remove a delay to a neural network's response.separatewb - Separate biases and weights from a weight/bias vector.setwb - Set all network weight and bias values with a single vector.Simulink support.gensim - Generate a Simulink block to simulate a neural network. setsiminit - Set neural network Simulink block initial conditionsgetsiminit - Get neural network Simulink block initial conditionsneural - Neural network Simulink blockset.Training functions.trainb - Batch training with weight & bias learning rules.trainbfg - BFGS quasi-Newton backpropagation.trainbr - Bayesian Regulation backpropagation.trainbu - Unsupervised batch training with weight & bias learning rules. trainbuwb - Unsupervised batch training with weight & bias learning rules. trainc - Cyclical order weight/bias training.traincgb - Conjugate gradient backpropagation with Powell-Beale restarts. traincgf - Conjugate gradient backpropagation with Fletcher-Reeves updates. traincgp - Conjugate gradient backpropagation with Polak-Ribiere updates. traingd - Gradient descent backpropagation.traingda - Gradient descent with adaptive lr backpropagation.traingdm - Gradient descent with momentum.traingdx - Gradient descent w/momentum & adaptive lr backpropagation. trainlm - Levenberg-Marquardt backpropagation.trainoss - One step secant backpropagation.trainr - Random order weight/bias training.trainrp - RPROP backpropagation.trainru - Unsupervised random order weight/bias training.trains - Sequential order weight/bias training.trainscg - Scaled conjugate gradient backpropagation.Plotting functions.plotconfusion - Plot classification confusion matrix.ploterrcorr - Plot autocorrelation of error time series.ploterrhist - Plot error histogram.plotfit - Plot function fit.plotinerrcorr - Plot input to error time series cross-correlation.plotperform - Plot network performance.plotregression - Plot linear regression.plotresponse - Plot dynamic network time-series response.plotroc - Plot receiver operating characteristic. plotsomhits - Plot self-organizing map sample hits. plotsomnc - Plot Self-organizing map neighbor connections. plotsomnd - Plot Self-organizing map neighbor distances. plotsomplanes - Plot self-organizing map weight planes. plotsompos - Plot self-organizing map weight positions. plotsomtop - Plot self-organizing map topology. plottrainstate - Plot training state values.plotwb - Plot Hinton diagrams of weight and bias values.Lists of other neural network implementation functions.nnadapt - Adapt functions.nnderivative - Derivative functions.nndistance - Distance functions.nndivision - Division functions.nninitlayer - Initialize layer functions.nninitnetwork - Initialize network functions.nninitweight - Initialize weight functions.nnlearn - Learning functions.nnnetinput - Net input functions.nnperformance - Performance functions.nnprocess - Processing functions.nnsearch - Line search functions.nntopology - Topology functions.nntransfer - Transfer functions.nnweight - Weight functions.Demonstrations, Datasets and Other Resourcesnndemos - Neural Network Toolbox demonstrations. nndatasets - Neural Network Toolbox datasets.nntextdemos - Neural Network Design textbook demonstrations. nntextbook - Neural Network Design textbook information.。