Continuum limit, Galilean invariance, and solitons in the quantum equivalent of the noisy B

基于MRT-LBM的方腔流动局部加密算法

基于MRT-LBM的方腔流动局部加密算法陈颂英;汪超;曲延鹏;王润堃【摘要】使用多参数弛豫模型的格子玻尔兹曼方法及D2Q9模型,对方腔流顶盖下方左右奇异角落处应用局部网格加密模拟方腔流动特性.在粗细网格界面上,建立了分布函数的转换公式,采用3次样条插值计算加密界面上插值点的参量,根据Chapman-Enskog分析,给出了应力计算公式.数值计算结果表明:对雷诺数1000的方腔流动,沿腔中心线的速度分布与经典文献结果对比效果良好,压力、涡量轮廓图的噪声明显降低,应力振荡明显减少,证实了所提局部加密方法的有效性.%Employing the D2Q9 model, grids at the double singular corners were locally refined to investigate the flow peculiarity of the lid driven cavity based on the multi-relaxation time of lattice Boltzmann method (MRT-LBM). The transferring formulae of the distribution functions were established between the coarse and fine grids. Parameters were interpolated with cubic spline implementation on the refined layers, and the stress expressions were given on the basis of the Chapman-Enskog. For the cavity flow with the Reynolds number 1 000,the simulation results showed that the velocity distribution along the cavity mid plane agrees with that of the classical benchmark very well,the noises on the pressure and vortex contours are significantly reduced,and the stress fluctuation obviously decreases. The computational results showed validation of the present method.【期刊名称】《东北大学学报(自然科学版)》【年(卷),期】2018(039)004【总页数】5页(P538-542)【关键词】格子Boltzmann;多参数弛豫模型;局部网格加密;方腔;D2Q9模型【作者】陈颂英;汪超;曲延鹏;王润堃【作者单位】山东大学高效洁净机械制造教育部重点实验室,山东济南 250061;山东大学高效洁净机械制造教育部重点实验室,山东济南 250061;山东大学高效洁净机械制造教育部重点实验室,山东济南 250061;山东大学高效洁净机械制造教育部重点实验室,山东济南 250061【正文语种】中文【中图分类】O35格子Boltzmann方法(LBM)[1-3]广泛应用于流体动力学计算中,采用Boltzmann 方程代替格子气自动机,并将该模型用于流体的数值计算[4-5],再引入平衡态分布函数,将碰撞算子用一个碰撞矩阵代替[6].在此基础上,单弛豫时间法(SRT)[7]进一步简化了碰撞算子.Qian等[8]提出格子BGK模型,D’humeriers[9]提出了一种广义LBE模型(GLBE),Lallemand等[10]对GLBE模型作了细致的理论分析,表明其在物理原理、参数选取和数值稳定性方面都有很大优势.Luo等[11]提出多弛豫碰撞模型在精度和数值稳定性方面都要优于单弛豫的BGK(Bhatnagar-Gross-Krok)碰撞模型,当对高雷诺数流动进行模拟时,BGK模型会产生数据波动,最终导致计算失稳[12].GLBE的碰撞过程使用多个弛豫时间,因此也称MRT(multi-relaxation-time)模型[13-16].多参数弛豫模型是目前使用最广泛的格子Boltzmann模型,其中Qian等[8]提出的D2Q9模型最具有代表性,目前已证明MRT-LBM模型不仅能提高计算稳定性,还能提高准确性,Peng等[17]提出浸入式边界LBM的多块模型,对方腔流进行分块网格处理来验证正确性,成功计算出方腔流的涡心,结果与Ghia等[18]的DNS计算结果值吻合.本文通过对物理量变化剧烈的左、右上方两角区域的网格进行局部加密处理,将流场进行分区,各区域使用不同密度的网格划分,同时通过区域间边界处的信息传递来实现计算的耦合,可显著提高计算效率.1 MRT加密算法1.1 多参数弛豫模型格子Boltzmann方法MRT-LBM方程为f(x+eiδt,t+δt)=f(x,t)-M-1S[m-meq] .(1)式中:f为节点上的分布函数;m为矩;meq为矩的平衡态;M为正交转换矩阵;S为驰豫系数矩阵.在MRT模型中,剪切黏度和体积黏度分别为(2)式中:/3;弛豫参数Sv与Se分别与剪切黏度和体积黏度有关.MRT模型的主要特征是在矩空间进行碰撞,然后在离散的速度方向进行迁移.1.2 局部加密方法图1为网格加密结构,在方腔左、右上角分别设有2个加密区,这里以左上角为例.粗网格区边界为ABC,加密区域边界为DEF,为了使两区域的信息得以互相传递,在中间分别加一过渡层.加密区过渡层为ABC,即与粗网格区边界重合;粗网格区过渡层为GHI,在粗网格区和加密区中,两节点之间的点(标记为×的叉点)为插值点,插值点上的信息可以通过相邻两点的3次样条插值[19]得到.图1 网格加密结构图Fig.1 Structure sketch of local grid refinement粗网格区c的网格尺寸为δxc,加密区f的网格尺寸为δxf,尺寸比例为n=δxc/δxf=δtc/δtf=2,由粗细网格区域内剪切黏度和体积黏度相同可得加密区和粗网格区的弛豫参数关系为(3)在区域边界上的正应力与剪应力应相等,由Chapman-Enskog分析知(4)根据粗细网格界面节点上对应应力分量连续,在这2个区域中3个非平衡态e,pxx,pxy之间的关系为(5)其他3个非平衡态矩为能量平方ε,x与y方向能量通量,由文献[19-20]得(6)由此可知,粗网格区与加密区之间的矩空间关系为.(7)加密区与粗网格区碰撞后的分布函数推导见文献[20],加密区碰撞后的分布函数为 .(8)式中:.(9)同样,粗网格区碰撞后的分布函数也可以由加密区碰撞后的函数得到:.(10)式中,2 数值计算结果与分析为了验证MRT-LBM模型进行局部加密提高计算精度的有效性,对方腔的左、右上角2个部位的局部网格加密(DCLR),如图2所示,这2个区域存在非常大的速度梯度.图2 二维方腔流局部网格加密(DCLR)布局Fig.2 Sketch of local grid refinement for two dimensional cavity流动雷诺数Re=LUw/v=1 000,其中L是方腔宽度,这里L=Nx=Ny=128.5;Uw是上端盖的驱动速度.v为剪切黏度,体积黏度ξ等于v,粗网格区内的.886 8,.8868;δtc=1;δxc=1;.54,.9,两个局部加密区的宽度Nxx=Nyy=39,dxf=0.5,由此确定的弛豫系数.641,.641,另外2个弛豫系数不变,即.54,.9.2.1 相对速度在初始是静止状态,经过一段充分长的时间后(超过200 000个粗网格时间步长),使得流动达到稳定.图3为所有速度都是方腔流达到稳定状态时的结果,将之与Ghia 等[18]的基准值和Wu等[21]的粗网格MRT-LBM模拟结果进行对比.由图3可知,沿腔内垂直几何中心线和腔内水平几何中心线的瞬时速度与Ghia的基准值非常接近,远超过Wu的模拟结果,可知加密网格处理后的数据更加精确.2.2 压力轮廓图如图4所示,左边是经过两角局部网格加密处理后的无量纲压力轮廓图,右边是Wu 所得出的无量纲压力轮廓图.通过对比,在速度不连续的方腔内左、右上角,粗网格处理后会存在非常多的噪声区域,而对两角进行局部加密后的压力图则有着非常明显的降噪效果.其次,在两角加密区和粗网格区的边界上的压力轮廓线是连续的,这说明了本文加密边界处理的正确性和可行性.2.3 涡量涡量分布如图5所示.加密后的方腔无量纲涡量图清晰地表现左、右上角两个奇异角落的漩涡强度,而粗网格所画出的无量纲涡量图在这两个角上存在较大嘈杂噪声,两角局部网格加密可以改善涡量图整体计算精度.图3 沿方腔中心线的速度Fig.3 Velocity along mid-plane2.4 应力由式(4)可以得到 xx,xy,中心截面上应力如图6所示,应力曲线始终是连续的,说明了应力分布图的正确性,加密后的应力剧烈振荡的曲线明显得以缓和.2.5 计算资源进行局部加密处理后,网格数量从16 641个加密到25 767个,增加了9 126个网格.单次循环的CPU时间由4.225 ms提高到了9.255 ms,牺牲了一定的计算时间.但是在内存占用方面,程序从4 164 kB内存提高到了6 447 kB,仅为1.55倍,却带来了显著的计算精度提升,这说明局部网格加密具有非常高的可行性.图4 方腔压力轮廓图Fig.4 Pressure contour of cavity(a)—DCLR; (b)—MRT-LBM.图5 方腔涡量图Fig.5 Vortex contour of cavity(a)—DCLR; (b)—MRT-LBM. 图6 方腔沿x=13的无量纲应力Fig.6 Normalized stress of cavity along x=13 3 结论1) 通过对顶盖驱动方腔的2个奇异角进行加密网格处理后,得到的相对速度更加精确,数值更接近Ghia的基准值,即局部加密能更好地传递数值,提高全场数据的精确性.2) 从得到的压力轮廓图和涡量轮廓图知:局部网格加密能够显著改善左、右上角的轮廓分布,噪声得到了极大改善,从而得到更清晰更精确的压力与涡量结果.3) 除了速度分布,本文还对方腔内的应力分布进行了验证.对奇异角落局部网格加密能够极大减少应力振荡,得出较为平滑的应力曲线,在以前的研究中没有报道,对今后的LBM研究具有一定的参考价值.参考文献:[1] Chen S,Doolen ttice Boltzmann method for fluid flows [J].Annual Review of Fluid Mechanics,1998,30:329-364.[2] Succi S.The lattice Boltzmann equation for fluid dynamics and beyond[M].Oxford:Clarendon Press,2001.[3] Yu D,Mei R,Luo L S,et al.Viscous flow computations with the method of lattice Boltzmann equation [J].Progress Aerospace Science,2003,39:329-367.[4] Frish U,Hasslaeher B,Porneau ttice-gas automata for the Navier-Stokes equations [J].Physical Review Letters,1986,56(14):1505-1508. [5] Menamara G R,Zanetti e of the Boltzmann equation to simulate lattice automata [J].Physical Review Letters,1988,61(20):2332-2335. [6] Higuera F J,Jimenez J.Boltzmann approach to lattice gas simulation [J].Euro-Physics Letters,1989,9(7):663-668.[7]Chen S,Chen H D.Martinez D,et ttice Boltzmann model for simulation of magneto hydrodynamics [J].Physical ReviewLetters,1991,67(27):3776-3779.[8] Qian Y H,D’Humieres D,Lallemand ttice BGK models for Navier-Stokes equation [J].Euro-Physics Letters,1992,17(6):479-484.[9] D’humieres D.Generalized lattice Boltzmann equations in AIAA rarefied gas dynamics:theory and applications[J].Progress Astronaut Aeronaut,1992,159:450-458.[10]Lallemand P,Luo L S.Theory of the lattice Boltzmannmethod:dispersion,dissipation,isotropy,Galilean invariance and stability [J].Physical Review E,2000,61:6546-6562.[11]Luo L S,Liao W,Chen X,et al.Numerics of the lattice Boltzmann method:effects of collision models on the lattice Boltzmann simulations [J].Physical Review E,2011,83(5):056710.[12]杨帆,施徐明,郭雪岩,等.多弛豫时间格子波尔兹曼方法的分块算法[J].排灌机械工程学报,2013(1):56-60.(Yang Fan,Shi Xu-ming,Guo Xue-yan,et al.Multi-block implementation of MRT-LBM [J].Journal of Drainage and Irrigation Machinery Engineering,2013(1):56-60.)[13]郭照立,郑楚光.格子Boltzmann方法的原理及应用[M].北京:科学出版社,2009:46-53.(Guo Zhao-li,Zheng Chu-guang.The principle and application of lattice Boltzmann method [M].Beijing:Science Press,2009:46-53.)[14]Shan F,Guo X S,Tu J,et al.Multi-relaxation-time lattice Boltzmann modeling of the acoustic field generated by focusedtransducer[J].International Journal of Modern Physics C,2017,28(3):38-52.[15]Humieres D,Ginzburg I,Krafczyk M,et al.Multiple relaxation-time lattice Boltzmann models in three dimensions [J].Philosophical Transaction of the Royal Society,2002,360:437-451.[16]Mei R,Luo L S,Lallemand P,et al.Consistent initial conditions for lattice Boltzmann simulation [J].Computer & Fluids,2006,35:855-862.[17]Peng Y,Shu C,Chew Y T,et al.Application of multi-block approach in the immersed boundary-lattice Boltzmann method for viscous fluid flows [J].Journal of Computational Physics,2006,218:460-478.[18]Ghia U,Ghia K N,Shin C T.High-resolutions for incompressible flow using the Navier-Stokes equations and a multi-grid method [J].Journal of Computational Physics,1982,48:387-411.[19]Farhat H,Lee J S.Fundamentals of migrating multi-block lattice Boltzmann model for immiscible mixtures in 2D geometries[J].International Journal of Multiphase Flow,2010,36:769-779.[20]Chen S Y,Peng C,Teng Y H,et al.Improving lattice Boltzmann simulation of moving particles in a viscous flow using local grid refinement[J].Computer & Fluids,2010,36(10):769-779.[21]Wu J S,Shao Y L.Simulation of lid-driven cavity flows by parallel lattice Boltzmann method using multi-relaxation-time scheme [J].International Journal of Numerical Method in Fluids,2004,46:921-937.。

continuum术语中文

continuum术语中文在数学中,continuum(连续体)是指一个无穷的连续集合。

该术语最早由德国数学家Georg Cantor在19世纪末引入,用于描述实数集(包括有理数和无理数)的无穷性质。

在集合论中,continuum通常指代具有与实数集相同基数的任何集合,包括一维线段、平面、立体以及更高维度的空间。

这个概念在数学中有着广泛的应用,涉及到微积分、几何、拓扑学等多个领域。

在微积分中,continuum通常用于描述无限小和无限大的概念。

例如,在求导和积分的过程中,我们将一个曲线视为由无数个无限小的线段组成的连续体,通过计算线段的斜率或面积来得到近似的结果。

这也是微积分的基本思想之一。

在几何学中,continuum用于描述平面和空间的连续性。

例如,我们可以将一条直线视为由无数个点组成的连续体,这条直线上的任意两点之间都可以通过插入无数个其他点来达到,使得直线上的点密度无限接近。

在拓扑学中,continuum指代一个连续的空间,即一个没有间断或断裂的空间。

这种连续性可以被形式化地定义为没有空隙或间断的性质。

例如,一维连续体可以是一个线段或一个环,二维连续体可以是一个平面或一个球面,三维连续体可以是一个立体或一个球体等。

连续性在拓扑学中是一个非常重要的概念,它可以帮助我们理解空间的性质和结构。

在物理学中,continuum被用于描述连续介质。

例如,流体力学中的连续介质假设流体由无穷多个无限小的粒子组成,每个粒子都与其周围的粒子相互作用。

这种连续性假设使得我们可以使用微分方程来描述流体的运动和行为。

总而言之,continuum是数学中一个非常重要的概念,用于描述连续性和无限性质。

无论在微积分、几何、拓扑学还是物理学等领域,连续性的概念都起到了至关重要的作用。

而理解和应用continuum的概念,对于深入研究这些领域的数学家、物理学家和工程师来说都至关重要。

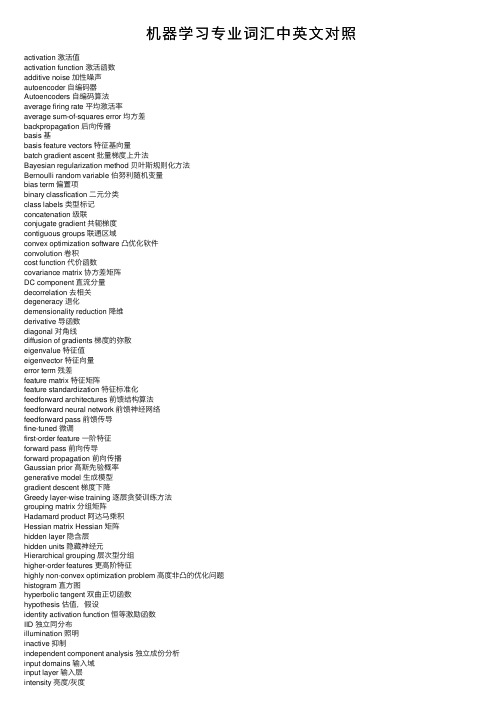

机器学习专业词汇中英文对照

机器学习专业词汇中英⽂对照activation 激活值activation function 激活函数additive noise 加性噪声autoencoder ⾃编码器Autoencoders ⾃编码算法average firing rate 平均激活率average sum-of-squares error 均⽅差backpropagation 后向传播basis 基basis feature vectors 特征基向量batch gradient ascent 批量梯度上升法Bayesian regularization method 贝叶斯规则化⽅法Bernoulli random variable 伯努利随机变量bias term 偏置项binary classfication ⼆元分类class labels 类型标记concatenation 级联conjugate gradient 共轭梯度contiguous groups 联通区域convex optimization software 凸优化软件convolution 卷积cost function 代价函数covariance matrix 协⽅差矩阵DC component 直流分量decorrelation 去相关degeneracy 退化demensionality reduction 降维derivative 导函数diagonal 对⾓线diffusion of gradients 梯度的弥散eigenvalue 特征值eigenvector 特征向量error term 残差feature matrix 特征矩阵feature standardization 特征标准化feedforward architectures 前馈结构算法feedforward neural network 前馈神经⽹络feedforward pass 前馈传导fine-tuned 微调first-order feature ⼀阶特征forward pass 前向传导forward propagation 前向传播Gaussian prior ⾼斯先验概率generative model ⽣成模型gradient descent 梯度下降Greedy layer-wise training 逐层贪婪训练⽅法grouping matrix 分组矩阵Hadamard product 阿达马乘积Hessian matrix Hessian 矩阵hidden layer 隐含层hidden units 隐藏神经元Hierarchical grouping 层次型分组higher-order features 更⾼阶特征highly non-convex optimization problem ⾼度⾮凸的优化问题histogram 直⽅图hyperbolic tangent 双曲正切函数hypothesis 估值,假设identity activation function 恒等激励函数IID 独⽴同分布illumination 照明inactive 抑制independent component analysis 独⽴成份分析input domains 输⼊域input layer 输⼊层intensity 亮度/灰度intercept term 截距KL divergence 相对熵KL divergence KL分散度k-Means K-均值learning rate 学习速率least squares 最⼩⼆乘法linear correspondence 线性响应linear superposition 线性叠加line-search algorithm 线搜索算法local mean subtraction 局部均值消减local optima 局部最优解logistic regression 逻辑回归loss function 损失函数low-pass filtering 低通滤波magnitude 幅值MAP 极⼤后验估计maximum likelihood estimation 极⼤似然估计mean 平均值MFCC Mel 倒频系数multi-class classification 多元分类neural networks 神经⽹络neuron 神经元Newton’s method ⽜顿法non-convex function ⾮凸函数non-linear feature ⾮线性特征norm 范式norm bounded 有界范数norm constrained 范数约束normalization 归⼀化numerical roundoff errors 数值舍⼊误差numerically checking 数值检验numerically reliable 数值计算上稳定object detection 物体检测objective function ⽬标函数off-by-one error 缺位错误orthogonalization 正交化output layer 输出层overall cost function 总体代价函数over-complete basis 超完备基over-fitting 过拟合parts of objects ⽬标的部件part-whole decompostion 部分-整体分解PCA 主元分析penalty term 惩罚因⼦per-example mean subtraction 逐样本均值消减pooling 池化pretrain 预训练principal components analysis 主成份分析quadratic constraints ⼆次约束RBMs 受限Boltzman机reconstruction based models 基于重构的模型reconstruction cost 重建代价reconstruction term 重构项redundant 冗余reflection matrix 反射矩阵regularization 正则化regularization term 正则化项rescaling 缩放robust 鲁棒性run ⾏程second-order feature ⼆阶特征sigmoid activation function S型激励函数significant digits 有效数字singular value 奇异值singular vector 奇异向量smoothed L1 penalty 平滑的L1范数惩罚Smoothed topographic L1 sparsity penalty 平滑地形L1稀疏惩罚函数smoothing 平滑Softmax Regresson Softmax回归sorted in decreasing order 降序排列source features 源特征sparse autoencoder 消减归⼀化Sparsity 稀疏性sparsity parameter 稀疏性参数sparsity penalty 稀疏惩罚square function 平⽅函数squared-error ⽅差stationary 平稳性(不变性)stationary stochastic process 平稳随机过程step-size 步长值supervised learning 监督学习symmetric positive semi-definite matrix 对称半正定矩阵symmetry breaking 对称失效tanh function 双曲正切函数the average activation 平均活跃度the derivative checking method 梯度验证⽅法the empirical distribution 经验分布函数the energy function 能量函数the Lagrange dual 拉格朗⽇对偶函数the log likelihood 对数似然函数the pixel intensity value 像素灰度值the rate of convergence 收敛速度topographic cost term 拓扑代价项topographic ordered 拓扑秩序transformation 变换translation invariant 平移不变性trivial answer 平凡解under-complete basis 不完备基unrolling 组合扩展unsupervised learning ⽆监督学习variance ⽅差vecotrized implementation 向量化实现vectorization ⽮量化visual cortex 视觉⽪层weight decay 权重衰减weighted average 加权平均值whitening ⽩化zero-mean 均值为零Letter AAccumulated error backpropagation 累积误差逆传播Activation Function 激活函数Adaptive Resonance Theory/ART ⾃适应谐振理论Addictive model 加性学习Adversarial Networks 对抗⽹络Affine Layer 仿射层Affinity matrix 亲和矩阵Agent 代理 / 智能体Algorithm 算法Alpha-beta pruning α-β剪枝Anomaly detection 异常检测Approximation 近似Area Under ROC Curve/AUC Roc 曲线下⾯积Artificial General Intelligence/AGI 通⽤⼈⼯智能Artificial Intelligence/AI ⼈⼯智能Association analysis 关联分析Attention mechanism 注意⼒机制Attribute conditional independence assumption 属性条件独⽴性假设Attribute space 属性空间Attribute value 属性值Autoencoder ⾃编码器Automatic speech recognition ⾃动语⾳识别Automatic summarization ⾃动摘要Average gradient 平均梯度Average-Pooling 平均池化Letter BBackpropagation Through Time 通过时间的反向传播Backpropagation/BP 反向传播Base learner 基学习器Base learning algorithm 基学习算法Batch Normalization/BN 批量归⼀化Bayes decision rule 贝叶斯判定准则Bayes Model Averaging/BMA 贝叶斯模型平均Bayes optimal classifier 贝叶斯最优分类器Bayesian decision theory 贝叶斯决策论Bayesian network 贝叶斯⽹络Between-class scatter matrix 类间散度矩阵Bias 偏置 / 偏差Bias-variance decomposition 偏差-⽅差分解Bias-Variance Dilemma 偏差 – ⽅差困境Bi-directional Long-Short Term Memory/Bi-LSTM 双向长短期记忆Binary classification ⼆分类Binomial test ⼆项检验Bi-partition ⼆分法Boltzmann machine 玻尔兹曼机Bootstrap sampling ⾃助采样法/可重复采样/有放回采样Bootstrapping ⾃助法Break-Event Point/BEP 平衡点Letter CCalibration 校准Cascade-Correlation 级联相关Categorical attribute 离散属性Class-conditional probability 类条件概率Classification and regression tree/CART 分类与回归树Classifier 分类器Class-imbalance 类别不平衡Closed -form 闭式Cluster 簇/类/集群Cluster analysis 聚类分析Clustering 聚类Clustering ensemble 聚类集成Co-adapting 共适应Coding matrix 编码矩阵COLT 国际学习理论会议Committee-based learning 基于委员会的学习Competitive learning 竞争型学习Component learner 组件学习器Comprehensibility 可解释性Computation Cost 计算成本Computational Linguistics 计算语⾔学Computer vision 计算机视觉Concept drift 概念漂移Concept Learning System /CLS 概念学习系统Conditional entropy 条件熵Conditional mutual information 条件互信息Conditional Probability Table/CPT 条件概率表Conditional random field/CRF 条件随机场Conditional risk 条件风险Confidence 置信度Confusion matrix 混淆矩阵Connection weight 连接权Connectionism 连结主义Consistency ⼀致性/相合性Contingency table 列联表Continuous attribute 连续属性Convergence 收敛Conversational agent 会话智能体Convex quadratic programming 凸⼆次规划Convexity 凸性Convolutional neural network/CNN 卷积神经⽹络Co-occurrence 同现Correlation coefficient 相关系数Cosine similarity 余弦相似度Cost curve 成本曲线Cost Function 成本函数Cost matrix 成本矩阵Cost-sensitive 成本敏感Cross entropy 交叉熵Cross validation 交叉验证Crowdsourcing 众包Curse of dimensionality 维数灾难Cut point 截断点Cutting plane algorithm 割平⾯法Letter DData mining 数据挖掘Data set 数据集Decision Boundary 决策边界Decision stump 决策树桩Decision tree 决策树/判定树Deduction 演绎Deep Belief Network 深度信念⽹络Deep Convolutional Generative Adversarial Network/DCGAN 深度卷积⽣成对抗⽹络Deep learning 深度学习Deep neural network/DNN 深度神经⽹络Deep Q-Learning 深度 Q 学习Deep Q-Network 深度 Q ⽹络Density estimation 密度估计Density-based clustering 密度聚类Differentiable neural computer 可微分神经计算机Dimensionality reduction algorithm 降维算法Directed edge 有向边Disagreement measure 不合度量Discriminative model 判别模型Discriminator 判别器Distance measure 距离度量Distance metric learning 距离度量学习Distribution 分布Divergence 散度Diversity measure 多样性度量/差异性度量Domain adaption 领域⾃适应Downsampling 下采样D-separation (Directed separation)有向分离Dual problem 对偶问题Dummy node 哑结点Dynamic Fusion 动态融合Dynamic programming 动态规划Letter EEigenvalue decomposition 特征值分解Embedding 嵌⼊Emotional analysis 情绪分析Empirical conditional entropy 经验条件熵Empirical entropy 经验熵Empirical error 经验误差Empirical risk 经验风险End-to-End 端到端Energy-based model 基于能量的模型Ensemble learning 集成学习Ensemble pruning 集成修剪Error Correcting Output Codes/ECOC 纠错输出码Error rate 错误率Error-ambiguity decomposition 误差-分歧分解Euclidean distance 欧⽒距离Evolutionary computation 演化计算Expectation-Maximization 期望最⼤化Expected loss 期望损失Exploding Gradient Problem 梯度爆炸问题Exponential loss function 指数损失函数Extreme Learning Machine/ELM 超限学习机Letter FFactorization 因⼦分解False negative 假负类False positive 假正类False Positive Rate/FPR 假正例率Feature engineering 特征⼯程Feature selection 特征选择Feature vector 特征向量Featured Learning 特征学习Feedforward Neural Networks/FNN 前馈神经⽹络Fine-tuning 微调Flipping output 翻转法Fluctuation 震荡Forward stagewise algorithm 前向分步算法Frequentist 频率主义学派Full-rank matrix 满秩矩阵Functional neuron 功能神经元Letter GGain ratio 增益率Game theory 博弈论Gaussian kernel function ⾼斯核函数Gaussian Mixture Model ⾼斯混合模型General Problem Solving 通⽤问题求解Generalization 泛化Generalization error 泛化误差Generalization error bound 泛化误差上界Generalized Lagrange function ⼴义拉格朗⽇函数Generalized linear model ⼴义线性模型Generalized Rayleigh quotient ⼴义瑞利商Generative Adversarial Networks/GAN ⽣成对抗⽹络Generative Model ⽣成模型Generator ⽣成器Genetic Algorithm/GA 遗传算法Gibbs sampling 吉布斯采样Gini index 基尼指数Global minimum 全局最⼩Global Optimization 全局优化Gradient boosting 梯度提升Gradient Descent 梯度下降Graph theory 图论Ground-truth 真相/真实Letter HHard margin 硬间隔Hard voting 硬投票Harmonic mean 调和平均Hesse matrix 海塞矩阵Hidden dynamic model 隐动态模型Hidden layer 隐藏层Hidden Markov Model/HMM 隐马尔可夫模型Hierarchical clustering 层次聚类Hilbert space 希尔伯特空间Hinge loss function 合页损失函数Hold-out 留出法Homogeneous 同质Hybrid computing 混合计算Hyperparameter 超参数Hypothesis 假设Hypothesis test 假设验证Letter IICML 国际机器学习会议Improved iterative scaling/IIS 改进的迭代尺度法Incremental learning 增量学习Independent and identically distributed/i.i.d. 独⽴同分布Independent Component Analysis/ICA 独⽴成分分析Indicator function 指⽰函数Individual learner 个体学习器Induction 归纳Inductive bias 归纳偏好Inductive learning 归纳学习Inductive Logic Programming/ILP 归纳逻辑程序设计Information entropy 信息熵Information gain 信息增益Input layer 输⼊层Insensitive loss 不敏感损失Inter-cluster similarity 簇间相似度International Conference for Machine Learning/ICML 国际机器学习⼤会Intra-cluster similarity 簇内相似度Intrinsic value 固有值Isometric Mapping/Isomap 等度量映射Isotonic regression 等分回归Iterative Dichotomiser 迭代⼆分器Letter KKernel method 核⽅法Kernel trick 核技巧Kernelized Linear Discriminant Analysis/KLDA 核线性判别分析K-fold cross validation k 折交叉验证/k 倍交叉验证K-Means Clustering K – 均值聚类K-Nearest Neighbours Algorithm/KNN K近邻算法Knowledge base 知识库Knowledge Representation 知识表征Letter LLabel space 标记空间Lagrange duality 拉格朗⽇对偶性Lagrange multiplier 拉格朗⽇乘⼦Laplace smoothing 拉普拉斯平滑Laplacian correction 拉普拉斯修正Latent Dirichlet Allocation 隐狄利克雷分布Latent semantic analysis 潜在语义分析Latent variable 隐变量Lazy learning 懒惰学习Learner 学习器Learning by analogy 类⽐学习Learning rate 学习率Learning Vector Quantization/LVQ 学习向量量化Least squares regression tree 最⼩⼆乘回归树Leave-One-Out/LOO 留⼀法linear chain conditional random field 线性链条件随机场Linear Discriminant Analysis/LDA 线性判别分析Linear model 线性模型Linear Regression 线性回归Link function 联系函数Local Markov property 局部马尔可夫性Local minimum 局部最⼩Log likelihood 对数似然Log odds/logit 对数⼏率Logistic Regression Logistic 回归Log-likelihood 对数似然Log-linear regression 对数线性回归Long-Short Term Memory/LSTM 长短期记忆Loss function 损失函数Letter MMachine translation/MT 机器翻译Macron-P 宏查准率Macron-R 宏查全率Majority voting 绝对多数投票法Manifold assumption 流形假设Manifold learning 流形学习Margin theory 间隔理论Marginal distribution 边际分布Marginal independence 边际独⽴性Marginalization 边际化Markov Chain Monte Carlo/MCMC 马尔可夫链蒙特卡罗⽅法Markov Random Field 马尔可夫随机场Maximal clique 最⼤团Maximum Likelihood Estimation/MLE 极⼤似然估计/极⼤似然法Maximum margin 最⼤间隔Maximum weighted spanning tree 最⼤带权⽣成树Max-Pooling 最⼤池化Mean squared error 均⽅误差Meta-learner 元学习器Metric learning 度量学习Micro-P 微查准率Micro-R 微查全率Minimal Description Length/MDL 最⼩描述长度Minimax game 极⼩极⼤博弈Misclassification cost 误分类成本Mixture of experts 混合专家Momentum 动量Moral graph 道德图/端正图Multi-class classification 多分类Multi-document summarization 多⽂档摘要Multi-layer feedforward neural networks 多层前馈神经⽹络Multilayer Perceptron/MLP 多层感知器Multimodal learning 多模态学习Multiple Dimensional Scaling 多维缩放Multiple linear regression 多元线性回归Multi-response Linear Regression /MLR 多响应线性回归Mutual information 互信息Letter NNaive bayes 朴素贝叶斯Naive Bayes Classifier 朴素贝叶斯分类器Named entity recognition 命名实体识别Nash equilibrium 纳什均衡Natural language generation/NLG ⾃然语⾔⽣成Natural language processing ⾃然语⾔处理Negative class 负类Negative correlation 负相关法Negative Log Likelihood 负对数似然Neighbourhood Component Analysis/NCA 近邻成分分析Neural Machine Translation 神经机器翻译Neural Turing Machine 神经图灵机Newton method ⽜顿法NIPS 国际神经信息处理系统会议No Free Lunch Theorem/NFL 没有免费的午餐定理Noise-contrastive estimation 噪⾳对⽐估计Nominal attribute 列名属性Non-convex optimization ⾮凸优化Nonlinear model ⾮线性模型Non-metric distance ⾮度量距离Non-negative matrix factorization ⾮负矩阵分解Non-ordinal attribute ⽆序属性Non-Saturating Game ⾮饱和博弈Norm 范数Normalization 归⼀化Nuclear norm 核范数Numerical attribute 数值属性Letter OObjective function ⽬标函数Oblique decision tree 斜决策树Occam’s razor 奥卡姆剃⼑Odds ⼏率Off-Policy 离策略One shot learning ⼀次性学习One-Dependent Estimator/ODE 独依赖估计On-Policy 在策略Ordinal attribute 有序属性Out-of-bag estimate 包外估计Output layer 输出层Output smearing 输出调制法Overfitting 过拟合/过配Oversampling 过采样Letter PPaired t-test 成对 t 检验Pairwise 成对型Pairwise Markov property 成对马尔可夫性Parameter 参数Parameter estimation 参数估计Parameter tuning 调参Parse tree 解析树Particle Swarm Optimization/PSO 粒⼦群优化算法Part-of-speech tagging 词性标注Perceptron 感知机Performance measure 性能度量Plug and Play Generative Network 即插即⽤⽣成⽹络Plurality voting 相对多数投票法Polarity detection 极性检测Polynomial kernel function 多项式核函数Pooling 池化Positive class 正类Positive definite matrix 正定矩阵Post-hoc test 后续检验Post-pruning 后剪枝potential function 势函数Precision 查准率/准确率Prepruning 预剪枝Principal component analysis/PCA 主成分分析Principle of multiple explanations 多释原则Prior 先验Probability Graphical Model 概率图模型Proximal Gradient Descent/PGD 近端梯度下降Pruning 剪枝Pseudo-label 伪标记Letter QQuantized Neural Network 量⼦化神经⽹络Quantum computer 量⼦计算机Quantum Computing 量⼦计算Quasi Newton method 拟⽜顿法Letter RRadial Basis Function/RBF 径向基函数Random Forest Algorithm 随机森林算法Random walk 随机漫步Recall 查全率/召回率Receiver Operating Characteristic/ROC 受试者⼯作特征Rectified Linear Unit/ReLU 线性修正单元Recurrent Neural Network 循环神经⽹络Recursive neural network 递归神经⽹络Reference model 参考模型Regression 回归Regularization 正则化Reinforcement learning/RL 强化学习Representation learning 表征学习Representer theorem 表⽰定理reproducing kernel Hilbert space/RKHS 再⽣核希尔伯特空间Re-sampling 重采样法Rescaling 再缩放Residual Mapping 残差映射Residual Network 残差⽹络Restricted Boltzmann Machine/RBM 受限玻尔兹曼机Restricted Isometry Property/RIP 限定等距性Re-weighting 重赋权法Robustness 稳健性/鲁棒性Root node 根结点Rule Engine 规则引擎Rule learning 规则学习Letter SSaddle point 鞍点Sample space 样本空间Sampling 采样Score function 评分函数Self-Driving ⾃动驾驶Self-Organizing Map/SOM ⾃组织映射Semi-naive Bayes classifiers 半朴素贝叶斯分类器Semi-Supervised Learning 半监督学习semi-Supervised Support Vector Machine 半监督⽀持向量机Sentiment analysis 情感分析Separating hyperplane 分离超平⾯Sigmoid function Sigmoid 函数Similarity measure 相似度度量Simulated annealing 模拟退⽕Simultaneous localization and mapping 同步定位与地图构建Singular Value Decomposition 奇异值分解Slack variables 松弛变量Smoothing 平滑Soft margin 软间隔Soft margin maximization 软间隔最⼤化Soft voting 软投票Sparse representation 稀疏表征Sparsity 稀疏性Specialization 特化Spectral Clustering 谱聚类Speech Recognition 语⾳识别Splitting variable 切分变量Squashing function 挤压函数Stability-plasticity dilemma 可塑性-稳定性困境Statistical learning 统计学习Status feature function 状态特征函Stochastic gradient descent 随机梯度下降Stratified sampling 分层采样Structural risk 结构风险Structural risk minimization/SRM 结构风险最⼩化Subspace ⼦空间Supervised learning 监督学习/有导师学习support vector expansion ⽀持向量展式Support Vector Machine/SVM ⽀持向量机Surrogat loss 替代损失Surrogate function 替代函数Symbolic learning 符号学习Symbolism 符号主义Synset 同义词集Letter TT-Distribution Stochastic Neighbour Embedding/t-SNE T – 分布随机近邻嵌⼊Tensor 张量Tensor Processing Units/TPU 张量处理单元The least square method 最⼩⼆乘法Threshold 阈值Threshold logic unit 阈值逻辑单元Threshold-moving 阈值移动Time Step 时间步骤Tokenization 标记化Training error 训练误差Training instance 训练⽰例/训练例Transductive learning 直推学习Transfer learning 迁移学习Treebank 树库Tria-by-error 试错法True negative 真负类True positive 真正类True Positive Rate/TPR 真正例率Turing Machine 图灵机Twice-learning ⼆次学习Letter UUnderfitting ⽋拟合/⽋配Undersampling ⽋采样Understandability 可理解性Unequal cost ⾮均等代价Unit-step function 单位阶跃函数Univariate decision tree 单变量决策树Unsupervised learning ⽆监督学习/⽆导师学习Unsupervised layer-wise training ⽆监督逐层训练Upsampling 上采样Letter VVanishing Gradient Problem 梯度消失问题Variational inference 变分推断VC Theory VC维理论Version space 版本空间Viterbi algorithm 维特⽐算法Von Neumann architecture 冯 · 诺伊曼架构Letter WWasserstein GAN/WGAN Wasserstein⽣成对抗⽹络Weak learner 弱学习器Weight 权重Weight sharing 权共享Weighted voting 加权投票法Within-class scatter matrix 类内散度矩阵Word embedding 词嵌⼊Word sense disambiguation 词义消歧Letter ZZero-data learning 零数据学习Zero-shot learning 零次学习Aapproximations近似值arbitrary随意的affine仿射的arbitrary任意的amino acid氨基酸amenable经得起检验的axiom公理,原则abstract提取architecture架构,体系结构;建造业absolute绝对的arsenal军⽕库assignment分配algebra线性代数asymptotically⽆症状的appropriate恰当的Bbias偏差brevity简短,简洁;短暂broader⼴泛briefly简短的batch批量Cconvergence 收敛,集中到⼀点convex凸的contours轮廓constraint约束constant常理commercial商务的complementarity补充coordinate ascent同等级上升clipping剪下物;剪报;修剪component分量;部件continuous连续的covariance协⽅差canonical正规的,正则的concave⾮凸的corresponds相符合;相当;通信corollary推论concrete具体的事物,实在的东西cross validation交叉验证correlation相互关系convention约定cluster⼀簇centroids 质⼼,形⼼converge收敛computationally计算(机)的calculus计算Dderive获得,取得dual⼆元的duality⼆元性;⼆象性;对偶性derivation求导;得到;起源denote预⽰,表⽰,是…的标志;意味着,[逻]指称divergence 散度;发散性dimension尺度,规格;维数dot⼩圆点distortion变形density概率密度函数discrete离散的discriminative有识别能⼒的diagonal对⾓dispersion分散,散开determinant决定因素disjoint不相交的Eencounter遇到ellipses椭圆equality等式extra额外的empirical经验;观察ennmerate例举,计数exceed超过,越出expectation期望efficient⽣效的endow赋予explicitly清楚的exponential family指数家族equivalently等价的Ffeasible可⾏的forary初次尝试finite有限的,限定的forgo摒弃,放弃fliter过滤frequentist最常发⽣的forward search前向式搜索formalize使定形Ggeneralized归纳的generalization概括,归纳;普遍化;判断(根据不⾜)guarantee保证;抵押品generate形成,产⽣geometric margins⼏何边界gap裂⼝generative⽣产的;有⽣产⼒的Hheuristic启发式的;启发法;启发程序hone怀恋;磨hyperplane超平⾯Linitial最初的implement执⾏intuitive凭直觉获知的incremental增加的intercept截距intuitious直觉instantiation例⼦indicator指⽰物,指⽰器interative重复的,迭代的integral积分identical相等的;完全相同的indicate表⽰,指出invariance不变性,恒定性impose把…强加于intermediate中间的interpretation解释,翻译Jjoint distribution联合概率Llieu替代logarithmic对数的,⽤对数表⽰的latent潜在的Leave-one-out cross validation留⼀法交叉验证Mmagnitude巨⼤mapping绘图,制图;映射matrix矩阵mutual相互的,共同的monotonically单调的minor较⼩的,次要的multinomial多项的multi-class classification⼆分类问题Nnasty讨厌的notation标志,注释naïve朴素的Oobtain得到oscillate摆动optimization problem最优化问题objective function⽬标函数optimal最理想的orthogonal(⽮量,矩阵等)正交的orientation⽅向ordinary普通的occasionally偶然的Ppartial derivative偏导数property性质proportional成⽐例的primal原始的,最初的permit允许pseudocode伪代码permissible可允许的polynomial多项式preliminary预备precision精度perturbation 不安,扰乱poist假定,设想positive semi-definite半正定的parentheses圆括号posterior probability后验概率plementarity补充pictorially图像的parameterize确定…的参数poisson distribution柏松分布pertinent相关的Qquadratic⼆次的quantity量,数量;分量query疑问的Rregularization使系统化;调整reoptimize重新优化restrict限制;限定;约束reminiscent回忆往事的;提醒的;使⼈联想…的(of)remark注意random variable随机变量respect考虑respectively各⾃的;分别的redundant过多的;冗余的Ssusceptible敏感的stochastic可能的;随机的symmetric对称的sophisticated复杂的spurious假的;伪造的subtract减去;减法器simultaneously同时发⽣地;同步地suffice满⾜scarce稀有的,难得的split分解,分离subset⼦集statistic统计量successive iteratious连续的迭代scale标度sort of有⼏分的squares平⽅Ttrajectory轨迹temporarily暂时的terminology专⽤名词tolerance容忍;公差thumb翻阅threshold阈,临界theorem定理tangent正弦Uunit-length vector单位向量Vvalid有效的,正确的variance⽅差variable变量;变元vocabulary词汇valued经估价的;宝贵的Wwrapper包装分类:。

穆雷卡公式

穆雷卡公式《穆雷卡公式》是一种拟贝叶斯在多元线性回归中的独特统计方法,它被称为“模型特征选择”。

穆雷卡公式能够有效地排除那些不重要特征的影响,缩小多元线性回归的参数误差,提高模型的可解释性。

穆雷卡公式有一定的数学基础,它最初以一种名为“Akaike信息准则(AIC)的度量表示。

这是一种对统计模型的评估标准,可以用于估计参数的误差。

穆雷卡公式的概念,引用了贝叶斯统计方法,这种方法把概率变量看作是一种随机变量。

穆雷卡公式重新定义了AIC,以将其变为更加灵活的统计模型。

穆雷卡公式使得统计模型的参数估计更加准确,从而更加精确地预测数据的变化。

穆雷卡公式具有一些独特的特点,首先它引用了贝叶斯统计方法,经过不断变化,从而赋予了穆雷卡公式更多的灵活性。

其次,穆雷卡公式会排除不重要特征的影响,缩小多元线性回归的参数误差,从而提高模型的可解释性。

最后,穆雷卡公式更准确地估计参数,也就是说当某个特征变化时,它能够更好地反应出变化的可能性。

穆雷卡公式今天应用较为广泛,可以用于精确的预测。

它的应用领域涉及到经济,金融,机器学习,社会等多个领域。

可以通过穆雷卡公式来估计用户行为,这样可以更加准确地预测市场的变化,从而帮助企业取得成功。

此外,穆雷卡公式还可以用于机器学习,它能够更准确地估计神经网络模型的参数,从而提高性能。

穆雷卡公式是一种很有用的统计模型,它能有效地排除不重要特征的影响,缩小多元线性回归的参数误差,更准确地估计参数,并且能够有效地预测数据变化,而这也是统计学家和科学家所追求的目标。

在今天的社会经济环境下,穆雷卡公式的应用越来越普遍,从而更好地帮助人们实现数据分析,做出更加准确的统计和决策。

常用物理英语单词

常用物理英语单词absolute acceleration 绝对加速度absolute motion 绝对运动absolute velocity 绝对速度accelerated motion 加速运动acceleration of gravity 重力加速度acceleration 加速度accelerometer 加速度计acting force 作用力active force 主动力angle of friction 摩擦角angle of nutation 章动角angle of precession 进动角angle of rotation 自转角angular acceleration 角加速度angular displacement 角位移angular motion 角[向]运动angular velocity vector 角速度矢[量]angular velocity 角速度areal velocity 掠面速度又称“扇形速度(sector velocity)”arm of couple 力偶臂attraction force 吸引力Atwood machine 阿特伍德机average velocity,mean velocity 平均速度axial acceleration 轴向加速度axial vector 轴矢[量]ballistic curve 弹道ballistic pendulum 弹道摆ballistics 弹道学base point 基点bearing 轴承binormal acceleration 副法向加速度bounce 反弹center of force 力心center of gravity 重心center of mass 质心center of moment 矩心center of parallel force system 平行力系中心center of percussion 撞击中心center of reduction 简化中心又称“约化中心”。

质点参考系知识点

质点参考系知识点质点参考系是物理学中常用的概念,涉及到质点运动的描述和分析中,为了更好地理解和研究物理现象和规律,需要掌握和应用质点参考系相关的知识。

一、参考系的定义参考系是描述和分析物理运动及变形过程中同时存在的一组坐标轴和时间标尺的集合,它是研究物理现象的工具。

根据参考系的不同,同一物理量在不同参考系下的值是不同的。

例如,一个质点的速度是相对于参考系的,即不同参考系下的速度是不同的。

因此,建立一个适当的参考系对于研究物理现象非常重要。

二、坐标系的选择在建立参考系时,需要确定坐标轴的位置和方向,从而建立坐标系。

常用的坐标系有直角坐标系、柱坐标系和球坐标系。

直角坐标系:选择三条互相垂直的坐标轴,以它们的交点为原点,建立三维直角坐标系。

这种坐标系中,每个点都有唯一的三个坐标值来表示它的位置。

柱坐标系:柱坐标系是三维极坐标系的一种。

它由一个“径向量”和一个“角向量”组成。

径向量为一个非负实数,表示点到柱坐标系原点的距离;角向量是垂直于径向量的矢量,用来表示点在径向量方向上的位置。

球坐标系:球坐标系也是三维极坐标系的一种。

通过一个向径的实数、一个极角和一个方位角来表示点的坐标。

向径是点到球坐标系原点的距离,极角是向径和某一个固定的方向线之间形成的夹角,方位角是从某一固定的参考线到垂直于极角的平面的夹角。

根据具体的物理问题,可以选择不同的坐标系。

为了方便,一般选择符合对称性的坐标系,以简化物理计算。

三、质点参考系的定义质点参考系是基于一个质点相对于某个参考系的运动状态来建立的坐标系,其实质就是把质点看做坐标系的参考物,研究其它物体相对于此质点的运动状态。

物理量在不同质点参考系下的变化规律就是相对论(或相对论体系)的基本内容之一。

四、几个常用的质点参考系Galilean invariance伽利略不变性的概念是指经典力学中的参考系变换所遵循的规律。

伽利略变换指的是两个相对运动的参考系之间的转换,这个转换遵循以下条件:(1)参考系之间的时间流逝率相等;(2)两个参考系中的物理规律形式相同;(3)两个参考系中的物理现象有相同的形式。

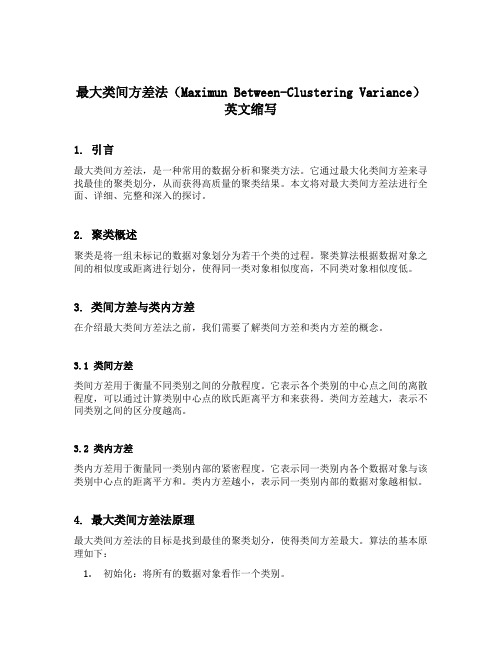

最大类间方差法英文缩写

最大类间方差法(Maximun Between-Clustering Variance)英文缩写1. 引言最大类间方差法,是一种常用的数据分析和聚类方法。

它通过最大化类间方差来寻找最佳的聚类划分,从而获得高质量的聚类结果。

本文将对最大类间方差法进行全面、详细、完整和深入的探讨。

2. 聚类概述聚类是将一组未标记的数据对象划分为若干个类的过程。

聚类算法根据数据对象之间的相似度或距离进行划分,使得同一类对象相似度高,不同类对象相似度低。

3. 类间方差与类内方差在介绍最大类间方差法之前,我们需要了解类间方差和类内方差的概念。

3.1 类间方差类间方差用于衡量不同类别之间的分散程度。

它表示各个类别的中心点之间的离散程度,可以通过计算类别中心点的欧氏距离平方和来获得。

类间方差越大,表示不同类别之间的区分度越高。

3.2 类内方差类内方差用于衡量同一类别内部的紧密程度。

它表示同一类别内各个数据对象与该类别中心点的距离平方和。

类内方差越小,表示同一类别内部的数据对象越相似。

4. 最大类间方差法原理最大类间方差法的目标是找到最佳的聚类划分,使得类间方差最大。

算法的基本原理如下:1.初始化:将所有的数据对象看作一个类别。

2.计算总体的类别中心点。

3.遍历所有的数据对象,将其移动到与其中心点距离最大的类别中心点所在的类别。

4.重复步骤2和步骤3,直到类别的类间方差最大化。

5. 最大类间方差法的优缺点最大类间方差法作为一种常用的聚类方法,具有以下优点:•简单易懂:最大类间方差法的原理易于理解和实现。

•有效性高:通过最大化类间方差,可以得到高质量的聚类结果。

然而,最大类间方差法也存在一些缺点:•对初始聚类中心点敏感:初始聚类中心点的选择会影响到最终的聚类结果。

•需要预先设定聚类数目:最大类间方差法需要事先确定聚类的数目。

6. 最大类间方差法的应用最大类间方差法在许多领域都有广泛的应用,比如:1.数据挖掘:最大类间方差法可以帮助发现数据集中的有意义的模式和趋势。

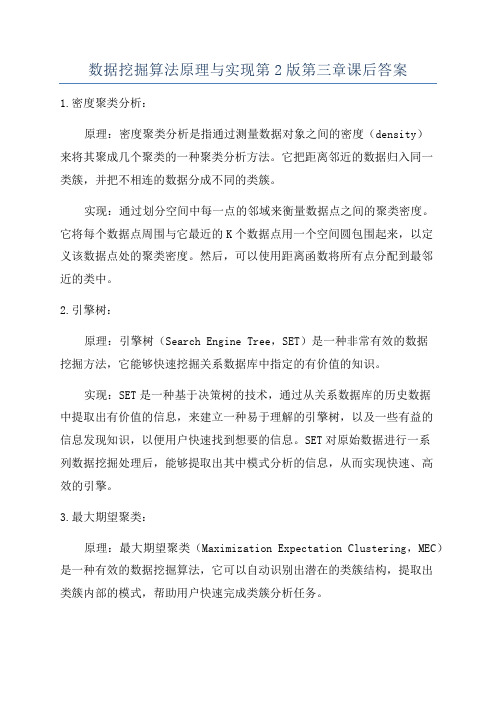

数据挖掘算法原理与实现第2版第三章课后答案

数据挖掘算法原理与实现第2版第三章课后答案

1.密度聚类分析:

原理:密度聚类分析是指通过测量数据对象之间的密度(density)

来将其聚成几个聚类的一种聚类分析方法。

它把距离邻近的数据归入同一

类簇,并把不相连的数据分成不同的类簇。

实现:通过划分空间中每一点的邻域来衡量数据点之间的聚类密度。

它将每个数据点周围与它最近的K个数据点用一个空间圆包围起来,以定

义该数据点处的聚类密度。

然后,可以使用距离函数将所有点分配到最邻

近的类中。

2.引擎树:

原理:引擎树(Search Engine Tree,SET)是一种非常有效的数据

挖掘方法,它能够快速挖掘关系数据库中指定的有价值的知识。

实现:SET是一种基于决策树的技术,通过从关系数据库的历史数据

中提取出有价值的信息,来建立一种易于理解的引擎树,以及一些有益的

信息发现知识,以便用户快速找到想要的信息。

SET对原始数据进行一系

列数据挖掘处理后,能够提取出其中模式分析的信息,从而实现快速、高

效的引擎。

3.最大期望聚类:

原理:最大期望聚类(Maximization Expectation Clustering,MEC)是一种有效的数据挖掘算法,它可以自动识别出潜在的类簇结构,提取出

类簇内部的模式,帮助用户快速完成类簇分析任务。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

λ a coupling constant characterand η (x, t) a white noise,

izing the slope dependence of the growth velocity,

< η (x, t)η (x′ , t′ ) >= ∆δ (x − x′ )δ (t − t′ ), representing fluctuations either in the drive or in the environment. The slope variable u = ∇h satisfies the noisy Burgers equation [3,4] ∂u/∂t − λu∇u = ν ∇2 u + ∇η . (2)

range of validity, it was noticed in [4] that both scaling dimensions follow explicitly from two exact scaling relations. The first one follows from the Galilean invariance of the original Burgers equation (generalized to λ = −1), i.e., u(x, t) → u(x − λu0 t, t) − u0 , leaving all averages unchanged. This property implies that λ is a structural constant of the symmetry group and therefore remains invariant under a renormalization group transformation. Comparing the scaling properties of the two terms on the left hand side of (2) we then obtain the first scaling relation, z = 2 − ζ . The other scaling relation is particular to the case d = 1 + 1 and follows from the fact that the simple Gaussian equal time stationary probability distribution, ln P (u) ∝ − u2 (x)dx, satisfies the Fokker-Planck equation for the probability distribution P (u, t), ∂P (u, t) =− ∂t ∆ + 2 ∂u δ ∂2u (−λu + ν 2 )P (u, t) δu ∂x ∂x 2 ∂ δ 2 P (u, t) ′ dxdx′ δ ( x − x ) , ∂x∂x′ δuδu′ dx

PACS numbers: 05.40.+j, 05.60.+w, 75.10.Jm, 64.60.Ht

E-mail: 1. fogedby@dfi.aau.dk 2. eriksn@nordita.dk 3. mikheev@nordita.dk

Typeset using REVTEX 1

The Kardar-Parisi-Zhang (KPZ) equation plays an important role in modern non equilibrium statistical mechanics as a continuum description of growing interfaces [1,2]. In a co-moving frame the equation of motion for the relative height variable h(x, t) has the form 1 ∂h/∂t = ν ∇2 h + λ(∇h)2 + η , 2 where ν is an effective diffusion coefficient, (1)

arXiv:cond-mat/9503028v1 6 Mar 1995

Anders B. Eriksson

2

and Lev V. Mikheev3

Nordita, Blegdamsvej 17, DK-2100, Copenhagen Ø, Denmark (February 1, 2008)

Abstract

The universality class represented by (1) and (2), besides driven interface and irrotational fluid dynamics, includes such important models as a driven lattice gas [5], as well as a directed polymer [6], or a quantum particle [7], in random environment. These models serve as paradigms in the theories of driven and disordered systems. An additional attraction of the problem is its analytical tractability. A consistent, although uncontrolled, perturbative renormalization group flow has been constructed up to the two-loop level [4,8,9] and appears to give qualitatively correct results. What emerges is a critical (massless) behavior, which at and below two spatial dimensions is always governed by a strong-coupling renormalization group fixed point. Two basic scaling dimensions describe the long-wave-length low-frequency behavior of the problem: i) the roughness exponent ζ characterizing the height correlations in (1) and ii) the dynamical exponent z . The velocity field u or, equivalently, slope field ∇h for the interface, has scaling dimension 1 − ζ . The pair correlation function scales as < u(x0 , t0 )u(x0 + x, t0 + t) >= x−2(1−ζ ) f (t/xz ) , where the scaling function f (x) ∝ x−2(1−ζ )/z for large values of its argument. The case one spatial and one time dimension, d = 1+1, is of particular interest. Although the perturbative renormalization group flows into the strong coupling regime, outside of its 2 (3)

A continuum limit of the non-Hermitian spin-1/2 chain, conjectured recently to belong to the universality class of the noisy Burgers or, equivalently, Kardar-Parisi-Zhang equation, is obtained and analyzed. The Galilean invariance of the Burgers equation is explicitly realized in the operator algebra. In the quasi-classical limit we find nonlinear soliton excitations exhibiting the ω ∝ kz dispersion relation with dynamical exponent z = 3/2.

Continuum limit, Galilean invariance, and solitons in the quantum equivalent of the noisy Burgers equation

Hans C. Fogedby

1

Institute of Physics and Astronomy, University of Aarhus, DK-8000, Aarhus C, Denmark

(4)

corresponding to (2) for any value of λ. This property then implies ζ = 1/2 (random walk behavior) and thus z = 3/2. The exact rational values of the scaling exponents found in d = 1 + 1 bear a superficial resemblance to the exponents encountered in two-dimensional classical critical problems, equivalent to d = 1 + 1 relativistic quantum field theories [10]. Note, however, that the value z = 3/2 is manifestly non-relativistic, making extensions of the conformal field theory methods a highly nontrivial task. We might, however, still expect to gain new insight by studying the equivalent (1+1)-dimensional nonrelativistic quantum system by the methods developed for one-dimensional spin chains [11]. Here spin waves and solitons in, e. g., the Heisenberg ferromagnet, are characterized by ω = k z with z = 2 [12], while activational quantum dynamics of the Ising chain in a random transverse field implies z = ∞ [13]. Such a quantum spin chain approach has been proposed in [14], and considered furthee equivalence between the master equation describing the evolution of a one-dimensional driven lattice gas or the equivalent lattice interface growth model and the non-Hermitian spin s = 1/2 Hamiltonian for N spins, 3