深度学习的深度信念网络DBN

基于深度信念网络的特征抽取方法研究与应用

基于深度信念网络的特征抽取方法研究与应用深度学习在近年来取得了巨大的突破,成为人工智能领域的热门研究方向。

其中,深度信念网络(Deep Belief Networks,DBN)作为一种基于无监督学习的深度学习模型,被广泛应用于特征抽取任务中。

本文将探讨基于DBN的特征抽取方法的研究与应用。

一、深度信念网络的基本原理深度信念网络是由多层堆叠的玻尔兹曼机(Boltzmann Machine,BM)组成的,每一层都是一个BM。

它的训练过程可以分为两个阶段:预训练和微调。

预训练阶段通过逐层训练,将每一层的权重初始化为最优值,使得网络可以自动地学习到输入数据的高层抽象特征。

而微调阶段则是通过反向传播算法对整个网络进行训练,进一步提升网络的性能。

二、基于DBN的特征抽取方法基于DBN的特征抽取方法主要包括两个步骤:预训练和特征提取。

预训练阶段通过逐层训练,将原始输入数据转化为高层次的抽象特征表示。

而特征提取阶段则是将预训练得到的权重参数应用于新的数据集,提取其特征表示。

在预训练阶段,DBN通过对每一层进行贪心逐层训练,逐渐提高网络的表达能力。

每一层的训练过程都是一个无监督的学习过程,通过最大化对数似然函数来学习每一层的权重参数。

在训练过程中,网络通过学习到的权重参数,逐渐学习到输入数据的高层次抽象特征。

在特征提取阶段,DBN将预训练得到的权重参数应用于新的数据集,提取其特征表示。

通过将新的数据集输入到DBN中,可以得到每一层的输出,即特征表示。

这些特征表示可以用于后续的分类、聚类等任务。

三、基于DBN的特征抽取方法的应用基于DBN的特征抽取方法在图像识别、语音识别、自然语言处理等领域中得到了广泛的应用。

在图像识别领域,DBN可以通过学习到的高层次抽象特征,对图像进行特征表示。

这些特征表示可以用于图像分类、目标检测等任务。

通过深度学习的方法,可以提高图像识别的准确率和鲁棒性。

在语音识别领域,DBN可以通过学习到的语音特征表示,提高语音识别的准确率。

DBN(深度信念网络)MATLABDeepLearnToolbox源码学习

DBN(深度信念网络)MATLABDeepLearnToolbox源码学习深度信念网络(Deep Belief Networks,DBN)是一种无监督学习算法,用于将浅层的无监督学习算法(如受限玻尔兹曼机)组合成深层的结构。

DBN的核心思想是通过逐层训练,将特征从原始数据中抽取出来,并在每一层中学习到更加抽象和高级的特征表示。

为了学习DBN的实现细节,我选择了MATLAB中的DeepLearnToolbox源码进行学习。

DeepLearnToolbox是MATLAB的一个开源工具包,提供了各种深度学习模型的实现,包括DBN。

在学习DBN的MATLAB源码之前,首先了解一下DBN的结构和训练过程是非常重要的。

DBN由多层玻尔兹曼机(RBM)组成,每一层的RBM都被训练为一个无监督学习的生成模型。

在训练完成之后,DBN的每一层就是上一层的隐藏层,通过从上到下的顺序连接起来形成整个DBN。

学习源码时,首先需要熟悉DeepLearnToolbox提供的DBN类的方法和属性。

然后,可以根据具体的需求对源码进行修改和调试。

在学习源码的过程中,我发现DBN类中的一些核心方法特别值得关注,如train、propup、sampleH、reconstruct和propdown等。

这些方法分别对应DBN的训练过程中的不同步骤,如正向传播、反向传播、样本采样和重构等。

理解这些方法的实现细节,可以帮助我们更好地理解DBN的实现原理。

此外,我还注意到DeepLearnToolbox提供了一些辅助函数,如sigm、rbmup、rbmdown和sample等,用于计算激活函数的输出、计算RBM的正向传播和反向传播的输出、以及对样本进行采样等。

这些辅助函数在DBN 的实现中起到了重要的作用。

在学习DBN的源码过程中,我还可以将实现的方法与DBN的理论知识进行对比,加深对DBN算法的理解。

另外,还可以通过实验和调试源码,观察不同参数设置对DBN性能的影响,从而进一步探索DBN的特性。

深度学习--深度信念网络(Deep-Belief-Network)

深度学习--深度信念网络(Deep Belief Network)概述深度信念网络(Deep Belief Network, DBN) 由Geoffrey Hinton 在2006 年提出。

它是一种生成模型,通过训练其神经元间的权重,我们可以让整个神经网络按照最大概率来生成训练数据。

我们不仅可以使用DBN 识别特征、分类数据,还可以用它来生成数据。

下面的图片展示的是用DBN 识别手写数字:图 1 用深度信念网络识别手写数字。

图中右下角是待识别数字的黑白位图,它的上方有三层隐性神经元。

每一个黑色矩形代表一层神经元,白点代表处于开启状态的神经元,黑色代表处于关闭状态的神经元。

注意顶层神经元的左下方即使别结果,与画面左上角的对应表比对,得知这个DBN 正确地识别了该数字。

下面是展示了一个学习了大量英文维基百科文章的DBN 所生成的自然语言段落:In 1974 Northern Denver had been overshadowed by CNL, and several Irish intelligence agencies in the Mediterranean region. However, on the Victoria, Kings Hebrew stated that Charles decided to escape during analliance. The mansion house was completed in 1882, the second in its bridge are omitted, while closing is the proton reticulum composed below it aims, such that it is the blurring of appearing on any well-paid type of box printer.DBN 由多层神经元构成,这些神经元又分为显性神经元和隐性神经元(以下简称显元和隐元)。

dbn原理

dbn原理

DBN(Deep Belief Network,深度信念网络)是一种深度学习模型,由多个堆叠的受限玻尔兹曼机(Restricted Boltzmann Machines,RBM)组成。

DBN的原理涉及到概率图模型、无监督学习和逐层贪婪训练等概念。

以下是DBN的基本原理:

1.概率图模型:DBN是一种概率图模型,用于建模变量之间的概率关系。

它的基本组成部分是RBM,是一种能量模型,用于描述变量之间的概率分布。

2.受限玻尔兹曼机(RBM):RBM是概率图模型中的一种,具有两层神经元,分别是可见层和隐藏层。

RBMs之间的连接是双向的,但层内神经元之间没有连接。

RBMs用于学习数据的分布,并提取数据中的特征。

3.逐层贪婪训练:DBN的训练过程采用逐层贪婪训练的策略。

首先,每一层的RBM在无监督方式下逐层地进行训练,学习输入数据的分布和特征。

然后,将前一层RBM的隐藏层作为后一层RBM的可见层,层层堆叠形成DBN。

4.深度表示学习:由于DBN的层层堆叠,它可以学习数据的层次化表示。

底层表示捕捉原始数据的基本特征,而高层表示捕捉更抽象和复杂的特征。

这使得DBN在处理复杂数据和进行特征学习方面具有优势。

5.有监督微调:在无监督训练之后,可以通过有监督微调的方式使用反向传播算法进一步调整网络,以适应特定的任务,如分类或回归。

总体而言,DBN的原理结合了概率图模型和深度学习的思想,通过逐层贪婪训练学习数据的层次化表示,使其在处理复杂数据和进行特征学习方面表现出色。

dbn方法 -回复

dbn方法-回复什么是DBN方法?DBN方法指的是深度信念网络(Deep Belief Networks)方法。

深度信念网络是一种基于神经网络的无监督学习算法,被广泛应用于机器学习和人工智能领域。

它由多层堆叠的受限玻尔兹曼机(Restricted Boltzmann Machine,RBM)组成,其中每一层都是由一组可见单元和一组隐藏单元组成。

在深度信念网络中,每一层的可见单元由外部输入提供,而隐藏单元则通过学习自动提取输入数据中的特征。

通过逐层训练,每一层的隐藏单元都可以认为是下一层的输入数据的高级抽象表示。

这种层级化的特征提取能力使得深度信念网络在处理复杂高维数据时具有优势。

DBN方法的训练过程主要分为两个阶段:预训练和微调。

首先是预训练阶段,也称为无监督预训练。

在该阶段中,每一层的RBM 按顺序进行训练。

通过最大化数据的似然函数,RBM学习到了输入数据的分布特征,并通过学习自动提取了输入数据的抽象表示。

每一层的隐藏单元的值也可作为下一层的输入数据,使得每一层的特征逐渐变得更加抽象。

这一阶段的目标是逐层构建一个具有良好表示能力的特征提取器。

接下来是微调阶段,也称为有监督微调。

在该阶段中,通过使用带标签的数据来训练整个网络。

通过最小化损失函数(如交叉熵损失函数),网络的权重参数进行调整,从而提高网络的准确性和泛化能力。

微调过程中,网络的所有层都参与训练,使得整个网络能够适应于特定的任务和数据集。

DBN方法的优势在于它能够自动学习和提取数据的抽象表示,无需手工设计特征。

这种特点使得DBN方法在特征表示和数据表示方面具有很强的表达能力。

此外,DBN方法还可以处理高维数据、具有更好的可解释性和更快的训练速度。

然而,DBN方法也存在一些挑战和限制。

首先,预训练阶段是无监督的,无法直接优化整个网络的目标函数,可能导致预训练与微调之间的性能下降。

其次,DBN方法对超参数的选择敏感,包括网络结构、学习率和正则化参数等。

堆叠自动编码器的深度信念网络解析(Ⅱ)

深度信念网络(DBN)是一种深度学习模型,它由多层堆叠自动编码器组成。

在本文中,我们将对堆叠自动编码器和深度信念网络进行解析,探讨它们在机器学习领域的应用和原理。

自动编码器是一种无监督学习算法,它的目标是学习数据的表示,然后重构输入。

自动编码器由输入层、隐藏层和输出层组成。

隐藏层的节点数比输入层和输出层更少,这迫使自动编码器学习数据的压缩表示。

在训练过程中,自动编码器尝试最小化输入和重构输出之间的差异,从而学习到数据的有用特征。

堆叠自动编码器是由多个自动编码器组成的深度学习模型。

它通过逐层训练每个自动编码器,然后将它们堆叠在一起形成一个深层结构。

这种逐层训练的方法可以解决训练深度神经网络时遇到的梯度消失和梯度爆炸等问题。

深度信念网络是一种由多层堆叠自动编码器组成的概率生成模型。

它可以用来对数据进行建模和生成。

深度信念网络的训练过程是通过无监督的逐层贪婪训练方法来实现的。

在训练过程中,每一层的参数都被调整以最大化模型对训练数据的似然。

深度信念网络在许多领域都有广泛的应用,包括计算机视觉、自然语言处理和推荐系统等。

在计算机视觉领域,深度信念网络可以用来进行特征学习和图像生成。

在自然语言处理领域,它可以用来进行情感分析和语言建模。

在推荐系统领域,它可以用来进行用户画像和推荐算法。

堆叠自动编码器的深度信念网络具有许多优点,例如它可以对大规模数据进行高效的表示学习和生成。

它还可以学习到数据的多层次抽象表示,从而可以更好地捕捉数据的内在特性。

此外,深度信念网络还可以应对数据的高维度和复杂性,提高模型的泛化能力。

然而,堆叠自动编码器的深度信念网络也存在一些局限性。

例如,它需要大量的训练数据和计算资源来进行训练。

此外,它的训练过程可能会受到参数初始化和超参数选择等因素的影响,需要进行仔细的调参和实验设计。

在总结上述内容之后,我们可以看到堆叠自动编码器的深度信念网络在深度学习领域具有重要的地位和应用前景。

它的原理和方法有助于我们更好地理解深度学习模型的内在机理和训练过程。

堆叠自动编码器的深度信念网络解析(九)

深度信念网络(DBN)是一种用于无监督学习的神经网络模型,它由多层堆叠自动编码器组成。

在本文中,我们将探讨堆叠自动编码器的深度信念网络的原理、结构和应用。

首先,让我们介绍一下自动编码器。

自动编码器是一种用于学习数据的特征表示的神经网络模型。

它由一个由编码器和解码器组成的结构构成,其中编码器将输入数据映射到隐藏层表示,解码器将隐藏层表示映射回原始数据空间。

自动编码器通过最小化输入和重构之间的误差来学习数据的高级表示。

堆叠自动编码器则是将多个自动编码器层叠在一起,每一层的输出作为下一层的输入,从而构建了一个深层的特征学习模型。

深度信念网络是一种基于概率图模型的无监督学习方法,它由多层堆叠自动编码器组成。

在深度信念网络中,每一层自动编码器的隐藏层表示被用作上一层自动编码器的输入,从而构建了一个深层的概率生成模型。

深度信念网络通过学习数据的概率分布来进行特征学习和生成模型的训练。

堆叠自动编码器的深度信念网络具有许多优点。

首先,它可以通过无监督学习来学习数据的高级表示,从而可以在没有标签数据的情况下进行特征学习和模型训练。

其次,深度信念网络具有强大的表示能力和泛化能力,能够对复杂的数据分布进行建模和生成。

此外,深度信念网络还可以通过反向传播算法进行有监督学习,从而可以在标签数据有限的情况下进行监督学习任务。

在实际应用中,堆叠自动编码器的深度信念网络被广泛应用于图像识别、语音识别、自然语言处理等领域。

在图像识别任务中,深度信念网络可以学习图像的高级特征表示,从而可以实现对图像的分类、检测和生成。

在语音识别任务中,深度信念网络可以学习语音的特征表示,从而可以实现对语音的识别和合成。

在自然语言处理任务中,深度信念网络可以学习文本的语义表示,从而可以实现对文本的分类、情感分析和生成。

总之,堆叠自动编码器的深度信念网络是一种强大的无监督学习模型,它具有强大的特征学习能力和泛化能力,并且在图像识别、语音识别、自然语言处理等领域有着广泛的应用。

四种深度学习模型介绍

四种深度学习模型介绍深度学习源于神经网络的研究,可理解为深层的神经网络。

通过它可以获得深层次的特征表示,免除人工选取特征的繁复冗杂和高维数据的维度灾难问题。

目前较为公认的深度学习的基本模型包括:•基于受限玻尔兹曼机(Restricted Boltzmann Machine,RBM)的深度信念网络(Deep Belief Network,DBN);•基于自动编码器(AutoEncoder, AE)的堆叠自动编码器(Stacked AutoEncoders,SAE);•卷积神经网络(Convolutional Neural Networks,CNN);•递归神经网络(Recurrent Neural Networks,RNN)。

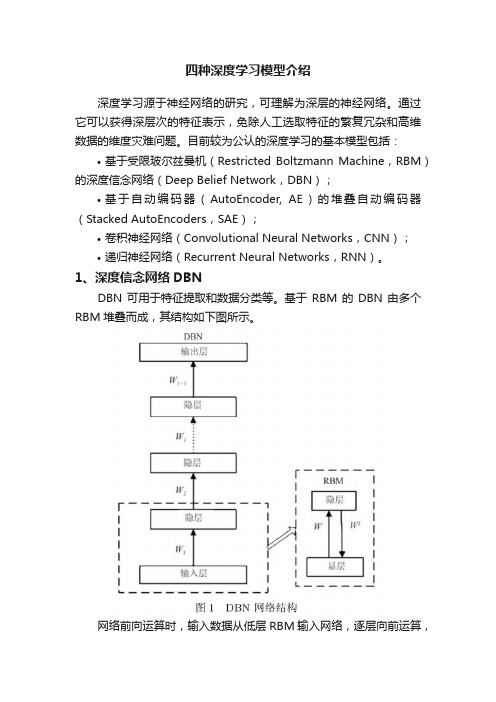

1、深度信念网络DBNDBN可用于特征提取和数据分类等。

基于RBM的DBN由多个RBM堆叠而成,其结构如下图所示。

网络前向运算时,输入数据从低层RBM输入网络,逐层向前运算,得到网络输出。

网络训练过程,不同于传统的人工神经网络(Artificial Neural Network),分为两个阶段:•预训练(Pretraining)•全局微调(Fine tuning)预训练阶段,从低层开始,每个RBM单独训练,以最小化RBM 的网络能量为训练目标。

低层RBM训练完成后,其隐层输出作为高层RBM的输入,继续训练高层RBM。

以此类推,逐层训练,直至所有RBM训练完成。

预训练阶段,只使用了输入数据,没有使用数据标签,属于无监督学习(Unsupervised Learning)。

全局微调阶段,以训练好的RBM之间的权重和偏置作为深度信念网络的初始权重和偏置,以数据的标签作为监督信号计算网络误差,利用BP(Back Propagation)算法计算各层误差,使用梯度下降法完成各层权重和偏置的调节。

2、堆叠自动编码器SAE类似于DBN,SAE由多个AE堆叠而成,其结构如下图所示。

SAE前向计算类似于DBN,其训练过程也分为预训练和全局微调两个阶段。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

可视层

RBM网络共有2层,其中第一层称为可视层,一般来说是输入层,另一层 是隐含层,也就是我们一般指的特征提取层。 Wnm 是可视层与隐藏层之间

的权重矩阵, b 是可视节点的偏移量, c 是隐藏节点的偏移量。

“预训练”方法——限制玻尔兹曼机(RBM)

m

p(hj 1| v) ( wjivi c j ) i 1

多层置信网络结构

首先,你需要用原始 输入 x(k) 训练第一个 自编码器,它能够学 习得到原始输入的一 阶特征表示 h^{(1)(k)}。

多层置信网络结构

接着,你需要把原始 数据输入到上述训练 好的稀疏自编码器中, 对于每一个输入 x(k), 都可以得到它对应的 一阶特征表示 h^{(1)(k)}。然后你再 用这些一阶特征作为 另一个稀疏自编码器 的输入,使用它们来 学习二阶特征 h^{(2)(k)}。

多层置信网络结构

再把一阶特征输入到 刚训练好的第二层稀 疏自编码器中,得到 每个h^{(1)(k)} 对应的 二阶特征激活值 h^{(2)(k)}。接下来, 你可以把这些二阶特 征作为softmax分类器 的输入,训练得到一 个能将二阶特征映射 到数字标签的模型。

多层置信网络结构

最终,你可以将这三 层结合起来构建一个 包含两个隐藏层和一 个最终softmax分类器 层的栈式自编码网络, 这个网络能够如你所 愿地对MNIST数字进 行分类。

“

在此输入标题

“The En输d入!文字 在此录入上述图表的综合分析结论 在此录入上述图表的综合分析结论 在此录入上述图表的综合分析结论 在此录入上述图表的综合分析结论

深度置信网络BDN

——学习报告

PPT模板下载:/moban/

自编码算法

自编码神经网络尝试学习一个 hw,b ( x) x 的函数,也就是说,它尝试逼近一个

恒等函数,从而使得输出接近于输入。恒等函数虽然看上去不太有学习的意义,但是当 我们为自编码神经网络加入某些限制,比如限定隐藏神经元的数量,我们就可以从输入 数据中发现一些有趣的结构。

深度学习的实质,是通过构建具有很多隐层的机器学习模型组合低层特征形成更加抽象的 高层来表示属性类别或特征,以发现数据的分布式特征。其动机在于建立模拟人脑进行分析学 习的神经网络,模仿人脑的机制来解释数据,例如图像,声音和文本。因此,“深度模型”是 手段,“特征学习”是目的。

深度学习的核心思路如下: ①无监督学习用于每一层网络的pre-train; ②每次用无监督学习只训练一层,将其训练结果作为其高一层的输入; ③用自顶而下的监督算法去调整所有层。

n

p(vi 1| h) ( wjihj bi ) j 1

限制玻尔兹曼机(RBM)

定义能量函数: 联合概率分布:

E(v, h) vibi hjcj vihjwij

i

j

i, j

p(v, h) 1 eE(v,h) Z

Z为归一化系数,其定义为:

Z eE(v,h)

v,h

输入层的边缘概率为:

p(v) 1 eE(v,h)

Zh

计算方法

权值更新

网络学习的目的是最大可能的拟合输入数据,即最大化 p(v)。

Hinton提出了一种快速算法,称作contrastive divergence(对比分歧)算法。这种算法

只需迭代k次,就可以获得对模型的估计,而通常k等于1. CD算法在开始是用训练数据去初始化可

多层置信网络结构

DBNs由多个限制玻 尔兹曼机(Restricted Boltzmann Machines) 层组成,一个典型的 神经网络类型如图所 示。

多层置信网络结构

·最终在构筑好整个网络后,相当于进行了一次完整的无监督学习。 ·在确定了网络的权值后,再次根据样本,以BP神经网络的算法,进 行一次有监督的学习过程。这一过程被称为多层置信网络的微调。

见层,然后用条件分布计算隐层;然后,再根据隐层,同样,用条件分布来计算D算法:

wij

vi hj

data

vi hj

recon

其中, 是学习率, vi hj data 是样本数据的期望, vi hj recon 是重构后可视层数据的期望

深度学习

自编码神经网络示例

如果输入数据中隐含着一些 特定的结构,比如某些输入特征是 彼此相关的,那么这一算法就可以 发现输入数据中的这些相关性。事 实上,这一简单的自编码神经网络 通常可以学习出一个跟主元分析 (PCA)结果非常相似的输入数据的 低维表示。

“预训练”方法——限制玻尔兹曼机(RBM)

隐含层