模式识别试题总结

模式识别试卷及答案

模式识别试卷及答案一、选择题(每题5分,共30分)1. 以下哪一项不是模式识别的主要任务?A. 分类B. 回归C. 聚类D. 预测答案:B2. 以下哪种算法不属于监督学习?A. 支持向量机(SVM)B. 决策树C. K最近邻(K-NN)D. K均值聚类答案:D3. 在模式识别中,以下哪一项是特征选择的目的是?A. 减少特征维度B. 增强模型泛化能力C. 提高模型计算效率D. 所有上述选项答案:D4. 以下哪种模式识别方法适用于非线性问题?A. 线性判别分析(LDA)B. 主成分分析(PCA)C. 支持向量机(SVM)D. 线性回归答案:C5. 在神经网络中,以下哪种激活函数常用于输出层?A. SigmoidB. TanhC. ReLUD. Softmax答案:D6. 以下哪种聚类算法是基于密度的?A. K均值聚类B. 层次聚类C. DBSCAND. 高斯混合模型答案:C二、填空题(每题5分,共30分)1. 模式识别的主要任务包括______、______、______。

答案:分类、回归、聚类2. 在监督学习中,训练集通常分为______和______两部分。

答案:训练集、测试集3. 支持向量机(SVM)的基本思想是找到一个______,使得不同类别的数据点被最大化地______。

答案:最优分割超平面、间隔4. 主成分分析(PCA)是一种______方法,用于降维和特征提取。

答案:线性变换5. 神经网络的反向传播算法用于______。

答案:梯度下降6. 在聚类算法中,DBSCAN算法的核心思想是找到______。

答案:密度相连的点三、简答题(每题10分,共30分)1. 简述模式识别的基本流程。

答案:模式识别的基本流程包括以下几个步骤:(1)数据预处理:对原始数据进行清洗、标准化和特征提取。

(2)模型选择:根据问题类型选择合适的模式识别算法。

(3)模型训练:使用训练集对模型进行训练,学习数据特征和规律。

模式识别期末考试题及答案

模式识别期末考试题及答案一、选择题(每题2分,共20分)1. 以下哪一项不是模式识别的主要任务?A. 分类B. 回归C. 聚类D. 预测答案:B2. 以下哪一种方法不属于统计模式识别方法?A. 最小二乘法B. 感知机C. 支持向量机D. 决策树答案:A3. 在模式识别中,以下哪种技术用于降低特征维度?A. 主成分分析(PCA)B. 线性判别分析(LDA)C. 神经网络D. K-均值聚类答案:A4. 以下哪一种模式识别方法适用于非线性问题?A. 线性判别分析(LDA)B. 支持向量机(SVM)C. 主成分分析(PCA)D. K-最近邻(K-NN)答案:B5. 以下哪一项不是模式识别的评价指标?A. 准确率B. 精确率C. 召回率D. 信息熵答案:D二、填空题(每题2分,共20分)6. 模式识别的主要任务包括分类、回归、聚类和________。

答案:预测7. 统计模式识别方法包括最小二乘法、感知机、________和决策树。

答案:支持向量机8. 主成分分析(PCA)的主要目的是________特征。

答案:降低维度9. 在模式识别中,________用于将样本分为不同的类别。

答案:分类器10. 支持向量机(SVM)的基本思想是找到一个________,使得不同类别的样本之间的间隔最大化。

答案:最优分割超平面三、简答题(每题10分,共30分)11. 请简述模式识别的主要步骤。

答案:(1)数据预处理:对原始数据进行清洗、标准化和降维等处理。

(2)特征提取:从原始数据中提取有助于分类的特征。

(3)模型训练:使用训练集对分类器进行训练。

(4)模型评估:使用测试集对分类器的性能进行评估。

(5)模型优化:根据评估结果对模型进行调整和优化。

12. 请简述支持向量机(SVM)的基本原理。

支持向量机是一种二分类模型,其基本思想是找到一个最优分割超平面,使得不同类别的样本之间的间隔最大化。

SVM通过求解一个凸二次规划问题来寻找最优分割超平面,从而实现分类任务。

模式识别考试总结

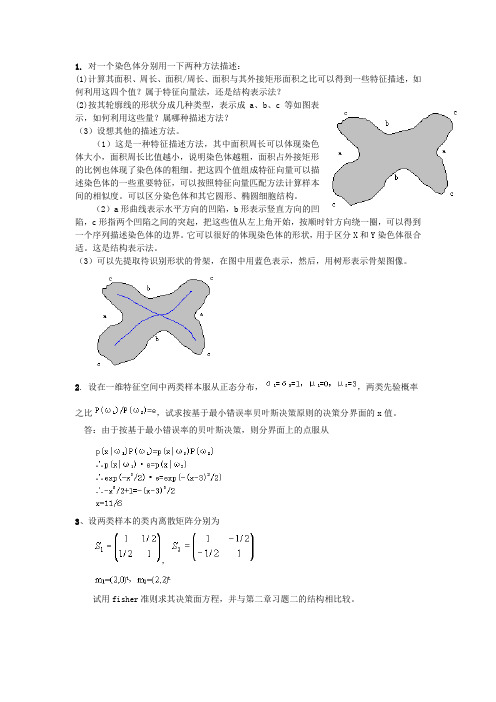

1.对一个染色体分别用一下两种方法描述:(1)计算其面积、周长、面积/周长、面积与其外接矩形面积之比可以得到一些特征描述,如何利用这四个值?属于特征向量法,还是结构表示法?(2)按其轮廓线的形状分成几种类型,表示成a、b、c等如图表示,如何利用这些量?属哪种描述方法?(3)设想其他的描述方法。

(1)这是一种特征描述方法,其中面积周长可以体现染色体大小,面积周长比值越小,说明染色体越粗,面积占外接矩形的比例也体现了染色体的粗细。

把这四个值组成特征向量可以描述染色体的一些重要特征,可以按照特征向量匹配方法计算样本间的相似度。

可以区分染色体和其它圆形、椭圆细胞结构。

(2)a形曲线表示水平方向的凹陷,b形表示竖直方向的凹陷,c形指两个凹陷之间的突起,把这些值从左上角开始,按顺时针方向绕一圈,可以得到一个序列描述染色体的边界。

它可以很好的体现染色体的形状,用于区分X和Y染色体很合适。

这是结构表示法。

(3)可以先提取待识别形状的骨架,在图中用蓝色表示,然后,用树形表示骨架图像。

2. 设在一维特征空间中两类样本服从正态分布,,两类先验概率之比,试求按基于最小错误率贝叶斯决策原则的决策分界面的x值。

答:由于按基于最小错误率的贝叶斯决策,则分界面上的点服从3、设两类样本的类内离散矩阵分别为,试用fisher准则求其决策面方程,并与第二章习题二的结构相比较。

答:由于两类样本分布形状是相同的(只是方向不同),因此应为两类均值的中点。

4,设在一个二维空间,A类有三个训练样本,图中用红点表示,B类四个样本,图中用蓝点表示。

试问:(1)按近邻法分类,这两类最多有多少个分界面(2)画出实际用到的分界面(3) A1与B4之间的分界面没有用到下图中的绿线为最佳线性分界面。

答:(1)按近邻法,对任意两个由不同类别的训练样本构成的样本对,如果它们有可能成为测试样本的近邻,则它们构成一组最小距离分类器,它们之间的中垂面就是分界面,因此由三个A类与四个B类训练样本可能构成的分界面最大数量为3×4=12。

模式识别期末试题

模式识别期末试题1.模式识别系统的基本构成单元包括模式采集、特征提取与选择和模式分类。

这些构成单元一起协作,以确定输入模式的类别或特征。

2.统计模式识别中,描述模式的方法一般使用特征向量;而句法模式识别中,模式描述方法一般有串、树、网等。

3.聚类分析算法属于无监督分类;判别域代数界面方程法属于统计模式识别方法。

4.若描述模式的特征量为0-1二值特征量,则一般采用匹配测度进行相似性度量。

5.准则函数可以作为聚类分析中的判别标准,常用的有距离准则、均值准则和连通性准则。

6.Fisher线性判别函数的求解过程是将N维特征向量投影在一维空间中进行。

7.感知器算法只适用于线性可分情况;而积累位势函数法既适用于线性可分,也适用于线性不可分情况。

8.满足文法定义的四元组包括:起始符号、非终结符号集合、终结符号集合和产生式规则集合。

其中,第一、二、四个四元组满足文法定义。

9.影响层次聚类算法结果的主要因素包括计算模式距离的测度、聚类准则、类间距离门限和预定的类别数目。

10.欧式距离具有平移不变性和旋转不变性;马式距离具有平移不变性、旋转不变性、尺度缩放不变性和不受量纲影响的特性。

11.线性判别函数的正负和数值大小的几何意义是正(负)表示样本点位于判别界面法向量指向的正(负)半空间中;绝对值正比于样本点到判别界面的距离。

12.感知器算法适用于线性可分和线性不可分的情况。

13.积累位势函数法相较于H-K算法的优点是该方法可用于非线性可分情况,也可用于线性可分情况。

位势函数K(x,xk)与积累位势函数K(x)的关系为K(x) = ∑αkK(x,xk),其中xk∈X。

14、XXX判决准则适用于一种判决错误比另一种判决错误更为重要的情况,而最小最大判决准则适用于先验概率未知的情况。

15、特征个数越多并不一定有利于分类。

特征选择的主要目的是从n个特征中选出最有利于分类的m个特征(m<n),以降低特征维数。

在可分性判据对特征个数具有单调性且特征个数远小于样本数的情况下,可以使用分支定界法以减少计算量。

模式识别期末试题及答案

模式识别期末试题及答案正文:模式识别期末试题及答案1. 选择题1.1 下列关于机器学习的说法中,正确的是:A. 机器学习是一种人工智能的应用领域B. 机器学习只能应用于结构化数据C. 机器学习不需要预先定义规则D. 机器学习只能处理监督学习问题答案:A1.2 在监督学习中,以下哪个选项描述了正确的训练过程?A. 通过输入特征和预期输出,训练一个模型来进行预测B. 通过输入特征和可能的输出,训练一个模型来进行预测C. 通过输入特征和无标签的数据,训练一个模型来进行预测D. 通过输入特征和已有标签的数据,训练一个模型来进行分类答案:D2. 简答题2.1 请解释什么是模式识别?模式识别是指在给定一组输入数据的情况下,通过学习和建模,识别和分类输入数据中的模式或规律。

通过模式识别算法,我们可以从数据中提取重要的特征,并根据这些特征进行分类、聚类或预测等任务。

2.2 请解释监督学习和无监督学习的区别。

监督学习是一种机器学习方法,其中训练数据包含了输入特征和对应的标签或输出。

通过给算法提供已知输入和输出的训练样本,监督学习的目标是学习一个函数,将新的输入映射到正确的输出。

而无监督学习则没有标签或输出信息。

无监督学习的目标是从未标记的数据中找到模式和结构。

这种学习方法通常用于聚类、降维和异常检测等任务。

3. 计算题3.1 请计算以下数据集的平均值:[2, 4, 6, 8, 10]答案:63.2 请计算以下数据集的标准差:[1, 3, 5, 7, 9]答案:2.834. 综合题4.1 对于一个二分类问题,我们可以使用逻辑回归模型进行预测。

请简要解释逻辑回归模型的原理,并说明它适用的场景。

逻辑回归模型是一种用于解决二分类问题的监督学习算法。

其基本原理是通过将特征的线性组合传递给一个非线性函数(称为sigmoid函数),将实数值映射到[0,1]之间的概率。

这个映射的概率可以被解释为某个样本属于正类的概率。

逻辑回归适用于需要估计二分类问题的概率的场景,例如垃圾邮件分类、欺诈检测等。

大学模式识别考试题及答案详解

大学模式识别考试题及答案详解Last revision on 21 December 2020一、填空与选择填空(本题答案写在此试卷上,30分)1、模式识别系统的基本构成单元包括:模式采集、特征提取与选择和模式分类。

2、统计模式识别中描述模式的方法一般使用特真矢量;句法模式识别中模式描述方法一般有串、树、网。

3、聚类分析算法属于(1);判别域代数界面方程法属于(3)。

(1)无监督分类 (2)有监督分类(3)统计模式识别方法(4)句法模式识别方法4、若描述模式的特征量为0-1二值特征量,则一般采用(4)进行相似性度量。

(1)距离测度(2)模糊测度(3)相似测度(4)匹配测度5、下列函数可以作为聚类分析中的准则函数的有(1)(3)(4)。

(1)(2) (3)(4)6、Fisher线性判别函数的求解过程是将N维特征矢量投影在(2)中进行。

(1)二维空间(2)一维空间(3)N-1维空间7、下列判别域界面方程法中只适用于线性可分情况的算法有(1);线性可分、不可分都适用的有(3)。

(1)感知器算法(2)H-K算法(3)积累位势函数法8、下列四元组中满足文法定义的有(1)(2)(4)。

(1)({A, B}, {0, 1}, {A01, A 0A1 , A 1A0 , B BA , B 0}, A)(2)({A}, {0, 1}, {A0, A 0A}, A)(3)({S}, {a, b}, {S 00S, S 11S, S 00, S 11}, S)(4)({A}, {0, 1}, {A01, A 0A1, A 1A0}, A)二、(15分)简答及证明题(1)影响聚类结果的主要因素有那些(2)证明马氏距离是平移不变的、非奇异线性变换不变的。

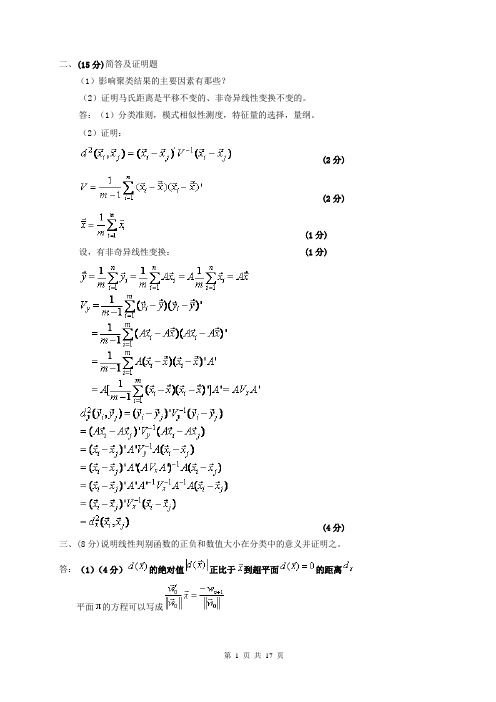

答:(1)分类准则,模式相似性测度,特征量的选择,量纲。

(2)证明:(2分)(2分)(1分)设,有非奇异线性变换:(1分)(4分)三、(8分)说明线性判别函数的正负和数值大小在分类中的意义并证明之。

模式识别试题及总结

二、(15分)简答及证明题(1)影响聚类结果的主要因素有那些?(2)证明马氏距离是平移不变的、非奇异线性变换不变的。

答:(1)分类准则,模式相似性测度,特征量的选择,量纲。

(2)证明:(2分)(2分)(1分)设,有非奇异线性变换:(1分)(4分)三、(8分)说明线性判别函数的正负和数值大小在分类中的意义并证明之。

答:(1)(4分)的绝对值正比于到超平面的距离平面的方程可以写成式中。

于是是平面的单位法矢量,上式可写成设是平面中的任一点,是特征空间中任一点,点到平面的距离为差矢量在上的投影的绝对值,即(1-1)上式中利用了在平面中,故满足方程式(1-1)的分子为判别函数绝对值,上式表明,的值正比于到超平面的距离,一个特征矢量代入判别函数后所得值的绝对值越大表明该特征点距判别界面越远。

(2)(4分)的正(负)反映在超平面的正(负)侧两矢量和的数积为(2分)显然,当和夹角小于时,即在指向的那个半空间中,>0;反之,当和夹角大于时,即在背向的那个半空间中,<0。

由于,故和同号。

所以,当在指向的半空间中时,;当在背向的半空间中,。

判别函数值的正负表示出特征点位于哪个半空间中,或者换句话说,表示特征点位于界面的哪一侧。

五、(12分,每问4分)在目标识别中,假定有农田和装甲车两种类型,类型ω1和类型ω2分别代表农田和装甲车,它们的先验概率分别为0.8和0.2,损失函数如表1所示。

现在做了三次试验,获得三个样本的类概率密度如下::0.3,0.1,0.6:0.7,0.8,0.3(1)试用贝叶斯最小误判概率准则判决三个样本各属于哪一个类型;(2)假定只考虑前两种判决,试用贝叶斯最小风险准则判决三个样本各属于哪一类;(3)把拒绝判决考虑在内,重新考核三次试验的结果。

表1类型损失判决1ω1α 1 45 11 1解:由题可知:,,,,(1)(4分)根据贝叶斯最小误判概率准则知:,则可以任判;,则判为;,则判为;(2)(4分)由题可知:则,判为;,判为;,判为;(3)(4分)对于两类问题,对于样本,假设已知,有则对于第一个样本,,则拒判;,则拒判;,拒判。

模式识别期末复习总结

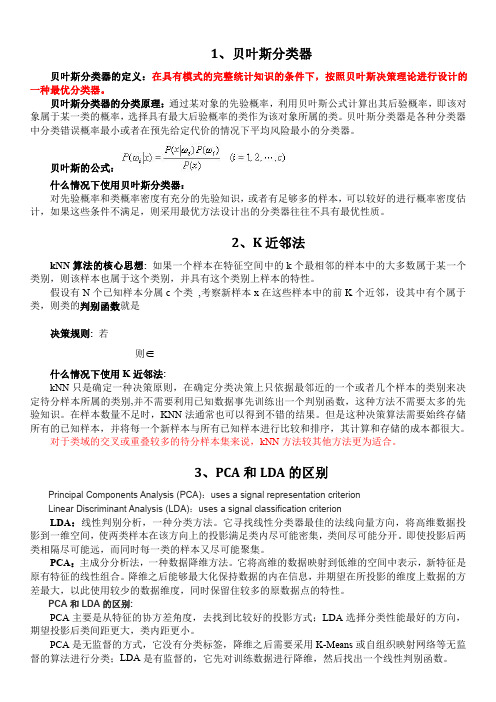

1、贝叶斯分类器贝叶斯分类器的定义:在具有模式的完整统计知识的条件下,按照贝叶斯决策理论进行设计的一种最优分类器。

贝叶斯分类器的分类原理:通过某对象的先验概率,利用贝叶斯公式计算出其后验概率,即该对象属于某一类的概率,选择具有最大后验概率的类作为该对象所属的类。

贝叶斯分类器是各种分类器中分类错误概率最小或者在预先给定代价的情况下平均风险最小的分类器。

贝叶斯的公式:什么情况下使用贝叶斯分类器:对先验概率和类概率密度有充分的先验知识,或者有足够多的样本,可以较好的进行概率密度估计,如果这些条件不满足,则采用最优方法设计出的分类器往往不具有最优性质。

2、K近邻法kNN算法的核心思想:如果一个样本在特征空间中的k个最相邻的样本中的大多数属于某一个类别,则该样本也属于这个类别,并具有这个类别上样本的特性。

假设有N个已知样本分属c个类,考察新样本x在这些样本中的前K个近邻,设其中有个属于类,则类的判别函数就是决策规则:若则∈什么情况下使用K近邻法:kNN只是确定一种决策原则,在确定分类决策上只依据最邻近的一个或者几个样本的类别来决定待分样本所属的类别,并不需要利用已知数据事先训练出一个判别函数,这种方法不需要太多的先验知识。

在样本数量不足时,KNN法通常也可以得到不错的结果。

但是这种决策算法需要始终存储所有的已知样本,并将每一个新样本与所有已知样本进行比较和排序,其计算和存储的成本都很大。

对于类域的交叉或重叠较多的待分样本集来说,kNN方法较其他方法更为适合。

3、PCA和LDA的区别Principal Components Analysis(PCA):uses a signal representation criterionLinear Discriminant Analysis(LDA):uses a signal classification criterionLDA:线性判别分析,一种分类方法。

它寻找线性分类器最佳的法线向量方向,将高维数据投影到一维空间,使两类样本在该方向上的投影满足类内尽可能密集,类间尽可能分开。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

一、填空与选择填空(本题答案写在此试卷上,30分)1、模式识别系统的基本构成单元包括:模式采集、特征提取与选择和模式分类。

2、统计模式识别中描述模式的方法一般使用特真矢量;句法模式识别中模式描述方法一般有串、树、网。

3、聚类分析算法属于(1);判别域代数界面方程法属于(3)。

(1)无监督分类(2)有监督分类(3)统计模式识别方法(4)句法模式识别方法4、若描述模式的特征量为0-1二值特征量,则一般采用(4)进行相似性度量。

(1)距离测度(2)模糊测度(3)相似测度(4)匹配测度5、下列函数可以作为聚类分析中的准则函数的有(1)(3)(4)。

(1)(2)(3)(4)6、Fisher线性判别函数的求解过程是将N维特征矢量投影在(2)中进行。

(1)二维空间(2)一维空间(3)N-1维空间7、下列判别域界面方程法中只适用于线性可分情况的算法有(1);线性可分、不可分都适用的有(3)。

(1)感知器算法(2)H-K算法(3)积累位势函数法8、下列四元组中满足文法定义的有(1)(2)(4)。

(1)({A, B}, {0, 1}, {A→01, A→0A1 , A→1A0 , B→BA , B→ 0}, A)(2)({A}, {0, 1}, {A→0, A→0A}, A)(3)({S}, {a, b}, {S → 00S, S → 11S, S → 00, S → 11}, S)(4)({A}, {0, 1}, {A→01, A→0A1, A→1A0}, A)9、影响层次聚类算法结果的主要因素有(计算模式距离的测度、(聚类准则、类间距离门限、预定的类别数目))。

10、欧式距离具有(1、2 );马式距离具有(1、2、3、4 )。

(1)平移不变性(2)旋转不变性(3)尺度缩放不变性(4)不受量纲影响的特性11、线性判别函数的正负和数值大小的几何意义是(正(负)表示样本点位于判别界面法向量指向的正(负)半空间中;绝对值正比于样本点到判别界面的距离。

)。

12、感知器算法1。

(1)只适用于线性可分的情况;(2)线性可分、不可分都适用。

13、积累势函数法较之于H-K算法的优点是(该方法可用于非线性可分情况(也可用于线性可分情况));位势函数K(x,x k)与积累位势函数K(x)的关系为(∑∈=XxxxKxK~kkk),()(α)。

14、在统计模式分类问题中,聂曼-皮尔逊判决准则主要用于(某一种判决错误较另一种判决错误更为重要)情况;最小最大判决准则主要用于(先验概率未知的)情况。

15、“特征个数越多越有利于分类”这种说确吗?(错误)。

特征选择的主要目的是(从n个特征中选出最有利于分类的的m个特征(m<n),以降低特征维数)。

一般在(可分性判据对特征个数具有单调性)和(C n m>>n )的条件下,可以使用分支定界法以减少计算量。

16、散度Jij越大,说明wi类模式与wj类模式的分布(差别越大);当wi类模式与wj类模式的分布相同时,Jij=(0)。

17、已知有限状态自动机Af=(∑,Q,d,q0,F),∑={0,1};Q={q0,q1};d:d(q0,0)= q1,d(q0,1)= q1,d(q1,0)=q0,d(q1,1)=q0;q0=q0;F={q0}。

现有输入字符串:(a) ,(b) 1100110011,(c) 0,(d)0010011,试问,用Af对上述字符串进行分类的结果为(ω1:{a,d};ω2:{b,c} )。

18、影响聚类算法结果的主要因素有(②③④)。

①已知类别的样本质量;②分类准则;③特征选取;④模式相似性测度。

19、模式识别中,马式距离较之于欧式距离的优点是(③④)。

①平移不变性;②旋转不变性;③尺度不变性;④考虑了模式的分布。

20、基于二次准则函数的H-K算法较之于感知器算法的优点是(①③)。

①可以判别问题是否线性可分;②其解完全适用于非线性可分的情况;③其解的适应性更好;④计算量小。

21、影响基本C均值算法的主要因素有(④①②)。

①样本输入顺序;②模式相似性测度;③聚类准则;④初始类心的选取。

22、位势函数法的积累势函数K(x)的作用相当于Bayes判决中的(②④)。

①先验概率;②后验概率;③类概率密度;④类概率密度与先验概率的乘积。

23、在统计模式分类问题中,当先验概率未知时,可以使用(②④)。

①最小损失准则;②最小最大损失准则;③最小误判概率准则;④N-P判决。

24、在(①③)情况下,用分支定界法做特征选择计算量相对较少。

①C n d>>n,(n为原特征个数,d为要选出的特征个数);②样本较多;③选用的可分性判据J对特征数目单调不减;④选用的可分性判据J具有可加性。

25、散度J D是根据(③)构造的可分性判据。

①先验概率;②后验概率;③类概率密度;④信息熵;⑤几何距离。

26、似然函数的概型已知且为单峰,则可用(①②③④⑤)估计该似然函数。

①矩估计;②最大似然估计;③Bayes估计;④Bayes学习;⑤Parzen窗法。

27、Kn近邻元法较之Parzen窗法的优点是(②)。

①所需样本数较少;②稳定性较好;③分辨率较高;④连续性较好。

28、从分类的角度讲,用DKLT做特征提取主要利用了DKLT的性质:(①③)。

①变换产生的新分量正交或不相关;②以部分新的分量表示原矢量均方误差最小;③使变换后的矢量能量更趋集中;29、一般,剪辑k-NN最近邻方法在(①)的情况下效果较好。

①样本数较大;②样本数较小;③样本呈团状分布;④样本呈链状分布。

30、如果以特征向量的相关系数作为模式相似性测度,则影响聚类算法结果的主要因素有(②③)。

①已知类别样本质量;②分类准则;③特征选取;④量纲。

二、(15分)简答及证明题(1)影响聚类结果的主要因素有那些?(2)证明马氏距离是平移不变的、非奇异线性变换不变的。

答:(1)分类准则,模式相似性测度,特征量的选择,量纲。

(2)证明:(2分)(2分)(1分)设,有非奇异线性变换:(1分)(4分)三、(8分)说明线性判别函数的正负和数值大小在分类中的意义并证明之。

答:(1)(4分)的绝对值正比于到超平面的距离平面的方程可以写成式中。

于是是平面的单位法矢量,上式可写成设是平面中的任一点,是特征空间中任一点,点到平面的距离为差矢量在上的投影的绝对值,即(1-1)上式中利用了在平面中,故满足方程式(1-1)的分子为判别函数绝对值,上式表明,的值正比于到超平面的距离,一个特征矢量代入判别函数后所得值的绝对值越大表明该特征点距判别界面越远。

(2)(4分)的正(负)反映在超平面的正(负)侧两矢量和的数积为(2分)显然,当和夹角小于时,即在指向的那个半空间中,>0;反之,当和夹角大于时,即在背向的那个半空间中,<0。

由于,故和同号。

所以,当在指向的半空间中时,;当在背向的半空间中,。

判别函数值的正负表示出特征点位于哪个半空间中,或者换句话说,表示特征点位于界面的哪一侧。

五、(12分,每问4分)在目标识别中,假定有农田和装甲车两种类型,类型w1和类型w2分别代表农田和装甲车,它们的先验概率分别为0.8和0.2,损失函数如表1所示。

现在做了三次试验,获得三个样本的类概率密度如下::0.3,0.1,0.6:0.7,0.8,0.3(1)试用贝叶斯最小误判概率准则判决三个样本各属于哪一个类型;(2)假定只考虑前两种判决,试用贝叶斯最小风险准则判决三个样本各属于哪一类;(3)把拒绝判决考虑在,重新考核三次试验的结果。

表1类型损失判决1ω1α 1 45 11 1解:由题可知:,,,,(1)(4分)根据贝叶斯最小误判概率准则知:,则可以任判;,则判为;,则判为;(2)(4分)由题可知:则,判为;,判为;,判为;(3)(4分)对于两类问题,对于样本,假设已知,有则对于第一个样本,,则拒判;,则拒判;,拒判。

1.监督学习与非监督学习的区别:监督学习方法用来对数据实现分类,分类规则通过训练获得。

该训练集由带分类号的数据集组成,因此监督学习方法的训练过程是离线的。

非监督学习方法不需要单独的离线训练过程,也没有带分类号(标号)的训练数据集,一般用来对数据集进行分析,如聚类,确定其分布的主分量等。

(实例:道路图)就道路图像的分割而言,监督学习方法则先在训练用图像中获取道路象素与非道路象素集,进行分类器设计,然后用所设计的分类器对道路图像进行分割。

使用非监督学习方法,则依据道路路面象素与非道路象素之间的聚类分析进行聚类运算,以实现道路图像的分割。

2.动态聚类是指对当前聚类通过迭代运算改善聚类;分级聚类则是将样本个体,按相似度标准合并,随着相似度要求的降低实现合并。

3. 线性分类器三种最优准则:Fisher准则:根据两类样本一般类密集, 类间分离的特点,寻找线性分类器最佳的法线向量方向,使两类样本在该方向上的投影满足类尽可能密集,类间尽可能分开。

该种度量通过类离散矩阵Sw和类间离散矩阵Sb实现。

感知准则函数:准则函数以使错分类样本到分界面距离之和最小为原则。

其优点是通过错分类样本提供的信息对分类器函数进行修正,这种准则是人工神经元网络多层感知器的基础。

支持向量机:基本思想是在两类线性可分条件下,所设计的分类器界面使两类之间的间隔为最大, 它的基本出发点是使期望泛化风险尽可能小。

一、试问“模式”与“模式类”的含义。

如果一位姓王的先生是位老年人,试问“王先生”和“老头”谁是模式,谁是模式类?答:在模式识别学科中,就“模式”与“模式类”而言,模式类是一类事物的代表,概念或典型,而“模式”则是某一事物的具体体现,如“老头”是模式类,而王先生则是“模式”,是“老头”的具体化。

二、试说明Mahalanobis距离平方的定义,到某点的Mahalanobis距离平方为常数的轨迹的几何意义,它与欧氏距离的区别与联系。

答:Mahalanobis距离的平方定义为:其中x,u为两个数据,是一个正定对称矩阵(一般为协方差矩阵)。

根据定义,距某一点的Mahalanobis 距离相等点的轨迹是超椭球,如果是单位矩阵Σ,则Mahalanobis距离就是通常的欧氏距离。

三、试说明用监督学习与非监督学习两种方法对道路图像中道路区域的划分的基本做法,以说明这两种学习方法的定义与它们间的区别。

答:监督学习方法用来对数据实现分类,分类规则通过训练获得。

该训练集由带分类号的数据集组成,因此监督学习方法的训练过程是离线的。

非监督学习方法不需要单独的离线训练过程,也没有带分类号(标号)的训练数据集,一般用来对数据集进行分析,如聚类,确定其分布的主分量等。

就道路图像的分割而言,监督学习方法则先在训练用图像中获取道路象素与非道路象素集,进行分类器设计,然后用所设计的分类器对道路图像进行分割。