AdaBoost算法流程和证明

adaboost算法基本原理

adaboost算法基本原理Adaboost算法是一种集成学习方法,通过组合多个弱分类器来构建一个强分类器。

它的基本原理是通过逐步调整训练样本的权重,并将每个弱分类器的分类结果进行加权投票,从而得到最终的分类结果。

Adaboost算法的核心思想是通过迭代的方式训练多个弱分类器,并根据每个分类器的性能调整样本的权重,使得那些被错误分类的样本在后续的训练中得到更多的关注。

具体来说,Adaboost算法的训练过程可以分为以下几个步骤:1. 初始化样本权重:开始时,所有样本的权重相等。

2. 迭代训练:对于每次迭代,都会训练一个新的弱分类器。

训练过程中,会根据当前的样本权重来调整训练样本的相对重要性。

3. 弱分类器训练:在每次迭代中,选择一个最佳的弱分类器来训练。

弱分类器通常是一个简单的分类模型,比如决策树桩(decision stump)。

4. 弱分类器权重计算:计算当前弱分类器的权重,该权重取决于分类器的准确性。

准确性越高的分类器,其权重越大。

5. 样本权重更新:根据当前的弱分类器的表现,调整每个样本的权重。

被正确分类的样本权重会减小,被错误分类的样本权重会增加。

6. 结果加权投票:将每个弱分类器的分类结果进行加权投票,权重为其对应的分类器权重。

最终的分类结果是投票得到的分类标签。

通过上述步骤的迭代,Adaboost算法能够不断调整样本的权重,逐渐提升弱分类器的准确性,并且将它们组合成一个强分类器。

Adaboost算法的优点在于,它能够处理多类别分类问题,并且对于噪声数据具有较好的鲁棒性。

此外,Adaboost算法还能够自动选择特征,并且减少了参数的选择。

然而,Adaboost算法也存在一些限制。

首先,它对异常值敏感,异常值可能会对训练过程产生较大的影响。

其次,Adaboost算法对于噪声数据和过拟合问题也比较敏感。

最后,Adaboost算法的训练过程是串行的,无法并行化处理。

总结起来,Adaboost算法是一种通过迭代训练多个弱分类器,并将它们进行加权投票的集成学习方法。

adaboostclassifier()介绍

adaboostclassifier()介绍摘要:1.AdaBoost 简介2.AdaBoost 算法原理3.AdaBoost 应用实例4.AdaBoost 优缺点正文:1.AdaBoost 简介AdaBoost(Adaptive Boosting)是一种自适应的集成学习算法,主要用于解决分类和回归问题。

它通过组合多个基本分类器(弱学习器)来提高预测性能,可以有效地解决单个分类器准确率不高的问题。

AdaBoost 算法在机器学习领域被广泛应用,尤其是在图像识别、文本分类等任务中取得了很好的效果。

2.AdaBoost 算法原理AdaBoost 算法的核心思想是加权训练样本和加权弱学习器。

在每一轮迭代过程中,算法会根据样本的权重来调整训练样本,使得错误分类的样本在下一轮中拥有更高的权重。

同时,算法会根据弱学习器的权重来调整弱学习器的重要性,使得表现更好的弱学习器在下一轮中拥有更高的权重。

这个过程会一直进行,直到达到预设的迭代次数。

具体来说,AdaBoost 算法包括以下步骤:(1) 初始化:设置初始权重,通常为等权重。

(2) 迭代:a.根据样本权重,对训练样本进行加权抽样。

b.训练弱学习器,得到弱学习器的预测结果。

c.更新样本权重,将错误分类的样本权重增加,正确分类的样本权重减小。

d.更新弱学习器权重,将表现更好的弱学习器权重增加,表现较差的弱学习器权重减小。

(3) 终止条件:达到预设的迭代次数或满足其他终止条件。

(4) 集成:将多个弱学习器进行集成,得到最终的预测结果。

3.AdaBoost 应用实例AdaBoost 算法在许多领域都有广泛应用,例如:(1) 图像识别:在计算机视觉领域,AdaBoost 算法被广泛应用于图像识别任务,尤其是人脸识别、车牌识别等。

(2) 文本分类:在自然语言处理领域,AdaBoost 算法可以用于文本分类任务,例如情感分析、垃圾邮件过滤等。

(3) 语音识别:在语音识别领域,AdaBoost 算法可以用于声学模型的训练,提高语音识别的准确率。

Adaboost算法流程和证明.doc

Adaboost 算法1、 Adaboost 算法简介Adaboost 算法是 Freund 和 Schapire 根据在线分配算法提出的,他们详细分析了 Adaboost 算法错误率的上界,以及为了使强分类器达到错误率,算法所需要的最多迭代次数等相关问题。

与Boosting 算法不同的是, Adaboost 算法不需要预先知道弱学习算法学习正确率的下限即弱分类器的误差,并且最后得到的强分类器的分类精度依赖于所有弱分类器的分类精度,这样可以深入挖掘弱分类器算法的能力。

2、 Adaboost 算法基本原理Adaboost 是一种迭代算法,其核心思想是针对同一个训练集训练不同的分类器 ( 弱分类器 ) ,然后把这些弱分类器集合起来,构成一个更强的最终分类器( 强分类器 ) 。

其算法本身是通过改变数据分布来实现的,它根据每次训练集之中每个样本的分类是否正确,以及上次的总体分类的准确率,来确定每个样本的权值。

将修改过权值的新数据集送给下层分类器进行训练,最后将每次训练得到的分类器最后融合起来,作为最后的决策分类器。

使用Adaboost 分类器可以排除一些不必要的训练数据特征,并将关键放在关键的训练数据上面。

Adaboost 算法中不同的训练集是通过调整每个样本对应的权重来实现的。

开始时,每个样本对应的权重是相同的,即其中n 为样本个数,在此样本分布下训练出一弱分类器。

对于分类错误的样本,加大其对应的权重;而对于分类正确的样本,降低其权重,这样分错的样本就被突出出来,从而得到一个新的样本分布。

在新的样本分布下,再次对弱分类器进行训练,得到弱分类器。

依次类推,经过T 次循环,得到T 个弱分类器,把这T 个弱分类器按一定的权重叠加(boost) 起来,得到最终想要的强分类器。

Adaboost 算法的具体步骤如下:设输入的n 个训练样本为: {( x1 , y1 ),( x2 , y2 ), L ,( x n , y n )} , 其中x i 是输入的训练样本,y i {0,1 } 分别表示正样本和负样本,其中正样本数为l ,负样本数m 。

解决二分类问题的算法——AdaBoost算法

解决二分类问题的算法——AdaBoost算法

1.集成学习

集成学习(ensemble learning)通过组合多个基分类器(base classifier)来完成学习任务,颇有点“三个臭皮匠顶个诸葛亮”的意味。

基分类器一般采用的是弱可学习(weakly learnable)分类器,通过集成学习,组合成一个强可学习(strongly learnable)分类器。

所谓弱可学习,是指学习的正确率仅略优于随机猜测的多项式学习算法;强可学习指正确率较高的多项式学习算法。

集成学习的泛化能力一般比单一的基分类器要好,这是因为大部分基分类器都分类错误的概率远低于单一基分类器的。

偏差与方差

“偏差-方差分解”(bias variance decomposition)是用来解释机器学习算法的泛化能力的一种重要工具。

对于同一个算法,在不同训练集上学得结果可能不同。

对于训练集,由于噪音,样本的真实类别为(在训练集中的类别为),则噪声为

学习算法的期望预测为

使用样本数相同的不同训练集所产生的方法

期望输入与真实类别的差别称为bias,则

为便于讨论,假定噪声的期望为0,即,通过多项式展开,可对算法的期望泛化误差进行分解(详细的推导参看[2]):

也就是说,误差可以分解为3个部分:bias、variance、noise。

bias度量了算法本身的拟合能力,刻画模型的准确性;variance度量了数据扰动所造成的影响,刻画模型的稳定性。

为了取得较好的泛化能力,则需要充分拟合数据(bias小),并受数据扰动的影响小(variance 小)。

但是,bias与variance往往是不可兼得的:。

adaboost分类算法

adaboost分类算法

Adaboost(Adaptive Boosting)是一种集成学习(Ensemble Learning)方法,用于解决二分类问题。

它通过组合多个弱分类器(weak classifiers)来构建一个强分类器(strong classifier)。

以下是Adaboost分类算法的主要步骤:

1. 初始化权重:对于N个训练样本,初始化每个样本的权重为相等值,即w1=1/N, w2=1/N, ..., wN=1/N。

2. 对于每个弱分类器:

a. 训练一个弱分类器,该分类器在当前样本权重下能够取得较低的分类错误率。

b. 计算该弱分类器的权重,该权重取决于该分类器的分类错误率。

分类错误率越小,权重越大。

3. 更新样本权重:根据当前的弱分类器的权重,调整每个样本的权重。

如果某个样本被错误分类,则增加它的权重,反之减少。

4. 重复步骤2和步骤3,直到所有的弱分类器都被训练完毕。

5. 构建强分类器:将每个弱分类器的权重与它们的预测结果组合起来,得到最终的强分类器。

6. 对新样本进行分类:根据强分类器,对新的样本进行分类。

Adaboost算法通过迭代地调整样本权重,训练并组合多个弱

分类器来提高分类性能。

弱分类器通常是基于一些简单的特征或规则进行分类。

每个弱分类器的权重根据其分类性能进行调整,以便对常被错误分类的样本给予更多的关注。

Adaboost算法在实际应用中表现出较好的性能,能够有效地处理复杂的分类问题。

它具有较强的鲁棒性和泛化能力,能够自适应地调整样本权重,对数据中的异常或噪声具有较强的抵抗力。

Adaboost算法的前世今生

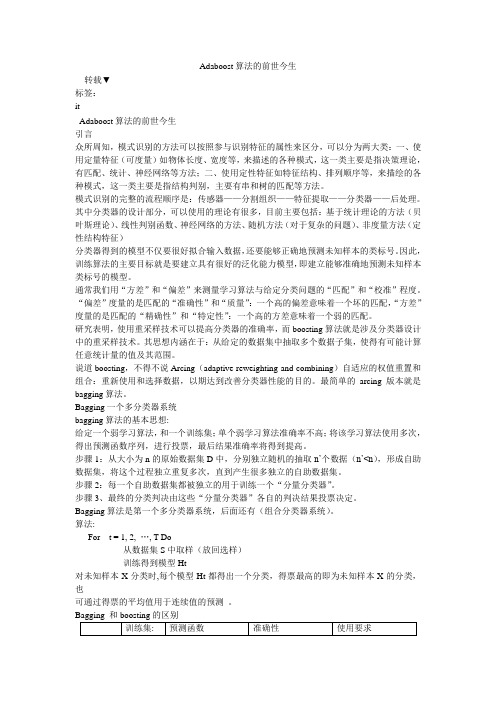

Adaboost算法的前世今生转载▼标签:itAdaboost算法的前世今生引言众所周知,模式识别的方法可以按照参与识别特征的属性来区分,可以分为两大类:一、使用定量特征(可度量)如物体长度、宽度等,来描述的各种模式,这一类主要是指决策理论,有匹配、统计、神经网络等方法;二、使用定性特征如特征结构、排列顺序等,来描绘的各种模式,这一类主要是指结构判别,主要有串和树的匹配等方法。

模式识别的完整的流程顺序是:传感器——分割组织——特征提取——分类器——后处理。

其中分类器的设计部分,可以使用的理论有很多,目前主要包括:基于统计理论的方法(贝叶斯理论)、线性判别函数、神经网络的方法、随机方法(对于复杂的问题)、非度量方法(定性结构特征)分类器得到的模型不仅要很好拟合输入数据,还要能够正确地预测未知样本的类标号。

因此,训练算法的主要目标就是要建立具有很好的泛化能力模型,即建立能够准确地预测未知样本类标号的模型。

通常我们用“方差”和“偏差”来测量学习算法与给定分类问题的“匹配”和“校准”程度。

“偏差”度量的是匹配的“准确性”和“质量”:一个高的偏差意味着一个坏的匹配,“方差”度量的是匹配的“精确性”和“特定性”:一个高的方差意味着一个弱的匹配。

研究表明,使用重采样技术可以提高分类器的准确率,而boosting算法就是涉及分类器设计中的重采样技术。

其思想内涵在于:从给定的数据集中抽取多个数据子集,使得有可能计算任意统计量的值及其范围。

说道boosting,不得不说Arcing(adaptive reweighting and combining)自适应的权值重置和组合:重新使用和选择数据,以期达到改善分类器性能的目的。

最简单的arcing版本就是bagging算法。

Bagging一个多分类器系统bagging算法的基本思想:给定一个弱学习算法,和一个训练集;单个弱学习算法准确率不高;将该学习算法使用多次,得出预测函数序列,进行投票,最后结果准确率将得到提高。

adaboost算法的公式

adaboost算法的公式Adaboost(Adaptive Boosting)是一种集成学习方法,用于改善分类算法的性能。

它被广泛应用于图像识别、语音处理、计算机视觉等领域,在机器学习中具有重要的地位。

本文将详细讨论Adaboost算法的公式及其背后的原理。

Adaboost算法的公式可以分为两个部分:基分类器权重更新公式和最终分类器的计算公式。

1. 基分类器权重更新公式假设训练数据集为D={(x1, y1),(x2, y2),...,(xm, ym)},其中xi表示第i个样本的特征向量,yi表示第i个样本的类别标签。

Adaboost算法通过迭代的方式,逐步提高分类器的性能。

首先,给定一个初始的权重分布w1 = [w11, w12, ..., wm],其中wi表示第i个样本的权重,初始时所有样本的权重都相等。

然后迭代进行以下步骤:1.1. 选择一个弱分类器,将其称为基分类器(或叫做弱分类器)。

基分类器是一种效果不太好的分类器,它的准确率可能只比随机猜测略高。

1.2. 对于每个样本i,计算基分类器的分类误差率err:err = Σwi,如果基分类器将样本i分类错误,则wi的值会增加,即权重越高;如果正确分类,wi的值不会发生变化。

1.3. 通过计算基分类器的权重α,更新样本权重w。

其中,α表示基分类器在最终分类器中的重要性,它的值取决于分类器的准确性。

计算公式为:α = 0.5 * ln((1 - err) / err)为了保证公式中的分母不为零,在计算过程中可以加入一个极小的数,如1e-6。

1.4. 更新样本权重w。

对于错误分类的样本,wi = wi * exp(α),对于正确分类的样本,wi = wi * exp(-α)。

1.5. 归一化样本权重w,使得它们之和等于1。

2. 最终分类器的计算公式经过多次迭代后,Adaboost算法会生成多个基分类器及对应的权重,最终通过组合这些基分类器构建出一个较为准确的分类器。

adaboost的一些说明

adaboost的一些说明~~~~~~~~~`2008-11-27 01:14上学期拿出一部分时间来做adaboost,做的时候做了一些笔记。

论坛上也有一些正在读程序研究算法的人。

我就把这份粗糙的笔记拿出来与大家分享一下吧。

肯定有错误的地方,也有不妥当的地方,大家不要太相信我还有这个地方不能贴公式,不能贴图片,还有我很懒,就挑了几幅重要的贴了,其他的大家去看文章吧排版不好看,也许写得也不明白,大家多包涵,希望大家可以完善这个文档。

让后来者少走些弯路。

不用发论坛消息问我,发在这里让更多人看见,更多人解答,然后也可以让更多的人知道,更好些第一部分:算法的产生1996年Yoav Freund在Experiments with a New Boosting Algorithm中提出了AdaBoost.M1和AdaBoost.M2两种算法.其中,AdaBoost.M1是我们通常所说的Discrete AdaBoost;而AdaBoost.M2是M1的泛化形式.该文的一个结论是:当弱分类器算法使用简单的分类方法时,boosting的效果明显地统一地比bagging要好.当弱分类器算法使用C4.5时,boosting比bagging较好,但是没有前者的比较来得明显.文献中记录的.M1算法初始1.获得一组样本(X)和它的分类(Y)和一个分类器(weaklearn).2.赋予平均的权值分布D(i)进入循环:T次1. 赋予弱分类器权值D(i),使用弱分类器获得样本(X)到分类(Y)上的一个映射.(就是把某个X归到某个Y类中去)2. 计算这个映射的误差e.e=各个归类错误的样本权值之和.如果e>1/2那么弱分类器训练失败,挑出循环,训练结束(这在二值检测中是不会发生的,而多值的情况就要看分类器够不够强健了)3. 设B = e / ( 1 - e ).用于调整权值.因为e<1/2.因此0<B<14. 如果某样本分类正确,该样本的权值就乘以B让权值变小;如果分类错误,就让该样本的权值乘以B^-1或者不变,这样就让分类正确的样本权值降低,分类错误的样本权值升高,加强了对较难分类样本的分类能力5. 权值均衡化循环结束1. 最终的分类器是,当一个X进入时,遍历所有Y,寻找使(h(x)=y的情况下,log(1/B)之和)最大者即是输出分类yM2相比于M1的改进是允许弱分类器输出多个分类结果,并输出这几个分类结果的可能性(注意,这里不是概率).M2的流程是1.获得一组样本(X)和它的分类(Y)和一个分类器(weaklearn).2.对于某个样本Xi将它的分类归为一个正确分类Yi和其他不正确分类Yb3.样本权值进行如下分布首先每个样本分到1/m的权值,然后每个不正确分类分到(1/m)/Yb的个数.也就是说样本权值是分到了每个不正确的分类上进入循环1. 求每个样本的权值,即每个样本所有不正确的分类的权值和,再求每个样本错误分类的权值,即不正确分类的权值除以该样本的权值.最后将每个样本的权值归一化2. 将样本权值和某样本的不正确分类的权值输入到weaklearn,获得弱分类器的输出为各个分类的可能值3. 计算伪错误率:公式见上4. 更新权值退出循环最终的强分类器: 图贴不出来了...1999年, ROBERT E. SCHAPIRE和YORAM SINGER,于Machine Learning发表论文:Improved Boosting Algorithms Using Confidence-rated Predictions.提出了更具一般性的AdaBoost形式.提出了自信率以改善AdaBoost的性能.并提出了解决多标签问题的AdaBoost.MH和AdaBoost.MR算法,其中AdaBoost.MH算法的一种形式又被称为Real Boost算法.事实上:Discrete AdaBoost是指,弱分类器的输出值限定在{-1,+1},和与之相应的权值调整,强分类器生成的AdaBoost算法;Real AdaBoost是指,弱分类器输出一个可能度,该值的范围是整个R, 和与之相应的权值调整,强分类器生成的AdaBoost算法。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Discete-AdaBoost 算法

1、给定训练集:()()11,,...,,N N x y x y ,其中{}1,1i y ∈-,表示i x 的正确

的类别标签,1,...,i N = ,()j i g x 表示第i 副图像的第j 个特征值 2、训练集上样本的初始分布:()11D i m

= 3、寻找若分类器 h t (1,...,t T =) (1)对于每个样本中的第j 个特征,可以得到一个若分类器h j ,

即可得到阈值j θ和方向P j ,使得1()()N

j t i j i i i D x h x y ε==≠∑达到最小,

而弱分类器h j 为:

1()()1j j j j

j p g x p h x other

θ<⎧=⎨

-⎩ 其中P j 决定不等式的方向, 只有1±两种情况。

4、将所有特征(j)中挑选出一个具有最小误差t ε的弱分类器t h 。

5、对所有的样本权重进行更新

()()()()

1exp t t i t i t t

D i y h x D i Z α+-=

其中t Z 是使N

1i 1

D ()1t i x +==∑得归一化因子。

6、经过T 轮训练得到T 个最优的弱分类器,此时组成一个强分

类器;

()()1T

final t t t H x sign h x α=⎛⎫

= ⎪

⎝⎭∑

在Adaboost 算法的弱学习中,将产生错误率为12,T εεε 的弱分类器。

如果每个错误率1/2t ε≤,则强分类器的总错误率

e <一切都从强分类器的错误率开始 首先 权值更新

其中f ()()i t t t

x h x α=∑

然后 强分类器的错误率

使这个错误率快速下降?

t Z 为归一化因子。

转化为求t Z 的最小值了!

:()

:()

()exp(())

()exp()()exp()

(1)exp()exp()

i i i i t t i t i t i i

t i t t i t i y H x i y H x t t t t Z D x y h x D x D x αααεαεα=≠=-=

-+

=--+∑∑

∑

此时我们用贪心算法求出t Z 的一个局部最小值 对t Z 中的t α求导[此时将t ε固定]

(1)exp()exp()t

t t t t t

dZ d εαεαα=---+ 令导数为零

0t

t

dZ d α=解出 11ln(

)2

t

t t

εαε-=

此时

t Z =

绘制t Z 关于t ε的曲线图

从这幅图上我们可以看出,当错误率越小或者越大(只要不在中点处徘徊)的时候t Z 快速收敛到0。

越小:说明错误越小的分类器能快速识别出正例。

越大: 说明错误越大的分类器也能快速识别出正例。

1()()N

j t i j i i i D x h x y ε==≠∑

既然最大,只要我把弱分类器取反,这样错误率就是最小,这样还是收敛到0。

从以上的证明,我们知道只要是弱分类器的错误率都取最小,于是我们就能组合得到一个强分类器。

接下来我们就找出一个弱分类器1()h x 错误率1ε很小。

找T 个联合起来就得到了强分类器()final H x ! 怎么找弱分类器? 决策树ID3,C4.5,C5.0

ID3 生成树用(CIG 类别属性增益法) C4.5 生成树用(Gain Ratio 增益比率法)

修剪树用(Rule post-pruning 规则修剪)

C5.0 生成树用(Gini index 基尼指数)

修剪树用(CRAT 回归树修剪)

然后给出Yoav Freund 论文中给出的寻找方法

12(),()()j j j N g x g x g x

排序

12(),()()N j j j g x g x g x

令阈值

1g ()()

2

i i j j i

j x g x θ++=

1()()0j j j j

j p g x p h x other

θ<⎧=⎨

⎩,1()()N j t i j i i i D x h x y ε==≠∑。