08-基于序列图象对应概率累积的基础矩阵求解方法

[转载]图的拉普拉斯矩阵学习-Laplacian

![[转载]图的拉普拉斯矩阵学习-Laplacian](https://img.taocdn.com/s3/m/528874d72dc58bd63186bceb19e8b8f67c1cefa5.png)

[转载]图的拉普拉斯矩阵学习-Laplacian Matrices of Graphs We all learn one way of solving linear equations when we first encounter linearalgebra: Gaussian Elimination. In this survey, I will tell the story of some remarkable connections between algorithms, spectral graph theory, functional analysisand numerical linear algebra that arise in the search for asymptotically faster algorithms.I will only consider the problem of solving systems of linear equationsin the Laplacian matrices of graphs. This is a very special case, but it is also avery interesting case. I begin by introducing the main characters in the story.1. Laplacian Matrices and Graphs. We will consider weighted, undirected,simple graphs G given by a triple (V,E,w), where V is a set of vertices, Eis a set of edges, and w is a weight function that assigns a positive weight toevery edge. The Laplacian matrix L of a graph is most naturally defined bythe quadratic form it induces. For a vector x ∈ IRV , the Laplacian quadraticform of G is:Thus, L provides a measure of the smoothness of x over the edges in G. Themore x jumps over an edge, the larger the quadratic form becomes.The Laplacian L also has a simple description as a matrix. Define theweighted degree of a vertex u by:Define D to be the diagonal matrix whose diagonal contains d, and definethe weighted adjacency matrix of G by:We haveL = D − A.It is often convenient to consider the normalized Laplacian of a graph insteadof the Laplacian. It is given by D−1/2LD−1/2, and is more closely related tothe behavior of random walks.Regression on Graphs. Imagine that you have been told the value of afunction f on a subset W of the vertices of G, and wish to estimate thevalues of f at the remaining vertices. Of course, this is not possible unlessf respects the graph structure in some way. One reasonable assumption isthat the quadratic form in the Laplacian is small, in which case one mayestimate f by solving for the function f : V → IR minimizing f TLf subjectto f taking the given values on W (see [ZGL03]). Alternatively, one couldassume that the value of f at every vertex v is the weighted average of f atthe neighbors of v, with the weights being proportional to the edge weights.In this case, one should minimize:|D-1Lf|subject to f taking the given values on W. These problems inspire manyuses of graph Laplacians in Machine Learning.。

矩阵奇异值分解具体计算过程_解释说明以及概述

矩阵奇异值分解具体计算过程解释说明以及概述1. 引言1.1 概述矩阵奇异值分解(Singular Value Decomposition,简称SVD)是一种重要的矩阵分解方法,广泛应用于数据降维、图像处理、推荐系统和信号处理等领域。

通过将一个矩阵分解为三个独特的部分,即原始矩阵的奇异向量和奇异值,SVD 可以提供有关原始数据的宝贵信息。

本文旨在详细介绍矩阵奇异值分解的具体计算过程,并对其应用领域以及算法优化和改进方向进行探讨。

首先,我们将给出该方法的定义和基本原理,并描述其计算方法和数学推导。

接着,我们将深入探究矩阵奇异值分解在图像压缩与降维、推荐系统和数据挖掘以及信号处理和模式识别等方面的应用。

然后,我们将讨论近似求解算法、加速技术以及大规模矩阵奇异值分解算法的最新进展。

最后,我们还将探索结合其他矩阵分解技术发展方向。

1.2 文章结构本文共包含五个主要部分。

第一部分是引言,主要概述了本文的目的和结构。

第二部分将详细介绍矩阵奇异值分解的具体计算过程,包括定义、基本原理、计算方法和数学推导。

第三部分将解释说明矩阵奇异值分解在不同领域中的应用,如图像压缩与降维、推荐系统和数据挖掘以及信号处理和模式识别。

第四部分将讨论矩阵奇异值分解算法的优化和改进方向,包括近似求解算法、加速技术以及结合其他矩阵分解技术的发展方向。

最后一部分是结论,总结文章的主要内容和贡献,并对未来研究方向进行展望。

1.3 目的本文旨在通过详细讲解矩阵奇异值分解的具体计算过程,深入理解其原理和应用,并探讨其改进方向。

通过对该方法进行全面系统地介绍,希望能够增加读者对矩阵奇异值分解有关知识的了解,并为相关领域的研究者提供参考和启示。

同时,本文也为后续相关领域深入研究和应用提供了理论基础和开发方向。

2. 矩阵奇异值分解具体计算过程2.1 矩阵奇异值分解定义和基本原理矩阵奇异值分解(Singular Value Decomposition,简称SVD)是一种常用的矩阵分解方法。

matlab基于svd算法计算点集之间的变换矩阵

一、概述在计算机视觉和图像处理领域,点集之间的变换矩阵是非常重要的一部分。

通过计算点集之间的变换矩阵,可以实现图像的配准、目标跟踪、姿态估计等应用。

而在matlab中,基于奇异值分解(SVD)算法来计算点集之间的变换矩阵是一种常见且有效的方法。

本文将介绍如何利用matlab中的SVD算法来计算点集之间的变换矩阵。

二、奇异值分解(SVD)算法简介SVD是一种矩阵分解的方法,它将一个矩阵分解为三个矩阵的乘积。

对于一个矩阵A,其SVD分解可以表示为:A = U * S * V',其中U 和V是正交矩阵,S是对角矩阵。

SVD分解可以帮助我们理解矩阵的性质,并在计算点集之间的变换矩阵时提供了重要的数学基础。

三、点集之间的变换矩阵在计算机视觉和图像处理中,我们常常需要计算一个点集到另一个点集之间的变换矩阵,以实现图像的配准和对齐。

假设有两个点集P和Q,它们分别包含了n个点,我们希望找到一个变换矩阵T,使得对于任意的点p_i∈P,都存在一个对应的点q_i∈Q,满足q_i = T * p_i。

四、 matlab中基于SVD算法计算变换矩阵的实现在matlab中,可以利用SVD算法来计算点集之间的变换矩阵。

以下是一个基于SVD算法计算点集之间的变换矩阵的matlab代码示例:```matlabfunction transformation_matrix = calculate_transform_matrix(P, Q)P和Q分别为两个点集,每一列代表一个点计算均值中心化mean_P = mean(P, 2);mean_Q = mean(Q, 2);P_centered = P - mean_P;Q_centered = Q - mean_Q;计算协方差矩阵covariance_matrix = P_centered * Q_centered';对协方差矩阵进行SVD分解[U, ~, V] = svd(covariance_matrix);计算旋转矩阵RR = V * U';计算平移矩阵tt = mean_Q - R * mean_P;构造变换矩阵transformation_matrix = eye(3);transformation_matrix(1:2, 1:2) = R;transformation_matrix(1:2, 3) = t;end```五、结论通过使用matlab中的SVD算法,我们可以有效地计算点集之间的变换矩阵,从而实现图像的配准、目标跟踪等应用。

cummulative possibility方法 -回复

cummulative possibility方法-回复以中括号内的内容为主题,写一篇1500-2000字文章,一步一步回答。

[累积概率方法]在概率统计学中,累积概率方法是一种常用的统计分析方法,它用于计算或估计某个事件发生的累积概率。

通过将事件的概率累积起来,可以得出事件在一定范围内的概率分布情况。

一、理论基础1.1 概率的定义概率是用来描述随机事件发生可能性的数值。

在数学中,概率被定义为一个事件发生的次数与实验总次数之比。

通常用P(A)来表示事件A发生的概率。

1.2 累积概率的定义累积概率是指某个事件在一个范围内发生的概率。

通过将事件的概率逐个累加,可以得到一个随机变量的累积分布函数,用来描述事件在一定范围内的发生概率。

二、累积概率的计算方法2.1 离散概率与连续概率在计算累积概率时,需要根据事件的性质选择合适的计算方法。

当事件是离散的,即取有限个数的取值,可以使用离散概率的计算方法。

而当事件是连续的,即可以取任意实数值,就需要使用连续概率的计算方法。

2.2 累积函数的计算累积函数是累积概率的数学描述。

对于离散事件,累积函数可以通过将事件的概率从小到大进行累加得到。

而对于连续事件,累积函数可以通过事件的密度函数和积分计算得到。

2.3 数值计算方法在实际应用中,累积概率的计算通常需要使用数值计算方法。

其中最常用的方法是使用统计软件或编程语言来进行计算,通过调用相应的函数来计算累积概率。

三、累积概率的应用3.1 随机事件的预测累积概率方法可以帮助我们对随机事件的发生概率进行预测。

通过计算事件在过去的发生频率,可以估计事件在未来发生的概率。

3.2 风险评估与决策分析累积概率方法还可以用于风险评估和决策分析。

通过计算不同风险事件的累积概率,可以评估风险的大小,并帮助做出相应的决策。

3.3 统计分析与建模在统计分析和建模中,累积概率方法可以用来评估模型的拟合度。

通过比较观测值的累积概率与模型预测的累积概率,可以评估模型的准确性和可靠性。

八点法求解基本矩阵

八点法求解基本矩阵八点法是一种用于求解基本矩阵的常用方法。

基本矩阵是在计算机视觉和几何学中非常重要的概念,它可以用来描述两个图像之间的几何关系。

在这篇文章中,我将详细介绍八点法的原理和步骤,并给出一个完整的求解基本矩阵的示例。

1. 问题定义在计算机视觉中,我们经常需要估计两幅图像之间的相机运动关系,即两个视图之间的基本矩阵。

基本矩阵可以描述图像之间的本质矩阵,通过它可以恢复出图像间的3D结构。

2. 八点法的原理八点法是求解基本矩阵的一种常用方法。

它利用了图像上的对应点对来建立一个线性方程组,进而求解基本矩阵。

具体来说,对于每对对应点(x1, y1)和(x2, y2),我们可以得到一个线性方程:[x2, y2, 1] * F * [x1, y1, 1] = 0其中F为3x3的基本矩阵,表示两个视图之间的几何约束。

3. 具体步骤下面是使用八点法求解基本矩阵的步骤:- 收集一组对应点对。

对应点是在两个图像上具有对应关系的像素点,可以通过特征点匹配算法来获取。

- 将对应点的坐标归一化。

为了使得计算更加稳定,我们需要对对应点的坐标进行归一化处理。

具体方法是对坐标进行平移和缩放,使得均值为0,方差为1。

- 构建方程组。

对于每对归一化的对应点,我们可以得到一个线性方程。

- 解线性方程组。

通过求解线性方程组,我们可以得到基本矩阵的参数。

- 对基本矩阵进行约束。

由于求解得到的基本矩阵可能不满足一些几何约束,比如矩阵的秩为2,我们需要对其进行约束调整。

- 重构基本矩阵。

根据得到的参数,构建出基本矩阵。

4. 示例接下来,我们以一个具体的例子来演示八点法求解基本矩阵的过程。

我们有两幅图像,分别是A和B,每幅图像上有8个对应点。

现在我们要计算出A和B之间的基本矩阵。

首先,我们收集到了两个图像上的对应点,现在我们有了8个对应点对:A1 <-> B1A2 <-> B2A3 <-> B3A4 <-> B4A5 <-> B5A6 <-> B6A7 <-> B7A8 <-> B8接下来,我们对对应点的坐标进行归一化处理。

行列阵的算法

行列阵的算法行列阵是数学中的一个重要概念,它是由行和列组成的矩阵,可以用来表示线性方程组、线性变换等。

在计算机科学中,行列阵也是一个非常重要的概念,它被广泛应用于图像处理、数据分析、机器学习等领域。

本文将介绍行列阵的算法,包括矩阵乘法、矩阵分解等。

一、矩阵乘法矩阵乘法是行列阵中最基本的运算之一,它可以用来计算两个矩阵的乘积。

假设有两个矩阵A和B,它们的大小分别为m×n和n×p,那么它们的乘积C的大小为m×p,其中C的每个元素为:C(i,j) = sum(A(i,k)*B(k,j), k=1...n)其中,i表示C的行号,j表示C的列号,k表示A和B的公共维度。

矩阵乘法可以用以下的伪代码来表示:for i = 1 to mfor j = 1 to pC(i,j) = 0for k = 1 to nC(i,j) += A(i,k) * B(k,j)矩阵乘法的时间复杂度为O(mnp),因此在实际应用中需要尽量减少矩阵乘法的次数。

矩阵乘法还有一些特殊形式,如矩阵-向量乘法、向量-矩阵乘法等,它们都可以用矩阵乘法的基本形式来实现。

二、矩阵分解矩阵分解是将一个矩阵分解成若干个子矩阵的过程,这些子矩阵可以用来表示矩阵的结构、性质等。

常见的矩阵分解方法有QR分解、SVD分解、LU分解等。

1. QR分解QR分解是将一个矩阵分解成一个正交矩阵Q和一个上三角矩阵R 的乘积,即A=QR。

其中,Q是一个正交矩阵,它的列向量是正交的,即Q^TQ=I,R是一个上三角矩阵,它的对角线元素为正数。

QR分解可以用以下的伪代码来表示:Q, R = qr(A)A = Q * R其中,qr(A)表示对矩阵A进行QR分解,Q和R是分解得到的正交矩阵和上三角矩阵,*表示矩阵乘法。

QR分解可以用来求解线性方程组、最小二乘问题等,它还可以用来计算矩阵的秩、特征值等。

2. SVD分解SVD分解是将一个矩阵分解成一个左奇异矩阵U、一个对角矩阵Σ和一个右奇异矩阵V^T的乘积,即A=UΣV^T。

基础矩阵

基础矩阵及其求法同一三维场景在两个不同视点处得到的两幅二维图像之间的几何关系——极几何以及极几何的代数表示——基础矩阵。

两幅图像可以是由两个摄像机在不同位置同时采集的,也可以是同一摄像机顺序采集的,例如摄像机相对场景移动。

对于这两种情况,几何上认为是相等的。

一般地,同一世界坐标系下的同一物体的图像间存在一种几何上的对极约束关系。

在立体视觉中,可以利用图像点的匹配来恢复这种几何关系,反过来,也可以利用这种几何关系来约束匹配,使得对应点的搜索范围由二维平面降低到对应一维极线,使得匹配的鲁棒性、精度都得到很大提高。

对极几何关系在数学上可以用基础矩阵F 来表示,因此,对极几何问题就转化为对基础矩阵F 的估计问题。

精确地计算F 对于标定、寻找精确匹配和三维重建都有重要意义。

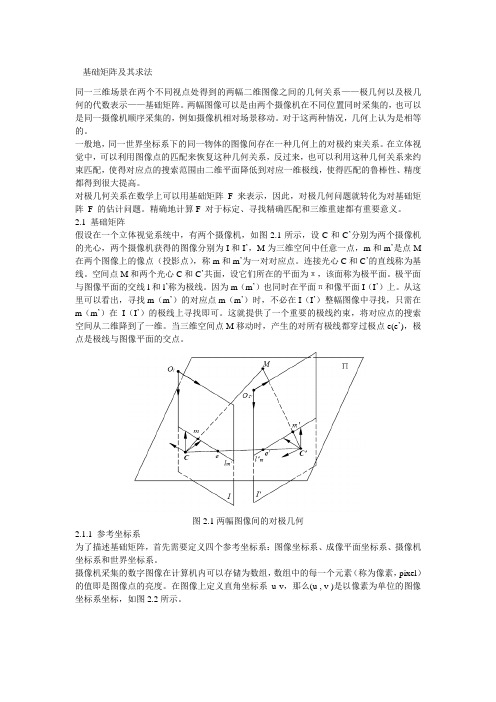

2.1 基础矩阵假设在一个立体视觉系统中,有两个摄像机,如图2.1所示,设C和C’分别为两个摄像机的光心,两个摄像机获得的图像分别为I和I’,M为三维空间中任意一点,m和m’是点M 在两个图像上的像点(投影点),称m和m’为一对对应点。

连接光心C和C’的直线称为基线。

空间点M和两个光心C和C’共面,设它们所在的平面为π,该面称为极平面。

极平面与图像平面的交线l和l’称为极线。

因为m(m’)也同时在平面π和像平面I(I’)上。

从这里可以看出,寻找m(m’)的对应点m(m’)时,不必在I(I’)整幅图像中寻找,只需在m(m’)在I(I’)的极线上寻找即可。

这就提供了一个重要的极线约束,将对应点的搜索空间从二维降到了一维。

当三维空间点M移动时,产生的对所有极线都穿过极点e(e’),极点是极线与图像平面的交点。

图2.1两幅图像间的对极几何2.1.1 参考坐标系为了描述基础矩阵,首先需要定义四个参考坐标系:图像坐标系、成像平面坐标系、摄像机坐标系和世界坐标系。

摄像机采集的数字图像在计算机内可以存储为数组,数组中的每一个元素(称为像素,pixel)的值即是图像点的亮度。

basic matrices 基矩阵

basic matrices 基矩阵

摘要:

1.基矩阵的定义

2.基矩阵的性质

3.基矩阵的应用

正文:

基矩阵是线性代数中的一个重要概念,它与向量空间和线性变换密切相关。

下面我们来详细了解一下基矩阵的定义、性质和应用。

1.基矩阵的定义

基矩阵,又称为基变换矩阵,是指在向量空间中,将一个基底向量映射到另一个基底向量的矩阵。

设V 是一个n 维向量空间,其中有两个基底B 和C,分别有n 个元素。

那么,基矩阵B 和C 之间的关系可以表示为一个矩阵A,即:

A = [B] = [C]^-1

其中,[B] 表示将B 中的元素列成一列,[C]^-1 表示C 的逆矩阵。

显然,基矩阵是线性变换,并且是满秩矩阵。

2.基矩阵的性质

基矩阵具有以下性质:

(1) 线性性:基矩阵将一个向量映射到另一个向量,满足线性组合的性质。

(2) 满秩性:基矩阵是满秩矩阵,即行列式不为0。

(3) 可逆性:基矩阵是可逆矩阵,即存在逆矩阵。

(4) 矩阵乘法:两个基矩阵相乘等于单位矩阵。

3.基矩阵的应用

基矩阵在实际应用中有很多重要作用,下面举两个例子:

(1) 在计算机图形学中,基矩阵用于将三维模型变换到二维屏幕上。

通过基矩阵的线性变换,可以将三维空间中的点映射到二维屏幕上的点。

(2) 在机器学习和数据挖掘领域,基矩阵用于对数据进行降维处理。

通过基变换矩阵,可以将高维数据映射到低维数据上,从而减少计算复杂度和避免过拟合。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

摘 要: 提出一种基于图象序列对应概率累积的基础矩阵求解算法 . 该算法基于序列对应概率累积 求最大熵点的对应概率累积分布图 , 采用 R 通 过统计 分 AN S A C 思想和加权 最小二 乘法拟合 极线 , 类器求解极点并消除出格极线 , 并利用所求的对应极线和极点 , 采 用一种参 量化方法求 解 犉 矩 阵 . 该算法工程实现容易 , 对输入的源图象没有苛刻的要求 , 可以基于随机拍摄的图象序列方便地求解

] 3 化形 式 等 等 [ 线性方法和非线性方法均基于最小 .

无法处理输入数据中含有出格点的情况 , 二乘框架 , 因此 人 们 引 入 了 诸 如 M 、 E s t i m a t o r C a s eD e l e t i o n 、 D i a n o s t i c s L m e d S、 R AN S A C 等多种鲁棒估计方 g

国家自然科学基金 ( ) 资助 6 0 6 7 5 0 1 9 : T e l 0 1 0 6 6 3 4 5 2 8 9 收稿日期 : 2 0 0 8 0 4 2 2 : b w 2 0 2@1 E m a i l 2 6. c o m y 修回日期 : 2 0 0 8 0 7 3 0

) - 狊 犑( 狆, 狇 ( ) 犘= e 3 由上式可以看出 , 对 于 较 小 的 灰 度 残 余 犑( , 狆 狇)

] 1, 4 6 法[ 现有方法共同特点均是基于输入对应点对 , .

对对应点求解算法的鲁棒性以及对应点求解准确度 都要求较高 , 在存 在 大 量 出 格 点 的 情 况 下 都 存 在 失 败的风险 , 并且对 不 同 输 入 数 据 求 解 的 极 点 位 置 稳 甚至偏差较大 . 定性差 , 为了 提 高 基 础 矩 阵 估 计 的 稳 定 性 和 实 用 性, 本 文提出一种基于图象序列对应概率累积的基础矩阵 求解方法 . 该方 法 采 用 边 缘 S U S AN 角 点 检 测 算 法 检测出每幅图象中 的 角 点 ; 在此基础上基于序列对 应概率累积求最大 熵 点 的 对 应 概 率 累 积 分 布 图 ; 然

许多相应的方法 . 根据张正友关于基础矩阵估计方

] 1 , 基础矩阵估计方法可分为两 法所 作 的 研 究 综 述 [

类: 线性方法和非 线 性 方 法 . 两 者 区 别 主 要 在 于: 处 理噪音和误匹配时 所 采 用 的 策 略 、 非线性优化中采 用的代价函数以及为确保秩为二所采用的具体参量

] 9 本文采用联合概率分布[ 来表征两者之间的差异 . 首

图1 , ) 对应的概率累积分布图 2 3 5 3 0 2 最大熵点 ( F i . 1 h e a c c u m u l a t e dp r o b a b i l i t h a r t c o r r e s o n d i n T g yc p g t om a x i m u me n t r o i x e l p yp

犉 矩阵 . 关键词 : 图象序列 ; 对应 ; 概率 ; 基础矩阵

中图分类号 : ( ) T P 3 9 1 文献标识码 : A 文章编号 : 1 0 0 4 4 2 1 3 2 0 0 9 1 1 3 0 2 1 4

0 引言

对极几何是计算机视觉领域近年来突出的研究 其关键技术是精确估计基础矩阵( 成果之一 , 犉矩 阵) 在基于立体视觉技术进行图象稀疏匹配 . ( 、 图象校正( 、 稠密 S a r s eM a t c h i n R e t i f i c a t i o n) p g) 匹配 ( 、 深度映射图计算( D e n s eM a t c h i n D e t h g) p ) 、 图象拼接 ( ) 等都不可避免地 要估 计图 M o s a i c M a p 象对之间的 犉 矩阵 . 目前 犉 矩阵的估计已 经 成 为人

] 1 2 R AN S A C 思想和加权最小二乘法拟合极 采用统计分类 器 求 解 极 点 , 消 除 出 格 极 线; 进一 线, 步采用同样的思想 求 解 对 应 极 线 和 极 点 , 最后采用 参量化方法求解 犉 矩阵 .

1 基于边缘犛 犝 犛 犃 犖 算子的图象角点检测

[ ] 8

{

犔-1

犈= 犈 犻

犻 =0

( ) 1

式中 犘 犻在图象中出现的概率 , 犔 为图象的 犻 为灰度级 基于最大熵的特征块选取算法是将侯选 最大灰度级 . 模板块的熵值作为标准 , 选取熵值最大的图象块作为 匹配模板 . 首先 , 从第一幅图象 的 重叠边 界处 选 取一 假定 H 系列一定宽度的图象块作为侯选模板 , S 为侯 选模板 定 义 在 { , , …2 集合上原始图象的直方 0 1 5 5} 由于受图象噪音的影响 , 图象 的统计 直方图 曲 线 图. 也存在一定的噪音 . 为了克服噪 音影 响 , 算 法首 先 对 以消除噪音的干扰 , 设定滤波 H S进行中值滤波处理 , 然后在此基础上按照式 处理后的图象直方图为 H S 1. ( ) 对每一个侯选模板的 H ) , 求取侯 1 S 犻 1 计算熵值 犈( { ) } , 将其对应的图 选模板中的最大熵 犈m a x 犈( 犻 a x =m 象块作为匹配模板 . 2 . 2 对应角点的联合概率分布 由于扭曲 、 成像噪音的存在 , 物 体表 面通常不 是 理想的朗伯 ( ) 表面 , 直接采用互相关法 判 L a m b e r t i a n 而且由于两幅 别侯选配准角点得到的结果通常很多 , 图象整体亮度 、 对比度之间的差 异 , 得到 的相似性 测 度大小不一致 , 因此很难确定阈 值来 筛选对 应 角 点 .

3 0 2 2

光 子 学 报

3 8卷

准确度 、 抗噪音性 、 对边缘的依 赖性 等 方 面 取 得 了 较 好的平衡 ; 此外 , 该方法在检测角点的同时能够得到 对本文的后续工作非常有帮助 . 角点响应值的大小 ,

检测出图象中的角点 , 对序列角点图进行累加并归一 化得到序列角点响应直方图 . 序列角点响应直方图是 对序列图象中的所有角点响应图象统计所得的分 布 图, 它反映序列图象角点的总 体分布 情况 . 对于 左 图 象序列每幅图象中固定坐标的最大熵点 , 计算右图象 序列中每幅图象中每一角点的联合概率分布 , 得到左 对序列 图象序列中最大熵点对应的联合概率分布图 , 联合概率分布图累加便可得最大熵点对应概率累 积 分布 . 图 1 为最大 熵点 ( , ) 对应的 概率累积 分 2 3 5 3 0 2 阈值化后) 布( .

先采用残差平方和法计算局部相关测度 , 即 ) 犑( = 狆, 狇 (,)

犻犼 ∈犖

, ) , )2 犜 犻 -犜 犻 犼 犼 狆( 狇(

( ) 2

式中 , , ) 和犜 , ) 表示匹配模板 ( 中心分别在 狆 犜 犻 犻 犼 犼 狆( 狇( 和狇 大小一定的图象区域 犖) 的灰度值 . 则模板对 之 [0 ] 表示 间的局部相关置信度可以借助于 G i b b s分布 1 成如下形式

3 对应极线与极点求解

3 . 1 犃 犖 犛 犃 犆 和加权最小二乘法的极线拟合 基于 犚 传统 H o u h 变换直线检测方法需要对整个参量 g 无效样本多 , 运算量大 , 运算时 空间进行离散化采样 , 间长 , 而且受采样间隔大小的限制 , 准确度不高 . 本文 提出采用 R A N S A C 结合加权最小二乘法的极线检测 方法 . 方法是由 R A N S A C F i s c h k e r和 B o l l e s提出的一 种鲁棒性估计算法 , 基本思想是先用满足可行条件的 最小数据集获得大量 随机初始解 , 然后用一致性条件 ` 扩大其中的一致数据集 . 首先采用 R 在对 应概 率累积 分布 A N S A C 思想 , 的非零点集中遍历任意抽取 ( 最小点集 ) 两点 ( 狓 狔 狀, 狀) 和( , 得到两点确定的直线方程 . 除此 两 点 狓 狔 狀+1 , 狀+1) 外其它非零概率点( 距该直线的距离 D ( 可 狓 i s t 犽) 狔 犽, 犽) 求, 统计到该直线距离 D ( ( 的非 i s t 犽) 狋 狋为距离阈值) < 零概率点数目 S 该直线的支持度由在一定距 u m( 狀) . 离阈值狋内的点数来度量 . 令这样的随机选择重复多 次, 求取最大非零概率点数 S 即最大支持度 ) 对 u mm a x( 应的两点( 和( , 由此两点确定的直 狓 狓 狔 狔 犽, 犽) 犽+1 , 犽+1 ) 线为犾 则可将距犾 狋的非零 犽 为是最佳的拟合 . 犽 不大于 概率点集即为拟合极线的有效点作为内点( ) 对 I n l i e r . 所有内点采用加权最小二乘法拟合所得的直线即 为 局部最大熵点对应的极线 , 此处各内点的权值即为上

角点 检 测 方 法 通 常 分 为 两 类 : 基于图象灰度信 息的角点检测和基 于 边 缘 图 象 的 角 点 提 取 . 前者定 位准确度较差 , 容易受噪音的影响 , 同时可能漏掉一 而后者对边缘提取依赖较大 , 如果检 些实际的角点 ; 测出的边缘线发生中断 , 则会对角点的提取结果造成 较大的影响 . 本文综合上述两种 方法 的优点 , 提出边 缘S 该方 法在 定位准 确 度 、 抗 U S A N 角点 检测 算法 , 对边缘的依赖性等方面取得了较好的平衡 . 噪音性 、 S U S A N( S m a l l e s tU n i v a l u eS e m e n tA s s i m i l a t i n g g [ 7] /最小 等 值 分 割 吸 收 核 ) 算子 的基本思想 N u c l e u s 将是图象中每个点都与一个具有相似亮度的局部区 同核具有相同 或 相 似 亮 度) 区域 域相联系 . U S AN( 包含着围绕任意点 区 域 的 重 要 结 构 信 息 , 当圆形模 板完全在 背 景 或 目 标 中 时 , 而当模板 U S AN 最 大 , 移向目标边缘 时 , 其U 当圆心处于 S AN 逐 渐 减 小 , 目标边缘时 , 当 圆 心 在 目 标 角 点 处 时, U S AN 很 小 , 由此 , U S AN 最小 . S U S AN 算子以在图象每点上 的 U S AN 大小作为该处特征的 显 著 性 度 量 . U S AN 计 算公式及判别函数文献 [ ] 中有详细叙述 , 这里不再 7 赘述 . 本文在综合多种角点检测算子优缺点的基础 上, 提出了一种新的边缘 S 该 U S AN 角点检测算 法 . 方法首先假设大多 数 角 点 都 位 于 边 缘 上 , 然后采用 在边缘存在位置 C a n n y 算子检测出 图 象 中 的 边 缘 , 上利用 S 该方法综合了 U S AN 算 子 进 行 角 点 检 测 . 基于灰度信息的方法和基于边缘方法的优点 , 在定位