信息论中有关信源熵的不等式

信息论(第二版傅祖云编着)课后答案(1)

⋅ 第二章课后习题【2.1】设有 12枚同值硬币,其中有一枚为假币。

只知道假币的重量与真币的重量不同,但不知究竟是重还是轻。

现用比较天平左右两边轻重的方法来测量。

为了在天平上称出哪一枚是假币,试问至少必须称多少次?解:从信息论的角度看,“12枚硬币中,某一枚为假币”该事件发生的概率为 P = 112 ; “假币的重量比真的轻,或重”该事件发生的概率为 P = 1 2; 为确定哪一枚是假币,即要消除上述两事件的联合不确定性,由于二者是独立的,因此有I = log12 + log 2 = log 24比特而用天平称时,有三种可能性:重、轻、相等,三者是等概率的,均为 P = 平每一次消除的不确定性为 I = log 3比特因此,必须称的次数为13,因此天I 1 I 2log 24 log 3 H 2.9次因此,至少需称 3次。

【延伸】如何测量?分 3堆,每堆 4枚,经过 3次测量能否测出哪一枚为假币。

【2.2】同时扔一对均匀的骰子,当得知“两骰子面朝上点数之和为 2”或“面朝上点数之和为 8”或“两骰子面朝上点数是 3和 4”时,试问这三种情况分别获得多少信息量?解:“两骰子总点数之和为 2”有一种可能,即两骰子的点数各为 1,由于二者是独立的,因此该种情况发生的概率为 P =1 1 6 6 136,该事件的信息量为:⋅ ⋅ 5 =⋅ ⋅ 2 =I = log 36 H 5.17比特“两骰子总点数之和为 8”共有如下可能:2和 6、3和 5、4和 4、5和 3、6和 2,概率为 P =1 1 6 6 536 ,因此该事件的信息量为:36 I = logH 2.85比特 5“两骰子面朝上点数是 3和 4”的可能性有两种:3和 4、4和 3,概率为P = 1 1 6 6 118, 因此该事件的信息量为:I = log18 H 4.17比特【2.3】如果你在不知道今天是星期几的情况下问你的朋友“明天星期几?”则答案中含有多少信息量?如果你在已知今天是星期四的情况下提出同样的问题,则答案中你能获得多少信息量(假设已知星期一至星期日的顺序)?解:如果不知今天星期几时问的话,答案可能有七种可能性,每一种都是等概率的,均为P = 17,因此此时从答案中获得的信息量为I = log 7 = 2.807比特而当已知今天星期几时问同样的问题,其可能性只有一种,即发生的概率为 1,此时获得的信息量为 0比特。

信息论中信源熵之间关系的证明

∑ ∑ =

−

m j=1

n i=1

p(aib j ) log

2

p(ai ) p(ai /b j )

p( ai

/bj )

∑∑ ∑∑ =

mn j=1 i=1

p(ai b j ) log 2

p(ai / bj ) − p(ai )

mn j=1 i=1

p(aibj ) log 2 p(ai / bj )

j

i

∑ ∑ = − [ p(bj ) p(ai / bj )] log 2 p(ai)

i

j

= H(X),

∑ ∑ 其中

p(bj ) p(ai/ bj ) = p(aibj ) = p(ai ) .

j

j

同理: H (Y) = H(Y / X ) + I (X;Y) ≥ H (Y / X ) .

3.1.2. H ( X ) = H ( XY ) − H(Y / X ) .

同理: I ( X ;Y ) = H (Y ) − H (Y / X ) .

∑ ∑ 3.4.2 证明:

I(X;Y )

=

n i =1

m j =1

p(aibj ) log

2

p(ai / bj ) p(ai )

∑ ∑ n m

1

= i =1 j =1 p(aibj )log 2 p(ai / bj ) p(bj / ai ) p(aibj )

nm

∑ ∑ 证明: H ( X / Y ) = −

p(aibj ) log 2 p(ai / bj )

i=1 j =1

nm

mn

∑∑ ∑ ∑ = −

p(aibj ) log 2 p(aibj ) + [ p(aib j )]log 2 p(bj )

信息论总结与复习

(3)稳态符号概率: (4)稳态信息熵:

结论:N阶马氏信源稳态信息熵(即极限熵)等于N+1阶条件熵。

第一部分、信息论基础

1.1 信源的信息理论

[例1] 已知二阶马尔可夫信源的条件概率:

p(0|00)=p(1|11)=0.8;p(0|01)=p(1|10)=0.6;

(2)联合熵:

H(XY)= -0.21log0.21 –0.14log0.14 –0.35log0.35 –0.12log0.12 –0.09log0.09–0.09log0.09 =2.3924 bit/符号

第一部分、信息论基础

1.2 信道的信息理论

(3)噪声熵:

由 和

H(Y | X)= – 0.21log0.3 –0.14log0.2 –0.35log0.5

(4)无噪有损信道:分组多对一(归并),其传输矩阵应具 有多行一列的分块对角化形式。

(5)对称信道:传输矩阵的各行都是一些相同元素的重排, 各列也是一些相同元素的重排。

第一部分、信息论基础

1.2 信道的信息理论

3、信道有关的信息熵:

(1)信源熵 (先验熵):

(2)噪声熵 (散布度):

(3)联合熵: (4)接收符号熵:

–0.12log0.4 –0.09log0.3–0.09log0.3

==(0.21+0.12,0.14+0.09,0.35+0.09) = (0.33, 0.23, 0.44)

H(Y)= -0.33log0.33 -0.23log0.23 -0.44log0.44

[例3]求对称信道 解:C =log4-H(0.2,0.3,0.2,0.3) =2+(0.2log0.2+0.3log0.3)×2 = 0.03 bit/符号; 的信道容量。

信息论与编码 第二章 信源与信息熵

现概率是它自身的先验概率。

无记忆信源

{发出符号序列的无记忆信源

发出单个符号的无记忆信源

{

离散 连续

2.1.1 无记忆信源

发出单个符号的离散无记忆信源

——指信源每次只发出一个符号代表一个消息, 且消息的取值个数是有限的(或可列无限多个)。 例如扔骰子,每次实验结果必然是1~6点中的某一 个面朝上。每次实验的结果不随实验次数变化,也 不与先前的实验结果相关,因而该信源是单符号离

p( X1 , X 2 , X l , X L ) p( X l ) [ p( X )]L

l 1

L

2.1.2 有记忆信源

有记忆信源——在不同时刻发出的符号是相互依赖的。 发出符号序列的有记忆信源 ——每次发出1组含2个以上符号的符号序列来代表一 个消息的信源,且各符号之间是相互依赖的。

I=-log2(1/2m)=m bit

2.2.1 自信息量

自信息量I (xi)的特性:

⑴ I (xi)是非负值

⑵ 当p(xi) = 1时, I (xi) = 0

⑶ 当p (xi) = 0时, I (xi) =∞

⑷ I (xi)是先验概率p (xi)的单调递减函数,即 当p (x1)>p (x2)时, I (x1) < I (x2) ⑸可加性 : 两个独立事件的联合信息量等于它们分别的信 息量之和。

发出符号序列的无记忆信源

——每次发出1组含2个以上符号的符号序列来代表一 个消息的信源,且各符号之间没有统计关联性。

需要用随机序列(或随机矢量) X =(X1, X2,…, Xl, …, XL)来描 述信源输出的消息,用联合概率分布p(X1, X2,…, Xl, …, XL)来表 示信源特性。 p (X 1 ) p (X 2 ) … p (X l ) … p (X L ) 若离散信源输出的每个符号是统计独立的,且具有相同的概 率空间,则该信源是离散平稳无记忆信源,亦称为独立同分布 (independently identical distribution,i. i. d.)信源。

信源熵的名词解释

信源熵的名词解释信源熵(Source Entropy)是信息论中一个重要的概念,用于衡量信息源的不确定性和信息的平均编码长度。

在信息论中,信息可以被看作是从一个信源中获取的,而信源熵用来描述这个信源的不确定性大小。

信源熵的计算方法是根据信源可能产生的符号的概率分布来进行的。

具体来说,如果一个信源有n个可能取值(符号)S1,S2,...,Sn,并且每个符号出现的概率分别为P1,P2,...,Pn,那么信源的熵H(S)可以通过下面的公式计算得出:H(S) = -P1log(P1) - P2log(P2) - ... - Pnlog(Pn)其中,log是以2为底的对数,P1,P2,...,Pn是概率分布。

信源熵的含义是,对于一个不确定性较大的信源,需要更长的编码长度来表示每一个符号,所以熵值越大,说明信息的平均编码长度越长。

相反,当一个信源的不确定性较小,即各个符号出现的概率分布较平均时,信息的平均编码长度较短,熵值较小。

以一个简单的例子来说明信源熵的概念。

假设有一个只有两个符号的信源,分别记为S1和S2,它们出现的概率分别为P1和P2。

如果这两个符号的概率分布相等(即P1 = P2 = 0.5),那么信源的熵就是最大的,因为这两个符号的不确定性相同,需要同样长度的编码来表示它们。

而如果其中一个符号的概率接近于1,另一个符号的概率接近于0,那么信源的熵就是最小的,因为其中一个符号的信息是确定的,只需要很短的编码来表示它。

这个例子可以帮助我们理解信源熵与不确定性之间的关系。

除了信源熵,信息论中还有一个重要的概念是条件熵(Conditional Entropy)。

条件熵是在已知一定的背景条件下,信源的不确定性大小,即在给定前提条件下的平均编码长度。

条件熵可以通过信源和条件之间的联合概率分布来计算,其公式为:H(S|T) = -ΣΣP(s, t)log(P(s|t))其中,P(s, t)表示符号s和条件t联合发生的概率。

信息论与编码2-信源及信源熵1

信息论与编码-信源及信源熵

又例如对离散化的平面图像来说,从 空间上来看是一系列离散的符号,而空间 每一点的符号(灰度)又都是随机的,由此 形成了不同的图像.所以我们可以把一般 信源输出的消息看作为时间或空间上离 散的一系列随机变量,即随机矢量.这样,信 源 描的述输,其出中可N可用为N维有随限机正矢整量数(或x1,可x2,数…的xN)无来 限值.

25

信息论与编码-信源及信源熵

2.2.2 离散信源熵

前面定义的自信息是指某一信源发出某一消 息所含有的信息量.所发出的消息不同,它们所含 有的信息量也就不同.所以自信息I(ai) 是一个 随机变量,不能用它来作为整个信源的信息测度.

我们定义自信息的数学期望为信源的平均信 息量,即

H ( X ) E [ I ( X ) ]p ( x i) I ( x i) p ( x i) lo p ( x i) g

7

信息论与编码-信源及信源熵

离散信源的数学模型就是离散型的概率空间:

X P

x1

p(x1)

x2

xn

p(x2) p(xn)

其中概率p(xi)(i=1,2,…,n)称为符号xi的先验概 率,应满足∑p(xi)=1

它表示信源可能取的消息(符号)只有n 个:x1,x2,…xn,而且每次必定取其中一个.

当xi和yj相互独立时,有p(xi,yj)=p(xi)p(yj) 于是有

I(xi,yj)= I(xi)+ I(yj)

24

信息论与编码-信源及信源熵

条件自信息量: 当xi和yj相互联系时,在事件yj 出现的条件下,xi 的

自信息量称为条件自信息量,定义为 I(xi|yj)=-logp(xi|yj)

第二章基本信息论6_连续信源的熵

一、连续信源熵的定义

♦连续信源:输出在时间和取值上都是连续的信源 连续信源:

连续信源

采样

离散信源

求信源熵

若连续信源的频带受限, 若连续信源的频带受限,为W,则根据采样定理, ,则根据采样定理, 只要采样频率大于2W, 只要采样频率大于 ,则连续信源经采样离散 不损失任何信息。 后,不损失任何信息。 p( x ) 将连续信源离散化为离散 信源,其信源熵为: 信源,其信源熵为:

∞

1 λ1 −1 e = σ 2π ⇒ λ =− 1 2 2 2σ

− 2 1 得p ( x ) = e 2σ 为高斯分布 σ 2π

x2

P(x)

最大熵

H max ( X ) = − ∫ p ( x )log p( x )dx

−∞

x 1 − 2 = − ∫ p ( x )ln e 2σ −∞ σ 2π

H max ( X ) = − ∫

V2 −V1

V2

x

p ( x )log p ( x )dx = log(V1 + V2 )

2、输出平均功率受限的信源 、 设信源 ( X ) = − ∫ p( x )log p ( x )dx为极大值的p ( x )

−V

V

以及对应的最大熵H max ( X ), 其限制条件:

P( x )

1/ 2

0

1 dx1 3

x

P(x)

2

dx2

6 x

二、连续信源熵的性质

♦ 连续信源熵可正可负

H ( X ) = −∫

−∞

∞

p ( x )log p( x )dx

1 1 = − ∫ lb dx = −1比特/采样 3 2 2

《信息论、编码与密码学》课后习题答案资料

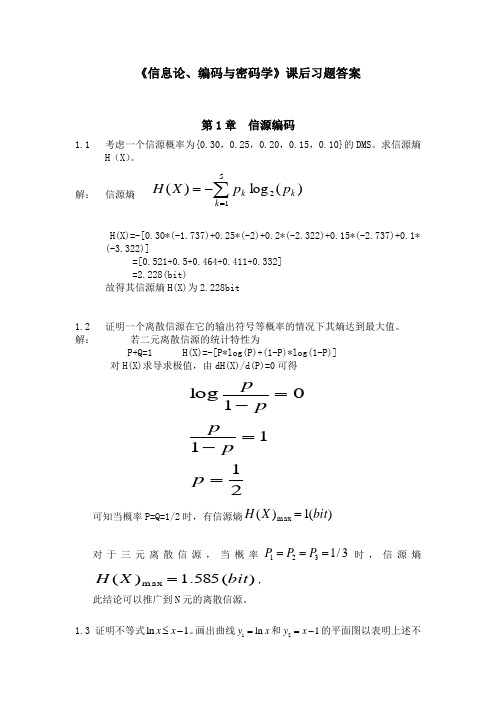

《信息论、编码与密码学》课后习题答案第1章 信源编码1.1考虑一个信源概率为{0.30,0.25,0.20,0.15,0.10}的DMS 。

求信源熵H (X )。

解: 信源熵 ∑=-=512)(log )(k k k p p X HH(X)=-[0.30*(-1.737)+0.25*(-2)+0.2*(-2.322)+0.15*(-2.737)+0.1*(-3.322)]=[0.521+0.5+0.464+0.411+0.332] =2.228(bit)故得其信源熵H(X)为2.228bit1.2 证明一个离散信源在它的输出符号等概率的情况下其熵达到最大值。

解: 若二元离散信源的统计特性为P+Q=1 H(X)=-[P*log(P)+(1-P)*log(1-P)] 对H(X)求导求极值,由dH(X)/d(P)=0可得211101log ==-=-p ppp p可知当概率P=Q=1/2时,有信源熵)(1)(max bit X H =对于三元离散信源,当概率3/1321===P P P 时,信源熵)(585.1)(m ax bit X H =,此结论可以推广到N 元的离散信源。

1.3 证明不等式ln 1x x ≤-。

画出曲线1ln y x =和21y x =-的平面图以表明上述不等式的正确性。

证明:max ()ln 1(0)1()()01001()0()0ln 11ln 1ln 1f x x x x f x xf x x x x f x f x f x x x x x x x =-+>'=''==>∴<≤>≤=≤-≥≤-≤-令,又有时此时也即当时同理可得此时综上可得证毕绘制图形说明如下 可以很明确说明上述 不等式的正确性。

1.4 证明(;)0I X Y ≥。

在什么条件下等号成立?1111(,)(,)(,)(,)log()()n mi j i j i j n mi j i j i j i j I P x y I x y P x y P x y P x P y =====∑∑∑∑(X ;Y )=当和相互独立时等号成立。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

论文题目:信息论中有关各种熵之间关系的证明学院:数学科学学院专业:信息与计算科学姓名:周艳君学号:20071115158信息论中有关各种熵之间关系的证明07信息班 周艳君 20071115158 指导老师 王桂霞摘 要 根据信息量与熵的定义和重要定理以及主要公式,对各种熵之间的关系进行分析和证明.关键词 无条件熵 条件熵 联合熵 交互熵.⒈基本定义1.1信息就是对事物动态(或它的存在方式)的不确定性的一种描述.不确定 性及随机性,可以用研究随机现象的数学教具—概率论与随机过程来描述信息.1.2自信息量:一个随机事件发生某一结果后所带来的信息量称为自信息量,简称自信息.用)(i a I 来表示.1.3联合自信息量:自信息量是二维联合集XY 上元素j i b a 的联合概率)(j i b a p 数的负值,称为联合自信息量.用)(j i b a I 来表示.1.4条件自信息量:为条件概率对数的负值.用)/(j i b a I 来表示.1.5交互信息量:i a 后验概率与先验概率比值的对数为j b 对i a 的互信息量, 也称交互信息量(简称互信息).用);(j i b a I 来表示.1.6信源熵:信源各个离散消息的自信息量的数学期望(即概率加权的统计 平均值)为信源的平均自信息量,一般称为信源的信息熵,也叫信源熵或香农熵,记为)(X H .1.7条件熵:在联合符号集合XY 上的条件自信息量的数学期望.可以用)/(Y X H 表示.1.8联合熵:也叫共熵,是联和离散符号XY 上的每的元素j i b a 的联合自信息量的数学期望,用)(XY H 表示.2.基本公式2.1 自信息量:)(log )(2i i a p a I -=2.2 联合的自信息量:)(log )(2j i j i b a p b a I -= 当X 和Y 相互独立时,)()()(j i j i b p a p b a p =;则有:)()()(log )(log )()(log )(log )(2222j i j i j i j i j i b I a I b p a p b p a p b a p b a I +=--=-=-=2.3条件自信息量:)/(log )/(2j i j i b a p b a I -= 或 )/(log )/(2i j i j a b p a b I -= 2.4互信息量:)()/(log );(2i j i j i a p b a p b a I = ),,2,1;,,2,1(m j n i ==2.5信源熵:)(log )(])(1[log )]([)(212i ni i i i a p a p a p E a I E X H ∑=-=== 2.6条件熵:ⅰ:在已知随机变量Y 的条件下,随机变量X 的条件熵)/(Y X H 为:)/()()]/([)/(11j i mj ni j i j i b a I b a p b a I E Y X H ∑∑====)/(log )(211j i m j ni j i b a p b a p ∑∑==-=.ⅱ:在已知随机变量X 的条件下,随机变量Y 的条件熵)/(X Y H 为:)/()()]/([)/(11i j mj ni j i i j a b I b a p a b I E X Y H ∑∑====)/(log )(211i j m j ni j i a b p b a p ∑∑==-=.2.7联合熵:)(log )()()()(21111j i m j ni j i j i n i m j j i b a p b a p b a I b a p XY H ∑∑∑∑====-==.2.8有关概率的基本公式:1)(1=∑=n i i a p ,1)(1=∑=m j j b p ,1)/(1=∑=ni j i b a p ,1)/(1=∑=mj i ja bp ,1)(11=∑∑==m j ji n i b a p ,)()(1j n i j i b p b a p =∑=,)()(1imj j i a p b a p =∑=,)/()()/()()(j i j i j i j i b a p b p a b p a p b a p ==.3.各种熵之间的关系 3.1无条件熵3.1.2 )/();()/()(Y X H Y X I Y X H X H ≥+=. 证明:①)(log )()(21i ni i a p a p X H ∑=-=)/()/()(log )(211j i j i i m j ni j i b a p b a p a p b a p ∑∑==-=)/(log )()()/(log )(211211j i mj ni j i i j i mj ni j i b a p b a p a p b a p b a p ∑∑∑∑====-=)/();(Y X H Y X I +=.②)/(log )/()()/(2j i jij i j b a p b a p b p Y X H ∑∑-=])/(log )/([)(2∑∑-=ij i j i jj b a p b a p b p .由熵的极值性知:≤)/(Y X H ])(log )/([)(2∑∑-ii j i jj a p b a p b p∑∑-=ji j i j ia pb a p b p )(log )]/()([2)(X H =, 其中)()()/()(ijji jijja pb a p b a p b p ==∑∑.同理: )/();()/()(X Y H Y X I X Y H Y H ≥+=.3.1.2. )/()()(X Y H XY H X H -=.证明:)(log )()(2i ii a p a p X H ∑-=∑∑-=ji j j i j i j ia b p b a p b a p b p )/()(log )]/()([2)]/(log )([)(log )(22i j ijj i j i ijj i a b p b a p b a p b a p ∑∑∑∑---=)/()(X Y H XY H -=, 同理:)/()()(Y X H XY H Y H -=.3.2条件熵 );()()()()/(Y X I X H Y H XY H Y X H -=-=. 3.2.1 )()()/(Y H XY H Y X H -=. 证明:)/(Y X H )/(log)(211j i n i mj ji b a p b a p ∑∑==-=+-=∑∑==)(log )(211j i ni m j j i b a p b a p )(log])([211j m j ni ji b p b a p ∑∑==)(log )()(log )(21211j mj j j i ni mj j i b p b p b a p b a p ∑∑∑===+-=)()(Y H XY H -=, 其中:)()(1j ni j i b p b a p =∑=.3.2.2 );()()/(Y X I X H Y X H -= .证明:)/(log )()/(211j i ni mj j i b a p b a p Y X H ∑∑==-=)()()(log )(211i j i i n i mj j i a p b a p a p b a p ∑∑==-=)()/(log )()(log ])([211211i j i mj j i ni i ni mj j i a p b a p b a p a p b a p ∑∑∑∑====--=);()(Y X I X H -=, 其中:)()(1imj ji a p b a p =∑=.同理:);()()()()/(Y X I Y H X H XY H X Y H -=-=. 3.3联合熵 )()(YX H XY H =)/()()/()()(Y X H Y H X Y H X H XY H +=+=);()()(Y X I Y H X H -+= );()/()/(Y X I X Y H Y X H ++=.3.3.1)/()()/()()(Y X H Y H X Y H X H XY H +=+= . 证明:)(log )()(211j i ni mj j i b a p b a p XY H ∑∑==-=)/()(log )(211i j i n i mj j i a b p a p b a p ∑∑==-=)/()()(log ])([11211i j n i mj j i i ni mj j i a b p b a p a p b a p ∑∑∑∑====--=)/()(X Y H X H +=, 其中:)()(1i mj j i a p b a p =∑=.同理: )/()()(Y X H Y H XY H +=. 3.3.2 );()()()(Y X I Y H X H XY H -+= . 证明:)/()(log )()(211i j i ni mj j i a b p a p b a p XY H ∑∑==-=)()/()()(log )(211j i j j i n i mj j i b p a b p b p a p b a p ∑∑==-=)(log ])([)(log ])([211211jb p b a p a p b a p mj ni j i i ni mj j i ∑∑∑∑====--=)()/(log )(211j i j n i mj j i b p a b p b a p ∑∑==-);()()(Y X I Y H X H -+=.3.3.3 );()/()/()(Y X I X Y H Y X H XY H ++=. 证明:)/()(log )()(211i j i ni mj j i a b p a p b a p XY H ∑∑==-=)/()()/()/(log )(211j i i i j j i n i mj j i b a p a p a b p b a p b a p ∑∑==-=)/(log )(211j i ni mj j i b a p b a p ∑∑==-=)/(log )(211i j ni mj j i a b p b a p ∑∑==-)()/(log )(211i j i n i mj j i a p b a p b a p ∑∑==+);()/()/(Y X I X Y H Y X H ++= 3.4交互熵 );();(X Y I Y X I =)/()()/()();(X Y H Y H Y X H X H Y X I -=-=)()()()/()/()(XY H Y H X H X Y H Y X H XY H -+=--= . 3.4.1 )/()()/()();(X Y H Y H Y X H X H Y X I -=-= 证明:=);(Y X I )()/(log )(211i j i n i mj j i a p b a p b a p ∑∑==∑∑∑∑====+-=ni mj j i j i i ni mj j i b a p b a p a p b a p 112211)/(log )()(log ])([)/()(Y X H X H -=, 其中:)()(1i mj j i a p b a p =∑=.同理:)/()();(X Y H Y H Y X I -=. 3.4.2证明: )()/(log )();(211i j i ni mj j i a p b a p b a p Y X I ∑∑===)(1)/()/(log )(211j i i j j i n i mj j i b a p a b p b a p b a p ∑∑===)(log )(211j i ni mj j i b a p b a p ∑∑==-=)/(log )(211j i ni mj j i b a p b a p ∑∑==+)/(log )(211i j ni mj j i a b p b a p ∑∑==+)/()/()(X Y H Y X H XY H --=.3.4.3证明:)()/(log )();(211i j i n i mj j i a p b a p b a p Y X I ∑∑===)()()(log )(211j i j i n i mj j i b p a p b a p b a p ∑∑===)(log ])([211i ni mj j i a p b a p ∑∑==-=)(log ])([211j mj ni j i b p b a p ∑∑==-)(log )(211j i ni mj j i b a p b a p ∑∑==+)()()(XY H Y H X H -+=.其中:)()(1i m j j i a p b a p =∑=,)()(1j ni j i b p b a p =∑=.参考文献[1]傅祖芸,赵建中.信息论与编码.电子工业出版社,2006,4. [2]邓稼先,康耀红.信息论与编码.西安电子科技大学出版社,2007,5. [3]陈运.信息论与编码.电子工业出版社,2007,12.[4]贾世楼.信息论理论基础. 哈尔滨工业大学出版社,2002,6.。