NMF

nmf的名词解释

nmf的名词解释引言在当今信息爆炸的时代,我们对于各种新概念和技术的了解变得非常重要。

本文将重点解释NMF,即非负矩阵分解(Non-Negative Matrix Factorization)的含义和应用。

希望通过深入探讨这一概念,能够让读者对于该技术有一个全面而清晰的认识。

一、什么是NMF?非负矩阵分解是一种在数据挖掘和机器学习领域常用的技术。

它可以将一个非负矩阵分解为两个非负矩阵的乘积。

换句话说,给定一个非负矩阵V,NMF的目标是找到两个非负矩阵W和H,使得它们的乘积W*H近似等于V。

其中,W被视为一组基向量,H则表示基向量在该矩阵上的线性组合。

二、NMF的原理和优势NMF的原理基于独立成分分析(Independent Component Analysis)和低秩分解(Low-Rank Decomposition)。

通过将非负矩阵分解为低秩的非负部分和非负权重系数,我们能够更好地理解数据中的隐藏模式和因素。

NMF的优势在于它能够提取出数据的局部特征,而不受全局线性关系的限制。

这意味着NMF可以捕捉到一些难以用其他方法表示的非线性关系,从而更好地挖掘数据的内在结构。

三、NMF的应用领域1. 文本挖掘在文本挖掘中,NMF可以帮助我们从大量的文本数据中提取主题信息。

通过将文档-词频矩阵进行NMF分解,我们可以发现文本集合中隐藏的主题结构,并识别关键词,从而实现文本分类和聚类等任务。

2. 图像处理NMF在图像处理领域也有广泛的应用。

它可以帮助我们提取图像的基础元素,如边缘、纹理等。

通过NMF分解得到的基向量,我们可以进行图像重构、图像压缩和图像分割等任务,从而改善图像处理的效果和质量。

3. 音频处理在音频处理方面,NMF可以用来分离复杂的音频信号。

通过将混合的音频信号矩阵进行NMF分解,我们可以恢复出原始信号的成分,从而实现音频去噪、音频源分离等任务。

4. 社交网络分析由于社交网络的庞大和复杂性,NMF可以帮助我们从海量的社交网络数据中发现用户群体和社区结构。

nmf验证方法

nmf验证方法全文共四篇示例,供读者参考第一篇示例:nmf验证方法是研究非负矩阵因子分解的一种重要方法。

nmf是一种矩阵分解技朧,用于解决大型数据矩阵中的模式和结构,它将一个非负矩阵分解为两个或多个非负的因子矩阵。

nmf在图像处理、文档分类、生物信息学等领域有广泛的应用。

nmf验证方法是指对nmf算法的结果进行验证,评估其有效性和稳定性的一种方法。

在实际应用中,nmf算法往往会受到数据噪音、初始值选取、参数设置等因素的影响,导致分解结果不稳定或不准确。

为了保证nmf算法的可靠性,需要对其进行充分的验证和评估。

nmf验证方法包括内部验证和外部验证。

内部验证是指利用原始数据矩阵本身来评估nmf算法的结果,常用的方法包括重构误差、稀疏性评估、聚类性能评估等。

重构误差是指原始数据矩阵与重构矩阵之间的差异度,通过计算重构误差可以评估nmf算法的精度。

稀疏性评估是指因子矩阵是否具有稀疏性,稀疏性较好的因子矩阵通常能更好地反映数据的结构。

聚类性能评估是指利用因子矩阵进行聚类分析,评估nmf算法在聚类任务上的表现。

外部验证是指利用已知的标签信息对nmf算法的结果进行评估,常用的方法包括准确率、召回率、F值等。

准确率是指分类器正确分类的样本数占总样本数的比例,召回率是指真实正例被分类器正确找到的比例,F值是准确率和召回率的加权调和平均。

通过比较nmf算法的外部验证指标,可以评估其在真实任务中的性能。

除了内部验证和外部验证,还可以采用交叉验证、指标选择等方法来评估nmf算法的稳定性和泛化能力。

交叉验证是指将数据划分为训练集和测试集,多次验证算法的效果,以减少因数据集划分不同而导致的误差。

指标选择是指挑选适合特定任务的评估指标,如对于文档分类任务可选用准确率等指标。

nmf验证方法是评估nmf算法有效性和稳定性的重要手段,通过内部验证、外部验证、交叉验证和指标选择等方法,可以全面评估nmf算法在不同任务中的表现,从而提高其实际应用的可靠性和有效性。

数据降维-NMF非负矩阵分解

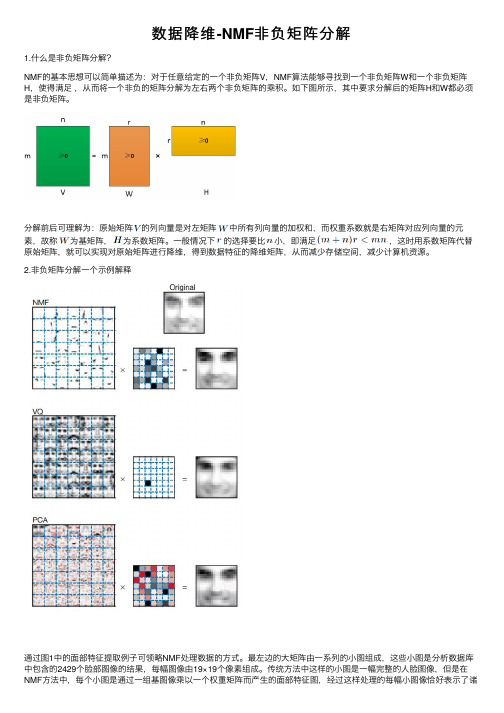

数据降维-NMF⾮负矩阵分解1.什么是⾮负矩阵分解?NMF的基本思想可以简单描述为:对于任意给定的⼀个⾮负矩阵V,NMF算法能够寻找到⼀个⾮负矩阵W和⼀个⾮负矩阵H,使得满⾜,从⽽将⼀个⾮负的矩阵分解为左右两个⾮负矩阵的乘积。

如下图所⽰,其中要求分解后的矩阵H和W都必须是⾮负矩阵。

分解前后可理解为:原始矩阵的列向量是对左矩阵中所有列向量的加权和,⽽权重系数就是右矩阵对应列向量的元素,故称为基矩阵,为系数矩阵。

⼀般情况下的选择要⽐⼩,即满⾜,这时⽤系数矩阵代替原始矩阵,就可以实现对原始矩阵进⾏降维,得到数据特征的降维矩阵,从⽽减少存储空间,减少计算机资源。

2.⾮负矩阵分解⼀个⽰例解释通过图1中的⾯部特征提取例⼦可领略NMF处理数据的⽅式。

最左边的⼤矩阵由⼀系列的⼩图组成,这些⼩图是分析数据库中包含的2429个脸部图像的结果,每幅图像由19×19个像素组成。

传统⽅法中这样的⼩图是⼀幅完整的⼈脸图像,但是在NMF⽅法中,每个⼩图是通过⼀组基图像乘以⼀个权重矩阵⽽产⽣的⾯部特征图,经过这样处理的每幅⼩图像恰好表⽰了诸如“⿐⼦”、“嘴巴”、“眼睛”等⼈脸局部概念特征,这便⼤⼤压缩了存放的图像数据量。

左边的⼤矩阵由每幅⼩图像的19列⼀起组成矩阵的⼀列,那样它就是19×19=361⾏,2429列。

这个例⼦中,NMF⽅法⽤基图像来代表眼、眉⽑、⿐⼦、嘴、⽿朵、胡⼦等,它们⼀起组成了数据库中的脸。

这样给⼈最先的直觉就是它很好地压缩了数据。

事实上Lee和Seung在他们的论⽂中更深⼊地指出,与⼈类识别事物的过程相似,NMF也是⼀种优化的机制,近似于我们的脑分析和存储⼈脸数据的过程。

这个例⼦中,原图像表⽰这些局部特征的加权组合,这与⼈类思维中“局部构成整体”的概念是相吻合的。

因此,NMF算法似乎体现了⼀种智能⾏为。

3.⾮负矩阵分解NMF的应⽤(1)图像分析 NMF最成功的⼀类应⽤是在图像的分析和处理领域(2)⽂本聚类,数据挖掘(3)语⾳处理(4)机器⼈控制(5)⽣物医药⼯程和化学⼯程。

nmf聚类对上皮细胞亚簇划分亚群

nmf聚类对上皮细胞亚簇划分亚群

非负矩阵分解(NMF)聚类是一种有效的降维和聚类方法,可以应用于单细胞数据集的分析。

在上皮细胞亚簇的划分亚群研究中,NMF聚类可以帮助我们更好地理解细胞之间的相

似性和差异。

具体操作步骤如下:

1. 数据预处理:首先,对原始单细胞表达量矩阵进行归一化和筛选,以消除实验偏差和噪声。

然后,可以选择对数据进行归一化处理,如log转换、归一化等。

2. 降维:使用PCA、t-SNE或UMAP等方法将归一化后的数据进行降维,以可视化单细胞之间的相似性。

3. NMF聚类:将降维后的数据矩阵分解为两个非负矩阵(基矩阵和权重矩阵),基矩

阵表示细胞亚群的特征,权重矩阵表示细胞亚群之间的相似性。

可以通过选择合适的聚类数目的方法(如谱聚类、K-means等)对基矩阵进行聚类,从而得到细胞亚群。

4. 分析亚群特征:对每个聚类亚群进行生物学特征分析,如细胞标志物、基因表达模式等。

这有助于揭示上皮细胞亚簇在不同亚群中的功能和相互作用。

5. 划分亚群:根据分析结果,对上皮细胞亚簇进行进一步的划分。

例如,可以根据免疫细胞、基质细胞、上皮细胞等不同的细胞类型对亚群进行细分。

6. 验证和优化:通过外部数据集、细胞功能实验等方法验证所划分的亚群是否具有生物学意义。

此外,可以通过调整聚类参数或使用其他聚类方法进一步优化亚群划分。

需要注意的是,在实际应用中,由于单细胞数据的复杂性和不确定性,获得的细胞亚群可能存在一定的重叠和模糊边界。

因此,在划分亚群时,应充分考虑生物学背景和实验条件,以获得更准确的结果。

韩国nmf面膜使用方法

韩国nmf面膜使用方法韩国的NMF面膜是一种非常受欢迎的面膜产品,它以其滋润、保湿和修复肌肤的功效而闻名。

下面是关于韩国NMF面膜的使用方法的详细介绍。

首先,为了确保面膜的效果最大化,你需要做好肌肤的准备工作。

首先,要彻底清洁你的脸部皮肤,去除任何化妆品残留物和污垢。

你可以使用洁面乳或卸妆水进行清洁。

然后,用温水彻底清洗脸部,确保皮肤干净和开放的毛孔。

接下来,你可以开始使用NMF面膜了。

首先,从包装中取出面膜片。

确保双手和面膜处于清洁状态,你可以使用面膜工具或在洗手后直接使用手指。

确保你的手指干净,并避免触摸面膜的内部。

然后,开始打开面膜。

大多数韩国NMF面膜都是单独包装的,所以你只需要轻轻拆开包装就可以了。

一旦打开面膜,你会发现它们通常折叠在一起,并在面膜片上涂有精华液。

当你准备好使用面膜时,将面膜逐渐展开并将其轻轻敷在你的脸上。

确保面膜均匀地贴合在你的脸上,确保它们覆盖到整个脸部肌肤,包括额头、鼻子、嘴巴和下巴。

你可以用指尖轻轻按压面膜,使其更好地贴合皮肤。

接下来,你可以让面膜在你的脸上停留一段时间。

大多数韩国NMF面膜的使用时间为15到20分钟,但具体的使用时间可以根据产品包装上的说明来确定。

在面膜放在脸上时,你可以放松身体,听音乐或进行其他放松的活动,以帮助面膜更好地渗透和滋润肌肤。

一旦时间到了,你可以轻轻将面膜从脸上取下。

当你撕下面膜时,注意要避免直接用力撕拉,以免对皮肤造成刺激。

相反,你可以从下巴或脖子开始撕下面膜,慢慢向上轻轻撕离脸部。

记住,面膜的目的是为了滋润皮肤,所以你可以使用手指将面膜上的余液轻轻按摩到皮肤中,以帮助其更好地吸收。

最后,不要忘记在使用完NMF面膜后进行日常的护肤步骤。

这包括使用爽肤水、精华液和乳液等产品来进一步滋润和保护肌肤。

另外,使用面膜的频率也需要根据自己的肤质和需求来确定,一般建议每周使用一到两次。

韩国的NMF面膜因其保湿和滋润功效而备受瞩目。

通过正确地使用这些面膜,可以使你的皮肤更加柔软、滋润和光滑。

单细胞nmf识别元程序

单细胞nmf识别元程序

单细胞NMF(Non-negative Matrix Factorization)是一种常用

于识别单细胞数据中元程序的方法。

元程序是一组高度相关的基因表达模式,常常表示细胞功能或状态的特征。

使用单细胞NMF识别元程序的步骤如下:

1. 数据预处理:对单细胞基因表达数据进行预处理,包括数据归一化、去除批次效应、标准化等处理,以确保数据质量和一致性。

2. 构建基因表达矩阵:将预处理后的单细胞基因表达数据转化为基因表达矩阵,其中每一行表示一个基因,每一列表示一个细胞。

3. 应用NMF模型:将基因表达矩阵输入NMF模型进行分解。

NMF模型将基因表达矩阵近似分解为两个非负矩阵,一个表

示元程序和细胞的关系,另一个表示元程序的基因表达模式。

4. 元程序聚类:根据NMF生成的元程序矩阵,使用聚类算法

对元程序进行聚类,将相似的元程序分在同一簇。

常用的聚类算法包括K-means、层次聚类等。

5. 元程序注释和分析:对每个聚类簇进行元程序的注释和功能分析,可以通过富集分析、GO分析、KEGG分析等方法,找

到与每个元程序关联的功能,深入了解细胞状态或功能。

总之,使用单细胞NMF可以高效地识别单细胞数据中的元程序,帮助揭示细胞功能和状态的差异,对了解生物学或疾病过程具有重要意义。

数据挖掘中的特征降维技术

数据挖掘中的特征降维技术在当今信息爆炸的时代,我们面对的数据量越来越庞大,这给数据分析带来了巨大的挑战。

特征降维技术作为数据挖掘中的重要工具,可以帮助我们从大量的特征中提取出最有价值的信息,简化数据分析的过程。

本文将介绍数据挖掘中常用的特征降维技术,并探讨其应用和优势。

一、主成分分析(PCA)主成分分析(Principal Component Analysis,简称PCA)是一种常用的特征降维技术。

它通过线性变换将原始数据映射到一个新的坐标系中,使得新坐标系下的数据具有最大的方差。

这样做的目的是减少数据的维度,同时保留最重要的信息。

PCA的优势在于可以减少数据的冗余信息,降低数据维度,提高数据分析的效率。

例如,在图像处理中,使用PCA可以将高维的图像数据降维到二维或三维,从而更方便地进行图像识别和分类。

此外,PCA还可以用于数据可视化,通过将高维数据降维到二维或三维,我们可以更直观地观察数据的分布情况,发现其中的规律和趋势。

二、线性判别分析(LDA)线性判别分析(Linear Discriminant Analysis,简称LDA)是一种常用的特征降维技术,主要用于分类问题。

与PCA不同的是,LDA不仅考虑了数据的方差,还考虑了数据的类别信息。

其目标是在降低数据维度的同时,最大化不同类别之间的差异,使得数据在新的低维空间中更容易被分类器分开。

LDA的优势在于可以提高分类的准确性。

通过将高维数据降维到低维空间,LDA可以减少类别重叠的情况,提高分类器的性能。

例如,在人脸识别中,使用LDA可以将高维的人脸图像降维到低维空间,从而更容易识别和区分不同的人脸。

三、非负矩阵分解(NMF)非负矩阵分解(Non-negative Matrix Factorization,简称NMF)是一种特征降维技术,主要用于非负数据的分析。

与PCA和LDA不同的是,NMF将原始数据分解为非负的基向量和系数矩阵,从而实现特征的降维。

常见的特征描述子及其原理

常见的特征描述子及其原理特征描述子是计算机视觉中用于描述图像中特征的算法。

它们通过对图像中的特征进行数学表示,将复杂的图像信息转化为一组具有独特性质的特征向量。

这些描述子可以帮助我们识别和匹配图像中的对象、检测变化或运动等。

以下是几种常见的特征描述子及其原理:1.尺度不变特征变换(SIFT)描述子:SIFT是一种在计算机视觉领域非常著名的特征描述子。

它通过检测图像中的极值点和关键点,然后使用高斯金字塔来对图像进行尺度空间的变换,最后根据图像局部梯度方向来计算描述子。

SIFT描述子具有尺度不变性、旋转不变性和光照不变性等特性,适用于目标识别、图像匹配和物体跟踪等应用。

2.加速稳健特征(ORB)描述子:ORB是一种结合了FAST特征检测器和BRIEF特征描述子的算法。

它通过检测图像中的角点来确定关键点,然后根据这些关键点的灰度信息计算描述子。

ORB描述子具有高速性能和良好的鲁棒性,适用于实时目标追踪、三维重建和SLAM(同时定位与地图构建)等应用。

3.方向梯度直方图(HOG)描述子:HOG是一种用于图像检测的特征描述子。

它通过计算图像中局部区域的梯度方向直方图来描述图像特征。

HOG描述子在人体检测、行人识别和行为分析等领域具有广泛应用。

4.高级二进制特征(ABD)描述子:ABD是一种基于局部二进制模式(Local Binary Patterns, LBP)的特征描述子。

它通过计算图像中每个像素与其周围像素的灰度差异,得到二进制编码,然后将编码的直方图作为图像的特征向量。

ABD描述子适用于人脸识别、纹理分类和图像检索等任务。

5.非负矩阵分解(NMF)描述子:NMF是一种基于矩阵分解的特征提取方法。

它通过将图像表示为非负矩阵的乘积形式,将图像特征分解到低维空间中。

NMF描述子可用于图像聚类、图像压缩和图像检索等任务。

综上所述,特征描述子在计算机视觉中发挥着重要作用。

不同的特征描述子适用于不同的应用场景,选择合适的描述子能够提高图像处理的效果和性能。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

1

Introduction

Data representation is a fundamental problem in image processing and pattern recognition tasks. A good representation can typically reveal the latent structure of data, and further facilitate these tasks[1-3] . However, in real applications, the input data matrix is generally of very high dimension, which makes learning from example infeasible. To solve this problem, matrix factorization approaches are used to explore two or more lower dimensional matrices whose product provides a good approximation for the original data matrix. For example, singular value decomposition (SVD) and principal component analysis (PCA) decompose the original matrix as the linear combination of principle components. In recent years, non-negative matrix factorization (NMF)[4] has become popular for data representation owning to its theoretical interpretation and practical performance. Several studies[5-6] have shown that there is psychological and physiological evidence for partsbased representation in human brain. While NMF with non-negative constraints could obtain a parts-based representation since there are only additive, not sub-

752

J. Comput. Sci. & Technol., Sept. 2013, Vol.28, No.5

GNMF[13] was suggested by incorporating label information into graph structure. Nevertheless, there was no theoretical guarantee that the same class data points would be projected together into the parts-based representation space, and it was still unknown that how to determine the weights in a principled manner. To overcome this limitation, Liu et al. developed a constrained NMF method (CNMF)[13] , which imposes the label information to the objective function as hard constraints. Mathematically, given the label constraint matrix A, CNMF is to find two non-negative matrix factors W and S where the product of the factors W , A and S is an approximation of the original matrix X (i.e., X = W (AS )T ). However, since CNMF mapps the images with the same label onto the same point, it is infeasible when there is only one labeled training example to rely on. That is to say, if there is only one labeled sample, the label matrix A will become an identity matrix and the label constraint will fail to work. In some real-world applications, there are a lot of unlabeled data (such as web pages on the Internet), but there is only one labeled example (such as the current interesting web page). Additionally, since the new representation based on NMF is an additive combination of a set of basis vectors (i.e., parts), the aforementioned NMF approaches fail to consider the correlation between the basis vectors and class labels. To overcome the above problems, we propose a semisupervised class-driven NMF method for image representation, named cdNMF. Inspired by [14], we associate a class label with each basis vector by introducing an inhomogeneous representation cost constraint. This constraint leads to learn a set of discriminative basis vectors which are enforced to represent better for their own classes but worse for the others. By minimizing the inhomogeneous representation cost, we can learn the basis even with one labeled example. Thus, data samples belonging to the same class will have similar representations, and the obtained new representations can have more discriminative power. In addition, with non-negative constraints, we can evaluate the inhomogeneous representation cost straightforwardly, which is more simple and faster than using L2 -norm in [14]. Furthermore, we utilize both Frobenius norm and KLdivergence to measure the reconstruction cost with the corresponding update rules. 2 Brief Review of NMF

tractive, combinations. Specifically, it models data as a linear combination of a set of basis vectors, and both the combination coefficients and the basis vectors are non-negative. For example, a face image can be represented by an additive combination of several versions of mouth, nose, eyes, and other facial parts. In addition, NMF has shown performance superior to PCA and SVD in face recognition[7] and document clustering[8] . Several NMF variants have been developed by integrating additional constraints into the original NMF. Xu and Gong[9] presented a concept factorization (CF) approach which expands NMF to the data containing negative values and can be implemented in the kernel space. To consider the geometric structure in the data, Cai et al.[10] presented a graph regularized NMF (GNMF) method. GNMF leads to a new partsbased data representation which respects the geometrical structure of the data space. However, the above NMF approaches ignore the discriminative label information as an unsupervised learning algorithm. In many real world applications, such as text categorization[11] and data clustering[12] , a small amount of labeled data could be used to aid and bias the learning of unlabeled data. Thus, semi-supervised