第四章 信源编码 习题解答

信息论与编码第四章习题参考答案

4.1某离散无记忆信源概率空间为分别使用长度为10和100的序列进行等长无失真编码,分别计算最短平均码长和编码效率。

解:信源的熵为881.03.03.07.07.0)(H =--=lb lb X 比特/符号当N=10时,序列码长应当满足 81.81881.0102)(L 1=⨯=>lb X NH 比特/序列考虑到序列码长应该为整数,取L1=9比特/符号,平均每个符号的码长为9.0NL L 11==比特/符号 所以编码效率为%9.97L )(H 11==X η 当N=100时,序列码长为1.881881.01002)(L 1=⨯=>lb X NH 比特/100符号取L1=89比特/符号,平均每个符号的码长为89.0NL L 22==比特/符号 编码效率为%99L )(H 22==X η 4.2设离散无记忆信源为如果要求编码效率为,允许错误概率为,求编码序列的长度。

解:信源的熵为722.02.02.08.08.0)(H =--=lb lb X 比特/符号自信息量方差为64.0722.0-)2.0(2.0)8.0(8.0D 222=+=lb lb采用二进制码进行等长编码,序列长度应当满足72221062.1)1)((D N ⨯=-≥δηηX H4.3设离散无记忆信源的概率空间为要求编码效率为(1) 如果采用序列等长编码,而允许译码错误概率为,求编码序列的长度。

(2) 如果采用序列变长编码,求编码序列的长度,并且与(1)比较,说明为什么会有这样的结果。

解1)信源的熵为811.025.025.075.075.0)(H =--=lb lb X 比特/符号自信息量方差为471.0811.0-)25.0(25.0)75.0(75.0D 222=+=lb lb采用二进制编码,序列长度为62221029.1)1)((D N ⨯=-≥δηηX H2)对信源进行二次扩展,并采用下列编码方式构成唯一可译码平均码长为6875.13161316321631169L =⨯+⨯+⨯+⨯=比特/2符号 每个符号码长为84375.026875.12L L ===比特/符号 编码效率为%95%1.9684375.0811.0L H(X)=>===δη 由于变长编码能够更好利用不同序列的概率分布进行编码,概率越大,序列的码长越短,概率越小,序列的码长越长,所以相对等长编码而言,变长编码的平均码长很短。

信息论、编码与密码学课后习题答案

第1章 信源编码

1.1考虑一个信源概率为{0.30,0.25,0.20,0.15,0.10}的DMS。求信源熵H(X)。

解: 信源熵

H(X)=-[0.30*(-1.737)+0.25*(-2)+0.2*(-2.322)+0.15*(-2.737)+0.1*(-3.322)]

10100+11110=01010 10100+00111=10011

10100+01101=11001

11110+00111=11001 11110+01101=10011

00111+01101=01010

满足第一条性质

2、全零码字总是一个码字

{00000,01010,10011,11001,10100,11110,00111,01101}

(1)给出此信源的霍夫曼码并确定编码效率。

(2)每次考虑两个符号时,给出此信源的霍夫曼码并确定编码效率。

(3)每次考虑三个符号时,给出此信பைடு நூலகம்的霍夫曼码并确定编码效率。

解:

(1)本题的霍夫曼编码如下图所示:

图1.11 霍夫曼编码

则霍夫曼码如下表:

符号

概率

码字

x1

0.5

1

x2

0.4

00

x3

0.1

01

该信源的熵为:

(2)全零字总是一个码字,

(3)两个码字之间的最小距离等于任何非零码字的最小重量,即

设 ,即 , , , ,

首先证明条件(1):

, , , , , ,

很明显,条件(1)是满足的。条件(2)也是显然成立的。

清华《信源编码》第四章

b 1 4e b e 2b

要使D最小, 令 e-b=0.293, D=0.657,则 =R(D)=60.6%, 比分别量化有所提高. 三维四维联合量化尚可进一步提高.

30

进一步提高压缩比的探讨(7)

K维情况,Zador得下列结果:

Lim n 2 / k G ห้องสมุดไป่ตู้ [ p( x ) k ,

21

语声的脉码调制(6)

A=87.65, y’(0)=16, =20log1016=24 db, 可压缩4比特,仍能满足小信号信扰比。 y’(1)=0.183, =-15db, 大信号时量化 噪声仍可满足。 实际用13线段来近似,均匀量化后用数 字逻辑电路实现

22

语声的脉码调制(7)

1

y

信号功率 W=2/2, 量化噪声 L 2 n L2 L Wq pi L p( x)dx 3n 2 (1 e ) 12 i 1 12

18

语声的脉码调制(3)

过载噪声

2 Wo 2 ( x L ) p( x )dx 2 L

2 L L 2 2 ( } n n

26

进一步提高压缩比的探讨(3)

要后处理,也可不用先达到最小平均失真, p(y)=p(-y)=z/2, H(Y)=z+H(z) =-log(1-2z+2z)/[z+H(z)] 取导置零,可得z=0.41, =69%. 对于独立序列,后处理虽能提高编码效率, 但效果不明显,如何能快速逼近R(D)也不 知. 对于相关信源,后处理以消除相关性, 可取得很大压缩比,以后讨论.

13

2

最佳标量量化(7)

绝对失真

( 2i 1) L dx L D |x | n L 4n 4 i 1 ( i 1) L

信息论第四章习题解答

四 解 (1) 要能纠一位错,监督位数 r 必须满足 2r ? n ? 1,

章

由 n = 6 ? r 可求得满足该条件的最小的 r 为 r = 4 .

抗

故需构造 (10, 6 ) 码。

干

(2) 可以构造出多种 (10, 6 ) 码,下面仅给出其中的一种。

扰

111100 1000

二 元

监督阵 [H ] =

二

元 编

当

d

为偶数时,可以纠正

??? d

2

2 ?? 位错误, ?

码

且发现 ?? d - 2 ?? ? 1 位错误。

?2?

4

习题解答

第 4.4 试计算 ( 8, 7 ) 奇偶校验码的漏检概率和编码效率,

四

已知码元的错误概率为 Pe = 10- 4 .

章 解 (1) 奇偶校验码不能发现偶数位错误,其漏检概率为:

码

(5) 系统码和非系统码 (略)。

(P 175)

19

习题解答

第 4.13 已知 (7, 4) 循环码的生成多项式为 g( x) = x3 ? x2 ? 1,

四

当收到一循环码字为 0010011 时,根据校验子判断有

章

无错误?哪一位错了?

抗 解 (1) 求校验子 干 扰 二 元 编 码

c0 位错 c1 位错 c2 位错 c3 位错 c4 位错 c5 位错 c6 位错

00000,11101,11110,11000,10100。

编

码

2

习题解答

第 4.2 求 000000、110110、011101、101010 四码字的汉明距离,

四

并据此拟出校正错误用的译码表。

通信原理第四章(数字基带传输系统)习题及其答案

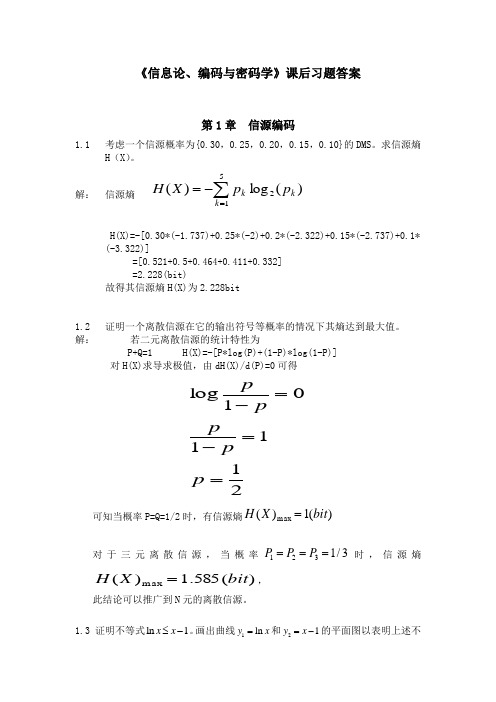

第四章(数字基带传输系统)习题及其答案【题4-1】设二进制符号序列为110010001110,试以矩形脉冲为例,分别画出相应的单极性码型,双极性码波形,单极性归零码波形,双极性归零码波形,二进制差分码波形。

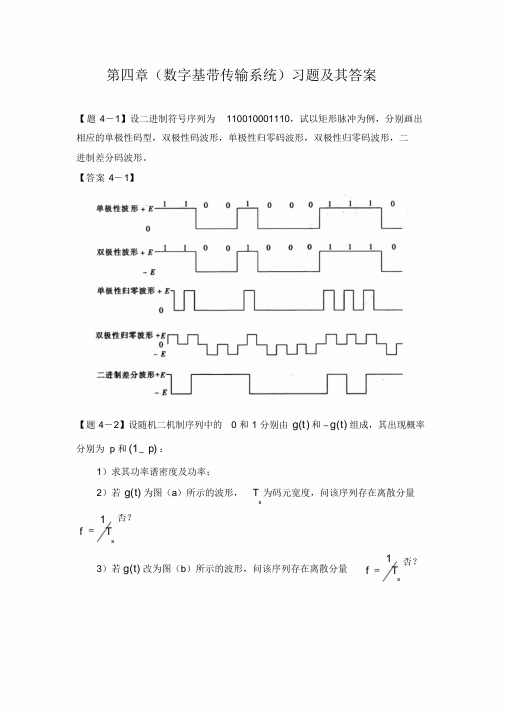

【答案4-1】【题4-2】设随机二机制序列中的0和1分别由g(t)和g(t)组成,其出现概率分别为p和(1p):1)求其功率谱密度及功率;2)若g(t)为图(a)所示的波形,T为码元宽度,问该序列存在离散分量s1f Ts否?3)若g(t)改为图(b)所示的波形,问该序列存在离散分量1f Ts否?【答案4-2】1)随机二进制序列的双边功率谱密度为2 2P ( ) f P(1 P) G ( f ) G ( f ) f [PG (mf ) (1 P)G (mf )] ( f mf ) s s 1 2 s 1 s 2 s sm由于g1(t) g2 (t) g(t )可得:22 2 2P ( ) 4 f P(1 P)G ( f ) f (1 2P) G(mf ) ( f mf )s s s s sm式中:G( f )是g(t )的频谱函数。

在功率谱密度P() 中,第一部分是其连续谱成s分,第二部分是其离散谱成分。

随机二进制序列的功率为1S P ( )ds2--22[4 f P(1 P)G ( f ) f (1 2P)G (mf ) ( f mf )] dfs s s sm224 f P(1 P) G ( f )df f (1 2P)G( mf ) ( f mf )dfs s s s--m2 2 24 f P(1 P) G ( f )df f (1 2P) G( m f )s s s-m22)当基带脉冲波形g(t ) 为Ts1 tg(t) { 20 elset g(t )的付式变换G( f )为G( f ) T Sa( T f )s s因此sinG( f s ) T s Sa( T s f s) T s 0式中:fs1T 。

信息论与编码技术第四章课后习题答案

解:(1) D =

∑ P(u,υ )d (u,υ ) = (1 − p)q

UV

(2)根据题4.5,可知R(D)的最大值为H(p),此时q=0,平均失真D=0; (3)R(D)的最大值为0,此时q=1,平均失真D=(1-p); 4.7 设连续信源 X ,其概率密度分布为

p ( x) =

a − a | x| e 2

达到

D

min

的信道为

⎡1 ⎡1 0 ⎤ ⎡1 0 ⎤ ⎢ ⎥ ⎢ ⎥ ⎢1 [ P (υ j | u i )] = ⎢ ⎢ 0 1 ⎥ , ⎢1 0 ⎥ 或 ⎢ 2 ⎢ ⎣0 1 ⎥ ⎦ ⎢ ⎣0 1⎥ ⎦ ⎢0 ⎣

4.2 已知二元信源 ⎢

0⎤ 1⎥ ⎥ 2⎥ 1⎥ ⎦

1 ⎤ ⎡ X ⎤ ⎡ 0, ⎡0 1⎤ =⎢ =⎢ 以及失真矩阵 ⎡ dij ⎤ ⎥ ⎥ ⎥ ,试求: ⎣ ⎦ ⎣ p ( x ) ⎦ ⎣ p, 1 − p ⎦ ⎣1 0 ⎦

g (θ ) 的傅立叶变换

G s(w) = ∫

+∞ −∞

g

s

(θ )e

− jwθ

dθ =

s

2

s

2 2

+w

, (3)

得: Q( w) = P ( w) + w2 P( w), (4)

2

s

求式(4)的傅立叶反变换,又根据式(2)得

p( y ) = p( x = y) − D 所以 p( y ) =

2

p ( x = y), (5)

⎡0 ⎢1 定义为 D = ⎢ ⎢1 ⎢ ⎣1

解:

1 0 1 1

1 1 0 1

1⎤ 1⎥ ⎥ ,求 Dmax , Dmin 及信源的 R ( D ) 函数,并作出率失真函数曲线(取4到5个点)。 1⎥ ⎥ 0⎦

《信息论与编码》习题解答第四章(新)new

《信息论与编码》习题解答第四章 信息率失真函数-习题答案4.1解:依题意可知:失真矩阵:⎥⎦⎤⎢⎣⎡=0110d ,转移概率⎥⎦⎤⎢⎣⎡--=εεεε11)|(i j a b p 平均失真:εεεεε=⨯-⨯+⨯⨯+⨯⨯+⨯-⨯==∑∑==0)1(2/112/112/10)1(2/1),()|()(2121j i i j i j i b a d a b p a p D4.2解:依题意可知:失真矩阵:⎥⎦⎤⎢⎣⎡=0210d , 0min =D ,∑=⨯+⨯=⨯+⨯===ij i i j j y x d x p D D )102/122/1(2/112/102/1),()(min min max 舍去当0min =D ,bit X H R D R 12log )()0()(min ====因为没有失真,此时的转移概率为⎥⎦⎤⎢⎣⎡=1001P当2/1max =D ,0)(max =D R因为取的是第二列的max D 值,所以输出符号概率:,1)(,0)(21==b p b p ,,2221b a b a →→因此编码器的转移概率为⎥⎦⎤⎢⎣⎡=1010P 4.3解:0min =D0041041041041),(min )(43041141141141),()(min min min max =⨯+⨯+⨯+⨯===⨯+⨯+⨯+⨯===∑∑i j i j i i j i i j j y x d x p D y x d x p D D 当0min =D ,bit X H R D R 24log )()0()(min ==== 因为没有失真,此时的转移概率为⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=1000010000100001P 当4/3max =D ,0)(max =D R因为任何一列的max D 值均为3/4,所以取输出符号概率:0)(,0)(,0)(,1)(4321====b p b p b p b p ,即14131211,,,b a b a b a b a →→→→因此编码器的转移概率为⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=0001000100010001P 4.4解: 依题意可知:失真矩阵:⎥⎦⎤⎢⎣⎡=4/1014/110d , 0min =D∑=⨯+⨯===ij i i j j y x d x p D D )2/12(4/1)4/12/14/12/1min(),()(min min max 个均为其它当0min =D ,bit X H R D R 12log )()0()(min ====因为没有失真,此时的转移概率为⎥⎦⎤⎢⎣⎡=010001P 当4/1max =D ,0)(max =D R因为取的是第三列的max D 值为1/4,所以取输出符号概率:1)(,0)(,0)(321===b p b p b p ,即3231,b a b a →→因此编码器的转移概率为⎥⎦⎤⎢⎣⎡=100100P 4.5解:(1)依题意可知:失真矩阵:⎥⎦⎤⎢⎣⎡=0110d ,转移概率为:⎥⎦⎤⎢⎣⎡-=q q P 101 )1(0)1()1(1)1(1001),()|()(11p q q p q p p p y x d x y p x p D n i mj j i i j i -⨯=⨯-⨯-+⨯⨯-+⨯⨯+⨯⨯==∑∑==(2) 0min =D因为)(D R 是D 的递减函数,所以)1log()1(log )()()())(m ax (min min p p p p D H p H D R D R ----=-==当0=q 时可达到))(max(D R ,此时0=D(3) ∑-=⨯+⨯===iji i j j ,p p p p y x d x p D D )1(10),()(min min max 舍去更大另一个 因为)(D R 是D 的递减函数,所以0)()()())(m in(max max =-==D H p H D R D R当1=q 时可达到))(min(D R ,此时p D -=1(图略,见课堂展示)4.6解:依题意可知:失真矩阵:⎥⎦⎤⎢⎣⎡∞∞=1010d ,信源⎥⎦⎤⎢⎣⎡=⎥⎦⎤⎢⎣⎡2/12/110)(u p u 0min =D ,∑⨯+⨯⨯+∞⨯∞⨯+⨯===iji i j j y x d x p D D )12/112/1,02/12/1,2/102/1min(),()(min min max )(1]1,,m in[舍去另二个,∞=∞∞=10≤≤D因为二元等概信源率失真函数:⎪⎭⎫ ⎝⎛-=a D H n D R ln )( 其中1,2==a n ,所以率失真函数为:D D R -=1)(4.7解:失真矩阵为⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡=011101110d ,按照P81页方法求解。

第四章信源编码习题解答

第四章信源编码习题解答1种编码方法:1)哪些是非奇异码哪些是唯一可译码哪些是即时码2)分别计算每个唯一可译码的平均码长和编码效率。

解:1)A、B、C、D、E、F是非奇异码。

A、B、C、F是唯一可译码(E不满足克拉夫特不等式)。

A、C、F是即时码(B是续长码)。

3)编码A:平均码长:3AL=码元/消息信源熵:111111()lb lb4lb222441616H X=---⨯=比特/消息编码效率:max ()/2/366.7% lb21AH H X L Hη====码码编码B和C:平均码长:11111123456 2.1252416161616B CL L==+⨯+⨯+⨯+⨯+⨯=码元/消息编码效率:max ()/2/2.12594.1% lb21B CH H X L Hηη=====码码编码F:平均码长:111234 2.52416FL⎛⎫=⨯+⨯+⨯=⎪⎝⎭码元/消息编码效率:max ()/2/2.580%lb21F H H X L H η====码码2、离散无记忆信源X 的概率空间为:1234567()0.200.190.180.170.150.100.01X x x x x x x x p X ⎧⎫⎡⎤=⎨⎬⎢⎥⎩⎭⎣⎦ 1)对其进行费诺编码,并计算其编码效率;2)对其进行哈夫曼编码,并将其编码效率与费诺编码相比较。

解:1平均码长:()()()0.20.1720.190.180.1530.10.014 2.74L =+⨯+++⨯++⨯=码元/符号 信源熵:()0.20lb0.200.19lb0.190.18lb0.180.17lb0.170.15lb0.150.1lb0.10.01lb0.01 2.60/874H X =-------= 比特符号编码后平均码元熵:() 2.608740.95212.74H X H L===码比特/码元编码效率:max 0.952195.21%lb2H H η===码码2)哈夫曼编码: 码长码字 信源X (X )2 10 x 1 2 11 x 2 3000 x 33 001 x 43 010 x 54 0110 x 64 0111x 7平均码长:()()()0.20.1920.180.170.1530.10.014 2.72L =+⨯+++⨯++⨯=码元/符号 编码后平均码元熵:() 2.608740.95912.72H X H L===码比特/码元编码效率:max 0.959195.91%lb2H H η===码码与费诺编码相比,哈夫曼编码的编码效率要高于费诺编码。

信息论与编码第4章习题解答

《信息论与编码》第四章习题解答4.1 计算如下所示离散无记忆信道的容量: 习题4.1图[解] (a )信道概率转移矩阵为−−−−=δεδεεδδε11P , 信道是准对称信道,因此在输入为等概分布时达到信道容量,即5.0)1()0(====X P X P 时达到信道容量。

这时δ5.05.0)0(−==Y P δ==)1(Y Pδ5.05.0)2(−==Y P相应的信道容量为);1();0(Y X I Y X I C ====∑==2)()0|(log)0|(j j p j p j p 0111-ε1-δε δ 00 121-ε-δ εδδ 1-ε-δ1ε0 221 0.5 δ 110.250.25 0.50.50 2 21-ε ε ε 1-ε1ε 11-ε 0 0 223/41/4 111/3 1/31/3 1/43/40 2 311/3 211/31/3 1/31/31/3 1/3 1/31/3 (c)(a)(b) (e)(f)(d)δεεδδδδδεδε5.05.0log log 5.05.01log)1(−++−−−−−=)5.05.0log()1(log )1log()1(δδεεδεδε−−−+−−−−= (b )信道概率转移矩阵为=5.05.0025.025.05.0001P当5.0)2()0(====X P X P ,0)(=X P 时,5.0)0(==Y P ,25.0)1(==Y P ,25.0)2(==Y P1)()0|(log )0|();0(2===∑=j j p j p j p Y X I bit∑===2)()2|(log)2|();2(j j p j p j p Y X I 125.05.0log 5.025.05.0log 5.0=+= bit10);1(≤==Y X I ; 所以满足定理4.2.2条件,由达到信道容量充要条件可知,信道容量C =1 bit/次(c )信道转移概率矩阵为−−−=εεεεεε101001P ,信道是对称信道,当输入为均匀分布时,即31)2()1()0(======X P X P X P 时,达到信道容量。

信息论与编码第四章课后习题答案

−∫

1 − sin x d sin x 1 − sin x

因此有

h( X ) = −2 A log A −

A log e(2 ln 2 − 2 + 2 ln 2 − 2) 2Байду номын сангаас= −2 A log A + 2 A log e − 2 A log e ln 2 = −2 A log A + 2 A log e − 2 A 1 ,因此 2

试计算 h( X ) , h(Y ) , h( XY ) 和 I ( X ; Y ) 。 解: p( x) = ∫ p ( x, y )dy 1 =∫ dy (a 2 − a1 )(b2 − b1 ) = 1 a2 − a1

同理, p( y ) = 因此

1 。 b2 − b1

h( X ) = − ∫ p ( x ) log p ( x)dx = log(a 2 − a1 ) h(Y ) = − ∫ p( y ) log p( y )dy = log(b2 − b1 ) h( XY ) = − ∫ p ( x, y ) log p ( x, y )dxdy = log( a2 − a1 ) + log(b2 − b1 ) I ( X ; Y ) = h( X ) + h(Y ) − h( XY ) = 0 【4.7】在连续信源中,根据差熵、条件差熵和联合差熵的定义,证明 (1) h( X | Y ) ≤ h( X ) ,当且仅当 X 和 Y 统计独立时等号成立; (2)h( X 1 X 2 L X N ) ≤ h( X 1 ) + h( X 2 ) + L + h( X N ) ,当且仅当 X 1 X 2 L X N 彼此统计 独立时等式成立。 证明: (1) h( XY ) = − ∫ p( y )dy ∫ p( x | y ) log p ( x | y )dx ≤ − ∫ p ( y )dy ∫ p( x | y ) log p ( x )dx = − ∫ p( x, y ) log p ( x )dxdy = h( X ) 等号成立当且仅当 p( x | y ) = p ( x ) ,即 p( x, y ) = p( x ) p ( y ) ,因此仅当 X 和 Y 统计 独立时等号成立。 (2)根据条件概率密度的相关公式,有 h( X 1 X 2 X N ) = h( X 1 ) + h( X 2 | X 1 ) + h( X 3 | X 1 X 2 ) + L + h( X N | X 1 X 2 X N −1 ) 根据(1)的结论,条件差熵小于差熵,因此有 h( X 1 X 2 L X N ) ≤ h( X 1 ) + h( X 2 ) + L + h( X N ) 等号成立当且仅当

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第四章信源编码 习题解答1、一个信源由1) 哪些是非奇异码?哪些是唯一可译码?哪些是即时码? 2) 分别计算每个唯一可译码的平均码长和编码效率。

解:1)A 、B 、C 、D 、E 、F 是非奇异码。

A 、B 、C 、F 是唯一可译码(E 不满足克拉夫特不等式)。

A 、C 、F 是即时码(B 是续长码)。

3) 编码A :平均码长:3A L = 码元/消息 信源熵:111111()lb lb 4lb 222441616H X =---⨯=比特/消息 编码效率:max ()/2/366.7%lb21A H H X L H η====码码编码B 和C :平均码长:11111123456 2.1252416161616B C L L ==+⨯+⨯+⨯+⨯+⨯= 码元/消息 编码效率:max ()/2/2.12594.1%lb21B C H H X L H ηη=====码码编码F :平均码长:111234 2.52416F L ⎛⎫=⨯+⨯+⨯= ⎪⎝⎭ 码元/消息 编码效率:max ()/2/2.580%lb21F H H X L H η====码码2、离散无记忆信源X 的概率空间为:1234567()0.200.190.180.170.150.100.01X x x x x x x x p X ⎧⎫⎡⎤=⎨⎬⎢⎥⎩⎭⎣⎦ 1)对其进行费诺编码,并计算其编码效率;2)对其进行哈夫曼编码,并将其编码效率与费诺编码相比较。

解:1)费诺编码:平均码长:()()()0.20.1720.190.180.1530.10.014 2.74L =+⨯+++⨯++⨯=码元/符号 信源熵:()0.20lb0.200.19lb0.190.18lb0.180.17lb0.170.15lb0.150.1lb0.10.01lb0.01 2.60/874H X =-------= 比特符号编码后平均码元熵:() 2.608740.95212.74H X H L===码比特/码元编码效率:max 0.952195.21%lb2H H η===码码2)哈夫曼编码: 码长 码字 信源X p (X ) 2 10 x 1 2 11 x 2 3 000 x 3 3 001 x 4 3 010 x 5 4 0110 x 6 40111x 7平均码长:()()()0.20.1920.180.170.1530.10.014 2.72L =+⨯+++⨯++⨯=码元/符号 编码后平均码元熵:() 2.608740.95912.72H X H L===码比特/码元编码效率:max 0.959195.91%lb2H H η===码码与费诺编码相比,哈夫曼编码的编码效率要高于费诺编码。

一般情况下哈夫曼编码效率较高,但费诺编码如果每次划分概率很接近,则效率也很高。

3、离散无记忆信源X 的概率空间为:12345678()0.220.200.180.10.150.020.050.08X x x x x x x x x p X ⎧⎫⎡⎤=⎨⎬⎢⎥⎩⎭⎣⎦ 1)对其进行费诺编码;2)对其进行哈夫曼编码。

解:1信源X p (X ) 编码过程 码字 码长 x 1 0.22 00 00 2 x 2 0.20 1 01 2 x 3 0.18 1 00 100 3 x 5 0.15 1 101 3 x 4 0.1 1 0 110 3 x 8 0.08 10 1110 4 x 7 0.05 10 11110 5 x 60.0211111152)哈夫曼编码:4、离散无记忆信源S 描述为:123456()0.370.250.10.180.030.07S s s s s s s p S ⎧⎫⎡⎤=⎨⎬⎢⎥⎩⎭⎣⎦ 1)计算信源熵及其冗余度;2)对其进行费诺编码;3)对其进行哈夫曼编码;4*)对其进行香农-费诺-埃利阿斯编码; 5*)对其进行香农编码;6)计算哈夫曼码的平均码长、编码效率和码冗余度;7)把哈夫曼编码器的输出看成一个新信源X ,计算其概率分布p (x 1) 和 p (x 2); 8)H [p (x 1), p (x 2)] 是否等于H 码(即平均码元熵)?为什么? 解:1)信源熵:()0.37lb0.370.25lb0.250.18lb0.180.1lb0.10.07lb0.070.03lb0.03 2.229H S =------= 比特/消息冗余度:max ()2.231113.788%()lb6H S E H S =-=-=2)费诺编码:信源S p (S ) 编码过程 码字 码长 s 1 0.37 00 00 2 s 2 0.25 1 01 2 s 4 0.18 1 0 10 2 s 3 0.1 10 110 3 s 6 0.07 10 1110 4 s 50.031111143)哈夫曼编码:4) 香农-费诺-埃利阿斯编码:信源S p (S ) F (s ) ()F s()F s 的二进制数 码长 码字s 1 0.37 0.37 0.185 0.00101.. 3 001 s 2 0.25 0.62 0.495 0.01111.. 3 011 s 40.180.800.710.101101..410115)香农编码:6)分析哈夫曼码,其平均码长:61()2(0.370.250.18)30.14(0.07+0.03=2.3i i i L p s l ===⨯+++⨯+⨯∑) 码元/消息平均码元熵:() 2.2290.968962.3H S H L===码 比特/码元 编码效率:max 0.97096.896%lb2H H η===码码码冗余度:max 0.9689611 3.104%lb2H E H η==-=-=码码码1-7)把哈夫曼编码器的输出看成一个新信源X ,计算其概率分布p (x 1) 和 p (x 2):11211()(0)0.370.250.10.03+0.07=0.60422342p x p ==+⨯+⨯+⨯⨯21131()(1)0.250.10.180.030.070.39582342p x p ==⨯+⨯++⨯+⨯=8)计算12[(),()](0.6042,0.3958)0.6042lb0.60420.3958lb0.39580.9685 /H p x p x H ==--=比特码元 相比平均码元熵:12() 2.2290.96896[(),()]2.3H S H H p x p x L===≈码 比特/码元 可见,两者很相近,但理论上不相同。

因为平均码元熵计算的是算术平均值,而12[(),()]H p x p x 作的是统计平均。

5. 设有6个消息,其出现概率分别为A B C D E F 1/16 1/16 2/16 3/16 4/16 5/16将它们分别进行费诺编码和霍夫曼编码,并比较编码效率。

是否在任何情况下费诺编码比霍夫曼编码效率都低?解:信源:112345()161616161616A B C D E F X p X ⎧⎫⎡⎤⎪⎪=⎨⎬⎢⎥⎣⎦⎪⎪⎩⎭费诺编码:信源X p (X ) 编码过程 码字 码长 F 5/16 00 00 2 E 4/16 1 01 2 D 3/16 1 0 10 2 C 2/16 10 110 3 B 1/16 10 1110 4 A1/16111114平均码长:543211234 2.375161616161616L ⎛⎫⎛⎫=++⨯+⨯++⨯=⎪ ⎪⎝⎭⎝⎭码元/符号信源熵:111111331155()lb lb lb lb lb lb 2.35216161616881616441616H X =------=比特/符号 编码后平均码元熵:() 2.3520.992.375H X H L===码比特/码元 二元信源最大码元熵为1比特/码元,故编码效率:max 0.9999%1H H η===码码哈夫曼编码:由于平均码长与费诺编码一样,故编码效率也为99%。

一般情况下哈夫曼编码效率较高,但费诺编码如果每次划分概率很接近,则效率也很高。

6. 有一冗余位序列,N =15,码字为001000000010000,试将其编成L-D 码,并将L-D 码译回原序列。

解:001000000010000 N=15 编码:[]()2112212111111312152,3,1145247105 lb105 6.77 lb 151 4n n Q n n T C C C C C ----====+=+=+====+=⎡⎤⎣⎦已知:计算: 24477Q T ==将转变成位二进制数,转变成位二进制数,于是得L-D 码: 0010 0101111译码:221011215,2,4745475510111N Q T C C n ====≤<==+=修正:21101123147452223213T T C C C n =-=-==≤<==+=故译码恢复出原序列:001000000010000作业:1、2、4。