无失真信源编码题与答案

信息论与编码试题集与答案

1. 在无失真的信源中,信源输出由 H (X ) 来度量;在有失真的信源中,信源输出由 R (D ) 来度量。

2. 要使通信系统做到传输信息有效、可靠和保密,必须首先 信源 编码, 然后_____加密____编码,再______信道_____编码,最后送入信道。

3. 带限AWGN 波形信道在平均功率受限条件下信道容量的基本公式,也就是有名的香农公式是log(1)C W SNR =+;当归一化信道容量C/W 趋近于零时,也即信道完全丧失了通信能力,此时E b /N 0为 -1.6 dB ,我们将它称作香农限,是一切编码方式所能达到的理论极限。

4. 保密系统的密钥量越小,密钥熵H (K )就越 小 ,其密文中含有的关于明文的信息量I (M ;C )就越 大 。

5. 已知n =7的循环码42()1g x x x x =+++,则信息位长度k 为 3 ,校验多项式 h(x)= 31x x ++ 。

6. 设输入符号表为X ={0,1},输出符号表为Y ={0,1}。

输入信号的概率分布为p =(1/2,1/2),失真函数为d (0,0) = d (1,1) = 0,d (0,1) =2,d (1,0) = 1,则D min = 0 ,R (D min )= 1bit/symbol ,相应的编码器转移概率矩阵[p(y/x )]=1001⎡⎤⎢⎥⎣⎦;D max = 0.5 ,R (D max )= 0 ,相应的编码器转移概率矩阵[p(y/x )]=1010⎡⎤⎢⎥⎣⎦。

7. 已知用户A 的RSA 公开密钥(e,n )=(3,55),5,11p q ==,则()φn = 40 ,他的秘密密钥(d,n )=(27,55) 。

若用户B 向用户A 发送m =2的加密消息,则该加密后的消息为 8 。

四、计算题1.已知(),X Y 的联合概率(),p x y 为: 求()H X ,()H Y ,(),H X Y ,();I X Y解: (0)2/3p x == (1)1/3p x == (0)1/3p y == (1)2/3p y == ()()(1/3,2/3)H X H Y H ===0.918 bit/symbol(),(1/3,1/3,1/3)H X Y H ==1.585 bit/symbol ();()()(,)I X Y H X H Y H X Y =+-=0.251 bit/symbol2.某系统(7,4)码)()(01201230123456c c c m m m m c c c c c c c ==c 其三位校验位与信息位的关系为:231013210210c m m m c m m m c m m m=++⎧⎪=++⎨⎪=++⎩ 01X Y011/31/301/3(1)求对应的生成矩阵和校验矩阵; (2)计算该码的最小距离;(3)列出可纠差错图案和对应的伴随式; (4)若接收码字R =1110011,求发码。

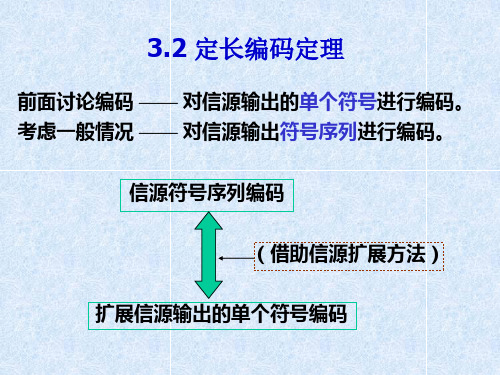

第三章-无失真信源编码(2)

序列 x1x1 x1x2 x2x1 x2x2

序列概率 9/16 3/16 3/16 1/16

即时码 0 10 110 111

这个码的码字平均长度

lN

9 1

3 2

3 3

1 3 27

码元/ 信源序列

16 16 16 16 16

单个符号的平均码长

l

l

N

lN

27

码元 / 符号

N 2 32

编码效率

c

H(X)

例1:设有一简单DMS信源:

U

p

u1 1 2

u2 1 22

u3 1 23

u4 u5 u6 u7

111

1

24 25 26 26

用码元表X={0,1}对U的单个符号进行编码(N=1),即对U

的单个符号进行2进制编码。

解:用X的两个码元对U的7个符号进行编码,单 个对应的定长码长:

l lN log q log 7 2.8 码元 / 符号 N log r log 2

j 1

log r

1 qN

r l j

ln 2

P(a j ) ln

j 1

P(aj )

1 qN

r l j

ln 2 j1 P(a j )( P(a j ) 1)

(ln z z 1)

qN

qN

rlj P(a j )

j 1

j 1

ln 2

11 0 (Kraft不等式和概率完备性质) ln 2

(2)根据信源的自信息量来选取与之对应的码长:

【说明】

霍夫曼编码是真正意义上的最佳编码,对给定的信源,平 均码长达到最小,编码效率最高,费诺编码次之,香农编码 效率最低。

信息论与编码习题答案-曹雪虹

3-14

信源 符号 xi x1 x2 x3 x4 x5 x6 x7

符号概 率 pi 1/3 1/3 1/9 1/9 1/27 1/27 1/27 1/3 1/3 1/9 1/9 2/27 1/27 1/3 1/3 1/9 1/9 1/9

编码过程

编码 1/3 1/3 1/3 2/3 1/3 00 01 100 101 111 1100 1101

得p0p1p223当p0或p1时信源熵为0第三章无失真信源编码31321因为abcd四个字母每个字母用两个码每个码为05ms所以每个字母用10ms当信源等概率分布时信源熵为hxlog42平均信息传递速率为2信源熵为hx0198bitms198bitsbitms200bits33与上题相同351hu12log2?14log4?18log8?116log16?132log32?164log64?1128log128?1128log128?1984111111112481632641281282每个信源使用3个二进制符号出现0的次数为出现1的次数为p0p134相应的香农编码信源符号xix1x2x3x4x5x6x7x8符号概率pi12141811613216411281128累加概率pi00507508750938096909840992logpxi12345677码长ki12345677码字010110111011110111110111111011111110相应的费诺码信源符号概符号xi率pix1x2x3x4x5x6x7x812141811613216411281128111第一次分组0第二次分组0第三次分组0第四次分组0第五次分组011第六次分组01第七次分组01二元码0101101110111101111101111110111111105香农码和费诺码相同平均码长为编码效率为

第五章无失真信源编码分析

s jN

C N {w 1 , w 2 , , w q N }

w j w j1 w j2 w jN

s j s j1 s j2

j 1, 2 , , q N

j1 , j 2 , , j N 1, 2 , , q

第五章:无失真信源编码

一、信源编码的相关概念

3. N次扩展码(续1)

2 2.5 3 3

s1= s1 s1 s2= s1 s2 s3= s1 s3 s4= s1 s4 s5= s2 s1 s6= s2 s2 s7= s2 s3 s8= s2 s4

1/4 1/8 1/16 1/16

1/8

1/16 1/32

1.5

2 2.5

1/32

2.5

s9 = s3 s 1 s10= s3 s2 s11= s3 s3 s12= s3 s4 s13= s4 s1 s14= s4 s2 s15= s4 s3 s16= s4 s4

2) 非奇异码

s1 0 s2 10 s3 s4 00 01

译码 0 10 00 01 0 译码

s1 s 2 s 3 s 4 s1

01 00

00 10

s 4 s3 s3 s 2

第五章:无失真信源编码

一、信源编码的相关概念

6. 唯一可译性(续4)

3)

等长码

非奇异码

唯一可译码

s1 s2

00 01

s3 10 s4 11

第五章:无失真信源编码

一、信源编码的相关概念

8. 即时码的构造方法(续4)

非分组码 奇异码 非唯一可译码 码 分组码 非奇异码 即时码 唯一可译码 非即时码

信息论与编码试卷及答案

一、(11’)填空题(1)1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

(2)必然事件的自信息是0 。

(3)离散平稳无记忆信源X的N次扩展信源的熵等于离散信源X的熵的N倍。

(4)对于离散无记忆信源,当信源熵有最大值时,满足条件为__信源符号等概分布_。

(5)若一离散无记忆信源的信源熵H(X)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为3 。

(6)对于香农编码、费诺编码和霍夫曼编码,编码方法惟一的是香农编码。

(7)已知某线性分组码的最小汉明距离为3,那么这组码最多能检测出_2_______个码元错误,最多能纠正___1__个码元错误。

(8)设有一离散无记忆平稳信道,其信道容量为C,只要待传送的信息传输率R__小于___C(大于、小于或者等于),则存在一种编码,当输入序列长度n足够大,使译码错误概率任意小。

(9)平均错误概率不仅与信道本身的统计特性有关,还与___译码规则____________和___编码方法___有关二、(9?)判断题(1)信息就是一种消息。

(?)(2)信息论研究的主要问题是在通信系统设计中如何实现信息传输、存储和处理的有效性和可靠性。

(?)(3)概率大的事件自信息量大。

(?)(4)互信息量可正、可负亦可为零。

(?)(5)信源剩余度用来衡量信源的相关性程度,信源剩余度大说明信源符号间的依赖关系较小。

(?)(6)对于固定的信源分布,平均互信息量是信道传递概率的下凸函数。

(?)(7)非奇异码一定是唯一可译码,唯一可译码不一定是非奇异码。

(?)(8)信源变长编码的核心问题是寻找紧致码(或最佳码),霍夫曼编码方法构造的是最佳码。

(?)(9)信息率失真函数R(D)是关于平均失真度D 的上凸函数. ( ? )三、(5?)居住在某地区的女孩中有25%是大学生,在女大学生中有75%是身高1.6米以上的,而女孩中身高1.6米以上的占总数的一半。

信息论与编码试题集与答案(新)

1. 在无失真的信源中,信源输出由 H (X ) 来度量;在有失真的信源中,信源输出由 R (D ) 来度量。

2. 要使通信系统做到传输信息有效、可靠和保密,必须首先 信源 编码, 然后_____加密____编码,再______信道_____编码,最后送入信道。

3. 带限AWGN 波形信道在平均功率受限条件下信道容量的基本公式,也就是有名的香农公式是log(1)C W SNR =+;当归一化信道容量C/W 趋近于零时,也即信道完全丧失了通信能力,此时E b /N 0为 -1.6 dB ,我们将它称作香农限,是一切编码方式所能达到的理论极限。

4. 保密系统的密钥量越小,密钥熵H (K )就越 小 ,其密文中含有的关于明文的信息量I (M ;C )就越 大 。

5. 已知n =7的循环码42()1g x x x x =+++,则信息位长度k 为 3 ,校验多项式 h(x)= 31x x ++ 。

6. 设输入符号表为X ={0,1},输出符号表为Y ={0,1}。

输入信号的概率分布为p =(1/2,1/2),失真函数为d (0,0) = d (1,1) = 0,d (0,1) =2,d (1,0) = 1,则D min = 0 ,R (D min )= 1bit/symbol ,相应的编码器转移概率矩阵[p(y/x )]=1001⎡⎤⎢⎥⎣⎦;D max = 0.5 ,R (D max )= 0 ,相应的编码器转移概率矩阵[p(y/x )]=1010⎡⎤⎢⎥⎣⎦。

7. 已知用户A 的RSA 公开密钥(e,n )=(3,55),5,11p q ==,则()φn = 40 ,他的秘密密钥(d,n )=(27,55) 。

若用户B 向用户A 发送m =2的加密消息,则该加密后的消息为 8 。

二、判断题1. 可以用克劳夫特不等式作为唯一可译码存在的判据。

(√ )2. 线性码一定包含全零码。

(√ )3. 算术编码是一种无失真的分组信源编码,其基本思想是将一定精度数值作为序列的 编码,是以另外一种形式实现的最佳统计匹配编码。

信息论与编码理论-第4章无失真信源编码-习题解答-20071202

信息论与编码理论-第4章无失真信源编码-习题解答-20071202信息论与编码理论第4章无失真信源编码习题及其参考答案4-1 有一信源,它有六个可能的输出,其概率分布如下表所示,表中给出了对应的码A、B、C、D、E和F(1)求这些码中哪些是唯一可译码;(2)求哪些码是及时码;(3)对所有唯一可译码求出其平均码长。

?X??s14-2 设信源????p(s)P(X)???1s6?p(s2)?p(s6)???s2?p(s)?1。

对此次能源进行m元唯一ii?16可译编码,其对应的码长为(l1,l2,…,l6)=(1,1,2,3,2,3),求m值的最好下限。

(提示:用kraft不等式)?s?X??14-3设信源为??1??p(X)???2?(1)信源的符号熵;(2)这种码的编码效率;s214s3s411816s5132s6s7s8?,编成这样的码:(000,001,111???64128128?010,011,100,101,110,111)。

求(3)相应的仙农码和费诺码。

4-4求概率分布为(,11122信)源的二元霍夫曼编码。

讨论此码对于概率分布为355151511111(,,,,)的信源也是最佳二元码。

555554-5有两个信源X和Y如下:1信息论与编码理论s2s3s4s5s6s7??X??s1??p(X)??0.200.190.180.170.150.100.01?????s2s3s4s5s6s7s8s9??Y??s1??p(Y)??0.490.140.140.070.070.040.020.02 0.01?????(1)用二元霍夫曼编码、仙农编码以及费诺编码对信源X和Y进行编码,并计算其平均码长和编码效率;(2)从X,Y两种不同信源来比较三种编码方法的优缺点。

4-6设二元霍夫曼码为(00,01,10,11)和(0,10,110,111),求出可以编得这样霍夫曼码的信源的所有概率分布。

4-7设信源为?码。

第二章 无失真信源编码3Huffman编码

U

P

u1 0.5

u2 0.25

u3 0.125

u4 0.125

码长

1 2 3 3

消息 符号 码字 符号 概率

ui P(ui)

0

u1 0.5

10 u2 0.25

110 u3 0.125

111 u4 0.125

信息熵:

H(U) p(ui )lbp(ui ) 1. 75bit i

0

平均码长:

2.3 霍夫曼码及其他编码方法

一、霍夫曼码 二、费诺编码 三、香农-费诺-埃利斯码

一、Huffman编码

1.二元Huffman编码

步骤:

① 递减排序;S=[s1,s2,…,sq] ② 合并概率最小的两个符号; ③ 重复①②,直至缩减信源中只有两个符号为止; ④ 分配码元。

例1:

已知离散无记忆信源如下所示,对应的霍夫曼编码为:

消息 概率

第一次 分组

第二次 分组

第三次 分组

第四次 分组

码字

码长

si

P(si)

s1

0.20

0

00 2

s2

0L.19

0P(si

)li

1

2.740code

/

sig

010

3

s3

0.18

1

011 3

s4

0.17

0

10 2

H (S )

s5 R0.15 L1 0.953 b0it / code 110

3

55

LL PP((ssii))llii 00..4421 0.2 2 0.2 23 0.1 43 0.1 43 2.2 code / sig

ii11

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

有一信源,它有6个可能的输出,其概率分布如题表所示,表中给出了对应的码E D C B A ,,,, 和 F 。

(1) 求这些码中哪些是唯一可译码; (2) 求哪些是非延长码(即时码); (3) 对所有唯一可译码求出其平均码长L 。

解:

(1) 唯一可译码:A ,B ,C

A 是等长码,码长3,每个码字各不相同,因此是唯一可译码。

B 是非即时码,前缀码,是唯一可译码。

C 是即时码,是唯一可译码。

D 是变长码,码长}4 ,4 ,4 ,3 ,2 ,1{,不是唯一可译码,因为不满足Kraft 不等式。

10625.132********

321≥=⨯⎪⎭

⎫

⎝⎛+⎪⎭⎫ ⎝⎛+⎪⎭⎫ ⎝⎛+⎪⎭⎫ ⎝⎛=∑-i

l i

r

E 是变长码,码长}4 ,4 ,4 ,4 ,2 ,1{,满足Kraft 不等式,但是有相同的码字,110053==W W ,不是唯一可译码。

1142121214

21≤=⨯⎪⎭

⎫

⎝⎛+⎪⎭⎫ ⎝⎛+⎪⎭⎫ ⎝⎛=∑-i

l i

r

F 是变长码,码长}3 ,3 ,3 ,3 ,3 ,1{,不满足Kraft 不等式,不是唯一可译码。

1125.1521213

1≥=⨯⎪⎭

⎫

⎝⎛+⎪⎭⎫ ⎝⎛=∑-i

l i

r

(2) 非延长码:A ,C (3)

3125.1616

1

5161416131612411213

=⨯+⨯+⨯+⨯+⨯+⨯=

⋅===∑i

i i C B A l p L L L

设离散信源的概率空间为

⎭⎬⎫⎩

⎨⎧=⎥⎦⎤⎢⎣⎡05.010.015.020.025.025.0654321

s s s s s s P S

对其采用香农编码,并求出平均码长和编码效率。

解:

()%7.897

.2423

.2)( 423.205.0log 05.0...25.0log 25.0log )(7

.2505.041.0315.032.0225.0225.0===

=⨯++⨯-=-==⨯+⨯+⨯+⨯+⨯+⨯=⋅=∑∑L S H bit p p S H l p L i

i i i

i i η

设无记忆二元信源,其概率995.0 ,005.021==p p 。

信源输出100=N 的二元序列。

在长为

100=N 的信源序列中只对含有3个或小于3个“1”的各信源序列构成一一对应的一组等长码。

(1) 求码字所需要的长度;

(2) 考虑没有给予编码的信源序列出现的概率,该等长码引起的错误概率E p 是多少?

解: (1)

码字中有0个“1”,码字的个数:10

100=C 码字中有1个“1”,码字的个数:1001100=C 码字中有2个“1”,码字的个数:49502100=C 码字中有3个“1”,码字的个数:1617003100=C

1835.17166751log log 166751

161700495010013100210011000100===≥≥=+++=+++=i r i l l q l q

r C C C C q i

(2)

码字中有0个“1”,错误概率:()100

995.01=a p

码字中有1个“1”,错误概率:()005.0995.099

2⨯=a p

码字中有2个“1”,错误概率:()()2

98

500.0995.03⨯=a p

码字中有3个“1”,错误概率:()()3

97

500.0995.04⨯=a p

()()0017

.09983.0119983

.0 161700005.0995.04950005.0 995.0100005.0995.01995.0 397298991003100

2100110001004321=-=-==⨯⨯+⨯⨯+⨯⨯+⨯=+++=N E a a a a N G p p C p C p C p C p G p εε

设有离散无记忆信源

⎭⎬

⎫⎩

⎨⎧=⎥⎦⎤⎢⎣⎡02.005.008.010.015.018.020.022.087654321

s s s s s s s s P S 码符号集}2 ,1 ,0{=X ,现对该信源S 进行三元哈夫曼编码,试求信源熵)(S H ,码平均长度L 和编码效率η。

解:

满树叶子节点的个数:(){}... ,9 ,7 ,5 ,3231=+=-+k r k r ,8=q ,不能构成满树。

i i i l w s

1s 1 1 2s 22 2 3s 21 2

4s 20 2 5s 02 2 6s 01 2 7s 000 3 8s 001 3

85.1302.0305.0208.021.0215.0218.022.0122.0=⨯+⨯+⨯+⨯+⨯+⨯+⨯+⨯=⋅=∑i

i i l p L

()%

9.933log 85.175.2log )( 75.202.0log 02.0...22.0log 22.0log )(=⨯===⨯++⨯-=-=∑r L S H bit

p p S H i

i i η

设有离散无记忆信源,其概率空间为

⎭⎬

⎫⎩

⎨⎧=⎥⎦⎤⎢⎣⎡04.008.016.018.022.032.0654321

s s s s s s P S 进行费诺编码,并求其信源熵)(S H ,码平均长度L 和编码效率η。

解:

()%984

.2352

.2)( 352.204.0log 04.0...32.0log 32.0log )(4

.2404.0408.0316.0218.0222.0232.0===

=⨯++⨯-=-==⨯+⨯+⨯+⨯+⨯+⨯=⋅=∑∑L S H bit

p p S H l p L i

i i i

i i η

设有离散无记忆信源

⎭⎬

⎫⎩

⎨⎧=⎥⎦⎤⎢⎣⎡01.010.015.017.018.019.020.07654321

s s s s s s s P S (1) 求该信源符号熵)(S H ;

(2) 用霍夫曼编码编成二元变长码,计算其编码效率;

(3) 用霍夫曼编码编成三元变长码,计算其编码效率;

(3) 当译码错误小于310-的定长二元码要达到(2)中霍夫曼码的效率时,估计要多少个信源符号一起编才能办到。

解: (1)

()bit p p S H i

i i 609.201.0log 01.0...2.0log 2.0log )(=⨯++⨯-=-=∑

(2)

s7

s6

s7

s6

s5s2s3s4

i i i l w s

1s 10 2 2s 11 2 3s 010 3

4s 011 3 5s 001 3 6s 0000 4 7s 0001 4

%

9.9572.2609.2)(72

.2401.041.0315.0317.0318.0219.022.0====⨯+⨯+⨯+⨯+⨯+⨯+⨯=⋅=∑L S H l p L i

i i η

(3)

满树叶子节点的个数:(){}... ,9 ,7 ,5 ,3231=+=-+k r k r ,7=q ,能构成满树。

i i i l w s

1s 1 1 2s 20 2 3s 21 2

4s 22 2 5s 00 2 6s 01 2 7s 02 2

%

4.913

log 8.1609.2log )(8

.1201.021.0215.0217.0218.0219.012.0=⨯===⨯+⨯+⨯+⨯+⨯+⨯+⨯=⋅=∑r L S H l p L i

i i η

若某一信源有N 个符号,并且每个符号均已等概率出现,对此信源用最佳霍夫曼二元编码,问当i N 2=和12+=i N (i 为正整数)时,每个码字的长度等于多少?平均码长是多少?

解:

()1

22

11

21log 1log log 21211211

2 )2(21log 1log log 21212 )1(1

1

+++=

=+=⎪

⎭

⎫ ⎝⎛=+-≤≤-<<+=+====⎪⎭⎫ ⎝⎛=+-≤≤-⎪

⎭

⎫ ⎝⎛===∑∑++i i

i

i i i i i i i i i i i

i i i

i i i

i i i i i

i i i

i i l p L i l p l p p p N when i

l p L i

l p l p p N when。