熵约束广学习矢量量化神经网络和软竞争学习算法

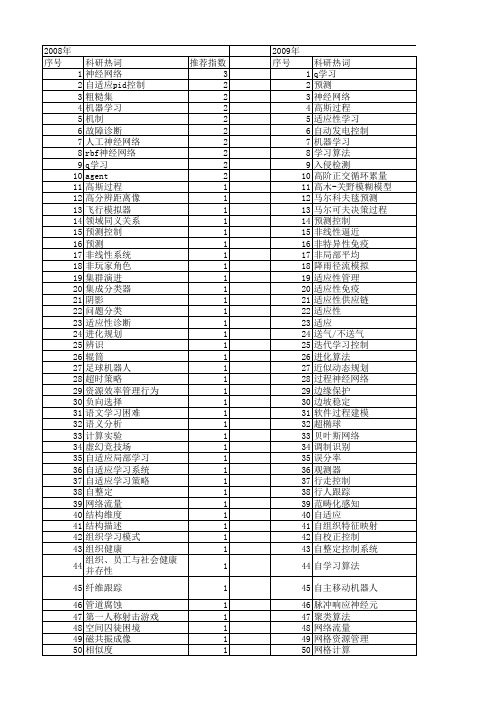

【国家自然科学基金】_适应性学习_基金支持热词逐年推荐_【万方软件创新助手】_20140730

53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95 96 97 98 99 100 101 102 103 104 105 106

组织学习 组织复杂性 组织免疫行为 组织免疫机制 纹理图像分割 粒子群算法 竞争学习矢量量化 竞争学习 社会资本 示功图 磁共振成像 知识积累 知觉训练 直推式学习 盲检测 电力市场 用户兴趣代理 用户个人兴趣模式 瓦斯涌出量 瓦斯含量 特异性免疫 牙种植体 灰色理论 演化 混凝土结构 泛函网络 步态学习 模糊神经网络 模糊知识库 模糊推理 模糊建模 模糊划分 模糊q学习 模式识别 模式分类 最小二乘支持向量机 最优控制 智能体 数值积分 故障跟踪估计器 故障诊断 改进的圆型反向传播网络 支持向量机 搜索引擎 控制性能标准 徐变预测 强化学习 建模 应用性研究 应用 应急管理 广义信息论 带内相关 岩土力学

特征选择 演化路径 演化博弈 温度控制 注气开发 油液光谱分析 汉字字形 比例积分微分神经元网络(pidnn) 步长 模糊推理 概率密度估计 概念漂移 核学习 最小二乘支持向量机回归 最大熵原则 智能断 昆虫记忆 数据流 数学学习困难 故障分析 故障传播模型 政策建议 收益 收敛性 战略互联网 性能检测 快速留一法 强化学习 弥散张量成像 张量偏转 建模 并联机器人 对照研究 实时控制 学习方式 多时相模式 复杂适应性 复杂网络 增量式学习 基于行为的控制系统 基于累计量的随机学习算法 垃圾邮件 场景分析 地下水位 在线建模 在线优化 图像要旨 图像处理 固有诊断 合作行为 变异策略 发酵过程 双层决策模型 双困难

计算机应用技术就业方向怎么样

计算机应用技术就业方向怎么样计算机应用技术就业方向1、网页制作,将来去网站工作。

2、学习3D、MAX等软件,去做动画。

3、学习美术设计。

4、网络,将来考个CCNA,去专业组网。

5、在保证能顺利毕业的前提下,去疯狂玩游戏,做个职业玩家或做一个或几个网络游戏的GM。

6、做程序员,搞软件开发。

专业特色计算机应用专业的特色是"厚基础,重方向"。

本专业学生可以学到很扎实的计算机应用基础知识,就业面广;同时,在此基础上又强化专业方向,学生们有重点地掌握一个专门化的技能,以便从事专业性较强的计算机岗位工作。

本方向着重研究神经网络、模糊逻辑、模糊神经网络、模拟退火技术、蚁群算法等在视频图像处理与编码中的应用,旨在发展快速高效和具有在低码率信道下实现视频图像实时编码潜能的压缩算法;在国内率先开展了模糊矢量量化技术的研究,提出了模糊学习vq算法、模糊k-邻域vq算法、随机竞争学习vq算法,使得vq编码性能大大提高,解决了对初始码书的依赖性问题和码书设计时间过长的问题。

在数字水印技术方面,较为系统地引入了混沌理论,同时在国内较早地开始第二代数字水印算法的研究;本方向还将医学成像技术、人工生命、非线性非确定系统辩识相结合,在国内较早地提出了基于spect、fmri、eeg、meg等信息融合高维时空非线性模型的建立和辨识,能够为医学功能实时成像提供定量的理论依据、有效的分析方法和实用的计算手段。

本方向重视高水平的实验室建设,分别与美国ti公司和美国motorola公司合作成立了dsp实验室和eda实验室各一个,实验室设备总投入已超过400万元,着重研究数字信号的实时处理技术与硬件实现,在现场可编程门阵列系统的动态可重构技术方面的研究,已经取得了关键技术的突破。

这些实验室设备先进,及时跟踪国外大公司的最新技术,当前已经为深圳特区的信息行业提供了较为雄厚的技术支持和完整的技术培训,具有较大的知名度和良好的学术声誉。

学习矢量量化的推广及其典型形式的比较

Kewo d :u sp ri dL Q, an u co , s u ci , a i td se t y r s nu e s V s l gfnt n l sfnt n g de ecn v e ci i o o r n

维普资讯

学 习矢量量 化的推广及 其典型形式 的比较

程剑 锋 徐俊 艳 ( 中国科 技 大学 自动化 系, 肥 2 0 2 ) 合 3 0 7

E ma : fs @s a o - i c ut i . m lj c nt 摘 要 无 监 督 学 习 矢量 量化 (V 是 一 类基 于最 小化 风 险 函数 的聚 类 方 法 , 中通 过 对 无 监 督 L Q风 险 函数 的研 究 , I Q) J 文 V

要 方 式 是 序 贯 竞 争 学 习 格 式 .这 种 格 式 最 主 要 的 方 法 就 是

习矢 量 量 化 ( C L Q) E G V 很好 地解 决 了这 个 问 题 . 们 都 有 明确 它 的 目标 函 数 并 通过 梯度 下 降 法 将 目标 函 数 变成 在 线 学 习 格 式 . 适 用 于 L Q神 经 网 络 的在 线 学 习 本文 根据 L O算 法 的 风 险 V V 函 数 . 出 了 L Q神 经 网 络 的广 义形 式 。 通过 对 无 监 督 L Q 提 V 并 V

ห้องสมุดไป่ตู้

te l sfn t n hspp rpee t a gnrle om li fu sp ri d L Q,n rnf scas a u spri d h o u c o. i ae rsns eea zd fr ua o o nu e s V ad t s r l il nu e s s i T i tn v e a e sc v e L Q l oi m no erig vc r q at ao hc s bsd o y i l sa n u ci ,s fr ua o s e V a rh i l nn et u ni t n w i i ae n tpc l c ig fnt n i o lt n i r g t t a o zi h ay l o t m i v y cne i tfri x ni n t api t nB nu e i d L Q n ua ntok ipoe e cn e spri d o vne o t et s n ad i p lai .y u sp r s V erl ew r m rvd w a gt u e s n s e o s c o v e v e L Q nua n tokw ihi b e n u spri d L Q a o tm a da pyi t sekriet ctn te e c n y V e r e r hc s a do nu e s V l rh n p l t o p ae d ni ao , f i c l w s v e gi i f i h fe i

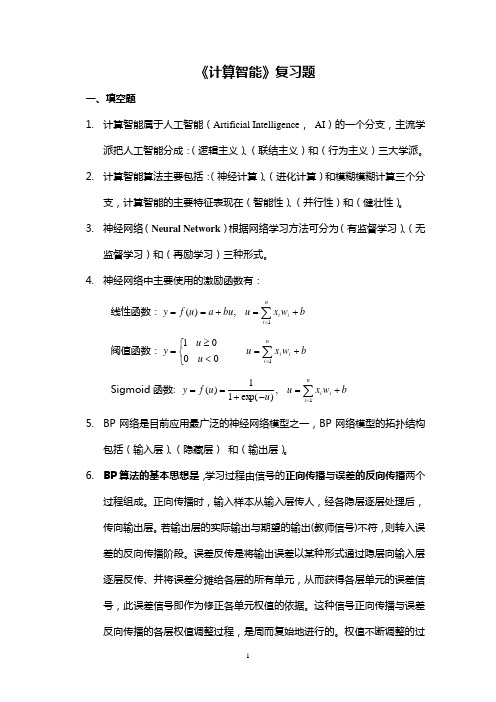

智能计算复习题1

《计算智能》复习题一、填空题1. 计算智能属于人工智能(Artificial Intelligence , AI )的一个分支,主流学派把人工智能分成:(逻辑主义)、(联结主义)和(行为主义)三大学派。

2. 计算智能算法主要包括:(神经计算)、(进化计算)和模糊模糊计算三个分支,计算智能的主要特征表现在(智能性)、(并行性)和(健壮性)。

3. 神经网络(Neural Network )根据网络学习方法可分为(有监督学习)、(无监督学习)和(再励学习)三种形式。

4. 神经网络中主要使用的激励函数有:线性函数:b w x u bu a u f y i ni i +=+==∑=1,)(阀值函数:⎩⎨⎧<≥=0001u u y b w x u ni i i +=∑=1Sigmoid 函数: b w x u u u f y i n i i +=-+==∑=1,)ex p(11)( 5. BP 网络是目前应用最广泛的神经网络模型之一,BP 网络模型的拓扑结构包括(输入层)、(隐藏层) 和(输出层)。

6. BP 算法的基本思想是,学习过程由信号的正向传播与误差的反向传播两个过程组成。

正向传播时,输入样本从输入层传人,经各隐层逐层处理后,传向输出层。

若输出层的实际输出与期望的输出(教师信号)不符,则转入误差的反向传播阶段。

误差反传是将输出误差以某种形式通过隐层向输入层逐层反传、并将误差分摊给各层的所有单元,从而获得各层单元的误差信号,此误差信号即作为修正各单元权值的依据。

这种信号正向传播与误差反向传播的各层权值调整过程,是周而复始地进行的。

权值不断调整的过程,也就是网络的学习训练过程。

此过程一直进行到网络输出的误差减少到可接受的程度,或进行到预先设定的学习次数为止。

7.人工神经网络的发展历程可归结为(萌芽期)、(低潮反思期)、(复兴发展时期和(新的发展时期)四个时期。

8.神经网络的7个学习规则:Hebb学习规则、Delta学习规则、梯度下降学习规则、Kohonen学习规则、后向传播学习规则、概率式学习规则和竞争式学习规则。

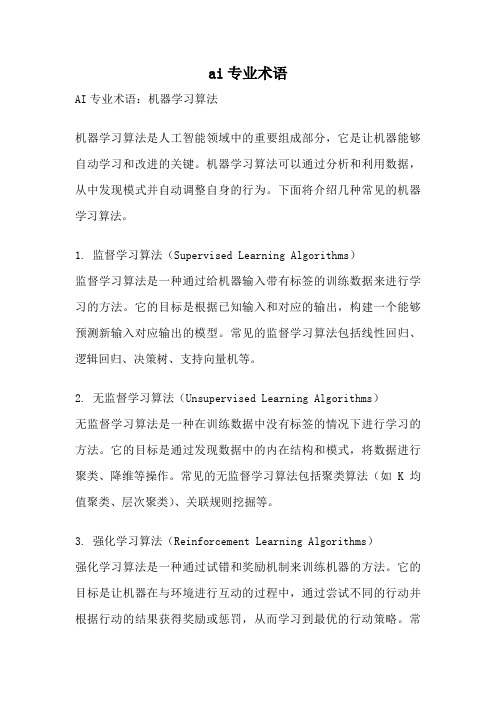

ai专业术语

ai专业术语AI专业术语:机器学习算法机器学习算法是人工智能领域中的重要组成部分,它是让机器能够自动学习和改进的关键。

机器学习算法可以通过分析和利用数据,从中发现模式并自动调整自身的行为。

下面将介绍几种常见的机器学习算法。

1. 监督学习算法(Supervised Learning Algorithms)监督学习算法是一种通过给机器输入带有标签的训练数据来进行学习的方法。

它的目标是根据已知输入和对应的输出,构建一个能够预测新输入对应输出的模型。

常见的监督学习算法包括线性回归、逻辑回归、决策树、支持向量机等。

2. 无监督学习算法(Unsupervised Learning Algorithms)无监督学习算法是一种在训练数据中没有标签的情况下进行学习的方法。

它的目标是通过发现数据中的内在结构和模式,将数据进行聚类、降维等操作。

常见的无监督学习算法包括聚类算法(如K均值聚类、层次聚类)、关联规则挖掘等。

3. 强化学习算法(Reinforcement Learning Algorithms)强化学习算法是一种通过试错和奖励机制来训练机器的方法。

它的目标是让机器在与环境进行互动的过程中,通过尝试不同的行动并根据行动的结果获得奖励或惩罚,从而学习到最优的行动策略。

常见的强化学习算法包括Q-Learning、Deep Q Network等。

4. 深度学习算法(Deep Learning Algorithms)深度学习算法是一种基于人工神经网络的机器学习算法。

它通过多层次的神经元网络来模拟人脑的工作原理,从而实现对复杂数据的学习和理解。

深度学习算法在图像识别、语音识别、自然语言处理等领域取得了巨大的成功。

常见的深度学习算法包括卷积神经网络(CNN)、循环神经网络(RNN)、长短期记忆网络(LSTM)等。

5. 迁移学习算法(Transfer Learning Algorithms)迁移学习算法是一种利用已学习到的知识来解决新问题的方法。

人工智能算法基础知识概览

人工智能算法基础知识概览人工智能算法是指为了实现人工智能技术而设计的一系列数学模型和方法。

它们是人工智能的核心组成部分,能够通过机器学习、数据挖掘和模式识别等手段,从大量数据中学习和推理,实现人类智能。

一、机器学习算法机器学习算法是人工智能算法的基石,广泛应用于各个领域。

它通过计算机从已有的样本数据中自动学习,并根据这些学习结果进行预测和决策。

1.1 监督学习监督学习算法是指在给定输入和对应输出的训练样本集的情况下,通过学习得到一个输入到输出的映射关系。

常见的监督学习算法有线性回归、逻辑回归和决策树等。

1.2 无监督学习无监督学习算法是指在给定输入的情况下,从数据中挖掘出隐藏的结构和规律。

常见的无监督学习算法有聚类分析、关联规则挖掘和主成分分析等。

1.3 强化学习强化学习算法是指通过试错的方式,使智能体与环境进行交互,并根据环境的反馈来调整自己的行为。

常见的强化学习算法有Q-learning 和深度强化学习等。

二、深度学习算法深度学习是机器学习的一种特殊形式,其核心是人工神经网络模型。

深度学习算法在图像识别、语音识别和自然语言处理等领域取得了重大突破。

2.1 卷积神经网络(CNN)卷积神经网络是一种专门用于处理图像识别和计算机视觉任务的深度学习算法。

它通过卷积、池化和全连接等操作,逐层提取图像的特征。

2.2 循环神经网络(RNN)循环神经网络是一种专门用于处理序列数据的深度学习算法。

它通过神经元之间的循环连接,使过去的信息可以传递到未来,适用于语言模型和序列生成等任务。

2.3 预训练模型预训练模型是指在大规模数据集上进行预训练,然后在特定任务上进行微调的深度学习算法。

常见的预训练模型有BERT、GPT和VGG 等。

三、演化算法演化算法是启发式搜索的一种,在优化问题和模拟进化过程中具有广泛应用。

它通过模拟生物进化的过程,通过选择、交叉和变异等操作来生成更好的解。

3.1 遗传算法遗传算法是一种模拟生物进化的优化算法。

自组织竞争神经网络

dj =

n

∑ (x

i =1

i

− wi j ) 2

∆wi j = η h( j , j*)( xi − wi j )

j − j*2 h ( j , j *) = exp − σ2

自组织竞争神经网络算法能够进行有效的自适应分类,但它仍存在一些问题: 学习速度的选择使其不得不在学习速度和最终权值向量的稳定性之间进行折中。 有时有一个神经元的初始权值向量离输入向量太远以至于它从未在竞争中获胜, 因 此也从未得到学习,这将形成毫无用处的“死”神经元。

网络结构

%1.ÎÊÌâÌá³ö X=[0 1;0 1]; clusters=8; points=10; std_dev=0.05; P=nngenc(X,clusters,points,std_dev); plot(P(1,:),P(2,:),'+r'); title('ÊäÈëÏòÁ¿'); xlabel('P(1)'); ylabel('P(2)'); %2.ÍøÂçÉè¼Æ net=newc([0 1;0 1],8,.1) w=net.IW{1}; plot(P(1,:),P(2,:),'+r'); hold on; circle=plot(w(:,1),w(:,2),'ob') %3.ÍøÂçѵÁ· net.trainParam.epochs=7; net=train(net,P) w=net.IW{1}; delete(circle); plot(w(:,1),w(:,2),'ob'); %4.ÍøÂç²âÊÔ p=[0.5;0.2]; a=sim(net,p)

基于实例的学习矢量量化神经网络诊断方法及其应用

I

匐 化

基 于实例 的学 习矢量量化神经 网络诊断

方法及其应用

张 国辉

( 华南理工大学 汽车工程学院, 广州 5 6 1 1 4) 0 摘 要 :基于 C R良好的可扩充性 、可移植性和神经 网络极强 的分类 能力,提出了基 于实例 的学 习矢 B 量量化神经网络诊 断方 法。 该方法应用于机械故障诊断系统中 , 可以减小 实例搜索 空间 , 提高

a pidt c a ia f u ig o i s se ( D ,h ann e t r u ni t n p l ame h nc la Ida n ss y t m F S)te l rigv co a t ai e o t e q z o

n r l e wo k h s b n i c r or t o t e CBR y l o i p o e t e e f i c n eu a t r a ee n o p a ed t h n c c e t m r v h f c en y a d i a c r c f h a l di g o i r c s . e i p e e ta d a p ia i t s o hi c u a y o e f u t a n s s p o e s Th m l m n n p l t t c on s ep ft s a p o c r e a l d p r a ha ed t i . e Ke y wor : lar ig v c or u n ia i n n r l e o k c s - a e e s nig; a l dag o i g ds e n n e t a t t eu a t r ; a e b s d r a o n f ut i n s n q z o n w

自组织神经网络

❖

PR

- Rx2 矩阵确定输入范围

❖

Di

- 第i层神经元个数,缺省为5× 8

❖ TFCN

- 拓扑函数,缺省为 'hextop'.

❖ DFCN

- 距离函数,缺省为 'linkdist'.

❖

OLR

- 排序阶段学习率,缺省为0.9.

❖ OSTEPS - 排序阶段最大学习步骤,缺省为1000.

❖

TLR

- 调整阶段学习率,缺省为0.02;

例:LVQ网络的设计

❖ 设定输入样本和期望输出 ❖ 构建并设置网络参数 ❖ 根据训练样本对网络进行训练 ❖ 用训练样本测试网络 ❖ 用新样本测试网络 ❖ 讨论比例的影响

小结

❖ 何谓自组织:没有答案的学习

❖ 自组织竞争神经网络的基本概念

神经元:输入与权值的负距离加上阈值 网络结构:竞争网络 学习方法:Kohonen和阈值学习规则 用途:聚类

❖

TND

- 调整阶段最大学习步骤,缺省为1

例八:SOFM网络的构建和训练

❖ 构建网络 ❖ 设置训练样本 待聚类样本 ❖ 观察训练前网络的状态 ❖ 根据样本进行训练

排序阶段 粗调 调整阶段 细调

❖ 观察训练后网络的状态

例九:一维SOFM网络设计

❖ 输入为二维向量,神经元分布为一维 ❖ 将二维空间的特征映射到一维拓扑结构 ❖ 步骤

* IW 1 ,1 ( q 1 )

若分类不正确:

修正第 i个神经元的权值更远离

该样本

i i - ( p ( q ) i ) * IW 1,1 ( q )

* IW 1 ,1 ( q 1 )

* IW 1 ,1 ( q 1 )

神经网络设计课程教学大纲(可编辑修改word版)

《神经网络设计》课程教学大纲一、课程基本信息课程代码:110437课程名称:神经网络设计英文名称:Neural Network Design课程类别:专业课学时:总学时72 (其中含实验学时:7)学分:3.5适用对象:信息与计算科学、计算机、信息管理、机电工程专业本科考核方式:考试(闭卷)先修课程:高等数学、离散数学、数据结构、计算方法、线性代数二、课程简介人工神经网络模型只是生物神经系统的一种高度简化后的近似。

它是用大量的简单神经元广泛互连成的一种计算结构,属于非线性动力学系统.人工神经网络模型最初是为了探索和复制人脑处理日常事务的能力,例如说话、视觉、信息处理等,同时也有对实际相似的问题的分类且进行比较好的解释。

近一、二十年来,掀起了一次研究人工神经网络的新高潮以来,引起了许多领域科学家的高度重视,由于积极开展了大量研究工作,取得了不少突破性进展, 例如系统控制、数据压缩、模式识别、系统鉴别等方面。

本课程主要介绍人工神经网络原理及其应用,同时给出了大量的实例来加以解释。

Artificial neural networks are computational paradigms which implement simplified models of their biological counterparts,biological neural networks. Artificial neural networks are the local assemblages of neurons and their dendritic connections that form the human brain.It is classified nonlinear dynamic system by mathematics. Although the initial intent of artificial neural networks was to explore and reproduce human information processing tasks such as speech,vision,and knowledge processing,artificial neural networks also demonstrated their superior capability for classification and function approximation problems.During the last two decades artificial neural networks have been studied intensively.Some results are obtained in many demains. This has great potential for solving complex problems such as systems control,data compression,optimization problems,pattern recognition,and system identification. Artificial neural networks theory and its application was introduced in the books and many example are given to explain it theory.三、课程性质与教学目的本课程基于简明易懂、便于软件实现、鼓励探索的原则介绍人工神经网络的基本模型、拓扑结构和特性等。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Ab t a t Ac o dn o t eg n r l e e r i g v co u n iai n ( sr c c r i g t h e e ai d la n n e t rq a t to z z GLVQ )n t r e wo k

a d t a i u — n r y prncp e, a ntop on t a n d g ne a ie e r n ec n he m x m m e t op i i l n e r yቤተ መጻሕፍቲ ባይዱc s r i e e r lz d l a ni g v —

t e p o lm sf rf z y ag rt mso h r b e o u z lo ih f GLVQ e wo kp s e s n t r o s s .M a yi o tn r p r n mp r a tp o e te ft e ECGLVQ e wo k a d is s f c mp tt e la nn lo ih a e g v n is o h n t r n t o t o e ii e r ig ag rt m r ie . v

LEARNI G LG oRI N A TH M

ZH A N G i H ua ZH E N G a N i g ZH A N G uaiFeng Y H aiX i Zh — N n n H — a

( nt ueo I s tt f A1& Roois Yt nd a tn 南… ,x i bt ,, ’ ioo g un c 口 r ( n ;z h a Ma .jl d n Er m] h a @ r xt eu c ) l 7 04 ) 1 0 9

关键词 学 习 矢 量 量 化 , 大 熵 原 理 , 竞 争 学 习 , 格 朗 日乘 子 极 软 拉 TPI 8

中囝 分 类号

EN TROPY— Co NS TRAI ED ENERALI N G ZED LEARN I NG VECTo R

QUANTI ZATI ON NEURAL NETw oRK AND oF C0M PETI I S T T VE

张志华 郑南 宁 张准峰

西安

于海 霞

70 4 ) 10 9

( 安交 通大 学 人工 智 能与 机器 人研 究所 西

( ma ;z h a aa t . d n) E f h a @ ir u e u o l

摘

要

结 台 广 义 学 习矢 量量 化神经 网络 的 思 想和 信 息论 中 的极 大熵 原 理 , 出 了 一种 熵 约 束 提

维普资讯

第 2 8卷 第 2期 20 0 2年 3月

目

动

化

学

报

V 01 28, o.2 . N M a r., 2002

ACTA AU T0M ATI CA N I SI CA

熵 约 束 广 义 学 习 矢 量 量 化 神 经 网 络 和 软 竞 争 学 习算 法 D

t rq a tz to ( o u n ia in ECGLVQ )n u a e wo k i p o o e n t i p p r A e r i g a e r 1n t r s r p s d i hs a e . 1a nn l

g rt m ft e n t r o ih o h e wo k,a g n r l a i n o h o t c mp tt n s h me ( CS ,i e e e a i to ft e s f — o z e ii c e o S ) sd

广 义学 习矢 量 量 化神 经 阿络 , 用梯 度 下 降 法 导 出 其 学 习 算法 , 算 法 是 软 竞 争 格 式 的一 种 推 利 该 广. 由于 亏 损 因 子 和 尺度 函 数 被 定 义 为 同一 个 模 糊 隶 属 度 函 数 , 可 以有 效 地 克 服 广 义学 习矢 它 量 量 化 网络 的模 糊 算 法存 在 的 问 题. 中还 给 出熵 约 束 广 义学 习矢 量 量 化 网络 及 其 软 竞 争学 习 文 算 法 的许 多 重要 性 质 , 此 为依据 , 论 拉格 朗 日乘子 的选 取 规 则 . 讨

T h r by,t e r e f r c o i h g a ee h ul o ho sng t e La r ngi uli le s d s g d. an m tp i r i e i ne

Ke y wor s Le r n e t an ia i n ,m a m um — nt o i c p e,s f o p t— d a ni g v c orqu tz to xi e r py prn i l o tc m e i tv e r ng,La r ngin m uli i ie l a ni ga a tpl er 1 )国 家 自 然 科 学 重 点 基 盘 ( 9 3 0 0 和 博 士 点 专 项 基 盘 ( 8 6 8 5 资 助 6 75 1) 90 9 9 ) 收 稿 日期 1 9 12 9 9 1 9 收 修 改 稿 日期 9 0 70 0 0 0 6

rv d vi he g ade e c ntm e h i e a t r int d s e t od. B c s he 1 S a t n h o r s nd n e au e t O S f c or a d t e c r e po i g s al u c i n a e d fn d a h a e f z y m e b r h p f nc i n ,i a e c m e c i ng f n to r e i e s t e s m u z m e s i u to t c n ov r o