概率为0事件的信源熵

合集下载

2-2 第2章 信源熵及其基本性质和定理

1、信源熵;2、条件熵;3、联合熵 信源熵; 条件熵;

2.1.3 2.1.4 2.1.5 2.1.6

信源熵的基本性质和定理 加权熵的概念及基本性质 平均互信息量 各种熵之间的关系

1

自信息量不能作为信源的信息测度

自信息量 I ( xi ), i = 1,2,... 是指某一信源X发出某一信 息符号 x i 所含有的信息量。发出的信息符号不同, 它们所含有的信息量就不同。

晴 地域A 1/2 地域B 1/2 多云 1/4 1/8 雨 1/8 1/8 冰雹 1/8 1/4

H(A) = H(B) =1.75bit 1 1 2 = log 2 + log 4 + log 8 2 4 8

17

熵函数的性质—— 2. 非负性 熵函数的性质

非负性

H(X ) = H[ p(x1), p(x2 ),L, p(xn )] H(X ) = −∑p(xi ) log p(xi ) ≥ 0

信源熵与平均自信息量数值相等,含义不同

信源熵表征信源的平均不确定度; 平均自信息量是消除信源不确定度所需要的信 息的度量;

信源熵H(X)的三种物理含义:

表示信源输出后,每个离散消息所提供的平均 信息量; 表示信源输出前,信源的平均不确定度; 反映了变量X的随机性。

9

条件熵

定义 2.1.7 联合集XY上,条件自信息量I(x|y)的 概率加权平均值定义为条件熵。其定义式为

f α X 1 + (1 − α ) X 2 < α f ( X 1) + (1 − α ) f ( X 2) ( X 1 ≠ X 2)

则称f(X)为定义域上的下凸函数(Cup型函数)或严格下凸函数。 f(x)是上凸函数 是上凸函数, f(x)便是下凸函数 反过来也成立。 便是下凸函数, 若f(x)是上凸函数,则-f(x)便是下凸函数,反过来也成立。故, 通常只需研究上凸函数

2.1.3 2.1.4 2.1.5 2.1.6

信源熵的基本性质和定理 加权熵的概念及基本性质 平均互信息量 各种熵之间的关系

1

自信息量不能作为信源的信息测度

自信息量 I ( xi ), i = 1,2,... 是指某一信源X发出某一信 息符号 x i 所含有的信息量。发出的信息符号不同, 它们所含有的信息量就不同。

晴 地域A 1/2 地域B 1/2 多云 1/4 1/8 雨 1/8 1/8 冰雹 1/8 1/4

H(A) = H(B) =1.75bit 1 1 2 = log 2 + log 4 + log 8 2 4 8

17

熵函数的性质—— 2. 非负性 熵函数的性质

非负性

H(X ) = H[ p(x1), p(x2 ),L, p(xn )] H(X ) = −∑p(xi ) log p(xi ) ≥ 0

信源熵与平均自信息量数值相等,含义不同

信源熵表征信源的平均不确定度; 平均自信息量是消除信源不确定度所需要的信 息的度量;

信源熵H(X)的三种物理含义:

表示信源输出后,每个离散消息所提供的平均 信息量; 表示信源输出前,信源的平均不确定度; 反映了变量X的随机性。

9

条件熵

定义 2.1.7 联合集XY上,条件自信息量I(x|y)的 概率加权平均值定义为条件熵。其定义式为

f α X 1 + (1 − α ) X 2 < α f ( X 1) + (1 − α ) f ( X 2) ( X 1 ≠ X 2)

则称f(X)为定义域上的下凸函数(Cup型函数)或严格下凸函数。 f(x)是上凸函数 是上凸函数, f(x)便是下凸函数 反过来也成立。 便是下凸函数, 若f(x)是上凸函数,则-f(x)便是下凸函数,反过来也成立。故, 通常只需研究上凸函数

第二章 信源和信息熵

第二章 信源和信息熵

2.1 信源的数学模型及分类

通信系统模型及信息传输模型:

第二章 信源和信息熵

一、离散无记忆信源

例:扔一颗质地均匀的正方体骰子,研究其下落后, 朝上一面的点数。每次试验结果必然是1点、2点、3点、 4点、5点、6点中的某一个面朝上。每次试验只随机出 现其中一种消息,不可能出现这个集合以外的消息, 考察此事件信源的数学模型。

• 平均符号熵就是信源符号序列中平均每个信 源符号所携带的信息量。

• 条件熵≤无条件熵;条件较多的熵≤条件较少 的熵,所以:

第二章 信源和信息熵

离 散 平 稳 信 源 性 质(H1(X)<∞时):

• 条件熵随N的增加是递减的; • 平均符号熵≥条件熵; • 平均符号熵HN(X)随N增加是递减的; • 极限熵

且:I(X1;X2)=I(X2;X1)

第二章 信源和信息熵

注意:任何无源处理总是丢失信息的,至多保持原来 的信息,这是信息不可增性的一种表现。

二、离散平稳信源的极限熵 设信源输出一系列符号序列X1,X2, ‥XN 概率分布: 联合熵:

定义序列的平均符号熵=总和/序列长度,即:

第二章 信源和信息熵

即:收信者所获得的信息量应等于信息传输前 后不确定性的减少的量。

例:设一条电线上串联8个灯泡,且损坏的可 能性为等概,若仅有一个坏灯泡,须获知多少 信息量才可确认?

第二章 信源和信息熵

例解:

测量前,P1(x)=1/8,存在不确定性: I(P1(x))=log8=3bit

第一次测量获得信息量: 第二次测量获得信息量: 第三次测量获得信息量: 每次测量获得1bit信息量,需三次测量可确定坏灯泡

例:运用熵函数的递增性,计算熵函数 H(1/3,1/3,1/6,1/6)的数值。

信源熵2

H (Y / X ) E[ I ( y j / xi )] p( xi y j ) log 2

பைடு நூலகம்

1 p ( y j / xi )

• 思考:这里为什么使用联合概率呢?

条件熵(续)

• 信道疑义度—H(X/Y)

–表示信宿在收到Y后,信源X仍然存在的不确定 度。是通过有噪信道传输后引起的信息量的损 失,是传输失真造成的,故也可称为损失熵。

– X1:表示摸出的是红球 – X2:表示摸出的是白球 – 根据熵的定义可知:

信源熵的物理意义

• 信源熵H(X)是表示信源输出后每个消 息(或符号)所提供的平均信息量 • 信源熵H(X)表示信源输出前,信源的 平均不确定性 • 信源熵H(X)可表征随机变量X的随机 性

– 如下例,变量Y取y1和y2是等概率的,所以 其随机性大。而变量X取x1的概率比取x2的 概率大很多,这时变量X的随机性就小。因 此H(X)反映了随机变量的随机性。

• 噪声熵—H(Y/X)

–表示在已知X的条件下,对于符号集Y尚存在的 不确定性(疑义),这完全是由于信道中噪声 引起的。

联合熵

• 定义:

–是联合离散符号集合XY上的每个元素对的联合 自信息量的数学期望,也叫共熵。用H(XY)表示。

H ( XY ) E[ I ( xi y j )] p( xi y j )log 2

1 p ( xi )

] p( xi ) log

i 1

1 p ( xi )

信源熵—平均自信息量(续)

• 信息熵的单位

– 取决于对数底的选取。一般地,计算选用以2为底, 其单位为比特/符号;理论推导选用以e为底。

• 信息熵的意义:

– 信源的信息熵是从整个信源的统计特性来考虑的。 它是从平均意义上来表征信源的总体特性的。对于 某特定的信源,其信息熵只有一个。不同的信源因 其统计特性不同,其熵也不同。

第2讲-信源熵

基本内容

• 二元信源是应用广泛且容易分析的一类信 源,我们会讨论二元联合信源的联合熵, 条件熵,离散平稳信源的信源熵和极限熵。 马尔可夫信源是一类符号具有相关性,且 能精确计算其信源熵的离散信源,我们讨 论该信源的定义及计算方法。信源如不是 理想的,则必定有冗余,我们简单介绍了 冗余度的定义及如果使用。与离散信源对 偶的是连续信源,我们讨论了具有实用意 义的三种特定连续信源的最大熵,并引出 熵功率的概念。

• (3) 发生概率小的事件其不确定性应比发生概率大的 事件不确定性大

信息量的直观定义:

收到某消息获得的信息量=不确定性减少的量 =(收到此消息前关于某事件发生的不确定性) -(收到此消息后关于某事件发生的不确定性) 在无噪声时,通过信道的传输,可以完全不失真地收到所 发的消息,收到此消息后关于某事件发生的不确定性完全 消除,此项为零。因此得 收到某消息获得的信息量 =收到此消息前关于某事件发生的不确定性 =信源输出的某消息中所含有的信息量

yj:功率为j的电阻 p(yj):选取出功率为j的电阻的概率 假设q种不同功率的选择也是等概率的,则被告知“选取出 功率为j的电阻”所获得的信息量为

I ( y j ) f [ p( y j )] f [ 1 q]

这两个函数

1 应该是同一类函数 f[1 ] 和 f [ p q]

再设在第三个布袋中,放入p种不同阻值,而每一种阻值又有q种不同 功率的电阻,即共有p· q个电阻。 设它们的选取也是等可能性的,其概率空间为

哪个符号都是随机的,而且一般前后符号之间是有依赖关系的。可用 随机矢量描述。

② 连续信源:输出连续消息。可用随机过程描述。

(2) 单符号离散信源数学模型

单符号离散信源的数学模型就是离散型的概率空间:

第2章 信源与信源熵(1)

2016年5月29日7时35 分 13

表述有记忆信源要比表述无记忆信源困 难得多。实际上信源发出的符号往往只与前 面几个符号的依赖关系较强,而与更前面的 符号依赖关系就弱。为此可以限制随机序列 的记忆长度。 当记忆长度为m+1时,称这种有记忆信源 为m阶马尔可夫信源。也就是信源所发出的符 号只与前m个符号有关,与更前面的符号无关。

2016年5月29日7时35 分 6

(二)离散信源的度量 §2.1 信源的数学模型及其分类 正如绪论中所述,在通信系统中收信 者在未收到消息以前,对信源发出 什么消息是不确定的,所以可用随 机变量或随机矢量来描述信源输出 的消息。或者说,用概率空间来描 述信源。 离散信源的数学模型就是离散型的概 率空间:

这个I(ai)也就是ai本身所含有的信息量,即能

提供的全部信息量,我们称之为ai 的“自信息 量”。

2016年5月29日7时35 分 18

根据上述的一般原则,就可有:

I(ai)=收到ai前,收信者对信源发ai的不确 定性。 这就是说,信源符号 ai 的自信息量,在 数量上等于信源发符号 ai 的不确定性。 ai 的 度量问题,就转变为信源发符号 ai 的不确定 性的度量问题。 我们知道,不确定性是与可能性相联系 的,而可能性又可由概率的大小来表示.所 以可以断言,自信息量I(ai)一定是信源发符 号ai的先验概率p(ai)的某一函数。

来描述,其中N可为有限正整数或可数的无限值。

2016年5月29日7时35 分

10

在上述随机矢量中,若每个随机变量

x i (i 1,2, , N )

都是离散的,则可用 N重离散概率空间来描述 这类信源。 即若N维随机矢量 X ( x1 , x 2 , , x N ) 中

表述有记忆信源要比表述无记忆信源困 难得多。实际上信源发出的符号往往只与前 面几个符号的依赖关系较强,而与更前面的 符号依赖关系就弱。为此可以限制随机序列 的记忆长度。 当记忆长度为m+1时,称这种有记忆信源 为m阶马尔可夫信源。也就是信源所发出的符 号只与前m个符号有关,与更前面的符号无关。

2016年5月29日7时35 分 6

(二)离散信源的度量 §2.1 信源的数学模型及其分类 正如绪论中所述,在通信系统中收信 者在未收到消息以前,对信源发出 什么消息是不确定的,所以可用随 机变量或随机矢量来描述信源输出 的消息。或者说,用概率空间来描 述信源。 离散信源的数学模型就是离散型的概 率空间:

这个I(ai)也就是ai本身所含有的信息量,即能

提供的全部信息量,我们称之为ai 的“自信息 量”。

2016年5月29日7时35 分 18

根据上述的一般原则,就可有:

I(ai)=收到ai前,收信者对信源发ai的不确 定性。 这就是说,信源符号 ai 的自信息量,在 数量上等于信源发符号 ai 的不确定性。 ai 的 度量问题,就转变为信源发符号 ai 的不确定 性的度量问题。 我们知道,不确定性是与可能性相联系 的,而可能性又可由概率的大小来表示.所 以可以断言,自信息量I(ai)一定是信源发符 号ai的先验概率p(ai)的某一函数。

来描述,其中N可为有限正整数或可数的无限值。

2016年5月29日7时35 分

10

在上述随机矢量中,若每个随机变量

x i (i 1,2, , N )

都是离散的,则可用 N重离散概率空间来描述 这类信源。 即若N维随机矢量 X ( x1 , x 2 , , x N ) 中

信息熵的基本性质

pi pij log pi

pi pij log pij

i 1 j 1

i 1 j 1

nm

n

m

( pij ) pi log pi pi pij log pij

i1 j 1

i 1

j 1

n

n

m

pi log pi pi ( pij log pij )

电子信息工程学院

H ( p1, p2,, pq ) H ( p2, p3,, pq , p1) H ( pq , p1,, pq1)

电子信息工程学院

信息论

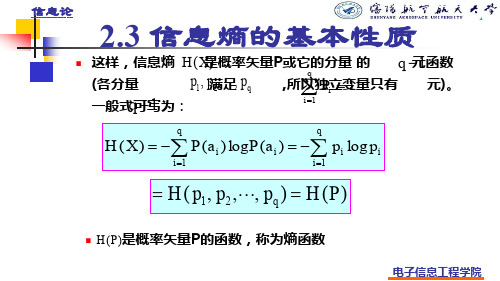

2.3 信息熵的基本性质

该性质表明:熵只与随机变量的总体结构有关,即与信源的总

体的统计特性有关。

X / 6

a3 1/ 2

,

Y P

a1 1/ 6

a2 1/ 2

a3 1/ 3

,

Z P

b1 1/ 3

b2 1/ 2

b3 1/ 6

差别:信源X与Y同一消息的概率不同,X与Z的具体信息不同,但 它们的信息熵相同,表示三个信源总的统计特性相同,它们的信 息数和总体结构是相同的。即:

该性质是非常明显的,因为随机变量X的所有取值的概率 分布满足0 pi 时 1,熵是正值的,只有当随机变量是确知量 时,其熵等于零。

这种非负性对于离散信源而言是正确的,但对于连续信源 来说这一性质就不一定存在。以后可以看到,在差熵的概 念下,可能出现负值。

电子信息工程学院

信息论

2.3 信息熵的基本性质

pi log

pi

0

。而其余分量

pi

0(i

j), lim p j 0

第2章信源熵--马尔科夫信源及极限熵

“基于马尔可夫链的我国城乡居民收入演进分析”

信源熵

四、马尔科夫信源及其极限熵

1、马尔科夫信源

定义

N维离散平稳信源符号序列中第N个符号只与前m (≤N-1)个符号相关,该信源为m阶马尔科夫信源。

马尔科夫信源是离散平稳有限记忆信源,其记忆 长度为m 。* m阶马尔科夫信源符号序列的长度N=m+1。

信源熵

信源熵

中华人民共和国

中国

*华人民*和国

*国

信源熵 抽象描述

实际信源抽象为N维离散平稳信源,H∞是其熵率, 即从理论上看,只要传送H∞就可以了。 但是这必须掌握信源的全部统计特性,这显然是 不现实的。实际中,只能掌握有限记忆长度m, 其熵率用Hm+1近似,即需要传送Hm+1 与理论值相比,多传送了Hm+1-H∞ 由于Hm+1>H∞,表现在信息传输上存在冗余。

信源熵

0.2P(s1 ) 0.5P(s3 ) 0 0.2P(s1 ) P(s 2 ) 0.5P(s3 ) 0 0.5P(s 2 ) P(s3 ) 0.2P(s 4 ) 0 0.5P(s 2 ) 0.2P(s 4 ) 0

完备性

P(s1 ) P(s2 ) P(s3 ) P(s4 ) 1

信源熵

定义

信源的m阶极限熵Hm+1与N-1阶极限熵H∞的相对差 为该信源的冗余度,也叫剩余度。

信源熵

马尔可夫链的应用 排队理论和统计学中的建模,还可作为信号模型用 于熵编码技术,如算术编码 著名的LZMA数据压缩算法就使用了马尔可夫链与 类似于算术编码的区间编码。 生物学应用, 人口过程,可以帮助模拟生物人口过程的建模。 隐蔽马尔可夫模型还被用于生物信息学,用以编 码区域或基因预测。 马尔可夫链最近的应用是在地理统计学 (geostatistics)中,被称为是“马尔可夫链地理 统计学”。仍在发展过程中。

信源熵

四、马尔科夫信源及其极限熵

1、马尔科夫信源

定义

N维离散平稳信源符号序列中第N个符号只与前m (≤N-1)个符号相关,该信源为m阶马尔科夫信源。

马尔科夫信源是离散平稳有限记忆信源,其记忆 长度为m 。* m阶马尔科夫信源符号序列的长度N=m+1。

信源熵

信源熵

中华人民共和国

中国

*华人民*和国

*国

信源熵 抽象描述

实际信源抽象为N维离散平稳信源,H∞是其熵率, 即从理论上看,只要传送H∞就可以了。 但是这必须掌握信源的全部统计特性,这显然是 不现实的。实际中,只能掌握有限记忆长度m, 其熵率用Hm+1近似,即需要传送Hm+1 与理论值相比,多传送了Hm+1-H∞ 由于Hm+1>H∞,表现在信息传输上存在冗余。

信源熵

0.2P(s1 ) 0.5P(s3 ) 0 0.2P(s1 ) P(s 2 ) 0.5P(s3 ) 0 0.5P(s 2 ) P(s3 ) 0.2P(s 4 ) 0 0.5P(s 2 ) 0.2P(s 4 ) 0

完备性

P(s1 ) P(s2 ) P(s3 ) P(s4 ) 1

信源熵

定义

信源的m阶极限熵Hm+1与N-1阶极限熵H∞的相对差 为该信源的冗余度,也叫剩余度。

信源熵

马尔可夫链的应用 排队理论和统计学中的建模,还可作为信号模型用 于熵编码技术,如算术编码 著名的LZMA数据压缩算法就使用了马尔可夫链与 类似于算术编码的区间编码。 生物学应用, 人口过程,可以帮助模拟生物人口过程的建模。 隐蔽马尔可夫模型还被用于生物信息学,用以编 码区域或基因预测。 马尔可夫链最近的应用是在地理统计学 (geostatistics)中,被称为是“马尔可夫链地理 统计学”。仍在发展过程中。

信源与信源熵4

11

• 信源的序列熵

9 2 H (Χ) H ( X ) p(ai )log p (ai ) 3bit / 序列 i 1

• 平均每个符号(消息)熵为

1 H 2 (X) H (X) 1.5bit / 符号 2

12

2.3 离散序列信源熵

• 2.3.1 离散无记忆信源的序列熵 • 2.3.2 离散有记忆信源的序列熵

{

{发出符号序列的无记忆信源 发出符号序列的有记忆信源 { 发出符号序列的马尔可夫信源

发出单个符号的无记忆信源

4

离散无记忆信源的序列熵

• 发出单个符号的信源

X 1 2 3 4 5 6 P 1 / 6 1 / 6 1 / 6 1 / 6 1 / 6 1 / 6

• 当前后符号无依存关系时,有下列推论:

H ( X1 , X 2 ) H ( X1 ) H ( X 2 ) H ( X 1 | X 2 ) H ( X 1 ), H ( X 2 | X 1 ) H ( X 2 )

14

• 若信源输出一个L长序列,则信源的序列熵为 H ( X ) H ( X 1 , X 2 , , X L ) H ( X 1 ) H ( X 2 | X 1 ) H ( X L | X L 1 , , X 1 )

a1

a2

a0

1/4

a1

1/18

a2

0

1/18

0

1/3

1/18

1/18 7/36

H(X2| X1)<H(X1) H ( X ) H ( X 1 ) p(ai ) log p(ai ) 1.543bit信源的条件熵比无依 / 符号 赖时的熵H(X)减少了 i 0 0.671 比 特 , 这 正 是 因 为符号之间有依赖性 所造成的结果。 • 当考虑符号之间有依赖性时,计算得条件熵