信息论考试卷及答案

信息论试卷含答案资料讲解

《信息论基础》参考答案一、填空题(共15分,每空1分)1、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。

2、信源的剩余度主要来自两个方面,一是信源符号间的相关性,二是信源符号的统计不均匀性。

3、三进制信源的最小熵为0,最大熵为32log bit/符号。

4、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r (S))。

5、当R=C 或(信道剩余度为0)时,信源与信道达到匹配。

6、根据信道特性是否随时间变化,信道可以分为恒参信道和随参信道。

7、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。

8、若连续信源输出信号的平均功率为2σ,则输出信号幅度的概率密度是高斯分布或正态分布或()222x f x σ-=时,信源具有最大熵,其值为值21log 22e πσ。

9、在下面空格中选择填入数学符号“,,,=≥≤〉”或“〈”(1)当X 和Y 相互独立时,H (XY )=H(X)+H(X/Y)=H(Y)+H(X)。

(2)()()1222H X X H X =≥()()12333H X X X H X = (3)假设信道输入用X 表示,信道输出用Y 表示。

在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y)<H(X)。

二、(6分)若连续信源输出的幅度被限定在【2,6】区域内,当输出信号的概率密度是均匀分布时,计算该信源的相对熵,并说明该信源的绝对熵为多少。

()1,2640,x f x ⎧≤≤⎪=⎨⎪⎩Q 其它()()()62log f x f x dx ∴=-⎰相对熵h x=2bit/自由度该信源的绝对熵为无穷大。

三、(16分)已知信源1234560.20.20.20.20.10.1S s s s s s s P ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦(1)用霍夫曼编码法编成二进制变长码;(6分) (2)计算平均码长L ;(4分)(3)计算编码信息率R ';(2分)(4)计算编码后信息传输率R ;(2分) (5)计算编码效率η。

信息论基础理论与应用考试题及答案

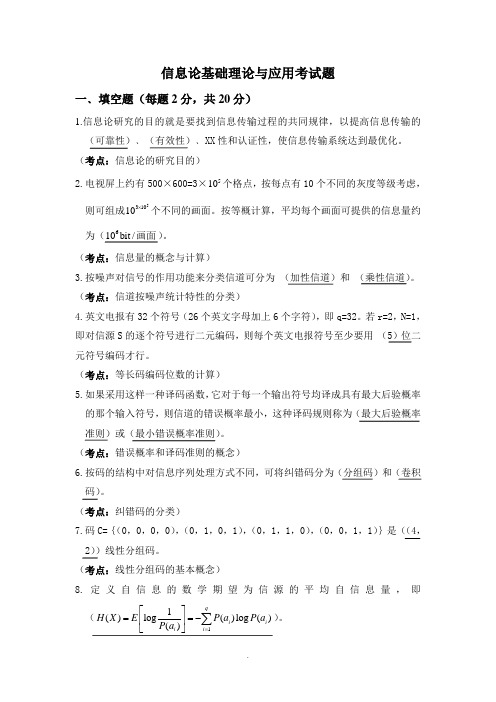

信息论基础理论与应用考试题一﹑填空题(每题2分,共20分)1.信息论研究的目的就是要找到信息传输过程的共同规律,以提高信息传输的 (可靠性)﹑(有效性)﹑XX 性和认证性,使信息传输系统达到最优化。

(考点:信息论的研究目的)2.电视屏上约有500×600=3×510个格点,按每点有10个不同的灰度等级考虑,则可组成531010⨯个不同的画面。

按等概计算,平均每个画面可提供的信息量约为(610bit /画面)。

(考点:信息量的概念与计算)3.按噪声对信号的作用功能来分类信道可分为 (加性信道)和 (乘性信道)。

(考点:信道按噪声统计特性的分类)4.英文电报有32个符号(26个英文字母加上6个字符),即q=32。

若r=2,N=1,即对信源S 的逐个符号进行二元编码,则每个英文电报符号至少要用 (5)位二元符号编码才行。

(考点:等长码编码位数的计算)5.如果采用这样一种译码函数,它对于每一个输出符号均译成具有最大后验概率的那个输入符号,则信道的错误概率最小,这种译码规则称为(最大后验概率准则)或(最小错误概率准则)。

(考点:错误概率和译码准则的概念)6.按码的结构中对信息序列处理方式不同,可将纠错码分为(分组码)和(卷积码)。

(考点:纠错码的分类)7.码C={(0,0,0,0),(0,1,0,1),(0,1,1,0),(0,0,1,1)}是((4,2))线性分组码。

(考点:线性分组码的基本概念)8.定义自信息的数学期望为信源的平均自信息量,即(11()log ()log ()()q i i i i H X E P a P a P a =⎡⎤==-⎢⎥⎣⎦∑)。

(考点:平均信息量的定义)9.对于一个(n,k)分组码,其最小距离为d,那么,若能纠正t个随机错误,同时能检测e(e≥t)个随机错误,则要求(d≥t+e+1)。

(考点:线性分组码的纠检错能力概念)10.和离散信道一样,对于固定的连续信道和波形信道都有一个最大的信息传输速率,称之为(信道容量)。

信息论与编码试卷及答案(多篇)

一、概念简答题(每题5分,共40分)1.什么是平均自信息量与平均互信息,比较一下这两个概念的异同?答:平均自信息为表示信源的平均不确定度,也表示平均每个信源消息所提供的信息量。

平均互信息表示从Y获得的关于每个X的平均信息量,也表示发X前后Y的平均不确定性减少的量,还表示通信前后整个系统不确定性减少的量。

2.简述最大离散熵定理。

对于一个有m个符号的离散信源,其最大熵是多少?答:最大离散熵定理为:离散无记忆信源,等概率分布时熵最大。

最大熵值为。

3.解释信息传输率、信道容量、最佳输入分布的概念,说明平均互信息与信源的概率分布、信道的传递概率间分别是什么关系?答:信息传输率R指信道中平均每个符号所能传送的信息量。

信道容量是一个信道所能达到的最大信息传输率。

信息传输率达到信道容量时所对应的输入概率分布称为最佳输入概率分布。

平均互信息是信源概率分布的∩型凸函数,是信道传递概率的U型凸函数。

4.对于一个一般的通信系统,试给出其系统模型框图,并结合此图,解释数据处理定理。

答:通信系统模型如下:数据处理定理为:串联信道的输入输出X、Y、Z组成一个马尔可夫链,且有,。

说明经数据处理后,一般只会增加信息的损失。

5.写出香农公式,并说明其物理意义。

当信道带宽为5000Hz,信噪比为30dB时求信道容量。

.答:香农公式为,它是高斯加性白噪声信道在单位时间内的信道容量,其值取决于信噪比和带宽。

由得,则6.解释无失真变长信源编码定理。

.答:只要,当N足够长时,一定存在一种无失真编码。

7.解释有噪信道编码定理。

答:当R<C时,只要码长足够长,一定能找到一种编码方法和译码规则,使译码错误概率无穷小。

8.什么是保真度准则?对二元信源,其失真矩阵,求a>0时率失真函数的和?答:1)保真度准则为:平均失真度不大于允许的失真度。

2)因为失真矩阵中每行都有一个0,所以有,而。

二、综合题(每题10分,共60分)1.黑白气象传真图的消息只有黑色和白色两种,求:1)黑色出现的概率为0.3,白色出现的概率为0.7。

《信息论》期末考试试题( 卷)标准答案

。

4) R(D)是满足 D 准则下平均传送每信源符号的所需的最少比特数,它是定义域 上的严格递减函数。

5) AWGN 信道下实现可靠通信的信噪比下界为-1.59dB,此时对应的频谱利用率 为 0。

6)若某离散无记忆信源有 N 个符号,并且每个符号等概出现,对这个信源进行 二元 Huffman 编码,当 N = 2i (i 是正整数)时,每个码字的长度是 i ,平 均码长是 i 。

2 1) 求此马氏源的平稳分布;(4 分) 2) 求此马氏源的熵;(3 分) 3)求平稳马氏源的二次扩展源的所有符号概率;(3 分) 4)对此二次扩展源进行二元 Huffman 编码并求编码后平均码长和编码效率。 (3+2 分)

解:

1) 此马氏源的平稳分布: (π1

π2

π3

) =(1 3

1 3

1 3

)

3 × 1 × (− 1 log 1 − 1 log 1 − 1 log 1) = 1.5比特/信源符号 2) 此马氏源的熵: 3 2 2 4 4 4 4

3)平稳马氏源的二次扩展源的所有符号及概率为: p(x1x2 ) = p(x1 ) p(x2 x1)

1 00: 6

1 11: 6

1 22: 6

编码效率为: l 19

2.(共 10 分)有两枚硬币,第一枚是正常的硬币,它的一面是国徽,另一面是 面值;第二枚是不正常的硬币,它的两面都是面值。现随机地抽取一枚硬币,进 行 2 次抛掷试验,观察硬币朝上的一面,其结果为:面值、面值。

1)求该试验结果与事件“取出的是第一枚硬币”之间的互信息;(4 分)

1) 求该信道的信道容量;(2 分)

2) 当传输速率达到容量时,确定 M 与 n 的关系。(2 分)

信息论试题

信息论试题一、选择题1. 信息论的创始人是()。

A. 克劳德·香农B. 艾伦·图灵C. 约翰·冯·诺伊曼D. 阿兰·麦席森2. 下列哪个选项是信息论中信息熵的计算公式?()。

A. H(X) = -ΣP(x)log_2P(x)B. H(X) = ΣP(x)xC. H(X) = 1/ΣP(x)D. H(X) = log_2(1/P(x))3. 在信息论中,互信息用于衡量两个随机变量之间的()。

A. 独立性B. 相关性C. 非线性D. 周期性4. 以下哪个不是信息论的应用领域?()。

A. 通信系统B. 密码学C. 机器学习D. 生物遗传学5. 香农极限是指()。

A. 信息传输的最大速率B. 信息压缩的最小冗余度C. 信道容量的理论上限D. 编码长度的最优解二、填空题1. 信息论中的信息熵是衡量信息的不确定性或________的度量。

2. 互信息表示两个随机变量之间共享的信息量,它是衡量两个变量之间________的指标。

3. 香农在1948年发表的论文《________》奠定了信息论的基础。

4. 在数字通信中,信道容量可以通过公式________来计算。

5. 信息论不仅在通信领域有广泛应用,它还对________、数据分析等产生了深远影响。

三、简答题1. 简述信息论的基本原理及其在现代通信中的作用。

2. 描述香农信息论中的主要概念及其相互之间的关系。

3. 说明信息论如何应用于数据压缩技术,并给出一个实际例子。

4. 讨论信息论对于密码学和信息安全的贡献。

四、论述题1. 论述信息论对于人工智能和机器学习领域的影响及其潜在的应用前景。

2. 分析信息论在生物信息学中的应用,以及如何帮助我们更好地理解生物系统的复杂性。

3. 探讨信息论在社会网络分析中的应用,以及它如何帮助我们理解和预测社会行为模式。

4. 评述信息论在量子通信和量子计算中的潜在作用及其对未来科技发展的意义。

信息论典型试题及答案

第五章

5.1将下表所列的信源进行六种不同的二进制编码。

(1)求这些码中哪些是惟一可译码。

(2)哪些码是非延长码

(3)对所有惟一可译码求出其平均码长 。

消息

C1

C2

C3

C4

C5

C6

1/2

000

0

0

0

0

0

1/4

001

01

10

10

10

100

1/16

010

011

110

110

1100

101

27.能够描述无失真信源编码定理

例1:.黑白气象传真图的消息只有黑色和白色两种,求:

1)黑色出现的概率为0.3,白色出现的概率为0.7。给出这个只有两个符号的信源X的数学模型。假设图上黑白消息出现前后没有关联,求熵H(X);

2)假设黑白消息出现前后有关联,其依赖关系为:P(白/白)=0.9,P(黑/白)=0.1,P(白/黑)=0.2,P(黑/黑)=0.8,求其熵H2(X);

10.互信息的性质是什么?

11.熵的表达式、单位、含义是什么?

12.单符号离散信源最大熵是多少?信源概率如何分布时能达到?

13.熵的性质是什么?

14.联合熵、条件熵和熵的关系。

15.平均互信息的定义是什么?平均互信息的表达式怎么推导?

16.平均互信息的含义?

17.信道疑义度、损失熵和噪声熵的含义?

18.平均互信息的性质?(能够证明,并说明每个性质的含义)

解:

由题意可知该二元信道的转移概率矩阵为:

为一个BSC信道

所以由BSC信道的信道容量计算公式得到:

3.14电视图像编码中,若每帧为500行,每行划分为600个像素,每个像素采用8电平量化,且每秒传送30帧图像。试求所需的信息速率(bit/s)。

信息论与编码考题标准答案

信 息 论 与 编 码 考题与标准答案第一题 选择题1.信息是( b )a. 是事物运动状态或存在方式的描述b.是事物运动状态或存在方式的不确定性的描述c.消息、文字、图象d.信号 2.下列表达式哪一个是正确的(e )a. H (X /Y )=H (Y /X )b. )();(0Y H Y X I <≤c.)/()(),(X Y H X H Y X I -=d. )()/(Y H Y X H ≤e. H (XY )=H (X )+H (Y /X )3.离散信源序列长度为L ,其序列熵可以表示为( b )a. )()(1X LH X H =b.c. ∑==Ll lXH X H 1)()(d. )()(X H X H L =4.若代表信源的N 维随机变量的取值被限制在一定的范围之内,则连续信源为( c ),具有最大熵。

a. 指数分布b. 正态分布c. 均匀分布d. 泊松分布 5.对于平均互信息);(Y X I ,下列说法正确的是( b )a. 当)(i x p 一定时,是信道传递概率)(i j x y p 的上凸函数,存在极大值b. 当)(i x p 一定时,是信道传递概率)(i j x y p 的下凸函数,存在极小值c.当)(i j x y p 一定时,是先验概率)(i x p 的上凸函数,存在极小值d.当)(i j x y p 一定时,是先验概率)(i x p 的下凸函数,存在极小值 6.当信道输入呈( c )分布时,强对称离散信道能够传输最大的平均信息量,即达到信道容量 a. 均匀分布 b. 固定分布 c. 等概率分布 d. 正态分布7.当信道为高斯加性连续信道时,可以通过以下哪些方法提高抗干扰性(b d ) a. 减小带宽 b. 增大发射功率 c. 减小发射功率 d.增加带宽第二题 设信源 ⎥⎦⎤⎢⎣⎡=⎥⎦⎤⎢⎣⎡6.04.0)(21x x X p X 通过一干扰信道,接收符号为Y={y 1,y 2},信道传递矩阵为⎥⎦⎤⎢⎣⎡43416165 求:(1) 信源 X 中事件 x 1 和 x 2 分别含有的自信息量。

信息论典型试题及答案

3.1设有一个信源,它产生0,1序列的信息。它在任意时间而且不论以前发生过什么符号,均按P(0) = 0.4,P(1) = 0.6的概率发出符号。

(1)试问这个信源是否是平稳的?

(2)试计算H(X2),H(X3/X1X2)及H∞;

(3)试计算H(X4)并写出X4信源中可能有的所有符号。

解:

(1)这个信源是平稳无记忆信源。因为有这些词语:“它在任意时间而且不论以前发生过什么符号……”

(1)计算接收端的平均不确定性;

(2)计算由于噪声产生的不确定性H(Y/X);

解:(1)

(2)

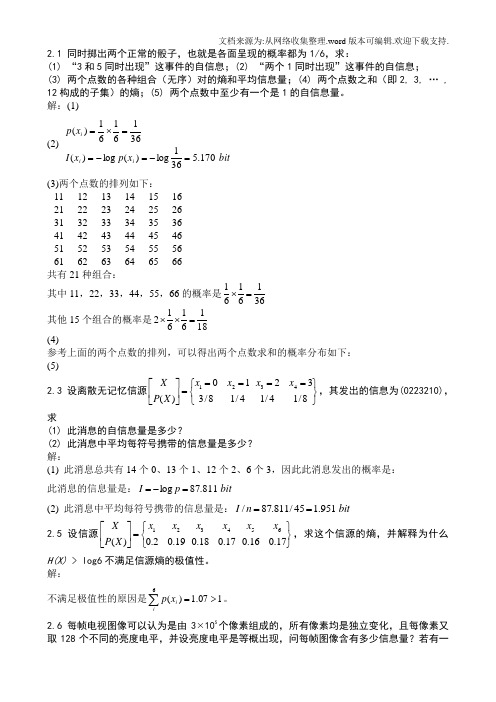

(3)两个点数的排列如下:

11

12

13

14

15

16

21

22

23

24

25

26

31

32

33

34

35

36

41

42

43

44

45

46

51

52

53

54

55

56

61

62

63

64

65

66

共有21种组合:

其中11,22,33,44,55,66的概率是

其他15个组合的概率是

(4)

参考上面的两个点数的排列,可以得出两个点数求和的概 Nhomakorabea分布如下:

解:

(1)

(2)黑白气象传真图的消息前后有关联时,由其前后的依赖关系可知,黑色白色同时出现的联合概率为:

则信源的联合熵为:

H(X1X2)=1.426bit/symbol

H2(X)=1/2*H(X1X2)=0.713 bit/symbol

(3)上述两种信源的剩余度分别为:

《信息论》期末考试B卷答案

北方民族大学试卷课程代码: 01100622 课程:信息理论及编码B 卷答案:号学说明:此卷为《信息理论及编码》B 卷答案一、概念简答题(每小题6分,共30分)1、比较平均自信息(信源熵)与平均互信息的异同。

题试试考末期期学季 秋 年学- —80名姓班级业专程工息信院学程工息信气电线 - q- 答:平均自信息为 H X - -7 p q log p q ,表示信源的平均不确定度,也表示平-i 4-均每个信源消息所提供的信息量。

........................... (3分)平均互信息I X;Y P xy logX,Y。

表示从Y 获得的关于每个 X 的平均信息量,也表示发X 前后Y 的平均不确定性减少的量,还表示通信前后整个系统不确定性减少的量。

(3分)2、简述香农第一定理。

- 答:对于离散信源 S 进行r 元编码,只要其满足L N_匕^, ..................................... (3分)-N log r- 当N 足够长,总可以实现无失真编码。

............................. (3分) 密3、简述唯一可译变长码的判断方法?- 答:将码C 中所有可能的尾随后缀组成一个集合F ,当且仅当集合 F 中没有包含任一码字-时,码C 为唯一可译变长码。

构成集合 F 的方法: ............. (2分) 首先,观察码C 中最短的码字是否是其他码字的前缀。

若是,将其所有可能的尾随后缀排 列出。

而这些尾随后缀又可能是某些码字的前缀, 再将由这些尾随后缀产生的新的尾随后缀列出。

依此下去,直至没有一个尾随后缀是码字的前缀或没有新的尾随后缀产生为止。

.............(2分)接着,按照上述步骤将次短的码字直至所有码字可能产生的尾随后缀全部列出, 得到尾随后缀集合F 。

............. (2分) 4、简述最大离散熵定理。

信息论考题及答案

一、(25分)如果X 和Y 相互独立,证明X 和Y 的熵满足可加性,即 H(Y)H(X)Y)H(X,+= 证明:设P(x,y)=P(x)P(y),则有1H(X,Y)()()logP()()11()()log()()log ()()11()log()log ()()()()xyxyxy xy P x P y x P y P x P y P x P y P x P y P x P y P x P y H X H Y ==+=+=+∑∑∑∑∑二、(50分)联合总体X ,Y 具有如下联合分布。

XY分别计算(1) 联合熵H(X,Y)是多少? (2)边缘熵H(X)和H(Y)是多少?(3)对于每一个y 值,条件熵H(X ︱y)是多少? (4)条件熵H(X ︱Y)是多少? (5)X 和Y 之间的互信息是多少? 解答:(1) H(X,Y)=3.375(2) H(X)=2, H(Y)=1.75(3) H(X|y=1)=2,H(X|y=1)=1.875,H(X|y=1)=1.875, H(X|y=4)=0.5(4)H(X|Y)=1.1264(5)I(X;Y)=H(X)-H(X|Y)=2-1.1264=0.8736 三、(25分)考虑一个差错概率为f=0.15的二进制对称信道。

输入总体为x Ω:{0P =0.9,1p =0.1},假设观察到y=1,请计算(1|1)P x y ==? 解:(1|1)P x y ===(1|1)(1)(1|)()xP y x P x P y x P x ===∑==9.015.01.085.01.085.0⨯+⨯⨯=22.0085.0=0.39一、(25分)如果X 和Y 相互独立,证明X 和Y 的熵满足可加性,即 H(Y)H(X)Y)H(X,+=二、(50分)联合总体X ,Y 具有如下联合分布。

XY分别计算(1) 联合熵H(X,Y)是多少? (2)边缘熵H(X)和H(Y)是多少?(3)对于每一个y 值,条件熵H(X ︱y)是多少? (4)条件熵H(X ︱Y)是多少? (5)X 和Y 之间的互信息是多少?三、(25分)考虑一个差错概率为f=0.15的二进制对称信道。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

考试科目名称:信息论一. 单选(每空2分,共20分)1.信道编码的目的是(C ),加密编码的目的是(D )。

A.保证无失真传输B.压缩信源的冗余度,提高通信有效性C.提高信息传输的可靠性D.提高通信系统的安全性2.下列各量不一定为正值的是(D )A.信源熵B.自信息量C.信宿熵D.互信息量3.下列各图所示信道是有噪无损信道的是(B )A.B.C.D.4.下表中符合等长编码的是( A )5.联合熵H(XY)与熵H(X)及条件熵H(X/Y)之间存在关系正确的是(A )A.H(XY)=H(X)+H(Y/X)B.H(XY)=H(X)+H(X/Y)C.H(XY)=H(Y)+H(X)D.若X和Y相互独立,H(Y)=H(YX)6.一个n位的二进制数,该数的每一位可从等概率出现的二进制码元(0,1)中任取一个,这个n位的二进制数的自信息量为(C )A.n2B.1 bitC.n bitnD.27.已知发送26个英文字母和空格,其最大信源熵为H0 = log27 = 4.76比特/符号;在字母发送概率不等时,其信源熵为H1 = 4.03比特/符号;考虑字母之间相关性时,其信源熵为H2 = 3.32比特/符号;以此类推,极限熵H=1.5比特/符号。

问若用一般传送方式,冗余度为( B )∞A.0.32B.0.68C .0.63D .0.378. 某对称离散信道的信道矩阵为 ,信道容量为( B )A .)61,61,31,31(24log H C -= B .)61,61,31,31(4log H C -= C .)61,61,31,31(2log H C -= D .)61,31(2log H C -= 9. 下面不属于最佳变长编码的是( D )A .香农编码和哈夫曼编码B .费诺编码和哈夫曼编码C .费诺编码和香农编码D .算术编码和游程编码二. 综合(共80分)1. (10分)试写出信源编码的分类,并叙述各种分类编码的概念和特性。

(1分)将信源消息分成若干组,即符号序列xi , xi =(xi1xi2…xil …xiL),{非分组码 分组码{奇异码 非奇异码{非唯一可译码 唯一可译码{非即时码即时码(非延长码)码(5分)xil A={a1,a2,…,ai,…,an}每个符号序列xi依照固定码表映射成一个码字yi,yi=(yi1yi2…yil…yiL),yil B={b1,b2,…,bi,…,bm}这样的码称为分组码,有时也叫块码。

只有分组码才有对应的码表,而非分组码中则不存在码表。

(1分)奇异码和非奇异码若信源符号和码字是一一对应的,则该码为非奇异码。

反之为奇异码。

(1.5分)唯一可译码任意有限长的码元序列,只能被唯一地分割成一个个的码字,便称为唯一可译码(1.5分)即时码:只要收到符号就表示该码字已完整,可以立即译码。

即时码又称为非延长码,任意一个码字都不是其它码字的前缀部分,有时叫做异前缀码。

2.(15分)有一个二元二阶马尔可夫信源,其信源符号集为{0,1},已知符号条件概率:p(0|00) = 1/2 p(1|00)=1/2p(0|01) = 1/3 p(1|01)=2/3p(0|10) = 1/4 p(1|10)=3/4p(0|11) = 1/5 p(1|11)=4/5求:(1).信源全部状态及状态转移概率;(2).画出完整的二阶马尔可夫信源状态转移图;(3).求平稳分布概率。

解:(1).符号条件概率矩阵状态转移概率矩阵(5分)(2).(5分)(3). 平稳分布概率(5分)121234()()()1/21/2()1/32/3(|)()1/43/4(010*******)1/54/5j i a a s s p a s s s ⎡⎤⎢⎥⎢⎥=⎢⎥⎢⎥⎣⎦⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=5/45/100004/34/13/23/100002/12/1)|(43214321s s s s s s p s s s s i j 154325131432141214321442342231131=+++⎪⎪⎪⎪⎭⎪⎪⎪⎪⎬⎫=+=+=+=+⇒=∑W W W W W W W W W W W W W W W W pijjiiW W 74,356,356,3534321====W W W W ∑1316161493. (20分)具有符号集},{10u u U =的二元信源,信源发生概率为:210,1)(,)(10≤<-==p p u p p u p 。

Z 信道如图 所示,接收符号集},{10v v V =,转移概率为:q u v q u v q -==1)|(,1)|(1100。

发出符号与接收符号的失真:1),(),(,0),(),(10011100====v u d v u d v u d v u d 。

(1). 计算平均失真—D ;(2). 率失真函数R(D)的最大值是什么?当q 为什么值时可达到该最大值?此时平均失真—D 是多大?(3). 率失真函数R(D)的最小值是什么?当q 为什么值时可达到该最小值?此时平均失真—D 是多大? (4). 画出R(D)-D 曲线。

解:(1). 已知信源符号概率210,1)(,)(10≤<-==p p u p p u p ; 转移概率矩阵⎥⎦⎤⎢⎣⎡-=q q u v q i j 101)]|([;失真矩阵⎥⎦⎤⎢⎣⎡=0110)],([j i v u d ;联合概率矩阵⎥⎦⎤⎢⎣⎡---=)1)(1()1(0)],([q p q p p v u p j i ; q p q p q p p v u d v u p D j i j i )1(0)1)(1(1)1(100),(),(ij-=⨯--+⨯-+⨯+⨯==∑—。

(5分) (2). maxR(D)=R(Dmin)=H(X)=-plogp-(1-p)log(1-p);当q=0时,Dmin=0,即得到maxR(D);—D =0。

(5分)(3). minR(D)=R(Dmax)=0;当q=1时,转移概率矩阵⎥⎦⎤⎢⎣⎡=0101)]|([i j u v q ,可使得到minR(D);—D =1-p 。

(5分)(4). (5分)4. (15分)一个平均功率受限制的连续信道,其通频带为1MHz ,信道上存在白色高斯噪声。

(1). 已知信道上的信号与噪声的平均功率比值为20,求该信道的信道容量;(2). 信道上的信号与噪声的平均功率比值降至10,要达到相同的信道容量,信道通频带应为多大?(3). 若信道的通频带增加至2MHz 时,要保持相同的信道容量,信道通频带应为多大? 解:(1). 已知SNR=20s Mbit SNR W W N s PW C /392.421log 1)1log()01log(=⨯=+=+=(5分)(2). 若SNR=10,C=4.392Mbit/s ;)101log(392.4+=WW=1.27MHz (5分)(3). 若W=2MHz ,C=4.392Mbit/s ;)1log(2392.4SNR +⨯=SNR=3.582(5分)5. (20分)信源符号X 有6种字母,概率为0.32,0.22,0.18,0.16,0.08,0.04。

(1). 求符号熵H (X );(2). 用费诺(Fano )编码法编成二进制变长码,求出平均码长和编码效率;(3). 用香农(Shannon )编码法编成二进制变长码,求出平均码长和编码效率;(4). 用哈夫曼(Huffma )编码法编成三进制变长码,求出平均码长和编码效率。

解:(1). ∑=-=ii i bit a p a p X H 符号/35.2)(log )()((5分)(2). 费诺编码法编成二进制变长码(5分)00,01,10,110,1110,1111%9.974.235.2)()(====—KX H R X H L η (3). 香农编码法编成二进制变长码(5分)第 11 页 共 11 页00,010,100,101,1110,11110%7.8284.235.2)()(====—KX H R X H L η (4). 哈夫曼编码法编成三进制变长码(5分)1,2,00,01,020,021%8.933log 58.135.2log )()(=⨯===m LKX H R X H L —η m=3,n=6,令k=2 m+k(m-1)=7,s=7-n=1所以第一次取m-s=2个符号进行编码。