信息论与编码08

信息论与编码技术

信息论与编码技术信息论是研究信息传输、存储和处理的一门学科,而编码技术则是信息论的一项重要应用。

信息论与编码技术的发展,对现代通信、数据存储和计算机科学等领域产生了深远的影响。

本文将从信息熵、信道容量和编码理论等方面来探讨信息论与编码技术的基本概念和应用。

一、信息熵信息熵是信息论中的一个重要概念,它用来衡量一个离散随机变量的不确定性。

在信息论中,信息熵越大,代表着信息的不确定性越高,信息量也就越大;相反,信息熵越小,表示信息的不确定性越低,信息量也就越小。

信息熵的计算公式为:H(X) = -∑(p(i) * log2(p(i)))其中,H(X)表示离散随机变量X的信息熵,p(i)表示X取各个值的概率。

通过计算信息熵,我们可以评估信息的平均编码长度。

在通信系统中,对于概率分布已知的消息源,我们可以使用无损编码技术将信息源的输出编码成二进制串,从而实现高效的信息传输和存储。

二、信道容量信道容量是衡量信道传输速率的理论上限。

在信息论中,我们可以通过计算信道容量来确定一种特定的编码和调制方案是否可以实现理论最大传输速率。

对于离散无记忆信道,其信道容量C计算公式为:C = ∑(p(x) * log2(p(x)/p(y)))其中,p(x)表示发送端发出的信号为x的概率,p(y)表示接收端接收到的信号为y的概率。

在计算信道容量时,我们需要寻找一种合适的编码方案,使得发送端发出的信号与接收端接收到的信号之间的互信息最大化。

这样可以有效提高信道的利用率,提高信号传输的可靠性。

三、编码理论编码理论是信息论的重要组成部分,它研究如何将信息源的输出进行编码,以减少数据传输或存储过程中的冗余,从而提高信息传输的效率。

常见的编码技术有可变长编码、定长编码、哈夫曼编码等。

其中,哈夫曼编码是一种基于概率的编码方法,它可以根据不同符号的出现概率,为每个符号分配不同长度的编码,从而实现信息的高效压缩。

除了无损编码技术,还有一种重要的编码技术是差分编码。

精品课课件信息论与编码(全套讲义)

跨学科交叉融合

信息论将与更多学科进行交叉融合,如物理学、 化学、社会学等,共同推动信息科学的发展。

编码技术的发展趋势

高效编码算法

随着计算能力的提升,更高效的编码算法将不断涌现,以提高数据 传输和存储的效率。

智能化编码

借助人工智能和机器学习技术,编码将实现智能化,自适应地调整 编码参数以优化性能。

跨平台兼容性

未来的编码技术将更加注重跨平台兼容性,以适应不同设备和网络环 境的多样性。

信息论与编码的交叉融合

理论与应用相互促进

信息论为编码技术提供理论支持, 而编码技术的发展又反过来推动 信息论的深入研究。

共同应对挑战

精品课课件信息论与编码(全套 讲义)

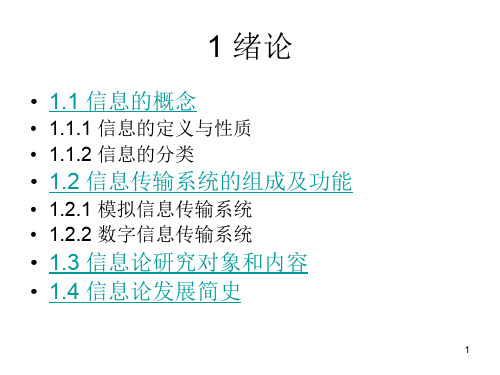

目

CONTENCT

录

• 信息论基础 • 编码理论 • 信道编码 • 信源编码 • 信息论与编码的应用 • 信息论与编码的发展趋势

01

信息论基础

信息论概述

信息论的研究对象

研究信息的传输、存储、处理和变换规律的科学。

信息论的发展历程

从通信领域起源,逐渐渗透到计算机科学、控制论、 统计学等多个学科。

卷积编码器将输入的信息序列按位输入到一个移位寄存器中,同时根据生成函数将移位寄存 器中的信息与编码器中的冲激响应进行卷积运算,生成输出序列。

卷积码的译码方法

卷积码的译码方法主要有代数译码和概率译码两种。代数译码方法基于最大似然译码准则, 通过寻找与接收序列汉明距离最小的合法码字进行译码。概率译码方法则基于贝叶斯准则, 通过计算每个合法码字的后验概率进行译码。

04

信息论与编码(杜玉华)

8.1纠错编码的基本概念

8.2 纠错编码分类 8.3线性分组码 8.4循环码

8.1 纠错编码的基本概念

• 信源编码提高数字信号有效性

• 将信源的模拟信号转变为数字信号

• 降低数码率,压缩传输频带(数据压缩)

• 信道编码提高数字通信可靠性

• 数字信号在信道的传输过程中,由于实际信道的

错检测有无差错,通过按预定规则的运算,

如检测到差错,则确定差错的具体位置和性质, 自动加以纠正,故称为“前向纠错”。

8.2 纠错编码分类

HEC方式:是检错重发和前向纠错两种方式的

8.2 纠错编码分类

其中分组码又可分循环码和非循环码:对循环

码而言,其码书的特点是,若将其全部码字分成

若干组,则每组中任一码字中码元循环移位后仍

是这组的码字;对非循环码来说,任一码字中的

码元循环移位后不一定再是该码书中的码字。

8.2 纠错编码分类

卷积码----把信息序列以每k0(通常较小)个码元 分段,编码器输出该段的监督码元r=n- k0 不但与本段的k0个信息元有关,而且还与其前面L 段的信息码元有关,故记卷积码为(n, k0,L)。 按照每个码元的取值来分,可有二元码和多元 码。由于目前的传输或存储系统大都采用二进制 的数字系统,所以一般提到的纠错码都是指二元 码。

8.2 纠错编码分类

前向纠错方式----用于纠错的纠错码在译码器输 出端总要输出一个码字或是否出错的标志,这种 纠错码的应用方式称为前向纠错方式(FEC, Forward-error control)。

另外用于检错与纠错的方式还有混合纠错(HEC ,Hybrid Error Correction)。 如图所示为上述几种检错与纠错方式示意图, 图中有斜线的方框表示在该端检出错误。

信息论与编码理论课后答案

信息论与编码理论课后答案【篇一:《信息论与编码》课后习题答案】式、含义和效用三个方面的因素。

2、 1948年,美国数学家香农发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。

3、按照信息的性质,可以把信息分成语法信息、语义信息和语用信息。

4、按照信息的地位,可以把信息分成客观信息和主观信息。

5、人们研究信息论的目的是为了高效、可靠、安全地交换和利用各种各样的信息。

6、信息的是建立信息论的基础。

7、8、是香农信息论最基本最重要的概念。

9、事物的不确定度是用时间统计发生概率的对数来描述的。

10、单符号离散信源一般用随机变量描述,而多符号离散信源一般用随机矢量描述。

11、一个随机事件发生某一结果后所带来的信息量称为自信息量,定义为其发生概率对数的负值。

12、自信息量的单位一般有比特、奈特和哈特。

13、必然事件的自信息是。

14、不可能事件的自信息量是15、两个相互独立的随机变量的联合自信息量等于两个自信息量之和。

16、数据处理定理:当消息经过多级处理后,随着处理器数目的增多,输入消息与输出消息之间的平均互信息量趋于变小。

17、离散平稳无记忆信源x的n次扩展信源的熵等于离散信源x的熵的。

limh(xn/x1x2?xn?1)h?n???18、离散平稳有记忆信源的极限熵,。

19、对于n元m阶马尔可夫信源,其状态空间共有m个不同的状态。

20、一维连续随即变量x在[a,b] 。

1log22?ep21、平均功率为p的高斯分布的连续信源,其信源熵,hc(x)=2。

22、对于限峰值功率的n维连续信源,当概率密度均匀分布时连续信源熵具有最大值。

23、对于限平均功率的一维连续信源,当概率密度24、对于均值为0,平均功率受限的连续信源,信源的冗余度决定于平均功率的限定值p和信源的熵功率p25、若一离散无记忆信源的信源熵h(x)等于2.5,对信源进行等长的无失真二进制编码,则编码长度至少为。

2728、同时掷两个正常的骰子,各面呈现的概率都为1/6,则“3和5同时出现”这件事的自信息量是 ?mn?ki?11?mp(x)?em29、若一维随即变量x的取值区间是[0,∞],其概率密度函数为,其中:x?0,m是x的数学2期望,则x的信源熵c。

信息论与编码全部课件-PPT精选文档398页

37

2.1.1 自信息量

• 三个单位间的转换关系为:

• 1奈特=log2e 1.433比特 • 1哈特莱=log210 3.332比特

• 自信息量非负且单调递减。

f(x)

log2x

f(x)

34

2.1.1 自信息量

• 应用概率空间的概念分析上例,设取红球

的状态为x1,白球为x2,黑球为x3,黄球为 x4,则概率空间为:

• (1)

• (2)

PX(x)0x1.99 PX(x)0x1.5

x2 0.01

x2 0.5

• (3) P X (x) 0 x1 .250.x 2 2 5x30.25x0 4.25

• (7)按生成领域分:宇宙信息、自然信息、社会信息、 思维信息等。

• (8)按应用部门分:工业信息、农业信息、军事信息、 政治信息、科技信息、文化信息等。

(9)按信息源的性质分:语声信息、图像信息、文 字信息、数据信息、计算信息等。 (10)按载体性质分:电子信息、光学信息、生物信 息等。 (11)按携带信息的信号形式分:连续信息、离散信 息、半连续信息等。

19

1.2.2 数字信息传输系统

• 优点:

• (1)抗干扰能力强,特别在中继传输中尤为明 显。

• (2)可以进行差错控制,提高了信息传输的灵 活性。

(3)便于使用现代计算机技术对信号进行处 理、存储和变换。 (4)便于加密,实现保密信息传输。

20

1.2.2 数字信息传输系统

• (5)易于与其他系统配合使用,构成综合 业务信息传输网。

35

2.1.1 自信息量

• 结论: • (1)不确定度与信源概率空间的状态数及

信息论与讲义编码8

定义 8.1 域是一些元素的集合,在这些元素中定义了

加法和乘法两种运算,且满足如下11条性质: (1)对加法它是一个交换群

(满足5条性质:封闭性、结合律、交换律、存在幺 元、存在逆元);

(2)对乘法它也是一个交换群 (满足5条性质:封闭性、结合律、交换律、存在幺

元、存在逆元(除去0元素)); (3)对加法、乘法满足分配律:

的其他所有非零元素都可写成α的方幂 ,2, ,q1e。

以本原元为根的即约多项式称为本原多项式。

【例8.7】 基域GF (2)={0,1},扩展域G F ( 2 m ) ,生成多项p(x)x3x21 ,

α是p(x)的根,即 p () 3 2 1 0 3 2 1

G F ( 2 m ) 是所有阶次小于3的多项式集合,共有8个元素:

8.1 有限域及其结构

8.1.1 域的定义

1.多项式

几个有关概念: (1)多项式:f( x ) f0 f 1 x f2 x 2 fn x n; (2)系数: fi∈K(集合) i=1, 2, …,n; (3)首一多项式:若多项式最高幂次项的系数 fn = 1,称该多项式为首一多项式; (4)多项式f (x)的阶次n记为f (x) = n; (5)多项式因式分解:将多项式分解为若干个 因式相乘,这种分解是唯一的; (6)即约多项式:阶大于0且在给定集合K上除 了常数和本身的乘积外,不能被其他多项式除尽 的多项式。

2.有关多项式的一些运算

(1)多项式带余除法

若p (x)不能整除a(x),商Q (x),余r(x),记为:

a(x)= Q (x) p (x) +r (x)

r(x) < p (x)

(2)多项式模d(x)运算的剩余类集合

多项式a(x)被p(x)所除,余数记为r (x),称为a(x)的模p(x)运算, R p ( x ) [a ( x就)]称为对多项式a(x)进行模p(x)运算的剩余类集合。

信息论与编码陈运主编答案完整版

p x x( i1 i3 )log p x( i3 / xi1)

i1 i2 i3

i1 i3

∑∑∑ ∑∑∑ = −

p x x x( i1 i2i3 )log p x( i3 / x xi1 i2 ) +

p x x x( i1 i2i3 )log p x( i3 / xi1)

i1

i2 i3 i1 i2 i3 p x( i3 / xi1)

( 1)

5 / 61

⎧p e( 1 ) = p e( 2 ) = p e( 3 ) ⎨

⎩p e( 1 ) + p e( 2 ) + p e( 3 ) =1 ⎧p e( 1 ) =1/3 ⎪ ⎨p e( 2 ) =1/3 ⎪⎩p e( 3 ) =1/3

⎧p x( 1 ) = p e( 1 ) (p x1 /e1 ) + p e( 2 ) (p x1 /e2 ) = p p e⋅( 1 ) + p p e⋅( 2 ) = (p + p)/3 =1/3 ⎪⎪ ⎨p x( 2 ) = p e( 2 ) (p x2 /e2 ) + p e( 3 ) (p x2 /e3 ) =p p e⋅( 2 ) + p p e⋅( 3 ) = (p + p)/3 =1/3

p x( i ) = I x( i ) =−log p x( i ) = log52!= 225.581 bit

(2) 52 张牌共有 4 种花色、13 种点数,抽取 13 张点数不同的牌的概率如下:

413 p x( i ) =

C5213

413 I x( i ) = −log p x( i ) = −log C5213 =13.208 bit

解: (1)

《信息论与编码》课件

优点

可以快速计算出哈希值,常用于数据完整性验证和密码存储。

缺点

对于某些输入,哈希函数可能产生冲突,即不同的输入可能会产生相同的哈希值。

信息论的应用

05

数据压缩

数据压缩是信息论的一个重要应用,通过编码技术减少数据冗余,提高存储和传输效率。

压缩算法

常见的压缩算法包括哈夫曼编码、算术编码、LZ77和LZ78等,这些算法利用数据的统计特性进行压缩。

定义

RSA(Rivest-Shamir-Adleman)、ECC(椭圆曲线加密)等。

常见的非对称加密算法

密钥管理相对简单,安全性较高。

优点

加密速度较慢,通常比对称加密算法慢几个数量级。

缺点

定义

哈希函数是一种将任意长度的数据映射为固定长度哈希值的函数。

常见的哈希函数

MD5(Message Digest Algorithm 5)、SHA(Secure Hash Algorithm)等。

互信息定义

条件互信息表示一个随机变量在给定另一个随机变量的条件下与第三个随机变量之间的相关性。

条件互信息定义

信源编码

02

无损压缩编码是一种完全保留原始数据,没有任何信息损失的编码方式。

有损压缩编码是一种允许一定信息损失的编码方式,通常用于图像、音频和视频等连续媒体数据的压缩。有损压缩编码通过去除数据中的冗余信息和细节来减少存储空间或传输时间。解压缩时,虽然不能完全恢复原始数据,但人眼或耳朵通常无法察觉到损失的信息。因此,它常用于需要快速传输或低成本存储的场景,如数字电视广播、互联网流媒体等。有损压缩编码的优点是压缩率高,适合处理大量数据;缺点是原始数据的完整性和真实性可能受到损失。常见的有损压缩算法包括JPEG、MPEG、MP3等。这些算法通过离散余弦变换、小波变换等技术来减少数据量,同时采用量化等技术来控制信息损失的程度。

《信息论与编码全部》课件

信息论与编码全部PPT课件

汇报人:PPT

目录

CONTENTS

01 添加目录标题 03 信息度量与熵

02 信息论与编码的基 本概念

04 信源编码

05 信道编码

06 加密与解密技术

07 信息安全与认证技 术

添加章节标题

信息论与编码的基本概 念

信息论的发展历程

1948年,香农提出信 息论,奠定了信息论

提高安全性

优点:安全性 高,速度快,

易于实现

应用:广泛应 用于电子商务、 网络通信等领

域

发展趋势:随 着技术的发展, 混合加密技术 将更加成熟和

完善

信息安全与认证技术

数字签名技术

数字签名:一种用于验证信息来源和完整性的技术 数字签名算法:RSA、DSA、ECDSA等 数字证书:用于存储数字签名和公钥的文件 数字签名的应用:电子邮件、电子商务、网络银行等

汇报人:PPT

熵越小,表示信息量越小,不确 定性越小

熵是概率分布的函数,与概率分 布有关

信源编码

定义:无损信源编码是指在编码过 程中不丢失任何信息,保持原始信 息的完整性。

无损信源编码

应用:无损信源编码广泛应用于音 频、视频、图像等媒体数据的压缩 和传输。

添加标题

添加标题

添加标题

添加标题

特点:无损信源编码可以保证解码 后的信息与原始信息完全一致,但 编码和解码过程通常比较复杂。

古典密码学:公元前400年,古希腊人使用替换密码 近代密码学:19世纪,维吉尼亚密码和Playfair密码出现 现代密码学:20世纪,公钥密码体制和数字签名技术出现 当代密码学:21世纪,量子密码学和后量子密码学成为研究热点

信息论与编码第7-8章习题解答

相应的校验矩阵为

1 0 0 1 ' G 和 G 的差别仅是列的置换,所以 H 和 H ' 的差别也是同样的列置换,所以 1 1 0 1 1 0 1 1 0 1 1 1 1 0 H = 0 1 1 1 0 0 0 I 4×4 0 0 0 1 1 1 1

该码的校验矩阵任意二列线性独立,而第 1,2,3 列之和为零矢量,所以存在 着相关的三列,从而最小 Hamming 重量为 3。

wH (c 1 + c 2 ) = wH (c 1 ) + wH (c 2 ) − 2 wH (c 1 ⋅ c 2 ) 是偶数,其中 c1 ⋅ c 2 表示 c1 和 c 2 的交截。因此 c1 + c 2 ∈ E n ,所以 En 是一个线性码。

由于对称性, 在所有长度为 n 的二元矢量中, 奇数重量与偶数重量的矢量数相等, n −1 所以 En 中码字数为 2 , 从而 k = n − 1 ; 又 En 中最小非零码字的重量为 2, 所以 d = 2 , 于是 En 的参数为 ( n, n − 1,2) 。 7-4 设二元线性码 M 的生成矩阵为 1 0 0 1 1 G = 0 0 1 0 1 0 1 1 1 1 求 M 的最小距离。 [解] 由 G 生成的(5,3)码的八个码字为 (00000) , (10011 ) , (00101) , (01111) (10110) , (01010) , (11100) , (11001) 所以非零码字最小重量为 2,从而最小 Hamming 矩离 d min = 2 。 7-5 设二元线性码 M 的生成矩阵为 1 1 0 1 0 G = 0 1 0 1 0 , 建立码 M 的标准阵,并对码字 11111 和 10000 分别进行译码。 [解] 由 G 生成的(5,2)码 M 的标准阵列为 (00000) , (11010) , (01010) , (10000) (00001) , (11011) , (01011 ) , (10001) (00010) , (11000) , (01000) , (10010) (00100) , (11110) , (01110) , (10100) (00011 ) , (11001) , (01001) , (10011 ) (00101) , (11111) , (01111) , (10101) (01100) , (10110) , (00110) , (11100)

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

m βj 2.由 2.由 C = log 2 ∑ 2 ,求C j =1

3.由 3.由

p bj = 2

p bj =

n

( )

β j −C

(须确认所有的p(ai)≥0) 须确认所有的 ( )

,求 p(bj) (

4.由 4.由

( ) ∑ p(a ) p(b

i i =1

j

ai

)

1) 2) I ( a i ;Y ) = C I ( a i ;Y ) ≤ C p(a i ) ≠ 0 p(a i ) = 0

对一切 i 对一切 i

这时常数C 就是所求的信道容量。 这时常数 就是所求的信道容量。式中

I (a i ;Y ) = I (Y ; a i ) =

∑ p(b

m j =1

j

a i log 2

相应的信源概率分布——最佳输入分布 最佳输入分布 相应的信源概率分布 ◆一一对应的无噪信道 C = max I ( X ;Y ) = max H ( X ) = log 2 n

p( ai ) p( ai )

◆扩展性能的无噪信道 C = max I ( X ;Y ) = max H ( X ) = log 2 n

四、准对称离散信道的信道容量

定理:对于单符号离散准对称信道,仅当其输入为等概率分布时, 定理:对于单符号离散准对称信道,仅当其输入为等概率分布时, 达到其信道容量。 达到其信道容量。即:

C = max I ( X ;Y ) = I ( X ;Y )

p( ai )

输入等概

= H (Y ) − H (Y / X )

p( ai ) p( ai )

中的m项分成 个子集M 将H(Y)中的 项分成 个子集 1, M2 , …, Mk , …, Ms , 中的 项分成s个子集 各子集分别有 m1, m2 , …, mk , …, ms 项。

4

四、准对称离散信道的信道容量

H (Y ) = −

∑ p(b )log p(b )

1 8

1 6 P3 = 1 6

1 8

1 3 P2 = 1 1 3 3

3

四、准对称离散信道的信道容量

0.7 P= 0.2 0.8 P= 0.1

0.2 0.1 0.1 0.7 0.1 0.1 0.1

0.8 → P1 = 来自0.1)()

7

3.2.3 离散信道容量的一般计算方法 离散信道容量的 信道容量的一般计算方法

一般离散信道容量的计算步骤: 一般离散信道容量的计算步骤: 1.由 1.由

∑ p(b

m j =1

j

ai β j =

)

∑ p(b

m j =1

j

a i log 2 p b j a i ,求 β j

)

(

)

β j = log 2 p(b j ) + C

p( ai ) p( ai )

◆归并性能的无噪信道 C = max I ( X ;Y ) = max H (Y ) = log 2 m

p( ai ) p( ai )

◆对称离散信道

C = max I ( X ;Y ) = log 2 m − H (q1 ,q2 ,L , qm )

p( ai )

◆强对称离散信道(均匀信道) 强对称离散信道(均匀信道)

C = log 2 n + p log 2 p + p log 2 n−1

p

2

3.2.2 几种特殊离散信道的信道容量 几种特殊离散信道的信道容量

四、准对称离散信道的信道容量

的行是可排列的, 如果单符号离散信道矩阵 P 的行是可排列的,列是不可 排列的。但矩阵中 列可以分成 个不相交的子集, 列可以分成s个不相交的子集 排列的。但矩阵中m列可以分成 个不相交的子集,各子集分 别有 m1, m2 , …, ms 列( m= m1 + m2 +… +ms ) ,若由 n 行 mk 列(k=1,2, …,s) 组成的子矩阵 Pk 具有可排列性,则称这信道 组成的子矩阵 具有可排列性, 为准对称信道。 准对称信道。

,求 p(ai) (

8

(bk )

此时第k个子集中的熵最大 个子集中的熵最大。 ,此时第 个子集中的熵最大。

H (Y ) ≤ −

∑ m p(b )log p(b )

k k k k =1

s

C =−

∑ m p(b )log p(b ) − H (q ,q ,L, q )

k k k 1 2 m k =1

5

s

最佳输入分布: 最佳输入分布:等概分布

例:

1 2 P = 1 4 1 4 1 2 1 8 1 8 1 8 1 8

输入等概

1 2 → P1 = 1 4

1 4 1 2

1 8 P2 = 1 8

1 8 1 8

6

3.2.3 离散信道容量的一般计算方法 离散信道容量的 信道容量的一般计算方法

定理:一般离散信道的平均互信息 ( ; )达到极大值(等于C) 定理:一般离散信道的平均互信息I(X;Y)达到极大值(等于 )的 充要条件是输入概率分布p( 充要条件是输入概率分布 (ai)满足

0.1 0 .8

0.8

0.1 P2 = 0.1

I ( X ; Y ) = H (Y ) − H (Y / X )

= H (Y ) − H (q 1 ,q 2 ,L , q m )

C = max I ( X ;Y ) = max[H (Y )] − H (q1 ,q2 ,L , qm )

1 2 P= 1 4 1 3 P= 1 6 1 4 1 2 1 3 1 3 1 8 1 8 1 6 1 6 1 8

1 2 → P1 = 1 4

1 3 → P1 = 1 6

1 8 1 3

1 6

1 2

1 6

1 4

1 8 P2 = 1 8

)

p b j ai p bj

(

( )

)

C=

m

∑ p(b

m j =1

j

a i log 2 p b j a i −

)

(

) ∑ p(b

m j =1

j

a i log 2 p b j

)

( )

∑ p(b

j =1

j

a i log 2 p b j + C =

)[

( ) ] ∑ p(b

m j =1

j

a i log 2 p b j a i

m j j j =1

=−

∑ ( ∑ p(b )log p(b ) )

s j j k =1 p b j ∈M k

j j p b j ∈M s

=−

p b j ∈M 1

∑ p(b )log p(b ) − LL − ( ∑ p(b )log p(b ) ( ) )

j j

由于子矩阵 具有可排列性,当信源X呈等概分布时 可使第k个子集的 呈等概分布时, 由于子矩阵 Pk 具有可排列性,当信源 呈等概分布时,可使第 个子集的 输出概率相等, p 输出概率相等,即达到其均值

信息论与编码

Information Theory and Coding

通信与信息工程学院

2011-4-3

3.2.2 几种特殊离散信道的信道容量 几种特殊离散信道的信道容量

最大的信息传输率为信道容量 最大的信息传输率为信道容量C 信道容量

C = max R = max I ( X ;Y )

p( ai ) p( ai )