神经网络最新发展综述

图神经网络研究综述

图神经网络研究综述近年来,图神经网络(graph neural networks,GNNs)成为了机器学习领域的研究热点。

图神经网络是一种用于处理图数据的神经网络模型,通过学习节点之间的关系和图的结构,实现对图数据的分析和预测。

本文将对图神经网络的研究进行综述,并介绍其应用和未来发展方向。

一、图神经网络简介图神经网络是一种基于图结构的神经网络模型,其目标是学习节点之间的关系和图的结构。

相比于传统的神经网络模型,图神经网络可以处理非结构化数据,并在节点分类、图分类、关系预测等任务中取得良好的效果。

图神经网络主要由节点嵌入和图嵌入两个部分组成。

1. 节点嵌入节点嵌入是将节点映射到低维空间中的一个过程,将图中的节点表示为向量形式,用于捕捉节点的特征和上下文信息。

常用的节点嵌入方法有GraphSage、GAT和GCN等。

2. 图嵌入图嵌入是将整个图映射到低维空间中的一个过程,用于对整个图进行特征提取和表示。

常用的图嵌入方法有Graph Convolutional Networks (GCNs)、Graph Attention Networks (GAT)和GraphSAGE等。

二、图神经网络的应用图神经网络在各个领域都有广泛的应用,包括社交网络分析、推荐系统、生物信息学和药物发现等。

以下将介绍几个典型的应用场景:1. 社交网络分析社交网络是一个充满复杂关系的图结构,传统的方法往往无法准确地分析和预测社交网络中的节点行为。

图神经网络通过学习节点之间的关系和图的结构,可以有效地进行社交网络分析,包括社区发现、影响力传播和节点分类等任务。

2. 推荐系统推荐系统需要对用户和商品之间的关系进行建模和预测,而这种关系往往可以用图结构进行表示。

图神经网络可以学习用户和商品之间的关系,提取隐含的特征信息,并用于推荐算法中的推荐和评分预测。

3. 生物信息学生物信息学研究需要对蛋白质、基因和化合物等生物实体进行建模和分析。

BP神经网络研究综述【文献综述】

文献综述电气工程及自动化BP神经网络研究综述摘要:现代信息化技术的发展,神经网络的应用范围越来越广,尤其基于BP算法的神经网络在预测以及识别方面有很多优势。

本文对前人有关BP神经网络用于识别和预测方面的应用进行归纳和总结,并且提出几点思考方向以作为以后研究此类问题的思路。

关键词:神经网络;数字字母识别;神经网络的脑式智能信息处理特征与能力使其应用领域日益扩大,潜力日趋明显。

作为一种新型智能信息处理系统,其应用贯穿信息的获取、传输、接收与加工各个环节。

具有大家所熟悉的模式识别功能,静态识别例如有手写字的识别等,动态识别有语音识别等,现在市场上这些产品已经有很多。

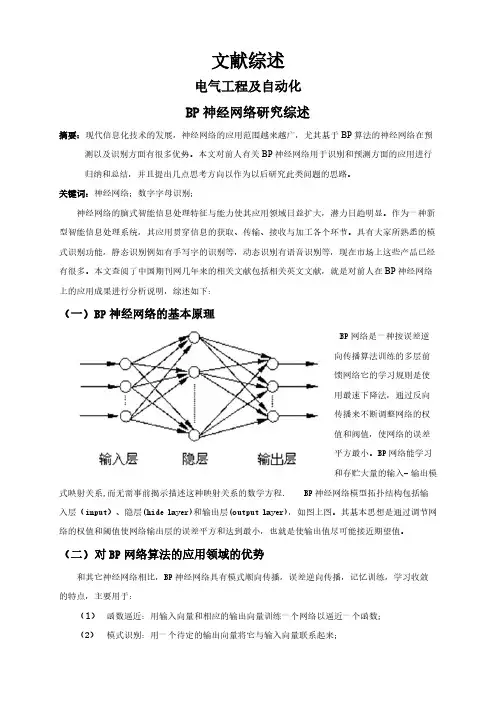

本文查阅了中国期刊网几年来的相关文献包括相关英文文献,就是对前人在BP神经网络上的应用成果进行分析说明,综述如下:(一)B P神经网络的基本原理BP网络是一种按误差逆向传播算法训练的多层前馈网络它的学习规则是使用最速下降法,通过反向传播来不断调整网络的权值和阀值,使网络的误差平方最小。

BP网络能学习和存贮大量的输入- 输出模式映射关系,而无需事前揭示描述这种映射关系的数学方程.BP神经网络模型拓扑结构包括输入层(input)、隐层(hide layer)和输出层(output layer),如图上图。

其基本思想是通过调节网络的权值和阈值使网络输出层的误差平方和达到最小,也就是使输出值尽可能接近期望值。

(二)对BP网络算法的应用领域的优势和其它神经网络相比,BP神经网络具有模式顺向传播,误差逆向传播,记忆训练,学习收敛的特点,主要用于:(1)函数逼近:用输入向量和相应的输出向量训练一个网络以逼近一个函数;(2)模式识别:用一个待定的输出向量将它与输入向量联系起来;(3)数据压缩:减少输出向量维数以便于传输或存储;(4)分类:把输入向量所定义的合适方式进行分类;]9[BP网络实质上实现了一个从输入到输出的映射功能,,而数学理论已证明它具有实现任何复杂非线性映射的功能。

bp神经网络的应用综述

bp神经网络的应用综述近年来,人工神经网络(ANN)作为一种神经网络形式在不断发展,因其计算能力强,对现实世界较好地识别和适应能力,已得到越来越广泛的应用,其中,BP神经网络是最典型的人工神经网络之一。

BP神经网络是指以马尔可夫随机过程为基础的反向传播算法,具有自组织学习、泛化、模糊推理的特点,具有非常广泛的应用场景。

它可以用来解决实际问题。

首先,BP神经网络可以用来解决分类问题。

它可以根据给定的输入向量和输出向量,训练模型以分类相关的输入特征。

这种模型可以用来解决工业控制问题、专家系统任务等。

例如,BP神经网络可以用来识别照片中的面孔,帮助改进自动门的判断等。

此外,BP神经网络还可以用于计算机视觉,即以计算机图像识别的形式进行图像处理。

通常,计算机视觉技术需要两个步骤,即识别和分析。

在识别步骤中,BP神经网络可以被用来识别图片中的特征,例如物体的形状、大小、颜色等;在分析步骤中,BP神经网络可以用来分析和判断图片中的特征是否满足要求。

此外,BP神经网络还可以用于机器人技术。

它可以用来识别机器人环境中的物体,从而帮助机器人做出正确的动作。

例如,利用BP神经网络,机器人可以识别障碍物并做出正确的行动。

最后,BP神经网络还可以用于未来的驾驶辅助系统中。

这种系统可以利用各种传感器和摄像机,搜集周围环境的信息,经过BP神经网络分析,判断当前环境的安全程度,及时采取措施,以达到更好的安全驾驶作用。

综上所述,BP神经网络具有自组织学习、泛化、模糊推理的特点,拥有非常广泛的应用场景,可以用于分类问题、计算机视觉、机器人技术和驾驶辅助系统等。

然而,BP神经网络也存在一些问题,例如训练时间长,需要大量的训练数据,容易受到噪声攻击等。

因此,研究人员正在积极改进BP神经网络,使其能够更好地解决各种问题。

神经网络的综述

1.绪论 (3)1.1 神经网络的提出与发展 (3)1.2神经网络的定义 (3)1.3神经网络的发展历程 (4)1.4 神经网络研究的意义 (6)2.BP神经网络 (7)2.1 BP神经网络介绍 (7)2.2 BP算法的研究现状 (7)2.3 BP网络的应用 (8)2.4基本结构与学习算法 (8)2.5 动作过程 (11)2.6 主要特点及参数优选 (13)3.BP网络在复合材料研究中的应用 (15)3.1 材料设计 (15)3.2 性能预测 (16)2.4损伤检测和预测 (17)2.5 结论 (17)致谢: (18)BP神经网络综述摘要:本文阐述了人工神经网络和神经网络控制的基本概念特点以及两者之间的关系,讨论了人工神经网络的两个主要研究方向神经网络的VC 维计算和神经网络的数据挖掘,着重介绍了人工神经网络的工作原理和神经网络控制技术的应用首先介绍了神经网络的发展历程,随后对BP神经网络的学习方法分为了导师知识学习训练和模式识别决策,并重点分析了导师知识学习训练的网络结构和学习算法,最后介绍了BP神经网络在性能预测中的应用。

关键词:人工神经网络;神经网络控制;应用;维;数据挖掘Abstract:It expounds the basic concepts, characteristics of the artificial neural network and neural network control and the relationship between them.It discusses two aspects: the Vapnik-Chervonenkis dimension calculation and the data mining in neural nets.And the basic principle of artificial neural networks and applications of neural network control technology are emphatically introduced. Key words:Artificial Neural Networks; Neural Network Control;this paper introduces the developing process of neural networks, and then it divides the learning methods of BP neural network into a inst ructor knowledge learning training and pattern recognition decisions, and focus on analysis of the network structure and learning algorith m of knowledge and learning mentors training .And finally it introduc es the applications of BP neural network in performance prediction.Application;Vapnik-Chervonenkis Mimension;Data Mining1.绪1.1 神经网络的提出与发展系统的复杂性与所要求的精确性之间存在尖锐的矛盾。

神经网络的未来趋势

神经网络的未来趋势

神经网络作为一种机器学习算法,已经取得了巨大的成功,并在许多领域展示了强大的能力。

未来,神经网络的发展趋势可能包括以下几个方面:

1. 更复杂的网络架构:目前广泛使用的神经网络架构,如多层感知机和卷积神经网络,在某些任务上已经达到了瓶颈。

未来,研究人员可能会开发更复杂的网络架构,以处理更复杂的数据模式和任务。

2. 结合其他学习算法:神经网络在处理大规模数据和复杂问题方面表现出色,但在处理小规模数据和多模态数据等领域仍存在挑战。

未来,可以考虑将神经网络与其他学习算法结合,以提高性能和灵活性。

3. 自监督学习:目前,神经网络通常需要大量标注数据进行训练,但获取标注数据成本高昂且耗时。

未来,自监督学习将成为发展趋势,这种方法利用数据自身的结构或先验知识进行无监督训练,从而减少对标注数据的依赖。

4. 异构网络融合:神经网络在不同领域和任务中都取得了成功,而不同网络结构在处理不同类型的数据和任务时可能具有不同的优势。

未来,研究人员可能会探索将不同网络结构进行融合,以发挥它们的优势和互补性。

5. 硬件优化:当前的深度学习任务通常需要大量的计算资源和存储空间,对硬件提出了更高的要求。

未来,神经网络的发展将不仅仅局限于算法和模型本身,

还将与硬件技术的进步密切相关,例如专用芯片和量子计算等。

总之,神经网络作为一种强大的机器学习算法,在未来的发展中有望进一步提升性能,并在更广泛的领域和任务中发挥作用。

(完整word版)神经网络历史发展及应用综述个人整理(word文档良心出品)

人工神经网络历史发展及应用综述1、引言人类为了生存在改造探索自然的过程中,学会利用机械拓展自身的体力,随着对自然认识的不断深入,创造语言,符号,算盘、计算工具等来强化自身脑力。

复杂的数字计算原本是靠人脑来完成的,为了摆脱这种脑力束缚发明了计算机。

其数字计算能力比人脑更强,更快、更准。

计算机的出现,人类开始真正有了一个可以模拟人类思维的工具,期盼可以实现人工智能,构造人脑替代人类完成相应工作。

要模拟人脑的活动,就要研究人脑是如何工作的,要怎样模拟人脑的神经元。

人脑的信息处理具有大规模并行处理、强容错性和自适应能力、善于联想、概括、类比和推广的特点,多少年以来,人们从生物学、医学、生理学、哲学、信息学、计算机科学、认知学、组织协同学等各个角度企图获悉人脑的工作奥秘,寻求神经元的模拟方法。

在寻找上述问题答案的研究过程中,从20世纪40年代开始逐渐形成了一个新兴的边缘性交叉学科,称之为“神经网络”,是人工智能、认知科学、神经生理学、非线性动力学、信息科学、和数理科学的“热点”。

关于神经网络的研究包含众多学科领域,涉及数学、计算机、人工智能、微电子学、自动化、生物学、生理学、解剖学、认知科学等学科,这些领域彼此结合、渗透,相互推动神经网络研究和应用的发展。

2、定义思维学普遍认为,人类大脑的思维有三种基本方式,分为抽象(逻辑)思维、形象(直观)思维和灵感(顿悟)思维。

逻辑性的思维是根据逻辑规则进行推理的过程,这一过程可以写成指令,让计算机执行,获得结果。

而直观性(形象)的思维是将分布式存储的信息综合起来,结果是忽然间产生想法或解决问题的办法。

这种思维方式的有以下两个特点:一是信息通过神经元上的兴奋模式分布储在网络上;二是信息处理通过神经元之间同时相互作用的动态过程来完成的。

人工神经网络就是模拟第二种人类思维方式。

人工神经网络是由大量具备简单功能的人工神经元相互联接而成的自适应非线性动态系统。

虽然单个神经元的结构和功能比较简单,但大量神经元连接构成的网络系统行为却异常复杂。

神经网络的最新研究进展

神经网络的最新研究进展近年来,随着人工智能技术的发展和神经网络算法的不断更新,神经网络在人类认知、语音识别、自然语言处理等方面的应用已经逐渐显现出来。

在深度学习技术的支持下,神经网络的应用前景十分广阔。

神经网络作为一种模拟人脑的计算模型,通过计算机模拟神经元之间的信号传递和学习方式,可以快速地处理大量的数据。

最近,神经网络在图像识别、语音识别、自然语言处理等方面的表现已经超越了人类,成为了众多领域中不可或缺的一部分。

一、基于神经网络语言模型的自然语言处理在自然语言处理方面,神经网络的应用非常广泛。

其中,基于神经网络语言模型的自然语言处理技术是近年来的研究热点之一。

神经网络语言模型作为一种语言学模型,可以实现自然语言的自动建模和向量化表示,为自然语言处理技术提供了丰富的表现形式,大大提高了自然语言处理的准确性。

目前,基于神经网络语言模型的自然语言处理技术已经广泛应用于语音识别、机器翻译、文本分类、问答系统等领域。

其中,最新的研究成果之一是“BERT”模型。

BERT(Bidirectional Encoder Representations from Transformers)是由Google公司提出的一种基于Transformer架构的预训练语言模型,可以从大量未标注的文本中自动学习语言知识,大大提高了自然语言处理的准确性和效率。

目前,BERT已经成为了自然语言处理领域的一项重要技术。

二、基于神经网络的图像识别技术在图像识别领域,神经网络也发挥着非常重要的作用。

神经网络可以通过深度学习技术,学习到图像的特征并将其分类,实现图像的自动识别。

最新的研究成果之一是“ResNet”模型。

ResNet是由Microsoft公司提出的一种基于残差块(Residual Block)的深度神经网络模型,可以有效地解决深度网络中的梯度消失和梯度爆炸等问题,大大提高了图像识别的准确性和效率。

此外,神经网络的卷积神经网络(CNN)也是图像处理领域中的十分重要的技术。

深度神经网络的发展现状

深度神经网络的发展现状深度神经网络(Deep Neural Network,DNN)是一种具有多层神经元的人工神经网络,其结构与人类的神经系统相似。

近年来,随着计算机硬件与算法技术的不断进步,深度神经网络在图像识别、自然语言处理、语音识别等领域取得了广泛应用,成为了人工智能领域的热门技术之一。

本文将就深度神经网络的发展现状进行探讨。

1. 深度神经网络的基本结构深度神经网络通常由输入层、隐藏层和输出层组成。

每个层都由若干个神经元构成,神经元之间的连接带有权重,且每个神经元都有一个激活函数,用于计算该神经元的输出值。

其中,输入层负责接收外部输入的数据,隐藏层则负责处理输入数据,提取数据中的特征,输出层则负责根据输入数据得到相应的输出结果。

2. 深度神经网络的训练方法深度神经网络的训练方法通常采用反向传播算法。

该算法通过计算网络输出值与实际结果之间的误差,然后按照一定的规则进行权重调整,从而不断完善网络的识别能力。

此外,还有很多针对深度神经网络的优化算法,如随机梯度下降法(Stochastic Gradient Descent,SGD)、Adagrad、Adam等。

这些优化算法能够在保证深度神经网络训练效果的同时,加快训练速度。

3. 深度神经网络的应用领域深度神经网络在图像识别、自然语言处理、语音识别等领域取得了广泛应用,为人工智能技术的发展提供了有力的支持。

在图像识别领域,深度神经网络可以对图片进行快速、准确的分类和识别,例如识别车牌、人脸等。

在自然语言处理领域,深度神经网络可以用于自然语言的情感分析、机器翻译、语言模型建立等。

在语音识别领域,深度神经网络能够通过处理语音信号,将语音转化为文本,实现不同语言之间的互识。

4. 深度神经网络的发展趋势随着互联网的不断普及和数据的不断积累,深度神经网络将会在更多的领域得到应用。

而在深度神经网络本身的研究方面,还有一些重要问题需要解决:(1)更高效的训练算法:当前的训练算法还需要不断优化,使深度神经网络能够更加高效地学习和处理数据;(2)更深度的网络结构:随着网络深度的增加,网络模型的复杂度也会不断提高,需要解决网络训练过程中的梯度消失和梯度爆炸问题;(3)更好的可解释性:深度神经网络是一种“黑箱”模型,其内部运作的机制需要更好地解释和理解。

神经网络的现状与发展趋势

神经网络的现状与发展趋势一、引言人工神经网络(Artificial Neural Network, ANN)是一种通过模拟人类神经系统实现信息处理、表达和识别的计算模型。

自 1943 年 McCulloch 和 Pitts 提出 ANNs 模型以来,神经网络成为了人工智能领域研究的热点之一,并在计算机视觉、语音识别、自然语言处理、数据挖掘、模式识别等方面取得了卓越成果。

随着技术和应用的不断深入,神经网络技术也在不断发展和成熟。

本文将阐述神经网络的现状与发展趋势。

二、神经网络的现状1.神经网络应用领域广泛神经网络现在应用在各个领域中,包括医疗、金融、保险、制造业、游戏等。

在医疗领域中,神经网络广泛应用于癌症筛查、药物研发、疾病预测等方面;在金融领域中,神经网络被用于股票价格预测、风险评估、欺诈检测等方面;在游戏领域中,神经网络被广泛用于图像处理、行为预测等方面。

神经网络在这些领域中具有较高的精度和灵活性,成为了人工智能技术中不可或缺的一部分。

2.深度学习技术的广泛应用深度学习作为神经网络技术的分支之一,逐渐成为了人工智能应用的主流。

深度学习通过多个隐层来逐步提取数据的高层次特征,大幅度提高了模型的准确性和鲁棒性。

目前,深度学习模型已经迅速应用于语音识别、机器翻译、自然语言处理、图像、视频等多个领域中。

深度学习的发展极大地促进了人工智能技术的研究和应用。

3.大数据技术的支持大数据技术是神经网络技术得以快速发展和应用的重要因素。

神经网络需要大量的数据进行训练和调整,而大数据时代的到来使得海量数据的存储和挖掘变得更加容易。

此外,人工智能应用也逐渐从精准分析转向预测和决策,并需要从大规模数据中发现规律和趋势。

大数据技术在神经网络技术的发展和应用中发挥了重要的作用。

三、神经网络的发展趋势1.自适应神经网络的发展传统的神经网络技术需要大量的人工调试和参数设置,而自适应神经网络技术可以根据自身的表现动态调整参数,自我进化。

随机神经网络发展现状综述

随机神经网络发展现状综述一、本文概述随着和机器学习技术的迅猛发展,神经网络已成为一种强大的工具,广泛应用于各种领域,如计算机视觉、语音识别、自然语言处理、游戏等。

其中,随机神经网络作为一种新兴的神经网络架构,近年来引起了广泛的关注和研究。

本文旨在综述随机神经网络的发展现状,包括其基本原理、应用领域、挑战与前景等,以期为读者提供一个全面而深入的了解。

随机神经网络,顾名思义,是一种在神经网络中引入随机性的网络架构。

与传统的深度学习模型相比,随机神经网络在权重初始化、激活函数选择、网络结构等方面具有更高的灵活性和随机性。

这种随机性不仅有助于提升模型的泛化能力,还能在一定程度上解决深度学习模型中的一些固有问题,如过拟合、梯度消失等。

本文首先简要介绍了随机神经网络的基本概念和发展历程,然后重点分析了其在各个应用领域中的表现。

在此基础上,本文还深入探讨了随机神经网络所面临的挑战,如如何平衡随机性与稳定性、如何设计有效的训练算法等。

本文展望了随机神经网络未来的发展趋势和研究方向,以期为推动该领域的发展提供有益的参考。

二、随机神经网络的理论基础随机神经网络(Random Neural Networks, RNNs)的理论基础主要建立在概率论、统计学习理论以及优化算法的基础之上。

其核心思想是通过引入随机性来增强网络的泛化能力和鲁棒性,同时减少过拟合的风险。

在概率论方面,随机神经网络利用随机权重和随机连接来模拟人脑神经元的随机性和不确定性。

这种随机性可以在训练过程中引入噪声,从而提高网络对噪声数据和未知数据的处理能力。

同时,随机性还有助于探索更多的解空间,增加网络的多样性,避免陷入局部最优解。

在统计学习理论方面,随机神经网络通过引入正则化项来控制模型的复杂度,防止过拟合现象的发生。

正则化项通常包括权重衰减、dropout等策略,这些策略可以在训练过程中随机关闭一部分神经元或连接,从而减少网络的复杂度,提高泛化能力。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

神经网络最新发展综述学校:上海海事大学专业:物流工程姓名:***学号:************神经网络最新发展综述摘要:作为联接主义智能实现的典范,神经网络采用广泛互联的结构与有效的学习机制来模拟人脑信息处理的过程,是人工智能发展中的重要方法,也是当前类脑智能研究中的有效工具。

目前,模拟人脑复杂的层次化认知特点的深度学习成为类脑智能中的一个重要研究方向。

通过增加网络层数所构造的“深层神经网络”使机器能够获得“抽象概念”能力,在诸多领域都取得了巨大的成功,又掀起了神经网络研究的一个新高潮。

本文分8个方面综述了其当前研究进展以及存在的问题,展望了未来神经网络的发展方向。

关键词: 类脑智能;神经网络;深度学习;大数据Abstract: As a typical realization of connectionism intelligence, neural network, which tries to mimic the information processing patterns in the human brain by adopting broadly interconnected structures and effective learning mechanisms, is an important branch of artificial intelligence and also a useful tool in the research on brain-like intelligence at present. Currently, as a way to imitate the complex hierarchical cognition characteristic of human brain, deep learning brings an important trend for brain-like intelligence. With the increasing number of layers, deep neural network entitles machines the capability to capture “abstract concepts” and it has achieved great success in various fields, leading a new and advanced trend in neural network research. This paper summarizes the latest progress in eight applications and existing problems considering neural network and points out its possible future directions.Key words : artificial intelligence; neural network; deep learning; big data1 引言实现人工智能是人类长期以来一直追求的梦想。

虽然计算机技术在过去几十年里取得了长足的发展,但是实现真正意义上的机器智能至今仍然困难重重。

伴随着神经解剖学的发展,观测大脑微观结构的技术手段日益丰富,人类对大脑组织的形态、结构与活动的认识越来越深入,人脑信息处理的奥秘也正在被逐步揭示。

如何借助神经科学、脑科学与认知科学的研究成果,研究大脑信息表征、转换机理和学习规则,建立模拟大脑信息处理过程的智能计算模型,最终使机器掌握人类的认知规律,是“类脑智能”的研究目标。

类脑智能是涉及计算科学、认知科学、神经科学与脑科学的交叉前沿方向。

类脑智能的实现离不开大脑神经系统的研究。

众所周知,人脑是由几十多亿个高度互联的神经元组成的复杂生物网络,也是人类分析、联想、记忆和逻辑推理等能力的来源。

神经元之间通过突触连接以相互传递信息,连接的方式和强度随着学习发生改变,从而将学习到的知识进行存储。

模拟人脑中信息存储和处理的基本单元-神经元而组成的人工神经网络模型具有自学习与自组织等智能行为,能够使机器具有一定程度上的智能水平。

神经网络的计算结构和学习规则遵照生物神经网络设计,在数字计算机中,神经细胞接收周围细胞的刺激并产生相应输出信号的过程可以用“线性加权和”及“函数映射”的方式来模拟,而网络结构和权值调整的过程用优化学习算法实现。

按照该方式建立的这种仿生智能计算模型虽然不能和生物神经网络完全等价和媲美,但已经在某些方面取得了优越的性能。

目前神经网络已经发展了上百种模型,在诸如手写体识别、显著性检测、语音识别和图像识别、模式识别、人机交互、优化算法、深度学习等技术领域取得了非常成功的应用。

2.各领域简单介绍2.1手写体识别2009年,认识到自由手写文本是一个具有挑战性的任务。

草书分割或重叠的字符的困难,与需要利用周围的环境相结合,导致了较低的识别率,即使是当时最好的识别。

Graves Alex等人[1]提出了一种基于一种新型的递归神经网络,专门为序列标注任务设计的,其中数据是很难段和含有远距离双向的相互依存关系的一种方法。

在两个大型无约束手写数据库的实验中,该方法实现了对在线数据79.7%,而上的脱机数据74.1%的单词识别精度,显著超越国家的最先进的基于HMM的系统。

此外,证明了网络的鲁棒性词汇的大小,测量其隐层的个人影响力。

2010年,Ciresan D.C.等人[2]使用整个未变形的训练集进行验证,不浪费训练图像。

原始灰度图像的像素强度的范围从0(背景)到255(最高前景强度)。

每幅图像的28×28 =784个像素被映射到真实值在[1.0,1.0],和被馈送到对NN输入层。

使用2至9隐藏层和单位数目不等的隐藏单元来培养MLPs,。

大多是每一层隐藏单元的数量向输出层(表1)降低,但不都是这样。

结合AF NE(旋转,缩放和水平剪切)和弹性变形,在每一个初划时代整个MNIST训练集被变形。

小型网络初步实验得到一些参数。

表1的结果表明:极具竞争力的MNIST手写基准,单精度浮点基于GPU的神经网络超越所有先前报告的结果,其中包括涉及专门的架构,无监督的训练前,学习机等分类训练集足够大小的组合更为复杂的方法获得的通过适当地变形的图像被获得。

当然,这种方法并不局限于手写,显然为许多视觉和其他模式识别问题带来了很大的希望。

表1 MNIST测试的错误率2012年,Alexander Goltsev等人[3]对图像识别(名为里拉的功能)的手写体数字识别的任务进行了研究。

两个神经网络分类被认为-改性3层感知里拉和模块化组件的神经网络。

提出的特征选择的方法,用于分析形成在神经网络分类器的初步学习过程的连接权重。

在使用的手写体数字的MNIST数据库的实验中,特征选择过程允许减少的特征数目(从60000至7000)保可比的识别能力,同时加速计算。

里拉感知和模块化装配神经网络的实验比较完成的,这表明了模块化组装神经网络的识别能力是有所好转。

2.2显著性检测2015年,Wang L.J等人[4]由局部估计和全局搜索整合提出了一个深度网络的显著性检测算法。

在局部估计阶段,我们通过使用局部学习功能的补丁,在全局搜索阶段,局部的显着图与全局的对比度和几何信息一起作为整体特征描述SETOF目标和IDATE区域.深层神经网络(DNN-G)进行训练来进行预测。

如图1。

图1 局部估计和全局搜索结合结构图由于低层次的显著性线索或先验不能够产生足够好的显着性检测结果,特别是当显著对象在低对比度的背景与混乱的视觉外观中的时候。

Zhao R等人[5]提出一个为显著性检测的多情景深度学习框架,该框架采用深度卷积神经网络在图像中去检测目标的显著性,全局背景和局部背景综合考虑,共同塑造一个统一的多背景深度学习框架。

为深度卷积神经网络提供更好的初始化,探究了不同的预训练策略和一个设计用多背景模型适应显著性检测的特殊任务预训练方案。

在五个公共数据集实验,结果表明不错。

整体多环境模型:超像素中心的输入窗口的预测是通过估计显着性概率执行的。

score(x gc , x lc ) = P(y = 1 | x gc , x lc ; θ 1 ), (1)x gc,x lc分别是全局背景和局部背景模型倒数第二层的输出,y是中心超像素的显著性预测,y=1时是显著性超像素,y=0时是背景。

训练了一个二元分类在最后一个网络层的顶部,为了分类背景和显著性,通过在分类结果和全局标签之间统一的函数的最小值。

L( θ; {x (i)gc ,x(i)lc,y (i) } mi=1 ) (2)框架的参数可以分为几个部分。

θ j = { w gc,j , w lc,j , α, β} w gc,j是全局背景模型中神经网络的最后一层参数,w lc,j是局部背景模型的最后一层参数,α,β 是一个含糊不清的模型功能控制局部背景模型的需要的参数。

目的是推断标签的概率同时通过俩个组件。

2.3语音识别隐马尔可夫模型(HMM)已经被国家认可的声学建模的最先进的技术,尽管他们不切实际的独立性假设和隐藏状态的非常有限的代表能力。

坚定信念网络(动态贝叶斯)被证明是对各种机器学习问题非常有效,Mohamed A.R等人[6]在2011年采用动态Bayesian声学建模。

在标准TIMIT语料库,动态贝叶斯网在TIMIT核心试验等的电话实现了23.0%的错误率。

高斯混合模型是用于模拟隐马尔可夫模型的语音识别的发光分布的显性技术。

Mohamed A.R[7]在2012年证明,在TIMIT数据集可以通过包含的特征和非常大量的参数,用很多层深神经网络代替高斯混合模型来实现更好的手机识别。

这些网络的第一预训练如光谱特征向量的窗的多层生成模型,而不利用任何区别信息。

一旦生成前培训设计的功能,使用反向传播小幅调整功能,在预测单音隐马尔可夫模型的状态的概率分布时进行微调,以使他们更好地进行判别。

E (v,ℎ|θ)=−∑∑w ij H j=1V i=1v i ℎj −∑b i v i V i=1−∑a j ℎj H j=1 (1)P (v |θ)=∑e −E(v,ℎ))ℎ∑∑e −E(u,ℎ)ℎu (2)P(ℎj =1|v,θ)=σ(a j +∑w ij V i=1v i ) (3) P (v i =1|ℎ,θ)=σ(b i +∑w ij H j=1ℎj ) (4) ∆w ij ∞<v i h j >data −<v i h j >reconstruction (5) E (v,ℎ|θ)=∑(v i −b i )22V i=1−∑∑w ij H j=1V i=1v i h j −∑a j h j H j=1 (6)P (v i |ℎ,θ)=N( b i +∑w ij H j=1ℎi ,1) (7)Dahl G.E.等人[8]在2012年提出了一种新的上下文相关(CD )模型,它采用深信念网络进行电话确认,对大词汇量语音识别(LVSR )。