信息论基础第二版习题答案

信息论基础各章参考答案

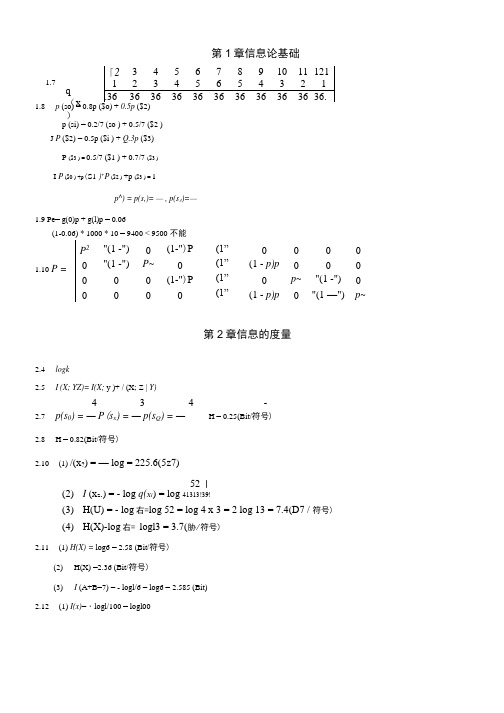

各章参考答案2.1. (1)4.17比特 ;(2)5.17比特 ; (3)1.17比特 ;(4)3.17比特2.2. 1.42比特2.3. (1)225.6比特 ;(2)13.2比特2.4. (1)24.07比特; (2)31.02比特2.5. (1)根据熵的可加性,一个复合事件的平均不确定性可以通过多次实验逐步解除。

如果我们使每次实验所获得的信息量最大。

那么所需要的总实验次数就最少。

用无砝码天平的一次称重实验结果所得到的信息量为log3,k 次称重所得的信息量为klog3。

从12个硬币中鉴别其中的一个重量不同(不知是否轻或重)所需信息量为log24。

因为3log3=log27>log24。

所以在理论上用3次称重能够鉴别硬币并判断其轻或重。

每次实验应使结果具有最大的熵。

其中的一个方法如下:第一次称重:将天平左右两盘各放4枚硬币,观察其结果:①平衡 ②左倾 ③右倾。

ⅰ)若结果为①,则假币在未放入的4枚币,第二次称重:将未放入的4枚中的3枚和已称过的3枚分别放到左右两盘,根据结果可判断出盘中没有假币;若有,还能判断出轻和重,第三次称重:将判断出含有假币的三枚硬币中的两枚放到左右两盘中,便可判断出假币。

ⅱ)若结果为②或③即将左盘中的3枚取下,将右盘中的3枚放到左盘中,未称的3枚放到右盘中,观察称重砝码,若平衡,说明取下的3枚中含假币,只能判出轻重,若倾斜方向不变,说明在左、右盘中未动的两枚中其中有一枚为假币,若倾斜方向变反,说明从右盘取过的3枚中有假币,便可判出轻重。

(2)第三次称重 类似ⅰ)的情况,但当两个硬币知其中一个为假,不知为哪个时,第三步用一个真币与其中一个称重比较即可。

对13个外形相同的硬币情况.第一次按4,4,5分别称重,如果假币在五个硬币的组里,则鉴别所需信息量为log10>log9=2log3,所以剩下的2次称重不能获得所需的信息.2.6. (1)215log =15比特; (2) 1比特;(3)15个问题2. 7. 证明: (略) 2.8. 证明: (略)2.9.31)(11=b a p ,121)(21=b a p ,121)(31=b a p ,61)()(1312==b a b a p p ,241)()()()(33233222====b a b a b a b a p p p p。

信息论基础与应用(第2版)

读书笔记

读书笔记

这是《信息论基础与应用(第2版)》的读书笔记模板,可以替换为自己的心得。

精彩摘录

精彩摘录

这是《信息论基础与应用(第2版)》的读书笔记模板,可以替换为自己的精彩内容摘录。

谢谢观看

2.6.1连续信源的相对熵 2.6.2连续信源最大熵定理 2.6.3连续信源的互信息

2.7熵计算及熵应用

2.7.1熵计算 2.7.2熵信息应用

3.1信道分类和参数 表示

3.2离散单符号信道 及其容量

3.3离散序列信道及 其容量

3.4连续信道及其容 量

3.5信道容量计 算及MATLAB程

序实现

习题3

3.2离散单符号信道及其容量

3.2.1信道容量定义 3.2.2离散单符号无噪信道及其容量 3.2.3离散单符号有噪信道及其容量

3.3离散序列信道及其容量

3.3.1并联信道 3.3.2和信道 3.3.3扩展信道

3.4连续信道及其容量

3.4.1时间离散信道及其容量 3.4.2时间连续信道及其容量

3.5信道容量计算及MATLAB程序实现

5.3离散信道编码定理

5.3.1有噪信道编码定理 5.3.2有噪信道编码逆定理

5.4信道编码方法

5.4.1线性分组码 5.4.2循环码 5.4.3卷积码

5.5信道编码MATLAB计算实现

5.5.1 RS码 5.5.2 Turbo码 5.5.3 LDPC码 5.5.4 Polar码

6.1相关信源及可达 速率区域

6.2多址接入信道及 其容量区域

6.3广播信道及其容 量区域

习题6

6.2多址接入信道及其容量区域

6.2.1离散二址接入信道及其容量区域 6.2.2高斯加性二址接入信道及其容量区域 6.2.3离散多址接入信道及其容量区域

信息论基础智慧树知到课后章节答案2023年下潍坊学院

信息论基础智慧树知到课后章节答案2023年下潍坊学院潍坊学院第一章测试1.信息论的奠基人是()。

A:香农 B:阿姆斯特朗 C:哈特利 D:奈奎斯特答案:香农2.下列不属于信息论的研究内容的是()。

A:纠错编码 B:信息的产生 C:信道传输能力 D:信源、信道模型答案:信息的产生3.下列不属于消息的是()A:文字 B:图像 C:信号 D:语音答案:信号4.信息就是消息. ()A:错 B:对答案:错5.信息是不可以度量的,是一个主观的认识。

()A:错 B:对答案:错6.任何已经确定的事物都不含有信息。

()A:对 B:错答案:对7.1948年香农的文章《通信的数学理论》奠定了香农信息理论的基础。

()A:错 B:对答案:对8.信息论研究的目的就是要找到信息传输过程的共同规律,以提高信息传输的(),使信息传输系统达到最优化。

A:有效性 B:认证性 C:可靠性 D:保密性答案:有效性;认证性;可靠性;保密性9.下列属于香农信息论的主要研究理论的是()。

A:压缩理论 B:调制理论 C:保密理论 D:传输理论答案:压缩理论;保密理论;传输理论10.信源编码的作用包含()。

A:检错纠错 B:对信源的输出进行符号变换 C:数据压缩 D:提升信息传输的安全性答案:对信源的输出进行符号变换;数据压缩第二章测试1.信息传输系统模型中,用来提升信息传输的有效性的部分为()A:信源 B:信道编码器、信道译码器 C:信道 D:信源编码器、信源译码器答案:信源编码器、信源译码器2.对于自信息,以下描述正确的是()A:以2为底时,单位是奈特。

B:以2为底时,单位是比特。

C:以10为底时,单位是奈特。

D:以e为底时,单位是比特答案:以2为底时,单位是比特。

3.信息熵的单位是()A:比特 B:比特每符号 C:无法确定答案:比特每符号4.必然事件和不可能事件的自信息量都是0 。

()A:错 B:对答案:错5.概率大的事件自信息量大。

信息论基础教材习题答案.docx

第

9.6共有28=256个码字,不能由一个码字的循环产生所有的码字,因为码长为8位,由一个码字循环移位 最多能产生8个码字。

9.7根据伴随式定义:5(x)=j(x) [mod g(x)],由于码多项式都是g(x)的倍式,如果接受矢量y(x)是码多 项式,则它的的伴随式等于0,如果y(Q不是码多项式,则伴随式s(Q不等于0。

0

0

0

0

0

1

1

0

1

0

0

0

0

0

0

0

0

0

0

1

0

1

0

0

1

0

0

0

0

0

0

0

0

0

1

1

0

0

0

0

1

0

0

0

0

0

0

0

0

1

1

1

0

0

0

0

1

0

0

0

0

0

0

1

0

0

1

G =

0

0

0

0

0

1

0

0

0

0

0

1

1

1

0

0

0

0

0

0

0

1

0

0

0

0

1

0

1

1

0

0

0

0

0

0

0

1

0

0

0

1

1

0

0

0

0

0

0

0

0

0

0

信息论基础知识

选择题:

信息论的主要创立者是?

A. 牛顿

B. 爱因斯坦

C. 香农(正确答案)

D. 图灵

在信息论中,熵是用来衡量什么的?

A. 信息的不确定性(正确答案)

B. 信息的速度

C. 信息的长度

D. 信息的重量

下列哪个不是信息论中的基本概念?

A. 熵

B. 信道容量

C. 编码

D. 动力学(正确答案)

信道容量是指什么?

A. 信道能够无错误传输的最大信息率(正确答案)

B. 信道的物理长度

C. 信道的宽度

D. 信道的重量

在信息论中,什么是冗余信息?

A. 重复或无用的信息(正确答案)

B. 重要的信息

C. 加密的信息

D. 解密的信息

数据压缩的主要目的是什么?

A. 提高数据的传输速度

B. 减少存储空间的占用(正确答案)

C. 增加数据的安全性

D. 改变数据的格式

下列哪个不是信息编码的方式?

A. 哈夫曼编码

B. 游程编码

C. JPEG编码(正确答案)

D. 算术编码

在信息论中,什么是噪声?

A. 信号中的干扰或不需要的成分(正确答案)

B. 信号的强度

C. 信号的频率

D. 信号的相位

误码率是用来衡量什么的?

A. 信道传输信息的准确性(正确答案)

B. 信道传输信息的速度

C. 信道传输信息的数量

D. 信道传输信息的距离。

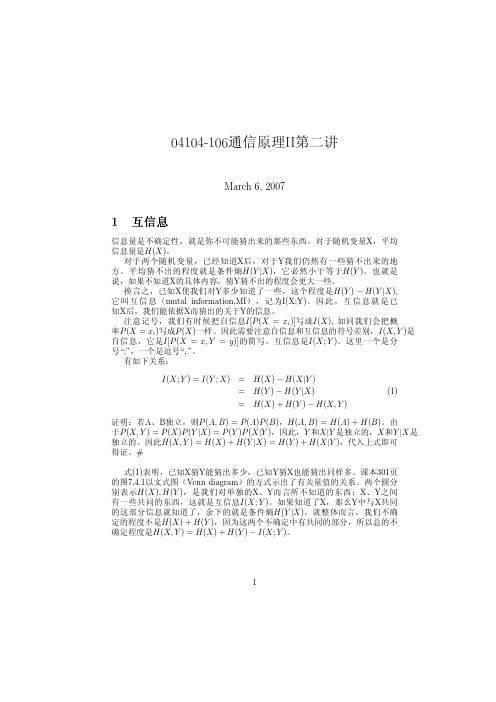

LN2-信息论基础2

平

均

只

需要H∞

(X

)比

特

。

压

缩

比

极

限

可

达

到

H∞ (X ) H0 (X )

。

这பைடு நூலகம்

个

比

值

也

叫

信

源

的

效

率η,相应定义信源的冗余度为

R

=

1

−

η

=

H0(X) − H∞(X) H0 (X )

=

1

−

H∞ (X ) H0 (X )

实际信源的特征往往是:符号不等概,符号之间有很强的相关性。因此它

一定可以压缩,具体方法的压缩能力或许有区别,最大的压缩程度可由η或R衡

扣除了过去所有符号在XL上的贡献,只传送纯新的增量信息。如果我们只考 虑A个符号,即对于第L个输出符号,只扣除前A−1个符号的贡献,那么效率就

会低一些,平均每符号最少需要的比特数将是HA(X) H(XL|XL−1, · · · , XL−A+1)。

3

H2(X) = H(XL|XL−1)只考虑前一个符号的贡献;H1(X) H(X)只考虑单个 符号,不考虑相关性,但考虑了不等概特性;H0 (X )则连不等概都不考虑,即 不进行压缩。下面的不等式是显而易见的

办法,如课本上的例7.6.2。我们对此不作特别要求,只是再次重申一下信息论

的观点:

传输(或存储)序列{X1, X2, · · · , XL}(L非常大)所需要的比特数最少 是H(X1, X2, · · · , XL),折合到每个符号仅为:

H∞ (X )

lim

L→∞

H (X1 ,

X2, · L

·

信息论第一章答案

《信息论基础》习题答案第一章信息与信息的度量-1 解:根据题意,“没有不及格”或“pass”的概率为因此当教师通知某甲“没有不及格”后,甲获得信息在已知“pass”后,成绩为“优”(A),“良”(B),“中”(C)和“及格”(D)的概率相同:为确定自己的成绩,甲还需信息1-2 解:该锁共可设个数值,开锁号码选取每一个值的概率都相同,所以-3 解:由于每个汉字的使用频度相同,它们有相同的出现概率,即因此每个汉字所含的信息量为每个显示方阵能显示种不同的状态,等概分布时信息墒最大,所以一个显示方阵所能显示的最大信息量是显示方阵的利用率或显示效率为-4 解:第二次发送无误收到,因此发、收信息量相等,均为第一次发出的信息量为第一次传送的信息量为两次发送信息量之差:-5 解:由信息熵定义,该信源输出的信息熵为消息ABABBA所含的信息量为消息FDDFDF所含的信息量为6位长消息序列的信息量期望值为三者比较为-6 解:由信息熵定义,该信源输出的信息熵为消息ABABBA所含的信息量为消息FDDFDF所含的信息量为6位长消息序列的信息量期望值为三者比较为-7 解:X和Y的信息熵分别为因传输无误,信宿收到的信息等于发送信息。

因此当第一个字符传送结束后,两信宿收到信息量等于发送的信息量,即整个序列发送结束后,由于符号间独立,两信宿收到的总信息量是平均每次(每个符号)发送(携带)的信息为-8 解:(a) 根据扑克牌的构成,抽到“红桃”、“人头”、“红桃人头”的概率分别为13/52=1/4、12/52=3/13和3/52,所以当告知抽到的那张牌是:“红桃”、“人头”和“红桃人头”时,由信息量定义式(1-5),所得到的信息各是(b) 在52张扑克牌中,共有红人头6张(3张红桃,3张方块),因此在已知那张牌是红人头,为确切地知道是哪张牌,还需要信息。

-9 解:一个二元信息所含的最大信息熵是确定的,所以当以2或5为底时,最大信息熵相同,即1 bit = (该信息量单位)或 1 (该信息量单位) = 2.33 bits同理, 1 nat = 0.62 (该信息量单位)或 1(该信息量单位) = 1.61 nats。

信息论基础与编码课后题答案(第三章)

3-1 设有一离散无记忆信源,其概率空间为12()0.60.4X x x P x ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦,信源发出符号通过一干扰信道,接收符号为12{,}Y y y =,信道传递矩阵为51661344P ⎡⎤⎢⎥=⎢⎥⎢⎥⎢⎥⎣⎦,求: (1) 信源X 中事件1x 和2x 分别含有的自信息量;(2) 收到消息j y (j =1,2)后,获得的关于i x (i =1,2)的信息量; (3) 信源X 和信宿Y 的信息熵;(4) 信道疑义度(/)H X Y 和噪声熵(/)H Y X ; (5) 接收到消息Y 后获得的平均互信息量(;)I X Y 。

解:(1)12()0.737,() 1.322I x bit I x bit ==(2)11(;)0.474I x y bit =,12(;) 1.263I x y bit =-,21(;) 1.263I x y bit =-,22(;)0.907I x y bit =(3)()(0.6,0.4)0.971/H X H bit symbol ==()(0.6,0.4)0.971/H Y H bit symbol ==(4)()(0.5,0.1,0.1,0.3) 1.685/H XY H bit symbol ==(/) 1.6850.9710.714/H X Y bit symbol =-= (/)0.714/H Y X bit symbol =(5)(;)0.9710.7140.257/I X Y bit symbol =-=3-2 设有扰离散信道的输入端是以等概率出现的A 、B 、C 、D 四个字母。

该信道的正确传输概率为0.5,错误传输概率平均分布在其他三个字母上。

验证在该信道上每个字母传输的平均信息量为0.21比特。

证明:信道传输矩阵为:11112666111162661111662611116662P ⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦,信源信宿概率分布为:1111()(){,,,}4444P X P Y ==, H(Y/X)=1.79(bit/符号),I(X;Y)=H(Y)- H(Y/X)=2-1.79=0.21(bit/符号)3-3 已知信源X 包含两种消息:12,x x ,且12()() 1/2P x P x ==,信道是有扰的,信宿收到的消息集合Y 包含12,y y 。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

信息论基础第二版习题答案

信息论是一门研究信息传输和处理的学科,它的基础理论是信息论。

信息论的基本概念和原理被广泛应用于通信、数据压缩、密码学等领域。

而《信息论基础》是信息论领域的经典教材之一,它的第二版是对第一版的修订和扩充。

本文将为读者提供《信息论基础第二版》中部分习题的答案,帮助读者更好地理解信息论的基本概念和原理。

第一章:信息论基础

1.1 信息的定义和度量

习题1:假设有一个事件发生的概率为p,其信息量定义为I(p) = -log(p)。

求当p=0.5时,事件的信息量。

答案:将p=0.5代入公式,得到I(0.5) = -log(0.5) = 1。

习题2:假设有两个互斥事件A和B,其概率分别为p和1-p,求事件A和B 同时发生的信息量。

答案:事件A和B同时发生的概率为p(1-p),根据信息量定义,其信息量为

I(p(1-p)) = -log(p(1-p))。

1.2 信息熵和条件熵

习题1:假设有一个二进制信源,产生0和1的概率分别为p和1-p,求该信源的信息熵。

答案:根据信息熵的定义,信源的信息熵为H = -plog(p) - (1-p)log(1-p)。

习题2:假设有两个独立的二进制信源A和B,产生0和1的概率分别为p和1-p,求两个信源同时发生时的联合熵。

答案:由于A和B是独立的,所以联合熵等于两个信源的信息熵之和,即

H(A,B) = H(A) + H(B) = -plog(p) - (1-p)log(1-p) - plog(p) - (1-p)log(1-p)。

第二章:信道容量

2.1 信道的基本概念

习题1:假设有一个二进制对称信道,其错误概率为p,求该信道的信道容量。

答案:对于二进制对称信道,其信道容量为C = 1 - H(p),其中H(p)为错误概率为p时的信道容量。

习题2:假设有一个高斯信道,信道的信噪比为S/N,求该信道的信道容量。

答案:对于高斯信道,其信道容量为C = 0.5log(1 + S/N)。

2.2 信道编码

习题1:假设有一个二进制对称信道,其错误概率为p,要使得传输的信息错误率小于等于ε,应该选择什么样的编码方式?

答案:根据信道编码定理,要使得传输的信息错误率小于等于ε,应该选择编码方式,使得编码后的码字长度满足n > H(p)/ε。

习题2:假设有一个高斯信道,信道的信噪比为S/N,要使得传输的信息错误率小于等于ε,应该选择什么样的编码方式?

答案:对于高斯信道,要使得传输的信息错误率小于等于ε,应该选择编码方式,使得编码后的码字长度满足n > 0.5log(1 + S/N)/ε。

通过以上习题的解答,读者可以更好地理解信息论的基础概念和原理,对于信息的度量、信息熵、信道容量和信道编码有更深入的理解。

信息论作为一门重要的学科,不仅在通信领域有广泛应用,还在数据压缩、密码学等领域发挥着重要作用。

希望读者通过学习《信息论基础第二版》和本文提供的习题答案,能够对信息论有更全面的认识和理解。