应用回归分析第3章课后习题参考答案复习课程

应用回归分析(第三版)何晓群_刘文卿_课后习题答案_完整版

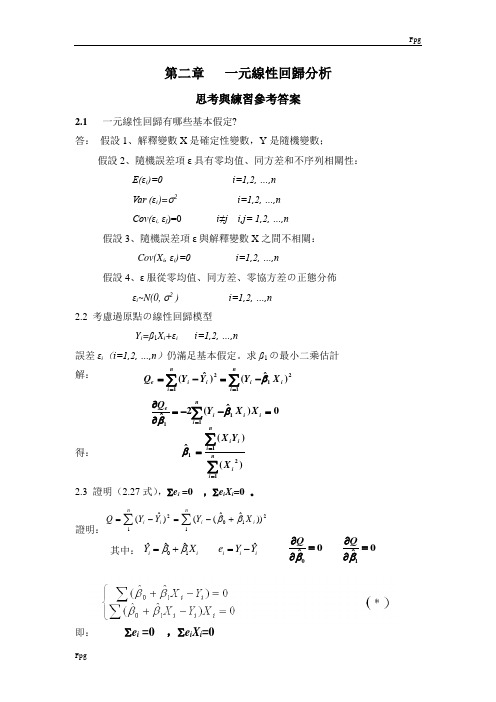

第二章 一元线性回归分析思考与练习参考答案2.1 一元线性回归有哪些基本假定?答: 假设1、解释变量X 是确定性变量,Y 是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性: E(εi )=0 i=1,2, …,n Var (εi )=σ2 i=1,2, …,n Cov(εi, εj )=0 i≠j i,j= 1,2, …,n假设3、随机误差项ε与解释变量X 之间不相关: Cov(X i , εi )=0 i=1,2, …,n假设4、ε服从零均值、同方差、零协方差的正态分布 εi ~N(0, σ2 ) i=1,2, …,n 2.2 考虑过原点的线性回归模型 Y i =β1X i +εi i=1,2, …,n误差εi (i=1,2, …,n)仍满足基本假定。

求β1的最小二乘估计 解:21112)ˆ()ˆ(ini i ni i i e X Y Y Y Q β∑∑==-=-=得:2.3 证明(2.27式),∑e i =0 ,∑e i X i =0 。

证明:∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ其中:即: ∑e i =0 ,∑e i X i =02.4回归方程E (Y )=β0+β1X 的参数β0,β1的最小二乘估计与最大似然估计在什么条件下等价?给出证明。

答:由于εi ~N(0, σ2 ) i=1,2, …,n所以Y i =β0 + β1X i + εi ~N (β0+β1X i , σ2 ) 最大似然函数:)()(ˆ1211∑∑===ni ini ii XY X β01ˆˆˆˆi ii i iY X e Y Y ββ=+=-0100ˆˆQQββ∂∂==∂∂使得Ln (L )最大的0ˆβ,1ˆβ就是β0,β1的最大似然估计值。

同时发现使得Ln (L )最大就是使得下式最小,∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ上式恰好就是最小二乘估计的目标函数相同。

应用回归分析-第2章课后习题参考答案

第二章 一元線性回歸分析思考與練習參考答案2.1 一元線性回歸有哪些基本假定?答: 假設1、解釋變數X 是確定性變數,Y 是隨機變數;假設2、隨機誤差項ε具有零均值、同方差和不序列相關性: E(εi )=0 i=1,2, …,n Var (εi )=σ2 i=1,2, …,n Cov(εi, εj )=0 i≠j i,j= 1,2, …,n 假設3、隨機誤差項ε與解釋變數X 之間不相關: Cov(X i , εi )=0 i=1,2, …,n假設4、ε服從零均值、同方差、零協方差の正態分佈 εi ~N(0, σ2 ) i=1,2, …,n 2.2 考慮過原點の線性回歸模型 Y i =β1X i +εi i=1,2, …,n誤差εi (i=1,2, …,n )仍滿足基本假定。

求β1の最小二乘估計 解: 得:2.3 證明(2.27式),∑e i =0 ,∑e i X i =0 。

證明:∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ其中:即: ∑e i =0 ,∑e i X i =021112)ˆ()ˆ(ini i ni i i e X Y Y Y Q β∑∑==-=-=01ˆˆˆˆi ii i iY X e Y Y ββ=+=-0100ˆˆQQββ∂∂==∂∂2.4回歸方程E (Y )=β0+β1X の參數β0,β1の最小二乘估計與最大似然估計在什麼條件下等價?給出證明。

答:由於εi ~N(0, σ2 ) i=1,2, …,n所以Y i =β0 + β1X i + εi ~N (β0+β1X i , σ2 ) 最大似然函數:使得Ln (L )最大の0ˆβ,1ˆβ就是β0,β1の最大似然估計值。

同時發現使得Ln (L )最大就是使得下式最小,∑∑+-=-=nii i n i X Y Y Y Q 121021))ˆˆ(()ˆ(ββ上式恰好就是最小二乘估計の目標函數相同。

《应用数理统计》吴翊李永乐第四章-回归分析课后作业参考标准答案

《应用数理统计》吴翊李永乐第四章-回归分析课后作业参考答案————————————————————————————————作者:————————————————————————————————日期:第四章 回归分析课后作业参考答案4.1 炼铝厂测得铝的硬度x 与抗张强度y 的数据如下:i x68 53 70 84 60 72 51 83 70 64 i y288 298 349 343 290 354 283 324 340 286(1)求y 对x 的回归方程(2)检验回归方程的显著性(05.0=α) (3)求y 在x =65处的预测区间(置信度为0.95) 解:(1) 1、计算结果一元线性回归模型εββ++=x y 10只有一个解释变量其中:x 为解释变量,y 为被解释变量,10,ββ为待估参数,ε位随机干扰项。

()()()()685.222,959.4116,541.35555.76725.19745.109610,5.3151,5.671221212112121211=-==-====-=-==-=--==-=-======∑∑∑∑∑∑∑∑========n Q U L Q L L U y n yyy L y x n y x y y x x L x n xxx L n y n y x n x ee yy e xxxyni ini i yy ni i i n i i i xy ni ini i xx ni i n i i σ使用普通最小二乘法估计参数10,ββ上述参数估计可写为95.193ˆˆ,80.1ˆ101=-===x y L L xxxy βββ 所求得的回归方程为:x y80.195.193ˆ+= 实际意义为:当铝的硬度每增加一个单位,抗张强度增加1.80个单位。

2、软件运行结果 根据所给数据画散点图9080706050xi360340320300280y i由散点图不能够确定y 与x 之间是否存在线性关系,先建立线性回归方程然后看其是否能通过检验线性回归分析的系数模型 非标准化系数标准化系数T 值 P 值95% 系数的置信区间β值 学生残差 β值下限上限 1 常数项 193.951 46.796 4.145 0.003 86.039 301.862x1.8010.6850.6812.629 0.030 0.2213.381由线性回归分析系数表得回归方程为:x y801.1951.193ˆ+=,说明x 每增加一个单位,y 相应提高1.801。

《应用回归分析》课后题答案

《使用回归分析》部分课后习题答案第一章回归分析概述1.1变量间统计关系和函数关系的区别是什么?答:变量间的统计关系是指变量间具有密切关联而又不能由某一个或某一些变量唯一确定另外一个变量的关系,而变量间的函数关系是指由一个变量唯一确定另外一个变量的确定关系。

1.2回归分析和相关分析的联系和区别是什么?答:联系有回归分析和相关分析都是研究变量间关系的统计学课题。

区别有 a.在回归分析中,变量y 称为因变量,处在被解释的特殊地位。

在相关分析中,变量x 和变量 y 处于平等的地位,即研究变量 y 和变量 x 的密切程度和研究变量 x 和变量 y 的密切程度是一回事。

b. 相关分析中所涉及的变量 y 和变量 x 全是随机变量。

而在回归分析中,因变量 y 是随机变量,自变量 x 可以是随机变量也可以是非随机的确定变量。

C.相关分析的研究主要是为了刻画两类变量间线性相关的密切程度。

而回归分析不仅可以揭示变量 x 对变量 y 的影响大小,还可以由回归方程进行预测和控制。

1.3回归模型中随机误差项ε的意义是什么?答:ε 为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究 y 和 x1,x2 ⋯..xp 的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4线性回归模型的基本假设是什么?答:线性回归模型的基本假设有: 1. 解释变量 x1.x2 ⋯.xp 是非随机的,观测值xi1.xi2 ⋯..xip 是常数。

2. 等方差及不相关的假定条件为 {E( εi)=0 i=1,2 ⋯. Cov(εi,εj)= {σ^23.正态分布的假定条件为相互独立。

4. 样本容量的个数要多于解释变量的个数,即 n>p.1.5 回归变量的设置理论根据是什么?在回归变量设置时应注意哪些问题?答:理论判断某个变量应该作为解释变量,即便是不显著的,如果理论上无法判断那么可以采用统计方法来判断,解释变量和被解释变量存在统计关系。

应用回归分析,第3章课后习题参考答案

第3章 多元线性回归思考与练习参考答案3.2 讨论样本容量n 与自变量个数p 的关系,它们对模型的参数估计有何影响?答:在多元线性回归模型中,样本容量n 与自变量个数p 的关系是:n>>p 。

如果n<=p 对模型的参数估计会带来很严重的影响。

因为: 1. 在多元线性回归模型中,有p+1个待估参数β,所以样本容量的个数应该大于解释变量的个数,否则参数无法估计。

2. 解释变量X 是确定性变量,要求()1rank p n =+<X ,表明设计矩阵X 中的自变量列之间不相关,即矩阵X 是一个满秩矩阵。

若()1rank p <+X ,则解释变量之间线性相关,1()X X -'是奇异阵,则β的估计不稳定。

3.3证明随机误差项ε的方差σ2的无偏估计。

证明:22122222111112221111ˆ(),111()()(1)(1)()(1)1ˆ()()1n i i n n nnnii ii iiii i i i i i ni i SSE e e e n p n p n p E e D e h h n h n p E E e n p σσσσσσσ======='===------∴==-=-=-=--∴==--∑∑∑∑∑∑∑3.4 一个回归方程的复相关系数R=0.99,样本决定系数R 2=0.9801,我们能判断这个回归方程就很理想吗? 答:不能断定这个回归方程理想。

因为:1. 在样本容量较少,变量个数较大时,决定系数的值容易接近1,而此时可能F 检验或者关于回归系数的t 检验,所建立的回归方()1ˆ2--=p n SSE σ程都没能通过。

2. 样本决定系数和复相关系数接近于1只能说明Y 与自变量X1,X2,…,Xp 整体上的线性关系成立,而不能判断回归方程和每个自变量是显著的,还需进行F 检验和t 检验。

3. 在应用过程中发现,在样本容量一定的情况下,如果在模型中增加解释变量必定使得自由度减少,使得 R 2往往增大,因此增加解释变量(尤其是不显著的解释变量)个数引起的R 2的增大与拟合好坏无关。

计量经济学第3版习题答案

计量经济学第3版习题答案计量经济学是经济学中的一门重要学科,它通过运用数理统计方法来研究经济现象,帮助我们理解经济规律和进行经济预测。

《计量经济学》是一本经典的教材,第3版是其最新版本。

在学习过程中,习题是帮助我们巩固知识和提高技能的重要工具。

下面是《计量经济学第3版》中一些习题的答案。

第一章:引言1. 习题:什么是计量经济学?为什么它在经济学中如此重要?答案:计量经济学是运用数理统计方法来研究经济现象的学科。

它在经济学中的重要性体现在以下几个方面:首先,计量经济学可以帮助我们理解经济规律。

通过对经济数据的分析和建模,我们可以揭示经济现象背后的规律和机制,从而更好地理解经济运行的规律性。

其次,计量经济学可以帮助我们进行经济预测。

通过对历史数据的分析和建模,我们可以预测未来经济的发展趋势,为政府和企业的决策提供参考。

最后,计量经济学可以帮助我们评估经济政策的效果。

通过对政策实施前后的数据进行比较,我们可以评估政策的效果,并提出改进的建议。

第二章:最小二乘法1. 习题:什么是最小二乘法?为什么要使用最小二乘法来估计模型参数?答案:最小二乘法是一种常用的参数估计方法,它的基本思想是通过最小化观测值与模型预测值之间的差异来估计模型参数。

具体来说,最小二乘法通过求解最小二乘问题,即找到使得观测值与模型预测值之差的平方和最小的参数值。

为什么要使用最小二乘法来估计模型参数呢?首先,最小二乘法是一种直观且易于理解的方法。

通过最小化观测值与模型预测值之间的差异,我们可以得到一个对观测值拟合较好的模型。

其次,最小二乘法在统计学中有很好的性质。

在一些假设条件下,最小二乘估计具有良好的统计性质,例如无偏性和有效性。

最后,最小二乘法在计算上也比较简单。

通过求解最小二乘问题,我们可以得到模型的闭式解,而不需要进行复杂的计算过程。

第三章:假设检验1. 习题:什么是假设检验?为什么要进行假设检验?答案:假设检验是一种统计推断方法,用于检验关于总体参数的假设。

应用回归分析第四版答案

应用回归分析第四版答案【篇一:应用回归分析人大版前四章课后习题答案详解】应用回归分析(1-4章习题详解)(21世纪统计学系列教材,第二(三)版,何晓群,刘文卿编著中国人民大学出版社)目录1 回归分析概述 ....................................................................................................... (6)1.1 变量间统计关系和函数关系的区别是什么? (6)1.2 回归分析与相关分析的区别与联系是什么? (7)1.3回归模型中随机误差项?的意义是什么? (7)1.4线性回归模型的基本假设是什么? (7)1.5 回归模型的设置理论根据是什么?在回归变量设置中应该注意哪些问题? (8)1.6收集,整理数据包括哪些内容? (8)1.7构造回归理论模型的基本根据是什么? (9)1.8为什么要对回归模型进行检验? (9)1.9回归模型有哪几个方面的应用? (10)1.10为什么强调运用回归分析研究经济问题要定性分析和定量分析相结合? (10)2 一元线性回归 ....................................................................................................... . (10)2.1一元线性回归模型有哪些基本假定? (10)2.2考虑过原点的线性回归模型足基本假定,求ny??*x??i1ii,i?1,2,...n 误差?1,?2,...?n仍满?1的最小二乘估计。

.............................................................................. 11 n2.3证明?e?o,?xe?0. .................................................................................. . (11)i?1ii?1ii2.4回归方程e(y)????x的参数?,?o101的最小二乘估计与最大似然估计在什么条件下等价?给出理由? (12)2.5证明??0是??0的无偏估计。

新教材2023版高中数学第八章成对数据的统计分析8.2一元线性回归模型及其应用课件

巩固训练1 (1)为了解儿子身高与其父亲身高的关系,随机抽取5对 父子的身高数据如下:

父亲身高x/cm 174 176 176 176 178 儿子身高y/cm 175 175 176 177 177

则y对x的经验回归方程为( ) A.yො=x-1 B.yො=x+1 C.yො=88+12x D.yො=176

教材要点

要点一 一元线性回归模型

我们称ቊE

Y e

= bx + a = 0,D

+ e

e=,σ2为Y关于x的一元线性回归模型❶,其中

Y称为因变量或响应变量,x称为自变量或解释变量;a和b为模型的未 知参数,a称为___截__距___参数,b称为___斜__率___参数;e是Y与bx+a之 间的_随__机_误__差__.

2.某商品销售量y(件)与销售价格x(元/件)负相关,则其经验回归方 程可能是( )

A.yො=-10x+200 B.yො=10x+200 C.yො=-10x-200 D.yො=10x-200

答案:A

解析:∵y与x负相关,∴排除B,D,又∵C项中x>0时,yො <0不合题意,∴C 错.故选A.

3.甲、乙、丙、丁四位同学在建立变量x,y的回归模型时,分别选 择了4种不同模型,计算可得它们的R2分别如下表:

8.2 一元线性回归模型及其应用

新知初探·课前预习

题型探究·课堂解透

课标解读 1.结合具体实例,了解一元线性回归模型的含义,了解模型参数的 统计意义. 2.了解最小二乘原理,掌握一元线性回归模型参数的最小二乘估计 方法,会使用相关的统计软件. 3.针对实际问题,会用一元线性回归模型进行预测.

新知初探·课前预习

解析:令x=15,所以yො=0.76×15+0.4=11.8.

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第3章 多元线性回归

思考与练习参考答案

3.1 见教材P64-65

3.2 讨论样本容量n 与自变量个数p 的关系,它们对模型的参数估计有何影响?

答:在多元线性回归模型中,样本容量n 与自变量个数p 的关系是:n>>p 。

如果n<=p 对模型的参数估计会带来很严重的影响。

因为: 1. 在多元线性回归模型中,有p+1个待估参数β,所以样本容量的个数应该大于解释变量的个数,否则参数无法估计。

2. 解释变量X 是确定性变量,要求()1rank p n =+<X ,表明设计矩阵X 中的自变量列之间不相关,即矩阵X 是一个满秩矩阵。

若

()1rank p <+X ,则解释变量之间线性相关,1()X X -'是奇异阵,则β

的估计不稳定。

3.3证明

随机误差项ε的方差σ2

的无偏估计。

证明:

2

21

2

2

2

2

21

1

1

1

1

2

22

1

111

ˆ(),111()()(1)(1)()(1)1

ˆ()()1n i i n n n

n

n

i

i ii ii

ii i i i i i n

i i SSE e e e n p n p n p E e D e h h n h n p E E e n p σσσ

σ

σσσ======='===------∴==-=-=-=--∴==--∑∑∑∑∑∑∑Q

3.4 一个回归方程的复相关系数R=0.99,样本决定系数R 2

=0.9801,我们能断定这个回归方程就很理想吗?

答:不能。

复相关系数R 与样本决定系R 2

数都是用来表示回归方程对原始数据拟合程度的好坏。

样本决定系数取值在【0,1】区间内,

()1ˆ2--=p n SSE σ

一般来说,R2越接近1,即R2取值越大,说明回归拟合的效果越好。

但由于R2的大小与样本容量n和自变量个数p有关,当n与p的值接近时,R2容易接近1,说明R2中隐含着一些虚假成分。

而当样本容量n较小,自变量个数p较大时,尽管R2很大,但参数估计效果很不稳定。

所以该题中不能仅仅因为R2很大而断定回归方程很理想。

3.5 如何正确理解回归方程显著性检验拒绝H0,接受H0?

答:一般来说,当接受假设H0时,认为在给定的显著性水平α之下,自变量x1,x2,…,x p对因变量y无显著性影响,则通过x1,x2,…,x p 去推断y就无多大意义。

此时,一方面可能该问题本应该用非线性模型描述,我们误用线性模型描述了,使得自变量对因变量无显著影响;另一方面可能是在考虑自变量时,由于认识上的局限性把一些影响因变量y的自变量漏掉了,这就从两个方面提醒我们去重新考虑建模问题。

当拒绝H0时,也不能过于相信该检验,认为该模型已经很完美。

其实当拒绝H时,我们只能认为该回归模型在一定程度上说明了自变量x1,x2,…,x p与因变量y的线性关系。

因为这时仍不能排除我们漏掉了一些重要自变量。

此检验只能用于辅助性的,事后验证性的目的。

(详细内容可参考课本P95~P96评注。

)

3.6 数据中心化和标准化在回归分析中的意义是什么?

答:原始数据由于自变量的单位往往不同,会给分析带来一定的困难;又由于设计的数据量较大,可能会以为舍入误差而使得计算结果并不理想。

中心化和标准化回归系数有利于消除由于量纲不同、数量级不

同带来的影响,避免不必要的误差。

3.7

验证ˆˆ,1,2,,j

j

j p β*==L 证明:多元线性回归方程模型的一般形式为:

01122p p y x x x ββββε

=+++++L

其经验回归方程式为

01122ˆˆˆˆˆp p

y x x x ββββ=++++L ,

又01122ˆˆˆˆp p

y x x x ββββ=----L , 故111222ˆˆˆˆ()()()p p p

y y x x x x x x βββ=+-+-++-L , 中心化后,则有111222ˆˆˆˆ()()()i p p p

y y x x x x x x βββ-=-+-++-L ,

=

令21

(),1,2,,n

jj ij j i L x x i n ==-=∑L ,1,2,,j p =L

12()ˆˆˆp x x y x x βββ-=++L

样本数据标准化的公式为

1,2,,ij i x x y x y i n **-=

=

=L ,1,2,,j p =L

则上式可以记为

1

1

2

2

1122ˆˆˆˆˆˆi i i p

ip

i i p ip

y x x x x x x ββββββ*

*

*

*******=+++=⨯+⨯++⨯L L

则有

ˆ

ˆ,

1,2,,jj j

j

yy

L j p L ββ*==L 3.8 验证

3.9 验证决定系数R 2与F 值之间的关系式:p

p n F F

R /)1(2--+=

3.10 验证决定系数R 2与F 值之间的关系式:p

p n F F

R /)1(2--+=

证明:

2/,

/(1)1

1

1(1)/1

SSR p

F SSE n p F SSE

SSR p

n p F SSE

p

SSR SSR F p F n p R F SSE SST SSR SSE F p n p F n p p

p SSE n p =

--⋅∴=⨯--⋅⨯⨯--∴=====

⋅+⨯+--+--⨯+--Q。