十 大 经 典 排 序 算 法 总 结 超 详 细

中国法制史史料8明代的参考资料与案例

中国法制史史料8——明代的参考资料与案例(一)文献史料1.关于明太祖重典治吏有明一代刑法大概。

太祖开国之初,惩元季贪冒,重绳赃吏,揭诸司犯法者于申明亭以示戒。

又命刑部,凡官吏有犯,宥罪复职,书过榜其门,使自省。

不悛,论如律。

累颁犯谕、戒谕、榜谕,悉象以刑,诰示天下。

及十八年《大诰》成,序之曰:“诸司敢不急公而务私者,必穷搜其原而罪之。

”凡三《诰》所列凌迟、枭示、种诛者,无虑千百,弃市以下万数。

贵溪儒士夏伯启叔侄断指不仕,苏州人才姚润、王谟被征不至,皆诛而籍其家。

“寰中士夫不为君用”之科所由设也。

其《三编》稍宽容,然所记进士监生罪名,自一犯至四犯者犹三百六十四人。

幸不死还职,率戴斩罪治事。

其推原中外贪墨所起,以六曹为罪魁,郭桓为诛首。

郭桓者,户部侍郎也。

帝疑北平二司官吏李彧、赵全德等与桓为奸利,自六部左右侍郎下皆死,赃七百万,词连直省诸官吏,系死者数万人。

核赃所寄借遍天下,民中人之家大抵皆破。

时咸归谤御史余敏、丁廷举。

或以为言,帝乃手诏列桓等罪,而论右审刑吴庸等极刑,以厌天下心,言:“朕诏有司除奸,顾复生奸扰吾民,今后有如此者,遇赦不宥。

”先是,十五年空印事发。

每岁布政司、府州县吏诣户部核钱粮、军需诸事,以道远,预持空印文书,遇部驳即改,以为常。

及是,帝疑有奸,大怒,论诸长吏死,佐贰榜百戍边。

宁海人郑士利上书讼其冤,复杖戍之。

二狱所诛杀已过当。

而胡惟庸、蓝玉两狱,株连死者且四万。

节选自《明史·志第七十·刑法二》凡奸邪进谗言,左使杀人者,斩。

若犯罪律该处死,其大臣小官,巧言谏免,暗邀人心者,亦斩。

若在朝官员,交结朋党,紊乱朝政者皆斩,妻子为奴,财产入官。

若刑部及大小各衙门官吏,不执法律,听从上司官主使,出入人罪者,罪亦如之。

若有不避权势,明具实迹,亲赴御前执法陈诉者,罪坐奸臣,言告之人与免本罪,仍将犯人财产均给充赏,有官者升二等,无官者量与一官,或赏银二千两。

节选自《大明律·吏律·奸党》凡诸衙门官吏及士庶人等,若有上言宰执大臣美政才德者,即是奸党,务要鞫问穷究来历明白,犯人处斩,妻子为奴,财产入官。

周髀算经——精选推荐

周髀算经天⽂算法类三代上之制作,类⾮后世所及,惟天⽂算法则愈阐愈精。

容成造术,颛顼⽴制,⽽测星纪闰,多述帝尧。

在古初已修改渐密矣。

洛下闳以后,利玛窦以前,变法不⼀。

泰西晚出,颇异前规,门户构争,亦如讲学。

然分曹测验,具有实徵,终不能指北为南,移昏作晓,故攻新法者⾄国初⽽渐解焉。

圣祖仁皇帝《御制数理精蕴》诸书,妙契天元,精研化本,於中西两法权衡归⼀,垂范亿年。

海宇承流,递相推衍,⼀时如梅⽂⿍等,测量撰述,亦具有成书。

故⾔天者⾄於本朝,更⽆疑义。

今仰遵圣训,考校诸家,存古法以溯其源,秉新制以究其变,古来疏密,厘然具矣。

若夫占验禨祥,率多诡说。

郑当再⽕,裨灶先诬,旧史各⾃为类,今亦别⼊之术数家。

惟算术、天⽂相为表⾥,《明史·艺⽂志》以算术⼊⼩学类,是古之算术,⾮今之算术也。

今核其实,与天⽂类从焉。

△《周髀算经》·⼆卷、《⾳义》·⼀卷(永乐⼤典本)案《隋书·经籍志·天⽂类》,⾸列《周髀》⼀卷,赵婴注。

⼜⼀卷,甄鸾重述。

《唐书·艺⽂志》李淳风《释周髀》⼆卷,与赵婴、甄鸾之注列之天⽂类。

⽽历算类中复列李淳风注《周髀算经》⼆卷,盖⼀书重出也。

是书内称周髀长⼋尺,夏⾄之⽇,晷⼀尺六⼨,盖髀者股也。

於周地⽴⼋尺之表以为股,其影为句,故⽈周髀。

其⾸章周公与商⾼问答,实勾股之⿐祖,故《御制数理精蕴》载在卷⾸⽽详释之,称为成周六艺之遗⽂。

荣⽅问於陈⼦以下,徐光启谓为千古⼤愚。

今详考其⽂,惟论南北影差以地为平远,复以平远测天,诚为臆说。

然与本⽂已绝不相类,疑后⼈传说⽽误⼊正⽂者,如夏⼩正之经传参合,傅崧卿未订以前,使⼈不能读也。

其本⽂之⼴⼤精微者,皆⾜以存古法之意,开西法之源,如书内以璇玑⼀昼夜环绕北极⼀周⽽过⼀度,冬⾄夜半璇玑起北极下⼦位,春分夜半起北极左卯位,夏⾄夜半起北极上午位,秋分夜半起北极右⾣位,是为璇玑四游所极,终古不变。

以七衡六间测⽇躔发敛,冬⾄⽇在外衡,夏⾄在内衡,春秋分在中衡,当其衡为中⽓,当其间为节⽓,亦终古不变。

十大经典排序算法总结

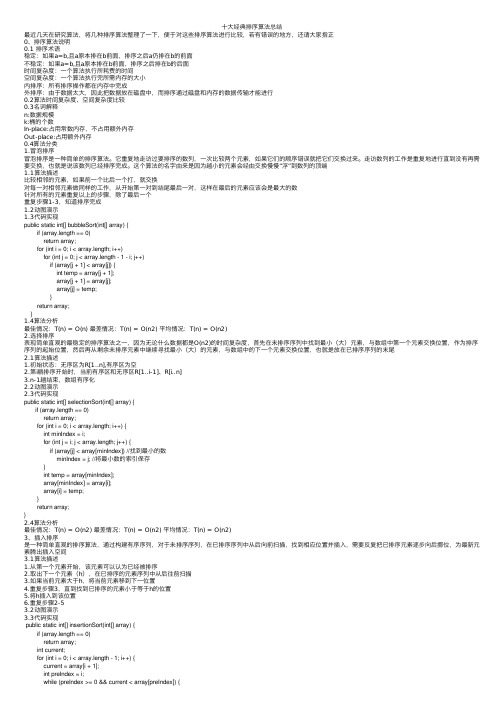

⼗⼤经典排序算法总结最近⼏天在研究算法,将⼏种排序算法整理了⼀下,便于对这些排序算法进⾏⽐较,若有错误的地⽅,还请⼤家指正0、排序算法说明0.1 排序术语稳定:如果a=b,且a原本排在b前⾯,排序之后a仍排在b的前⾯不稳定:如果a=b,且a原本排在b前⾯,排序之后排在b的后⾯时间复杂度:⼀个算法执⾏所耗费的时间空间复杂度:⼀个算法执⾏完所需内存的⼤⼩内排序:所有排序操作都在内存中完成外排序:由于数据太⼤,因此把数据放在磁盘中,⽽排序通过磁盘和内存的数据传输才能进⾏0.2算法时间复杂度、空间复杂度⽐较0.3名词解释n:数据规模k:桶的个数In-place:占⽤常数内存,不占⽤额外内存Out-place:占⽤额外内存0.4算法分类1.冒泡排序冒泡排序是⼀种简单的排序算法。

它重复地⾛访过要排序的数列,⼀次⽐较两个元素,如果它们的顺序错误就把它们交换过来。

⾛访数列的⼯作是重复地进⾏直到没有再需要交换,也就是说该数列已经排序完成。

这个算法的名字由来是因为越⼩的元素会经由交换慢慢“浮”到数列的顶端1.1算法描述⽐较相邻的元素,如果前⼀个⽐后⼀个打,就交换对每⼀对相邻元素做同样的⼯作,从开始第⼀对到结尾最后⼀对,这样在最后的元素应该会是最⼤的数针对所有的元素重复以上的步骤,除了最后⼀个重复步骤1-3,知道排序完成1.2动图演⽰1.3代码实现public static int[] bubbleSort(int[] array) {if (array.length == 0)return array;for (int i = 0; i < array.length; i++)for (int j = 0; j < array.length - 1 - i; j++)if (array[j + 1] < array[j]) {int temp = array[j + 1];array[j + 1] = array[j];array[j] = temp;}return array;}1.4算法分析最佳情况:T(n) = O(n) 最差情况:T(n) = O(n2) 平均情况:T(n) = O(n2)2.选择排序表现简单直观的最稳定的排序算法之⼀,因为⽆论什么数据都是O(n2)的时间复杂度,⾸先在未排序序列中找到最⼩(⼤)元素,与数组中第⼀个元素交换位置,作为排序序列的起始位置,然后再从剩余未排序元素中继续寻找最⼩(⼤)的元素,与数组中的下⼀个元素交换位置,也就是放在已排序序列的末尾2.1算法描述1.初始状态:⽆序区为R[1..n],有序区为空2.第i躺排序开始时,当前有序区和⽆序区R[1..i-1]、R[i..n]3.n-1趟结束,数组有序化2.2动图演⽰2.3代码实现public static int[] selectionSort(int[] array) {if (array.length == 0)return array;for (int i = 0; i < array.length; i++) {int minIndex = i;for (int j = i; j < array.length; j++) {if (array[j] < array[minIndex]) //找到最⼩的数minIndex = j; //将最⼩数的索引保存}int temp = array[minIndex];array[minIndex] = array[i];array[i] = temp;}return array;}2.4算法分析最佳情况:T(n) = O(n2) 最差情况:T(n) = O(n2) 平均情况:T(n) = O(n2)3、插⼊排序是⼀种简单直观的排序算法,通过构建有序序列,对于未排序序列,在已排序序列中从后向前扫描,找到相应位置并插⼊,需要反复把已排序元素逐步向后挪位,为最新元素腾出插⼊空间3.1算法描述1.从第⼀个元素开始,该元素可以认为已经被排序2.取出下⼀个元素(h),在已排序的元素序列中从后往前扫描3.如果当前元素⼤于h,将当前元素移到下⼀位置4.重复步骤3,直到找到已排序的元素⼩于等于h的位置5.将h插⼊到该位置6.重复步骤2-53.2动图演⽰3.3代码实现public static int[] insertionSort(int[] array) {if (array.length == 0)return array;int current;for (int i = 0; i < array.length - 1; i++) {current = array[i + 1];int preIndex = i;while (preIndex >= 0 && current < array[preIndex]) {array[preIndex + 1] = array[preIndex];preIndex--;}array[preIndex + 1] = current;}return array;}3.4算法分析最佳情况:T(n) = O(n) 最坏情况:T(n) = O(n2) 平均情况:T(n) = O(n2)4、希尔排序是简单插⼊排序经过改进之后的⼀个更⾼效的版本,也称为缩⼩增量排序,同时该算法是冲破O(n2)的第⼀批算法之⼀。

唐律的篇章结构(2)

11.捕亡律1卷18条 12.断狱律2卷34条

谋反

恶逆

不睦

不道

名

谋大逆

例

十恶

大不敬 不 义

律

的

谋叛

不孝 内乱

主

五刑

要

内 容

请

减

八议 赎

当

贵

对

族

象 亲故贤能功贵勤宾

官 僚 的

八 议

法

特 本人

议权

定

权

特内请权源自权容 亲疏尊卑减权

赎权

当权

议权:《名例律》总8条规定:“诸八议者犯死罪, 皆条 所犯及应议之状,先奏请议,议定奏裁,流罪以下减一等

谋反是十恶中的第一大罪,是以推翻一姓帝制 统治为直接目的的犯罪。

唐律谋反罪的构成特点是: 第一,只要有预谋就构成犯罪,不要求有对客体 的实际侵害行为。即“但谋即罪”。 第二,已行即罪,不必有害。《贼盗律》同条规 定:“虽谋反,词理不能动众,威力不足率人者, 亦皆斩。” 第三,出言即罪。《贼盗律》(总250条)云: “诸口陈欲反之言,心无真实之计,而无状可寻 者”,也以谋反论。

唐律的篇章结构

唐律有广义和狭义之分。

广义的唐律指唐代法律的总称,包括律、令、格、式等。狭义 唐律指唐代国家的刑法典,即唐朝法律体系律令格式中的律,《永 徽律疏》传世的唐代律典。我们下面要研究的正是这种狭义的唐律。

唐律的篇目,从名称到排列顺序都是很有研究的。 《法经》六 篇 ,秦律“繁如秋荼”,汉从《九章律》的九篇起,至最后为六十篇 , 《曹魏律》为十八篇 ,晋《泰始律》和北魏的《北魏律》均为二十 篇 ,至《北齐律》“校正古今”才定为十二篇。《开皇律》依《北齐 律》十二篇。《武德律》一准《开皇律》,也是十二篇,此后贞观、 永徽修律都没有改变。

赋学指南

周朝国《竹外一枝赋》:

开遍百花头上,南国无双;栽当千户封中,东风第一。

陆长庚《梦笔生花赋》:

岂夜入题诗之路,径本三三;倘朝思授管之人,仙疑七七。(押数目字)

韩潮《浔阳琵琶赋》:

嗟老大之无成,鬓将点白;叹浮生之若梦,眼孰垂青。

时皇上御宇之七年岁次戊申仲秋谷旦,纱山余丙照题于文华堂。

原叙(吴东昱)

司马相如曰:“赋家之心,包括宇宙,总揽人物,得之于内,不可得而传。”然则赋其不可学乎?然相如又云:“一经一纬,一宫一商,赋之迹也。”刘勰亦云:“丽辞雅义,符采相胜,赋之体也。”则赋又若不可学而可学。我朝文运昌明,自翰林

以及小试,莫不试士以赋,赋学之盛,追汉唐而轶宋明矣。乃草茅之士,能赋卒鲜者,非赋不可学也,欲学而不得其法,求法而不得其人,遂若可学而不可学也。余生纱山,少学于予,诗赋即颇留心,数载中耳提面命,赋中三昧,已得其大凡矣。后从周生豹山游,益加研习,赋学遂臻宏博,从此刊陈落腐,含英咀华,以登徐、庾之堂,而树骚坛之帜,殊可顷指。俟今年夏,以所辑《赋学指南》就正于余,集分十法,始于押韵,终于炼局,条分缕晰,各引佳联,以为程式。虽只就时下律赋细为指示,而于骚、古诸体概未之及。然初学之士,得此一编伏而读之,赋中诸法,了如指掌,不俟面命耳提,自可抽黄对白,又何法之不易知,赋之不可学哉!予喜纱山能叙述旧闻,更有心得也。少为更正,益以数条,命付剞劂,以广所学云。

时道光岁在昭阳单阏寎月,纱山氏余丙照题于黄士关之醉经堂。

凡例

1.国朝律赋选本林立,是集专为初学计,不得不细为指示,先引佳联,所以讲句法也;次引佳段,所以讲段法也;后引全篇,所以讲篇法也。

2.集中各条所引各联,原取其句法之佳,其立意有在题前、题后不一,不得以不合题面薄之。

经典排列组合问题100题配超详细解析

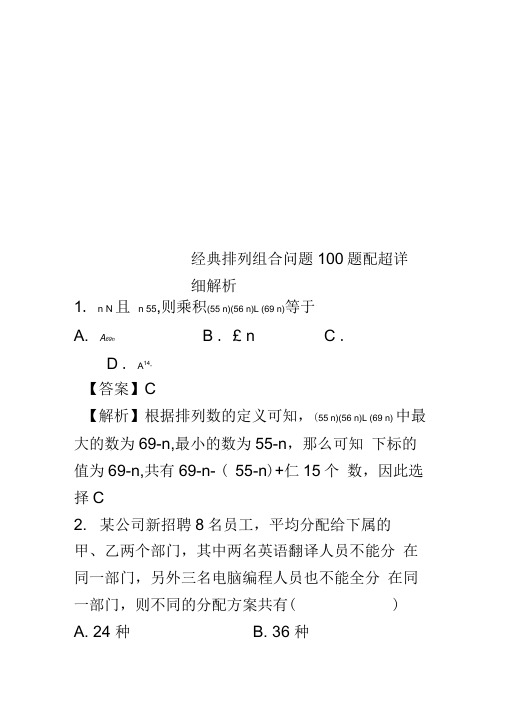

经典排列组合问题100题配超详细解析1. n N 且n 55,则乘积(55 n)(56 n)L (69 n)等于A. A69n B . £ n C .D . A14”【答案】C【解析】根据排列数的定义可知,(55 n)(56 n)L (69 n) 中最大的数为69-n,最小的数为55-n,那么可知下标的值为69-n,共有69-n- ( 55-n)+仁15个数,因此选择C2. 某公司新招聘8名员工,平均分配给下属的甲、乙两个部门,其中两名英语翻译人员不能分在同一部门,另外三名电脑编程人员也不能全分在同一部门,则不同的分配方案共有( ) A. 24 种 B. 36 种C. 38 种D. 108 种【答案】B【解析】因为平均分配给下属的甲、乙两个部门,其中两名英语翻译人员不能分在同一部门,另外三名电脑编程人员也不能全分在同一部门,那么特殊元素优先考虑,分步来完成可知所有的分配方案有36种,选B3. n€ N,贝U( 20-n ) (21-n)……(100-n)等于( )C・A80on D.【答案】C*【解析】因为根据排列数公式可知n€ N,则(20-n) (21-n)……(100-n)等于皑”,选C 4•从0,4,6中选两个数字,从3.5.7中选两个数字,组成无重复数字的四位数•其中偶数的个数为() A.56 B. 96 C. 36 D.360【答案】B【解析】因为首先确定末尾数为偶数,那么要分为两种情况来解,第一种,末尾是0,那么其余的有A5=6O,第二种情况是末尾是4,或者6, 首位从4个人选一个,其余的再选2个排列即可 4 3 3,共有96种5•从6名志愿者中选出4人分别从事翻译、导游、导购、保洁四项不同的工作,若其中甲、乙两名志愿者不能从事翻译工作,则选派方案共有( )A. 280 种B. 240 种C. 180 种D. 96 种【答案】B【解析】根据题意,由排列可得,从 6名志愿者中选出4人分别从事四项不同工作,有A 360种 种,乙从事翻译工作的有A 53 60种,若其中甲、乙 两名支援者都不能从事翻译工作,则选派方案共 有 360-60-60=240 种.6•如图,在/ AOB 勺两边上分别有 A 、A 、A 、 A 和B 、B 2、B 、B 4、R 共9个点,连结线段AB(K i < 4,1 < j < 5),如果其中两条线段不相 交,则称之为一对"和睦线”,则图中共有()对“和睦线”. D.124 【答案】A【解析】在/ AOB 的两边上分别取A,A j(i “和 B p ,B q (p q),可得四边形AA j B p B q中,恰有一对“和睦 不同的情况,其中包含甲从事翻译工作有A 360 A. 60B . 62C 72线"(AB p和A j B q),而在OA上取两点有C52种方法,在OB上取两点有C42种方法,共有10 6 60对“和睦线”. 7 •在某种信息传输过程中,用4个数字的一个排列(数字允许重复)表示一个信息,不同排列表示不同信息,若所用数字只有0和1,则与信息0110至多有两个对应位置上的数字相同的信息个数为()A. 10 B. 11 C •12D. 15【答案】B【解析】由题意知与信息0110至多有两个对应位置上的数字相同的信息包括三类:第一类:与信息0110有两个对应位置上的数字相同有C42=6 (个)第二类:与信息0110有一个对应位置上的数字相同的有&=4个,第三类:与信息0110没有一个对应位置上的数字相同的有&=1,由分类计数原理知与信息0110至多有两个对应位置数字相同的共有6+4+1=11个8甲、乙两人从4门课程中各选修2门,则甲、乙所选的课程中至少有1门不相同的选法共有( )A. 6 种 B . 12 种C. 30 种D. 36 种【答案】C【解析】分有一门不相同和二门不相同两种情况,所以共有C;c;c2 C42 309 .从一个不透明的口袋中摸出红球的概率为1/5,已知袋中红球有3个,则袋中共有球的个数为(). A. 5 个B . 8 个 C . 10个D . 15个【答案】D【解析】由于从一个不透明的口袋中摸出红球的概率为1/5,并且袋中红球有3个,设袋中共有球的个数为n,则3所以n 15.n 510. 从编号为1,2,3,4的四个不同小球中取三个不同的小球放入编号为1,2,3的三个不同盒子,每个盒子放一球,则1号球不放1号盒子且3号球不放3号盒子的放法总数为A. 10B. 12C. 14D. 16【答案】C【解析】解:由题意知元素的限制条件比较多, 要分类解决, 当选出的三个球是1、 一组为例, 1号球在2号盒子里, 1号球在3号盒子里,选1、2、3时共有3种结果, 选1、3、4时也有3种结果,当选到1、2、4或2、3、4时,各有C 21A 22=4种 结果,由分类和分步计数原理得到共有 3+3+4+4=14种 结果,故选C. 11. 在实验室进行的一项物理实验中,要先后 实施6个程序,其中程序A 只能出现在第一或最后 一步,程序B 和C 在实施时必须相邻,则实验顺 序的编排方法共有(A.34 D. 【答案】C【解析】解:本题是一个分步计数问题,2、3或1、3、4时,以前 2号和3号只有一种方法, 2号和3号各有两种结果,96种 种 B. 48 144种由题意知程序A只能出现在第一步或最后一一•••从第一个位置和最后一个位置选一个位置把A 排列,有A、2种结果•••程序B和C实施时必须相邻,•••把B和C看做一个元素,同除A外的3个元素排列,注意B和C之间还有一个排列,共有A4A2=48种结果.根据分步计数原理知共有2 X48=96种结果,故选C.12. 由两个1、两个2、一个3、一个4这六个数字组成6位数,要求相同数字不能相邻,则这样的6位数有A. 12 个B. 48 个C. 84 个D. 96 个【答案】C【解析】解:因为先排雷1, 2, 3,4然后将其与的元素插入进去,则根据相同数字不能相邻的原则得到满足题意的6位数有84个。

各种排序方法总结

选择排序、快速排序、希尔排序、堆排序不是稳定的排序算法,冒泡排序、插入排序、归并排序和基数排序是稳定的排序算法。

冒泡法:这是最原始,也是众所周知的最慢的算法了。

他的名字的由来因为它的工作看来象是冒泡:复杂度为O(n*n)。

当数据为正序,将不会有交换。

复杂度为O(0)。

直接插入排序:O(n*n)选择排序:O(n*n)快速排序:平均时间复杂度log2(n)*n,所有内部排序方法中最高好的,大多数情况下总是最好的。

归并排序:l og2(n)*n堆排序:l og2(n)*n希尔排序:算法的复杂度为n的1.2次幂这里我没有给出行为的分析,因为这个很简单,我们直接来分析算法:首先我们考虑最理想的情况1.数组的大小是2的幂,这样分下去始终可以被2整除。

假设为2的k次方,即k=log2(n)。

2.每次我们选择的值刚好是中间值,这样,数组才可以被等分。

第一层递归,循环n次,第二层循环2*(n/2)......所以共有n+2(n/2)+4(n/4)+...+n*(n/n) = n+n+n+...+n=k*n=log2(n)*n所以算法复杂度为O(lo g2(n)*n) 其他的情况只会比这种情况差,最差的情况是每次选择到的midd le都是最小值或最大值,那么他将变成交换法(由于使用了递归,情况更糟)。

但是你认为这种情况发生的几率有多大??呵呵,你完全不必担心这个问题。

实践证明,大多数的情况,快速排序总是最好的。

如果你担心这个问题,你可以使用堆排序,这是一种稳定的O(log2(n)*n)算法,但是通常情况下速度要慢于快速排序(因为要重组堆)。

文献分类学(超详细版)

⽂献分类学(超详细版)⽂献分类学第⼀章绪论第⼀节基本概念分类:以事物的本质属性或其他显著特征作为根据,把各种事物集合成类的过程⽂献分类:以⽂献分类法为⼯具,根据⽂献所反映的学科知识内容与其他显著特征,分门别类地、系统地组织与揭⽰⽂献的⼀种⽅法(作⽤:组织分类排架、建⽴分类检索系统)第⼆节体系分类法概念:以科学分类为基础,依据概念的划分与概括原理,把概括⽂献内容与事物的各种类⽬组成⼀个层层⾪属,详细列举的等级结构体系的⼀种⽂献分类法,⼜称列举式分类法、枚举式分类法实例:《中图法》、《科图法》、《⼈⼤法》、《杜威⼗进分类法》、《美国国会图书馆分类法》组成:主表(基本部类、基本⼤类、简表、详表),标记符号,复分表,类⽬注释与索引⼀主表结构基本部类:分类表中为便于类⽬展开⽽对知识和客观事物所作的最基本...、最.概括..的划分基本⼤类:在基本部类基础上列出的⽂献分类法的第⼀级类⽬简表:由基本⼤类与由其直接展开的⼀⼆级类⽬所形成的⼀种类⽬表详表:由简表展开的不同等级类⽬所组成的类⽬表,这是类分⽂献的真正依据主表中类⽬之间的关系:从属、并列、交替、相关①从属关系:上下位类之间的关系类系..是指对某个类进⾏连续划分所形成的⼀系列具有从属关系的类⽬②并列关系:同位类之间的关系类列..是指⼀组同位类③交替关系:正式类⽬和⾮正式类⽬之间的关系④相关关系:其他关联关系(通过类⽬参照和多重列类法实现)多重列类法.....:对某个类⽬同时采⽤⼏个分类标准,分别建⽴⼏组平⾏⼦⽬⼆标记符号标记符号是分类法中⽤以表⽰类⽬的代号,⼜称分类号。

性能:容纳性、表达性、助记性、简短性标记符号的种类单纯号码:采⽤⼀种符号系统,分为单纯数字号码和单纯字母号码两种,如《杜威⼗进分类法》、《科图法》混合号码:同时采⽤两种或两种以上符号系统,⼀般是字母与阿拉伯数字相结合,如《美国国会图书馆分类法》、《中图法》标记制度层累标记制:类号位数与类⽬等级相适应、层次分明的标记制度。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

机器学习十大经典算法机器学习中,决策树是一个预测模型;他代表的是对象属性与对象值之间的一种映射关系。

树中每个节点表示某个对象,而每个分叉路径则代表的某个可能的属性值,而每个叶结点则对应从根节点到该叶节点所经历的路径所表示的对象的值。

决策树仅有单一输出,若欲有复数输出,可以建立独立的决策树以处理不同输出。

从数据产生决策树的机器学习技术叫做决策树学习,?通俗说就是决策树。

决策树学习也是数据挖掘中一个普通的方法。

在这里,每个决策树都表述了一种树型结构,他由他的分支来对该类型的对象依靠属性进行分类。

每个决策树可以依靠对源数据库的分割进行数据测试。

这个过程可以递归式的对树进行修剪。

?当不能再进行分割或一个单独的类可以被应用于某一分支时,递归过程就完成了。

另外,随机森林分类器将许多决策树结合起来以提升分类的正确率。

决策树同时也可以依靠计算条件概率来构造。

决策树如果依靠数学的计算方法可以取得更加理想的效果。

决策树是如何工作的决策树一般都是自上而下的来生成的。

选择分割的方法有好几种,但是目的都是一致的:对目标类尝试进行最佳的分割。

从根到叶子节点都有一条路径,这条路径就是一条“规则”。

决策树可以是二叉的,也可以是多叉的。

对每个节点的衡量:1)?通过该节点的记录数2)?如果是叶子节点的话,分类的路径3)?对叶子节点正确分类的比例。

有些规则的效果可以比其他的一些规则要好。

由于ID3算法在实际应用中存在一些问题,于是Quilan提出了C4.5算法,严格上说C4.5只能是ID3的一个改进算法。

相信大家对ID3算法都很.熟悉了,这里就不做介绍。

C4.5算法继承了ID3算法的优点,并在以下几方面对ID3算法进行了改进:1)用信息增益率来选择属性,克服了用信息增益选择属性时偏向选择取值多的属性的不足;2)在树构造过程中进行剪枝;3)能够完成对连续属性的离散化处理;4)能够对不完整数据进行处理。

C4.5算法有如下优点:产生的分类规则易于理解,准确率较高。

其缺点是:在构造树的过程中,需要对数据集进行多次的顺序扫描和排序,因而导致算法的低效。

此外,C4.5只适合于能够驻留于内存的数据集,当训练集大得无法在内存容纳时程序无法运行。

来自搜索的其他内容:C4.5算法是机器学习算法中的一种分类决策树算法,其核心算法是ID3算法.?分类决策树算法是从大量事例中进行提取分类规则的自上而下的决策树.?决策树的各部分是:?根:?学习的事例集.?枝:?分类的判定条件.?叶:?分好的各个类.?§4.3.2?ID3算法?1.概念提取算法CLS?1)?初始化参数C={E},E包括所有的例子,为根.?2)?IF?C中的任一元素e同属于同一个决策类则创建一个叶子?节点YES终止.?ELSE依启发式标准,选择特征Fi={V1,V2,V3,...Vn}并创建?判定节点?划分C为互不相交的N个集合C1,C2,C3,...,Cn;?3)?对任一个Ci递归.?2.?ID3算法?1)?随机选择C的一个子集W?(窗口).?2)?调用CLS生成W的分类树DT(强调的启发式标准在后).?3)?顺序扫描C搜集DT的意外(即由DT无法确定的例子).?4)?组合W与已发现的意外,形成新的W.?5)?重复2)到4),直到无例外为止.?启发式标准:?只跟本身与其子树有关,采取信息理论用熵来量度.?熵是选择事件时选择自由度的量度,其计算方法为?P=freq(Cj,S)-|S|;INFO(S)=-SUM(P*LOG(P));SUM()函数是求j从1到n和.?Gain(X)=Info(X)-Infox(X);Infox(X)=SUM((|Ti|-|T|)*Info(X);为保证生成的决策树最小,ID3算法在生成子树时,选取使生成的子树的熵(即Gain(S))最小的的特征来生成子树.?§4.3.3:?ID3算法对数据的要求?1.?所有属性必须为离散量.?2.?所有的训练例的所有属性必须有一个明确的值.?3.?相同的因素必须得到相同的结论且训练例必须唯一.?§4.3.4:?C4.5对ID3算法的改进:?1.熵的改进,加上了子树的信息.?Split_Infox(X)=-SUM((|T|-|Ti|)*LOG(|Ti|-|T|));Gainratio(X)=Gain(X)-SplitInfox(X);2.?在输入数据上的改进.?因素属性的值可以是连续量,C4.5对其排序并分成不同的集合后按照ID3算法当作离散量进行处理,但结论属性的值必须是离散值.?2)训练例的因素属性值可以是不确定的,以?表示,但结论必须是确定的?3.对已生成的决策树进行裁剪,减小生成树的规模.2、The?k-means?algorithmk-meansalgorithm算法是一个聚类算法,把n的对象根据他们的属性分为k个分割,k?n。

它与处理混合正态分布的最大期望算法很相似,因为他们都试图找到数据中自然聚类的中心。

它假设对象属性来自于空间向量,并且目标是使各个群组内部的均方误差总和最小。

假设有k个群组Si,?i=1,2.,k。

μi是群组Si内所有元素xj 的重心,或叫中心点。

k平均聚类发明于1956年,?该算法最常见的形式是采用被称为劳埃德算法(Lloyd?algorithm)的迭代式改进探索法。

劳埃德算法首先把输入点分成k个初始化分组,可以是随机的或者使用一些启发式数据。

然后计算每组的中心点,根据中心点的位置把对象分到离它最近的中心,重新确定分组。

继续重复不断地计算中心并重新分组,直到收敛,即对象不再改变分组(中心点位置不再改变)。

劳埃德算法和k平均通常是紧密联系的,但是在实际应用中,劳埃德算法是解决k平均问题的启发式法则,对于某些起始点和重心的组合,劳埃德算法可能实际上收敛于错误的结果。

(上面函数中存在的不同的最优解)虽然存在变异,但是劳埃德算法仍旧保持流行,因为它在实际中收敛非常快。

实际上,观察发现迭代次数远远少于点的数量。

然而最近,David?Arthur和Sergei?Vassilvitskii提出存在特定的点集使得k平均算法花费超多项式时间达到收敛。

近似的k平均算法已经被设计用于原始数据子集的计算。

从算法的表现上来说,它并不保证一定得到全局最优解,最终解的质量很大程度上取决于初始化的分组。

由于该算法的速度很快,因此常用的一种方法是多次运行k平均算法,选择最优解。

k平均算法的一个缺点是,分组的数目k是一个输入参数,不合适的k可能返回较差的结果。

另外,算法还假设均方误差是计算群组分散度的最佳参数。

支持向量机,英文为Support?Vector?Machine,简称SV机(论文中一般简称svm)。

它是一种監督式學習的方法,它广泛的应用于统计分类以及回归分析中。

支持向量机属于一般化线性分类器.他们也可以认为是提克洛夫规范化(Tikhonov?Regularization)方法的一个特例.这族分类器的特点是他们能够同时最小化经验误差与最大化几何边缘区.因此支持向量机也被称为最大边缘区分类器。

在统计计算中,最大期望(EM)算法是在概率(probabilistic)模型中寻找参数最大似然估计的算法,其中概率模型依赖于无法观测的隐藏变量(Latent?Variabl)。

最大期望经常用在机器学习和计算机视觉的数据集聚(Data?Clustering)领域。

最大期望算法经过两个步骤交替进行计算,第一步是计算期望(E),也就是将隐藏变量象能够观测到的一样包含在内从而计算最大似然的期望值;另外一步是最大化(M),也就是最大化在?E?步上找到的最大似然的期望值从而计算参数的最大似然估计。

M?步上找到的参数然后用于另外一个?E?步计算,这个过程不断交替进行。

Vapnik等人在多年研究统计学习理论基础上对线性分类器提出了另一种设计最佳准则。

其原理也从线性可分说起,然后扩展到线性不可分的情况。

甚至扩展到使用非线性函数中去,这种分类器被称为支持向量机(Support?Vector?Machine,简称SVM)。

支持向量机的提出有很深的理论背景。

支持向量机方法是在近年来提出的一种新方法。

SVM的主要思想可以概括为两点:?(1)?它是针对线性可分情况进行分析,对于线性不可分的情况,通过使用非线性映射算法将低维输入空间线性不可分的样本转化为高维特征空间使其线性可分,从而使得高维特征空间采用线性算法对样本的非线性特征进行线性分析成为可能;(2)?它基于结构风险最小化理论之上在特征空间中建构最优分割超平面,使得学习器得到全局最优化,并且在整个样本空间的期望风险以某个概率满足一定上界。

在学习这种方法时,首先要弄清楚这种方法考虑问题的特点,这就要从线性可分的最简单情况讨论起,在没有弄懂其原理之前,不要急于学习线性不可分等较复杂的情况,支持向量机在设计时,需要用到条件极值问题的求解,因此需用拉格朗日乘子理论,但对多数人来说,以前学到的或常用的是约束条件为等式表示的方式,但在此要用到以不等式作为必须满足的条件,此时只要了解拉格朗日理论的有关结论就行。

支持向量机将向量映射到一个更高维的空间里,在这个空间里建立有一个最大间隔超平面。

在分开数据的超平面的两边建有两个互相平行的超平面。

分隔超平面使两个平行超平面的距离最大化。

假定平行超平面间的距离或差距越大,分类器的总误差越小。

一个极好的指南是C.J.C?Burges的《模式识别支持向量机指南》。

van?der?Walt?和?Barnard?将支持向量机和其他分类器进行了比较。

有很多个分类器(超平面)可以把数据分开,但是只有一个能够达到最大分割。

我们通常希望分类的过程是一个机器学习的过程。

这些数据点并不需要是中的点,而可以是任意(统计学符号)中或者?(计算机科学符号)?的点。

我们希望能够把这些点通过一个n-1维的超平面分开,通常这个被称为线性分类器。

有很多分类器都符合这个要求,但是我们还希望找到分类最佳的平面,即使得属于两个不同类的数据点间隔最大的那个面,该面亦称为最大间隔超平面。

如果我们能够找到这个面,那么这个分类器就称为最大间隔分类器。

问题定义设样本属于两个类,用该样本训练svm得到的最大间隔超平面。

在超平面上的样本点也称为支持向量.我们考虑以下形式的样本点其中ci为1或?1?--用以表示数据点属于哪个类.?是一个p?(统计学符号),?或?n?(计算机科学符号)?维向量,其每个元素都被缩放到[0,1]或[-1,1].缩放的目的是防止方差大的随机变量主导分类过程.我们可以把这些数据称为“训练数据”,希望我们的支持向量机能够通过一个超平面正确的把他们分开。

超平面的数学形式可以写作根据几何知识,我们知道向量垂直于分类超平面。

加入位移b的目的是增加间隔.如果没有b的话,那超平面将不得不通过原点,限制了这个方法的灵活性。