(完整word版)神经网络学习算法matlab仿真(word文档良心出品).docx

(完整word版)Matlab的神经网络工具箱入门

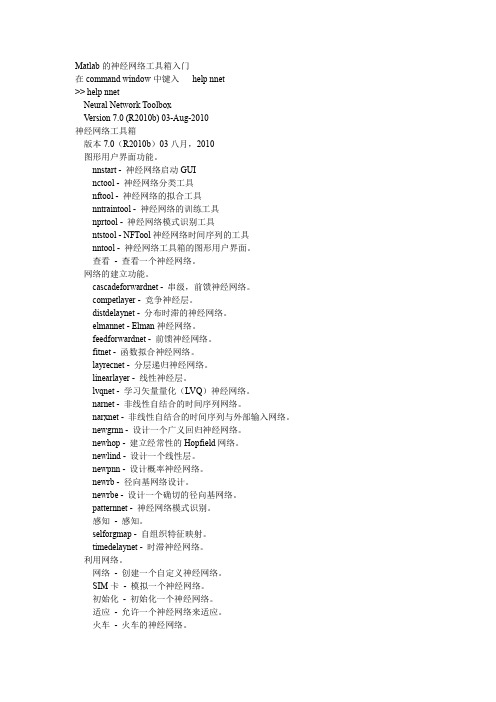

Matlab的神经网络工具箱入门在command window中键入help nnet>> help nnetNeural Network ToolboxVersion 7.0 (R2010b) 03-Aug-2010神经网络工具箱版本7.0(R2010b)03八月,2010图形用户界面功能。

nnstart - 神经网络启动GUInctool - 神经网络分类工具nftool - 神经网络的拟合工具nntraintool - 神经网络的训练工具nprtool - 神经网络模式识别工具ntstool - NFTool神经网络时间序列的工具nntool - 神经网络工具箱的图形用户界面。

查看- 查看一个神经网络。

网络的建立功能。

cascadeforwardnet - 串级,前馈神经网络。

competlayer - 竞争神经层。

distdelaynet - 分布时滞的神经网络。

elmannet - Elman神经网络。

feedforwardnet - 前馈神经网络。

fitnet - 函数拟合神经网络。

layrecnet - 分层递归神经网络。

linearlayer - 线性神经层。

lvqnet - 学习矢量量化(LVQ)神经网络。

narnet - 非线性自结合的时间序列网络。

narxnet - 非线性自结合的时间序列与外部输入网络。

newgrnn - 设计一个广义回归神经网络。

newhop - 建立经常性的Hopfield网络。

newlind - 设计一个线性层。

newpnn - 设计概率神经网络。

newrb - 径向基网络设计。

newrbe - 设计一个确切的径向基网络。

patternnet - 神经网络模式识别。

感知- 感知。

selforgmap - 自组织特征映射。

timedelaynet - 时滞神经网络。

利用网络。

网络- 创建一个自定义神经网络。

SIM卡- 模拟一个神经网络。

初始化- 初始化一个神经网络。

神经网络算法matlab

神经网络算法matlab神经网络算法是一种基于大脑神经元行为的计算模型,通过模拟神经元之间的相互连接和信息传递来实现智能的数据处理和学习能力。

Matlab是一种专门用于科学计算和算法开发的高级编程语言,在神经网络领域也有广泛的应用。

本文将介绍神经网络算法在Matlab中的实现方法。

首先,为了使用神经网络算法,首先需要安装Matlab并确保正确配置了相应的神经网络工具箱。

Matlab的神经网络工具箱提供了一系列用于构建、训练和测试神经网络模型的函数和工具。

在Matlab中,可以使用`feedforwardnet`函数来创建一个前馈神经网络。

这个函数可以指定网络的架构,包括神经元的数量、层数和激活函数等。

例如,下面的代码创建一个具有一个隐藏层和一个输出层的前馈神经网络:net = feedforwardnet([10]);```接下来,需要准备训练数据和目标数据。

在Matlab中,可以使用`mat2vec`函数将训练数据和目标数据转换为神经网络所需的格式。

然后,可以使用`train`函数将训练数据和目标数据输入到神经网络中进行训练。

例如,下面的代码将训练一个前馈神经网络来拟合一组数据:input = [1 2 3 4 5];target = [2 4 6 8 10];data = mat2vec(input, target);net = train(net, data.input, data.target);```在训练完成后,可以使用`sim`函数来对新的输入数据进行预测。

例如,下面的代码使用训练好的神经网络对新的输入数据进行预测:input_test = [6 7 8 9 10];output = sim(net, input_test);```除了前馈神经网络,Matlab还支持其他类型的神经网络模型,例如循环神经网络和自适应神经网络。

对于循环神经网络,可以使用`cascadeforwardnet`函数来创建一个具有循环连接的神经网络。

MATLAB神经网络及其应用讲课文档

BLF - Backprop weight/bias learning function, default = 'learngdm'.

PF - Performance function, default = 'mse'.

(2) Use TRAINBFG, which is slower but more memory efficient than TRAINLM.

(3) Use TRAINRP which is slower but more memory efficient than TRAINBFG.

第6页,共22页。

第9页,共22页。

输出参数说明

and returns,

NET - New network. TR - Training record (epoch and perf). Y - Network outputs. E - Network errors. Pf - Final input delay conditions. Af - Final layer delay conditions.

MATLAB神经网络及其应用

第1页,共22页。

2 BP网络

第2页,共22页。

3 MATLAB中的newff命令

NEWFF Create a feed-forward backpropagation network.

Syntax

net = newff net = newff(PR,[S1 S2...SNl],{TF1

第21页,共22页。

基于MATLAB的神经网络算法研究及仿真

基于MATLAB的神经网络算法研究及仿真焦文明摘要:人工神经网络以其具有信息的分布存储、并行处理以及自学习能力等优点, 已经在模式识别、信号处理、智能控制及系统建模等领域得到越来越广泛的应用。

MATLAB中的神经网络工具箱是以人工神经网络理论为基础, 利用MATLAB 语言构造出许多典型神经网络的传递函数、网络权值修正规则和网络训练方法,网络的设计者可根据自己的需要调用工具箱中有关神经网络的设计与训练的程序, 免去了繁琐的编程过程。

采用Matlab软件编程实现BP 神经网络算法,将神经网络算法应用于函数逼近和样本含量估计问题中,并分析相关参数对算法运行结果的影响。

关键词:神经网络;BP神经网络;函数逼近1 绪论人工神经网络(Artificial Neural Networks,NN)是由大量的、简单的处理单元(称为神经元)广泛地互相连接而形成的复杂网络系统,它反映了人脑功能的许多基本特征,是一个高度复杂的非线性动力学系统。

神经网络具有大规模并行、分布式存储和处理、自组织、自适应和自学习能力,特别适合处理需要同时考虑许多因素和条件的、不精确和模糊的信息处理问题。

神经网络的发展与神经科学、数理科学、认知科学、计算机科学、人工智能、信息科学、控制论、机器人学、微电子学、心理学、微电子学、心理学、光计算、分子生物学等有关,是一门新兴的边缘交叉学科。

神经网络具有非线性自适应的信息处理能力,克服了传统人工智能方法对于直觉的缺陷,因而在神经专家系统、模式识别、智能控制、组合优化、预测等领域得到成功应用。

神经网络与其他传统方法相组合,将推动人工智能和信息处理技术不断发展。

近年来,神经网络在模拟人类认知的道路上更加深入发展,并与模糊系统、遗传算法、进化机制等组合,形成计算智能,成为人工智能的一个重要方向。

MATLAB是一种科学与工程计算的高级语言,广泛地运用于包括信号与图像处理,控制系统设计,系统仿真等诸多领域。

(完整word版)算法设计试题(word文档良心出品)

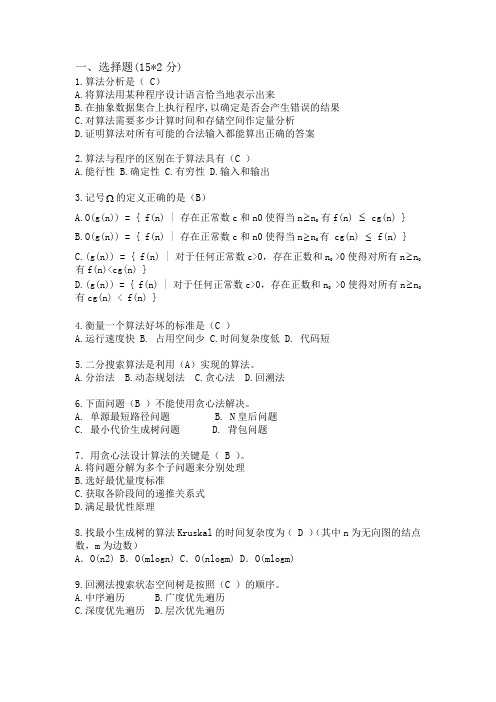

一、选择题(15*2分)1.算法分析是( C)A.将算法用某种程序设计语言恰当地表示出来B.在抽象数据集合上执行程序,以确定是否会产生错误的结果C.对算法需要多少计算时间和存储空间作定量分析D.证明算法对所有可能的合法输入都能算出正确的答案2.算法与程序的区别在于算法具有(C )A.能行性B.确定性C.有穷性D.输入和输出3.记号Ω的定义正确的是(B)A.O(g(n)) = { f(n) | 存在正常数c和n0使得当n≥n0 有f(n) ≤ cg(n) }B.O(g(n)) = { f(n) | 存在正常数c和n0使得当n≥n0有 cg(n) ≤ f(n) }>0使得对所有n≥n0 C.(g(n)) = { f(n) | 对于任何正常数c>0,存在正数和n有f(n)<cg(n) }D.(g(n)) = { f(n) | 对于任何正常数c>0,存在正数和n>0使得对所有n≥n0有cg(n) < f(n) }4.衡量一个算法好坏的标准是(C )A.运行速度快B. 占用空间少C.时间复杂度低D. 代码短5.二分搜索算法是利用(A)实现的算法。

A.分治法B.动态规划法C.贪心法D.回溯法6.下面问题(B )不能使用贪心法解决。

A. 单源最短路径问题B. N皇后问题C. 最小代价生成树问题D. 背包问题7.用贪心法设计算法的关键是( B )。

A.将问题分解为多个子问题来分别处理B.选好最优量度标准C.获取各阶段间的递推关系式D.满足最优性原理8.找最小生成树的算法Kruskal的时间复杂度为( D )(其中n为无向图的结点数,m为边数)A.O(n2) B.O(mlogn) C.O(nlogm) D.O(mlogm)9.回溯法搜索状态空间树是按照(C )的顺序。

A.中序遍历B.广度优先遍历C.深度优先遍历D.层次优先遍历10. 一个问题可用动态规划算法或贪心算法求解的关键特征是问题的( B )A.重叠子问题B.最优子结构性质C.最优量度标准性质D.定义最优解11.程序块(A)是回溯法中遍历排列树的算法框架程序。

神经网络与MATLAB仿真 (1)

两次迭代之间的权值变化已经很小

设定最大迭代次数M,当迭代了M次之后算 法就停止迭代

条件的混合使用,防止 出现算法不收敛现象。

2.单层感知器的学习算法

确定学习率

不应当过大,以便为输入向量提供一个比较稳 定的权值估计

不应当过小,以便使权值能够根据输入的向量x 实时变化,体现误差对权值的修正作用

P=[ -9, 1, -12, -4, 0, 5;...

15, -8, 4, 5, 11, 9]; d=[0,1,0,0,0,1]; % 期望输出

P=[ones(1,6);P]; P

P=

1 -9 15

1

1

1 -4 5

1 0 11

1 5 9

1 -12 -8 4

%% (2)显示要分类的点 figure; subplot(2,1,1); 类结果 plot([-9 , -12 -4 hold on; plot([1,5],[-8,9],'*'); axis([-13,6,-10,16]); legend('第一类','第二类'); title('6个坐标点的二分类'); % 显示待分类的点和分 0],[15, 4 5 11],'o');

2.单层感知器的学习算法

在实际应用中 ,通常采用纠错学习规则的学习算法。 将偏置作为一个固定输入

x0=1 x1 x2

... ...

1

2

0 =b

xi xN

输入 权值

i

N

T

f

y

x (n) 1, x1 (n), x2 (n), , xN (n)

ω(n) b(n), 1 (n), 2 (n), , N (n)

(完整word版)技术手册模板(word文档良心出品)

XXX局XXXXXX系统技术手册(XXX版本)目录1.引言 (1)1.1.编写目的 (1)1.2.系统背景 (1)1.3.术语定义 (1)1.4.参考资料 (1)1.5.版权声明 (1)2.系统概述 (1)2.1.系统功能 (1)2.2.系统性能 (2)2.2.1.数据精度 (2)2.2.2.时间特性 (2)2.2.3.系统灵活性 (2)2.2.4.系统安全性 (2)2.2.5.其他性能 (2)3.运行环境 (2)3.1.硬件环境 (2)3.2.软件环境 (2)3.3.数据结构 (3)4.服务器部署 (3)4.1.服务器部署结构 (3)4.2.应用服务器部署 (3)4.2.1.部署环境 (3)4.2.2.安装与配置 (3)4.2.3.部署验证 (3)4.3.W EB服务器部署 (4)4.3.1.部署环境 (4)4.3.2.安装与配置 (4)4.3.3.部署验证 (4)4.4.数据库服务器部署 (4)4.4.1.部署环境 (4)4.4.2.安装与配置 (4)4.4.3.数据初始化 (4)4.4.4.部署验证 (4)4.5.其它部署 (5)5.客户端部署 (5)6.系统日常维护 (5)6.1.执行文件 (5)6.2.权限管理 (5)6.3.参数配置 (5)6.4.系统日志 (5)6.5.数据备份与恢复 (5)6.6.其它维护 (6)7.常见问题解答 (6)8.售后技术支持 (6)1. 引言1.1. 编写目的描述本文档的目的文档读者。

1.2.系统背景系统名称及版本号:任务提出者:描述本项目的任务提出方任务承接者及实施者:描述本项目的承接者及实施者系统使用者:描述本系统的最终用户1.3. 术语定义列出本文档中用到的专门术语的定义和缩略词的原词组。

1.4. 参考资料列出本文档相关的参考文献和文档,说明名称、单位、日期。

其中需求分析说明书是必须的参考资料。

1.5. 版权声明版权所有声明,如:XXX程序:版权所有2000-2002,xxx有限公司,保留所有权利。

神经网络及深度学习(包含matlab代码).pdf

神经网络及深度学习(包含matlab代码).pdf

神经网络可以使用中间层构建出多层抽象,正如在布尔电路中所做的那样。

如果进行视觉模式识别,那么第1 层的神经元可能学会识别边;第2 层的神经元可以在此基础上学会识别更加复杂的形状,例如三角形或矩形;第3 层将能够识别更加复杂的形状,以此类推。

有了这些多层抽象,深度神经网络似乎可以学习解决复杂的模式识别问题。

正如电路示例所体现的那样,理论研究表明深度神经网络本质上比浅层神经网络更强大。

《深入浅出神经网络与深度学习》PDF+代码分析

《深入浅出神经网络与深度学习》PDF中文,249页;PDF英文,292页;配套代码。

提取码: 6sgh

以技术原理为导向,辅以MNIST 手写数字识别项目示例,介绍神经网络架构、反向传播算法、过拟合解决方案、卷积神经网络等内容,以及如何利用这些知识改进深度学习项目。

学完后,将能够通过编写Python 代码来解决复杂的模式识别问题。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

东南大学自动化学院智能控制概论神经网络学习算法研究学院:姓名:学号:日期:目录1任务要求叙述 .....................................................错误!未定义书签。

2系统分析及设计原理 .........................................错误!未定义书签。

3设计实现 ..............................................................错误!未定义书签。

4 仿真验证 (6)5讨论与分析 ..........................................................错误!未定义书签。

一.任务要求叙述( 1)任务(a)运行算法,观察和分析现有学习算法的性能;clear all;close all;nu=20;pi=3.1415926;for i=1:nup(i)=2*pi*i/nu;t(i)=0.5*(1+cos(p(i)));endminmax=[min(p(:)) max(p(:))]net = newff([ 0 7],[6 1],{'logsig' 'purelin'},'traingd');% traingd traingdm trainlmnet.trainParam.epochs = 10000;net.trainParam.goal = 0.0001;net.trainParam.show=200;net.trainParam.lr=0.1;net.trainParam.mc=0.6; %0.9 default value; available for momentumnet = train(net,p,t);y1 = sim(net,p);figure(2);plot(p,t,'*-',p,y1,'r--')%************** test data ******************nu2=nu*3/2;for i=1:(nu2)p2(i)=2*pi*i/(nu2);t2(i)=0.5*(1+cos(p2(i)));endy2 = sim(net,p2);figure(3);plot(t2,'*-');hold on; plot(y2,'r');xlabel('times');ylabel('outputs');figure(4);plot(t2-y2);xlabel('times');ylabel('error');(b)为了进一步提高学习逼近效果,可以采取那些措施,调节规律如何?根据所提的每种措施,修改算法程序,给出仿真效果验证、过程以及相应的曲线图,给出适当的评述;(c)联系、结合前向神经网络的算法样本学习、测试等过程,谈谈本人对神经网络系统的一些认识和看法。

( 2)要求提交完整的报告,包括:封面( 题目、个人学号姓名等信息)、目录、任务要求叙述、系统分析及设计原理(包括神经网络学习过程的原理图及文字分析)、完整的设计实现过程(包括神经网络结构、参数等选择与实现、计算、原理过程等)、仿真验证 (算法流程图、实现手段介绍、系统参数选择、曲线图、结合调参对响应曲线的影响给出必要的分析)、讨论与分析,总字数要求在2000 以上。

二.系统分析及设计原理( 1)神经网络的学习算法学习过程实质上是针对一组给定的输入x p ( p 1,2, N ) 使网络产生相应的期望输出的过程。

总的来说,神经网络的学习算法分为两大类:有导师学习和无导师学习。

输入信号 X网络输出 Y网络输出 Y 神经网络输入信号 X神经网络期望输出T距离计算图 1:有导师指导神经网络学习方式图 2 无导师指导神经网络学习方式由上图可见,所谓有导师学习就是在训练过程中,始终存在一个期望的网络输出。

期望输出和实际输出之间的距离作为误差度量并用于调整权值。

而无导师学习指的是网络不存在一个期望的输出,因而没有直接的误差信息,因此,为实现对网络的训练,徐建立一个简洁的评价函数,以对网络的某种行为取向做出评价。

( 2)多层传播网络的学习算法给定 N 组样本( X 1, T1 ; X 2 ,T2 ; X p , T p ; ) 。

这里 X i为 n i维输入矢量, T i为 n o维期望的输出矢量, i1,2 P ,.假设矢量 y 和 o 分别表示网络的输出层和隐含层的输出矢量。

则训练过程为:(1) 选0 , E m ax作为最大容许误差,并将权系数W l , l ,l 1,2, L, 初始化成某一小的随机权矩阵。

p 1, E0(2)训练开始O p(1)X p ,T T pn r按照 O pj(r 1)r 1 ( w r jl1o pl r j r 1 ), r0,1,2L 1 计算出各隐含层神经元的i 1n L 1尽力输出,按照ypjL (Net pj L)L (w L ji o pi L 1jL), L 1,2 n o 计算出各输i 1出层神经元的激励输出。

(3) 计算误差 E (t k y k )2 / 2E,k1,2n o(4) 按公式LE p E py pj (tpjNet pj LypjNet pj Lr E p E po r pj(pjNet pj ro rpj Net pj r((o r pk 1 w kj r 1 ) r (Net pj r ))kpjy pj ) L ( Net L pj )(E p Net pk r 1 ) r ( Net pj r )) kNet pk r 1 o pj r计算出pjL, pj r(5) 调整权阵系数 rrr 1rrw ji pj , opj j pj(6) 若 p P , pp 1,跳转到( 2),否则跳转到( 7)(7) 若 EE max ,结束,否则 p 1, E 0,跳转到( 2)。

三.设计实现( 1)神经网络的结构( BP 算法的神经网络结构)下图是一个多层传播结构。

即在输入层和输出层之间嵌入一层或多层隐含层的网络结构。

隐含层单元既可以与叔叔出单元相连也可以与其他隐含层单元相连。

隐含层单元与输入单元之间通过突触权系数 w ij 1 连接,并可用矩阵 w 1 表示全部关系。

隐含层单元与输出单元之间通过突触权系数 w ij 21连接,全部关系可用矩阵 w 2 表示。

图 3:神经网络结构图( 2) Maltab 神经网络工具箱1函数介绍① newc() 创建级联前向网络② ② newff() 创建前向 BP 网络③ ③ newffd() 创建存在输入延迟的前向网络在此次实验中,采用第二个函数即创建的是前向BP 网络。

前向网络中各神经元接受前一级的输入,并输出到下一级,网络中没有反馈,可以用一个有向无环路图表示,这种神经网络称为前向网络。

前向网络中节点分为两类,输入节点和计算节点。

每个输入节点可以有任意个输入,但只有一个输出。

而输出可以耦合到任意多个其他节点的输入。

前向网络通常可以分为不同的层,第i 层的输入仅与第i-1 层的输出连接。

一般认为输入节点为第一层,具有一层计算节点的网络实际上是一个两层网络。

由于输入节点和输出节点可以和外界连接,直接接受环境的影响,所以称为可见层。

而其他中间层则称为隐层。

2Newff ()函数参数介绍newff 函数的格式为:net=newff(PR,[S1 S2 ...SN],{TF1 TF2...TFN},BTF,BLF,PF),函数 newff 建立一个可训练的前馈网络。

输入参数说明:PR: Rx2 的矩阵以定义R 个输入向量的最小值和最大值;Si :第 i 层神经元个数;TFi :第 i 层的传递函数,默认函数为tansig 函数;BTF :训练函数,默认函数为trainlm 函数;BLF :权值 /阀值学习函数,默认函数为learngdm函数;PF :性能函数,默认函数为mse 函数。

3程序中参数含义(1)Newff ()函数中的参数a)传递函数有三种tansig(n)=2/(1+exp(-2*n))-1logsig(n)=1/(1+exp(-n))purelin(n)=nb)训练函数有 12 种trainbrBayes 规范化 BP 训练函数trainc 循环顺序渐增训练函数traincgb Powell-Beale 连接梯度 BP 训练函数 traincgfFletcher-Powell 连接梯度 BP 训练函数traincgp Polak-Ribiere连接梯度BP 训练函数traingda 自适应 lrBP 的梯度递减训练函数traingdx动量及自适应lrBP 的梯度递减训练函数trainlm Levenberg-Marquardt BP训练函数trainoss一步正切BP 训练函数trainr随机顺序递增更新训练函数trainrp 带反弹的BP 训练函数trains 顺序递增 BP 训练函数trainscg量化连接梯度BP 训练函数(2) 其他参数net.trainParam.epochs=10000;允许最大训练步数10000net.trainParam.goal=0.001;训练目标最小误差0.001net.trainParam.show=200;每间隔 200 步显示一次训练结果net.trainParam.lr=0.1;学习步长 0.1net.trainParam.mc=0.6;动量因子四.仿真验证( 1)参数调节方法首先改变传递函数,保持其他参数不变的条件下,将传递函数换成其余两个传递函数,观察运行结果,比较选出最符合要求的传递函数;然后使用最符合要求的传递函数,改变训练函数,同样选出最符合要求的训练函数;最后使用最符合要求的传递函数和训练函数,改变精度、步长、动量因子,比较分析,总结变化规律。

( 2)调节运行结果1初始运行结果图4:初始结果minmax =0.3142 6.2832TRAINGD, Maximum epoch reached, performance goal was not met.在初始算法中,采用的是net = newff([ 0 7],[6 1],{'logsig' 'purelin'},'traingd');由上图发现即使最大步长为10000 Epochs,最后也没有收敛到我们所需要的精度。

这是因为traingd 为单纯的梯度下降训练函数。