第10章 多元线性回归

第15讲 MATLAB 多元线性回归分析

变量 Y 线性依赖于某个变量 X i ;若检验的结果是 接受 H 0 ,则说明所有变量 X 1 , X 2 ,..., X p 对变量的线性 关系是不重要的。

本章目录

16

回 归 分析

2 线性回归

—多元线性回归

2.3 回归方程的假设检验—模型的检验

x i (1, xi1 ,...,xip )

例

本章目录

22

i 1,2,...,n

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

自变量的选择

本章目录

23

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

提

选择自变量的准则 选择自变量进入回归模型的方法

纲

(SAS实例)

本章目录

24

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

选择 自变 量的 准则

选择 自变 量进 入回 归模 型的 方法

1. 引言

因变量

y 自变量为 x , x ,, x

1 2

p

满足线性关系

p

y x x e

0 1 1 p

(I)

对 x1 , x2 ,, x p y 进行 n 次观测, 所得的 n 组数据为

xi1 , xi 2 ,, xip, (i 1,2,, n)

它们均满足(I)式

25

本章目录

回 归 分析

2 线性回归

—多元线性回归

2.4 自变量的选择

选择 自变 量的 准则

选择 自变 量进 入回 归模 型的 方法

多元线性回归模型

第三章多元线性回归模型一、名词解释1、多元线性回归模型:在现实经济活动中往往存在一个变量受到其他多个变量影响的现象,表现在线性回归模型中有多个解释变量,这样的模型被称做多元线性回归模型,多元是指多个解释变量2、调整的可决系数R2:又叫调整的决定系数,是一个用于描述多个解释变量对被解释变量的联合影响程2 2-2 2 门度的统计量‘克服了R随解释变量的增加而增大的缺陷,与R的矢系为R2=1 -(1 -R2)-n — k —1 3、偏回归系数:在多元回归模型中,每一个解释变量前的参数即为偏回归系数,它测度了当其他解释变量保持不变时,该变量增加1单位对被解释变量带来的平均影响程度。

4、正规方程组:采用OLS方法估计线性回归模型时,对残差平方和矢于各参数求偏导,并令偏导数为0后得到的方程组,其矩阵形式为XX A XYo5、方程显著1•生检验:是针对所有解释变量对被解释变量的联合影响是否显著所作的检验,旨在对模型中被解释变量与解释变量之间的线性矢系在总体上是否显著成立作岀判断。

、单项选择题1、C : F统计量的意义2、A: F统计量的定义22 Z ei3、B :随机误差项方差的估计值:? ・n _k_14、A :书上P92和P93公式5、C: A参看导论部分内容;B在判断多重共线等问题的时候,很有必要;D在相同解释变量情况下可以衡量6、C :书上P99,比较F统计量和可决系数的公式即可7、A :书P818、D : A截距项可以不管它;B不考虑betaO ;C相矢矢系与因果矢系的辨析9、B :注意!只是在服从基本假设的前提下,统计量才服从相应的分布10、 D : AB不能简单通过可决系数判断模型好坏,还要考虑样本量、异方差等问题;三、多项选择题1、ACDE :概念性2、BD :概念性3、BCD :总体显著,则至少一个参数不为04、BC :参考可决系数和F统计量的公式5、AD :考虑极端情况,ESS=O,可发现CE错四、判断题、1 ' " 2、” 3 > X 4 > X:调整的可决系数5、”五、简答题1、答:多元线性回归模型与一元线性回归模型的区别表现在如下几个方面:一是解释变量的个数不同;二是模型的经典假设不同,多元线性回归模型比一元线性回归模型多了个“解释变量之间不存在线性相矢尖系”的假定:三是多元线性回归模型的参数估计式的表达更为复杂。

应用多元统计分析-回归分析

3

第四章 回归分析

如果只要考察某一个因变量与 其余多个变量的相互依赖关系.我 们称为多元回归问题.

如果要同时考察p个因变量与m 个自变量的相互依赖关系,我们称 为多因变量的多元回归问题(或简 称为多对多回归).

10

第四章 §4.1 经典多元线性回归

参数向量β的最小二乘估计

定义4.1.1 在模型(4.1.2)中,参数β的最小

二乘估计量b=(b0,b1,…,bm)′是使误差平方和 Q(b)达最小.即

其中

11

第四章 §4.1 经典多元线性回归

参数向量β的最小二乘估计

记

C

1 1

1 n

x11

x21 xn1

型.其中Y是可观测的随机向量,ε是不可观测的

随机向量,C是已知矩阵,β,σ2是未知参数.并设n

>m, rk(C)=m+1.

9

第四章 §4.1 经典多元线性回归

多元线性回归模型

在经典回归分析中,我们讨论多元线 性回归模型中未知的参数向量β= (β0,β1,…,βm)′和σ2的估计和检验问题.

在近代回归分析中讨论变量筛选、 估计的改进及对模型中的一些假定进 行诊断.

但因σ^2不是σ2 的无偏估计量.通常取s 2作为σ2的估计:

15

第四章 §4.1 经典多元线性回归 σ2的估计

因Q(b) (Y Cb)'(Y Cb)

(Y C(CC)1CY )(In H )Y Y ' (In H )Y Y ' PY (P In H是对称幂等阵)

Q(b) Y PY (Y C C )P(Y C C )

SPSS多元线性回归分析教程

线性回归分析的SPSS操作本节内容主要介绍如何确定并建立线性回归方程。

包括只有一个自变量的一元线性回归和和含有多个自变量的多元线性回归。

为了确保所建立的回归方程符合线性标准,在进行回归分析之前,我们往往需要对因变量与自变量进行线性检验。

也就是类似于相关分析一章中讲过的借助于散点图对变量间的关系进行粗略的线性检验,这里不再重复。

另外,通过散点图还可以发现数据中的奇异值,对散点图中表示的可能的奇异值需要认真检查这一数据的合理性。

1、一元线性回归分析1.数据以本章第三节例3的数据为例,简单介绍利用SPSS如何进行一元线性回归分析。

数据编辑窗口显示数据输入格式如下图7-8(文件7-6-1.sav):图7-8:回归分析数据输入2.用SPSS进行回归分析,实例操作如下:2.1.回归方程的建立与检验(1)操作①单击主菜单Analyze / Regression / Linear…,进入设置对话框如图7-9所示。

从左边变量表列中把因变量y选入到因变量(Dependent)框中,把自变量x选入到自变量(Independent)框中。

在方法即Method一项上请注意保持系统默认的选项Enter,选择该项表示要求系统在建立回归方程时把所选中的全部自变量都保留在方程中。

所以该方法可命名为强制进入法(在多元回归分析中再具体介绍这一选项的应用)。

具体如下图所示:图7-9 线性回归分析主对话框②请单击Statistics…按钮,可以选择需要输出的一些统计量。

如Regression Coefficients(回归系数)中的Estimates,可以输出回归系数及相关统计量,包括回归系数B、标准误、标准化回归系数BETA、T值及显著性水平等。

Model fit项可输出相关系数R,测定系数R2,调整系数、估计标准误及方差分析表。

上述两项为默认选项,请注意保持选中。

设置如图7-10所示。

设置完成后点击Continue返回主对话框。

图7-10:线性回归分析的Statistics选项图7-11:线性回归分析的Options选项回归方程建立后,除了需要对方程的显著性进行检验外,还需要检验所建立的方程是否违反回归分析的假定,为此需进行多项残差分析。

3多元线性回归模型

第三章 多元线性回归模型一、单项选择题1、决定系数2R 是指【 】A 剩余平方和占总离差平方和的比重B 总离差平方和占回归平方和的比重C 回归平方和占总离差平方和的比重D 回归平方和占剩余平方和的比重2、在由n=30的一组样本估计的、包含3个解释变量的线性回归模型中,计算的多重决定系数为0.8500,则调整后的决定系数为【 】A 0.8603B 0.8389C 0.8 655D 0.83273、设k 为模型中的参数个数,则回归平方和是指【 】 A 21)(y yn i i -∑= B 21)ˆ(i n i i yy -∑= C 21)ˆ(y yn i i -∑= D )1/()(21--∑=k y y n i i4、下列样本模型中,哪一个模型通常是无效的【 】A i C (消费)=500+0.8i I (收入)B d i Q (商品需求)=10+0.8i I (收入)+0.9i P (价格)C s i Q (商品供给)=20+0.75i P (价格)D i Y (产出量)=0.656.0i L (劳动)4.0i K (资本)5、对于iki k i i i e x x x y +++++=ββββˆˆˆˆ22110 ,统计量∑∑----)1/()ˆ(/)ˆ(22k n y y k y y i i i 服从【 】 A t(n-k) B t(n-k-1) C F(k-1,n-k) D F(k,n-k-1)6、对于iki k i i i e x x x y +++++=ββββˆˆˆˆ22110 ,检验H 0:0=i β),,1,0(k i =时,所用的统计量)ˆvar(ˆi it ββ=服从【 】A t(n-k-1)B t(n-k-2)C t(n-k+1)D t(n-k+2)7、调整的判定系数 与多重判定系数 之间有如下关系【 】A 1122---=k n n R RB 11122----=k n n R R C 11)1(122---+-=k n n R R D 11)1(122-----=k n n R R 8、用一组有30 个观测值的样本估计模型i i i i u x x y +++=22110βββ后,在0.05的显著性水平下对1β的显著性作t 检验,则1β显著地不等于零的条件是其统计量大于等于【 】 A 05.0t (30)B 025.0t (28)C 025.0t (27)D 025.0F (1,28)9、如果两个经济变量x 与y 间的关系近似地表现为当x 发生一个绝对量变动(∆x )时,y 有一个固定地相对量(∆y/y )变动,则适宜配合地回归模型是【 】A i i i u x y ++=10ββB ln i i i u x y ++=10ββC i ii u x y ++=110ββ D ln i i i u x y ++=ln 10ββ 10、对于iki k i i i e x x x y +++++=ββββˆˆˆˆ22110 ,如果原模型满足线性模型的基本假设,则在零假设j β=0下,统计量)ˆ(/ˆjj s ββ(其中s(j β)是j β的标准误差)服从【 】 A t (n-k ) B t (n-k-1) C F (k-1,n-k ) D F (k ,n-k-1)11、下列哪个模型为常数弹性模型【 】A ln i i i u x y ++=ln ln 10ββB ln i i i u x y ++=10ln ββC i i i u x y ++=ln 10ββD i ii u x y ++=110ββ 12、模型i i i u x y ++=ln 10ββ中,y 关于x 的弹性为【 】A i x 1βB i x 1βC iy 1β D i y 1β 13、模型ln i i i u x y ++=ln ln 10ββ中,1β的实际含义是【 】A x 关于y 的弹性B y 关于x 的弹性C x 关于y 的边际倾向D y 关于x 的边际倾向14、关于经济计量模型进行预测出现误差的原因,正确的说法是【 】A.只有随机因素B.只有系统因素C.既有随机因素,又有系统因素D.A 、B 、C 都不对15、在多元线性回归模型中对样本容量的基本要求是(k 为解释变量个数):【 】A n ≥k+1B n<k+1C n ≥30或n ≥3(k+1)D n ≥3016、下列说法中正确的是:【 】A 如果模型的2R 很高,我们可以认为此模型的质量较好B 如果模型的2R 较低,我们可以认为此模型的质量较差C 如果某一参数不能通过显著性检验,我们应该剔除该解释变量D 如果某一参数不能通过显著性检验,我们不应该随便剔除该解释变量 二、多项选择题1、对模型i i i i u x x y +++=22110βββ进行总体显著性检验,如果检验结果总体线性关系显著,则有【 】A 1β=2β=0B 1β≠0,2β=0C 1β≠0,2β≠0D 1β=0,2β≠0E 1β=2β≠02、剩余变差(即残差平方和)是指【 】A 随机因素影响所引起的被解释变量的变差B 解释变量变动所引起的被解释变量的变差C 被解释变量的变差中,回归方程不能作出解释的部分D 被解释变量的总变差与回归平方和之差E 被解释变量的实际值与拟合值的离差平方和3、回归平方和是指【 】A 被解释变量的实际值y 与平均值y 的离差平方和B 被解释变量的回归值yˆ与平均值y 的离差平方和 C 被解释变量的总变差与剩余变差之差D 解释变量变动所引起的被解释变量的变差E 随机因素影响所引起的被解释变量的变差4、下列哪些非线性模型可以通过变量替换转化为线性模型【 】A i i i u x y ++=210ββB i ii u x y ++=110ββ C ln i i i u x y ++=ln 10ββ D i i i u x y ++=210ββE i i i i u x y ++=ββ05、在模型ln i i i u x y ++=ln 10ββ中【 】A y 与x 是非线性的B y 与1β是非线性的C lny 与1β是线性的D lny 与lnx 是线性的E y 与lnx 是线性的三、判断题观察下列方程并判断其变量是否线性,系数是否线性,或都是或都不是。

spss回归分析

第八章回归分析回归分析是处理两个及两个以上变量间线性依存关系的统计方法。

在医学领域中,此类问题很普遍,如人头发中某种金属元素的含量与血液中该元素的含量有关系,人的体表面积与身高、体重有关系;等等。

回归分析就是用于说明这种依存变化的数学关系。

第一节Linear过程8.1.1 主要功能调用此过程可完成二元或多元的线性回归分析。

在多元线性回归分析中,用户还可根据需要,选用不同筛选自变量的方法(如:逐步法、向前法、向后法,等)。

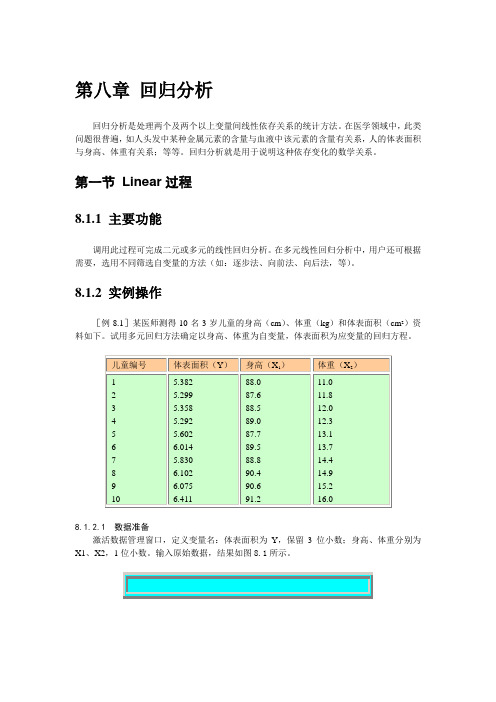

8.1.2 实例操作[例8.1]某医师测得10名3岁儿童的身高(cm)、体重(kg)和体表面积(cm2)资料如下。

试用多元回归方法确定以身高、体重为自变量,体表面积为应变量的回归方程。

8.1.2.1 数据准备激活数据管理窗口,定义变量名:体表面积为Y,保留3位小数;身高、体重分别为X1、X2,1位小数。

输入原始数据,结果如图8.1所示。

图8.1 原始数据的输入8.1.2.2 统计分析激活Statistics菜单选Regression中的Linear...项,弹出Linear Regression对话框(如图8.2示)。

从对话框左侧的变量列表中选y,点击 钮使之进入Dependent框,选x1、x2,点击 钮使之进入Indepentdent(s)框;在Method处下拉菜单,共有5个选项:Enter(全部入选法)、Stepwise(逐步法)、Remove(强制剔除法)、Backward(向后法)、Forward(向前法)。

本例选用Enter法。

点击OK钮即完成分析。

图8.2 线性回归分析对话框用户还可点击Statistics...钮选择是否作变量的描述性统计、回归方程应变量的可信区间估计等分析;点击Plots...钮选择是否作变量分布图(本例要求对标准化Y预测值作变量分布图);点击Save...钮选择对回归分析的有关结果是否作保存(本例要求对根据所确定的回归方程求得的未校正Y预测值和标准化Y预测值作保存);点击Options...钮选择变量入选与剔除的α、β值和缺失值的处理方法。

计量经济学复习资料2

2、如果假设 4 满足,则假设 2 也满足。

以上假设也称为线性回归模型的经典假设或高斯(Gauss)假设,满足该假设的线性回归模

型,也称为经典线性回归模型

二、参数的普通最小二乘估计(OLS)

给定一组样本观测值(Xi, Yi)(i=1,2,…n)要求样本回归函数尽可能好地拟合这组值.

普通最小二乘法给出的判断标准是:二者之差的平方和最小。

R 2 1 RSS /(n k 1) TSS /(n 1) 其中:n-k-1 为残差平方和的自由度,n-1 为总体平方和

的自由度。

R 2 1 (1 R 2 ) n 1 n k 1

三、方程的显著性检验(F 检验) H0: ß0= ß1= ß2= … =ßk=0 H1: ßj 不全为 0

TSS yi2 (Yi Y )2 总体平方和

ESS yˆi2 (Yˆi Y )2 回归平方和

RSS ei2 (Yi Yˆi )2 残差平方和

1、TSS=ESS+RSS 2、可决系数 R2 统计量

记

R 2 ESS 1 RSS

TSS

TSS

称 R2 为(样本)可决系数/判定系数 可决系数的取值范围:[0,1] R2 越接近 1,说明实际观测点离样本线越近,拟合优度越高。 T 检验 检验步骤: (1)对总体参数提出假设

n

n

Q (Yi Yˆi )2 (Yi (ˆ0 ˆ1 X i ))2

1

1

xi2

(X i X )2

X

2 i

1 n

Xi 2

xi yi

(X i X )(Yi Y )

X

iYi

1 n

X i Yi

上述参数估计量可以写成:

ˆ1

应用多元统计分析课后习题答案高惠璇第四章部分习题解答市公开课获奖课件省名师示范课获奖课件

0

2

)

3 2

(ˆ

2

)

3 2

ˆ 2 ˆ 0 2

3

2

V

3 2

下列来讨论与V等价旳统计量分布:

ˆ 2

1 3

( y1

aˆ)2

( y2

2aˆ

bˆ)2

( y3

aˆ

2bˆ)2

1 3

( y1

yˆ1 ) 2

( y2

yˆ2 )2

( y3

yˆ3 )2

1 3

(Y

Xˆ )(Y

Xˆ )

1Y 3

(I3

X

(

X

X

)1

Q(β)=(Y-Cβ) '(Y-Cβ) . 试证明β^=(C'C)-1C'Y是在下列四种意义下达最小:

(1) trQ(β^)≤trQ(β) (2) Q(β^)≤Q(β) (3) |Q(β^)|≤|Q(β)|

(4) ch1(Q(β^))≤ch1(Q(β)),其中ch1(A)表达A

旳最大特征值. 以上β是(m+1)×p旳任意矩阵.

[(

y1

aˆ0

)2

]

0

可得

ˆ

2

1 3

( y1

aˆ0 )2

( y2

aˆ0 )2

( y3

3aˆ0 )2

drf

ˆ

2 0

似然比统计量旳分子为

L(aˆ0

,ˆ

2 0

)

(2

)

3 2

(ˆ 0 2

)

3 2

exp[

3 2

].

5

第四章 回归分析

似然比统计量为

L(aˆ0 ,ˆ02 ) L(aˆ,bˆ,ˆ 2 )

《计量经济学》第三章 多元线性回归模型

Yi 1 2 X 2i 3 X 3i ... k X ki ui

7

多元样本回归函数

Y 的样本条件均值表示为多个解释变量的函数

ˆ ˆ ˆ ˆ ˆ Yi 1 2 X 2i 3 X3i ... k X ki

或

ˆ ˆ ˆ ˆ Yi 1 2 X 2i 3 X3i ... k X ki ei

22

ˆ ˆ 因 2 是未知的,可用 2代替 2 去估计参数 β 的标

准误差:

ˆ ● 当为大样本时,用估计的参数标准误差对 β 作标 准化变换,所得Z统计量仍可视为服从正态分布 ˆ ●当为小样本时,用估计的参数标准误差对 β 作标

准化变换,所得的t统计量服从t分布: ˆ βk - βk t ~ t (n - k ) ^ ˆ SE( βk )

i i

i

e e 0 4.残差 ei 与 X 和

3.

i

e X

i

3i

ei X 2i 0

2i

X 3i 都不相关,即

ˆ 5.残差 ei 与 Yi 不相关,即

e Yˆ 0

i i

18

二、OLS估计式的性质-统计性质

OLS估计式(用矩阵表式) 1.线性特征:

ˆ = (X X)-1 X Y β

2 i

ˆ ei2 (Yi - Yi )2

ˆ X X ... X )]2 ˆ min e [Yi -(1 ˆ2 2i ˆ3 3i k ki

求偏导,令其为0:

( ei2 ) 0 ˆ

j

13

即 ˆ ˆ ˆ ˆ -2 Yi - (1 2 X 2i 3 X 3i ... ki X ki ) 0

多元线性回归

RC2

0.546 0.528 0.488 0.447 0.441 0.440 0.435 0.408

Cp 方程中的自变量

RC2

3.15 X2,X3

0.408

5.00 X1,X3

0.375

5.96 X4

0.347

7.97 X1

0.284

7.42 X1,X2

0.275

7.51 X3

0.231

7.72 X2

16

偏回归平方和

某自变量的偏回归平方和表示模型中含有其他 m-1个自变量的条件下该自变量对Y的回归贡 献。相当于从回归方程中剔除该自变量后所引 起的回归平方和的减少量。或者说在m-1个 自变量的基础上新增加该自变量引起回归平方 和的增加量。

m-1个自变量对Y的回归平方和由重新建立的 新方程得到。

对回归方程的预测或解释能力作出综合评价(决 定系数);

在此基础上进一步对各个自变量的重要性作出评 价(偏回归平方和、t检验、标准回归系数)。

8

方差分析步骤-建立假设

H0:自变量整体与应变量没有回归关系

1 2 m 0

H1:自变量整体与应变量有回归关系

确定检验水准: 0.05

21

偏回归平方和的检验步骤-结论

F3>F0.05,1,22 P3<0.05 F4<F0.05,1,22

P4<0.05

结论:在 0.05 水准处,拒绝胰岛素(X3)和糖化 血红蛋白(X4)的H0,接受H1,可以认为两者和血

糖有回归关系,糖化血红蛋白的回归贡献更大(偏回

归平方和越大,回归贡献越大)。

好;越接近0,说明拟合程度越差。

13