基于图像的视觉控制

机器视觉技术的原理及应用

机器视觉技术的原理及应用随着人工智能技术的不断发展,机器视觉技术也逐渐成为了人们关注的焦点之一。

机器视觉技术是一种通过计算机模拟人眼进行图像识别和分析的技术,其主要应用于工业自动化、安防监控、医疗健康、智能家居等领域。

本文将详细介绍机器视觉技术的原理及应用。

一、机器视觉技术的原理机器视觉技术是基于数字图像的处理,通过对传感器采集的视觉信息进行图像处理和分析,从而实现对图像的识别和理解。

机器视觉技术的核心技术是图像处理技术和模式识别技术。

1. 图像处理技术图像处理技术是机器视觉技术的基础。

它包括图像获取、预处理、特征提取、分割、增强、变形、压缩和重构等过程。

其中,预处理是将采集到的图像进行去噪、滤波和几何校正等处理,使图像更加清晰、准确。

特征提取是从预处理后的图像中提取出被识别物体的特征,如颜色、纹理、形状、大小等。

分割是将图像中的前景和背景进行分离,以便进一步处理。

增强是通过图像处理技术提高图像质量,如增强对比度、锐度等。

2. 模式识别技术模式识别技术是机器视觉技术的核心部分,其主要任务是对预处理后的图像进行解析、分类和识别。

机器视觉技术主要采用的模式识别技术包括统计学、人工神经网络、支持向量机和决策树等。

其中,人工神经网络是最常用的模式识别技术之一,其模拟人类大脑的神经元构建识别模型,通过学习训练数据来实现对图像的分类和识别。

二、机器视觉技术的应用机器视觉技术在工业自动化、安防监控、医疗健康、智能家居等领域有广泛的应用。

1. 工业自动化机器视觉技术在工业制造中的应用主要是利用计算机视觉系统对制造过程进行监控和控制。

例如,机器人在生产过程中通过图像检测技术实现自我定位和精确定位,从而提高了生产效率和制品质量。

在生产线上,机器视觉技术实现了产品的缺陷检测和质量控制,从而提高了产品的一致性和可靠性。

2. 安防监控机器视觉技术在安防监控领域是一种非常有效的技术。

通过数字摄像机、视频处理和传输技术,将监控的图像信号传输给计算机进行处理和分析。

结合视觉感知的对象基嵌入式图像编码中的码率控制方法

第33卷第4期 2012年4月 通信学报

Journal on Communications Vo1.33 No.4

April 2012

结合视觉感知的对象基嵌入式图像编码中的码率控制方法 李动节1,2朱仲杰 ,一,王玉儿 (1.浙江万里学院宁波市DSP重点实验室,浙江宁波315100;2.郑州大学物理工程学院,河南郑州450001)

摘要:结合人眼视觉感知特性,提出一种面向对象基嵌入式编码的码率控制算法。首先结合人眼视觉感知特性 估计各对象的重要性并确定其编码优先级;然后依据优先级对视觉对象进行位平面建模和熵编码,得到各自独立 的码流;最后基于率失真优化理论在给定码率下对对象码流进行优化截取和重装。仿真实验结果表明,所提算法 可以对不同重要对象进行差异化编码和传输,与基于PCRD算法的码率控制方法相比,新算法能提高重构图像的 整体视觉效果。 关键词:对象基编码;嵌入式编码;PCRD算法;视觉感知特性;码率控制 中图分类号:TP391 文献标识码:B 文章编号:1000—436X(2012)04.0115.06

HVS.based rate.control scheme for object—based embedded image coding

LI Dong-jie '_,ZHU Zhong-jie ’-,WANG Yu—er (1-Ningbo Key Lab.ofDSP,Zhejiang Wanli University,Ningbo 315100,China; 2.Physical Engineering College,Zhengzhou University,Zhengzhou 450001,China)

Abstract:A new rate control algorithm for object—based embedded coding was proposed by incorporating the character- istics of human visual systems(HVS).Firstly,the importance and coding priority of each visual object were estimated. Then,bit-plane modeling and entropy coding were implemented for each object based on the coding pfiori ̄and its cor- responding bit stream was outpuaed.Finally,bit streains of visual objects were truncated and reassembled based on the rate-distortion optimization principle under the given bit rate.Experimental results reveal that the proposed algorithm can encode and transmit diferent important objects with diferent strategies.Compared with the PCRD algorithm,the pro— posed algorithm Can improve the overall visual quality of the reconstructed image. Key words:object-based coding;embedded coding;PCRD algorithm;human visual system;rate control

无人机视觉伺服原理

无人机视觉伺服原理

无人机视觉伺服原理主要是利用视觉信息来控制无人机的运动,以达到稳定和跟踪目标的目的。

这种控制方法基于实时图像反馈,通过比较期望的视觉特征与实际获得的图像特征之间的差异,形成误差信号,然后将误差信号转化为控制输入,驱动无人机的运动,以减小视觉误差并使无人机保持在期望的位姿。

视觉伺服系统通常由图像采集、图像处理、控制器和执行器四个部分组成。

在无人机上,通常搭载有高清摄像机和相关图像处理设备,如计算机视觉系统等。

这些设备可以实时获取无人机的视觉信息,并通过图像处理技术提取出目标物体的特征。

在控制器部分,根据输入的目标位置、姿态等期望值与实际值进行比较,形成误差信号。

然后根据误差信号计算出控制输入,调整无人机的位置和姿态。

这个控制过程是一个闭环反馈过程,控制器会不断调整无人机的运动状态,直到视觉误差减小到零或足够小。

执行器部分通常包括无人机的发动机、起落架、舵机等部件,它们根据控制器的指令调整无人机的位置和姿态。

在这个过程中,无人机的图像采集和处理系统会不断获取新的视觉信息,与期望值进行比较,形成新的误差信号,以调整无人机的运动状态。

总的来说,无人机视觉伺服原理是一个复杂的闭环反馈控制系统,它通过实时处理和分析图像信息,控制无人机的运动状态,以实现稳定跟踪和定位目标的目的。

这种控制方法在无人机自主导航、目标跟踪、遥控遥测等领域具有广泛的应用前景。

纯视觉方案 算法

纯视觉方案算法引言纯视觉方案算法是一种基于图像处理和计算机视觉技术的解决方案。

它通过分析和处理图像数据,实现对图像的理解、识别和分析。

纯视觉方案算法在许多领域中都有广泛的应用,包括医疗影像分析、自动驾驶、智能安防等。

本文将介绍纯视觉方案算法的原理、应用和发展趋势。

纯视觉方案算法原理纯视觉方案算法主要基于以下原理: - 图像获取:通过摄像机或其他传感器获取图像数据。

- 图像处理:对获取到的图像数据进行预处理,包括去噪、增强、边缘检测等操作,以提高图像质量和对图像内容的理解。

- 特征提取:从图像中提取出有用的特征,如颜色、形状、纹理等,以便进行后续的图像识别和分析。

- 目标检测:识别图像中的目标物体,并进行定位和分类。

- 图像分析:对图像中的目标物体进行进一步的分析,如运动跟踪、行为识别等。

纯视觉方案算法应用领域纯视觉方案算法在许多领域中都有广泛的应用,下面列举几个典型的应用领域:医疗影像分析纯视觉方案算法在医疗影像分析中发挥着重要作用。

通过对医学影像(如X光片、计算机断层扫描图像等)的处理和分析,可以实现疾病的早期诊断、病情监测等功能。

例如,通过图像处理技术可以自动检测和分析肿瘤的位置和大小,辅助医生进行临床决策。

自动驾驶纯视觉方案算法在自动驾驶领域中也得到了广泛应用。

通过分析车辆周围的图像数据,可以实现道路标志识别、车道线检测、障碍物识别等功能,从而实现智能驾驶和自动辅助驾驶。

智能安防纯视觉方案算法在智能安防领域中扮演重要角色。

通过对监控视频的处理和分析,可以实现入侵检测、人脸识别、行为分析等功能。

例如,通过人脸识别技术可以实现人员识别和出入记录,提升安防系统的智能化水平。

纯视觉方案算法发展趋势纯视觉方案算法在不断发展和演进中,面临着以下发展趋势:深度学习应用随着深度学习技术的快速发展,纯视觉方案算法中的深度学习模型被广泛应用于图像识别、目标检测等任务中。

深度学习模型通过从大量数据中学习和提取特征,可以实现更高级别的图像理解和分析。

基于视觉注意的宏块级码率控制算法

Science &Technology Vision 科技视界在视频编码标准H.264/AVC 中,通常以客观标准(如峰值信噪比,PSNR)来评价压缩后的视频质量,客观质量评定方法具有速度快、易实行的特点,但其结果往往不太符合人眼的主观视觉感受。

视觉心理学研究表明,人类视觉系统(HVS)对图像和视频的主观感知受到亮度、对比度、颜色、纹理、运动和位置等多种因素影响,并存在空间、时间和色彩的掩盖效应[1]。

在一个复杂的视觉场景中,人眼的注意力迅速被场景中感兴趣的区域所吸引,并优先处理这些信息,这个过程称为视觉注意。

对视觉注意机制的研究表明,人眼在观看视频图像时,视觉注意力往往不是均匀分布在整幅图像中,而是集中在其中的某些部分,对这些部分的图像失真也更加敏感[2]。

因此在视频编码过程中,对人眼注意力集中的区域分配较多的目标比特,以获得更好的视频质量,而对人眼处理优先级较低,不容易引起注意的区域分配较少的目标比特,提高视频编码效率。

1HVS 视觉注意特性视觉注意是HVS 的一种潜意识过程,同时也是人类最具体的认识过程,它受到两类因素影响:自顶向下(概念驱动)的因素和自底向上(刺激驱动)的因素[3]。

前者来自人类复杂的心理过程,受个人知识、兴趣爱好等因素影响,比如基于知识和经验的模式识别,它使人眼直接关注场景中某些对象的特征。

后者是指视频场景中与人眼光学属性和视网膜相关的因素,比如颜色、对比度、空间掩蔽、时间掩蔽和对象运动等。

目前视觉注意方面的研究,主要是通过建立自底向上的注意力分析模型来表示视觉内容,然而分析每种影响视觉注意因素的计算复杂度非常高,并不适合实时视频编码应用。

大量实验表明[4-5],视频场景中的对象运动和纹理区域是影响视觉注意力分布的最重要的因素,因此我们主要考虑这两方面因素优化目标比特分配。

2运动区域检测视频场景中的运动分为前景运动和背景运动,背景运动主要由摄像机的运动引起,如变焦、平移和旋转动作,以及场景光线变化;前景运动指视频中对象的运动。

基于模糊控制的机器人视觉伺服系统

2 0 Si eh E gg 0 6 c.T c . nn .

计算机 技术

基于模糊 控制的机 器人视觉 伺服 系统

孙 洪淋 孙 ' 炜h 石玉秋 廖 继 旺

( 湖南大学 电气与信息工程学院 长沙 408 ; , 102 湖南信息职业技 术学院 沙 400 ) 长 120

模糊视觉控 制器 以圆球 在成像平 面上 的 图像 特征( Y r作为机 器人视觉伺服系统的输入语言 ,,) 变量 , 以机 械 手各 关 节 的位 置 期 望 变化 率 ( 0 、 A

△ : ) 、 作为输 出信号 , △ 与之对应的输 出语言变量

为 J J。 hJ 3

图 2 机器人视觉伺服模 糊控制系统结构

关键词

模糊控制

机器人

视觉伺服 系统

中图法分类号 1 26 12 . ; P4

文献标识码 A

机器人视觉伺服控 制系统是 一个 多输人 多输 出的非线性 系统 , 它具 有时变性 、 强耦 合和非线 性

的动力学 特 征 , 难 用 精 确 的 数 学模 型来 描 述 。用 很

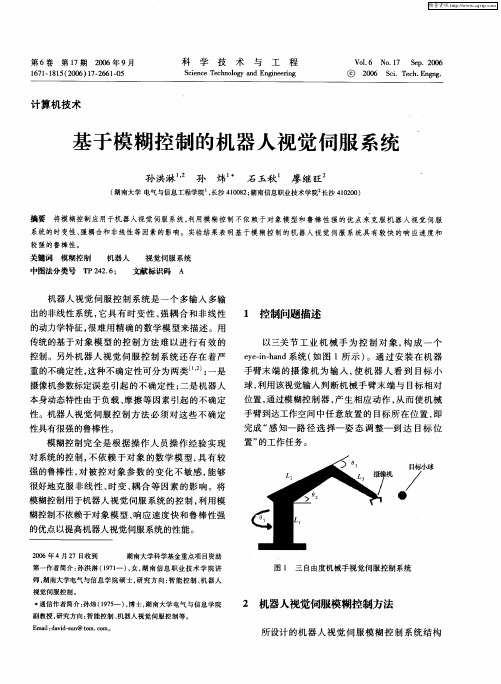

1 控 制问题描述

以三关 节 工业 机 械手 为 控 制对 象 , 成 一个 构 ee nhn 系统( 图 l y— —ad i 如 所示 ) 。通 过安装 在机 器 手臂末 端 的摄 像机 为 输入 , 机 器人 看 到 目标小 使 球, 利用该视觉输入判 断机械手臂末端 与 目标 相对 位置 , 通过模糊控制器 , 生相应动作 , 而使机械 产 从 手臂到达工作空间中任 意放 置的 目标所在位置 , 即 完成 “ 知一路 径 选 择一姿 态 调 整一到 达 目标 位 感 置” 的工作任务 。

目标小球

传统的基 于对象模型 的控 制方法难 以进行 有效 的

视觉伺服

从控制结构的角度, 可分为开环控制系统和闭 环控制系统。开环控制的视觉信息只用来确定运动 前的目标位姿, 系统不要求昂贵的实时硬件, 但要求 事先对摄像机-机器人进行精确标定。闭环控制的视 觉信息用作反馈, 这种情况下能抵抗摄像机与机器 人的标定误差, 但要求快速视觉处理硬件。

根据视觉处理的时间可将系统分为静态和动态 两类。

qa表示

关节

速度

矢量,

õ

f

表示图像特

征的变化

速度

。

关节速度 qa 与对应的任务空间速度 sa之间的关

系为 sa= J 1qa, 其中 J 1 称为机器人雅可比矩阵[ 12] , 表

示向量 s 对向量 q 的导数。 任务空间速度 sa与对应的图像特征的变化速度

õ

õ

f 之间的关系为 f=

J 2sa, 其 中 J 2 称 为 Local

第 16 卷 第 6 期

赵清杰等: 机器人视觉伺服综述

851

直接用于反馈, 不需要对三维姿态进行估计。该方案 的结构框图如图 2 所示。

该方法将旋转与平移进行解耦, 反馈信号一部分采 用 3D 笛卡儿空间坐标表示, 一部分采用 2D 图像空 间坐标表示。这种方法可对 position-based 和 image-based 两种结构进行取长补短, 系统的稳定性和 收敛域都有所提高。

基于计算机视觉的自动化工业检测与控制系统设计

基于计算机视觉的自动化工业检测与控制系统设计自动化工业检测与控制系统基于计算机视觉的设计摘要:自动化工业检测与控制系统在现代工业生产中起着重要作用,它可以提高生产效率、降低生产成本、减少人力投入。

本文介绍了一种基于计算机视觉的自动化工业检测与控制系统的设计方法,包括系统框架、硬件设备、软件算法和实验结果等方面的内容。

1. 引言随着科技的发展和工业生产的不断进步,自动化工业检测与控制系统在现代工业生产中得到了广泛应用。

传统的工业检测与控制系统通常依赖人工操作,存在效率低、成本高、易出错等问题。

基于计算机视觉的自动化工业检测与控制系统通过图像处理和分析技术,可以实现对物体的快速检测、精确测量和自动控制,大大提高了生产效率、降低了生产成本、减少了人力投入。

2. 系统框架基于计算机视觉的自动化工业检测与控制系统主要由硬件设备和软件算法两部分组成。

硬件设备包括摄像头、图像采集卡、光源和机械臂等,用于实现图像采集、图像传输和物体控制等功能。

软件算法主要通过图像处理、特征提取和模式识别等方法,对图像进行分析和识别,实现对物体的检测和测量。

3. 硬件设备摄像头是基于计算机视觉的自动化工业检测与控制系统中最核心的设备之一,它主要负责图像的采集和传输。

根据实际需求,可以选择合适的摄像头类型,如CCD摄像头、CMOS摄像头和红外摄像头等。

图像采集卡用于将模拟信号转换成数字信号,实现图像的采集和处理。

光源可以提供足够的亮度和均匀的光线照射,保证图像清晰度和准确度。

机械臂用于物体的自动抓取和放置,实现对物体的控制。

4. 软件算法图像处理是基于计算机视觉的自动化工业检测与控制系统中最核心的算法之一,它主要通过一系列图像预处理、滤波等操作,对图像进行消噪、增强、分割等处理。

特征提取是指从图像中提取特征信息,如边缘、轮廓、纹理等。

模式识别是指通过图像特征和模型匹配,对物体进行识别和分类。

在实际应用中,可以选择适合的图像处理、特征提取和模式识别算法,如图像滤波、Canny边缘检测、Harris角点检测、SIFT特征提取和支持向量机等。

基于DSP的视觉监测相机的图像处理系统

( 3 提 供 了2 1) 个通 用 的外部 引 脚X 0 X 1可 由 F 、 F,

软件 设 置为 输 入输 出 .也 用 作T 3 0 C 3 多处 MS 2 V 3 在

机 所信 号 与信 息 处 理 专 业 硕 士 研 究 生 。研 究 方 向 : TD P 图像 处 基 S ̄

理 系统 。E ma : he e2 3 6 . m。 - iy obl1 @13t lp o

航空航 天 电子 系统 中 本文 所介 绍 的正是 某小 型智 能 飞行 机 器 人 系统 的视 觉 监 测 相 机 的 图 像 处 理 系

() 2 内存 空 间 大 . 有 3 K 3 位 的 片 内双静 态 具 4 x2

R M. 降低 了 系统 的 开发 成 本 . 提 高 了 系统 的 A 既 又 运行 速 度 ( ) 开 的程序 总 线 、。 3分 . 锯总 线 和D MA总线 , 读

⑥ 2 0 SiT c. nn . 0 6 c. eh E gg

基于D P S 的视觉监测相机的图像处理系统

岳 亮 李 自田 李 长乐 段 小锋

( 国 科学 院 西安 光 学 精 密 机 械 研 究 所 , 中 西安 7 06 ;中科 院研 究 生 院 , 京 10 4 ) 10 8 北 0 0 8

的空 间 坐标 ( Y 。 , 后通 过 R 2 2 口将 结 果 发 , ,) 最 S3 串

往下位 机

以大 大 简1 与I 及 存储 器 的接 口 / O

( ) 有 B oL a e功 能 , 以将 程 序 装 载 到 6具 o tod r 可 DP S 内部 的高 速 的R M中运 行 A ( ) 有 四个 外 部 中断 , 断触 发 方 式 有两 种 : 7具 中 边沿 触 发和 电平触 发 f) 8 具有 符 合I E 1 4 标 准 的片 内 扫描 仿 真接 E E 19 口(T G) 仿真速 度更 快 。 JA ,

基于图像处理的眼动跟踪技术研究

基于图像处理的眼动跟踪技术研究眼动跟踪技术是一种通过分析人眼在视觉任务过程中的运动轨迹来研究观看行为的方法。

它通过记录和分析人眼在观察屏幕、图片或其他视觉刺激物时的运动路径,可以获取到人眼在感兴趣区域上的停留时间、扫视轨迹以及视线移动速度等信息,从而帮助研究者了解人类的视觉注意力分布、信息处理方式以及心理认知过程。

基于图像处理的眼动跟踪技术是目前应用最为广泛的眼动跟踪方法之一。

它利用计算机视觉和图像处理技术对眼球位置进行实时追踪和解析。

与传统的物理接触式眼动仪相比,基于图像处理的眼动跟踪技术无需接触被试的眼睛,具有非侵入性、易操作、成本低等优势。

图像处理眼动跟踪技术主要包括两个步骤:眼睛检测和眼球定位。

眼睛检测是指通过计算机视觉算法自动地检测图像中的眼睛位置。

眼睛检测算法通常基于特征提取、模型匹配、机器学习等方法,可根据眼睛在图像中的独特形状和特征进行识别和定位。

眼球定位是指在检测到眼睛位置后,进一步确定眼球在眼蓝球上的具体位置。

通常使用的方法包括瞳孔中心定位、瞳孔边缘检测等。

基于图像处理的眼动跟踪技术的核心是眼球位置的追踪和解析。

为了实现高精度的眼球位置追踪,需要解决以下几个关键问题。

首先是光照条件的影响。

光照条件的变化会对图像质量产生较大的影响,进而影响眼动跟踪的准确性。

因此,需要对图像进行预处理,包括灰度校正、增强对比度等操作。

其次是眼球的遮挡问题。

当被试佩戴眼镜或存在遮挡物时,眼球位置的追踪会受到影响。

解决此问题的方法包括使用多传感器融合、采用机器学习算法等。

最后是眼球运动的实时性要求。

眼动跟踪技术通常需要实时更新眼球位置信息,以保证实验或应用的质量。

为了提高实时性,需要结合硬件优化和算法优化,如并行计算、加速计算等。

基于图像处理的眼动跟踪技术在许多领域都有广泛的应用。

首先,它在心理学研究中扮演着重要角色。

通过眼动跟踪技术,心理学家可以研究人类的视觉认知、情绪、学习和记忆等方面的问题。

例如,在阅读研究中,眼动跟踪技术可以揭示受试者在阅读过程中的注意力分配、阅读顺序以及语义理解等信息。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

4.2 基于图像的视觉控制 基于图像的视觉控制,直接利用图像特征对机器人进行。控制器的给定是目标的图像特征,利用视觉测量目标的当前图像特征作为反馈,以图像特征的偏差控制机器人的运动。如果根据图像特征的偏差直接对机器人的关节运动速度进行控制,构成的控制系统称为基于图像的视觉伺服控制,否则,构成的控制系统称为基于图像的视觉控制。

4.2.1 基于图像特征的视觉控制 下面以操作阀门为例,针对Eye-in-Hand结构的视觉系统,说明基于图像的视觉控制。图4-9为机器人操作阀门示意图。在阀门上,利用色标作为阀门标记和手柄标记。其中,用正方形红色色标作为阀门标记,长方形绿色色标作为手柄标记。机械手末端装有抓手,抓手具有闭合和松开两个位置。抓手与机械手末端之间装有腕力传感器和微型摄像机。腕力传感器用于测量机械手腕部的力和力矩,微型摄像机用手引导机械手的抓手抓取阀门手柄。 微型摄像机的坐标系建立在其光轴中心处,Z轴取沿光轴到景物的方向,X轴取图像坐标水平增加的方向,Y轴取图像坐标垂直增加的方向。在安装摄像机时,通过调整摄像机的方向,使得抓手沿机械手末端坐标系的X轴平移时,在摄像机采集的目标图像中只有水平图像坐标变化,垂直图像坐标保持不变;抓手沿机械手末端坐标系的Y轴平移时,在摄像机采集的目标图像中只有垂直图像坐标变化,水平图像坐标保持不变。这样,可以是摄像机坐标系与机械手的末端坐标系具有相同的姿态。 由于手柄标记的尺寸较小,而摄像机的镜头为广角镜头,在摄像机与阀门的距离较远时,手柄标记的图像区域很小,不易分辨。因此,将抓手对阀门趋近作业分为两个阶段:第一个阶段抓手距离阀门较远,通过视觉利用阀门标记对机械手的运动进行控制;第二个阶段抓手距阀门较近通过视觉利用手柄标记对机械手的运动进行控制。在基于图像的视觉控制中,对于上述两个阶段分别给出期望的图像特征。首先,利用手动控制将抓手移动到能够抓取到手柄的位置,采集手柄标记图像作为第二阶段的期望图像,提取手柄标记的图像特征作为期望的图像特征。图4-10所示的手柄标记图像就是在抓手能够抓取到手柄时所采集的期望图像。将抓手移离手柄一定高度,使阀门标记和两个手柄标记均在摄像机视场中,并且能够较好地分辨出手柄标记。此时,采集阀门标记和手柄标记图像作为第一阶段的期望图像,提取阀门标记的图像特征作为期望的图像特征。由于机器人具有6个自由度,所以选取的图像特征至少为6个。在该任务中,选取的图像特征分别为:1)色标的质心坐标;2)色标的图像区域面积;3)色标主方向;4)沿主方向的梯形畸变;5)垂直于主方向的梯形畸变。其中,色标的质心坐标用于机械手沿X、Y轴方向的平移调整,色标的图像区域面积用于机械手沿Z轴方向的平移调整,色标主方向用于机械手绕Z轴方向的旋转调整,沿主方向的梯形畸变用于机械手绕X轴方向的旋转调整,垂直于主方向的梯形畸变用于机械手绕Y轴方向的旋转调整。在第一阶段,以两个手柄标记的连线作为阀门标记色标的主方向。在第二阶段,以手柄标记的长轴作为手柄标记色标的主方向。 图4-11为绕坐标轴旋转所选取的图像特征示意图。在不同的摄像机姿态下,矩形成像后的图像为不同的四边形。例如,图4-10中期望图像的手柄标记是一个四边形。首先,利用Hotlling变换提取四边形的主特征向量。沿主特征向量方向,提取四边形上下两边的长度lx1和lx2

,以两者之比作为绕X轴的旋转特征,见图4-11(a)。沿垂直于主特征向量方向,提

取四边形左右两边的长度ly1和ly2,以两者之比作为绕Y轴的旋转特征,见图4-11(b)。主特征向量与X轴的夹角,作为绕Z轴的旋转特征,见图4-11(c)。

OX

Ylx1

lx2

O

Yly2l

y1

OX

Y

(a)绕X轴旋转特征 (b)绕Y轴旋转特征 (c)绕Z轴旋转特征 图4-11 绕坐标轴的旋转特征 对于机器人末端的微分调整量;;;;;xyzxyzddd,可以利用如式(4-1)所示的对应

关系进行描述:

1/xdydzdduudvvdSS

,1/1/xxxdyyydzdllll (4-1)

式中:xyzddd、、为末端的微分平移量;xyz、、

为末端的微分旋转量;

dduv,

为标记质心的期望图像坐标;uv,为标记质心的实际图像坐标;dS

为标记的期望图像面

积;S为标记的视觉图像面积;𝑙𝑥𝑑为标记沿主方向的期望梯形畸变;𝑙𝑥为标记沿主方向的实际梯形畸变;𝑙𝑦d为标记垂直于主方向的期望梯形畸变;𝑙𝑦为标记垂直于主方向的实际梯形畸变;𝜃𝑑为色标主方向与图像水平轴之间的期望夹角;θ为色标主方向与图像水平轴之间的实际夹角。 由式(4-1)可以发现,当实际图像特征小于期望图像特征时,微分调整量大于0;当实际图像特征大于期望图像特征时,微分调整量小于0;当实际图像特征等于期望图像特征时,微分调整量为0。这只是说明,按照上述方式选取的图像特征能够反映目标的位姿,建立的微分调整量与图像特征的关系能够表征机器人末端的运动趋势。实际上,微分调整量与图像特征增量之间关系是非线性的,而且耦合性强,要比式(4-1)复杂得多。因此,在实际应用中,可以对式(4-1)中的6个微分调整量赋予不同的优先级,通过分布调整实现各个图像特征之间的解耦。此外,微分增量xyzxyzddd、、、、、,不能直接用于控制机

器人的末端运动,需要经过适当的控制算法形成末端运动控制量

xyzccccccxyzddd、、、、、,例如,PID算法就是一种较常采用的控制算法。

由机器人末端的实际微分运动控制量xyzccccccxyzddd、、、、、,得到末端的位姿

调整量为 0000000zcycxczcxcycycxczcddd

(4-2)

在第一阶段,以预先采集的阀门标记作为期望图像,利用阀门标记图像的特征控制机械手的抓手向阀门运动。在第一阶段的起始阶段,由于阀门标记的当前图像与期望图像差距可能较大,有可能在当前图像中得不到6个图像特征。在此情况下,可以利用阀门标记图像的质心位置中的两个特征,先对机械手抓手的位置进行调整。待在当前图像中有6个图像特征后,再对抓手的位姿进行调整。当阀门标记的当前图像特征与期望图像特征差距较小,能够较好地分辨出手柄标记时,第一阶段结束,第二阶段开始。在第二阶段,以预先采集的手柄标记作为期望图像,利用手柄标记图像的特征控制机械手的抓手向阀门运动。当手柄标记的当前图像特征与期望图像特征差距足够小时,第二阶段结束。此时,抓手已经按照期望的姿态到达手柄位置,闭合抓手,即能够较好地抓取到手柄。 图4-12为一个阶段的基于图像的视觉控制框图。它由3个闭环构成,外环为图像特征闭环,内环为关节位置环和速度环。图4-12中的关节位置控制环节,由关节位置环和关节速度环构成,参见图4-1。视觉反馈为目标的当前图像特征,由图像采集和特征提取两部分构成。由给定的期望图像特征与当前特征比较得到特征偏差,根据该偏差设计机器人末端微分运动调整策略,实现图像空间偏差到笛卡儿空间偏差的转换。图像空间偏差到笛卡儿空间偏差的转换矩阵,又称为图像空间到笛卡儿空间微分运动的雅可比矩阵。根据机器人的当前位姿,由机器人末端微分运动量得到的机器人末端在笛卡儿空间的位姿,利用机器人的逆运动学计算出关节空间的位置给定。由6路关节位置控制器,根据各个关节的期望位置,利用伺服放大器对机器人的运动进行控制。通过机器人本体各个关节的运动,使得机器人的末端按照希望的位置和姿态运动。 机器人位姿调整策略计算末端位姿给定机器人本体特征提取图像采集期望图像特征末端位姿6路关节位置控制器当前图像特征目标特征测量+_+_逆运动学求解

关节位置控制环节

图4-12 基于图像的视觉控制框图 在本节中阀门抓取中,从图像空间偏差到笛卡儿空间偏差的转换是一种定性的关系,未用到摄像机的参数。该任务不需要对摄像机进行标定,是基于图像的视觉控制的一种特殊情况。一般地,基于图像的视觉控制需要获得从图像空间偏差到笛卡儿空间偏差转换的定量关系,即需要图像空间到笛卡儿空间微分运动的雅可比矩阵。该矩阵是摄像机到目标距离以及图像特征的函数。因此,基于图像的视觉控制需要顾及目标的深度信息,需要对摄像机进行标定。由于摄像机和机器人均包含在图像闭环之内,所以控制精度对摄像机参数误差和机器人的模型误差不敏感。

4.2.2 基于图像的视觉伺服控制 以工业机器人为例,针对Eye-in-hand结构的视觉系统,说明基于图像的视觉伺服控制。如图4-13所示,基于图像的视觉伺服由两个闭环构成,外环为图像特征闭环,内环为关节速度环。视觉反馈为目标的当前图像特征,由图像采集和特征提取两部分构成。由给定的期望图像特征与当前图像特征比较得到特征偏差,根据该偏差设计机器人的运动调整策略,并以其输出作为图像雅可比矩阵的输入。从图像空间到关节空间的雅可比矩阵称为图像雅可比矩阵,由图像空间到笛卡儿空间微分运动的雅可比矩阵和机器人的笛卡儿空间到关节空间的雅可比矩阵的乘积构成。图像雅可比矩阵的输出为各个关节的期望速度。由6路关节速度控制器,根据各个关节的期望速度,利用伺服放大器对机器人的运动进行控制。通过机器人本体各个关节的运动,使得机器人的末端按照希望的位置和姿态运动。求解图像雅可比矩阵是基于图像视觉伺服的一个主要任务,主要3种方法,分别为直接估计方法、深度估计方法、常数近似方法。直接估计的方法不考虑图像雅可比矩阵的解析形式,在摄像机运动过程中直接得到数值解。典型的直接估计方法是采用神经元网络和模糊逻辑逼近的方法。深度估计的方法需要求出图像雅可比矩阵的解析式,在每一个控制周期估计深度值,代入解析式求值。这种方法实时在线调整雅可比矩阵的值,精度高,但计算量较大。常数近似方法是简化的方