无约束优化法

演示文稿第六节无约束优化方法鲍威尔

x3

x1

1=0

2e2

S1

e3

S1

e2

x2 3e3

鲍威尔基本算法的退化

三、鲍威尔修正算法

在某轮已经取得的n+1个方向中,选取n个线性无关的并且共 轭程度尽可能高的方向作为下一轮的基本方向组

鲍威尔修正算法的搜索方向的构造:在第k轮的搜索中, x0k 为初

始点,搜索方向为d1k、d2k 、 • • • 、 dnk,产生的新方向为dk ,此 方向的极小点为xk。沿dk方向移动得到点 xn+1k=2xnk-x0k , 称之为 x0k对xnk的映射点。

第六页,共46页。

开始

给定 x00 ,ε

K←1 i←1

沿ei方向一维搜索αi

xik xik1ikei

x xik f←f(x)

N

i←i+1

x* xnk Y

i=n? Y

xnk x0k ?

结束

k←k+1

N

x0k 1 xnk

例:用坐标轮换法求下列目标函数的无约束最优解。

F (x) x12 x22 x1x2 10x1 4x2 60

第十七页,共46页。

鲍威尔基本算法的缺陷:

可能在某一轮迭代中出现基本方向组为线性相关的矢量 系的情况。如第k轮中,产生新的方向:

dk=xnk-x0k=1kd1k+ 2kd2k + • • • + nkdnk 式中, d1k、d2k 、 • • • 、 dnk为第k轮基本方向组矢量, 1k 、 2k、 • • • 、 nk为各方向的最优步长。

第三页,共46页。

§4.5 坐标轮换法

计算步骤:

⑴任选初始点,确定搜索方向

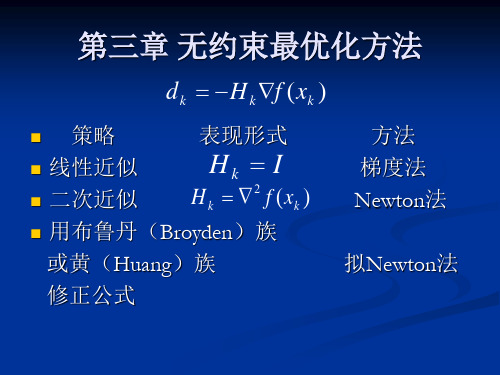

第三章 无约束最优化--梯度方法(1)

2 做直线搜索 zk 1 LS( zk , - gk ), 计算f k 1 f ( zk 1 ), gk 1 g ( zk 1 ); 3 判定终止准则H是否满足,若满足则打印最优解 z k+1 , f k+1, 终止。否则转2。 将最速下降法用于具有对称正定矩阵Q的二次函数: 1 T f ( z ) z Qz bT z c,可以推出步长公式来 : 2 设第 k 次迭代点为zk 。下面求zk 1的表达式:

f z k f z k 1 f z k f z k f zk

但λ到底取多大,没有统一的标准, λ取小了,收敛太慢,而λ取大 了,又会漏掉极小点。

1 T f ( z ) z Qz , 定理:对于二次函数 2

四 用于二次函数时的收敛速度

为了清除最优步长最速下降法中两个搜索方向正交的不良 后果,人们发明了不少方法,如: (1)选择不同初始点。

例如:对问题: min

取初点

为求 z1 ,沿 f z0 方向从 z0 出发求 f z 的极点,即在线 搜索 min f ( z0 tf z0 )

f ( z) x 25x T z0 2,2 f z0 104 , f z0 4,100T

2 T

* T z ( 0 , 0 ) z 然后再从 1开始迭代,经过10次迭代,近似得最优解

f ( z1 ) 3.686164 .

计算中可以发现,开始几次迭代,步长比较大,函数值下将降 较快但当接近最优点时,步长很小,目标函数值下降很慢。如 T ,0)T虽然后一初点较前一 果不取初点为 z0 (2,2) 而取 z0 (100 初点离最优点 z * (0,0)T 远,但迭代中不出现锯齿现象。这时:

第3章 无约束最优化方法 3-1 最速下降法 3-2 牛顿法

1

u f ( x)u m u

T 2

2

u R

n

则从任意的初始点 x 0 出发,阻尼牛顿法产 生的迭代点列 满足: (1)当 x k 为有穷点列时,其最后一个点 为 f ( x) 的唯一极小点。 (2)当 x k 为无穷点列时,收敛到 f ( x) 的

第3.2节 Newton法及其改进

第3.1节 最速下降法(Steepest Method)

对于最速下降法的几点说明 (1)第2.6节中介绍的关于下降算法的收敛 性定理对最速下降法都是成立的 。 (2)目标函数在负梯度方向下降得最快只 是局部性质。 (3)锯齿现象 (4)改进策略:在计算的开始阶段使用最 速下降法,在迭代数次后,改用其他算法。

本节的主要内容:

(1)牛顿法的基本思想

(2)阻尼牛顿法

(3)带保护措施的阻尼牛顿法

(4)吉尔-默里稳定牛顿法

(5)信赖域方法(一)

第3.2节 Newton法及其改进

(1)牛顿法的基本思想: * 在目标函数f ( x)的极小点 x 的近似点 x k 附近将 f ( x) 二阶Tayler展开,用展开的二次 函数去逼近 f ( x),将这个二次函数的极小点 * x 作为 的一个新的近似点 x k 1 ,依次下去, 用一系列二次函数的极小点 xk 1 去逼近 f ( x) 的极小点 x * 。

第3.2节 Newton法及其改进

设 f ( x)二次连续可微,则 f ( x) 在 x k 处的二次 近似为: 1 T f ( x) qk ( x) f ( xk ) f ( xk ) ( x xk ) ( x xk )T 2 f ( xk )( x xk ) 2 令

07凸优化理论与应用_无约束优化

T

信息与通信工程学院 庄伯金 bjzhuang@

10

步长因子搜索

信息与通信工程学院 庄伯金 bjzhuang@

m

11

梯度下降法

下降方向: x f ( x) 终止条件: f ( x) 2 收敛性: f ( x( k ) ) p* ck ( f ( x(0) ) p* ) 其中 c (0,1) 。

xnt 2 f ( x)1f ( x)

2 f ( x )

( xT 2 f ( x) x)1/ 2 上的最速下降方向。

信息与通信工程学院 庄伯金 bjzhuang@

19

牛顿法

信息与通信工程学院 庄伯金 bjzhuang@

20

牛顿减量

T 2 2

p* 为最优值,则

1 f ( x) p f ( x ) 2m

* 2 2

信息与通信工程学院 庄伯金 bjzhuang@

5

强凸性

若函数 f ( x ) 在 S 上具有强凸性,则可以证明存 在M 0 ,满足 2 f ( x) MI 则有

M f ( y ) f ( x) f ( x) ( y x) yx 2

l1 范数:

f ( x) xsd ei xi

16

信息与通信工程学院 庄伯金 bjzhuang@

最速下降法

信息与通信工程学院 庄伯金 bjzhuang@

17

收敛性分析

范数界:

x * x 2 , (0,1]

c 1 2m 2 min{1, 2 / M }

令

( x) (f ( x)T 2 f ( x)1f ( x))1/ 2

数学中的最优化方法

数学中的最优化方法数学是一门综合性强、应用广泛的学科,其中最优化方法是数学的一个重要分支。

最优化方法被广泛应用于各个领域,如经济学、物理学、计算机科学等等。

本文将从理论和应用两个角度探讨数学中的最优化方法。

一、最优化的基本概念最优化是在给定约束条件下,寻找使某个目标函数取得最大(或最小)值的问题。

在数学中,最优化可以分为无约束最优化和有约束最优化两种情况。

1. 无约束最优化无约束最优化是指在没有限制条件的情况下,寻找使目标函数取得最大(或最小)值的问题。

常见的无约束最优化方法包括一维搜索、牛顿法和梯度下降法等。

一维搜索方法主要用于寻找一元函数的极值点,通过逐步缩小搜索区间来逼近极值点。

牛顿法是一种迭代方法,通过利用函数的局部线性化近似来逐步逼近极值点。

梯度下降法则是利用函数的梯度信息来确定搜索方向,并根据梯度的反方向进行迭代,直至达到最优解。

2. 有约束最优化有约束最优化是指在存在限制条件的情况下,寻找使目标函数取得最大(或最小)值的问题。

在解决有约束最优化问题时,借助拉格朗日乘子法可以将问题转化为无约束最优化问题,进而使用相应的无约束最优化方法求解。

二、最优化方法的应用最优化方法在各个领域中都有广泛的应用。

以下将以几个典型的应用领域为例加以说明。

1. 经济学中的最优化在经济学中,最优化方法被广泛应用于经济决策、资源配置和生产计划等问题的求解。

例如,在生产计划中,可以使用线性规划方法来优化资源分配,使得总成本最小或总利润最大。

2. 物理学中的最优化最优化方法在物理学中也是常见的工具。

例如,在力学中,可以利用最大势能原理求解运动物体的最优路径;在电磁学中,可以使用变分法来求解电磁场的最优配置;在量子力学中,可以利用变分法来求解基态能量。

3. 计算机科学中的最优化在计算机科学中,最优化方法被广泛应用于图像处理、机器学习和数据挖掘等领域。

例如,在图像处理中,可以使用最小割算法来求解图像分割问题;在机器学习中,可以使用梯度下降法来求解模型参数的最优值。

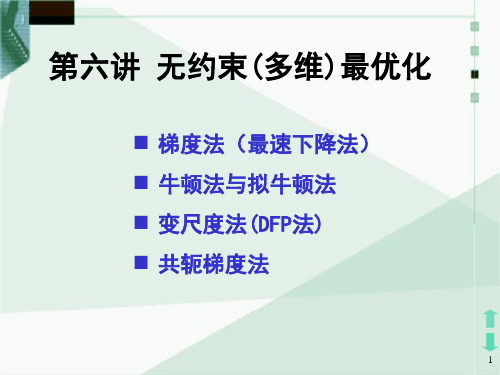

最优化方法第六讲 无约束(多维)最优化

step4. 若 || f ( xk1) || ,停止,x* xk1 ;

否则,令 k : k 1, 转step 2 。

14

➢算法框图

给定初始点x0和精度 || f ( x0 ) ||

停止,输出x1

否

是

| x1 x0 |

是 停止,输出x0

否 否

2 f (x0) 0

计算x1

x0

f ( x0 ) 2 f (x0)

1

13 62

x2

x1

1d 1

(

36 , 31

8 31

)T

7

三、最速下降法的特点

1.性质. 设 f ( x) 有一阶连续偏导数,若 步长 满足 k

f ( xk d k ) min f ( xk d k )

k

则有 f ( xk d k )T d k 0。 k

证明:令 ( ) f ( xk d k ),所以

5

一、梯度法(最速下降法):

1. 搜索方向:d k f ( xk ) ,也称为最速下降方向;

2. 搜 索 步 长: k 取 最 优 步 长, 即 满 足

f (xk

kd k )

min

f

(xk

d k ) 。

二、梯度法算法步骤:

1. 给定初始点 x1 Rn ,允许误差 0, 令k 1。

2. 计算搜索方向 d k f ( xk ) ;

Step3. 令 xk 1 xk kd k , 其中tk : f ( xk kd k ) min f ( xk d k )。

24

Step 4. 判断 xk 1 是否满足终止准则: yes: 计算 stop, 则x* : xk1

No : 转 step 5 。

无约束问题的最优化条件

即,在算法每次迭代中,求解信赖域子问题:

1 T min (d ) f ( xk ) g k d d Gk d 2

(k ) T

s.t

d hk

在信赖域算法中,信赖域半径 hk 采用自适应方式调整, 若

(k )

(d ) 与 f ( xk d ) 近似程度好,则 hk 尽可能取大,

T (0)

2)方向

d

(0)

(G( x )) f ( x ) 1, 3 2

(0) 1 (0)

T

3)求最优步长

x

(0) dFra bibliotek(0)代入目标函数得:

(1)

1 0 3 3 0 2 2

(0)

三、最速下降算法收敛性定理

定理 5 设 f C1 (一阶连续可微), S x f ( x ) f ( x0 )

有界,则由最速下降法得到的迭代点列 xk 具有如下性质: 1) 数列 f ( xk ) 严格单调下降; 2) xk 的任何极限点(聚点) x 都是 f ( x ) 的驻点,

T k 1

d k 0

5.3 牛顿法

自动化学院

一、牛顿迭代公式

牛顿法的基本思想是利用目标函数在当前迭代点 xk 处 的二次近似的极小点作为 f ( x ) 的近似极小点。

设 xk 是当前迭代点, 2 f ( xk ) 正定,

1 f ( x) f ( xk ) f ( xk ) ( x xk ) ( x xk )T 2 f ( xk )( x xk ) 2 1 (k ) T Q ( x) f ( xk ) f ( xk ) ( x xk ) ( x xk )T 2 f ( xk )( x xk ) 2

第5讲 无约束优化

3、运行结果: x= 0.5000 -1.0000 y = 1.3029e-10

•fminsearch是用单纯形法寻优. fminunc的算法见以下几点说明:

[1] fminunc为无约束优化提供了大型优化和中型优化算法。 由options中的参数LargeScale控制:

LargeScale=’on’(默认值), 使用大型算法 LargeScale=’off’(默认值), 使用中型算法

4. 用fminunc 函数 (1)建立M-文件fun2.m function f=fun2(x)

f=100*(x(2)-x(1)^2)^2+(1-x(1))^2

(2)主程序

oldoptions=optimset('fminunc'); options=optimset(oldoptions,'LargeScale','off'); options11=optimset(options,'HessUpdate','dfp'); [x11,fval11,exitflag11,output11]=fminunc('fun2', [-1.2 2],options11); pause options21=optimset(options,'HessUpdate','bfgs'); [x21,fval21,exitflag21,output21]=fminunc('fun2', [-1.2 2],options21) pause options31=optimset(options,'HessUpdate','steepdesc'); [x31,fval31,exitflag31,output31]=fminunc('fun2', [-1.2 2],options31) pause options32=optimset(options,'HessUpdate','steepdesc','MaxIter',8000,'MaxFunEvals',8000); [x32,fval32,exitflag32,output32]=fminunc('fun2', [-1.2 2],options32) pause options33=optimset(options,'HessUpdate','steepdesc','MaxIter',9000,'MaxFunEvals',9000); [x33,fval33,exitflag33,output33]=fminunc('fun2', [-1.2 2],options33)

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第三章无约束优化法概述梯度法牛顿法共轭梯度法坐标轮换法鲍威尔法概述无约束优化问题的一般形式:求设计变量X 工[X i,X2,…X n]T使目标函数F(x) > min,对X没有任何约束条件。

工程实际问题中,无约束结构优化问题很少,多数是有约束条件的。

学习无约束结构优化原因:1)工程也有少量无约束结构优化问题,其数学模型就是无约束优化问题,除了在非常接近最小点的情况下,可以按无约束问题处理;2)为研究约束优化问题打下基础;3)约束优化问题可以通过一系列无约束方法达到。

无约束优化问题的求解,可以直接应用函数极值问题的求解方程:iF =0的问题,即求X,使其满足:cx1cF °cx2n个方程组,一般为非线性的,很难用解析方法求解,一般采用数值方法。

与其用数值方法求解非线性方程组,倒不如用数值方法直接求解无约束极值问题。

数值方法最常用的就是搜索法,其基本思想:从给定的初始点x0出发,按照一定原则寻找搜索方向S0,沿方向S0进行搜索,确定最佳步长:',使得函数沿方向S0下降最快,依次形成迭代公式:X k 1=X k g k S k k =0,1,2,…根据构成搜索方向所使用的信息不同分为:(1)间接法利用目标函数的一阶或二阶导数,如梯度法(最速下降法)、牛顿法、共轭梯度法和变尺度法;梯度法最早由1847年柯西提出,是无约束优化的基本方法。

其基本思想:取目标函数的负梯度方向作为迭代的搜索方向,必使函数值下降的速度最快。

k设在第k次迭代中取得迭代点x,从该点出发,取负梯度方向:S k _ F(X k)为搜索方向,式中:*)=匡g亜心•…兰曲GX\ CX2 dx n第k 1次得到的新点:X k1=x k-宀F(X k)—般步长、丫一k= 1常采用沿负梯度方向做一维搜索:k 1 k k k、F(X ) = min F(X y S )算法特点:初始阶段改进较快,最优解附近改进较慢。

具体迭代步骤:1. 选择初始点X0及迭代精度;・0,令迭代次数k=0;2. 计算点X k的梯度、F(X k)及梯度的模、F(X k),并令s k U'F(X k)3. 判断是否满足收敛精度|p F(X k)卜S—般情况下,若p F(X k)|",则X k为近似最优点,F(X k)为近似最优值,可以输出最优解X” = X k,kF(X ) =F(X ),否则进行4.4. 从点X k出发,沿负梯度方向求最优步长:-k,及沿S k进行一维搜索,求得使函数下降最多的步长因子:-kmin F(X k:k S k) =min ()x k1 =x k-:.k s k令^k 1,转入2步。

用最速下降法求解问题2 2min f (X) = 4x x2,其中X=(X!,x2)T.取初始点X^ =(1,1),允许误差;=0.1.解:f在点X(X!,x2)T处的梯度I f (X) =(8N,2X2)T.第一次迭代:令搜索方向S^ - - ■ f (X0^(-8,-2)T,£*64 4 =2、17 ■;故从点X0出发沿S)作一维搜索,代入目标函数并求其最小值min f(X0+.工S))=min:(.二) 令::(.二)=0 即最佳步长因子得:0=0.130769X,(1,1)T 0.13.769(-8, _2)T=(-0.046152,0.738462)T第二次迭代:令搜索方向 3 - f(XJ =(0.369216, -1.476924)S. = ..218305—=1.522375 •;从点人出发沿包作一维搜索,X2 = (0.101537, 0.147682) T第三次迭代:令搜索方向S2 - - ;f (X 2)=(0.369216, -1.476924)S2=:;0.747056—=0.864329 ;从点X2出发沿S2作一维搜索,X 3=(-0.009747, 0.107217) T第四次迭代:令搜索方向S3 - f(X3) =(0.077976, -0.214434)S3= £0052062 >0.228171 ;从点x3出发沿s3作一维搜索,X4 = (0.019126, 0.027816) T第五次迭代:令搜索方向S4 - _\f (X4) =(-0.153008, -0.055632)T,S4 0.026506 0.162807 .;从点x4出发沿s4作一维搜索,TX5 =(£ .001835,0.020195)此时,I f(X5)= .0.001847 :::■:,满足精度要求,故得问题的最优解为X =(-0.001835,0.020195) T实际上,原问题的最优解为X二(0,0)T梯度法的特点:1. 理论明确,方法简单,概念清楚,计算量小,对初始点没有严格要求。

2. 相邻两次迭代的梯度方向是相互正交的,搜索线路呈直角锯齿形,越靠近极小点,搜索密度越大,收敛越慢。

3. 迭代次数与目标函数等值线的形状有关,目标函数若为椭圆族越扁,迭代次数越多,搜索到最优点的难度越大。

4.所谓最速下降方向- (X k )仅仅反映了f在点X k处的局部性质,对局部来说是最速的下降方向,但对整体求解过程并不一定使目标值下降得最快。

最速下降法逼近极小点X的路线是锯齿形的,当迭代点越靠近X,其搜索步长就越小,因而收敛速度越慢。

2 2试用梯度法求目标函数F (X) = (X j -1) •(X2 -1)的极小值,设初始点X0二[0,九;=0.01。

习题二::试用梯度法求目标函数F(X) +25x;的最优解。

初始点X°=[2,2]T,迭代精度;=0.05。

牛顿法牛顿法的基本思想就是利用二次函数来代替原目标函数,以二次函数的极小点作为原目标函数的极小点的近似,并逐步逼近该点。

k设一般目标函数f(x)具有一、二阶偏导数,此时,在X处做泰勒展开并取值二次项,得:f(X)」(X) = f (x k) if (X k )T(X _x k) 1(X _x k八2f(X k )T(X _x k)其中 H (x k ) J 2f X k 为f(X)在X k 的海森矩阵,是对称方阵。

求f (X)的极小问题转换为(X)的极小值问题。

令I 「(X) =0,即:kkkVf (X ) H (X )(X -X )=0若H (X k )为正定,解得:X =x k—H 二(X k)l f (X k)由于X k 在极小点附近,X “作为f(x)极小点的下一个近似点X k^X k-H 」(X$f(X k)其中: 搜索方向 s k - -H 」(X k p f (x k )步长恒为1o用牛顿法求解问题 min f (X) =4x ; x ;,其中X=(X 1,X 2)T 取初始点X o =(1,1),允许误差;=0.1.以上例子说明,牛顿法比最速下降法收敛快有定理可以证明,当初始点 X 0靠近极小点X ”时,牛顿法的收敛速度是 很快的。

但是,当X 0远离X 时寸,牛顿法可能不收敛,甚至连下降性也保证不了。

其原因是:迭代点X k1不一定是目标函数f 在搜索方向s k上的极小点 仅是(X )在牛顿方向上的极小点。

习题三::用牛顿法求目标函数 F (X) = x ? +25x ;的极小点和极小值。

取初始点X ° = [2, 2]T 习题四:用牛顿法求 F(X) =10x14x2+2的最优解,取初始点 X °=[2,5]T ,迭代 精度;=0.01。

解:'f (X o ) =(8,2)T,l 2卞01f(X 0)十 2;,S 0=—['.2f(X 0)]七 f(X 0)=-;1 -(1,1)T =(0,0)T,故_ 18 一0X^X o S o =(1,1:)由于f (X 1) 0 <0.1,迭代结束,得x 1为问题的最优解。

[l 2f(X 0)]」修正牛顿法为了弥补牛顿法的上述缺陷,人们把牛顿法作了如下修正:由X k求X k 1时,不直接用迭代公式x k 1二x k- P 2f(x k)]七f (X k),其因为这个公式已经把步长限定为1。

而是沿着牛顿方向S k进行一维搜索。

这样就是所谓的阻尼牛顿法,也称为修正牛顿法。

阻尼牛顿法一般步骤:1选取初始数据。

选取初始点X0,给定允许误差;・0,令k = 0 2检验是否满足终止准则。

计算、f(X k),若' f(X k):::;,迭代终止,X k为问题的近似最优解;否则,转steps.3构造牛顿方向。

计算『2f(X k)",取S k一[、2f (X k)] A f (X k)4进行一维搜索。

求:k和X k1,使得f (X :s k S<^ min f(X k:二S k)x k 1= x k讦心k S"令k :二k 1,返回step2牛顿法特点如果f (x)是对称正定矩阵A的二次函数,则用牛顿法经过一次迭代,就可达到最优点,如不是二次函数,则牛顿法不能一步达到极值点,但由于这种函数在极值点附近和二次函数很近似,因此牛顿法的收敛速度还是很快的。

牛顿法的收敛速度虽然较快,但要求海森矩阵要可逆,要计算二阶导数和逆矩阵,就加大了计算机计算量和存储量。

2 2习题五:用阻尼牛顿法求函数F(X^4(x^1) +2(x2 T) +/+X2+10的最优解,取初始点X0=[0,0]T,迭代精度;=0.001。

共轭方向法和共轭梯度法共轭方向概念共轭方向的概念是在研究二次函数1F X X T HX B T X C过程中引出的。

考虑二维情形,如果按最速下降法,选择负梯度方向为搜索方向,会产生锯齿现象;为避免锯齿的发生,取下一次的迭代搜索方向直接指向极小点,如果选定这样的搜索方向,对于二元二次函数只需进行两次直线搜索就可以求到极小点。

初选初始点X0沿某个下降方向S0做一维搜索,得X1x1 =x°:0s0=-0是沿s0方向搜索的最佳步长,即在点X1处的函数F(X)沿方向s0的方向导数为零。

考- 1虑到点X1处方向导数与梯度之间的关系,有:-F_(X)= ' F x1S° = 0 为避免锯齿现象,下一次迭代搜索方向S1指向极小点XX “ = X1 * W 其中〉1为方向S1的最佳步长。

1这样的S满足什么条件?对于二次函数F (X)在X处取得极小点的必要条件:'F X* 二HX* B = 0 C F X1= HX1B)即:' F X* = HX : 9) B = HX1B :「HS1「F X1:用=0 上式两边左乘_S0f得:_S0 T HS1 =0满足上式的两个量S0和S1称为H的共轭向量,或称S0和S1对H是共轭方向。

G是n xn寸称正定矩阵,方向向量d i, d2, -,- d m的m < r如果:d i T Gd j =0 -i = j称方向向量d i, d2, ••d m关于G的共轭方向共轭方向性质:0 11) S , S ,。