熵与信息生命赖负熵为生

熵

• 系统的熵值直接反映了它所处状态的均匀

程度,系统的熵值越小 程度,系统的熵值越小,它所处的状态越 是有序,越不均匀;系统的熵值越大,它 有序,越不均匀;系统的熵值越大 所处的状态越是无序,越均匀。 所处的状态越是无序,越均匀。 • 系统总是力图自发地从熵值较小的状态向 熵值较大(即从有序走向无序)的状态转 变,这就是隔离系统“熵值增大原理”的 微观物理意义。

• 2.系统外部 2.系统外部

(1).从国外摄取负熵,以补充国内正 从国外摄取负熵, 例如出口,掠夺战争等。 熵。例如出口,掠夺战争等。 (2).直接从自然界摄取负熵,以补充 直接从自然界摄取负熵, 国内正熵。例如:采矿,砍伐森林等。 国内正熵。例如:采矿,砍伐森林等。

• 一个国家可以通过多种手段来实现正熵与

• 1.自然界无法承受熵增而崩溃,人类社会也随着崩溃。 1.自然界无法承受熵增而崩溃,人类社会也随着崩溃。 • 2.自然界无力补充人类社会所需的负熵,人类社会崩溃, 2.自然界无力补充人类社会所需的负熵,人类社会崩溃,

自然界则逐步重新得到平衡。

• 3.自然界无力补充人类社会所需的负熵,人类主动寻求人 3.自然界无力补充人类社会所需的负熵,人类主动寻求人

事物从有序向无序变化则熵增加, 可称之为正熵。 可称之为正熵。 事物从无序向有序变化则熵减少, 可称之为负熵。 可称之为负熵。

生命熵

生命体是一个开放的系统,时刻与外 生命体是一个开放的系统, 界进行着物质、能量、信息的交换, 界进行着物质、能量、信息的交换,符合 耗散结构” “耗散结构”,可以用熵来分析一个生命 体从生长、衰老、病死的全过程, 体从生长、衰老、病死的全过程,用“生 命熵”来独立定义。 命熵”来独立定义。

生命负熵来源

对于人类,有序化的能量形式是多种多样的, 对于人类,有序化的能量形式是多种多样的, 并且随着生产力的发展而不断扩展 人类——最早的有序化能量主要是食物 最早的有序化能量主要是食物, 人类——最早的有序化能量主要是食物,火的应 用拓展了食物的范围; 用拓展了食物的范围; ——按照不同的需要建造各种扩展耗散结构 ——按照不同的需要建造各种扩展耗散结构, 按照不同的需要建造各种扩展耗散结构, 间接地把许多形式的无序化能量转化为有序化能 量; ——通过发电设备将各种水力 煤炭、石油、 ——通过发电设备将各种水力、煤炭、石油、 通过发电设备将各种水力、 核能、风能、太阳能等无序化能量转化为电能; 核能、风能、太阳能等无序化能量转化为电能;

薛定谔:生命以负熵为生

薛定谔:生命以负熵为生生命是什么?1944年,来自奥地利的理论物理学家——薛定谔,发出了这样的疑问。

薛定谔(Schrodinger),量子力学的奠基人,由于薛定谔方程的发现获得1933年诺贝尔物理学奖,统计热力学集大成者,分子生物学的开山鼻祖,引领了一大批物理学家向探索生命的奥秘;不过,最让大众熟知的,其实是他提出的一个有趣的思想实验——“薛定谔的猫”。

薛定谔的猫——一只既死又活的猫1944年,薛定谔出了一本小册子——《生命是什么:生物细胞的物理学见解》,此书一出,吸引了一大批物理学家投身于分子生物学研究。

今天我们就借由一个伟大的物理学家的智慧,来从物理角度窥探生命的奥秘。

世界由原子组成我们日常接触的所有物质,其实都是数量超乎想象的原子(分子)。

有多么超乎想象呢?开尔文举过一个让人印象深刻的例子:假设你把一杯水倒入大海,只要充分搅拌后,再从七大洋中任意一处再舀出一杯水来,将会发现,这杯水中仍有大约100个水分子来自于原先那杯水!换言之,100个分子相比于一杯水,恰如一杯水相比于七大洋。

足见水分子之小。

具体有多小呢?一般我们认为,一个原子的直径约为1~2埃(1埃=米)。

其实,原子是没有确定的直径的,因为——原子并不是一个实体原子由原子核与电子组成,电子本身是“一个点”,没有半径,它围绕着原子核转动,它转动的范围姑且理解为原子的内部吧。

原子核更小了,是原子的十万分之一左右,那么,原子核是个实体吗?非也。

原子核由质子与中子组成,而质子与中子都是由3个夸克组成,而这个夸克也只是一个点而已,没有直径,不是实体!看到这里,我们才真正第一次明白了,什么叫“万物皆空”,因为原子本身只是由一些“点”组成的,原子是“空”的,万物也是“空”的!“色即是空,空即是色。

”——《心经》前面我们了解了一些宏观世界与微观世界的基本关系,帮助我们运用想象力在宏微世界中出入无碍,下面我们要提出一个重要的物理学思想——所有物理定律都是统计规律统计物理学(Statistical Physics)告诉我们,每一个原子虽然都在做着难以预测的运动,但是,一堆原子的“集体行为”却是可以预测的,而这就是所有物理学定律的基础。

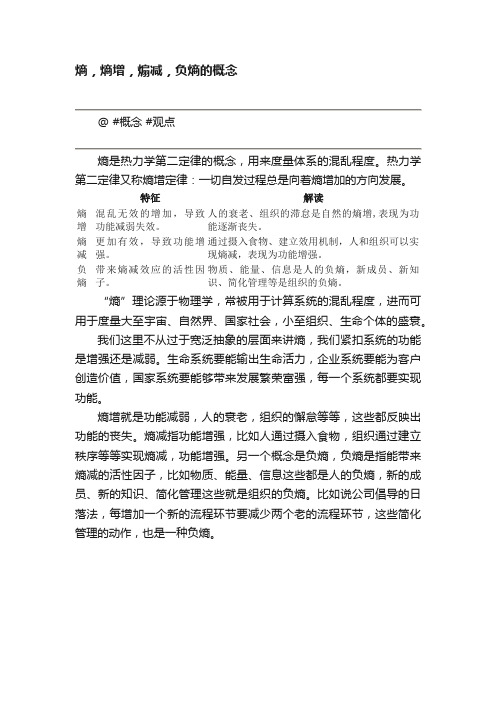

熵,熵增,煽减,负熵的概念

熵,熵增,煽减,负熵的概念

@ #概念 #观点

熵是热力学第二定律的概念,用来度量体系的混乱程度。

热力学第二定律又称熵增定律:一切自发过程总是向着熵增加的方向发展。

特征解读

熵增混乱无效的增加,导致

功能减弱失效。

人的衰老、组织的滞怠是自然的熵增,表现为功

能逐渐丧失。

熵减更加有效,导致功能增

强。

通过摄入食物、建立效用机制,人和组织可以实

现熵减,表现为功能增强。

负熵带来熵减效应的活性因

子。

物质、能量、信息是人的负熵,新成员、新知

识、简化管理等是组织的负熵。

“熵”理论源于物理学,常被用于计算系统的混乱程度,进而可

用于度量大至宇宙、自然界、国家社会,小至组织、生命个体的盛衰。

我们这里不从过于宽泛抽象的层面来讲熵,我们紧扣系统的功能是增强还是减弱。

生命系统要能输出生命活力,企业系统要能为客户创造价值,国家系统要能够带来发展繁荣富强,每一个系统都要实现功能。

熵增就是功能减弱,人的衰老,组织的懈怠等等,这些都反映出功能的丧失。

熵减指功能增强,比如人通过摄入食物,组织通过建立秩序等等实现熵减,功能增强。

另一个概念是负熵,负熵是指能带来熵减的活性因子,比如物质、能量、信息这些都是人的负熵,新的成员、新的知识、简化管理这些就是组织的负熵。

比如说公司倡导的日落法,每增加一个新的流程环节要减少两个老的流程环节,这些简化管理的动作,也是一种负熵。

生命与熵

三、一般疾病与生物熵 当生物体患病的时候,输入生物体内的各种无序的 物质在细胞和机体中堆积起来,细胞和肌体的新陈代 谢能力减弱,不能将它们分解消除掉. 随着时间的推 移,负熵流下降, 生物熵上升,若得不到很好的改善, 无序物的堆积就会越积越多, 生物熵增大,生命就越 来越弱。 四、肿瘤与生物熵 熵增加原理也可以解释肿瘤在人体内的发生、扩 散。现代医学研究表明,癌基因以原癌基因的形式 存在于正常生物基因组内,没被激活时,不会形成 肿瘤。原癌基因是一个活化能位点,在外界环境的 诱导下,细胞可能发生癌变,即肿瘤的形成是非自 发的。

熵与大自然

大量实验表明,熵增、随机、不可逆、非线性的振 荡恰恰是“生命”、“自然”和“自然生机”这些现象 最本质的原因。熵增意味着最终的混沌、无序、热寂和 死亡,然而同时也意味着它孕育了这个过程之中的那短 暂却壮丽辉煌的“生命”、“生命力”,创造了大自然 最神奇的“成长”和“自然演化”的机制,显示着物质 自身运动真正的“时间”,包含着整个宇宙生与死、从 混沌到有序的全部秘密。

热力学毫不顾忌我们人类童年的那种幻想和价值意愿仅用燃烧之火终将熄灭这样一个简单的事实就打破了我们自以为真实而实际只存在于文化符号中的诸如天堂理想国等理念的永恒世界残忍地向我们揭开了整个宇宙和人类的一种悲剧化的过程让人类又一次从真正意义上看到了自我的份量感悟生命无疑是高度有序的存在

熵与生命

演讲人

负熵

感悟

人类在追求宇宙和自身的永恒中,通过热力学语言, 很不情愿地发现了与我们人类的生命感觉相一致的、正如 远古哲人孔子所述的“逝者如斯夫”那样的宇宙事实:时 间并不是幻觉,而是物质有方向的变化过程;时间具有方 向性,是不可逆的,无论是宇宙还是我们人类,只能从生 到死,而不可倒逆;宇宙没有永恒体,没有上帝,我们人 也不可能羽化成仙。热力学毫不顾忌我们人类童年的那种 幻想和价值意愿,仅用“燃烧之火终将熄灭”这样一个简 单的事实就打破了我们自以为真实而实际只存在于文化符 号中的诸如“天堂”、“理想国”等理念的永恒世界,残 忍地向我们揭开了整个宇宙和人类的一种悲剧化的过程, 让人类又一次从真正意义上看到了自我的份量 。

生命与负熵

生命(life)与负熵(entropy)【提纲与简要分析】引子虽然负熵的知识现在我们还没开始学习,但是作为一个高中主学生物的学生来说,没有比用物理学解释生命原理的内容更吸引我的了。

1.熵与负熵的概念简单的按我的理解,熵是一种态函数,用来描述热力学系统中,某一过程初,终状太之间的巨大差异性,并对过程的方向性做出判断的新的状态量,所以叫做态函数。

至于负熵,顾名思义就是反向的熵(entropy),在系统与环境进行物质交换时,流进负熵会使系统的熵减少。

2.生命是什么?作为一个物理学变化,却可以解释生命是什么。

我们学习物理就要从物理学角度来看生命,生命系统是十分的复杂的,作为生命中的熵流,更是非常奇异,生命可以得以延续就要生命系统中的熵流发生有序和有组织的流动,有正向也有负向,这样生命才得以产生,这就是我理解的物理学解释生命学之本质。

负熵是由薛定谔(Erwin Schrödinger)首先提出的,理解他的《生命是什么》是理解物理学看生命的本质的关键。

比如说人,作为一个高等生命体,为什么会有成长,也会有死亡?因为任何生命体都要从外界的环境中吸取能量,如人要吃饭喝水。

从物理学角度去看,这就是从外界的事物和环境中吸取负熵。

任何物质都有有序和无序的状态,退化和死亡是无序状态,任何生命体要想维持自己的生命,就要不停的从外界环境汲取负熵,使自己维持自己相当高的有序能力。

这是我对负熵与生命体联系的理解。

可以看出生命体是赖环境的负熵为生的,吸取外界的负熵是生命体必须的能力。

3.负熵与生命运动(1)新陈代谢(metabolism)新陈代谢是解释负熵的很好案例,新陈代谢中的那个“新”字就是只生命体从外界汲取负熵,他们不断增加自己的熵维持自己的有序状态,但当生命体的汲取的负熵接近或达到最大值的熵值时,生命体也会死亡。

所以“陈”将有机体将自己活时产生的熵值进行消耗。

例如,人类吃食物是来增加自己的负熵,保持自己的有序状态,但排泄下来后减少了由于负熵满值导致机体死亡的无序状态的可能,这是正熵的排出。

人活着就是在对抗熵增定律,生命以负熵为生。对科学研究的启示

人活着就是在对抗熵增定律,生命以负熵为生。

对科学研究的启示“人活着就是在对抗熵增定律,生命以负熵为生”这句话表达了一个重要的科学观点,即生命体系通过不断地从环境中摄取负熵来维持自身的秩序和稳定。

这对科学研究有以下启示:1. 热力学第二定律的重要性:熵增定律是热力学第二定律的一种表述,它指出在一个封闭系统中,熵总是趋向于增加。

这意味着系统会自然地趋向于更加无序和混乱的状态。

了解熵增定律对于理解许多自然现象和生命过程非常重要。

2. 生命体系的特殊性质:生命体系通过摄取负熵来对抗熵增定律,维持自身的秩序和稳定。

这表明生命体系具有一种特殊的能力,可以从环境中获取能量和物质,并将其转化为有用的形式。

这种能力使得生命体系能够在热力学上保持相对稳定的状态。

3. 能量和信息的关系:生命体系通过摄取负熵来维持自身的秩序和稳定,这涉及到能量和信息的转化。

能量是维持生命活动的动力,而信息则是指导生命体系如何利用能量的关键。

因此,研究能量和信息的转化过程对于理解生命现象至关重要。

4. 系统的复杂性和稳定性:生命体系是高度复杂的系统,但它们能够通过自我组织和调节来维持自身的稳定性。

这表明,在复杂系统中,稳定性并不一定依赖于简单的热力学平衡,而是可以通过引入负熵来实现。

这对于研究复杂系统的行为和稳定性具有重要启示。

“人活着就是在对抗熵增定律,生命以负熵为生”这句话提醒我们,生命体系是通过摄取负熵来维持自身的秩序和稳定的。

这一观点对于理解生命现象、热力学第二定律以及复杂系统的行为具有重要的科学启示。

6.简论热力学熵、信息熵及熵的泛化-魏环-河北理工学院

3。

简论热力学熵、信息熵及熵的泛化热力学熵熵是克劳修斯1865年定义并命名的一个热力学系统的状态函数,它严格应用于系统的热运动,故又称“热力学熵”。

熵的英文为“entropy ”,是克劳修斯用两个希腊字拼合而成,“en ”是能量的词冠,“tropy ”意为转移和变化,因此,熵是一个与热力学过程中的能量变 化有关的量。

根据热力学第一、第二定律,有dA ≤−(dU −TdS) (1)式中U 、S 、T 分别为系统的内能、熵和温度,dA 为系统对外做的功。

式(1)表明:在热力学过程中,系统被消耗的内能分为两部分,能用来 对外做功的能量为(dU −TdS),而另一部分能量TdS 则不可利用,它失去了做功的潜力,是退化了的能量。

并且,这部分不可利用能在量值上与该过程中系统的熵增成正比。

因此,是熵将能量再分为两类;熵从反面量度系统的运动转化潜力,熵是系统能量品位的量度。

系统的熵越高,其能量的品位越低、对外做功的潜力越小、可用性越小。

在自然界中,一切真实的过程都是不可逆的过程,也是熵增加的过程,因此,一切真实过程的进行都会导致能量的退化、贬值。

熵的这种性质,也使其为一切热力学过程 发生的条件、进行的方向及进行的限度提供了普遍的判据。

从分子运动的观点看,熵是系统内分子运动紊乱程度的测度,即S=klnW (2) 式中W 为系统的微观态数,又称为热力学概率。

式(2)表明:分子运动越是无序,系统的熵就越髙。

玻尔兹曼对熵做出的这一统计解释,为熵的泛化奠定了理论基础。

信息熵从通讯的角度看,由于随机性的干扰(即噪音)是无法避免的,因此,通讯系统具有统计的特征,信号源可视为一组隨机事件的集合。

该集合所具有的随机性不确定度,与热 力学系统中因大量粒子无规则热运动所造成的微观状态的混乱度或无序度是类同的,所以,信息论的创始人申农(C.E.Shannon)采用了同样的思维方法——利用概率统计理论来定义具有一定概率分布的信号源的平均不确定性测度,即H =−k 1 P i n i lnP i (3)式中n 为信号源的信号种数,P i 为第i 种信号出现的概率。

生命赖负熵为生(ppt文档)

• 我们的生存条件是需要恒定的温度,为了维持 这个温度,需要的不是补充能量,而是降低熵。 埃姆顿的这一段话道出了生命体要维持生命的关 键所在——从环境吸取负熵。

• 以人类为例,人可数天不吃不喝,但不能停止心 脏跳动或停止呼吸。

为了维持心肌和呼吸肌的正常作功,要供给 一定的能量,这些能量最后耗散变为热量。

重组,在里面引入外来基因,人为地改变 遗传密码,形成 新转基因生物,从而使之 具备人们需要的性质。

• 例如,就人体科学来讲,若能弄明白器 官是怎样按时间顺序和空间位置发育的, 则某器官坏了就能克隆新的器官;

• 一些遗传性疾病如高血压、肥胖症可进 行基因治疗;对一些由于基因突变所导致 的癌症等,可进行转基因治疗。

• 那么蛋白质分子的信息熵又是多少呢?典型的蛋

白质分子质量为 120,000 个 碳单位,一个蛋白 质分子约含有 1000 种氨基酸基,每个氨基酸基 均是由20种氨基酸所组成, 若按16种氨基酸作估 算,则该蛋白质分子的信息熵为

S蛋白质

1000

log

16 2

4000 bit

• 正因为 DNA 的双螺旋排列中的遗传密码信息量.

• 上述按照遗传密码复制新蛋白质分子的过程可以 下面的简单分子予以表达

DNA 转 录RNA 翻译复制蛋白质

• 上述复制过程是与计算机的拷贝相类同的。但是

DNA 中复制每 1 bit的能耗仅 100 kT,它是当代

最先进的微电子元件能耗 108 kT的百万分之一。

• 现在可以通过人工对 DNA 进行切割和

时海带至少必须向外释放 T S 的热量。

注意到理想气体等温压缩中外界要对系统作功, 但在海带集富中 外界并未作功,而是利用了一 定的信息量(即造成信息的欠缺),从而使海带的 熵减少。 • 从海带集富碘这一例子可清楚地看到,生命体 是吸取了环境的负熵(流)而达到自身熵的减少的。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

X1, X2 , …… Xn

概率分布P(Xi) P(X1), P(X2 ),…… P(Xn)

实际例子:设有一在外的工作人员,收到消息得知家中的老母 中风住院治疗,这时他母亲就是个信息源,可能处于的本征态: 可能发送出的消息单元有(Xi) :

消息单元 Xi

X1 死亡

X2 昏迷

X3 偏瘫

X4 好转

X5 康复

混乱性——秩序性, 散漫性——组织性。 无序性——有序性, 不肯定性——肯定性。 盲目性——目的性, 一般性——特异性, 随意性——计划性, 随机性——确定性, 多样性——单纯性, 含糊性——透彻性, 暧昧性——明确性, 未知性——已知性 噪声——信号,………

并且满足如: P1

•每个消息单元Xi都有个确定的概率与之相对应,记:p(Xi),整个 消息单元的集合X有概率: P (X) ≡[P(X1), P(X2 ),……P(Xn)] 分布着,消息单元集合的互斥性与完备性反应在概率上是概率的总 和具有归一性。

n

P( Xi ) 1

i 1

因此,信息源的基本概型结构:

消息单元Xi

当各个消息单元是等概率时

P( X1 ) P( X2 )

P( Xn )

1 n

1 N

信息源的信息熵为:

N

HX

1 ln 1 ln N

i1 N

N

Hartrey定义的信息熵是shannon定义的信息熵在等概条件下 的最大值。

4、随着生物信息论、经济信息论、社会信息论等学科不断运 用信息熵,使之有进一步的泛化的必要。熵的产生于热力学, 扩展于信息论等学科领域。在不同的学科里,对熵的意义提法 有所不同。但是从泛熵的概念高度来看。它们在本质上是一致 的。凡是属于下列一类的对立统一性质的事物,例如:

因此,本征信息熵定义:消息单元概率的倒数的对数为消息单 元的不肯定性程度的量度。

1 H ( X i ) log2 P( X i ) log2 P( X i )

第一次电话后,五个本征态或消息单元,各个本征信息熵:

消息单元 Xi

P(Xi) H(Xi)bit

X1 死亡 1/5

2.322

X2 昏迷 1/5

H Xi ln Pi 2

n

Pi 1

i 1

信息熵定义:H(X) 各个不等概消息单元的本征信息熵的加权统计平均值。

n

n

H X Pi H Xi Pi ln Pi 3

i 1

i 1

Pi是第i个消息单元的概率,n是不等概消息单元的总数。 本征信息熵的意义:第i个消息单元Xi的不肯定性程度的量度。 总信息熵的意义:信息源X的总的不肯定程度的量度。

概率分布 1/5 1/5 1/5 1/5 1/5 P(Xi)

当工作人员又接到家信得悉母亲经抢救后,已恢复意识,

正在积极进行治疗。这时信息源的本征态或消息单元的集合概 率分布已发生了变化。

消息单元 Xi

X1 死亡

X2 昏迷

X3 偏瘫

X4 好转

X5 康复

概率分布

0

P(Xi)

0

1/3 1/3 1/3

如果工作人员又接到消息说:经积极治疗后已经能起床作太 极操了,则相应的概率分布变为:

消息单元 Xi

X1 死亡

X2 昏迷

X3 偏瘫

X4 好转

X5 康复

概率分布

0

0

0

1/2 1/2

P(Xi)

提出一个问题:各个消息单元的不肯定程度多大? 概论大,可 能性就越大,不可定性程度就越小;反之,概率小,可能性就 越小。 例如:X5康复的概率最大到1,其它概率降为零,这个 消息单元X5就完全肯定了。不确定性为零。

X2 Xi Xn

P2 Pi Pn

n

完备性:

Xi ;

i

归一性:

n

Pi 1

i 1

以上的问题,均可用熵作为指标进行分析。

二、信息源的概型结构 本征信息熵

现在讨论信息熵的基本概念

1、信息源:发送消息的源。Information source

例如:自然界中的一切物体,大至宇宙天体,小至原子、原 子核、基本粒子、以及中间的各个层次:生物圈,生态,群 落,种群,个体,系统,器官,组织,细胞,亚细胞,分子, 亚分子等,例如一个国家、社会团体,大脑,内分泌等等, 都有它们自己的情态,无不随时发送出它们自己的消息,因 而都可作为信息源。

S 常之高。 k ln w

3. 1928年,Hartrey可能受波尔兹曼关系的启发,首次在通 信领域里提出信息熵的定义:

H log N 1

N是等概率消息单元的总数,信息熵H的意义是输送一个 消息单元的不肯定性程度的量度。等概消息单元总数N愈多, 信息熵H愈大,输送一个消息单元的不肯定性程度就愈大;反 之,N愈少。当消息单元的总数N=1时,H=0,输送这个消息 的不肯定性程度为零,就是完全肯定输送这个消息。

信息熵意义:

在解决通信领域里的实际问题比较方便,只要知道等概 率消息单元总数N就可以计算信息熵H。

不足:

①对简单的信息源应用起来方便,对复杂的信息源把握等概 率消息单元总数N却不是容易做到的;

②用这个信息熵定义计算得到的实际上是信息源的最大熵。

3、1948年,shannon推广Hartrey信息熵的定义,首先引入各不 等概消息单元不肯定性的量度——本征信息熵为:

信息源特点:

•它们都具有一系列可能的基本状态,叫本征态。每一本征态称为 一个消息单元,记:Xi(i=1,2,3……n),这n个消息单元或本征态 序列实际上就是离散的随机变量,它具有互斥性和完备性。互斥性: 信息源可能处于这个基本状态,也可能处于其余的基本状态,但不 能同时处于同一个本征状态,处于这个本征态,就不处于其它本征 态;完备性:这个n个消息单元是完备无缺的。这个n个互斥的完备 的消息单元构成一个消息单元的集合,记:X≡[X1, X2 ,……Xn]

一、熵概念的发展简史

1. 熵最初产生于18世纪初,Carnot研究热机效率发现可逆循 环过程,随后Clausius根据可逆Carnot循环过程定义了态 函数熵。 Clausius明确了熵态函数,但没有给出更深刻的 物理含义。

2. 直到19世纪中期,1887年波尔兹曼著名公式:w是热力学 体系宏观态的微观状态数。当初称热力学几率,其实这个 词并不确切。因为:通常几率在<0,1>区间,而热力学 体系宏观状态的微观状态数w总是大于1,而且数量级非