一元线性回归的最小二乘估计

第一课时 一元线性回归模型及其参数的最小二乘估计

解析 由题意得-x=3+4+4 5+6=4.5, -y=25+30+4 40+45=35. ∵回归直线方程^y=b^x+a^中b^=7,∴35=7×4.5+a^,解得a^=3.5, ∴^y=7x+3.5. ∴当 x=10 时,^y=7×10+3.5=73.5(万元). 答案 73.5

(2)列出下表,并用科学计算器进行有关计算.

i

1

2

3

4

5

xi

2

4

5

6

8

yi

30

40

60

50

70

xiyi

60

160

300

300

560

x2i

4

16

25

36

64

-x=5,-y=50,i=∑5 1x2i =145,i=∑5 1xiyi=1 380

5

∑xiyi-5-x

-

y

于是可得,b^=i=15

∑xi2-5-x 2

【训练2】 某车间为了规定工时定额,需要确定加工零件所花费的时间,为此做了四 次实验,得到的数据如下:

零件的个数x(个) 加工的时间y(h)

23 2.5 3

45 4 4.5

(1)已知零件个数与加工时间线性相关,求出y关于x的线性回归方程; (2)试预测加工10个零件需要多少时间?

4

解 (1)由表中数据,得∑xiyi=2×2.5+3×3+4×4+5×4.5=52.5, i=1

【迁移2】 (变条件,变设问)本例中近似方程不变,每小时生产有缺点的零件件数是 7,估计机器的转速. 解 因为 y=5710x-67,所以当 y=7 时,7=5710x-67,解得 x≈11,即估计机器的转速约为 11 转/秒.

第1课时 一元线性回归模型及参数的最小二乘估计

C.劳动生产率提高1 000元时,工人工资平均提高130元 D.当月工资为250元时,劳动生产率为2 000元

解析 因为经验回归直线的斜率为80,所以x每增加1,y平均增加80, 即劳动生产率提高1 000元时,工人工资平均提高80元.

1234

x6

8

10

12

y23

5

6

(2)请根据上表提供的数据,用最小二乘法求出 y 关于 x 的经验回归方程y^

=b^ x+a^ ;

解 x =6+8+410+12=9, y =2+3+4 5+6=4,

4

x2i =62+82+102+122=344,

i=1

4

xiyi=6×2+8×3+10×5+14-10×8×2=24,

i=1

则b^ =8204=0.3, a^ = y -b^ x =2-0.3×8=-0.4, 故所求经验回归方程为y^ =0.3x-0.4.

(2)判断变量x与y之间是正相关还是负相关; 解 由于变量y的值随x值的增加而增加(b=0.3>0),故x与y之间是正相关.

随堂演练

一、一元线性回归模型与函数模型

知识梳理

一元线性回归模型:我们称

Y=bx+a+e, Ee=0,De=σ2

为Y关于x的_一__元__线_性__回__归__

模型,其中,Y称为 因变量 或 响应变量 ,x称为 自变量 或 解释变量 ;

a和b为模型的未知参数,a称为 截距参数,b称为 斜率 参数;e是Y与bx+a

i=1

b^ =15384-4-4×4×9×924=2104=0.7,a^ = y -b^ x =4-0.7×9=-2.3,

故经验回归方程为 y^ =0.7x-2.3.

一元线性回归模型参数的最小二乘法估计

8.2.1一元线性回归模型1.生活经验告诉我们,儿子的身高与父亲的身高相关.一般来说,父亲的身高较高时,儿子的身高通常也较高.为了进一步研究两者之间的关系,有人调查了14名男大学生的身高及其父亲的身高,得到的数据如表1所示.编号1234567891011121314父亲身高/cm 174 170 173 169 182 172 180 172 168 166 182 173 164 180 儿子身高/cm 176 176 170 170 185 176 178 174 170 168 178 172 165 182从图上看,散点大致分布在一条直线附近根据我们学过的整理数据的方法:相关系数r =0.886.父亲身高/cm180 175 170 165 160160 165 170 175180 185 190 ·· ·· · · · 儿子身高/cm· · · · ·185 1).问题1:可以得到什么结论?由散点图的分布趋势表明儿子的身高与父亲的身高线性相关,通过相关系数可知儿子的身高与父亲的身高正线性相关,且相关程度较高.2).问题2:是否可以用函数模型来刻画?不能,因为不符合函数的定义.这其中还受其它因素的影响.3).问题3:那么影响儿子身高的其他因素是什么?影响儿子身高的因素除父亲的身外,还有母亲的身高、生活的环境、饮食习惯、营养水平、体育锻炼等随机的因素,儿子身高是父亲身高的函数的原因是存在这些随机的因素.4).问题4: 你能否考虑到这些随机因素的作用,用类似于函数的表达式,表示儿子身高与父亲身高的关系吗?用x表示父亲身高,Y表示儿子的身高,用e表示各种其它随机因素影响之和,称e为随机误差, 由于儿子身高与父亲身高线性相关,所以Y=bx+a.考虑随机误差后,儿子的身高可以表示为:Y=bx+a+e由于随机误差表示大量已知和未知的各种影响之和,它们会相互抵消,为使问题简洁,可假设随机误差e的均值为0,方差为与父亲身高无关的定值 . 2σ2即E e D eσ:()0,().==我们称①式为Y 关于x 的一元线性回归模型,其中,Y 称为因变量或响应变量,x 称为自变量或解释变量 . a 称为截距参数,b 称为斜率参数;e 是Y 与bx+a 之间的随机误差.2,()0,().Y bx a e E e D e σ=++⎧⎨==⎩① 2、一元线性回归模型如果用x 表示父亲身高,Y 表示儿子的身高,e 表示随机误差.假定随机误差e 的均值为0,方差为与父亲身高无关的定值 ,则它们之间的关系可以表示为2σ4.问题5:你能结合具体实例解释产生模型①中随机误差项的原因吗?产生随机误差e的原因有:(1)除父亲身高外,其他可能影响儿子身高的因素,比如母亲身高、生活环境、饮食习惯和锻炼时间等.(2)在测量儿子身高时,由于测量工具、测量精度所产生的测量误差.(3)实际问题中,我们不知道儿子身高和父亲身高的相关关系是什么,可以利用一元线性回归模型来近似这种关系,这种近似关系也是产生随机误差e的原因.8.2.2一元线性回归模型参数的最小二乘法估计二、自主探究问题1.为了研究两个变量之间的相关关系, 我们建立了一元线性回归模型表达式 刻画的是变量Y 与变量x 之间的线性相关关系,其中参数a 和b 未知,我们如何通过样本数据估计参数a 和b?2,()0,().Y bx a e E e D e σ=++⎧⎨==⎩问题2.我们怎样寻找一条“最好”的直线,使得表示成对样本数据的这些散点在整体上与这条直线最“接近”?从成对样本数据出发,用数学的方法刻画“从整体上看,各散点与蓝色直线最接近”利用点到直线y=bx+a 的“距离”来刻画散点与该直线的接近程度,然后用所有“距离”之和刻画所有样本观测数据与该直线的接近程度.父亲身高/cm180 175 170 165 160160 165 170 175180 185 190 ·· ·· · · · 儿子身高/cm· · · · ·185 父亲身高/cm180 175 170 165 160160 165 170 175 180 185 190·· ·· · · · 儿子身高/cm· · · · ·185设满足一元线性回归模型的两个变量的n 对样本数据为(x 1,y 1),(x 2,y 2),…,(x n ,y n )父亲身高/cm180 175170165 160160165 170 175 180 185 190·· · · · · · 儿子身高/cm· ·· · · 185()()(1,2,3,,-).i i i i i i i i i i i y bx a e i n y bx a e e x y x bx a =++=⋅⋅⋅+=+由),得(显然越小,表示点,与点,的距离越小,()0,.i i i x y =即样本数据点离直线y=bx+a 的竖直距离越小,如上图特别地,当e 时,表示点在这条直线上1-)ni i i y bx a =+∑因此可用(来刻画各样本观测数据与直线y=bx+a 的整体接近程度.()iix y ,y=bx+a()i i x bx a +,·[]21(,)()ni i i Q a b y bx a ==-+∑残差平方和: 即求a ,b 的值,使Q ( a ,b )最小残差:实际值与估计值之间的差值,即 使Q 取得最小值,当且仅当b 的取值为121()()()nii i nii xx y y b xx ==--=-∑∑b.,ˆ,ˆ的最小二乘估计叫做求得a b a b(,).x y 经验回顾直线必经过的符号相同与相关系数r b ˆ最小二乘法我们将 称为Y 关于x 的经验回归方程,也称经验回归函数或经验回归公式,其图形称为经验回归直线,这种求经验回归方程的方法叫最小二乘法.ˆˆˆy bxa =+12111=i ni n22i ni n x x y y ˆb ,x x ˆˆa x y x y x xy b .i i i i i i ΣΣx )n ΣΣ(()()n ====⎧--⎪=⎪⎨-⎪⎪--=⎩-问题2:依据用最小二乘估计一元线性回归模型参数的公式,求出儿子身高Y 关于父亲身高x 的经验回归方程.儿子的身高不一定会是177cm ,这是因为还有其他影响儿子身高的因素,回归模型中的随机误差清楚地表达了这种影响,父亲的身高不能完全决定儿子的身高,不过,我们可以作出推测,当父亲的身高为176cm 时,儿子身高一般在177cm 左右.当x=176时, ,如果一位父亲身高为176cm,他儿子长大后身高一定能长到177cm 吗?为什么?177y ≈083928957ˆy .x .=+的意义?∧b残差的定义,e a bx Y ++=一元线性回归模型,,Y y 对于通过观测得响应到的数据称量为变观测值ˆ,y通过经验回归方程得到称为预报值的ˆ.ˆey y =-残观测值减去预报值称为即差判断模型拟合的效果:残差分析问题3:儿子身高与父亲身高的关系,运用残差分析所得的一元线性回归模型的有效性吗?残差图:作图时纵坐标为残差,横坐标可以选为样本编号,或身高数据或体重估计值等,这样作出的图形称为残差图.从上面的残差图可以看出,残差有正有负,残差点比较均匀地分布在横轴的两边,可以判断样本数据基本满足一元线性回归模型对于随机误差的假设.所以,通过观察残差图可以直观判断样本数据是否满足一元线性回归模型的假设,从而判断回归模型拟合的有效性.所以,只有图(4)满足一元线性回归模型对随机误差的假设图(1)显示残差与观测时间有线性关系,应将时间变量纳入模型; 图(2)显示残差与观测时间有非线性关系,应在模型中加入时间的非线性函数部分; 图(3)说明残差的方差不是一个常数,随观测时间变大而变大图(4)的残差比较均匀地集中在以横轴为对称轴的水平带状区域内.根据一元线性回归模型中对随机误差的假定,残差应是均值为0,方差为 的随机变量的观测值.2σ观察以下四幅残差图,你认为哪一个残差满足一元线性回归模型中对随机误差的假定?1.残差等于观测值减预测值2.残差的平方和越小越好;3.原始数据中的可疑数据往往是残差绝对值过大的数据;4. 对数据刻画效果比较好的残差图特征:残差点比较均匀的集中在水平带状区域内.归纳小结(残差图中带状越窄,精度越高)1.关于残差图的描述错误的是( )A.残差图的横坐标可以是样本编号B.残差图的横坐标也可以是解释变量或预报变量C.残差点分布的带状区域的宽度越窄相关指数越小D.残差点分布的带状区域的宽度越窄残差平方和越小C 三、巩固提升2.根据如下样本数据:得到的经验回归方程为 ,则( ) A. >0, >0B. >0, <0C. <0, >0D. <0, <0 x 2 3 4 5 6 Y42.5-0.5-2-3a $a $a $a$$b $b$b$b $$ybx a =+$ B3.某种产品的广告支出费用x(单位:万元)与销售额Y(单位:万元)的数据如表:已知Y 关于x 的经验回归方程为 =6.5x+17.5,则当广告支 出费用为5万元时,残差为________. x 2 4 5 6 8Y 30 40 60 50 70$y当x=5时, =6.5×5+17.5=50,表格中对应y=60,于是残差为60-50=10.$y10一元线性回归模型的应用例1.经验表明,对于同一树种,一般树的胸径(树的主干在地面以上1.3m处的直径)越大,树就越高.由于测量树高比测量胸径困难,因此研究人员希望由胸径预测树高.在研究树高与胸径之间的关系时,某林场收集了某种树的一些数据如下表所示,试根据这些数据建立树高关于胸径的经验回归方程.编号 1 2 3 4 5 6胸径/cm 18.1 20.1 22.2 24.4 26.0 28.3树高/m 18.8 19.2 21.0 21.0 22.1 22.1编号7 8 9 10 11 12胸径/cm 29.6 32.4 33.7 35.7 38.3 40.2树高/m 22.4 22.6 23.0 24.3 23.9 24.7dh· · ·· · · · · · · · · 解: 以胸径为横坐标,树高为纵坐标作散点图如下:散点大致分布在一条从左下角到右上角的直线附近,表明两个变量线性相关,并且是正相关,因此可以用一元线性回归模型刻画树高与胸径之间的关系.0.249314.84h d =+··· ·· · · · · · · · 用d 表示胸径,h 表示树高,根据据最小二乘法,计算可得经验回归方程为0.249314.84h d =+根据经验回归方程,由胸径的数据可以计算出树高的预测值(精确到0.1)以及相应的残差,如下表所示.编号胸径/cm 树高观测值/m 树高预测值/m 残差/m1 18.1 18.8 19.4 -0.62 20.1 19.2 19.9 -0.73 22.2 21.0 20.4 0.64 24.4 21.0 20.9 0.15 26.0 22.1 21.3 0.86 28.3 22.1 21.9 0.27 29.6 22.4 22.2 0.28 32.4 22.6 22.9 -0.39 33.7 23.0 23.2 -0.210 35.7 24.3 23.7 0.611 38.3 23.9 24.4 -0.512 40.2 24.7 24.9 -0.2以胸径为横坐标,残差为纵坐标,作残差图,得到下图.30252015-1.0-0.5 0.0 0.5 1.0· · · · · · · 残差/m· · · ·· 354045胸径/cm观察残差表和残差图,可以看到残差的绝对值最大是0.8,所有残差分布在以横轴为对称轴、宽度小于2的带状区域内 .可见经验回归方程较好地刻画了树高与胸径的关系,我们可以根据经验回归方程由胸径预测树高.编号1 2 3 4 5 6 7 8 年份 1896 1912 1921 1930 1936 1956 1960 1968 记录/s 11.8010.6010.4010.3010.2010.1010.009.95例2.人们常将男子短跑100m 的高水平运动员称为“百米飞人”.下表给出了1968年之前男子短跑100m 世界纪录产生的年份和世界纪录的数据.试依据这些成对数据,建立男子短跑100m 世界纪录关于纪录产生年份的经验回归方程以成对数据中的世界纪录产生年份为横坐标,世界纪录为纵坐标作散点图,得到下图在左图中,散点看上去大致分布在一条直线附近,似乎可用一元线性回归模型建立经验回归方程.将经验回归直线叠加到散点图,得到下图:76913031.4902033743.0ˆ1+-=t y用Y 表示男子短跑100m 的世界纪录,t 表示纪录产生的年份 ,利用一元线性回归模型来刻画世界纪录和世界纪录产生年份之间的关系 . 根据最小二乘法,由表中的数据得到经验回归方程为:从图中可以看到,经验回归方程较好地刻画了散点的变化趋势,请再仔细观察图形,你能看出其中存在的问题吗?你能对模型进行修改,以使其更好地反映散点的分布特征吗?仔细观察右图,可以发现散点更趋向于落在中间下凸且递减的某条曲线附近.回顾已有的函数知识,可以发现函数y=-lnx的图象具有类似的形状特征注意到100m短跑的第一个世界纪录产生于1896年, 因此可以认为散点是集中在曲线y=f(t)=c1+c2ln(t-1895)的周围,其中c1、c2为未知参数,且c2<0.y=f(t)=c1+c2ln(t-1895)这是一个非线性经验回归函数,如何利用成对数据估计参数c1、c2令x=ln(t-1895),则Y=c2x+c1对数据进行变化可得下表:编号 1 2 3 4 5 6 7 8 年份/t 1896 1912 1921 1930 1936 1956 1960 1968 x 0.00 2.83 3.26 3.56 3.71 4.11 4.17 4.29 记录/s 11.80 10.60 10.40 10.30 10.20 10.10 10.00 9.95将x=ln(t-1895)代入:得 8012653.114264398.0ˆ2+-=x y上图表明,经验回归方程对于成对数据具有非常好的拟合精度.将经验回归直线叠加到散点图,得到下图: 8012653.114264398.0ˆ2+-=x y8012653.11)1895ln(4264398.0ˆ2+--=t y经验回归方程为对于通过创纪录时间预报世界纪录的问题,我们建立了两个回归模型,得到了两个回归方程,你能判断哪个回归方程拟合的精度更好吗?8012653.114264398.0ˆ2+-=x y① 2ˆ0.4264398ln(1895)11.8012653y t =--+② 我们发现,散点图中各散点都非常靠近②的图象, 表明非线性经验回归方程②对于原始数据的拟合效果远远好于经验回归方程①.(1).直接观察法.在同一坐标系中画出成对数据散点图、非线性经验回归方程②的图象(蓝色)以及经验回归方程①的图象(红色).28212811ˆ,ˆQ Q (()0.004)0.669i i i i eu ===≈=≈∑∑8012653.114264398.0ˆ2+-=x y① 2ˆ0.4264398ln(1895)11.8012653yt =--+②(2).残差分析:残差平方和越小,模型拟合效果越好.Q 2明显小于Q 1,说明非线性回归方程的拟合效果 要优于线性回归方程.R 2越大,表示残差平方和越小,即模型的拟合效果越好 R 2越小,表示残差平方和越大,即模型的拟合效果越差. 21212ˆ()11()n i i nii i y y y y R ==-=-=--∑∑残差平方和。

一元线性回归模型参数的最小二乘估计(第二课时)课件-高二数学人教A版(2019)选择性必修第三册

残差比较均匀地分布在以取

值为0的横轴为对称轴的水

平带状区域内. 所以在四幅

残差图中,只有图(4)满足

一元线性回归模型对随机误

差的假设.

典例 1:下面给出了根据某地区 2013~2019 年水果人均占有量 y(单位:kg)和年份代码

x 绘制的散点图和经验回归方程的残差图(2013~2019 年的年份代码 x 分别为 1~7).

注意到100m短跑的第一个世界纪录产生于1896年,因此可认为散点集中在曲线

y=c1+c2ln(t-1895)的周围. 其中c1和c2为未知参数,且c2 < 0.

用上述函数刻画数据变化的趋势,这是一个非线性经验回归函数,其中c1, c2 是待

定参数. 现在问题转化为如何利用成对数据估计参数c1和c2.

መ

以计算出=0.839

,ො

=28.957,

求出儿子身高Y关于父亲身高x的经验回归方

程为

ŷ 0.839 x 28.957

相应的经验回归直线如图所示.

ŷ 0.839 x 28.957

ො

思考:当x=176时,≈177.

如果一位父亲身高为176cm,他儿子长大成人后的身高一

定是177cm吗? 为什么?

残差是随机误差的估计结果,通过对残差的分析可以判断模型刻画数据的效果,以及判断

原始数据中是否存在可疑数据等,这方面工作称为残差分析。

残差分析:

残差表:将残差以表格的形式呈现;

残差图:将残差以图象的形式呈现。

残差表:

编号

父亲身高/cm

儿子身高观测值/cm

儿子身高预测值/cm

残差/cm

1

174

最小二乘估计原理

最小二乘估计原理最小二乘估计是一种常用的参数估计方法,它可以用来估计线性回归模型中的参数。

在实际应用中,最小二乘估计被广泛应用于数据拟合、信号处理、统计分析等领域。

本文将介绍最小二乘估计的原理及其应用。

最小二乘估计的原理是基于最小化观测值与模型预测值之间的误差平方和来进行参数估计。

在线性回归模型中,我们通常假设因变量Y与自变量X之间存在线性关系,即Y = β0 + β1X + ε,其中β0和β1是待估参数,ε是误差项。

最小二乘估计的目标是找到最优的β0和β1,使得观测值与模型预测值之间的误差平方和最小。

为了形式化地描述最小二乘估计的原理,我们可以定义损失函数为误差的平方和,即L(β0, β1) = Σ(Yi β0 β1Xi)²。

最小二乘估计的思想就是通过最小化损失函数来求解最优的参数估计值。

为了找到最小化损失函数的参数估计值,我们可以对损失函数分别对β0和β1求偏导数,并令偏导数等于0,从而得到最优的参数估计值。

在实际应用中,最小二乘估计可以通过求解正规方程来得到参数的闭式解,也可以通过梯度下降等迭代方法来进行数值优化。

无论采用何种方法,最小二乘估计都能够有效地估计出线性回归模型的参数,并且具有较好的数学性质和统计性质。

除了在线性回归模型中的应用,最小二乘估计还可以推广到非线性回归模型、广义线性模型等更加复杂的模型中。

在这些情况下,最小二乘估计仍然是一种有效的参数估计方法,并且可以通过一些变形来适应不同的模型结构和假设条件。

总之,最小二乘估计是一种重要的参数估计方法,它具有简单直观的原理和较好的数学性质,适用于各种统计模型的参数估计。

通过最小化观测值与模型预测值之间的误差平方和,最小二乘估计能够有效地估计出模型的参数,并且在实际应用中取得了广泛的成功。

希望本文对最小二乘估计的原理有所帮助,谢谢阅读!。

一元线性回归的最小二乘估计

最小二乘估计是在所有线性无偏估计中方差最小的。

易于计算

最小二乘估计可以通过矩阵运算或者最优化方法快速计算得到。

最小二乘估计的应用范围和局限性

1 广泛应用

最小二乘估计在经济学、统计学、机器学习等领域有着广泛的应用。

2 数据相关性要求

最小二乘估计需要假设自变量和因变量之间存在线性关系,并且数据的相关性较强。

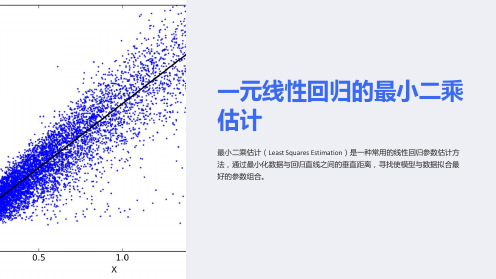

一元线性回归的最小二乘 估计

最小二乘估计(Least Squares Estimation)是一种常用的线性回归参数估计方 法,通过最小化数据与回归直线之间的垂直距离,寻找使模型与数据拟合最 好的参数组合。

最小二乘估计的背景和概念

回归分析起源

最小二乘估计最早由高斯提出,用于解决天文观测中的误差问题。

最小二乘估计可以应用于医疗研 究,分析药物剂量和疗效之间的 关系,指导临床决策。

残差图

残差图用于检验回归模型是否合理, 是否存在模型假设的违背。

最小二乘估计的公式推导

1 回归直线的表达式

2 最优参数估计

3 参数估计的标准误差

最小二乘估计通过最小化残 差平方和来求解回归直线的 斜率和截距。

最小二乘估计的求解可以通 过矩阵运算和最优化方法来 实现。

最小二乘估计可以估计参数 的标准误差,用于判断参数 估计的精确程度。

线性回归模型

线性回归模型假设自变பைடு நூலகம்和因变量之间存在线性关系,是最小二乘估计的基础。

误差项的假设

最小二乘估计假设误差项满足独立同分布的正态分布。

一元线性回归的基本原理和模型

散点图

通过散点图可以直观地观察自变量 和因变量之间的关系。

回归直线

线性回归模型通过一条直线拟合数 据,表示自变量对因变量的影响。

822一元线性回归模型参数的最小二乘估计 课件(共23张PPT)

观测数据与直线 y bx a的“整体接近程度”.

探究新知

残差:实际值与估计值之间的差值,即 yi (bxi a )

n

| y

i 1

i

(bxi a ) |

n

残差平方和: Q(a, b) yi (bxi a )

2

i 1

求a, b的值,使Q(a, b)最小

的变化的方法称为回归分析.

探究新知

一元线性回归模型Y bx a e

对于响应变量Y,通过观测得到的数据为观测值,通过经验回归

方程得到的 ŷ称为预测值,观测值减去预测值称为残差,即eˆ y yˆ .

残差是随机误差的估计值,通过对残差的分析可判断回归模

型刻画数据的效果,以及判断原始数据中是否存在可疑数据等,

C.a 0, b 0

D.a 0, b 0

6

n

i 1

i 1

2

(

x

x

)

17.5

x 5.5, y 0.25 ( xi x)( yi y) 24.5 i

25.5

b

1.4

17.5

â bˆ x y 7.95

利用公式(2)可以计算出b=0.839, a=28.957, 得到儿子身高Y

关于父亲身高x的经验回归方程为 y 0.839 x 28.957

相应的经验回归直线如下图所示:

儿子身高/cm

190

185

180

ŷ 0.839 x 28.957

175

170

165

160

160

165

170

175

探究新知

一元线性回归模型的参数估计

散点图

某居民小区家庭收入(X)与消费支出(Y)

Y

1500

的散点图

1300

1100

900

Yˆ = aˆ + bˆX

700

500

X

600

1100

1600

2100

最小二乘准则

Y

.(Xi,Yi)

. Yˆ = aˆ + bˆX (X j ,Yˆj )

ei

. . (Xi,Yˆi)

0

. ej

(Xj,Yj)

X

min

参数估计计算表

Yi

xi

yi

3637 3919 4185 4331 4616 4998 5359 6030

37075

-1517.4 -961.4 -640.4 -375.4 53.6 479.6 1058.6 1902.6 ——

-997.4 -715.4 -449.4 -303.4 -18.4 363.6 724.6 1395.6 ——

X = X i = 46403 = 5800.375

n

8

Y = Yi = 37075 = 4634.375

n

8

根据表 2 合计栏的数据及以上关于 X 和Y 的计

算结果可得:

bˆ1 =

xi yi = 6198658.9 0.7083 xi2 8751239.9

bˆ0 = Y - bˆ1 X 525.8662

2.对回归系数(斜率)进行统计假设检验,信度为 0.05。

3.估计可决系数并进行统计假设检验,信度为 0.05。

4.若下一年度居民货币收入为 25.5 亿元,预测购买消费品

支出的金额及预测区间,信度为 0.05。

计量经济学【一元线性回归模型——参数估计】

ˆ0计量ˆ1 和

可以分别表示为被解释变量观测Y值i

的线

性组合(线性函数);

ˆ证1 明

如( X下i : X )(Yi (Xi X )2

Y

)

(Xi X) (Xi X )2

(Yi

Y

)

ki (Yi Y )

其中ki :

(Xi X) (Xi X )2

ki

对ki于引0 进的 ki (X容i 易X证) 明有k如i X下i 的1 特性k:i2

2

,

,

,

,

,

,

,

,

i

1,

2,

n

假设3:随机误差项在不同样本点之间是独立的,不

存

Cov(i , j ) 0,,,,,,,i j,,,,i, j 1, 2, n

在序列相关,即:

一、一元线性回归模型的基本假设

假设 4:随机误差项与解释变量之间不相关, 即:

Cov( Xi , i ) 0,,,,,,,,,,,i 1, 2, n

:待估

E(Y

总样体本回回归归函函数数形形式式::Yˆi

| Xi)

ˆ0

0 ˆ1X i

1X i

其 计

中 估

方

ˆ0 , ˆ1 法ˆ0,, ˆ1求

是ˆ00,,ˆ11 出

的估计值,我们需要找到一种参数 , 并0 ,且1 这 种 参 数 估 计 方 法 保 证 了 估

计值 数

与总体真值

尽可能地接近;这种参

i

根据微 小,

积

分中

ˆ0 , ˆ1

求

极

值

的

原

理

,

要

使 i

ei2

待定系数

高中数学(新人教A版)选择性必修二:一元线性回归模型、一元线性回归模型参数的最小二乘估计【精品课件】

0.177 9

0.094 9

-1.071 1

^

e=

^

y-y

残差图如图所示.

由图可知,残差比较均匀地分布在横轴的两边,说明选用的模型比较合适.

(4)计算得R2≈0.985 5.说明拟合效果较好.

反思感悟(1)解答本类题目应先通过散点图、样本相关系数来分析两个变

量是否线性相关,再利用求经验回归方程的公式求解经验回归方程,并利用

归公式,其图形称为经验回归直线.这种求经验回归方程的方法叫做最小二乘

^ ^

法,求得的b, a叫做 b,a 的最小二乘估计.

n

^

∑ (x i -x)(y i -y)

b = i=1n

2

∑ (x i -x)

其中

,

i=1

^

^

a = y-bx.

回归直线过样本点的中心(x, y)

2.残差与残差分析

对于响应变量Y,通过观测得到的数据称为观测值,通过经验回归方程得到

2

∑ 2 -

=1

^

^

, = −Biblioteka )解 (1)散点图如图:

(2)由(1)中散点图可知 y 与 x 线性相关.

4

因为 ∑ xiyi=6×2+8×3+10×5+12×6=158,

=1

6+8+10+12

2+3+5+6

x=

=9,y =

=4,

4

4

4

∑ 2 =62+82+102+122=344,

2.67

由z=ln ae0+xln b及最小二乘法,得

ln b≈0.047 7,ln ae0≈2.378,

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

我们的任务是, 在给定X和Y的一组观测值 (X1, Y1), (X2, Y2) , ..., (Xn, Yn) 的情况下, 如 何求出 Yt = + Xt + ut 中 和 的估计值,使得拟 合的直线为最佳。

直观上看,也就是要求在X和Y的散点图上穿过 各观测点画出一条“最佳”直线,如下图所示。

3 例子

例1 对于第一段中的消费函数,若根据数据 得到:

n = 10 , X =23, Y =20

(X X)2 64, (X X)(Y Y) 37

则有ˆ

( X i X )(Yi (Xi X )2

Y)

37 64

0.58

ˆ Y ˆ X 20 0.58 * 23 6.70

因而 Yˆi 6.70 0.58X i

10

-8

-20

160 400

20

-4

-10

40 100

30

1

0

0

0

40

3

10

30 100

5 30 50

8

20

160 400

n=5 110 150

0

0

390 1000

Y X y x xy x2

X X t 150 30,Y Yt 110 22

n5

n5

ˆ

xy x2

390 1000

0.39,ˆ

= X X

即ˆ

=α 是α的无偏估计量。

2. ˆ 和ˆ 的方差

Var( ˆ )=E{[ˆ -E(ˆ )]2} ——根据定义

=E(ˆ -β)2

——由无偏性 E(βˆ )=β

由上段结果: ˆ

xt t

xt2

即Hale Waihona Puke ˆ xt tx2 t

∴ (ˆ )2 ( xt t )2 xt2

使各残差尽可能地小。要做到这一点,就必

须用某种方法将每个点相应的残差加在一起,

使其达到最小。理想的测度是残差平方和,

即

et 2 (Yt Yˆt )2

最小二乘法就是选择一条直线,使其残差平方和

达到最小值的方法。即选择 αˆ 和 ,使得

S et 2 (Yt Yˆt )2 (Yt ˆ ˆX t )2

E(i j )=0, i≠j

——根据假设(2)

∴ E(ˆ )2 (

1 xt2 )2 (

xi2 2 0)

2

xt2

即Var(ˆ) 2

达到最小值。

运用微积分知识,使上式达到最小值的必要条件为:

S ˆ

S ˆ

0

即

S

ˆ

2(1)(Yt ˆ ˆX t ) 0

(1)

S

ˆ

2( X t )(Yt ˆ ˆX t ) 0

(2)

整理,得:

Yt nˆ ˆ X t

(3)

XtYt ˆ

X t ˆ

X

2

.t

(4)

此二式称为正规方程。解此二方程,得:

∵ xt ( X t X ) X t X n X n X 0

∴ ˆ

xtYt xt2

xt ( X t t )

xt2

=

1 (

xt2

xt

xt X t

xt t )

=

1 (

xt2

xt X t

xt t )

1 xt2

(

xt2 X

xt

xt t )

例2 设Y和X的5期观测值如下表所示,试估计方程

Yt = + Xt + ut

序号

1

2

3

4

5

Yt 14 18 23 25 30

Xt 10 20 30 40 50

解:我们采用列表法计算。计算过程如下:

序号 Yt

表 1 14

3 -

2

18

1

3 23

4 25

Xt yt= Yt -Y xt=Xt-X xt yt xt2

ˆ (X t X )(Yt Y ) n X tYt X t Yt xt yt (5)

(Xt X)2

n X t 2 ( X t )2

xt 2

ˆ Y ˆ X

(6)

其中:Y Yt , X X t

n

n

xt X t X ,

yt Yt Y

样本均值 离差

(5)式和(6)式给出了OLS法计算αˆ 和 的 公式,αˆ 和 称为线性回归模型 Yt = + Xt + ut

= (

1 xt2 )2

( x1 1

x22

xnn )2

两边取期望值,得:

1

= (

xt2 )2 (

xi2i2 xi x j i j )

i j

E(ˆ )2 1 [ ( xt2 )2

xi2E(i2 ) xi x j E(i j )]

i j

由于

E(

2 t

)=

2

,

t=1,2,…,n

——根据假设(3)

Y

* * Y X

Yt

* **

Yˆt

et * *

*

*

**

* * * Yˆ*t

*Y

Yt

*

Xt

X

图2

残差

拟合的直线 Y X 称为拟合的回归线.

对于任何数据点 (Xt, Yt), 此直线将Yt 的总值 分 成两部分。 第一部分是Yt的拟合值或预测值 Yˆt :

Yˆt αˆ βˆ Xt , t=1,2,……,n

的参数 和 的普通最小二乘估计量 (OLS estimators)。

这两个公式可用于任意一组观测值数据,以求出 截距和斜率的OLS估计值(estimates),估计值是 从一组具体观测值用公式计算出的数值。

一般说来,好的估计量所产生的估计值将相当 接近参数的真值,即好的估计值。可以证明,对 于CLR模型,普通最小二乘估计量正是这样一个 好估计量。

1 ( xt2

xt2

xt t )

即 ˆ

xt t

x

2 t

两边取期望值,有

E(ˆ)

xt E(t )

xt2

=

这表明ˆ是的无偏估计量。

假设(4) --假设(1)

由ˆ Y ˆ X 我们有:

E(ˆ) E(Y ˆ X )

= E( X ˆ X ) = X E() X E(ˆ)

第二部分,et 代表观测点对于回归线的误差,称 为拟合或预测的残差 (residuals):

et Yt Yˆt

t=1,2,……,n

即 et Yt ˆ ˆ Xt

t=1,2,……,n

如何决定估计值 和 ?

残差平方和

我们的目标是使拟合出来的直线在某种

意义上是最佳的,直观地看,也就是要求估

计直线尽可能地靠近各观测点,这意味着应

Y

ˆ

*

X

22 0.39*30

10.3

Eviews 创建工作文件,输入数据并进行回归: Create u 1 5 data x y ls y c x

三、 最小二乘法估计量的性质

1. ˆ 和ˆ 的均值

ˆ

xt yt

xt (Yt Y )

xt Yt

Y

xt

xt2

xt2

x

2 t

xt2