一种新的Wolfe线搜索技术及全局收敛性

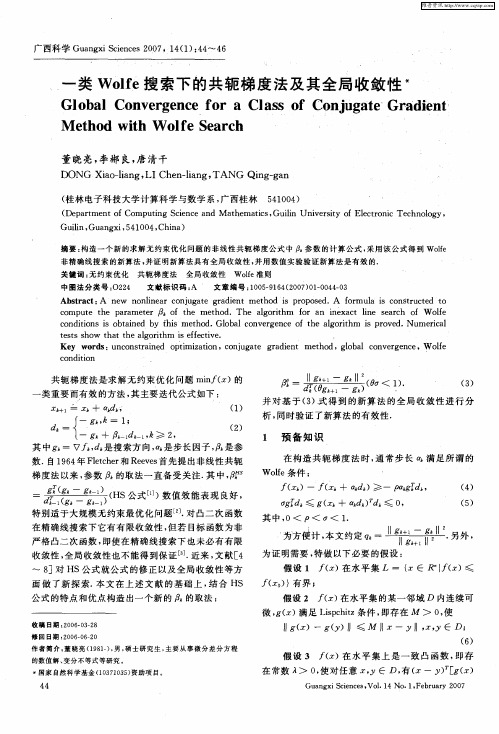

一类Wolfe搜索下的共轭梯度法及其全局收敛性

董 晓亮, 李郴 良, 清干 唐

DONG a —in L e — a g TANG n — a Xio l g, ICh n l n , a i Qi g g n ( 桂林 电子科 技大学 计算 科学 与数学 系 , 广西桂 林

^ 』 _ = < 【 1 - 1

一

g + 一 d 一 , l lk≥ 2 ,

‘ ( 2 ) J

1 预 备 知 识

在 构 造共 轭 梯度 法 时 , 常 步 长 a 满 足 所谓 的 通 k Wo e 件 : l条 f

f( x )一 f x + a ( k )≥ 一 pkr d a k , gd a r g( ad )d ≤ 0 gd ≤ x + k , () 4 () 5

维普资讯

广 西科学 Gun x S i cs2 0 1 ( ) 4 " 4 a g i c n e 0 7 4 1 :4- 6 e -

一

类 W0f 搜 索 下 的 共轭 梯 度 法 及 其全 局 收 敛 性 le

.

Gl b l a Co v r e c fr a C so o jg t’ r de t o n e g n e o ls fC n u ae G a i a n

f( 。 ) x ) 有界 ;

. 另外 ,

收敛性 , 全局 收敛性 也不 能得 到保证 L. 3 近来 , 献 [ ] 文 4

~

8 对 HS公式 就公 式 的修 正 以及 全局 收 敛性 等方 ]

面 做 了新 探 索. 文 在 上 述文 献 的基 础 上 , 合 HS 本 结

c n to o diin

共轭 梯度 法是 求 解无 约束 优 化 问题 mif x n ( )的

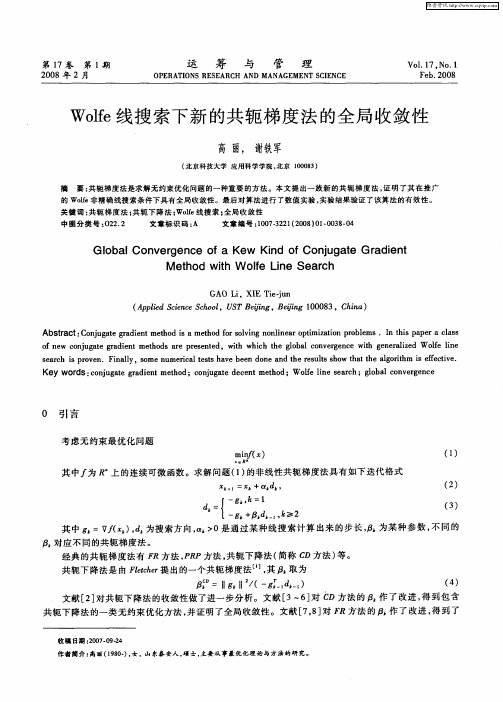

Wolfe线搜索下新的共轭梯度法的全局收敛性

(p l dSi c col S ei , e g 10 8 ,C i ) A p ̄ c neSh o,U TB in B n 0 0 3 hn e jg a A src : ojgt gai t e o to r o i ol er pi zt npol .I ti pp r l s b t tC n a rde t di a hdf l n nni a t a o rbe a u e n m h s me osv g n o mi i ms n hs a e aca s

Glb l o v re c f e Kn fC nu aeGrde t a n eg n eo K w ido o jg t in o C a a

M e h t ol ne Se c t od wi W f Li ar h h e

GA i O L ,XI i- n E T ej u

() 5

其 中 , 为参数 。因为精 确线 搜索确 定 的步长 满足 正交条 件 g x a d ) d = ( + k 0 所以, 当采 用精 确 线搜索 时得 到 = , 卢 故方 法 ( ) ( ) ( ) 2 、 3 和 5 是共 轭 梯度 法 。 在 式 ( ) 5 中取 =1 ,

维普资讯

第1 7卷

第1 期

运 筹 与 管 理

0P ERAT1 0NS RES EARCH AND ANAGEM ENT M SCI ENCE

Vo . 7 , . 1 1 No 1

20 0 8年 2月

F b. 0 e 2 08

o e oj g t a in to saep ee td i hc h lb o v re c t e eaie l ie fn w c nu aeg de tmeh d r rsne ,w t w ih tego a c n eg n ewi g n rl d Wof l r h l h z e n

Wolfe线搜索下的一类新的共轭梯度法

定理 1 假设条件 ( ) H 成立 , ‘ } { 是由算法 1 ’

作者简介 : 张雅琴 (99 , , 师 , , 16 一)女 讲 硕士 主要研究方 向为最优化理论与方法 。

太

原

科

技

大

学

学

报

21 0 0生

产生 的序列 , 如果对任 何 k 均பைடு நூலகம் g x )≠ 0 ( ’ ,

得到一个新的共轭梯度法 , 并在 Wo e l 线搜索 f 下证明了此共轭梯度法的收敛性。 w0 e l 线搜索要求步长 满足 : f

厂 ’ 厂 ‘ +a d )≥ 一 ( )一 ( k‘ ’

则

‘ ’停 ; “ 否则 , S p ; 转 t e6 Se 令 d“ =一 ( ‘ )+ + ‘ 其中 t 6 p ‘ g 1 ¨, d

行研究 。 g x ) = V 戈 记 (‘ ’ ‘ , 共 轭 梯 度法 ) 则 的计算 公 式为 :

( )= ( d ’+ ( ’ () 1

1 假设 与算 法

对 目 函数 ) 标 作如下假设( ) H : ()目标函数 ) I 在水平集 £ o)={ ∈ (( ’ 引

)≤ ‘ ) 有 界 ; 。 } ’

(I I)目标 函数 厂 ) ( 在水 平集 L )内连续 可 (

微, 且其梯度 g x ()满足 Lsci 条件 , i ht p z 即存在常数 M >0 使得 l ()一 ( )I≤ M } 一 , x , I x gY J g J YI V , J

参数 + 满足 ( ) , k=k+1转 Se . , 3 式 令 , t 3 p

g x (‘ ’+cd ’ ‘ t )d k ’≥ o ( ‘ )d ' x ‘ g ’ ’

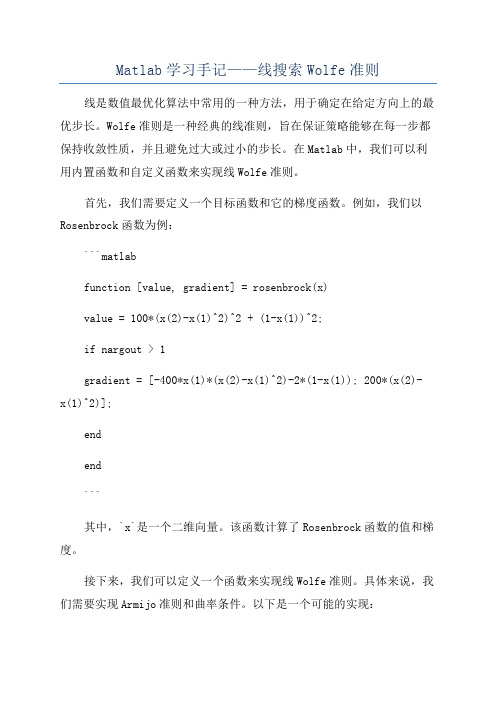

Matlab学习手记——线搜索Wolfe准则

Matlab学习手记——线搜索Wolfe准则线是数值最优化算法中常用的一种方法,用于确定在给定方向上的最优步长。

Wolfe准则是一种经典的线准则,旨在保证策略能够在每一步都保持收敛性质,并且避免过大或过小的步长。

在Matlab中,我们可以利用内置函数和自定义函数来实现线Wolfe准则。

首先,我们需要定义一个目标函数和它的梯度函数。

例如,我们以Rosenbrock函数为例:```matlabfunction [value, gradient] = rosenbrock(x)value = 100*(x(2)-x(1)^2)^2 + (1-x(1))^2;if nargout > 1gradient = [-400*x(1)*(x(2)-x(1)^2)-2*(1-x(1)); 200*(x(2)-x(1)^2)];endend```其中,`x`是一个二维向量。

该函数计算了Rosenbrock函数的值和梯度。

接下来,我们可以定义一个函数来实现线Wolfe准则。

具体来说,我们需要实现Armijo准则和曲率条件。

以下是一个可能的实现:```matlabfunction [alpha, value] = line_search_wolfe(f, x, p, c1, c2, max_iter, alpha_max)alpha = alpha_max;[f0, gradient0] = f(x);value = f0;for iter = 1:max_iter[f_alpha, gradient_alpha] = f(x + alpha*p);if f_alpha > f0 + c1*alpha*gradient0'*p , (iter > 1 &&f_alpha >= f_alpha0)alpha = zoom(f, x, p, c1, c2, alpha0, alpha);return;endif abs(gradient_alpha'*p) <= -c2*gradient0'*preturn;endif gradient_alpha'*p >= 0alpha = zoom(f, x, p, c1, c2, alpha, alpha0);return;endalpha0 = alpha;f_alpha0 = f_alpha;alpha = min(2*alpha, alpha_max);endendfunction alpha = zoom(f, x, p, c1, c2, alpha_lo, alpha_hi) while truealpha = (alpha_lo + alpha_hi)/2;[f_alpha, gradient_alpha] = f(x + alpha*p);f_lo = f(x + alpha_lo*p);if f_alpha > f_lo + c1*alpha*(gradient_alpha'*p) ,f_alpha >= f_alpha_loalpha_hi = alpha;elseif abs(gradient_alpha'*p) <= -c2*(gradient_lo'*p)break;endif gradient_alpha'*p*(alpha_hi - alpha_lo) >= 0alpha_hi = alpha_lo;endalpha_lo = alpha;f_alpha_lo = f_alpha;endendend```该函数接受一个目标函数和它的参数 `x` 和方向 `p`。

强wolfe准则

强Wolfe准则什么是强Wolfe准则?强Wolfe准则,也被称为强Wolfe-Powell准则,是数学优化中的一种准则,用于确定线搜索算法中的步长。

在优化问题中,我们常常需要通过迭代来寻找函数的最小值或最大值。

线搜索算法是一种常用的迭代方法,其中强Wolfe准则被广泛应用。

线搜索算法线搜索算法的目标是在每次迭代中找到一个合适的步长,在目标函数下降最快的方向上更新当前解。

这个步长通常通过满足一定条件来确定。

强Wolfe准则的定义强Wolfe准则给出了线搜索算法中步长选择的条件。

对于给定的目标函数和搜索方向,强Wolfe准则要求满足以下两个条件:1.曲率条件:目标函数在新解处有足够下降。

2.阻尼条件:新解相对于当前解具有足够小的梯度。

具体来说,假设f(x)是我们要优化的目标函数,g(x)是f(x)关于x的梯度向量(即导数),α是步长。

曲率条件可以表示为:f(x+αp)≤f(x)+c1αg T(x)p其中,p是搜索方向向量,c1是一个介于0和1之间的常数,用于控制下降程度。

这个条件确保了新解相对于当前解有足够的下降。

阻尼条件可以表示为:|g T(x+αp)p|≤c2|g T(x)p|其中,c2是另一个介于c1和1之间的常数,用于控制梯度变化。

这个条件确保了新解相对于当前解具有足够小的梯度。

强Wolfe准则要求同时满足曲率条件和阻尼条件。

强Wolfe准则的应用强Wolfe准则在优化算法中被广泛应用。

通过选择合适的步长,我们可以加快优化过程,并且能够更好地收敛到最优解。

在实际应用中,我们通常使用线搜索算法来满足强Wolfe准则。

一种常见的线搜索算法是回溯线搜索(backtracking line search)。

该算法通过不断缩小步长来找到满足强Wolfe准则的最佳步长。

回溯线搜索首先选择一个初始步长,并计算目标函数在新解处的值。

如果曲率条件不满足,则将步长缩小一定比例(通常是减半),并重新计算目标函数的值。

4 Frank-Wolfe方法

基本原理

Frank-Wolfe方法 方法

最优步长

(2) 确定一维搜索步长

Frank-Wolfe方法 方法 Step1 Step2

算法步骤

Step3 Step4

Frank-Wolfe方法 方法

举例

第一次迭代: 第一次迭代:

举例

Frank-Wolfe方法 方法

第二次迭代: 第二次迭代:

举例

Frank-Wolfe方法 方法

frankwolfe全局收敛性分析frankwolfe算法是一种可行方向法在每次迭代中搜索方向总是指向某个极点并且当迭代点接近最优解时搜索方向与目标函数的梯度趋于正交因此算法收敛速度比较慢

简介

Frank-Wolfe方法 方法

1956年,Frank 和Wo1fe提出了一种求解线性约束问题的算 年 提出了一种求解线性约束问题的算 其基本思想是将目标函数作线性近似, 法,其基本思想是将目标函数作线性近似,通过求解线性规 划求得可行下降方向,并沿该方向在可行域内作一维搜索 并沿该方向在可行域内作一维搜索. 划求得可行下降方向 并沿该方向在可行域内作一维搜索 这种方法又称作近似线性化方法.

Байду номын сангаас第三次迭代: 第三次迭代:

y2

.

Frank-Wolfe方法 方法

全局收敛性分析

特点

Frank-Wolfe算法是一种可行方向法,在每次迭代中, 算法是一种可行方向法,在每次迭代中, 算法是一种可行方向法 搜索方向总是指向某个极点,并且当迭代点接近最优解时, 搜索方向总是指向某个极点,并且当迭代点接近最优解时, 搜索方向与目标函数的梯度趋于正交, 搜索方向与目标函数的梯度趋于正交,因此算法收敛速度 比较慢. 比较慢 但该方法把求解非线性最优化问题转化为为求解一 系列线性规划问题,而且各线性规划具有相同的约束条件, 系列线性规划问题,而且各线性规划具有相同的约束条件, 因而该方法在实际应用中仍然是一种有用的算法. 因而该方法在实际应用中仍然是一种有用的算法.

推广的Wolfe型线性搜索下的广义拟牛顿法及全局收敛性Matlab程序实现

function [x,val,k]=TG_Wolfe(fun,gfun,x0)%功能:用推广的Wolfe线性搜索算法步长求解无约束问题:minf(x) %输入:x0是初始点,fun,gfun分别是目标函数及其梯度%输出:x,val分别是近似最优点和最优值,k是迭代次数maxk=1e3;%给出最大迭代次数lamida=0.45;sigma1=0.6;sigma2=0.8;phi=0.45;theta=0;%固定参数k=0;n=length(x0);epsilon=1e-5;Bk=eye(n);while(k<maxk)gk=feval(gfun,x0);%计算梯度if norm(gk)<epsilonbreak;end;dk=-Bk\gk;alpha=1;a=0;b=inf;while(1) %推广的Wolfe准则搜索求步长fk=feval(fun,x0);fk1=feval(fun,x0+alpha*dk);gk1=feval(gfun,x0+alpha*dk);if ~(fk1-fk<=lamida*alpha*gk'*dk)b=alpha;alpha=(alpha+a)/2;continue;endif ~(gk1'*dk>=sigma1*gk'*dk&&gk1'*dk<=-sigma2*gk'*dk) a=alpha;alpha=min([2*alpha,(b+alpha)/2]);continue;endbreak;endx=x0+alpha*dk;sk=x-x0;yk=feval(gfun,x)-gk;Rk=fk1-fk-gk'*sk;Qk=theta*sk'*yk+2*(1-theta)*Rk;Zk=sk/(sk'*sk)-Bk*sk/(sk'*Bk*sk);Bk=Bk-(Bk*sk*sk'*Bk)/(sk'*Bk*sk)+(Qk*sk*sk')/(sk'*sk)^2+...+phi*(sk'*Bk*sk)*Zk*Zk';x0=xk=k+1val=feval('fun',x0)end然后,根据相应的实例,建立目标函数文件fun.m和梯度文件gfun.m.。

离散灰狼优化算法-概述说明以及解释

离散灰狼优化算法-概述说明以及解释1.引言1.1 概述概述部分的内容:离散灰狼优化算法(Discrete Grey Wolf Optimization, DGWO) 是近年来新兴的一种智能优化算法,它是基于灰狼群体行为的智能搜索算法。

该算法通过模拟灰狼群体的求生行为,从而寻找最优解。

与传统的优化算法相比,离散灰狼优化算法具有较强的全局搜索能力和快速收敛速度,并且适用于求解离散型问题。

灰狼是一种社会性动物,具有高度的合作意识和自组织能力。

离散灰狼优化算法借鉴了灰狼群体中个体之间的合作和竞争方式,并通过启发式的搜索策略,在解空间中寻找最优解。

该算法的基本思想是通过模拟灰狼群体的寻食行为,将问题转化为一个个体和群体之间的协同寻优过程。

离散灰狼优化算法的应用领域非常广泛,包括工程优化、机器学习、数据挖掘等领域。

在工程优化中,它可以用于参数优化、布局优化、路径规划等问题。

在机器学习和数据挖掘中,它可以用于特征选择、聚类分析、神经网络优化等任务。

由于离散灰狼优化算法具有较强的全局搜索能力和快速收敛速度,因此在实际问题中得到了广泛的应用和研究。

然而,离散灰狼优化算法也存在一些局限性。

首先,该算法在处理大规模问题时可能面临搜索空间过大的挑战,导致计算复杂度增加。

其次,算法的参数设置对算法性能具有较大影响,需要进行针对性调整。

此外,离散灰狼优化算法的局部搜索能力相对较弱,可能会陷入局部最优解。

综上所述,离散灰狼优化算法作为一种智能优化算法,具有较强的全局搜索能力和快速收敛速度,适用于离散型问题的求解。

它在工程优化、机器学习、数据挖掘等领域具有广泛的应用前景。

然而,为了进一步提高算法的性能,还需要进行参数调优和改进算法的局部搜索能力。

未来的研究可以尝试结合其他优化算法,进一步提高离散灰狼优化算法的性能,并探索其在更广泛领域的应用。

1.2文章结构1.2 文章结构本文将按照以下结构进行介绍离散灰狼优化算法:1. 引言:首先介绍离散灰狼优化算法的背景和意义,以及文章的目的和重要性。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

第 2 卷 第 1期 8 20 年 2 08 月

桂 林 电 子 科 技 大 学 学 报

J u n lo ii iest fElc r n cTe h lg o r a fGu l Un v riy o e to i c noo y n

Wa r v d wih a e a tl e s a c fW o f .Nu rc l x e i n sd mo s r t d t e e f c i e e s o h e S p o e t n i x c i e r h o le n n me ia p rme t e n t a e h fe tv n s ft e n w e l es a c . i e r h n

Vo . 8, . 1 2 No 1 Fe . 0 8 b 20

一

种新 的 Wof 线搜 索技术 及全 局收敛性 l e

房 明 磊 ,张 聪 ,陈 风 华

(. 1 桂林 电子科技 大学 数 学与计 算科学学院 , 广西 桂 林

2 安 徽 理 工 大 学 理 学院 , 徽 淮 南 . 安 220) 3 0 1

() 2

k= 1

+ ad k

一

F ec e— e vs方 法 具 有 全 局 收 敛 性 , 是 P w l lth rR e e 但 o el

d ig 一 ≥ , k — 愚 2 — +

其 中 g=Vf x) d 为下 降方 向 >O为步 长 由某 ( , 种 线搜 索 确定 , 是 一 个 参数 , 轭 梯度 法 的 关键 就 共

是 和 的选取 。 常用的 公 式有 如下 几 种 :

、

在文献 E- z 中指 出, I 即使用精确线搜索 P l — ii r o kRb e a  ̄

方 法 也不 会有 全局 收敛 性 , 此方 法 在数 值 计算 中有 但 很好 的表 现 , 由此 就考虑 能 否把 方法 的 良好 数值 表现

Ke r s ie a tl e s ac W of y wo d : x c i e rh; n n le;c nu a eg a in t o o j g t r de tme h d;go a o v r e c lb l n eg n e c

1 问题 的提 出

考虑无 约 束优 化 问题 : n ( )z∈ R , ( ) mif x , 1 其 中厂: 一 R连 续可 微 的 函数 。求 解 问题 () 1的共 轭 梯度 法 的迭代 公式 为

2 o lg f in e .C l eo e c ,An u ie st f in e a d Te h o o y e c S hi Unv ri o e c n c n l g ,Hu ia 3 0 1 y c S an n 2 2 0 ,Chn ) i a

Ab ta tC nu ae r de t to meh df r ovn o l e r p i z t np o lms e p c l r es a sr c : o jg t g a in h di a t o l ign n i a t ai r b e , s e i l l g —c l me s o s n o mi o aya e p o lms n t i p p ran w c n u aeg a i tmeh df ra n w r b e .I hs a e e o jg t r d n t o e e o wa rp sd a d t e go a o v r e c sp o o e n h l b lc n e g n e

510; 4 0 4

摘

要: 共轭梯 度法是求解无约束优化 问题 的一种 重要的方法 , 尤其适用于大规模优化问题 的求解 。通过应用计算

的新公 式求得一种 新的共轭梯 度法 , 非精 确线性搜 索的 Wof 则下证 明新 的共轭梯度 法的全 局收敛性 , 在 l e准 并

且数值 实验表 明了这 种线搜索下算法 的有效性 。

+ 一

f

。一 二 l I

dk 1 _。 一 1

一 l 【 l l !

dk v 一1 一1

其中Y = 一 _ห้องสมุดไป่ตู้l I 。 l・I 为欧拉范数 。

一

些文 献和 相关 论 文对 的构 造 及算 法 的收 敛

性 做 了 大 量 的 研 究 。在 文 献 [ ]中 A1 al证 明 1 一 ai B

FAN G i g—e .ZH AN G Co g .CH EN n — u M n li n Fe g h a

( .S h o fM a h m aisa d C mp t t n lS in e Gu l i e s yo lc r ncTe h oo y, ul 4 0 4, ia 1 c e l t e t n o u ai a ce c , i n Unv r i fE e to i c n l g G i n 5 1 0 Ch a ; o c o i t i

关键词 : 非精确线性搜索 ; l ; Wof 共轭梯度法 ; e 全局收敛性 中图分 类号 : 2 02 4 文献标识码 : A 文章编号 :1 7 .0X( 0 8 0—0 30 6 38 8 2 0 ) 10 6 —4

A e ln e r h t c n w i e s a c e hni u f W o f n he g o a o e g n e q e o l e a d t l b lc nv r e c