感知机学习算法模拟与改进

机器学习算法与模型的优化与改进

机器学习算法与模型的优化与改进机器学习(Machine Learning)是人工智能领域中重要的分支之一,主要是通过计算机程序从数据中学习规律,提高模型预测能力。

机器学习广泛应用于数据挖掘、推荐系统、自然语言处理、计算机视觉等领域。

在机器学习中,算法和模型的优化与改进是非常重要的课题。

一、机器学习算法的优化机器学习算法的优化可以从两个方面入手:提高算法准确性和提高算法效率。

1、提高算法准确性提高算法准确性是机器学习的核心目标之一,因为精度是衡量机器学习算法好坏的重要指标之一。

一个常用的方法就是增加训练数据,从而提高算法准确性。

数据的多样性和数量都能够影响算法的准确性。

此外,优化数据预处理和特征工程,也能够提高算法的准确率。

2、提高算法效率提高算法效率也是机器学习算法的重要目标之一。

效率的提高可以从算法的复杂度、计算的数量和运行时间入手。

通常可以通过构建更加简单高效的模型、算法选取、降维等方法来提高算法的效率。

二、机器学习模型的优化机器学习模型的优化是机器学习团队研究的一个主要课题,优化的目标是提高模型的泛化能力和预测准确率。

1、提高模型泛化能力提高模型泛化能力是机器学习模型优化的重要方向之一。

模型的泛化能力是指模型在处理未知数据时的表现能力,在测试集和生产环境中的表现就是衡量它的泛化能力的重要指标之一。

提高模型泛化能力有以下几方面的方法:(1)数据增强:通过对现有的训练数据进行数据增强的操作,比如旋转、翻转、缩放等,从而扩大数据集,提高泛化能力。

(2)正则化:增强模型的泛化能力,可采用L1正则化,L2正则化等等。

(3)交叉验证:通过划分训练集和测试集,并交叉验证,提高泛化能力。

2、提高模型预测准确率提高模型预测准确率是机器学习模型优化的另一个重要目标。

针对不同的机器学习算法,有不同的优化方法。

(1)神经网络优化:优化神经网络的模型结构,比如增加层数、增加节点等。

这些操作可以增加模型的表达能力,提高预测准确率。

神经网络的发展历程与应用

神经网络的发展历程与应用神经网络是一种仿生的人工智能技术,它模拟了人类大脑中神经元之间的连接和信息传递方式,具有自学习和适应性强的特点。

神经网络的发展历程可以追溯到上世纪50年代,经过了长期的理论研究和应用实践,如今已经成为了人工智能领域中的重要技术之一。

本文将从神经网络的发展历程、基本模型、优化算法以及应用领域等方面进行介绍。

一、神经网络的发展历程神经网络的发展历程可以分为三个阶段,分别是感知机、多层前馈神经网络和深度学习。

1. 感知机感知机是神经网络的起源,由美国心理学家罗森布拉特于1957年提出。

感知机是一种单层神经网络,由若干感知器(Perceptron)组成。

每个感知器接收输入信号并进行加权和,然后经过一个阈值函数得到输出。

该模型的最大缺点是只能处理线性可分问题,无法解决非线性问题。

2. 多层前馈神经网络为了克服感知机的局限性,科学家们开始尝试使用多层前馈神经网络来处理非线性问题。

多层前馈神经网络由输入层、隐藏层和输出层组成。

每个神经元都有一个激活函数,用于将输入信号转换为输出。

这种结构可以处理非线性问题,并且可以通过反向传播算法来训练网络参数。

多层前馈神经网络在图像识别、语音识别、自然语言处理等领域得到了广泛应用。

3. 深度学习深度学习是指使用多层神经网络来学习高层次特征表示的一种机器学习方法。

深度学习在计算机视觉、自然语言处理等领域有着广泛的应用。

其中最著名的就是卷积神经网络(CNN)和循环神经网络(RNN)。

卷积神经网络主要用于图像识别和分类问题,循环神经网络主要用于序列预测和语言建模。

二、神经网络的基本模型神经网络的基本模型可以分为三类,分别是前馈神经网络、反馈神经网络和自组织神经网络。

1. 前馈神经网络前馈神经网络是指信息只能从输入层到输出层流动的神经网络。

其中最常用的是多层前馈神经网络,它由多个隐藏层和一个输出层组成。

前馈神经网络的训练主要使用反向传播算法。

2. 反馈神经网络反馈神经网络是指信息可以从输出层到输入层循环反馈的神经网络。

机器学习--感知机算法原理、方法及代码实现

机器学习--感知机算法原理、⽅法及代码实现1.感知器算法原理两类线性可分的模式类:,设判别函数为:。

对样本进⾏规范化处理,即类样本全部乘以(-1),则有:感知器算法通过对已知类别的训练样本集的学习,寻找⼀个满⾜上式的权向量。

2.算法步骤(1)选择N个分属于和类的模式样本构成训练样本集{ X1, …, X N }构成增⼴向量形式,并进⾏规范化处理。

任取权向量初始值W(1),开始迭代。

迭代次数k=1。

(2)⽤全部训练样本进⾏⼀轮迭代,计算W T(k)X i的值,并修正权向量。

分两种情况,更新权向量的值: 若,分类器对第i 个模式做了错误分类,权向量校正为:,c为整的校正增量。

若,分类正确,权向量不变,。

统⼀写成:(3)分析分类结果:只要有⼀个错误分类,回到(2),直⾄对所有样本正确分类。

感知器算法是⼀种赏罚过程: 分类正确时,对权向量“赏”——这⾥⽤“不罚”,即权向量不变; 分类错误时,对权向量“罚”——对其修改,向正确的⽅向转换。

3.代码⽰例#感知机算法import numpy as npimport matplotlib.pyplot as pltX0 = np.array([[1,0],[0,1],[2,0],[2,2]])X1 = np.array([[-1,-1],[-1,0],[-2,-1],[0,-2]])#将样本数据化为增⼴向量矩阵ones = -np.ones((X0.shape[0],1))X0 = np.hstack((ones,X0))ones = -np.ones((X1.shape[0],1))X1 = np.hstack((ones,X1))#对样本进⾏规范化处理X = np.vstack((-X0,X1))plt.grid()plt.scatter(X0[:,1],X0[:,2],c = 'r',marker='o',s=500)plt.scatter(X1[:,1],X1[:,2],c = 'g',marker='*',s=500)W = np.ones((X.shape[1],1))flag = Truewhile(flag):flag = Falsefor i in range(len(X)):x = X[i,:].reshape(-1,1)if np.dot(W.T,x)<=0:W = W + xflag = Truep1=[-2.0,2.0]p2=[(W[0]+2*W[1])/W[2],(W[0]-2*W[1])/W[2]] plt.plot(p1,p2)plt.show()输出结果:。

【统计学习】随机梯度下降法求解感知机模型

【统计学习】随机梯度下降法求解感知机模型1. 感知机学习模型感知机是⼀个⼆分类的线性分类问题,求解是使误分类点到超平⾯距离总和的损失函数最⼩化问题。

采⽤的是随机梯度下降法,⾸先任意选取⼀个超平⾯w0和b0,然后⽤梯度下降法不断地极⼩化⽬标损失函数,极⼩化过程中不是⼀次使所有误分类点的梯度下降,⽽是⼀次随机选取⼀个误分类点使其梯度下降。

假设误分类点集合M是固定的,那么损失函数L(w,b)的梯度:随机选取⼀个误分类点,对w和b进⾏更新:其中n是步长,⼜称为学习率(learning rate),这样通过迭代可以使损失函数L(w,b)不断减⼩,直到训练集中没有误分类点。

直观的解释:当⼀个实例点被误分类,即位于超平⾯的错误⼀侧时,则调整w和b的值,使分离超平⾯向该误分类点的⼀侧移动,以减少该误分类点与超平⾯间的距离,直⾄超平⾯越过该分类点使其正确分类[1]。

注意:当训练数据集线性可分时,这个迭代是收敛的,也就是经过有限次数的迭代是可以找到最优的超平⾯的[1]。

下⾯就详细讲解这个迭代的过程。

2.感知机算法的原始形式输⼊:训练数据集 T={(x1,y1),(x2,y2),...,(x n,y n)},其中x1∈R n,y i={+1,-1},i=1, 2, ..., n,学习率η(0 < η<= 1)输出:w, b;感知机模型 f(x) = sign(w·x + b)过程:1,选取初值w, b2,在训练集中取数据(x i,y i)3,若 y i(w·x i+ b) <= 0 即分类不正确,则:w= w + ηy i x ib= b + ηy i注:因为此时分类不对,所以y i= -14,转⾄步骤2,直到训练数据集中⽆误分类点3.感知机算法的对偶形式在原始形式中有公式:w= w + ηy i x ib= b + ηy i那么假设⼀共修改了n次,则w,b关于(x i(1),x i(2))的增量分别为:a i y i x i和 a i y i (a i= n iη)即:若η=1,则a i就是第i个点由于误分类⽽进⾏更新的次数,即a i = n i。

动手实现感知机算法,多分类问题

动⼿实现感知机算法,多分类问题问题描述:具有9个特征值的数据三分类问题,每个特征值的取值集合为{-1,0,1}。

数据如下格式:设计感知机: 如何⾃⼰实现感知机的多分类,⽹上不调⽤库的资料⾮常少。

之前有上算法课的时候,⽼师讲过多分类的神经⽹络,相⽐较于回归问题,多分类的损失函数设计时使⽤的是交叉熵。

那么咱们按照这个思路从头推导下如何⼀步步迭代出权重值使得它们拟合出较好的效果来。

第⼀步:隐藏层设计,h = W*x + b(其中W为3*9矩阵,x为9维向量,b为3维向量) 第⼆步:激活函数设计,a = softmax(h)(其中h为3维向量) 第三步:损失函数设计,Loss = y1lna1+y2lna2+y3lna3(其中a1,a2,a3,y1,y2,y3为单个数值)权重值迭代: 如何迭代权重值,以拟合我们的分类器。

这⾥我们使⽤梯度下降算法,即W = W - lr*dLoss/dW,b = b - lr*dLoss/db,lr是超参,那么我们要求的就只有对W和b偏导。

代码实现:import pandas as pdimport numpy as np#数据集⽂件路径file = 'Dataset.xlsx'#获取训练集(原始训练集百分之⼋⼗)、验证集(原始训练集百分之⼆⼗)、测试集def getData(filepath):df_train = pd.read_excel(filepath, sheet_name='training')df_test = pd.read_excel(filepath, sheet_name='test')length = len(df_train.values)x_train = df_train.values[:int(0.8 * length), :-1]y_train = df_train.values[:int(0.8 * length), -1]x_val = df_train.values[int(0.8 * length):, :-1]y_val = df_train.values[int(0.8 * length):, -1]x_test = df_test.values[:, :-1]return x_train, y_train, x_val, y_val, x_testdef main():#学习率lr = 0.000001# 类别⼀维转三维classMap = {'-1': [1, 0, 0],'0': [0, 1, 0],'1': [0, 0, 1]}#类别映射class_map = [-1, 0, 1]x_train, y_train, x_val, y_val, x_test = getData(file)#随机初始化W、bW = np.random.randn(3, 9)b = np.random.randn(3)#训练6000次for i in range(6000):loss = 0#初始化偏导alpha1 = [0] * 9alpha2 = [0] * 9alpha3 = [0] * 9beta1 = 0beta2 = 0beta3 = 0for xi, yi in zip(x_train, y_train):ai = np.sum(np.multiply([xi] * 3, W), axis=1) + by_predicti = np.exp(ai) / sum(np.exp(ai))y_i = classMap[str(yi)]lossi = -sum(np.multiply(y_i, np.log(y_predicti)))loss += lossi# 每个训练数据偏导累加alpha1 += np.multiply(sum(np.multiply([0, 1, 1], y_i)), xi)alpha2 += np.multiply(sum(np.multiply([1, 0, 1], y_i)), xi)alpha3 += np.multiply(sum(np.multiply([1, 1, 0], y_i)), xi)beta1 += sum(np.multiply([0, 1, 1], y_i))beta2 += sum(np.multiply([1, 0, 1], y_i))beta3 += sum(np.multiply([1, 1, 0], y_i))#W、b更新值W[0] -= alpha1 * lrW[1] -= alpha2 * lrW[2] -= alpha3 * lrb[0] -= beta1 * lrb[1] -= beta2 * lrb[2] -= beta3 * lrloss = loss/len(x_train)recall = 0#验证for xi, yi in zip(x_val, y_val):ai = np.sum(np.multiply([xi] * 3, W), axis=1) + by_predicti = np.exp(ai) / sum(np.exp(ai))y_predicti = [class_map[idx] for idx, i in enumerate(y_predicti) if i == max(y_predicti)][0] recall += 1 if int(y_predicti) == yi else 0print('验证集总条数:', len(x_val), '预测正确数:', recall)fp = open('perception.csv', 'w')#测试for xi in x_test:ai = np.sum(np.multiply([xi] * 3, W), axis=1) + by_predicti = np.exp(ai) / sum(np.exp(ai))y_predicti = [class_map[idx] for idx, i in enumerate(y_predicti) if i == max(y_predicti)][0] fp.write(str(y_predicti)+'\n')fp.close()if __name__ == '__main__': print('⽅法三:感知机') main()。

《人工神经网络:模型、算法及应用》习题参考答案

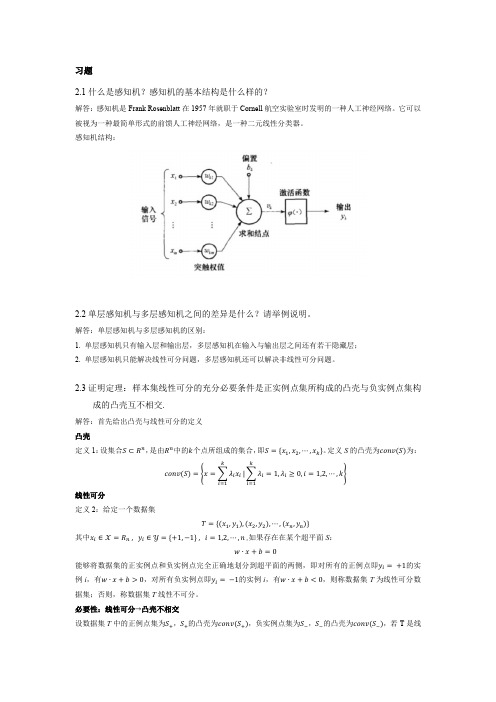

习题2.1什么是感知机?感知机的基本结构是什么样的?解答:感知机是Frank Rosenblatt在1957年就职于Cornell航空实验室时发明的一种人工神经网络。

它可以被视为一种最简单形式的前馈人工神经网络,是一种二元线性分类器。

感知机结构:2.2单层感知机与多层感知机之间的差异是什么?请举例说明。

解答:单层感知机与多层感知机的区别:1. 单层感知机只有输入层和输出层,多层感知机在输入与输出层之间还有若干隐藏层;2. 单层感知机只能解决线性可分问题,多层感知机还可以解决非线性可分问题。

2.3证明定理:样本集线性可分的充分必要条件是正实例点集所构成的凸壳与负实例点集构成的凸壳互不相交.解答:首先给出凸壳与线性可分的定义凸壳定义1:设集合S⊂R n,是由R n中的k个点所组成的集合,即S={x1,x2,⋯,x k}。

定义S的凸壳为conv(S)为:conv(S)={x=∑λi x iki=1|∑λi=1,λi≥0,i=1,2,⋯,k ki=1}线性可分定义2:给定一个数据集T={(x1,y1),(x2,y2),⋯,(x n,y n)}其中x i∈X=R n , y i∈Y={+1,−1} , i=1,2,⋯,n ,如果存在在某个超平面S:w∙x+b=0能够将数据集的正实例点和负实例点完全正确地划分到超平面的两侧,即对所有的正例点即y i=+1的实例i,有w∙x+b>0,对所有负实例点即y i=−1的实例i,有w∙x+b<0,则称数据集T为线性可分数据集;否则,称数据集T线性不可分。

必要性:线性可分→凸壳不相交设数据集T中的正例点集为S+,S+的凸壳为conv(S+),负实例点集为S−,S−的凸壳为conv(S−),若T是线性可分的,则存在一个超平面:w ∙x +b =0能够将S +和S −完全分离。

假设对于所有的正例点x i ,有:w ∙x i +b =εi易知εi >0,i =1,2,⋯,|S +|。

感知机的原理

感知机的原理

感知机是一种二分类模型,输入是实例的特征向量,输出是实例的类别,可以理解为一个将输入空间划分为正负两类的超平面。

感知机的学习算法是基于误分类驱动的,其原理如下:

1. 定义模型:感知机模型的定义是f(x) = sign(w•x + b),其中

w是权重向量,x是输入特征向量,b是偏置。

2. 初始化参数:将权重向量w和偏置b初始化为0或者随机值。

3. 对训练样本进行分类:对于每一个训练样本(x_i, y_i),其中

x_i是特征向量,y_i是真实的类别标签。

计算该样本的预测值y_i_hat = sign(w•x_i + b)。

4. 更新参数:如果预测结果与真实标签不一致,则更新参数w 和b,更新方式为w = w + η * y_i * x_i 和b = b + η * y_i,其

中η为学习率。

通过不断迭代样本,直到所有样本都被正确分类为止。

5. 重复步骤3和步骤4,直到所有样本都被正确分类或达到了

迭代次数的上限。

感知机的原理基于线性模型,试图通过一个超平面将数据分成两类,但是只能处理线性可分的问题。

对于线性不可分的问题,

感知机无法收敛。

感知机也可以通过核函数将其扩展为非线性问题的分类器,但是训练过程相对较慢。

了解计算机人工智能的基本算法与模型

了解计算机人工智能的基本算法与模型计算机人工智能的基本算法与模型人工智能(Artificial Intelligence,简称AI)作为计算机科学的重要分支,致力于模拟、延伸和扩展人类智能的能力,以实现机器自主学习和推理的目标。

在实现人工智能的过程中,算法和模型是不可或缺的组成部分。

本文将为您介绍计算机人工智能的基本算法与模型的概念和应用。

一、基本算法1. 搜索算法(Search Algorithms)搜索算法是人工智能中最常见的算法之一,用于在一定的搜索空间中寻找特定目标。

其中,广度优先搜索算法(Breadth-First Search,简称BFS)按照层级逐层扩展搜索,而深度优先搜索算法(Depth-First Search,简称DFS)则逐级纵向深入搜索。

这些搜索算法在路径规划、推荐系统和图像识别等领域有广泛的应用。

2. 遗传算法(Genetic Algorithms)遗传算法是一种模拟进化过程的优化算法,通过模拟“自然选择”和“遗传”过程,逐步改进现有解决方案。

遗传算法常在寻找最优解问题中使用,并在机器学习、组合优化和人员调度等领域得到应用。

3. 机器学习算法(Machine Learning Algorithms)机器学习算法是指通过数据和模式识别来使机器在特定任务上获得知识和经验的算法。

常见的机器学习算法包括决策树算法(Decision Tree)、支持向量机算法(Support Vector Machines)、神经网络算法(Neural Networks)和朴素贝叶斯算法(Naive Bayes)。

这些算法在数据挖掘、自然语言处理和图像识别等领域具有广泛的应用。

4. 神经网络算法(Neural Network Algorithms)神经网络是一种模拟人脑神经元联结的计算模型,通过训练提取特征,识别模式和解决问题。

著名的神经网络算法包括多层感知机(Multilayer Perceptron)和卷积神经网络(Convolutional Neural Network)。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

2009年第10期算法语言信息与电脑

China Computer&Communication

一、感知机学习规则

感知机采用有导师的学习规则,由一组描述网络行为的实例集合

(训练集)给出:

其中,P为网络的输入,t为相应的正确输出。

当输入作用到网络

时,网络的实际输出与目标相比较,然后学习规则调整网络的权值和

偏置值,从而使网络的实际输出越来越接近于目标输出。

感知机的结构:

图1. 感知机网络

该网络的输出为:a = hardlim ( W p + b )

利用该公式可以方便的引用感知机网络中的单个元素。

为此,首

先考虑如下权值矩阵:

将构成W的第i个行向量定义为:

据此,可以将权值矩阵W重写为:

这样就可以将网络输出向量的第i个元素写成:

再根据hardlim传输函数的定义,如果权值矩阵的第i个行向量与

输入向量的内积大于等于 -bi ,该输出为1,否则输出为0。

二、感知机的判定边界

考察有两个输入的单神经元感知机:

图2 两输入/单输出神经元感知机

输出为:

将P

1

、P

2

看作二维空间的两个变量[3],则上式在输入空间定义了

一条直线。

该直线一侧的输入向量相应的网络输出为0;而直线上和

另一侧的输入向量相应的网络输出侧为1。

图3 双输入感知机的判定边界

图3描绘了权值为1,偏置值为-1的判定边界。

权值1W将总是指

向神经元输出为1的区域。

三、多输入神经元感知机

学习算法模拟

1.学习算法流程图

感知机学习算法模拟与改进

李红霞 南京航空航天大学金城学院,江苏 南京 211156

摘要:20世纪50年代末,Frank Rosenblatt等人提出了一种称为感知机的神经元网络。

引入了用于训练神经网络解决模式识别问题的学习规则。

证明了只要求解问题的权值存在,那么其学习规则通常会收敛到正确的网络权值上。

整个学习过程较为简单,而且是自动的。

只要把反映网络行为的实例提交给网络,网络就能够根据实例从随机初始化的权值和偏置值开始自动的进行学习。

关键词:神经元;感知机;算法模拟

中图分类号:TP183 文献标识码:A 文章编号:1003-9767(2009)10-0098-02

Simulation and Improvement of perceptron Learning Algorithms

Li Hongxia , Nanjing Aero-Space University Jincheng college,211156

Abstract:In the late 20th century,50, Frank Rosenblatt, who proposed a machine called the perception neural network. The introduction of pattern recognition used to train neural networks to solve the problem of learning rules.They Proved that as long as the right of the value of solving the problem exists, then the learning rule will usually converge to the correct value of the network weights. The whole learning process was rather simple and automatic. As long as refl ecting an instance of network behavior presented to the network, the network began to automatic learning according to the instance from the random weights and bias values.

Keyword:Neuron;Perceptron;Algorithm simulation

图4 多输入神经元感知机学习算法流程图

2009年第10期

算法语言

信息与电脑

China Computer&Communication

2.UML模型

本文用VC++6.0实现了以上算法,各个类UML模型如下:

WPub:

名称:公共函数类

功能:封装基本公用函数

WNNFunction:

名称:传输函数类

功能:封装了常用的传输函数

WMatrix:

名称:矩阵类

功能:封装了矩阵的常用操作方法

WNNLearning:

名称:感知机学习类

功能:封装了感知机学习算法

3.程序运行界面

输入:

1.神经元个数

2.训练集大小

3.输入维数

4.最大探测次数 —— 若达到该值限定的循环次数算法仍未收敛

则强行退出

5.传输函数类型 —— 此处仅置用到硬极限函数

6.[W-b]初始值 —— 以矩阵形式输入,每行为一个神经元的权

值加偏置向量。

其中:每行的最后一个元素是b,其余是W

7.训练集 ——以矩阵形式输入,每列是一个输入向量加目标输

出。

其中,每列的最后一个元素是t,其余是P

输出:

1.[W-b]最终值 —— 形式同[W-b]初始值

运行:

1.输入各个参数

2.对输入参数作简单校验:

1)神经元个数是否与输入的W矩阵行数相等

2)训练集大小是否与输入的P矩阵列数相等

3)输入维数是否正确

3.点击“P”按钮,运行程序,显示结果如下

四、总结:

感知机网络结构简单,学习算法易于实现,但也有其局限性。

1.W,b的初始值对于运算过程和运算时间有影响,为了在有限

步内求得收敛解,可以多次选择不同的初始值来求解,从中找到最优

的初始值。

初始值选取的不好,可能会导致算法长时间不能收敛,可

以设定最大循环次数,若算法在此循环次数内不收敛则需要调整初始

值。

2.感知机的判定边界是一个线性边界(超平面),因而感知机

可以对那些能够被线性边界分开的输入向量进行分类。

然而,许多问

题并非是线性可分的,如异或。

使感知机的应用受到很大限制。

参考文献:

[1]. Martin T. Hagan,Howard B. Demuth,Mark H. Beale.神经网络设计

[M].机械工业出版社 2002.9.

[2]. Rodney G. Winter. Madaline Rule II: A new method for training

networks of Adalines. Stanford University,1989.

[3]. 许东,吴铮.基于MATLAB6.X的系统分析与设计——神经网络

(第二版)[M].西安电子科技大学出版社,2002.。