单目视觉定位中SURF算法参数的优化

机器视觉中基于SURF算法的目标识别研究

机器视觉中基于SURF算法的目标识别研究第一章:引言随着计算机技术的不断发展,机器视觉技术逐渐应用于各种领域。

其中,目标识别是机器视觉技术的重要应用之一,可以在自动控制、工业制造、军事等领域中发挥重要作用。

在目标识别中,特征点检测和匹配是关键技术。

SURF算法是一种快速有效的特征点检测和匹配算法,已经得到广泛应用。

本文将介绍机器视觉中基于SURF算法的目标识别研究,具体包括SURF算法原理、SURF算法在目标识别中的应用及其优劣势分析、SURF算法在实际系统中的应用及其发展趋势等。

第二章:SURF算法原理SURF算法是加速稳健特征(Speeded Up Robust Feature)的缩写。

它是基于尺度空间理论的特征点检测和匹配算法。

SURF算法主要包括三个步骤:尺度空间构建、特征点检测和特征描述。

尺度空间构建是指先将原始图像进行高斯滤波,得到不同尺度下的图像金字塔,然后通过差分的方式得到尺度不变的DoG (Difference of Gaussian)图像组。

特征点检测是指在DoG图像组中检测出极值点,SURF算法中采用的是Hessian矩阵。

特征描述是指在检测到的特征点周围的邻域内,计算一组具有较强区分度的局部特征描述子,SURF算法中采用的是基于积分图像的Haar小波特征描述子。

第三章:SURF算法在目标识别中的应用及其优劣势分析SURF算法在目标识别中的应用主要包括两个方面:特征点检测和匹配。

特征点检测是指在图像中寻找具有独特性、稳定性和可重复性的特征点,SURF算法对尺度空间建立和特征点检测都有良好的性能,能够有效地检测到目标物体中的关键点。

匹配是指在两个图像中寻找相似的特征点,SURF算法具有较高的匹配准确率和速度,能够实现快速准确地目标匹配。

但是,SURF算法也存在一些不足之处,比如对图像旋转、缩放、变形等变化不够鲁棒,需要额外的操作来进行补偿。

第四章:SURF算法在实际系统中的应用及其发展趋势SURF算法在实际系统中的应用非常广泛,例如在工业机器人、自动驾驶、安防监控等领域中都得到了应用。

改进SURF算法的特征提取与匹配方法研究

改进SURF算法的特征提取与匹配方法研究

赵腾飞;辛大欣;华瑾

【期刊名称】《机械与电子》

【年(卷),期】2017(035)009

【摘要】针对门把手图像特征点提取与匹配对快速性和准确性的要求,提出一种改进SURF算法.该算法主要对图像较平滑区域难以提取出大量信息点的问题进行改进.增加了边缘检测算法,得到图像边缘信息后进行形态学处理,并通过膨胀运算和开运算后获得门把手图像边缘区域信息并提取出关键点,进而获得较多特征明显的信息.改进SURF算法和原始SURF算法相比,在平滑区域能够较好提取出特征点,匹配准确率也有明显的提升,并且增强了算法的实时性.

【总页数】4页(P77-80)

【作者】赵腾飞;辛大欣;华瑾

【作者单位】西安工业大学电子信息工程学院,陕西西安710021;西安工业大学电子信息工程学院,陕西西安710021;西安工业大学电子信息工程学院,陕西西安710021

【正文语种】中文

【中图分类】TP39

【相关文献】

1.基于改进SURF算法的工件图像特征匹配 [J], 张强;韩松奇;于微波

2.基于SURF算法的无坐标矿山空间位置匹配方法研究 [J], 杨雪

3.基于SURF算法的绿色作物特征提取与图像匹配方法 [J], 张志斌;赵帅领;罗锡文;魏凤岐

4.改进的SURF算法在图像匹配中的应用 [J], 黄春凤; 刘守山; 别治峰; 许广会

5.基于ROI提取和改进SURF算法的图像匹配方法研究 [J], 田杰;徐忠民

因版权原因,仅展示原文概要,查看原文内容请购买。

SURF算法在小尺寸图像拼接中参数配置的优化

SURF算法在小尺寸图像拼接中参数配置的优化周宇浩崴;应忍冬;蒋乐天【摘要】在图像拼接领域,SURF算法因其出众的时效性和鲁棒性,有着十分广泛的应用。

针对SURF算法中特征点提取和描述过程中参数固定,对侧重点不同的图像拼接应用存在变通性较差的问题,提出了从窗口滤波器权值,特征点周围子区域的选择以及子区域内Haar小波变换的采样点范围三方面进行参数配置优化。

针对目前主流的流媒体尺寸图像,利用控制变量法在不同的SURF参数配置下,对算法的时效性、准确性和鲁棒性等性能进行了分析;通过特征点匹配率和特征点匹配效率的比较,给出了SURF算法参数的选择策略。

仿真结果表明该策略可以有效提高SURF算法在图像拼接中的运算速度和准确性,丰富算法在实时领域的应用。

%In the field of image stitching, SURF algorithm is widely used for its excellent real-time procedure and robust. Due to the fixed parameter settings in interest point detection and description, the adjustability of SURF algorithm to different applying situation is relatively weak. In order to improve the range of SURF application, this paper looks into three aspects in the algorithm:the weight of box filter, the sub-region selection and the Haar wavelet sampling point range within the sub-region. In comparing the real-time quality, the stitching accuracy and the robust quality of the algorithm, the experiments using variable control method propose a parameter setting strategy based on small scale image which is widely used in nowadays stream media. In analyzing the interest points match rate and efficiency, the strategies proposed in characterizing the algorithm can extend the use of SURF in real-time field.【期刊名称】《计算机工程与应用》【年(卷),期】2013(000)019【总页数】5页(P191-195)【关键词】加速鲁棒特征(SURF)算法;图像拼接;小尺寸图像;参数配置;特征点匹配;窗口滤波器;特征点子区域【作者】周宇浩崴;应忍冬;蒋乐天【作者单位】上海交通大学电子工程系,上海200240;上海交通大学电子工程系,上海 200240;上海交通大学电子工程系,上海 200240【正文语种】中文【中图分类】TP391图像拼接分为直接拼接和融合技术,在目前融合技术中主要分为基于灰度信息和基于特征信息两种模式。

改进SURF算法在图像汉字识别中的应用

改进SURF算法在图像汉字识别中的应用孟伟;钟娜【摘要】针对复杂背景下汉字匹配准确率较低的问题,提出一种改进的SURF算法。

该算法利用灰度分级的字符分割方法,先进行灰度分割增强图像的对比度,采用灰度分级树将图像中的所有像素处理为树的模式进行计算,根据灰度分级确定主节点,根据主节点的级别所对应的灰度值对图像进行分割。

同时,根据汉字结构的特殊性,取消了SURF算法的旋转不变性。

实验结果表明,与未使用改进的SURF 算法相比,对图像质量较差的文本图像,改进的SURF算法能有效地提高其匹配的准确率。

%Aiming at the low matching accuracy of Chinese characters, an improved algorithm of SURF is presented. The algorithm is based on gradation character segmentation. Contrast of image is enhanced by using gray level segmentation, and then with the gray level classification tree, all pixels in the image are processed to the tree model. According to the gray level classification, the main node is determined. Grey level corresponding to the main node level is used in image segmentation. According to the particularity of Chinese characters, the rotation invariance of SURF algorithm is cancelled. Experimental results show that the improved algorithm can improve the matching accuracy effectively, especially for text image of poor quality.【期刊名称】《计算机工程与应用》【年(卷),期】2015(000)012【总页数】5页(P156-160)【关键词】复杂背景;汉字匹配;快速鲁棒特征(SURF)算法;灰度分级;字符分割【作者】孟伟;钟娜【作者单位】北京林业大学信息学院,北京 100083;北京首钢自动化信息技术有限公司,北京 100043【正文语种】中文【中图分类】TP3911 引言近年来,汉字识别一直是模式识别等相关领域内长期的研究热点[1]。

surf算法代码 -回复

surf算法代码-回复什么是Surf算法Surf算法(Speeded Up Robust Features)是一种用于图像特征检测和描述的计算机视觉算法。

它是在2006年由Herbert Bay等人提出的,旨在提高图像处理中的特征点检测与匹配的速度和准确性。

Surf算法在计算机视觉和图像处理领域中得到广泛应用,它的主要目标是在图像中找到稳定且唯一的局部特征点。

Surf算法的步骤1. 尺度空间构建:Surf算法在图像中使用多尺度空间来有效地检测特征点。

它通过不断模糊图像,并计算模糊后的图像与原始图像的差异来构建多尺度空间。

算法使用一个高斯滤波器来进行图像模糊,并通过逐渐增加滤波器的方差来构建不同尺度下的图像。

这样做的目的是使得算法能够在不同尺度下检测到特征点,而不受图像缩放的影响。

2. 关键点检测:在构建好尺度空间后,Surf算法会在每个尺度中检测关键点。

关键点是那些在图像中具有稳定尺度和位置,并且对缩放、旋转和光照变化具有不变性的点。

Surf算法使用Hessian矩阵来检测关键点。

Hessian矩阵是一个用于测量图像局部变化的矩阵,在Surf算法中,它被用来检测图像中的高强度点。

3. 关键点定位:在检测到关键点后,Surf算法会对关键点进行精确定位。

它使用一个Haar 小波响应来定位关键点的位置和方向。

Haar小波是一种多尺度基函数,它能够识别出图像中的边缘和纹理特征。

Surf算法利用Haar小波响应来定位出关键点的具体位置和方向,以便后续的特征描述步骤。

4. 特征描述:在完成关键点定位后,Surf算法会对每个关键点进行描述,以便后续的特征匹配。

Surf算法使用了一种叫做加速权重积分(Fast Hessian)的方法来生成特征描述子。

特征描述子是一个向量,它能够描述关键点周围区域的结构和纹理信息。

Surf算法会通过计算关键点周围区域的灰度变化来生成特征描述子。

5. 特征点匹配:在完成特征描述后,Surf算法会使用一种叫做KD树的数据结构来进行特征点的匹配。

SURF算法在图像处理中的应用

SURF算法在图像处理中的应用SURF算法是一种被广泛应用于计算机视觉领域的算法,其全称是Speeded Up Robust Features。

它是一种特征提取算法,可以在图像中检测出具有特殊性质的关键点,并生成具有鲁棒性的特征描述子。

这些特征可以用于识别相似的图像,比较相似度,并在图像配准、图像跟踪、三维重建等领域中发挥重要作用。

本文将探讨SURF算法在图像处理中的应用。

一、 SURF算法的原理SURF算法是基于SIFT算法的一种改进,它的主要优势在于速度更快、鲁棒性更强。

下面简单介绍SURF算法的原理。

1. 尺度空间构建SURF算法首先对原始图像进行尺度变换,通过高斯金字塔来构建尺度空间。

尺度空间的不同层次可以检测到不同大小的特征。

通过不同层次检测的关键点可以估计出原始图像中的关键点,这个过程被称为尺度空间极值点检测。

2. 关键点定位在尺度空间中,SURF算法通过Hessian矩阵的行列式求解得到图像局部极值点位置,这些点是具有高强度、对光照变化鲁棒等性质的关键点。

3. 方向确定为了使SURF算法对旋转和光照变化更加鲁棒,需要为每个关键点确定一个主方向,这个方向是在关键点周围采用Hessian矩阵主方向确定的。

4. 特征描述为了描述关键点的局部特征,SURF算法使用了一种统计学上的方法,即将关键点周围的区域分解成小的子区域,每个子区域在水平和竖直方向上计算Haar小波变换,形成特征向量。

这些特征向量组成的特征描述子具有鲁棒性,可以用来评估关键点的稳定性。

5. 特征匹配在进行图像匹配时,SURF算法使用了一种快速的近似最近邻搜索方法,称为快速最近邻搜索(FLANN)。

它可以在大规模的特征库中快速找到与查询特征最相似的特征。

二、 SURF算法可以被广泛应用于图像处理中,下面介绍一些应用领域。

1. 图像配准SURF算法可以被用来匹配两幅图像之间的关键点,通过计算两幅图像中关键点的相似度来实现图像配准。

基于SURF算法的单目转双目视觉定位

i ma g e f e a t u r e p o i n t e x t r a c t i o n a n d ma t c h i n g i n t h e p r o c e s s o f o b j e c t t a r g e t r e c o g n i t i o n a n d l o c a t i n g . T h e e x p e r i me n t a l

r e s ul t i n d i c a t e s ,t he me t ho d o f mo n o c u l a r t o r e a l i s e b i n o c ul a r v i s u a l po s i t i o n i n g b a s e d o n S UR F a l g o r i t h m,bo t h i n

其 系 统结 构 简 单,造 价 较低 ,具有 一 定 的现 实 意义 .

通过摄 像机 获取 的图像 相对于真实物 体往往有缩放 、

旋转 以及遮挡 的变化 , 这 就需要对 图像进行特 征 匹配

目立 体视觉 作为机器 视觉 的一 种,是近年来 研究 的热 点方 向之 ~.该视 觉系统 模拟 人眼,利 用成像 设备 获

关键词 :提取;匹配

Mo no c u l a r t o Re a l i z e Bi no c u l a r Vi s u a l Po s i t i o n i n g Ba s e d o n SURF Al g o r i t h m

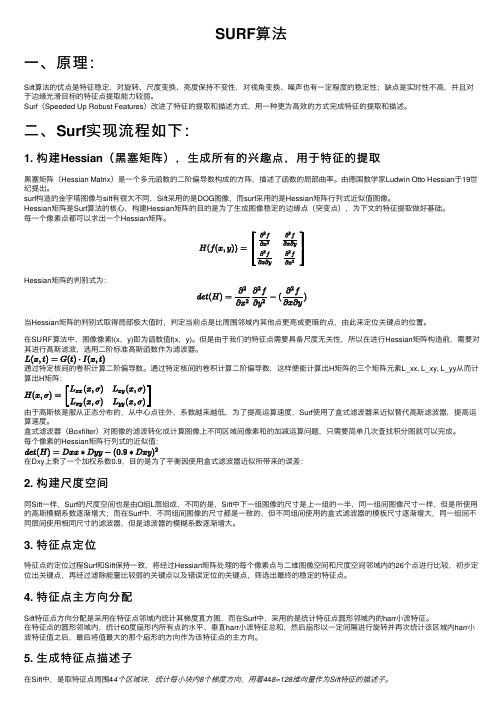

SURF算法

SURF算法⼀、原理:Sift算法的优点是特征稳定,对旋转、尺度变换、亮度保持不变性,对视⾓变换、噪声也有⼀定程度的稳定性;缺点是实时性不⾼,并且对于边缘光滑⽬标的特征点提取能⼒较弱。

Surf(Speeded Up Robust Features)改进了特征的提取和描述⽅式,⽤⼀种更为⾼效的⽅式完成特征的提取和描述。

⼆、Surf实现流程如下:1. 构建Hessian(⿊塞矩阵),⽣成所有的兴趣点,⽤于特征的提取⿊塞矩阵(Hessian Matrix)是⼀个多元函数的⼆阶偏导数构成的⽅阵,描述了函数的局部曲率。

由德国数学家Ludwin Otto Hessian于19世纪提出。

surf构造的⾦字塔图像与sift有很⼤不同,Sift采⽤的是DOG图像,⽽surf采⽤的是Hessian矩阵⾏列式近似值图像。

Hessian矩阵是Surf算法的核⼼,构建Hessian矩阵的⽬的是为了⽣成图像稳定的边缘点(突变点),为下⽂的特征提取做好基础。

每⼀个像素点都可以求出⼀个Hessian矩阵。

Hessian矩阵的判别式为:当Hessian矩阵的判别式取得局部极⼤值时,判定当前点是⽐周围邻域内其他点更亮或更暗的点,由此来定位关键点的位置。

在SURF算法中,图像像素l(x,y)即为函数值f(x,y)。

但是由于我们的特征点需要具备尺度⽆关性,所以在进⾏Hessian矩阵构造前,需要对其进⾏⾼斯滤波,选⽤⼆阶标准⾼斯函数作为滤波器。

H矩阵的三个矩阵元素L_xx, L_xy, L_yy从⽽计算出H矩阵:Surf使⽤了盒式滤波器来近似替代⾼斯滤波器,提⾼运算速度。

盒式滤波器(Boxfilter)对图像的滤波转化成计算图像上不同区域间像素和的加减运算问题,只需要简单⼏次查找积分图就可以完成。

每个像素的Hessian矩阵⾏列式的近似值:2. 构建尺度空间同Sift⼀样,Surf的尺度空间也是由O组L层组成,不同的是,Sift中下⼀组图像的尺⼨是上⼀组的⼀半,同⼀组间图像尺⼨⼀样,但是所使⽤的⾼斯模糊系数逐渐增⼤;⽽在Surf中,不同组间图像的尺⼨都是⼀致的,但不同组间使⽤的盒式滤波器的模板尺⼨逐渐增⼤,同⼀组间不同层间使⽤相同尺⼨的滤波器,但是滤波器的模糊系数逐渐增⼤。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

计算机技术与发展

COMPUTER TECHNOLOGY AND DEVELOPMENT

Vol. 22 No. 6 June 2012

单目视觉定位中 SURF 算法参数的优化

赵立双, 冯 莹, 曹 毓

( 国防科学技术大学 光电科学与工程学院 , 湖南 长沙 410073 )

Optimization of SURF Parameters in Monocular Visual Odometry

ZHAO Li -shuang , FENG Ying , CAO Yu

( College of Optoelectronics Science and Eng. , National Univ. of Defense Techn. , Changsha 410073 , China)

汽车

[5 , 6 ]

等领域有广泛应用 。目前 , 定位频率低是视觉

1

1. 1

路面图像特点与视觉定位算法流程

路面图像特性分析

定位方法发展中面临的重要问题之一 。为了提升视觉 定位方法的定位频率 , 设计了一种单目视觉定位系统 , 该系统针对柏油或水泥路面环境 , 采用基于 SURF 算 法的单目视觉定位方法实现相机运动轨迹的解算 。 为 了提升算法的效率 , 满足高频率的实时定位需求 , 并保 证现有算法的精度和稳定性 , 对 SURF 算法参数与路 面图像中特征点分布 、 程序耗时等关系进行了深入分 析, 据此优化了 SURF 算法中的组数和 层 数 , 并提出

0

引

言

[1 ]

hessian 行列 式 阈 值 动 态 设 定 方 法 。 实 验 结 果 表 明 , 是一种通过分析相机拍摄到的序列图 SURF 参数优化后 , 单目视觉定位在大幅提高效率的 同时 , 也保证了原有的精度和稳定性 。

视觉定位

像而确定运动平台位置和航向的方法 , 在同时定位与

[2 , 3 ] [4 ] 、 地图生成 ( SLAM ) 机器人定位导航 、 自主驾驶

图 1 中分别给出了实验中从柏油路面和水泥路面 拍摄的图像 。图像利用 PointGray Flea2 - 14S3 相机拍 摄, 分辨率为 640 × 480 , 拍摄时相机正俯视路面 , 距离 地面高度 1. 82m, 镜头焦距 16mm。 路面图像具有以下特点 : 1 ) 路面纹理的尺度较小 , 分布相对均匀 , 且相似 性较高 ; 2 ) 路边景物 、 路面人物和运动平台自身的阴影会 导致序列路面图像的亮度出现明显变化 ; 3 ) 镜头焦距较长 , 因此镜头畸变较小 , 为了提高 处理速度 , 可以省去镜头畸变校正的步骤 ; 4 ) 相机架设高度和角度固定 , 在忽略因相机抖动 而引起的误差情况下 , 可以认为所拍摄的序列路面图

收稿日期:2011-10-28 ;修回日期:2012-02-01 基金项目:中国人民解放军总后勤部资助项目 ( BY2008J018 ) 作者简介:赵立双( 1985- ) , 男, 硕士研究生, 研究方向为光电测控技 术; 冯 莹, 教授, 博士生导师, 研究方向为宽带光纤光源技术 、 光纤 激光器技术、 光纤波导生物传感器技术以及光电测控技术 。

摘 要:为了提升单目视觉定位方法的定位效率 , 在基于 SURF 算法的单目视觉定位系统上对 SURF 算法参数的选取进行

了优化。首先分析了路面图像的特点及路面图像中 SURF 特征点的特性, 据此选取了 SURF 算法中组数和层数这两个重 要参数; 其次分析了路面序列图像中特征点数目与 hessian 矩阵行列式阈值之间的关系, 提出了 hessian 矩阵行列式阈值动 态设定方法。通过对 SURF 算法参数的优化, 有效降低了程序的运算量。实验结果表明, 该方法能较好满足路面环境下定 位的要求, 在保证算法精度和稳定性的同时 , 大幅提高了程序的效率。 关键词:机器视觉; 单目视觉定位; SURF 参数; hessian 矩阵行列式阈值 中图分类号:TP212. 14 文献标识码:A 文章编号:1673-629X( 2012 ) 06-0006-04

Abstract:In order to increase the localization frequency of monocular visual odometry , optimization of SURF parameters w as done on features of pavement image and the SURF keypoint in it w ere analyzed, and monocular visual odometry system based on SURF. Firstly , octave number and octave layer number of SURF w ere properly chosen. Secondly , the relation betw een SURF keypoint number and hesand a method of hessian threshold dynamic setting w as put forw ard. By optimizing SURF sian threshold in image sequence w as analyzed, parameter , the amount of computation w as reduced efficiently. The experimental results demonstrate that the method can fit the demand of localization on the pavement, meanw hile, the efficiency of monocular visual odometry is greatly improved as the accuracy and stability are w ell kept. Key words:machine vision;monocular visual odometry ;SURF parameters;hessian threshold