ElearningMlearning 与 Blearning

机器学习与人工智能领域中常用的英语词汇

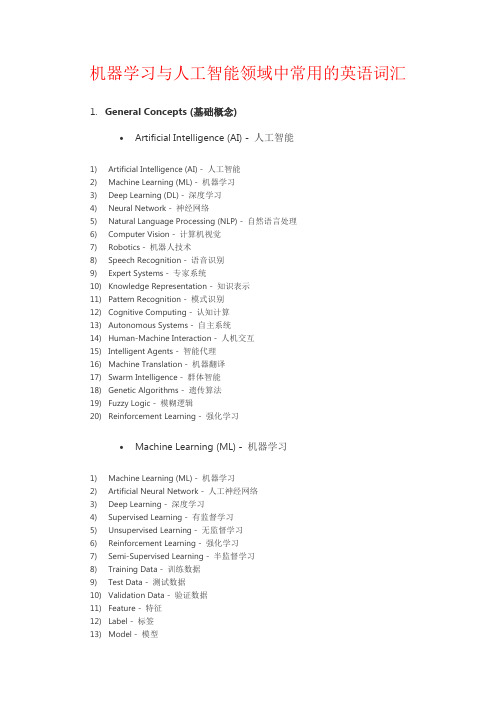

机器学习与人工智能领域中常用的英语词汇1.General Concepts (基础概念)•Artificial Intelligence (AI) - 人工智能1)Artificial Intelligence (AI) - 人工智能2)Machine Learning (ML) - 机器学习3)Deep Learning (DL) - 深度学习4)Neural Network - 神经网络5)Natural Language Processing (NLP) - 自然语言处理6)Computer Vision - 计算机视觉7)Robotics - 机器人技术8)Speech Recognition - 语音识别9)Expert Systems - 专家系统10)Knowledge Representation - 知识表示11)Pattern Recognition - 模式识别12)Cognitive Computing - 认知计算13)Autonomous Systems - 自主系统14)Human-Machine Interaction - 人机交互15)Intelligent Agents - 智能代理16)Machine Translation - 机器翻译17)Swarm Intelligence - 群体智能18)Genetic Algorithms - 遗传算法19)Fuzzy Logic - 模糊逻辑20)Reinforcement Learning - 强化学习•Machine Learning (ML) - 机器学习1)Machine Learning (ML) - 机器学习2)Artificial Neural Network - 人工神经网络3)Deep Learning - 深度学习4)Supervised Learning - 有监督学习5)Unsupervised Learning - 无监督学习6)Reinforcement Learning - 强化学习7)Semi-Supervised Learning - 半监督学习8)Training Data - 训练数据9)Test Data - 测试数据10)Validation Data - 验证数据11)Feature - 特征12)Label - 标签13)Model - 模型14)Algorithm - 算法15)Regression - 回归16)Classification - 分类17)Clustering - 聚类18)Dimensionality Reduction - 降维19)Overfitting - 过拟合20)Underfitting - 欠拟合•Deep Learning (DL) - 深度学习1)Deep Learning - 深度学习2)Neural Network - 神经网络3)Artificial Neural Network (ANN) - 人工神经网络4)Convolutional Neural Network (CNN) - 卷积神经网络5)Recurrent Neural Network (RNN) - 循环神经网络6)Long Short-Term Memory (LSTM) - 长短期记忆网络7)Gated Recurrent Unit (GRU) - 门控循环单元8)Autoencoder - 自编码器9)Generative Adversarial Network (GAN) - 生成对抗网络10)Transfer Learning - 迁移学习11)Pre-trained Model - 预训练模型12)Fine-tuning - 微调13)Feature Extraction - 特征提取14)Activation Function - 激活函数15)Loss Function - 损失函数16)Gradient Descent - 梯度下降17)Backpropagation - 反向传播18)Epoch - 训练周期19)Batch Size - 批量大小20)Dropout - 丢弃法•Neural Network - 神经网络1)Neural Network - 神经网络2)Artificial Neural Network (ANN) - 人工神经网络3)Deep Neural Network (DNN) - 深度神经网络4)Convolutional Neural Network (CNN) - 卷积神经网络5)Recurrent Neural Network (RNN) - 循环神经网络6)Long Short-Term Memory (LSTM) - 长短期记忆网络7)Gated Recurrent Unit (GRU) - 门控循环单元8)Feedforward Neural Network - 前馈神经网络9)Multi-layer Perceptron (MLP) - 多层感知器10)Radial Basis Function Network (RBFN) - 径向基函数网络11)Hopfield Network - 霍普菲尔德网络12)Boltzmann Machine - 玻尔兹曼机13)Autoencoder - 自编码器14)Spiking Neural Network (SNN) - 脉冲神经网络15)Self-organizing Map (SOM) - 自组织映射16)Restricted Boltzmann Machine (RBM) - 受限玻尔兹曼机17)Hebbian Learning - 海比安学习18)Competitive Learning - 竞争学习19)Neuroevolutionary - 神经进化20)Neuron - 神经元•Algorithm - 算法1)Algorithm - 算法2)Supervised Learning Algorithm - 有监督学习算法3)Unsupervised Learning Algorithm - 无监督学习算法4)Reinforcement Learning Algorithm - 强化学习算法5)Classification Algorithm - 分类算法6)Regression Algorithm - 回归算法7)Clustering Algorithm - 聚类算法8)Dimensionality Reduction Algorithm - 降维算法9)Decision Tree Algorithm - 决策树算法10)Random Forest Algorithm - 随机森林算法11)Support Vector Machine (SVM) Algorithm - 支持向量机算法12)K-Nearest Neighbors (KNN) Algorithm - K近邻算法13)Naive Bayes Algorithm - 朴素贝叶斯算法14)Gradient Descent Algorithm - 梯度下降算法15)Genetic Algorithm - 遗传算法16)Neural Network Algorithm - 神经网络算法17)Deep Learning Algorithm - 深度学习算法18)Ensemble Learning Algorithm - 集成学习算法19)Reinforcement Learning Algorithm - 强化学习算法20)Metaheuristic Algorithm - 元启发式算法•Model - 模型1)Model - 模型2)Machine Learning Model - 机器学习模型3)Artificial Intelligence Model - 人工智能模型4)Predictive Model - 预测模型5)Classification Model - 分类模型6)Regression Model - 回归模型7)Generative Model - 生成模型8)Discriminative Model - 判别模型9)Probabilistic Model - 概率模型10)Statistical Model - 统计模型11)Neural Network Model - 神经网络模型12)Deep Learning Model - 深度学习模型13)Ensemble Model - 集成模型14)Reinforcement Learning Model - 强化学习模型15)Support Vector Machine (SVM) Model - 支持向量机模型16)Decision Tree Model - 决策树模型17)Random Forest Model - 随机森林模型18)Naive Bayes Model - 朴素贝叶斯模型19)Autoencoder Model - 自编码器模型20)Convolutional Neural Network (CNN) Model - 卷积神经网络模型•Dataset - 数据集1)Dataset - 数据集2)Training Dataset - 训练数据集3)Test Dataset - 测试数据集4)Validation Dataset - 验证数据集5)Balanced Dataset - 平衡数据集6)Imbalanced Dataset - 不平衡数据集7)Synthetic Dataset - 合成数据集8)Benchmark Dataset - 基准数据集9)Open Dataset - 开放数据集10)Labeled Dataset - 标记数据集11)Unlabeled Dataset - 未标记数据集12)Semi-Supervised Dataset - 半监督数据集13)Multiclass Dataset - 多分类数据集14)Feature Set - 特征集15)Data Augmentation - 数据增强16)Data Preprocessing - 数据预处理17)Missing Data - 缺失数据18)Outlier Detection - 异常值检测19)Data Imputation - 数据插补20)Metadata - 元数据•Training - 训练1)Training - 训练2)Training Data - 训练数据3)Training Phase - 训练阶段4)Training Set - 训练集5)Training Examples - 训练样本6)Training Instance - 训练实例7)Training Algorithm - 训练算法8)Training Model - 训练模型9)Training Process - 训练过程10)Training Loss - 训练损失11)Training Epoch - 训练周期12)Training Batch - 训练批次13)Online Training - 在线训练14)Offline Training - 离线训练15)Continuous Training - 连续训练16)Transfer Learning - 迁移学习17)Fine-Tuning - 微调18)Curriculum Learning - 课程学习19)Self-Supervised Learning - 自监督学习20)Active Learning - 主动学习•Testing - 测试1)Testing - 测试2)Test Data - 测试数据3)Test Set - 测试集4)Test Examples - 测试样本5)Test Instance - 测试实例6)Test Phase - 测试阶段7)Test Accuracy - 测试准确率8)Test Loss - 测试损失9)Test Error - 测试错误10)Test Metrics - 测试指标11)Test Suite - 测试套件12)Test Case - 测试用例13)Test Coverage - 测试覆盖率14)Cross-Validation - 交叉验证15)Holdout Validation - 留出验证16)K-Fold Cross-Validation - K折交叉验证17)Stratified Cross-Validation - 分层交叉验证18)Test Driven Development (TDD) - 测试驱动开发19)A/B Testing - A/B 测试20)Model Evaluation - 模型评估•Validation - 验证1)Validation - 验证2)Validation Data - 验证数据3)Validation Set - 验证集4)Validation Examples - 验证样本5)Validation Instance - 验证实例6)Validation Phase - 验证阶段7)Validation Accuracy - 验证准确率8)Validation Loss - 验证损失9)Validation Error - 验证错误10)Validation Metrics - 验证指标11)Cross-Validation - 交叉验证12)Holdout Validation - 留出验证13)K-Fold Cross-Validation - K折交叉验证14)Stratified Cross-Validation - 分层交叉验证15)Leave-One-Out Cross-Validation - 留一法交叉验证16)Validation Curve - 验证曲线17)Hyperparameter Validation - 超参数验证18)Model Validation - 模型验证19)Early Stopping - 提前停止20)Validation Strategy - 验证策略•Supervised Learning - 有监督学习1)Supervised Learning - 有监督学习2)Label - 标签3)Feature - 特征4)Target - 目标5)Training Labels - 训练标签6)Training Features - 训练特征7)Training Targets - 训练目标8)Training Examples - 训练样本9)Training Instance - 训练实例10)Regression - 回归11)Classification - 分类12)Predictor - 预测器13)Regression Model - 回归模型14)Classifier - 分类器15)Decision Tree - 决策树16)Support Vector Machine (SVM) - 支持向量机17)Neural Network - 神经网络18)Feature Engineering - 特征工程19)Model Evaluation - 模型评估20)Overfitting - 过拟合21)Underfitting - 欠拟合22)Bias-Variance Tradeoff - 偏差-方差权衡•Unsupervised Learning - 无监督学习1)Unsupervised Learning - 无监督学习2)Clustering - 聚类3)Dimensionality Reduction - 降维4)Anomaly Detection - 异常检测5)Association Rule Learning - 关联规则学习6)Feature Extraction - 特征提取7)Feature Selection - 特征选择8)K-Means - K均值9)Hierarchical Clustering - 层次聚类10)Density-Based Clustering - 基于密度的聚类11)Principal Component Analysis (PCA) - 主成分分析12)Independent Component Analysis (ICA) - 独立成分分析13)T-distributed Stochastic Neighbor Embedding (t-SNE) - t分布随机邻居嵌入14)Gaussian Mixture Model (GMM) - 高斯混合模型15)Self-Organizing Maps (SOM) - 自组织映射16)Autoencoder - 自动编码器17)Latent Variable - 潜变量18)Data Preprocessing - 数据预处理19)Outlier Detection - 异常值检测20)Clustering Algorithm - 聚类算法•Reinforcement Learning - 强化学习1)Reinforcement Learning - 强化学习2)Agent - 代理3)Environment - 环境4)State - 状态5)Action - 动作6)Reward - 奖励7)Policy - 策略8)Value Function - 值函数9)Q-Learning - Q学习10)Deep Q-Network (DQN) - 深度Q网络11)Policy Gradient - 策略梯度12)Actor-Critic - 演员-评论家13)Exploration - 探索14)Exploitation - 开发15)Temporal Difference (TD) - 时间差分16)Markov Decision Process (MDP) - 马尔可夫决策过程17)State-Action-Reward-State-Action (SARSA) - 状态-动作-奖励-状态-动作18)Policy Iteration - 策略迭代19)Value Iteration - 值迭代20)Monte Carlo Methods - 蒙特卡洛方法•Semi-Supervised Learning - 半监督学习1)Semi-Supervised Learning - 半监督学习2)Labeled Data - 有标签数据3)Unlabeled Data - 无标签数据4)Label Propagation - 标签传播5)Self-Training - 自训练6)Co-Training - 协同训练7)Transudative Learning - 传导学习8)Inductive Learning - 归纳学习9)Manifold Regularization - 流形正则化10)Graph-based Methods - 基于图的方法11)Cluster Assumption - 聚类假设12)Low-Density Separation - 低密度分离13)Semi-Supervised Support Vector Machines (S3VM) - 半监督支持向量机14)Expectation-Maximization (EM) - 期望最大化15)Co-EM - 协同期望最大化16)Entropy-Regularized EM - 熵正则化EM17)Mean Teacher - 平均教师18)Virtual Adversarial Training - 虚拟对抗训练19)Tri-training - 三重训练20)Mix Match - 混合匹配•Feature - 特征1)Feature - 特征2)Feature Engineering - 特征工程3)Feature Extraction - 特征提取4)Feature Selection - 特征选择5)Input Features - 输入特征6)Output Features - 输出特征7)Feature Vector - 特征向量8)Feature Space - 特征空间9)Feature Representation - 特征表示10)Feature Transformation - 特征转换11)Feature Importance - 特征重要性12)Feature Scaling - 特征缩放13)Feature Normalization - 特征归一化14)Feature Encoding - 特征编码15)Feature Fusion - 特征融合16)Feature Dimensionality Reduction - 特征维度减少17)Continuous Feature - 连续特征18)Categorical Feature - 分类特征19)Nominal Feature - 名义特征20)Ordinal Feature - 有序特征•Label - 标签1)Label - 标签2)Labeling - 标注3)Ground Truth - 地面真值4)Class Label - 类别标签5)Target Variable - 目标变量6)Labeling Scheme - 标注方案7)Multi-class Labeling - 多类别标注8)Binary Labeling - 二分类标注9)Label Noise - 标签噪声10)Labeling Error - 标注错误11)Label Propagation - 标签传播12)Unlabeled Data - 无标签数据13)Labeled Data - 有标签数据14)Semi-supervised Learning - 半监督学习15)Active Learning - 主动学习16)Weakly Supervised Learning - 弱监督学习17)Noisy Label Learning - 噪声标签学习18)Self-training - 自训练19)Crowdsourcing Labeling - 众包标注20)Label Smoothing - 标签平滑化•Prediction - 预测1)Prediction - 预测2)Forecasting - 预测3)Regression - 回归4)Classification - 分类5)Time Series Prediction - 时间序列预测6)Forecast Accuracy - 预测准确性7)Predictive Modeling - 预测建模8)Predictive Analytics - 预测分析9)Forecasting Method - 预测方法10)Predictive Performance - 预测性能11)Predictive Power - 预测能力12)Prediction Error - 预测误差13)Prediction Interval - 预测区间14)Prediction Model - 预测模型15)Predictive Uncertainty - 预测不确定性16)Forecast Horizon - 预测时间跨度17)Predictive Maintenance - 预测性维护18)Predictive Policing - 预测式警务19)Predictive Healthcare - 预测性医疗20)Predictive Maintenance - 预测性维护•Classification - 分类1)Classification - 分类2)Classifier - 分类器3)Class - 类别4)Classify - 对数据进行分类5)Class Label - 类别标签6)Binary Classification - 二元分类7)Multiclass Classification - 多类分类8)Class Probability - 类别概率9)Decision Boundary - 决策边界10)Decision Tree - 决策树11)Support Vector Machine (SVM) - 支持向量机12)K-Nearest Neighbors (KNN) - K最近邻算法13)Naive Bayes - 朴素贝叶斯14)Logistic Regression - 逻辑回归15)Random Forest - 随机森林16)Neural Network - 神经网络17)SoftMax Function - SoftMax函数18)One-vs-All (One-vs-Rest) - 一对多(一对剩余)19)Ensemble Learning - 集成学习20)Confusion Matrix - 混淆矩阵•Regression - 回归1)Regression Analysis - 回归分析2)Linear Regression - 线性回归3)Multiple Regression - 多元回归4)Polynomial Regression - 多项式回归5)Logistic Regression - 逻辑回归6)Ridge Regression - 岭回归7)Lasso Regression - Lasso回归8)Elastic Net Regression - 弹性网络回归9)Regression Coefficients - 回归系数10)Residuals - 残差11)Ordinary Least Squares (OLS) - 普通最小二乘法12)Ridge Regression Coefficient - 岭回归系数13)Lasso Regression Coefficient - Lasso回归系数14)Elastic Net Regression Coefficient - 弹性网络回归系数15)Regression Line - 回归线16)Prediction Error - 预测误差17)Regression Model - 回归模型18)Nonlinear Regression - 非线性回归19)Generalized Linear Models (GLM) - 广义线性模型20)Coefficient of Determination (R-squared) - 决定系数21)F-test - F检验22)Homoscedasticity - 同方差性23)Heteroscedasticity - 异方差性24)Autocorrelation - 自相关25)Multicollinearity - 多重共线性26)Outliers - 异常值27)Cross-validation - 交叉验证28)Feature Selection - 特征选择29)Feature Engineering - 特征工程30)Regularization - 正则化2.Neural Networks and Deep Learning (神经网络与深度学习)•Convolutional Neural Network (CNN) - 卷积神经网络1)Convolutional Neural Network (CNN) - 卷积神经网络2)Convolution Layer - 卷积层3)Feature Map - 特征图4)Convolution Operation - 卷积操作5)Stride - 步幅6)Padding - 填充7)Pooling Layer - 池化层8)Max Pooling - 最大池化9)Average Pooling - 平均池化10)Fully Connected Layer - 全连接层11)Activation Function - 激活函数12)Rectified Linear Unit (ReLU) - 线性修正单元13)Dropout - 随机失活14)Batch Normalization - 批量归一化15)Transfer Learning - 迁移学习16)Fine-Tuning - 微调17)Image Classification - 图像分类18)Object Detection - 物体检测19)Semantic Segmentation - 语义分割20)Instance Segmentation - 实例分割21)Generative Adversarial Network (GAN) - 生成对抗网络22)Image Generation - 图像生成23)Style Transfer - 风格迁移24)Convolutional Autoencoder - 卷积自编码器25)Recurrent Neural Network (RNN) - 循环神经网络•Recurrent Neural Network (RNN) - 循环神经网络1)Recurrent Neural Network (RNN) - 循环神经网络2)Long Short-Term Memory (LSTM) - 长短期记忆网络3)Gated Recurrent Unit (GRU) - 门控循环单元4)Sequence Modeling - 序列建模5)Time Series Prediction - 时间序列预测6)Natural Language Processing (NLP) - 自然语言处理7)Text Generation - 文本生成8)Sentiment Analysis - 情感分析9)Named Entity Recognition (NER) - 命名实体识别10)Part-of-Speech Tagging (POS Tagging) - 词性标注11)Sequence-to-Sequence (Seq2Seq) - 序列到序列12)Attention Mechanism - 注意力机制13)Encoder-Decoder Architecture - 编码器-解码器架构14)Bidirectional RNN - 双向循环神经网络15)Teacher Forcing - 强制教师法16)Backpropagation Through Time (BPTT) - 通过时间的反向传播17)Vanishing Gradient Problem - 梯度消失问题18)Exploding Gradient Problem - 梯度爆炸问题19)Language Modeling - 语言建模20)Speech Recognition - 语音识别•Long Short-Term Memory (LSTM) - 长短期记忆网络1)Long Short-Term Memory (LSTM) - 长短期记忆网络2)Cell State - 细胞状态3)Hidden State - 隐藏状态4)Forget Gate - 遗忘门5)Input Gate - 输入门6)Output Gate - 输出门7)Peephole Connections - 窥视孔连接8)Gated Recurrent Unit (GRU) - 门控循环单元9)Vanishing Gradient Problem - 梯度消失问题10)Exploding Gradient Problem - 梯度爆炸问题11)Sequence Modeling - 序列建模12)Time Series Prediction - 时间序列预测13)Natural Language Processing (NLP) - 自然语言处理14)Text Generation - 文本生成15)Sentiment Analysis - 情感分析16)Named Entity Recognition (NER) - 命名实体识别17)Part-of-Speech Tagging (POS Tagging) - 词性标注18)Attention Mechanism - 注意力机制19)Encoder-Decoder Architecture - 编码器-解码器架构20)Bidirectional LSTM - 双向长短期记忆网络•Attention Mechanism - 注意力机制1)Attention Mechanism - 注意力机制2)Self-Attention - 自注意力3)Multi-Head Attention - 多头注意力4)Transformer - 变换器5)Query - 查询6)Key - 键7)Value - 值8)Query-Value Attention - 查询-值注意力9)Dot-Product Attention - 点积注意力10)Scaled Dot-Product Attention - 缩放点积注意力11)Additive Attention - 加性注意力12)Context Vector - 上下文向量13)Attention Score - 注意力分数14)SoftMax Function - SoftMax函数15)Attention Weight - 注意力权重16)Global Attention - 全局注意力17)Local Attention - 局部注意力18)Positional Encoding - 位置编码19)Encoder-Decoder Attention - 编码器-解码器注意力20)Cross-Modal Attention - 跨模态注意力•Generative Adversarial Network (GAN) - 生成对抗网络1)Generative Adversarial Network (GAN) - 生成对抗网络2)Generator - 生成器3)Discriminator - 判别器4)Adversarial Training - 对抗训练5)Minimax Game - 极小极大博弈6)Nash Equilibrium - 纳什均衡7)Mode Collapse - 模式崩溃8)Training Stability - 训练稳定性9)Loss Function - 损失函数10)Discriminative Loss - 判别损失11)Generative Loss - 生成损失12)Wasserstein GAN (WGAN) - Wasserstein GAN(WGAN)13)Deep Convolutional GAN (DCGAN) - 深度卷积生成对抗网络(DCGAN)14)Conditional GAN (c GAN) - 条件生成对抗网络(c GAN)15)Style GAN - 风格生成对抗网络16)Cycle GAN - 循环生成对抗网络17)Progressive Growing GAN (PGGAN) - 渐进式增长生成对抗网络(PGGAN)18)Self-Attention GAN (SAGAN) - 自注意力生成对抗网络(SAGAN)19)Big GAN - 大规模生成对抗网络20)Adversarial Examples - 对抗样本•Encoder-Decoder - 编码器-解码器1)Encoder-Decoder Architecture - 编码器-解码器架构2)Encoder - 编码器3)Decoder - 解码器4)Sequence-to-Sequence Model (Seq2Seq) - 序列到序列模型5)State Vector - 状态向量6)Context Vector - 上下文向量7)Hidden State - 隐藏状态8)Attention Mechanism - 注意力机制9)Teacher Forcing - 强制教师法10)Beam Search - 束搜索11)Recurrent Neural Network (RNN) - 循环神经网络12)Long Short-Term Memory (LSTM) - 长短期记忆网络13)Gated Recurrent Unit (GRU) - 门控循环单元14)Bidirectional Encoder - 双向编码器15)Greedy Decoding - 贪婪解码16)Masking - 遮盖17)Dropout - 随机失活18)Embedding Layer - 嵌入层19)Cross-Entropy Loss - 交叉熵损失20)Tokenization - 令牌化•Transfer Learning - 迁移学习1)Transfer Learning - 迁移学习2)Source Domain - 源领域3)Target Domain - 目标领域4)Fine-Tuning - 微调5)Domain Adaptation - 领域自适应6)Pre-Trained Model - 预训练模型7)Feature Extraction - 特征提取8)Knowledge Transfer - 知识迁移9)Unsupervised Domain Adaptation - 无监督领域自适应10)Semi-Supervised Domain Adaptation - 半监督领域自适应11)Multi-Task Learning - 多任务学习12)Data Augmentation - 数据增强13)Task Transfer - 任务迁移14)Model Agnostic Meta-Learning (MAML) - 与模型无关的元学习(MAML)15)One-Shot Learning - 单样本学习16)Zero-Shot Learning - 零样本学习17)Few-Shot Learning - 少样本学习18)Knowledge Distillation - 知识蒸馏19)Representation Learning - 表征学习20)Adversarial Transfer Learning - 对抗迁移学习•Pre-trained Models - 预训练模型1)Pre-trained Model - 预训练模型2)Transfer Learning - 迁移学习3)Fine-Tuning - 微调4)Knowledge Transfer - 知识迁移5)Domain Adaptation - 领域自适应6)Feature Extraction - 特征提取7)Representation Learning - 表征学习8)Language Model - 语言模型9)Bidirectional Encoder Representations from Transformers (BERT) - 双向编码器结构转换器10)Generative Pre-trained Transformer (GPT) - 生成式预训练转换器11)Transformer-based Models - 基于转换器的模型12)Masked Language Model (MLM) - 掩蔽语言模型13)Cloze Task - 填空任务14)Tokenization - 令牌化15)Word Embeddings - 词嵌入16)Sentence Embeddings - 句子嵌入17)Contextual Embeddings - 上下文嵌入18)Self-Supervised Learning - 自监督学习19)Large-Scale Pre-trained Models - 大规模预训练模型•Loss Function - 损失函数1)Loss Function - 损失函数2)Mean Squared Error (MSE) - 均方误差3)Mean Absolute Error (MAE) - 平均绝对误差4)Cross-Entropy Loss - 交叉熵损失5)Binary Cross-Entropy Loss - 二元交叉熵损失6)Categorical Cross-Entropy Loss - 分类交叉熵损失7)Hinge Loss - 合页损失8)Huber Loss - Huber损失9)Wasserstein Distance - Wasserstein距离10)Triplet Loss - 三元组损失11)Contrastive Loss - 对比损失12)Dice Loss - Dice损失13)Focal Loss - 焦点损失14)GAN Loss - GAN损失15)Adversarial Loss - 对抗损失16)L1 Loss - L1损失17)L2 Loss - L2损失18)Huber Loss - Huber损失19)Quantile Loss - 分位数损失•Activation Function - 激活函数1)Activation Function - 激活函数2)Sigmoid Function - Sigmoid函数3)Hyperbolic Tangent Function (Tanh) - 双曲正切函数4)Rectified Linear Unit (Re LU) - 矩形线性单元5)Parametric Re LU (P Re LU) - 参数化Re LU6)Exponential Linear Unit (ELU) - 指数线性单元7)Swish Function - Swish函数8)Softplus Function - Soft plus函数9)Softmax Function - SoftMax函数10)Hard Tanh Function - 硬双曲正切函数11)Softsign Function - Softsign函数12)GELU (Gaussian Error Linear Unit) - GELU(高斯误差线性单元)13)Mish Function - Mish函数14)CELU (Continuous Exponential Linear Unit) - CELU(连续指数线性单元)15)Bent Identity Function - 弯曲恒等函数16)Gaussian Error Linear Units (GELUs) - 高斯误差线性单元17)Adaptive Piecewise Linear (APL) - 自适应分段线性函数18)Radial Basis Function (RBF) - 径向基函数•Backpropagation - 反向传播1)Backpropagation - 反向传播2)Gradient Descent - 梯度下降3)Partial Derivative - 偏导数4)Chain Rule - 链式法则5)Forward Pass - 前向传播6)Backward Pass - 反向传播7)Computational Graph - 计算图8)Neural Network - 神经网络9)Loss Function - 损失函数10)Gradient Calculation - 梯度计算11)Weight Update - 权重更新12)Activation Function - 激活函数13)Optimizer - 优化器14)Learning Rate - 学习率15)Mini-Batch Gradient Descent - 小批量梯度下降16)Stochastic Gradient Descent (SGD) - 随机梯度下降17)Batch Gradient Descent - 批量梯度下降18)Momentum - 动量19)Adam Optimizer - Adam优化器20)Learning Rate Decay - 学习率衰减•Gradient Descent - 梯度下降1)Gradient Descent - 梯度下降2)Stochastic Gradient Descent (SGD) - 随机梯度下降3)Mini-Batch Gradient Descent - 小批量梯度下降4)Batch Gradient Descent - 批量梯度下降5)Learning Rate - 学习率6)Momentum - 动量7)Adaptive Moment Estimation (Adam) - 自适应矩估计8)RMSprop - 均方根传播9)Learning Rate Schedule - 学习率调度10)Convergence - 收敛11)Divergence - 发散12)Adagrad - 自适应学习速率方法13)Adadelta - 自适应增量学习率方法14)Adamax - 自适应矩估计的扩展版本15)Nadam - Nesterov Accelerated Adaptive Moment Estimation16)Learning Rate Decay - 学习率衰减17)Step Size - 步长18)Conjugate Gradient Descent - 共轭梯度下降19)Line Search - 线搜索20)Newton's Method - 牛顿法•Learning Rate - 学习率1)Learning Rate - 学习率2)Adaptive Learning Rate - 自适应学习率3)Learning Rate Decay - 学习率衰减4)Initial Learning Rate - 初始学习率5)Step Size - 步长6)Momentum - 动量7)Exponential Decay - 指数衰减8)Annealing - 退火9)Cyclical Learning Rate - 循环学习率10)Learning Rate Schedule - 学习率调度11)Warm-up - 预热12)Learning Rate Policy - 学习率策略13)Learning Rate Annealing - 学习率退火14)Cosine Annealing - 余弦退火15)Gradient Clipping - 梯度裁剪16)Adapting Learning Rate - 适应学习率17)Learning Rate Multiplier - 学习率倍增器18)Learning Rate Reduction - 学习率降低19)Learning Rate Update - 学习率更新20)Scheduled Learning Rate - 定期学习率•Batch Size - 批量大小1)Batch Size - 批量大小2)Mini-Batch - 小批量3)Batch Gradient Descent - 批量梯度下降4)Stochastic Gradient Descent (SGD) - 随机梯度下降5)Mini-Batch Gradient Descent - 小批量梯度下降6)Online Learning - 在线学习7)Full-Batch - 全批量8)Data Batch - 数据批次9)Training Batch - 训练批次10)Batch Normalization - 批量归一化11)Batch-wise Optimization - 批量优化12)Batch Processing - 批量处理13)Batch Sampling - 批量采样14)Adaptive Batch Size - 自适应批量大小15)Batch Splitting - 批量分割16)Dynamic Batch Size - 动态批量大小17)Fixed Batch Size - 固定批量大小18)Batch-wise Inference - 批量推理19)Batch-wise Training - 批量训练20)Batch Shuffling - 批量洗牌•Epoch - 训练周期1)Training Epoch - 训练周期2)Epoch Size - 周期大小3)Early Stopping - 提前停止4)Validation Set - 验证集5)Training Set - 训练集6)Test Set - 测试集7)Overfitting - 过拟合8)Underfitting - 欠拟合9)Model Evaluation - 模型评估10)Model Selection - 模型选择11)Hyperparameter Tuning - 超参数调优12)Cross-Validation - 交叉验证13)K-fold Cross-Validation - K折交叉验证14)Stratified Cross-Validation - 分层交叉验证15)Leave-One-Out Cross-Validation (LOOCV) - 留一法交叉验证16)Grid Search - 网格搜索17)Random Search - 随机搜索18)Model Complexity - 模型复杂度19)Learning Curve - 学习曲线20)Convergence - 收敛3.Machine Learning Techniques and Algorithms (机器学习技术与算法)•Decision Tree - 决策树1)Decision Tree - 决策树2)Node - 节点3)Root Node - 根节点4)Leaf Node - 叶节点5)Internal Node - 内部节点6)Splitting Criterion - 分裂准则7)Gini Impurity - 基尼不纯度8)Entropy - 熵9)Information Gain - 信息增益10)Gain Ratio - 增益率11)Pruning - 剪枝12)Recursive Partitioning - 递归分割13)CART (Classification and Regression Trees) - 分类回归树14)ID3 (Iterative Dichotomiser 3) - 迭代二叉树315)C4.5 (successor of ID3) - C4.5(ID3的后继者)16)C5.0 (successor of C4.5) - C5.0(C4.5的后继者)17)Split Point - 分裂点18)Decision Boundary - 决策边界19)Pruned Tree - 剪枝后的树20)Decision Tree Ensemble - 决策树集成•Random Forest - 随机森林1)Random Forest - 随机森林2)Ensemble Learning - 集成学习3)Bootstrap Sampling - 自助采样4)Bagging (Bootstrap Aggregating) - 装袋法5)Out-of-Bag (OOB) Error - 袋外误差6)Feature Subset - 特征子集7)Decision Tree - 决策树8)Base Estimator - 基础估计器9)Tree Depth - 树深度10)Randomization - 随机化11)Majority Voting - 多数投票12)Feature Importance - 特征重要性13)OOB Score - 袋外得分14)Forest Size - 森林大小15)Max Features - 最大特征数16)Min Samples Split - 最小分裂样本数17)Min Samples Leaf - 最小叶节点样本数18)Gini Impurity - 基尼不纯度19)Entropy - 熵20)Variable Importance - 变量重要性•Support Vector Machine (SVM) - 支持向量机1)Support Vector Machine (SVM) - 支持向量机2)Hyperplane - 超平面3)Kernel Trick - 核技巧4)Kernel Function - 核函数5)Margin - 间隔6)Support Vectors - 支持向量7)Decision Boundary - 决策边界8)Maximum Margin Classifier - 最大间隔分类器9)Soft Margin Classifier - 软间隔分类器10) C Parameter - C参数11)Radial Basis Function (RBF) Kernel - 径向基函数核12)Polynomial Kernel - 多项式核13)Linear Kernel - 线性核14)Quadratic Kernel - 二次核15)Gaussian Kernel - 高斯核16)Regularization - 正则化17)Dual Problem - 对偶问题18)Primal Problem - 原始问题19)Kernelized SVM - 核化支持向量机20)Multiclass SVM - 多类支持向量机•K-Nearest Neighbors (KNN) - K-最近邻1)K-Nearest Neighbors (KNN) - K-最近邻2)Nearest Neighbor - 最近邻3)Distance Metric - 距离度量4)Euclidean Distance - 欧氏距离5)Manhattan Distance - 曼哈顿距离6)Minkowski Distance - 闵可夫斯基距离7)Cosine Similarity - 余弦相似度8)K Value - K值9)Majority Voting - 多数投票10)Weighted KNN - 加权KNN11)Radius Neighbors - 半径邻居12)Ball Tree - 球树13)KD Tree - KD树14)Locality-Sensitive Hashing (LSH) - 局部敏感哈希15)Curse of Dimensionality - 维度灾难16)Class Label - 类标签17)Training Set - 训练集18)Test Set - 测试集19)Validation Set - 验证集20)Cross-Validation - 交叉验证•Naive Bayes - 朴素贝叶斯1)Naive Bayes - 朴素贝叶斯2)Bayes' Theorem - 贝叶斯定理3)Prior Probability - 先验概率4)Posterior Probability - 后验概率5)Likelihood - 似然6)Class Conditional Probability - 类条件概率7)Feature Independence Assumption - 特征独立假设8)Multinomial Naive Bayes - 多项式朴素贝叶斯9)Gaussian Naive Bayes - 高斯朴素贝叶斯10)Bernoulli Naive Bayes - 伯努利朴素贝叶斯11)Laplace Smoothing - 拉普拉斯平滑12)Add-One Smoothing - 加一平滑13)Maximum A Posteriori (MAP) - 最大后验概率14)Maximum Likelihood Estimation (MLE) - 最大似然估计15)Classification - 分类16)Feature Vectors - 特征向量17)Training Set - 训练集18)Test Set - 测试集19)Class Label - 类标签20)Confusion Matrix - 混淆矩阵•Clustering - 聚类1)Clustering - 聚类2)Centroid - 质心3)Cluster Analysis - 聚类分析4)Partitioning Clustering - 划分式聚类5)Hierarchical Clustering - 层次聚类6)Density-Based Clustering - 基于密度的聚类7)K-Means Clustering - K均值聚类8)K-Medoids Clustering - K中心点聚类9)DBSCAN (Density-Based Spatial Clustering of Applications with Noise) - 基于密度的空间聚类算法10)Agglomerative Clustering - 聚合式聚类11)Dendrogram - 系统树图12)Silhouette Score - 轮廓系数13)Elbow Method - 肘部法则14)Clustering Validation - 聚类验证15)Intra-cluster Distance - 类内距离16)Inter-cluster Distance - 类间距离17)Cluster Cohesion - 类内连贯性18)Cluster Separation - 类间分离度19)Cluster Assignment - 聚类分配20)Cluster Label - 聚类标签•K-Means - K-均值1)K-Means - K-均值2)Centroid - 质心3)Cluster - 聚类4)Cluster Center - 聚类中心5)Cluster Assignment - 聚类分配6)Cluster Analysis - 聚类分析7)K Value - K值8)Elbow Method - 肘部法则9)Inertia - 惯性10)Silhouette Score - 轮廓系数11)Convergence - 收敛12)Initialization - 初始化13)Euclidean Distance - 欧氏距离14)Manhattan Distance - 曼哈顿距离15)Distance Metric - 距离度量16)Cluster Radius - 聚类半径17)Within-Cluster Variation - 类内变异18)Cluster Quality - 聚类质量19)Clustering Algorithm - 聚类算法20)Clustering Validation - 聚类验证•Dimensionality Reduction - 降维1)Dimensionality Reduction - 降维2)Feature Extraction - 特征提取3)Feature Selection - 特征选择4)Principal Component Analysis (PCA) - 主成分分析5)Singular Value Decomposition (SVD) - 奇异值分解6)Linear Discriminant Analysis (LDA) - 线性判别分析7)t-Distributed Stochastic Neighbor Embedding (t-SNE) - t-分布随机邻域嵌入8)Autoencoder - 自编码器9)Manifold Learning - 流形学习10)Locally Linear Embedding (LLE) - 局部线性嵌入11)Isomap - 等度量映射12)Uniform Manifold Approximation and Projection (UMAP) - 均匀流形逼近与投影13)Kernel PCA - 核主成分分析14)Non-negative Matrix Factorization (NMF) - 非负矩阵分解15)Independent Component Analysis (ICA) - 独立成分分析16)Variational Autoencoder (VAE) - 变分自编码器17)Sparse Coding - 稀疏编码18)Random Projection - 随机投影19)Neighborhood Preserving Embedding (NPE) - 保持邻域结构的嵌入20)Curvilinear Component Analysis (CCA) - 曲线成分分析•Principal Component Analysis (PCA) - 主成分分析1)Principal Component Analysis (PCA) - 主成分分析2)Eigenvector - 特征向量3)Eigenvalue - 特征值4)Covariance Matrix - 协方差矩阵。

汇思e-learning分享:移动学习的定义 特征和结构

汇思e-learning分享:移动学习的定义特征和结构自21 世纪以来,全球步入信息化时代,全球最先进的社会已然成为一种全面的信息加工系统。

在这样的社会中知识成为一种战略性资源。

今天的城市建立于知识资源的基石上,围绕大学和金融资本为中心,基于媒体通讯网络构筑而成。

社会结构的巨大变迁,带来了教育目的和学习方式的改变。

今天的人们已不可能全部掌握所有历史上产生的旧知识和成长、生活中所产生的新知识;他们在实际工作中遇到的问题,往往需要未曾学习过的知识或自己创造新的知识。

我们发现传统教育体制的知识传授系统承担不了这样的历史任务,而移动学习的出现给这场危机带来了一线曙光。

我们围绕移动学习的讨论,不仅仅是在讨论某种新技术的开发和应用,而实质上是思考我们教育系统的未来蓝图。

1.移动学习(m-learning)的定义m-learning 起源于2000 年美国加州大学伯克利分校的"Mobile Education"研究项目,近10年来其发速度出人意料。

国际远程教育学家戴斯蒙德•基更(Desmond Keegan)在2000年庆祝上海电视大学建校40 周年的学术报告中首次将移动学习的概念介绍到中国。

移动学习,在今天的教育技术领域已经成为一个激动人心的话题,吸引了大量的研究者进入这个领域。

目前关于移动学习还没有一个明确、统一的定义,众多定义从不同角度阐释了移动学习。

国内外较权威的定义有:(1)芬兰的"TelenorWAP 移动学习"研究目的报告中给出的移动学习定义是:由于人们地理空间流动性和弹性学习需求的增加而使用移动终端设备进行一种新型学习方式。

(2)Alexzander Dye 等人在它们的题为《Mobile Education-aglance at the future》的文章中对M-Learning 作了一个较具体的定义:移动学习是一种在移动计算设备帮助下的能够在任何时间任何地点开展的学习,移动学习所使用的移动计算设备必须能够有效呈现学习内容并提供教师与学习者之间的双向交流。

ai的一些常用知识

ai的一些常用知识人工智能(Artificial Intelligence,AI)作为一门跨学科的科学,旨在模拟和复制人的智能行为,尤其是在计算机系统中。

AI已经广泛应用于各个领域,包括自动驾驶、机器人、语音识别等。

本文将介绍一些AI的常用知识。

一、机器学习(Machine Learning)机器学习是AI的重要分支,它是让计算机通过学习数据和经验来改善性能的一种方法。

机器学习可以分为监督学习、无监督学习和强化学习。

监督学习是通过提供标记的样本来进行学习,以预测或分类新的数据。

无监督学习则是在未标记的数据中寻找模式,进行数据聚类和降维等任务。

强化学习是通过与环境进行交互来学习最佳行为,其中包括奖励和惩罚的机制。

二、深度学习(Deep Learning)深度学习是机器学习的一种方法,通过模拟人脑的神经网络结构,进行大规模的数据学习和模式识别。

深度学习已经在计算机视觉、自然语言处理等领域取得了显著成果。

深度学习的核心是多层的神经网络,通过层层传递和处理数据来提取特征和进行决策。

三、自然语言处理(Natural Language Processing,NLP)自然语言处理是AI研究的重要领域之一,旨在使计算机能够理解和处理人类语言。

NLP可以用于机器翻译、自动问答、文本分类等任务。

NLP涉及到词法分析、语法分析、语义分析等技术,如词向量表示、序列模型和注意力机制等。

四、计算机视觉(Computer Vision)计算机视觉是AI研究的另一个重要方向,旨在使计算机具备解析和理解图像与视频的能力。

计算机视觉可以用于目标检测、图像分割、人脸识别等任务。

计算机视觉的核心技术包括图像特征提取、卷积神经网络和图像生成模型等。

五、强化学习(Reinforcement Learning)强化学习是AI中涉及决策制定和控制的一种方法,通过给予系统积极的奖励或消极的惩罚来引导系统学习最佳行为。

强化学习可以用于自动驾驶、智能游戏等领域。

人工智能技术的知识点整理

人工智能技术的知识点整理人工智能(Artificial Intelligence,简称AI)是近年来发展迅猛的一门技术领域,它致力于使计算机系统具备类似人类智能的功能和能力。

在AI技术的发展过程中,各种知识点相互交织,形成了庞大而复杂的知识网络。

本文将对人工智能技术的知识点进行整理和梳理,以便更好地理解和掌握这一领域。

一、机器学习(Machine Learning)机器学习是人工智能领域的重要基石,它关注计算机系统如何通过经验学习来改善性能。

在机器学习中,主要有以下几个重要知识点:1. 监督学习(Supervised Learning):通过给定输入和对应的输出样本训练模型,从而使其能够预测未知输入的输出。

2. 无监督学习(Unsupervised Learning):通过从输入样本中发现模式和结构,从而提取隐藏的信息和知识。

3. 强化学习(Reinforcement Learning):通过与环境交互,通过奖励和惩罚的机制来学习最优决策策略。

4. 深度学习(Deep Learning):通过模仿人脑神经网络的结构和工作方式,实现复杂的模式识别和决策。

二、自然语言处理(Natural Language Processing)自然语言处理是AI技术中与人类语言相关的领域,主要研究计算机如何理解和处理人类的自然语言。

以下是自然语言处理的几个重点知识点:1. 词法分析(Lexical Analysis):将自然语言的连续字符序列切分成有意义的词汇单位,例如分词、词性标注等。

2. 句法分析(Syntactic Analysis):研究语言中词汇之间的关系,例如依存关系、语法结构等。

3. 语义分析(Semantic Analysis):理解自然语言句子的意义,例如命名实体识别、意图识别等。

4. 机器翻译(Machine Translation):将一种自然语言转化成另一种自然语言的技术。

三、计算机视觉(Computer Vision)计算机视觉是研究如何使计算机通过摄像头或相似的设备感知和理解图像或视频的过程。

掌握机器学习中的集成学习和深度强化学习算法

掌握机器学习中的集成学习和深度强化学习算法集成学习和深度强化学习是机器学习领域中的两个重要研究方向。

本文将介绍集成学习和深度强化学习的基本概念、算法原理和应用领域。

一、集成学习集成学习(Ensemble Learning)是一种通过结合多个基学习器来提高机器学习算法性能的方法。

集成学习的基本思想是“三个臭皮匠,赛过诸葛亮”,通过将多个弱学习器集合在一起,形成一个强学习器,从而提高预测性能。

常见的集成学习方法包括投票法、平均法和Bagging、Boosting 等。

投票法是指通过多个弱学习器进行投票来决定最终的预测结果。

平均法则是将多个弱学习器的预测结果进行平均,作为最终的预测结果。

而Bagging和Boosting是将多个基学习器进行整合,分别通过并行和串行的方式进行训练,从而提高模型的泛化能力。

集成学习的应用非常广泛,其中最著名的应用之一是随机森林(Random Forest)。

随机森林是一种基于决策树的集成学习算法,通过多个决策树的投票或平均来进行分类或回归任务。

随机森林具有较强的鲁棒性和泛化能力,在各种实际应用中取得了良好的效果。

二、深度强化学习深度强化学习(Deep Reinforcement Learning)是结合深度学习和强化学习的一种方法。

强化学习是一种通过智能体在环境中执行动作并得到奖励信号,以达到最大化累积奖励的学习方法。

深度学习则是一种模仿人脑神经网络的学习方法,利用多层神经网络对输入特征进行高层抽象和表示学习。

深度强化学习的核心是使用深度神经网络来近似值函数或者策略函数。

一种经典的深度强化学习算法是深度Q网络(Deep Q-Network,DQN)。

DQN通过深度神经网络来逼近动作值函数(Q函数),从而实现智能体在环境中选取最优动作。

DQN具有较强的逼近能力和泛化能力,在很多领域,特别是游戏领域取得了非常好的效果。

深度强化学习在很多领域都有着广泛的应用。

例如,在机器人领域,深度强化学习可以用于实现机器人的自主导航和控制;在自然语言处理和机器翻译领域,深度强化学习可以用于语言模型的训练和优化;在金融领域,深度强化学习可以通过学习交易模式来进行股票交易。

M-Learning支持的成 人教育研究

M-Learning支持的成人教育研究摘要:从移动学习的学习形式移动性、实现方式数字化、学习内容互动性等角度,阐述M Learning支持成人教育的可适性。

分析了M Learning支持的成人学习的3种主要实现方式:基于短消息的实现方式、基于W AP的实现方式、基于PTT的实现方式。

力求为移动学习支持的成人教育提供一定参考。

关键词:M Learning;成人教育1M Learning概述M Learning是mobile learning的简称,在国内,通常被翻译成移动学习。

它是指在终身学习的思想指导下,利用现代通讯终端,如手机、PDA等设备(通常不包括具备无线上网功能的笔记本电脑)进行远程学习。

我们可以从以下几个方面来理解移动学习的内涵:(1)学习形式上的移动性。

移动学习者的终端设备主要包括PDA、智能手机、便携式计算机等,他们都具有可携带性、移动性和无线性的特点。

利用这些便携式的终端设备,学习者的学习形式不再局限于电脑桌前,而是可以真正“随时随地随身”学习。

(2)实现方式上的数字化。

移动学习是数字化学习的扩展,具有数字化的学习环境、数字化学习资源以及数字化的学习方式。

(3)学习内容上的互动性。

在M learning中,教学过程的4个基本要素:教师、学生、教学内容和教学媒体都是“移动”的。

即学习者不再局限在电脑前,可以“随时、随地、随身”,“短、平、快”地进行交流、协作。

因此,M learning可以看作是学习者在非固定和非预先设定的位置下发生的任何类型的学习,或者是学习者利用移动技术提供的优势所进行的学习,其特点是实现“Anyone、Anytime、Anywhere、Anystyle(4A)”下进行的更自由的学习。

2M Learning支持成人教育的可适性(1)成人学习者自身的特性。

成人学习者大都是在职的从业人员,他们中相当一部分人忙碌于工作和家庭的琐事中,很难挤出完整的学习时间进行系统化的学习。

《人工智能基础》名词术语

《人工智能基础》名词术语人工智能基础一、引言人工智能(Artificial Intelligence,简称AI)是近年来发展迅猛的前沿科学领域之一。

随着大数据和计算能力的快速增长,人工智能正在逐渐渗透到我们的日常生活和各个行业中。

本文将介绍人工智能基础的一些重要名词术语,帮助读者理解和应用人工智能技术。

二、机器学习机器学习(Machine Learning)指机器通过数据和算法自动进行学习和优化,从而不断改进性能。

监督学习(Supervised Learning)是一种常见的机器学习方法,它通过给机器提供带有标签的训练数据,让机器学习到输入数据和输出标签之间的关系。

无监督学习(Unsupervised Learning)则不需要标签,机器可以自主学习数据中的模式和结构。

三、深度学习深度学习(Deep Learning)是一种基于神经网络的机器学习方法,它模拟了人脑神经元之间的连接方式,通过多层的神经网络结构来进行学习和特征提取。

卷积神经网络(Convolutional Neural Network,简称CNN)是一种常用的深度学习结构,广泛应用于图像识别和计算机视觉领域。

四、自然语言处理自然语言处理(Natural Language Processing,简称NLP)是研究如何使机器能够理解和处理人类语言的一门技术。

文本分类(Text Classification)是NLP中的一项重要任务,它通过对文本进行分类或标记,实现对大规模文本数据的自动处理和分析。

情感分析(Sentiment Analysis)则是一种常见的文本分类应用,它可以判断文本中蕴含的情绪倾向。

五、强化学习强化学习(Reinforcement Learning)是一种通过试错学习来优化机器行为的方法,它通过与环境的交互,根据反馈信号对机器的行动进行调整和优化。

Q学习(Q-Learning)是强化学习中的一种常用算法,通过学习和更新动作值函数来实现智能体的决策策略的优化。

Elearning信息时代的网络学习

—科技改变学习Elearning 信息时代的网络学习人力资源开发中心2013-7-22目录一、中国电信网上大学介绍二、移动学习介绍E-learning 随时随地的学习E-Learning体系中国电信网上大学荣获美国培训与发展协会颁发的ASTD2008年度最佳实践奖•(一)自学课程•1、点击菜单最右边“我要选课”•2.选课分为按“知识、组织机构、岗位”等3种分类,例如:点击“组织机构分类”选课•3.在课程学习结束后,进入“我的考试”完成考试演示目录一、中国电信网上大学介绍二、移动学习介绍E-Learning 与 M-LearningE-Learning(Electronic learning)电子化学习M-Learning(Mobile learning)移动学习E-LearningM-Learning网络公开课机遇:优质学习资源集散地—网络公开课moocM assive 大规模的O pen 开放的O nline 在线的C ourse 课程M-Learning 移动学习是指在终身学习的思想指导下,在移动计算设备帮助下能够在任何时间、任何地点发生的学习。

移动学习被认为是一种未来的学习模式,或者说是未来学习不可缺少的一种学习模式。

計算設備的發展 Global Internet Device Sales2000 2001 2002 2003 2004 2005 2006 2007 2008 2009 2010 2011 2012 2013 2014 2015 2016500 mn1bn1.5bn 2bn2.5bn 3bnU N I T S YEARGlobal Internet Device Sales 2000 2001 2002 2003 2004 2005 2006 2007 2008 2009 2010 2011 2012 2013 2014 2015 2016U N I T S YEAR計算設備的發展500 mn1bn1.5bn2bn 2.5bn3bn2000 2001 2002 2003 2004 2005 2006 2007 2008 2009 2010 2011 2012 2013 2014 2015 2016U N I T S YEARWe are here Global Internet Device Sales計算設備的發展500 mn1bn1.5bn 2bn2.5bn3bn2011年移动终端出货量4.55亿部,全面超过PC出货量现在过去2011 2012 2013 2016 Global smartphone shipments as % of total phones shipments “移動為先”的趨勢 35 46 54 67.4U S A G E2009 2014 U S A G E2011 2013 2015 0.7%2016 70.065.060.055.050.045.040.0 35.030.025.020.015.010.0 5.0 0.0 4.3% 2010 1.6% 2012 8.5%Global use of mobile devices to access internet “移動為先”的趨勢1986 1997 2006 Percentage of the knowledge needed to memorize工作型態的改變 75 15-20 8-10NoMoPhobia 手機症候群现在过去 网站MobileeLearning 最终将进化到mLearning” mLearning is about augmenting our learning – and our performance “ 西安杨森 案例鉴于iPad 的业务功能及流量限制,不宜下载过大的数据量!希望拓展除拜访以外的功能,如:收发邮件、完成月度考试、完成学习计划等。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

1

2020/10/16

E-learning: electronic Learning,电子学习 M-learning: Mobile Learning,移动学习 B-learning: Blended Learning,混合学习 Hybrid-learning,混合学习 Online learning:网络学习

3

2020/10/16

一、关于E-learning

不知不觉中,我们已经步入一个E-化 的世界——E-mail、E-cash、Emarking、E-business、Emanagement、E-library ……and ELearning!

4

2020/10/16

Web-Based Learning Web-Based Instruction Web-Based Training Distributed Learning Online Learning Distance Learning

2

2020/10/16

“电子学习、移动学习、混合学习”都是人们 根据媒介及信息传播所依托的技术形式来对学 习进行分类而提出的学习概念。

在1999年,美国的Jay Cross首先使用eLearning这个名词。e-Learning的应用分为企 业与学校两大领域。

电子学习、移动学习、混合学习等概念均来自 于实践,作为一个常用术语目前已经被人们普 遍接受了。

2.学习支持—若员工进行学习时,无论在 技术支持上、学习主题上、行政支持上, 都能获得充分的协助,则接受度较高。

3.学习动机—假如员工认为所学的课程,对 他们而言非常重要,则接受度较高。

20

2020/10/16

ASTD研究中心主任Mark Van Buren 认为“有清楚的证据显示,员工的接 受度与e-Learning推动的方法及背景环 境有关,而与课程设计或e-Learning提 供形式关系不大。”

12

2020/10/16

世界级的大公司主要利用电子学习 进行员工素质培训、岗位培训、新 业务培训、管理培训和企业文化培 训等等。

13

2020/10/16

实践表明:越大的公司,其培训采用数字 学习的比例越高,一万人以上的公司采用 讲师课堂教学的比例降为62%,比平均值 69%还要低七个百分点,而其采用数字学 习的部分高达33%,与教室训练的比例是 一比二了,这也说明了未来企业培训的走 向。

18

2020/10/16

其实,很多人不是不愿尝 试E-Learning,而是害怕 学习过程中的挫折感。

19

2020/10/16

4、员工是否会接受或参与e-Learning,主要与下面三 个关键成功因素有关:

1.组织文化—若企业能在推动e-Learning前, 先大力宣导推广,让员工有充分的心理准 备,则接受度较高。

9

2020/10/16

E-Learning是学习者应用数字媒体学习 的过程,数字媒体包括因特网、企业网 络、计算机、卫星广播、录音带、录像 带、交互式电视及光盘等。

--ASTD(American Society for Training

& Development)

10

2020/10/16

数字化学习(E-learning)目前已经 广泛的应用于远程教育和企业员工培 训中。

21

2020/10/16

5、当前面临的问题

带宽瓶颈的问题是实施电子学习系统最主 要的障碍,多年来一直无法解决。

学习支持服务有待完善:在线辅导往往无 法做到即时解答,这大大降低了学员学习 的积极性,影响了学习效果。

6

2020/10/16

7

/khan

2020/10/16

电子学习的核心

为不同的学习者设计开放、灵活和 分布式学习环境。

8

2020/10/16

广义的E-Learning指的是运用电子技术,以 电视、光盘或互联网为教学媒介的学习方 式。

狭义的电子学习是专指基于互联网教学的 学习方式,它充分利用英特网和局域网技术 所提供的便捷的教学模式和丰富的学习资 源,实现一种全新的学习方式。

从面对面学习到电子学习,从CBT到 E-learning的趋势。

11

2Байду номын сангаас20/10/16

2、E-learning在企业员工培训中的应用

随着电子技术的发展完善和互联网的普及 运用,越来越多的企业将E-Learning运用到 企业的员工培训中;

Forrester Research的研究报告指出,美国 排名前500位的企业投入E-Learning后,其 投资回报率(ROI)是显著的,较传统的教室 训练课程节省30%~60%左右的成本。

16

2020/10/16

3、E-learning实施的现状如何?

即使是企业规定的必修课程,也有31%的 员工不会注册。

若为自由选修课程,有68%的员工不会出 现。

员工中途离课的比例,在50-80%之间。

17

2020/10/16

天下趋势公司对台湾企业作E-Learning 推动状况调查,结果发现“改变员工旧 有习惯”是企业推动E-Learning的最大 障碍,所以若想推动成功,一定要促成 组织文化的变革。

14

2020/10/16

企业将各种业务培训课程制作成通俗易懂 的多媒体互动课件,发布在企业内部电子 学习网站上,员工可以随时随地通过网络 选择并安排培训课程,建立学习小组,参 加在线讨论,向相关业务专家提问,并通 过在线测试检验学习效果。

15

2020/10/16

E-learning使员工都能得到培训机会, 为员工提供个人发展的环境,帮助企 业发现和培养高素质的员工,提高企 业在人才方面的竞争力。

5

2020/10/16

1、什么是E-learning?

电子学习是一种新型的学习方式,它利用 基于各种数字技术的功能特性和资源,结 合利用能适应开放、灵活的分布性学习环 境的其他形式的学习材料,面向处于任何 时间、任何地点和任何人,实现精心设计 的、以学习者为中心的、交互性的、促进 性的学习。

(Badrul Khan,电子学习的设计与评价,北 京师范大学出版社,2005)