K - M e a n s 聚 类 算 法 ( 2 0 2 0 )

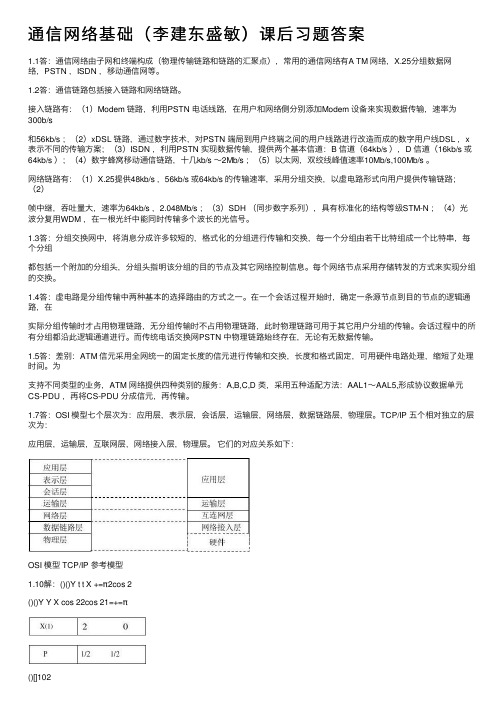

通信网络基础(李建东盛敏)课后习题答案

通信⽹络基础(李建东盛敏)课后习题答案1.1答:通信⽹络由⼦⽹和终端构成(物理传输链路和链路的汇聚点),常⽤的通信⽹络有A TM ⽹络,X.25分组数据⽹络,PSTN ,ISDN ,移动通信⽹等。

1.2答:通信链路包括接⼊链路和⽹络链路。

接⼊链路有:(1)Modem 链路,利⽤PSTN 电话线路,在⽤户和⽹络侧分别添加Modem 设备来实现数据传输,速率为300b/s和56kb/s ;(2)xDSL 链路,通过数字技术,对PSTN 端局到⽤户终端之间的⽤户线路进⾏改造⽽成的数字⽤户线DSL ,x 表⽰不同的传输⽅案;(3)ISDN ,利⽤PSTN 实现数据传输,提供两个基本信道:B 信道(64kb/s ),D 信道(16kb/s 或64kb/s );(4)数字蜂窝移动通信链路,⼗⼏kb/s ~2Mb/s ;(5)以太⽹,双绞线峰值速率10Mb/s,100Mb/s 。

⽹络链路有:(1)X.25提供48kb/s ,56kb/s 或64kb/s 的传输速率,采⽤分组交换,以虚电路形式向⽤户提供传输链路;(2)帧中继,吞吐量⼤,速率为64kb/s ,2.048Mb/s ;(3)SDH (同步数字系列),具有标准化的结构等级STM-N ;(4)光波分复⽤WDM ,在⼀根光纤中能同时传输多个波长的光信号。

1.3答:分组交换⽹中,将消息分成许多较短的,格式化的分组进⾏传输和交换,每⼀个分组由若⼲⽐特组成⼀个⽐特串,每个分组都包括⼀个附加的分组头,分组头指明该分组的⽬的节点及其它⽹络控制信息。

每个⽹络节点采⽤存储转发的⽅式来实现分组的交换。

1.4答:虚电路是分组传输中两种基本的选择路由的⽅式之⼀。

在⼀个会话过程开始时,确定⼀条源节点到⽬的节点的逻辑通路,在实际分组传输时才占⽤物理链路,⽆分组传输时不占⽤物理链路,此时物理链路可⽤于其它⽤户分组的传输。

会话过程中的所有分组都沿此逻辑通道进⾏。

⽽传统电话交换⽹PSTN 中物理链路始终存在,⽆论有⽆数据传输。

模式识别练习题

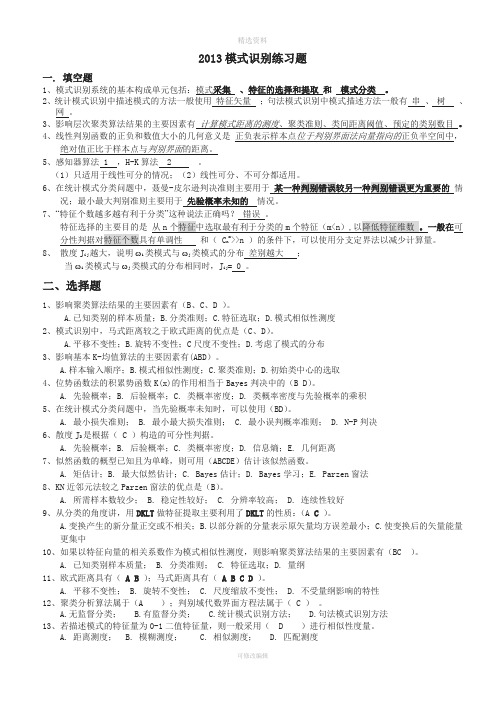

2013模式识别练习题一. 填空题1、模式识别系统的基本构成单元包括:模式采集、特征的选择和提取和模式分类。

2、统计模式识别中描述模式的方法一般使用特征矢量;句法模式识别中模式描述方法一般有串、树、网。

3、影响层次聚类算法结果的主要因素有计算模式距离的测度、聚类准则、类间距离阈值、预定的类别数目。

4、线性判别函数的正负和数值大小的几何意义是正负表示样本点位于判别界面法向量指向的正负半空间中,绝对值正比于样本点与判别界面的距离。

5、感知器算法1 ,H-K算法 2 。

(1)只适用于线性可分的情况;(2)线性可分、不可分都适用。

6、在统计模式分类问题中,聂曼-皮尔逊判决准则主要用于某一种判别错误较另一种判别错误更为重要的情况;最小最大判别准则主要用于先验概率未知的情况。

7、“特征个数越多越有利于分类”这种说法正确吗?错误。

特征选择的主要目的是从n个特征中选取最有利于分类的m个特征(m<n),以降低特征维数。

一般在和(C n m>>n )的条件下,可以使用分支定界法以减少计算量。

8、散度J ij越大,说明ωi类模式与ωj类模式的分布差别越大;当ωi类模式与ωj类模式的分布相同时,J ij= 0。

二、选择题1、影响聚类算法结果的主要因素有(B、C、D )。

A.已知类别的样本质量;B.分类准则;C.特征选取;D.模式相似性测度2、模式识别中,马式距离较之于欧式距离的优点是(C、D)。

A.平移不变性;B.旋转不变性;C尺度不变性;D.考虑了模式的分布3、影响基本K-均值算法的主要因素有(ABD)。

A.样本输入顺序;B.模式相似性测度;C.聚类准则;D.初始类中心的选取4、位势函数法的积累势函数K(x)的作用相当于Bayes判决中的(B D)。

A. 先验概率;B. 后验概率;C. 类概率密度;D. 类概率密度与先验概率的乘积5、在统计模式分类问题中,当先验概率未知时,可以使用(BD )。

A. 最小损失准则;B. 最小最大损失准则;C. 最小误判概率准则;D. N-P 判决6、散度J D 是根据( C )构造的可分性判据。

聚类分析(五)——基于密度的聚类算法OPTICS

聚类分析(五)——基于密度的聚类算法OPTICS 1 什么是OPTICS算法在前⾯介绍的DBSCAN算法中,有两个初始参数E(邻域半径)和minPts(E邻域最⼩点数)需要⽤户⼿动设置输⼊,并且聚类的类簇结果对这两个参数的取值⾮常敏感,不同的取值将产⽣不同的聚类结果,其实这也是⼤多数其他需要初始化参数聚类算法的弊端。

为了克服DBSCAN算法这⼀缺点,提出了OPTICS算法(Ordering Points to identify theclustering structure)。

OPTICS并不显⽰的产⽣结果类簇,⽽是为聚类分析⽣成⼀个增⼴的簇排序(⽐如,以可达距离为纵轴,样本点输出次序为横轴的坐标图),这个排序代表了各样本点基于密度的聚类结构。

它包含的信息等价于从⼀个⼴泛的参数设置所获得的基于密度的聚类,换句话说,从这个排序中可以得到基于任何参数E和minPts的DBSCAN算法的聚类结果。

2 OPTICS两个概念核⼼距离:对象p的核⼼距离是指是p成为核⼼对象的最⼩E’。

如果p不是核⼼对象,那么p的核⼼距离没有任何意义。

可达距离:对象q到对象p的可达距离是指p的核⼼距离和p与q之间欧⼏⾥得距离之间的较⼤值。

如果p不是核⼼对象,p和q之间的可达距离没有意义。

例如:假设邻域半径E=2, minPts=3,存在点A(2,3),B(2,4),C(1,4),D(1,3),E(2,2),F(3,2)点A为核⼼对象,在A的E领域中有点{A,B,C,D,E,F},其中A的核⼼距离为E’=1,因为在点A的E’邻域中有点{A,B,D,E}>3;点F到核⼼对象点A的可达距离为,因为A到F的欧⼏⾥得距离,⼤于点A的核⼼距离1.3 算法描述OPTICS算法额外存储了每个对象的核⼼距离和可达距离。

基于OPTICS产⽣的排序信息来提取类簇。

算法描述如下:算法:OPTICS输⼊:样本集D, 邻域半径E, 给定点在E领域内成为核⼼对象的最⼩领域点数MinPts输出:具有可达距离信息的样本点输出排序⽅法:1 创建两个队列,有序队列和结果队列。

聚合物分子量的测定(精)

计算题 在25℃的θ溶剂中,测得浓度为7.36×10-3g/mL的 聚氯乙烯溶液的渗透压为0.248g/cm2,求此试样的 相对分子质量和第二维里系数A2,并指出所得相对 分子质量是怎样的平均值。

解 θ状态下, 已知

A2 0

1 RT c M

2

0.248g cm c 7.36103 g mL

Kb Tb C c 0 M

T f C

Kf c0 M

应用这种方法应注意:

①分子量在3×104以下,不挥发,不解离 的聚合物 溶剂 ②溶液浓度的单位( g 1000g) Mn ③得到的是数均分子量

实验原理:利用稀溶液的依数性测分子量,间接地测 定溶液的蒸汽压降低来测定溶质的数均分子量。 测 M n同样以一系列浓度C的浓度分别测定 ,

为测定 M方法中,适用分子量广的一种。 n 可以得到 和 1 A2 是绝对方法

问答题 某种聚合物溶解于两种溶剂A和B中,渗透压π和浓 度c的关系如上图所示: (1)当浓度c→0时,从纵轴上的截距能得到什么? (2)从曲线A的初始直线段的斜率能得到什么? (3)B是良溶剂还是劣溶剂?

答案 (1)求得Mn, (2)A2 (3)B为θ溶剂(劣溶剂)

《高 分 子 物 理 》

课程团队:李彩虹 余旺旺 栗娟 苏珺

聚合物分子量的测定

绝对法:依数性方法、散射法、沉降平衡及排除体积色

谱法 等价法:端基分析法(需知道分子结构的信息) 相对法:稀溶液粘度法、体积排除色谱法 测定聚合物分子量的方法很多,不同测定方法所依 据的原理不同,得出的统计平均分子量的意义有所不同, 其适用的分子量范围也不相同。

入射光 r p 散射光 透射光

二组分凝聚系统相图.

T

' c

等压

c'

两相

T/K

453

413

373

Tc

c

0.2 0.4 0.6

单相

0.8 1.0

0

水

质量分数 水-烟碱的溶解度图

烟碱

6.4 二组分凝聚系统相图 一、二组分固态完全不互溶系统液固平衡相图

1. 热分析法

基本原理:二组分系统 C=2,指定压力不变,

f * = C +1 -F =3 -F

F = 1

f f 1 ** f f 2

*

相点 表示某个相状态(如相态、组成、温度等)的 点称为相点。 物系点 相图中表示系统总状态的点称为物系点。在T-x 图上,物系点可以沿着与温度坐标平行的垂线上、 下移动;在水盐相图上,随着含水量的变化,物系 点可沿着与组成坐标平行的直线左右移动。

单相区,物系点与相点重合;两相区中,只有 物系点,它对应的两个相的组成由对应的相点表示

B

3. 全部变为固体Bi后

f * C 1 Φ 1

t /s

温度又可以下降 纯Cd步冷曲线与之相同

Cd-Bi二元相图的绘制

w(Cd) 0.2

的步冷曲线

b

T /K

f* 2

C

D

f * 1

1. 加热到b点,Bi-Cd全部熔化 Φ 1 f * 2 1 Φ 2 温度可以下降,组成也可变 2. 冷至C点,固体Bi开始析出 Φ 2 f * 2 1 Φ 1 温度可以下降 3.D点固体Bi、Cd同时析出

Φ 3

f* 0 温度不能改变 f * 1 4.熔液消失,Bi和Cd共存

f 2 1 Φ 0

*

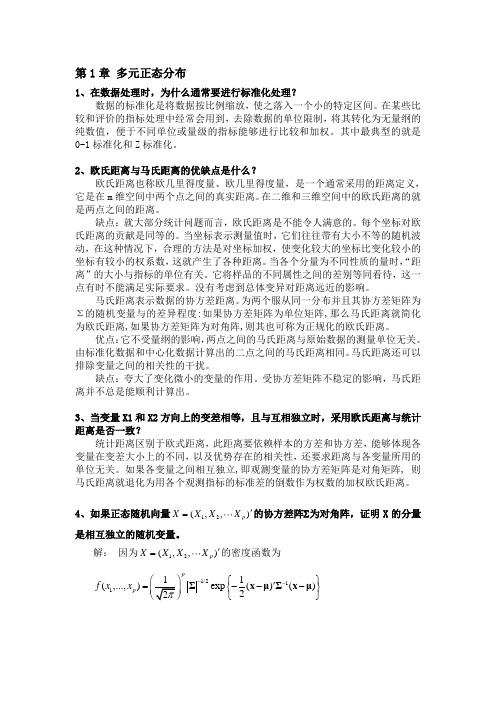

(完整版)多元统计分析课后练习答案

第1章 多元正态分布1、在数据处理时,为什么通常要进行标准化处理?数据的标准化是将数据按比例缩放,使之落入一个小的特定区间。

在某些比较和评价的指标处理中经常会用到,去除数据的单位限制,将其转化为无量纲的纯数值,便于不同单位或量级的指标能够进行比较和加权。

其中最典型的就是0-1标准化和Z 标准化。

2、欧氏距离与马氏距离的优缺点是什么?欧氏距离也称欧几里得度量、欧几里得度量,是一个通常采用的距离定义,它是在m 维空间中两个点之间的真实距离。

在二维和三维空间中的欧氏距离的就是两点之间的距离。

缺点:就大部分统计问题而言,欧氏距离是不能令人满意的。

每个坐标对欧氏距离的贡献是同等的。

当坐标表示测量值时,它们往往带有大小不等的随机波动,在这种情况下,合理的方法是对坐标加权,使变化较大的坐标比变化较小的坐标有较小的权系数,这就产生了各种距离。

当各个分量为不同性质的量时,“距离”的大小与指标的单位有关。

它将样品的不同属性之间的差别等同看待,这一点有时不能满足实际要求。

没有考虑到总体变异对距离远近的影响。

马氏距离表示数据的协方差距离。

为两个服从同一分布并且其协方差矩阵为Σ的随机变量与的差异程度:如果协方差矩阵为单位矩阵,那么马氏距离就简化为欧氏距离,如果协方差矩阵为对角阵,则其也可称为正规化的欧氏距离。

优点:它不受量纲的影响,两点之间的马氏距离与原始数据的测量单位无关。

由标准化数据和中心化数据计算出的二点之间的马氏距离相同。

马氏距离还可以排除变量之间的相关性的干扰。

缺点:夸大了变化微小的变量的作用。

受协方差矩阵不稳定的影响,马氏距离并不总是能顺利计算出。

3、当变量X1和X2方向上的变差相等,且与互相独立时,采用欧氏距离与统计距离是否一致?统计距离区别于欧式距离,此距离要依赖样本的方差和协方差,能够体现各变量在变差大小上的不同,以及优势存在的相关性,还要求距离与各变量所用的单位无关。

如果各变量之间相互独立,即观测变量的协方差矩阵是对角矩阵, 则马氏距离就退化为用各个观测指标的标准差的倒数作为权数的加权欧氏距离。

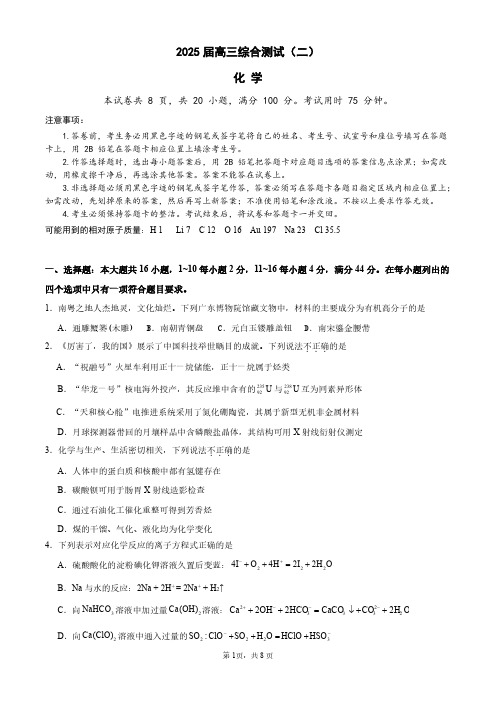

广东省华南师范大学附属中学2024-2025学年高三上学期11月综合测试(二)化学含答案

2025届高三综合测试(二)化学本试卷共8页,共20小题,满分100分。

考试用时75分钟。

注意事项:1.答卷前,考生务必用黑色字迹的钢笔或签字笔将自己的姓名、考生号、试室号和座位号填写在答题卡上,用2B 铅笔在答题卡相应位置上填涂考生号。

2.作答选择题时,选出每小题答案后,用2B 铅笔把答题卡对应题目选项的答案信息点涂黑;如需改动,用橡皮擦干净后,再选涂其他答案。

答案不能答在试卷上。

3.非选择题必须用黑色字迹的钢笔或签字笔作答,答案必须写在答题卡各题目指定区域内相应位置上;如需改动,先划掉原来的答案,然后再写上新答案;不准使用铅笔和涂改液。

不按以上要求作答无效。

4.考生必须保持答题卡的整洁。

考试结束后,将试卷和答题卡一并交回。

可能用到的相对原子质量:H 1Li 7C 12O 16Au 197Na 23Cl 35.5一、选择题:本大题共16小题,1~10每小题2分,11~16每小题4分,满分44分。

在每小题列出的四个选项中只有一项符合题目要求。

1.南粤之地人杰地灵,文化灿烂。

下列广东博物院馆藏文物中,材料的主要成分为有机高分子的是A .通雕蟹篓(木雕)B.南朝青铜盘C.元白玉镂雕盖钮D.南宋鎏金腰带2.《厉害了,我的国》展示了中国科技举世瞩目的成就。

下列说法不正确...的是A .“祝融号”火星车利用正十一烷储能,正十一烷属于烃类B .“华龙一号”核电海外投产,其反应堆中含有的23592U 与23892U 互为同素异形体C .“天和核心舱”电推进系统采用了氮化硼陶瓷,其属于新型无机非金属材料D .月球探测器带回的月壤样品中含磷酸盐晶体,其结构可用X 射线衍射仪测定3.化学与生产、生活密切相关,下列说法不正确...的是A .人体中的蛋白质和核酸中都有氢键存在B .碳酸钡可用于肠胃X 射线造影检查C .通过石油化工催化重整可得到芳香烃D .煤的干馏、气化、液化均为化学变化4.下列表示对应化学反应的离子方程式正确的是A .硫酸酸化的淀粉碘化钾溶液久置后变蓝:2224I O 4H 2I 2H O-+++=+B .Na 与水的反应:2Na +2H +=2Na ++H 2↑C .向3NaHCO 溶液中加过量2Ca(OH)溶液:223332Ca 2OH 2HCO CaCO CO 2H O +---++=↓++D .向2Ca(ClO)溶液中通入过量的2223SO :ClO SO H O HClO HSO --++=+5.电化学原理在生产生活中的用途十分广泛,下列说法正确的是A.钢铁发生电化学腐蚀时,铁失去电子生成3FeB.铅蓄电池在放电时,正极与负极质量均增加C.利用外加电流法保护闸门时,闸门与电源正极相连D.氯碱工业中电解饱和食盐水,选用阴离子交换膜6.某实验小组设计粗苯甲酸(含有少量NaCl和泥沙)的提纯方案如下。

美国ASME与TEMA标准管板计算方法比较(一)

S t A一 i 1 e iA ei c n D . p d A一1同时,OA o v A nx , p CD P

( 章) C 及欧共体标准(P Dsn 一 ls 7 UV i Pt Cu eg a ae r

1) 3也采用该方法。在 20 年, 3 02 这 个标准正式发

u日 餐S

() 2

布了 该计算方法, 这也是后来 AM S tn珊- S E i eo c

式中,一无因次量, C 圆板周边支承系数;

D . H 一2 基础, i1 v 中U X 1章的 . 更为详细的 资料参见

FOwi r 0) . l (02 发表的有关文章“CV 20 se e 2 IPT 2 0

Vnovr 1" acue R v 。 e 1

F V准规范

石油化工设计 Ptce i l e g eohmc Ds r a i n

20 ,1 ) 1 2 042( 2 一 6 4

编者按: 美国AM 和TM S E E A标准是国际上最具影响力的两大压力容器标准, 其中都有关于换热器管板等的设计方法。该

两标准在国内 外石化、 化工装置设计中 得到日 益广泛的应用。为此了解、 比较该两标准的理论基础及其差异对做好 国际、 国内 压力容器设计都显得十分重要。

宽度计算得到(SE AM 中的管板的 孔桥带效率产 ’

是基于最小的孔桥宽度计算得到的, 因而该值较

题。Gr e在 1 9 an d r 9 年时曾推荐过该值, 6 并被欧洲 的 一些国家标准采纳(S50C DP , B50, A )并运用了 O

近2 年。经圆平板极限载荷分析的修正, 0 对于简

TM 中, 最小值为0 2三角形排管) 的 EA .( 4 及

有关内 综合考虑了以 容, 下4 条: 1 管板开孔部分简化为当量均质的平板, ) 有

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

K-Means聚类进行图像处理实战在K-Means聚类算法原理中,我们对K-Means的原理做了总结,本文我们就来讨论用scikit-learn来学习K-Means聚类。

重点讲述如何选择合适的k值。

1. 【给力恋爱教-程】K-Means类概述在scikit-learn中,包括两个K-Means的算法,一个是传统的K-Means 算法,【Q】对应的类是KMeans。

另一个是基于采样的Mini Batch K-Means 算法,对【⒈】应的类是MiniBatchKMeans。

一般来说,使用K-Means的算法调参【0】是比较简单的。

用KM【1】eans类的话,一般要注意的仅仅就是k值的选择,即参数n_c【6】lusters;如果是用MiniBatchKMeans的话,也仅仅多了需要注意调参的【⒐】参数batch_size,即我们的Mini Batch的大小。

当然K【5】Means类和MiniBatchKMeans类可以选择的参数还有不少,但是大多【2】不需要怎么去调参。

下面我们就看看KMeans类和Min【б】iBatchKMeans类的一些主要参数。

2. KMeans类主要参数KMeans类的主要参数有:1) n_clusters: 即我们的k值,一般需要多试一些值以获得较好的聚类效果。

k值好坏的评估标准在下面会讲。

2)max_iter:最大的迭代次数,一般如果是凸数据集的话可以不管这个值,如果数据集不是凸的,可能很难收敛,此时可以指定最大的迭代次数让算法可以及时退出循环。

3)n_init:用不同的初始化质心运行算法的次数。

由于K-Means是结果受初始值影响的局部最优的迭代算法,因此需要多跑几次以选择一个较好的聚类效果,默认是10,一般不需要改。

如果你的k值较大,则可以适当增大这个值。

4)init:即初始值选择的方式,可以为完全随机选择’random’,优化过的’k-means++‘或者自己指定初始化的k个质心。

一般建议使用默认的’k-means++’。

5)algorithm:有“auto”, “full” or “elkan”三种选择。

“full"就是我们传统的K-Means算法,“elkan”是我们原理篇讲的elkan K-Means算法。

默认的"auto"则会根据数据值是否是稀疏的,来决定如何选择"full"和“elkan”。

一般数据是稠密的,那么就是“elkan”,否则就是"full”。

一般来说建议直接用默认的"auto"3. MiniBatchKMeans类主要参数MiniBatchKMeans类的主要参数比KMeans类稍多,主要有:1) n_clusters: 即我们的k值,和KMeans类的n_clusters意义一样。

2)max_iter:最大的迭代次数,和KMeans类的max_iter意义一样。

3)n_init:用不同的初始化质心运行算法的次数。

这里和KMeans类意义稍有不同,KMeans类里的n_init是用同样的训练集数据来跑不同的初始化质心从而运行算法。

而MiniBatchKMeans类的n_init则是每次用不一样的采样数据集来跑不同的初始化质心运行算法。

4)batch_size:即用来跑Mini Batch KMeans算法的采样集的大小,默认是100.如果发现数据集的类别较多或者噪音点较多,需要增加这个值以达到较好的聚类效果。

5)init:即初始值选择的方式,和KMeans类的init意义一样。

6)init_size: 用来做质心初始值候选的样本个数,默认是batch_size 的3倍,一般用默认值就可以了。

7)reassignment_ratio: 某个类别质心被重新赋值的最大次数比例,这个和max_iter一样是为了控制算法运行时间的。

这个比例是占样本总数的比例,乘以样本总数就得到了每个类别质心可以重新赋值的次数。

如果取值较高的话算法收敛时间可能会增加,尤其是那些暂时拥有样本数较少的质心。

默认是0.01。

如果数据量不是超大的话,比如1w以下,建议使用默认值。

如果数据量超过1w,类别又比较多,可能需要适当减少这个比例值。

具体要根据训练集来决定。

8)max_no_improvement:即连续多少个Mini Batch没有改善聚类效果的话,就停止算法,和reassignment_ratio, max_iter一样是为了控制算法运行时间的。

默认是10.一般用默认值就足够了。

4. K值的评估标准不像监督学习的分类问题和回归问题,我们的无监督聚类没有样本输出,也就没有比较直接的聚类评估方法。

但是我们可以从簇内的稠密程度和簇间的离散程度来评估聚类的效果。

常见的方法有轮廓系数Silhouette Coefficient和Calinski-Harabasz Index。

个人比较喜欢Calinski-Harabasz Index,这个计算简单直接,得到的Calinski-Harabasz分数值s越大则聚类效果越好。

Calinski-Harabasz分数值s的数学计算公式是:s(k)=tr(Bk)tr(Wk)m?kk?1其中m为训练集样本数,k为类别数。

Bk为类别之间的协方差矩阵,Wk为类别内部数据的协方差矩阵。

tr为矩阵的迹。

也就是说,类别内部数据的协方差越小越好,类别之间的协方差越大越好,这样的Calinski-Harabasz分数会高。

在scikit-learn中,Calinski-Harabasz Index对应的方法是metrics.calinski_harabaz_score.5. K-Means应用实例这里我们用K-Means聚类对图像进行压缩处理首先导入包from PIL import Imageimport numpy as npfrom sklearn.cluster import KMeansimport matplotlibimport matplotlib.pyplot as plt读取文件,由于图片的像素太多,这里随机抽取1000个样本进行训练 num_vq = 50 #设置要聚类的个数im = Image.open('16.lena.png') # 16.son.bmp(100)-16.flower2.png(200)-16.son.png(60)-16.lena.png( 50)image = np.array(im).astype(np.float) - 255image = image[:, :, :3] # 变成3通道image_v = image.reshape((-1, 3))model = KMeans(num_vq)show_scatter(image_v) #自定义的画三维立体图函数N = image_v.shape[0] # 图像像素总数# 选择足够多的样本(如1000个),计算聚类中心#print(N)idx = np.random.randint(0, N, size=1000)image_sample = image_v[idx]#print(image_sample)model.fit(image_sample)c = model.predict(image_v) # 聚类结果print( '聚类结果:', c)print ('聚类中心:', model.cluster_centers_)画图,这里的restore_image函数是自定义的将聚类后的结果组合成图片显示plt.figure(figsize=(15, 8), facecolor='w')plt.subplot(121)plt.axis('off')plt.title(u'原始图片', fontsize=18)plt.imshow(image)# plt.savefig('1.png')plt.subplot(122)vq_image = restore_image(model.cluster_centers_, c, image.shape) # 恢复图像plt.axis('off')plt.title(u'矢量量化后图片:%d色' % num_vq, fontsize=18) plt.imshow(vq_image)# plt.savefig('2.png')plt.tight_layout(1.2)plt.show()def restore_image(cb, cluster, shape):row, col, dummy = shapeimage = np.empty((row, col, 3))for r in range(row):for c in range(col):image[r, c] = cb[cluster[index]]index += 1return imagedef show_scatter(a):print( '原始数据:', a)density, edges = np.histogramdd(a, bins=[N,N,N], range=[(0,1), (0,1), (0,1)])density -= density.max()x = y = z = np.arange(N)d = np.meshgrid(x, y, z)fig = plt.figure(1, facecolor='w')ax = fig.add_subplot(111, projection='3d')ax.scatter(d[1], d[0], d[2], c='r', s=100*density, marker='o', depthshade=True)ax.set_xlabel(u'红色分量')ax.set_ylabel(u'绿色分量')ax.set_zlabel(u'蓝色分量')plt.title(u'图像颜色三维频数分布', fontsize=20)plt.figure(2, facecolor='w')den = density[density 0]den = np.sort(den)[::-1]t = np.arange(len(den))plt.plot(t, den, 'r-', t, den, 'go', lw=2)plt.title(u'图像颜色频数分布', fontsize=18)plt.grid(True)plt.show()filename = 'scaledfaithful.txt';(2)从图中可以看出, K值从1到5时,畸变程度变化最大。