决策树学习,机器学习

机器学习--决策树算法(ID3C4.5)

机器学习--决策树算法(ID3C4.5)在⽣活中,“树”这⼀模型有很⼴泛的应⽤,事实证明,它在机器学习分类和回归领域也有着深刻⽽⼴泛的影响。

在决策分析中,决策树可以明确直观的展现出决策结果和决策过程。

如名所⽰,它使⽤树状决策模型。

它不仅仅是在数据挖掘中⽤户获取特定⽬标解的策略,同时也被⼴泛的应⽤于机器学习。

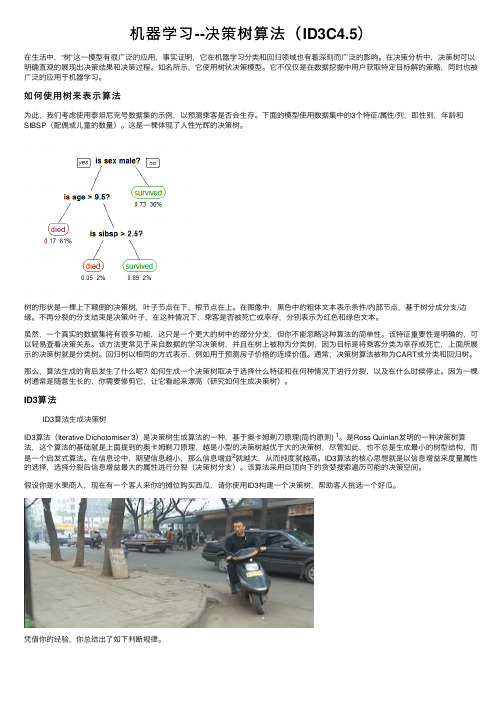

如何使⽤树来表⽰算法为此,我们考虑使⽤泰坦尼克号数据集的⽰例,以预测乘客是否会⽣存。

下⾯的模型使⽤数据集中的3个特征/属性/列,即性别,年龄和SIBSP(配偶或⼉童的数量)。

这是⼀棵体现了⼈性光辉的决策树。

树的形状是⼀棵上下颠倒的决策树,叶⼦节点在下,根节点在上。

在图像中,⿊⾊中的粗体⽂本表⽰条件/内部节点,基于树分成分⽀/边缘。

不再分裂的分⽀结束是决策/叶⼦,在这种情况下,乘客是否被死亡或幸存,分别表⽰为红⾊和绿⾊⽂本。

虽然,⼀个真实的数据集将有很多功能,这只是⼀个更⼤的树中的部分分⽀,但你不能忽略这种算法的简单性。

该特征重要性是明确的,可以轻易查看决策关系。

该⽅法更常见于来⾃数据的学习决策树,并且在树上被称为分类树,因为⽬标是将乘客分类为幸存或死亡,上⾯所展⽰的决策树就是分类树。

回归树以相同的⽅式表⽰,例如⽤于预测房⼦价格的连续价值。

通常,决策树算法被称为CART或分类和回归树。

那么,算法⽣成的背后发⽣了什么呢?如何⽣成⼀个决策树取决于选择什么特征和在何种情况下进⾏分裂,以及在什么时候停⽌。

因为⼀棵树通常是随意⽣长的,你需要修剪它,让它看起来漂亮(研究如何⽣成决策树)。

ID3算法ID3算法⽣成决策树ID3算法(Iterative Dichotomiser 3)是决策树⽣成算法的⼀种,基于奥卡姆剃⼑原理(简约原则) 1。

是Ross Quinlan发明的⼀种决策树算法,这个算法的基础就是上⾯提到的奥卡姆剃⼑原理,越是⼩型的决策树越优于⼤的决策树,尽管如此,也不总是⽣成最⼩的树型结构,⽽是⼀个启发式算法。

了解机器学习中的随机森林算法和决策树模型

了解机器学习中的随机森林算法和决策树模型一、介绍机器学习中的随机森林算法和决策树模型是常用的监督学习方法,被广泛应用于分类和回归问题。

本文将详细介绍这两个模型的原理以及它们在机器学习中的应用。

二、决策树模型1. 原理决策树是通过一系列的判断条件对数据进行分类或预测的模型。

其原理是基于对样本特征属性进行分割,直至得到能够完全分开不同类别的叶节点。

决策树模型具有易于理解、可解释性强等优点,适用于处理有离散特征和连续特征的数据集。

2. 构建过程决策树模型构建过程包括选择最佳划分属性、生成子节点以及递归构建子树等步骤。

通过计算划分属性的信息增益或其他指标,选择最佳属性作为当前节点的分裂条件。

然后将数据集按照该属性值进行划分,并递归地生成子节点,直到满足停止条件(如达到叶节点或深度限制)为止。

3. 应用领域决策树模型在多个领域都能得到广泛应用。

例如,在医学领域,可以利用决策树模型对患者的症状和各种检测指标进行分类,以辅助医生做出诊断决策。

在金融领域,可以通过构建决策树模型进行信用评分,帮助银行判断借款人的还款能力。

三、随机森林算法随机森林是一种基于集成学习思想的算法,它由多个决策树组成。

它通过对原始数据集进行有放回抽样(bootstrap)得到多个样本子集,并利用这些子集构建不同的决策树。

最后通过投票或平均等方式综合各决策树的结果来做出最终预测。

随机森林算法能够处理高维度数据和离群点,并且不容易过拟合。

2. 构建过程随机森林算法包括两个重要步骤:创建随机子集和构建决策树。

创建随机子集时,首先从原始数据集中进行有放回抽样得到训练集,然后再从每个特征子集中选择最佳划分属性。

构建决策树的过程与决策树模型相似,但在节点划分时只考虑随机子集中的一部分特征。

3. 应用领域随机森林算法被广泛用于文本分类、图像识别、推荐系统等领域。

在文本分类中,可以利用随机森林对文章或评论进行情感分析,帮助企业了解用户对其产品的态度。

在推荐系统中,可以利用随机森林对用户的历史行为进行分析,并给出个性化的推荐结果。

请介绍至少四种典型的机器学习和数据挖掘算法

请介绍至少四种典型的机器学习和数据挖掘算法

1. 决策树:决策树是最常见的机器学习算法之一,是一种将数据(此

处即有关问题的观察和测量数据)映射到潜在结果(由结论和动作组成)的分类方法。

它通常适用于复杂的问题,可以自动分析和分类数据,从而有助于解决现实世界中的挑战性问题。

2. 聚类分析:聚类分析是一种机器学习和数据挖掘算法,它使用输入

数据创建一组相似元素的分组,并将不相似元素分为不同组。

它是一

种无监督学习,无需有任何先验知识,可以自动分析出模式和结构。

3. 线性回归:线性回归是机器学习中最重要的算法之一,它旨在为某

个变量或结果预测另一个变量或结果的值。

它允许我们预测和解释现

实世界中的客观观察。

通过线性回归,可以找到数据变量之间的关系,并应用该关系预测另一变量的值。

4. 支持向量机:支持向量机(SVM)是一种机器学习技术,它可以用

来解决分类和回归问题。

它不同于传统的感知机技术,能够解决非线

性问题。

它可以用来构建分类器,识别明确的目标和特征,通过拟合

相关性分析,以对不同的对象实行有效的分类。

机器学习决策树算法ID3

机器学习决策树算法ID3决策树是一种重要的机器学习算法,它能够处理分类和回归的问题,并且易于理解和解释。

其中,ID3(Iterative Dichotomiser 3)算法是决策树学习中最简单和最流行的一种算法,本文将介绍ID3算法的基本原理和实现过程。

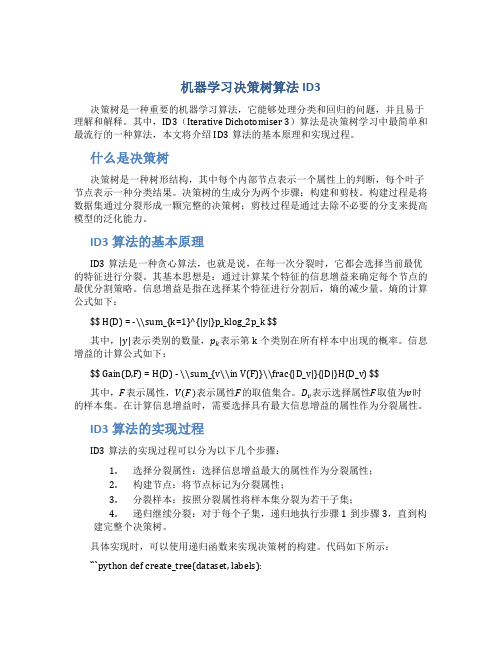

什么是决策树决策树是一种树形结构,其中每个内部节点表示一个属性上的判断,每个叶子节点表示一种分类结果。

决策树的生成分为两个步骤:构建和剪枝。

构建过程是将数据集通过分裂形成一颗完整的决策树;剪枝过程是通过去除不必要的分支来提高模型的泛化能力。

ID3算法的基本原理ID3算法是一种贪心算法,也就是说,在每一次分裂时,它都会选择当前最优的特征进行分裂。

其基本思想是:通过计算某个特征的信息增益来确定每个节点的最优分割策略。

信息增益是指在选择某个特征进行分割后,熵的减少量。

熵的计算公式如下:$$ H(D) = -\\sum_{k=1}^{|y|}p_klog_2p_k $$其中,|y|表示类别的数量,p k表示第k个类别在所有样本中出现的概率。

信息增益的计算公式如下:$$ Gain(D,F) = H(D) - \\sum_{v\\in V(F)}\\frac{|D_v|}{|D|}H(D_v) $$其中,F表示属性,V(F)表示属性F的取值集合。

D v表示选择属性F取值为v时的样本集。

在计算信息增益时,需要选择具有最大信息增益的属性作为分裂属性。

ID3算法的实现过程ID3算法的实现过程可以分为以下几个步骤:1.选择分裂属性:选择信息增益最大的属性作为分裂属性;2.构建节点:将节点标记为分裂属性;3.分裂样本:按照分裂属性将样本集分裂为若干子集;4.递归继续分裂:对于每个子集,递归地执行步骤1到步骤3,直到构建完整个决策树。

具体实现时,可以使用递归函数来实现决策树的构建。

代码如下所示:```python def create_tree(dataset, labels):。

机器学习及其相关算法简介

机器学习及其相关算法简介机器学习是一种让计算机可以从数据中学习并改善性能的技术。

它可以帮助计算机自动完成某些任务,如图像识别、语音识别、自然语言处理等。

在机器学习中,有许多不同的算法用于处理不同类型的数据和问题。

本文将简要介绍一些常见的机器学习算法及其原理和应用。

一、监督学习算法监督学习是一种机器学习的方法,在这种方法中,我们提供给算法一组有标签的训练数据,然后让算法从中学习规律,以便在未来的数据中做出预测。

常见的监督学习算法包括线性回归、逻辑回归、决策树、支持向量机等。

1. 线性回归(Linear Regression)线性回归是一种用于预测连续型数据的监督学习算法。

它建立了自变量和因变量之间的线性关系,并可以用于预测未来的数值。

线性回归的应用范围非常广泛,包括经济学、工程学、医学等各个领域。

逻辑回归是一种用于预测二分类问题的监督学习算法。

它通过将线性方程的输出映射到一个概率范围内,来预测数据点所属的类别。

逻辑回归在医学诊断、市场营销、风险管理等领域有着广泛的应用。

3. 决策树(Decision Tree)决策树是一种用于分类和回归问题的监督学习算法。

它通过构建一个树状结构来表示数据的特征和类别之间的关系。

决策树可以帮助我们理解数据,并且在解释性和可解释性上有着很大的优势。

4. 支持向量机(Support Vector Machine)支持向量机是一种用于分类和回归问题的监督学习算法。

它通过将数据映射到一个高维空间来寻找一个最优的超平面,以实现分类或回归的目的。

支持向量机在文本分类、图像识别等领域有着广泛的应用。

1. K均值聚类(K-means Clustering)K均值聚类是一种用于将数据点分成不同组的无监督学习算法。

它通过迭代的方式找到使得组内数据点相似度最高,组间数据点相似度最低的聚类中心。

K均值聚类在市场分析、图像分割等领域有着广泛的应用。

2. 主成分分析(Principal Component Analysis)主成分分析是一种用于降维的无监督学习算法。

《机器学习(周志华)》笔记--决策树(1)--决策树模型、决策树简史、基本流程

《机器学习(周志华)》笔记--决策树(1)--决策树模型、决策树简史、基本流程⼀、决策树模型 决策树(decision tree)是⼀种常⽤的机器学习⽅法,是⼀种描述对实例进⾏分类的树形结构。

决策树是⼀种常⽤的机器学习⽅法,以⼆分类为例,假设现在我们要对是否买西⽠进⾏判断和决策,我们会问⼀些问题,根据回答,我们决断是买还是不买,或者还拿补丁主意,这时会继续问问题,直到可以确定为⽌。

决策树基于“树”结构进⾏决策: (1)内部结点:属性 (2)分⽀:属性值 (3)p叶结点:分类结果 学习过程:通过对训练样本的分析来确定“划分属性”(即内部结点所对应的属性) 预测过程:将测试⽰例从根结点开始,沿着划分属性所构成的“判定测试序列”下⾏,直到叶结点 学习的过程就是通过划分属性构建决策树的过程,预测过程就是将测试样本从根节点开始,沿着划分属性构成的“判定序列”下⾏,直到叶结点。

结构举例: 从代码⾓度来看,决策树其实可以看成是⼀堆if-else语句的集合,例如引例中的决策树完全可以看成是如下代码:if isRed:if isCold:if hasSeed:print("buy")else:print("don't buy")else:if isCheap:print("buy")else:print("don't buy")else:print("don't buy") 由决策树的根结点(root node)到叶结点(leaf node)的每⼀条路径构建⼀条规则:路径上内部结点的特征对应着规则的条件,⽽叶结点的类对应着规则的结论。

决策树的路径或其对应的if-then规则集合具有⼀个重要的性质:互斥并且完备。

这就是说,每⼀个实例都被⼀条路径或⼀条规则所覆盖,⽽且只被⼀条路径或⼀条规则所覆盖。

机器学习中的决策树原理及应用

机器学习中的决策树原理及应用近年来,随着机器学习相关技术的发展,决策树成为了非常重要的一种分类算法。

在机器学习过程中,决策树算法常用于进行数据分类和预测分析。

本文将详细介绍决策树的原理及其在机器学习中的应用。

一、决策树原理决策树是一种基于树形结构的分类算法,通常被用于解决分类和回归问题等。

决策树的节点可以是分类属性或连续属性,通过对属性的不断划分来达到分类的目的。

决策树的节点可以用于描述待分类对象的特征,叶节点则代表分类的结果。

决策树的构建可以通过使用自顶向下或自底向上方法进行。

(一)自顶向下方法自顶向下方法是常用的构建决策树的方法。

具体步骤如下:1.将所有的训练数据都放到根节点上。

2.按照某个特征属性进行节点的划分,排除不利于分类的属性。

3.将根节点按照特征属性划分为子节点,同时向下递归地进行节点分类,直到满足分类要求为止。

4.对于每一个子节点,重复步骤2和3,直到树的叶子节点全部为单一分类。

(二)自底向上方法自底向上方法又称为升级方法,其基本步骤如下:1.将所有的训练数据都放到叶子节点上。

2.通过合并相似的叶节点来完成树的逐步升级。

3.设定分类错误率的阈值,判断是否满足分类的条件,若不满足则继续合并叶节点。

二、决策树的应用决策树算法具有能力处理离散的和连续的特征,同时能够处理多分类和二分类问题,可以应用于多种分类场景,例如医学、经济和环境等领域。

以下是决策树在应用中的主要场景:(一)医学领域决策树在医学领域中被广泛应用。

例如,医生可以使用决策树来评估患者的风险因素,决定患者是否需要进一步诊断和治疗。

此外,决策树还可以用于辅助医生进行药物治疗,从而避免患者对药物的不良反应。

(二)经济领域决策树在经济领域中也是非常重要的分类算法。

例如,银行可以使用决策树来判断借款人的信用风险,从而决定是否给予贷款。

此外,决策树还可以用于预测股票价格的波动趋势,为投资者提供决策的参考。

(三)环境领域决策树在环境领域中也具有广泛的应用,例如用于预测气候变化和环境污染等。

机器学习的常见模型

机器学习的常见模型机器学习任务中常见的⽅法有:决策树学习,关联规则学习,⼈⼯神经⽹络,深度学习,归纳逻辑设计,⽀持向量机,聚类,贝叶斯⽹络,强化学习,表⽰学习,相似度和度量学习,稀疏字典学习,遗传算法等。

⼀、决策树学习决策树学习就是根据数据的属性采⽤树状结构建⽴的⼀种决策模型,可以⽤此模型解决分类和回归问题。

常见的算法包括CART,ID3,C4.5等。

可以根据数据集来构建⼀颗决策树,他的重要任务就是根据数据中所蕴含的知识信息并提取出⼀系列的规则,这些规则就是树结构的创建过程。

决策树算法主要是指决策树进⾏创建中进⾏树分裂(划分数据集)的时候选取最优特征的算法,他的主要⽬的就是要选取⼀个特征能够将分开的数据集尽量的规整,也就是尽可能的纯。

最⼤的原则就是:将⽆序的数据变得更加有序。

常⽤的三个⽅法:信息增益增益⽐率基尼不纯度1、信息增益这⾥涉及到了信息论的⼀些概念:某个时间的信息量,信息熵,信息增益等。

a、某事件的信息量:这个事件发⽣的概率的负对数b、信息熵就是平均⽽⾔,⼀个事件发⽣得到的信息量⼤⼩,也就是信息量的期望值c、信息增益将⼀组数据集进⾏划分后,数据的信息熵会发⽣变化,我们可以通过使⽤信息熵的计算公式分别计算被划分的⼦数据集的信息熵并计算他们的平均值(期望值)来作为分割后的数据集的信息熵。

新的信息熵相⽐未划分数据的信息熵的减⼩值就是信息增益了。

假设我们将数据集D划分成k份D1,D2,...,Dk,则划分后的信息熵为:信息增益就是就两个信息熵的差值2、增益⽐率增益⽐率是信息增益⽅法的⼀种扩展,是为了克服信息增益带来的弱泛化的缺陷。

因为按照信息增益的选择,总是会倾向于选择分⽀多的属性,这样会使得每个⼦集的信息熵最⼩。

例如给每个数据添加独⼀⽆⼆的ID值特征,则按照这个ID值进⾏分类是获得信息增益最⼤的,这样每个⾃⼰中的信息熵都是0,但是这样的分类没有任何意义,没有任何泛化能⼒,类似于过拟合。

因此可以引⼊⼀个分裂信息找到⼀个更合适的衡量数据划分的标准,即增益⽐率。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

决策树的生长

贪婪搜索(greedy search) 选定作为测试的属性:分类能力最好的属 性被选作树的根节点的测试; 为根节点的属性的每个可能值产生一个Байду номын сангаас 支(离散情况),并依属性值划分样例;

重复该过程,用每个节点上的关联样例选 取该节点上的最佳测试属性。

22

关于决策树的修剪

针对过度拟合的情况: • 及早停止树的增长(直接,但难以衡量合适应停 止树的生长) • 后修剪法(post-pruning)—训练和验证集法 (training and validation set) 错误率降低修剪(reduced-error pruning)— 删除以某节点为根节点的子树,将和该节点相关 联训练样例的最常见分类赋给它。考查修剪后在 验证集上的精度。 规则后修剪(rule post-pruning)—将决策树转 化为等价的规则集合(区分决策节点使用的上下文 不同),删除不会导致估计精度下降的前件 (precondiction). 23

类样例的概率为

freq (C j ,T ) T

Cj

。

b) 可传达的信息为: log bits。

f req (C j ,T )

2

T

9

ID3: Gain Criterion(3)

c) 则 T 的熵为

info (T )

k

若样本集中所有成员属 于同一类,则熵为0

log

freq (C j ,T ) T

第二讲 机器学习的方法

第三章 决策树学习

1

3.2 决策树表示法

决策树的基本结构

N1 N2 N4 N5 N6

Internal node Leaf node

N3 N7

L1

L2

L3

L4

L5

L6

L7

L8

2

3.3 决策树学习的适用问题

• 实例由“属性-值”对(pair)表示 • 目标函数具有离散的输出值 • 可能需要析取的描述(disjunctive description) • 训练数据可以包含错误 (DT具有一定的鲁 棒性) • 训练数据可以包含缺少属性值的实例

gain ( X

H u mid it y

) 0 . 151

gain ( X Win d ) 0 . 048

gain ( X T e m p e r a t u r e ) 0 . 029

15

ID3: Gain Criterion(6)

f) 另外一种不期望的情况也会产生,那就是当测 试

X将样本集

Temperature Humidity Wind

Hot Hot Mild Cool Cool Mild High High High High Normal Normal Normal High Weak Strong Weak Weak Weak Strong Strong Weak

PlayTennis

此时信息增益达到最大值:

gain ( X ) info (T )

信息增益反映的是与分类相关的信息--随着 划分更符合目标分布情况而增长。

13

表3-2 目标概念PlayTennis的训练样例

gain

Gain ratio

Day D1 D2 D3 D4 D5 D6 D7 D8

Outlook

Sunny Sunny Rain Rain Rain Sunny

例: 若样本集被属性A彻底分割,则分裂信息 值为log2n。若属性B将样本集平分为两半, 则分裂信息为1。若属性A和B产生同样的 信息增益,那么B的信息增益率更高。

18

C4.5: Gain Ratio Criterion(2)

c) 当测试完全符合样本的分布时:

split _ info ( X ) info (T ) gain ( X )

表3-2

gain _ ratio ( X T e mp e r a t u r e ) 0 . 029

20

增益率的局限

• 当某个 T i 接近 T ( |T i | |T | )时分母可能为 0或非常小。 即若某个属性对于 T 的所有样例有几乎同样 的值,将导致增益比率未定义或增益比率 非常大。 • 解决的方法: 可以先计算每个属性的增益, 然后仅对那些增益高过平均值的属性应用 增益比率测试(Quinlan 1986)

7

ID3: Gain Criterion(1)

假设&条件: 样本集 T, 包含 k 类样本: C j , j 1,..., k 表示 T 中第 C j 类样例 的数目, |T | 表示 T 中包含的样本总数。

freq (C j ,T )

,

8

ID3: Gain Criterion(2)

a) 从样本中随机抽取一个样例 ,属于

gain _ ratio ( X

o u t lo o k

) gain ( X 0 . 156

o u t lo o k

) / split _ info ( X

o u t lo o k

)

gain _ ratio ( X

H u mid it y

) 0 . 151

gain _ ratio ( X Win d ) 0 . 049

inf o

X

(T )

n

Ti T

inf o (T i )

i 1

则 T 在测试 X 的划分下得到的信息增益为:

gain ( X ) info (T ) info X (T )

12

ID3: Gain Criterion(5)

e) 当测试 X 将 T 完全分类正确时,

info (T i ) 0

3

3.4 基本的决策树学习算法(1)

• 原型:concept learning systems(CLS)(实验归纳一书) [Hoveland, Hunt, 1950s; Hunt, Marin and Stone, 1966] • CART system [Friedman, 1977; Breiman et al., 1984] (由基尼系数-Gini Index—决定最佳的分割测试变量和阈 值) • ID3[J.R. Quilan, 1979,1983,1986]

C4.5的应用

采用构建的DT进行数据挖掘、分类、分析。 信息增益率准则可用于NNTree的构建: ENN的fitness function为每个ENN在 当前节点样本子集上划分的信息增益率。

24

3.7.4 处理缺少属性值的训练样 例

赋给它结点n的训练样例中该属性的最常

见值或赋给它结点n的被分类为c(x)的训练

样例中该属性的最常见值;

每个可能值赋与一个概率。

25

5

什么是C4.5 ?

• 一个基于Unix系统的应用软件 • 该应用软件的作用:通过C4.5设定的 算法/准则生成决策树,对数据分类、 分析 • 该设定的算法/准则:信息增益率准则 (information gain ratio criterion)

6

3.4.1哪个属性是最佳的分类属性

从ID3到C4.5共同之处: 通过自顶向下构造决策树进行学习; 构造过程的开始:哪一个属性将在树的根节点 被测试? 区别:选择测试属性时的准则 ID3: 增益准则(Gain criterion )—衡量给 定属性区分训练样例的能力。 C4.5: 增益率准则(Gain ratio criterion)

No No Yes Yes Yes No Yes No

Overcast Hot

Overcast Cool

D9

D10 D11

Sunny

Rain Sunny

Cool

Mild Mild

Normal

Normal Normal

Weak

Weak Strong

Yes

Yes Yes

D12

D13 D14

Overcast Mild

分为很多小子集时也可 T

以使得信息增益增加。极端的情况:每一个 子集只包含一个样例。此时同样有:

gain ( X ) info (T )

信息增益准则的内在偏置:偏袒具有较多值 的属性。

16

C4.5: Gain Ratio Criterion(1)

a) 若测试 X 将 T 划分为 n 个子集,则其分裂 信息(split/potential information)为:

split _ info ( X )

n

Ti T

log

Ti

2

i 1

T

分裂信息用来衡量属性分裂数据的广度和均 匀性,实际上就是T关于测试属性X的各值的 熵。

17

C4.5: Gain Ratio Criterion(1)

b) 信息增益率(随着有用分割而得到的信息 增益比率)定义为:

gain _ ratio ( X ) gain ( X ) / split _ info ( X )

则

gain _ ratio ( X ) 1

当分得过细时将导致 split _ info ( X ) 变大,从而使 gain _ ratio ( X ) 减小, 避免了过分细分的可能。

19

C4.5: 各属性划分的信息增益率

split _ info ( X

o u t lo o k

) -5/14 log 2 (5/14) - 4/14 log 2 (4/14) - 5/14 log 2 (5/14)

关于信息论中熵的更详细的内容:[A mathematical theory of communication, C.E. Shannon,1948 ] 11

ID3: Gain Criterion(4)