最优化算法实验3-最速下降法

最优化 马昌凤 第三章作业

最优化方法及其Matlab程序设计习题作业暨实验报告学院:数学与信息科学学院班级:12级信计一班姓名:李明学号:1201214049第三章 最速下降法和牛顿法一、上机问题与求解过程1、用最速下降法求212221216423),(x x x x x x f --+=的极小值。

解:仿照书上编写最速下降法程序如下:function [x,val,k]=grad(fun,gfun,x0) %功能:用最速下降法求解无约束化问题:min f(x) %输入:x0是初始点,fun,gfun 分别是目标函数和梯度 %输出:x,val 分别是近似嘴有点和最优值,k 是迭代次数 maxk=5000;rho=0.5;sigma=0.4;%一开始选择时选择的rho 和sibma 选择的数据不够合理,此处我参照书上的数据编写数据 k=0;epsilon=1e-5; while (k<maxk)g=feval(gfun,x0); %计算梯度 d=-g;%计算搜索方向if (norm(d)<epsilon),break ;end m=0;mk=0; while (m<20)%Armijo 搜索if (feval(fun,x0+rho^m*d)<feval(fun,x0)+sigma*rho^m*g'*d) mk=m;break ;%直接利用Armijo 搜索公式,一开始的时候没有记住公式编写出现错误 end m=m+1; endx0=x0+rho^mk*d; k=k+1; end x=x0;val=feval(fun,x0) %求得每一个的函数值然后仿照书上建立两个目标函数和梯度的M 文件:function f=fun(x)f=3*x(1)^2+2*x(2)^2-4*x(1)-6*x(2); function g=gfun(x) g=[6*x(1)-4,4*x(2)-6]';选取初始点为']0,0[,调用函数程序,得出最小极值点为']500.1,6667.0[,极小值为8333.5-,在界面框中输入的程序如下:[x,val,k]=grad('fun','gfun',x0) val = -5.8333 x =0.6667 1.5000 val =-5.8333 k = 10从结果可以看出迭代次数为10次,如果选取不同的初值点则迭代次数不一样,但是极小值相同。

最优化方法实验报告(2)

最优化方法实验报告Numerical Linear Algebra And ItsApplications学生所在学院:理学院学生所在班级:计算数学10-1学生姓名:甘纯指导教师:单锐教务处2013年5月实验三实验名称:无约束最优化方法的MATLAB实现实验时间: 2013年05月10日星期三实验成绩:一、实验目的:通过本次实验的学习,进一步熟悉掌握使用MATLAB软件,并能利用该软件进行无约束最优化方法的计算。

二、实验背景:(一)最速下降法1、算法原理最速下降法的搜索方向是目标函数的负梯度方向,最速下降法从目标函数的负梯度方向一直前进,直到到达目标函数的最低点。

2、算法步骤用最速下降法求无约束问题n R()min的算法步骤如下:xxf,a )给定初始点)0(x ,精度0>ε,并令k=0;b )计算搜索方向)()()(k k x f v -∇=,其中)()(k x f ∇表示函数)(x f 在点)(k x 处的梯度;c )若ε≤)(k v ,则停止计算;否则,从)(k x 出发,沿)(k v 进行一维搜索,即求k λ,使得)(min )()()(0)()(k k k k v x f v x f λλλ+=+≥; d )令1,)()()1(+=+=+k k v x x k k k k λ,转b )。

(二)牛顿法1、算法原理牛顿法是基于多元函数的泰勒展开而来的,它将)()]([-)(1)(2k k x f x f ∇∇-作为搜索方向,因此它的迭代公式可直接写出来:)()]([)(1)(2)()(k k k k x f x f x x ∇∇-=-2、算法步骤用牛顿法求无约束问题n R x x f ∈),(min 的算法步骤如下:a )给定初始点)0(x ,精度0>ε,并令k=0;b )若ε≤∇)()(k x f ,停止,极小点为)(k x ,否则转c );c )计算)()]([,)]([)(1)(2)(1)(2k k k k x f x f p x f ∇∇-=∇--令;d )令1,)()()1(+=+=+k k p x x k k k ,转b )。

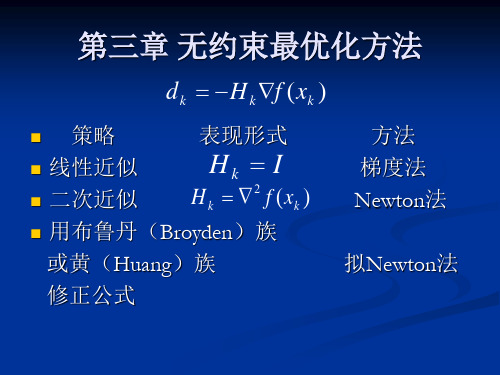

数值最优化算法与理论理论-第三章算法

1、最速下降法function f=fun_obj(x)f=100*(x(2)-x(1)^2)^2+(1-x(1))^2;function g=fun_grad(x)g=[2*x(1)-400*x(1)*(-x(1)^2+x(2))-2,-200*x(1)^2+200*x(2)];% 用armijo搜索确定步长,其中xk是当前迭代点,rho,sigma为armijo参数,gk为当前下降方向function mk=armijo(xk,rho,sigma,gk )%assert(rho>0&&rho<1); % 限制Armijo参数rho在(0,1)之间%assert(sigma>0&&sigma<0.5); % 限制Armijo参数sigma在(0,0.5)之间mk=0;max_mk=100; % 最大迭代次数while mk<=max_mkx=xk+rho^mk*gk; % 求解x(k+1)iffeval('fun_obj',x)<=feval('fun_obj',xk)-sigma*rho^mk*(fun_grad(xk))*g k' %终止条件break;endmk=mk+1; % 更新迭代endfunction [xk,fk,k]=steepestmain(x0)max_iter=5000; % max number of iterationsEPS=1e-6; % threshold of gradient normrho=0.8;sigma=0.59; % Armijo parametersk=0;xk=x0; % initializationwhile k<max_iterdk=fun_grad(xk);d=-dk; % search directionif norm(dk)<EPS %precisionbreak;endmk=armijo(xk,rho,sigma,d); %armijo line searchxk=xk+rho^mk*d; %updatefk=fun_obj(xk);k=k+1;endx0=[-1,2];[xk,fk,k]=steepestmain(x0);2、Newton法function f=fun_obj(x)f=100*(x(2)-x(1)^2)^2+(1-x(1))^2;function g=fun_grad(x)g=[2*x(1)-400*x(1)*(-x(1)^2+x(2))-2,-200*x(1)^2+200*x(2)];function He=Hess(x)He=[1200*x(1)^2-400*x(2)+2,-400*x(1);-400*x(1),200];% 用armijo搜索确定步长,其中xk是当前迭代点,rho,sigma为armijo参数,gk为当前下降方向function mk=armijo(xk,rho,sigma,gk )%assert(rho>0&&rho<1); % 限制Armijo参数rho在(0,1)之间%assert(sigma>0&&sigma<0.5); % 限制Armijo参数sigma在(0,0.5)之间mk=0;max_mk=100; % 最大迭代次数while mk<=max_mkx=xk+rho^mk*gk; % 求解x(k+1)iffeval('fun_obj',x)<=feval('fun_obj',xk)-sigma*rho^mk*(fun_grad(xk))*g k' %终止条件break;endmk=mk+1; % 更新迭代endfunction [xk,fk,k]=Newtonmain(x0)max_iter=5000; % 最大迭代次数EPS=1e-6; % 精度rho=1;sigma=1e-4; % Armijo 参数k=0;xk=x0; % 初值while k<max_iter % 迭代次数超过最大迭代次数时跳出循环k=k+1;dk=fun_grad(xk); % x(k)处的梯度H=Hess(xk); % x(k)处的Hessian矩阵d=-H\dk'; % x(k)处的搜索方向if norm(dk)<EPS % 终止条件break;endmk=armijo(xk,rho,sigma,d'); % 利用armijo搜索确定步长xk=xk+rho^mk*d'; % 计算x(k+1)的值fk=fun_obj(xk); % 计算x(k+1)处函数的值endx0=[1.2,1.2];[xk,fk,k]=Newtonmain(x0);3、Newton-最速下降法function f=fun_obj(x)f=100*(x(2)-x(1)^2)^2+(1-x(1))^2;function g=fun_grad(x)g=[2*x(1)-400*x(1)*(-x(1)^2+x(2))-2,-200*x(1)^2+200*x(2)];function He=Hess(x)He=[1200*x(1)^2-400*x(2)+2,-400*x(1);-400*x(1),200];% 用armijo搜索确定步长,其中xk是当前迭代点,rho,sigma为armijo参数,gk为当前下降方向function mk=armijo(xk,rho,sigma,gk )%assert(rho>0&&rho<1); % 限制Armijo参数rho在(0,1)之间%assert(sigma>0&&sigma<0.5); % 限制Armijo参数sigma在(0,0.5)之间mk=0;max_mk=100; % 最大迭代次数while mk<=max_mkx=xk+rho^mk*gk; % 求解x(k+1)iffeval('fun_obj',x)<=feval('fun_obj',xk)-sigma*rho^mk*(fun_grad(xk))*g k' %终止条件break;endmk=mk+1; % 更新迭代endfunction [xk,fk,k]=newton_steepest(x0)max_iter=5000; % 最大迭代次数EPS=1e-6; % 精度rho=1;sigma=1e-4; % Armijo 参数 rho=0.8;sigma=0.59;k=0;xk=x0; % 初值while(k<max_iter)k=k+1;dk=fun_grad(xk); % x(k)处的梯度,注意dk为行向量G=Hess(xk); % x(k)处的Hessian矩阵d=-G\dk'; % x(k)处的搜索方向,注意此时d为列向量if norm(dk)<EPS % x(k)处的搜索方向break;end%% 判断d是否为下降方向if d'*dk'<0 % 若d'*dk<0,则d为下降方向d=d;else% 若d'*dk>=0,则d不为下降方向,令下降方向为负梯度方向 d=-dk';endmk=armijo(xk,rho,sigma,d'); % 利用armijo搜索确定步长 xk=xk+rho^mk*d'; % 计算x(k+1)的值fk=fun_obj(xk); % 计算x(k+1)处函数的值endx0=rand(1,2000);[xk,fk,k]=newton_steepest(x0);。

第3章 无约束最优化方法 3-1 最速下降法 3-2 牛顿法

1

u f ( x)u m u

T 2

2

u R

n

则从任意的初始点 x 0 出发,阻尼牛顿法产 生的迭代点列 满足: (1)当 x k 为有穷点列时,其最后一个点 为 f ( x) 的唯一极小点。 (2)当 x k 为无穷点列时,收敛到 f ( x) 的

第3.2节 Newton法及其改进

第3.1节 最速下降法(Steepest Method)

对于最速下降法的几点说明 (1)第2.6节中介绍的关于下降算法的收敛 性定理对最速下降法都是成立的 。 (2)目标函数在负梯度方向下降得最快只 是局部性质。 (3)锯齿现象 (4)改进策略:在计算的开始阶段使用最 速下降法,在迭代数次后,改用其他算法。

本节的主要内容:

(1)牛顿法的基本思想

(2)阻尼牛顿法

(3)带保护措施的阻尼牛顿法

(4)吉尔-默里稳定牛顿法

(5)信赖域方法(一)

第3.2节 Newton法及其改进

(1)牛顿法的基本思想: * 在目标函数f ( x)的极小点 x 的近似点 x k 附近将 f ( x) 二阶Tayler展开,用展开的二次 函数去逼近 f ( x),将这个二次函数的极小点 * x 作为 的一个新的近似点 x k 1 ,依次下去, 用一系列二次函数的极小点 xk 1 去逼近 f ( x) 的极小点 x * 。

第3.2节 Newton法及其改进

设 f ( x)二次连续可微,则 f ( x) 在 x k 处的二次 近似为: 1 T f ( x) qk ( x) f ( xk ) f ( xk ) ( x xk ) ( x xk )T 2 f ( xk )( x xk ) 2 令

第3章 无约束最优化方法 3-1 最速下降法 3-2 牛顿法

是局部性质。 n (3)锯齿现象 n (4)改进策略:在计算的开始阶段使用最

速下降法,在迭代数次后,改用其他算法。

第3.1节 最速下降法(Steepest Method)

n [引理3.2](康德洛维奇Kntorovich不等式)

第3.2节 Newton法及其改进

n [推论3.8]设 且对任意的 在水平集

在开凸集D上二阶连续可微, ,存在常数 ,使得

上满足

则从任意的初始点 出发,牛顿法产生的迭

代点列 满足

,且收敛到

的唯一极小点。

第3.2节 Newton法及其改进

n 阻尼牛顿法的优点与缺点: 阻尼牛顿法克服了牛顿法要求初始点充分靠

n

,则d是下降方向;

n

,则 是下降方向。

第3.2.4节 吉尔-默里稳定牛顿法

n Gill-Murray稳定牛顿法的基本思想: n 当Hesse矩阵 在迭代点

处为不定矩阵时,对其进行强迫正 定的 分解;当 趋于零时, 采用负曲率方向使函数值下降。

第3.2.4节 吉尔-默里稳定牛顿法

n [算法3.15](求负曲率方向的算法)

得到方向 ,令

。

n (6)精确线性搜索求 ,且令

n (7)若

,则进行步(8);否则,

令

,转步(2)。

n (8)输出

,停止计算。

第3.2.4节 吉尔-默里稳定牛顿法

n [定理3.18]设 二阶连续可微,且存在

,使得

为有界闭

凸集。假定在吉尔-默里稳定牛顿法中取

,且初始点

,则吉尔-默里稳

定牛顿法产生的迭代序列 满足:

最优化算法实验3-最速下降法

最速下降法Matlab实现实验目的:1.掌握迭代法求解无约束最优化问题的基本思想2.通过实验掌握最速下降法的Matlab算法的基本步骤实验内容:1.迭代法求解无约束最优化问题的基本思想给定一个初始点x(0), 按照某一迭代规则产生一个迭代序列{x(k)}. 使得若该序列是有限的, 则最后一个点就是原问题的极小点; 否则, 若序列{x(k)} 是无穷点列时, 它有极限点且这个极限点即为原问题的极小点.设x(k) 为第k 次迭代点, d(k) 为第k 次搜索方向, a(k)为第k 次步长因子, 则第k 次迭代完成后可得到新一轮(第k + 1 次) 的迭代点x(k+1) = x(k) + a(k) d(k).2.无约束优化问题迭代算法的一般框架步0 给定初始化参数及初始迭代点x(0). 置k := 0.步1 若x(k) 满足某种终止准则, 停止迭代, 以x(k) 作为近似极小点.步2 通过求解x(k) 处的某个子问题确定下降方向d(k).步3 通过某种搜索方式确定步长因子a(k), 使得f(x(k) + a(k) d(k)) < f(x(k)).步4 令x(k+1) := x(k) + a(k) d(k), k := k + 1, 转步1.3. 最速下降法的基本步骤步0 选取初始点x(0) ∈R^n, 容许误差0 ≤e ≪1. 令k := 1.步1 计算g(k) = ∇f(x(k)). 若‖g(k)‖≤e, 停算, 输出x(k)作为近似最优解.步2 取方向d(k)= −g(k).步3 由线搜索技术确定步长因子a(k),即min f(a(k))=f(x(k)+a(k)d(k)).步4 令x(k+1) := x(k) + a(k)d(k)), k := k + 1, 转步1.4. 编写最速下降法Matlab 程序5. 利用程序求解无约束最优化问题f(x,y)=x^2+2y^2的最优值.。

最速下降法

0 为一维搜索最佳步长,应满足极值必要条件

0Байду номын сангаас0 f x1 min f x f x

min 2 4 25 2 100 min

2 2

0 8 2 4 5000 2 100 0

解 取初始值

x 0 2, 2

T

则初始点处函数值及梯度分别为

f x0 104 2 x1 4 f x0 50 x2 x0 100 沿负梯度方向进行一维搜索,有

x1 x 0 0f x 0 2 4 2 4 0 2 0 100 2 100 0

从直观上看在远离极小点的地方每次迭代可能使目标函数有较大的下降但是在接近极小点的地方由于锯齿现象从而导致每次迭代行进距离缩短因而收敛速度不快

最速下降法

1 无约束多变量问题最优化

考虑无约束问题

min

f (X) X E n

其中函数f (X)具有一阶连续偏导数。 在处理这类问题时,总希望从某一点出发,选择一个目

其中 d ( k ) 是从 x ( k ) 出发的搜索方向,这里取在点x ( k ) 处的最速 下降方向,即

d ( k ) f ( x ( k ) )

k 是从 x ( k )出发沿方向 d ( k )进行一维搜索的步长,即 k 满足

f ( x ( k ) k d ( k ) ) min f ( x ( k ) d ( k ) )

x 0

*

f

* x 0

0

T

根据一元函数极值的必要条件

和复合函数求导公式可得:

最优化方法-最速下降法

计算步骤

设f (X )是可微函数,精度要求为

X f ( ) K 1

,

X 0 为初始点。

(1)计算梯度

f

(

X

)

k

,初始k=0;

(2)

Pk

f

(

X

)

k

(3)求解 k

min f ( X k Pk)

s.t. 0

设 k 是一维搜索的最优解;

(4)求下一个点

评价

由例题中可以发现两次迭代的搜索方向满足:

P P P P T 0, T 0,...,

01

12

即相邻两个搜索方向 PK 与 PK1 正交,这是最速下降

法的搜索方向的基本形质。因此,最速下降法的迭代

路线呈锯齿形,尤其是在极小点附近,锯齿现象尤为

严重,从而影响了迭代速度。

评价

锯齿现象

最优化技术

第三章 7节 最速下降法

主要内容

1原 理

2 计算步骤

3 例题分析 4评 价

原理

定义:用来求解无约束多元函数 min f(x)

极小化问题的一种迭代算法。

拓展:

最速下降法又称梯度法,是 1847 年由著名数学家

Cauchy 给出的,它是解析法中最古老的一种,其他解析 方法或是它的变形,或是受它的启发而得到的,因此它是 最优化方法的基础。

X

)

0

(1,1)T

3-最优步长

2

X P ( ) f 5

0

0 2

1

0

应用一维搜索技术,解得函数最小值点 0 =0.2

举例分析

4-下一搜索点

X1

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

最速下降法Matlab实现

实验目的:

1.掌握迭代法求解无约束最优化问题的基本思想

2.通过实验掌握最速下降法的Matlab算法的基本步骤

实验内容:

1.迭代法求解无约束最优化问题的基本思想

给定一个初始点x(0), 按照某一迭代规则产生一个迭代序列{x(k)}. 使得若该序列是有限的, 则最后一个点就是原问题的极小点; 否则, 若序列{x(k)} 是无穷点列时, 它有极限点且这个极限点即为原问题的极小点.

设x(k) 为第k 次迭代点, d(k) 为第k 次搜索方向, a(k)为第k 次步长因子, 则第k 次迭代完成后可得到新一轮(第k + 1 次) 的迭代点

x(k+1) = x(k) + a(k) d(k).

2.无约束优化问题迭代算法的一般框架

步0 给定初始化参数及初始迭代点x(0). 置k := 0.

步1 若x(k) 满足某种终止准则, 停止迭代, 以x(k) 作为近似极小点.

步2 通过求解x(k) 处的某个子问题确定下降方向d(k).

步3 通过某种搜索方式确定步长因子a(k), 使得f(x(k) + a(k) d(k)) < f(x(k)).

步4 令x(k+1) := x(k) + a(k) d(k), k := k + 1, 转步1.

3. 最速下降法的基本步骤

步0 选取初始点x(0) ∈R^n, 容许误差0 ≤e ≪1. 令k := 1.

步1 计算g(k) = ∇f(x(k)). 若‖g(k)‖≤e, 停算, 输出x(k)作为近似最优解.

步2 取方向d(k)= −g(k).

步3 由线搜索技术确定步长因子a(k),即

min f(a(k))=f(x(k)+a(k)d(k)).

步4 令x(k+1) := x(k) + a(k)d(k)), k := k + 1, 转步1.

4. 编写最速下降法Matlab 程序

5. 利用程序求解无约束最优化问题f(x,y)=x^2+2y^2的最优值.。