英语,汉语信源信源熵研究

信息论汉字熵

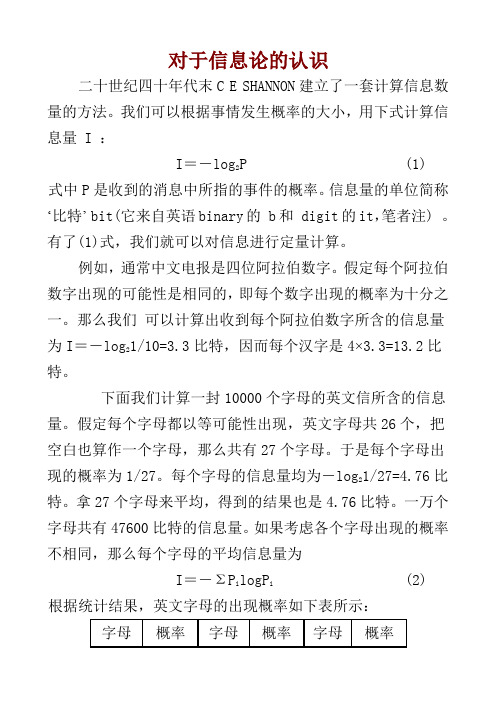

对于信息论的认识二十世纪四十年代末C E SHANNON建立了一套计算信息数量的方法。

我们可以根据事情发生概率的大小,用下式计算信息量 I :I=-log2P (1)式中P是收到的消息中所指的事件的概率。

信息量的单位简称‘比特’bit(它来自英语binary的 b和 digit的it,笔者注) 。

有了(1)式,我们就可以对信息进行定量计算。

例如,通常中文电报是四位阿拉伯数字。

假定每个阿拉伯数字出现的可能性是相同的,即每个数字出现的概率为十分之一。

那么我们可以计算出收到每个阿拉伯数字所含的信息量为I=-log21/10=3.3比特,因而每个汉字是4×3.3=13.2比特。

下面我们计算一封10000个字母的英文信所含的信息量。

假定每个字母都以等可能性出现,英文字母共26个,把空白也算作一个字母,那么共有27个字母。

于是每个字母出现的概率为1/27。

每个字母的信息量均为-log21/27=4.76比特。

拿27个字母来平均,得到的结果也是4.76比特。

一万个字母共有47600比特的信息量。

如果考虑各个字母出现的概率不相同,那么每个字母的平均信息量为I=-ΣP i logP i (2)根据统计结果,英文字母的出现概率如下表所示:把它们代入(2)式可以算出每个字母的平均信息量为4.03比特。

由此可见,字母的出现概率愈均匀,信息量愈大,反之就愈小。

在极端情况下,假设27个字母中有26个出现的概率为零,一个字母出现的概率为1,则信息量为零。

从上述的例子可以看到,字母以等概率出现时,每个字母所含的信息量最大。

要传输同样的信息量,字母以等概率出现时所需的长度(即字母个数)最短。

从传输信息量的角度来看,这是最理想的情况。

因为可以用最少的字母传递最多的信息量。

然而,实际的语言或文字总是达不到上述的极限。

就是说,传输同样的信息量需要较多的字母,具有一定的多余性。

从信息量的角度来看,这似乎是不利的。

但是,我们将会看到,由有了多余性,使人类的语言或文字具有一定的抗干扰能力。

信源熵的名词解释

信源熵的名词解释信源熵(Source Entropy)是信息论中一个重要的概念,用于衡量信息源的不确定性和信息的平均编码长度。

在信息论中,信息可以被看作是从一个信源中获取的,而信源熵用来描述这个信源的不确定性大小。

信源熵的计算方法是根据信源可能产生的符号的概率分布来进行的。

具体来说,如果一个信源有n个可能取值(符号)S1,S2,...,Sn,并且每个符号出现的概率分别为P1,P2,...,Pn,那么信源的熵H(S)可以通过下面的公式计算得出:H(S) = -P1log(P1) - P2log(P2) - ... - Pnlog(Pn)其中,log是以2为底的对数,P1,P2,...,Pn是概率分布。

信源熵的含义是,对于一个不确定性较大的信源,需要更长的编码长度来表示每一个符号,所以熵值越大,说明信息的平均编码长度越长。

相反,当一个信源的不确定性较小,即各个符号出现的概率分布较平均时,信息的平均编码长度较短,熵值较小。

以一个简单的例子来说明信源熵的概念。

假设有一个只有两个符号的信源,分别记为S1和S2,它们出现的概率分别为P1和P2。

如果这两个符号的概率分布相等(即P1 = P2 = 0.5),那么信源的熵就是最大的,因为这两个符号的不确定性相同,需要同样长度的编码来表示它们。

而如果其中一个符号的概率接近于1,另一个符号的概率接近于0,那么信源的熵就是最小的,因为其中一个符号的信息是确定的,只需要很短的编码来表示它。

这个例子可以帮助我们理解信源熵与不确定性之间的关系。

除了信源熵,信息论中还有一个重要的概念是条件熵(Conditional Entropy)。

条件熵是在已知一定的背景条件下,信源的不确定性大小,即在给定前提条件下的平均编码长度。

条件熵可以通过信源和条件之间的联合概率分布来计算,其公式为:H(S|T) = -ΣΣP(s, t)log(P(s|t))其中,P(s, t)表示符号s和条件t联合发生的概率。

信息论 第三章 信源及信源熵

• (1)求信源熵 • (2)求由m个“0”和(100-m)个“1”构成

的某一特定序列自信息量的表达式

• (3)计算由100个符号构成的符号序列的熵

• 3.3.2离散平稳有记忆信源 • 熵函数的链规则:

X x1,x2,,xN ,其中每个随机变量之间存在统计依赖关系。 H ( X ) H ( X1X 2 X N ) H ( X1) H ( X 2 X1) H ( X 3 X1X 2 ) H (X N X1X 2 X N1)

i

j

则称其具有遍历性,w

为平稳分布

j

• 遍历的马尔可夫信源熵率: • (1)齐次的马尔可夫信源:视作平稳的信源来处理 • 遍历的马尔可夫信源都是齐次的 • 遍历的马尔可夫信源:视作平稳的信源来处理 • (2) m阶马尔可夫信源: 只与最近的m个符号有关.

H

=

lim

N

H

(

X

N

X1X 2 X N 1)

件不断增加,平均符号熵

及HN (条X) 件熵

• H ( X N X1X 2 X3 X N1) 均随之减少。

• 当 N 时 HN (X)=H ( X N X1X 2 X N1)

• 即为熵率,它表示信源输出的符合序列中,平均 每个符号所携带的信息熵。

• 求熵率的两种途径:

• 1.极限平均符号熵 • 2.极限条件熵

4

)

0

0.5

0

0 0.5 0

0.5 0 0.2

0.5 0

=(w 1

0.8

w2

w3

w4 )

0.2w1 0.5w 2

+0.5w3 =w2 +0.2w4 =w3

lim lim 现在令N ,则有H (X )

英语的信息熵

英语的信息熵

英语的信息熵是指在英语语言中,每个字母或单词出现的概率和数量的统计分析。

信息熵是信息论中的一个概念,它表示信息的不确定性或信息量。

在英语语言中,每个字母或单词的出现概率不同,因此它们的信息熵也不同。

英语中最常用的字母是e,其出现频率约为12.7%,其次是t、a、o、i、n等字母,它们的出现频率也相对较高。

而较少使用的字母如z、q、x等,它们的出现频率非常低。

在英语中,单词的长度也会影响信息熵。

一般来说,单词长度越长,其出现概率就越低,因此其信息熵也就越大。

例如,单词“the”出现的概率很高,其信息熵也很低,而单词“antidisestablishmentarianism”则出现的概率很低,其信息熵也很高。

除了字母和单词的出现概率外,英语中的语法结构和词汇选择也会影响信息熵。

例如,英语中的主谓宾结构较为常见,而主谓宾补结构则较为罕见,因此前者的信息熵较低,后者的信息熵较高。

总之,英语的信息熵是一个复杂的概念,它涉及到英语语言中的多个方面,包括字母、单词、语法结构和词汇选择等。

通过对这些方面的分析,我们可以更好地理解英语语言的特点和规律。

信息论与编码2-信源及信源熵1

信息论与编码-信源及信源熵

又例如对离散化的平面图像来说,从 空间上来看是一系列离散的符号,而空间 每一点的符号(灰度)又都是随机的,由此 形成了不同的图像.所以我们可以把一般 信源输出的消息看作为时间或空间上离 散的一系列随机变量,即随机矢量.这样,信 源 描的述输,其出中可N可用为N维有随限机正矢整量数(或x1,可x2,数…的xN)无来 限值.

25

信息论与编码-信源及信源熵

2.2.2 离散信源熵

前面定义的自信息是指某一信源发出某一消 息所含有的信息量.所发出的消息不同,它们所含 有的信息量也就不同.所以自信息I(ai) 是一个 随机变量,不能用它来作为整个信源的信息测度.

我们定义自信息的数学期望为信源的平均信 息量,即

H ( X ) E [ I ( X ) ]p ( x i) I ( x i) p ( x i) lo p ( x i) g

7

信息论与编码-信源及信源熵

离散信源的数学模型就是离散型的概率空间:

X P

x1

p(x1)

x2

xn

p(x2) p(xn)

其中概率p(xi)(i=1,2,…,n)称为符号xi的先验概 率,应满足∑p(xi)=1

它表示信源可能取的消息(符号)只有n 个:x1,x2,…xn,而且每次必定取其中一个.

当xi和yj相互独立时,有p(xi,yj)=p(xi)p(yj) 于是有

I(xi,yj)= I(xi)+ I(yj)

24

信息论与编码-信源及信源熵

条件自信息量: 当xi和yj相互联系时,在事件yj 出现的条件下,xi 的

自信息量称为条件自信息量,定义为 I(xi|yj)=-logp(xi|yj)

信息论汉字熵

对于信息论的认识二十世纪四十年代末C E SHANNON建立了一套计算信息数量的方法。

我们可以根据事情发生概率的大小,用下式计算信息量 I :I=-log2P (1)式中P是收到的消息中所指的事件的概率。

信息量的单位简称‘比特’bit(它来自英语binary的 b和 digit的it,笔者注) 。

有了(1)式,我们就可以对信息进行定量计算。

例如,通常中文电报是四位阿拉伯数字。

假定每个阿拉伯数字出现的可能性是相同的,即每个数字出现的概率为十分之一。

那么我们 可以计算出收到每个阿拉伯数字所含的信息量为I=-log21/10=3.3比特,因而每个汉字是4×3.3=13.2比特。

下面我们计算一封10000个字母的英文信所含的信息量。

假定每个字母都以等可能性出现,英文字母共26个,把空白也算作一个字母,那么共有27个字母。

于是每个字母出现的概率为1/27。

每个字母的信息量均为-log21/27=4.76比特。

拿27个字母来平均,得到的结果也是4.76比特。

一万个字母共有47600比特的信息量。

如果考虑各个字母出现的概率不相同,那么每个字母的平均信息量为I=-ΣP i logP i (2)根据统计结果,英文字母的出现概率如下表所示:字母概率字母概率字母概率空格0.2S0.052Y,W0.012E0.105H0.047G0.011T0.072D0.035B0.0105O0.0654L0.029V0.008A0.063C0.023K0.003N0.059F,U0.0225X0.002I0.055M0.021J,Q,Z0.001R0.054P0.0175把它们代入(2)式可以算出每个字母的平均信息量为4.03比特。

由此可见,字母的出现概率愈均匀,信息量愈大,反之就愈小。

在极端情况下,假设27个字母中有26个出现的概率为零,一个字母出现的概率为1,则信息量为零。

从上述的例子可以看到,字母以等概率出现时,每个字母所含的信息量最大。

信息论与编码2-信源及信源熵

实例3

随机天气状况信源,其中晴天、雨天、雪天出现的概率分别是0.7、0.2、0.1。

实例1

随机二进制信源,其中每个二进制符号(0或1)出现的概率为0.5。

离散无记忆信源的实例

离散有记忆信源

03

离散有记忆信源是输出符号序列中符号与符号之间存在记忆关系的离散随机序列。

应用场景

广泛应用于网络通信、金融交易、军事通信等领域,保障信息安全和隐私。

加密通信

03

应用景

广泛应用于通信系统、数据存储等领域,如CD、DVD、硬盘等存储设备的纠错编码。

01

纠错原理

通过在数据中添加冗余信息,检测和纠正数据传输过程中的错误。

02

常见纠错编码

如奇偶校验码、海明码、循环冗余校验码等,这些编码利用数学原理对数据进行校验,确保数据的正确性。

纠错编码

THANKS

感谢观看

离散有记忆信源的输出符号之间存在统计依赖关系,这种关系会影响信息熵的计算。

定义

性质

离散有记忆信源的定义与性质

计算方法

条件熵

联合熵

离散有记忆信源熵的计算

离散有记忆信源熵是描述信源不确定性的度量,可以通过统计模型来计算。具体计算方法包括条件熵和联合熵等。

条件熵是在给定前一个或多个符号条件下,输出符号的熵。

应用场景

广泛应用于文件存储、网络传输、多媒体处理等领域,如JPEG图片压缩、MP3音频压缩等。

数据压缩原理

通过去除数据中的冗余信息,将数据压缩至更小的存储空间,提高存储和传输效率。

数据压缩

加密原理

通过特定的加密算法将明文转换为密文,确保信息在传输过程中的保密性。

关于信源熵的实验报告讲解

实验报告实验名称关于信源熵的实验课程名称信息论与编码姓名xxx 成绩90班级电子信息1102学号**********日期2013.11.22地点综合实验楼实验一关于信源熵的实验一、实验目的1. 掌握离散信源熵的原理和计算方法。

2. 熟悉matlab 软件的基本操作,练习使用matlab 求解信源的信息熵。

3. 自学图像熵的相关概念,并应用所学知识,使用matlab 或其他开发工具求解图像熵。

4. 掌握Excel的绘图功能,使用Excel绘制散点图、直方图。

二、实验原理1. 离散信源相关的基本概念、原理和计算公式产生离散信息的信源称为离散信源。

离散信源只能产生有限种符号。

随机事件的自信息量I(xi)为其对应的随机变量xi 出现概率对数的负值。

即: I (xi )= -log2p ( xi)随机事件X 的平均不确定度(信源熵)H(X)为离散随机变量 xi 出现概率的数学期望,即:2.二元信源的信息熵设信源符号集X={0,1} ,每个符号发生的概率分别为p(0)= p,p(1)= q,p+ q =1,即信源的概率空间为:则该二元信源的信源熵为:H( X) = - plogp–qlogq = - plogp –(1 - p)log(1- p)即:H (p) = - plogp –(1 - p)log(1- p) 其中 0 ≤ p ≤13. MATLAB二维绘图用matlab 中的命令plot( x , y) 就可以自动绘制出二维图来。

例1-2,在matlab 上绘制余弦曲线图,y = cos x ,其中 0 ≤ x ≤2。

>>x =0:0.1:2*pi; %生成横坐标向量,使其为 0,0.1,0.2,…,6.2>>y =cos(x ); %计算余弦向量>>plot(x ,y ) %绘制图形4. MATLAB求解离散信源熵求解信息熵过程:1) 输入一个离散信源,并检查该信源是否是完备集。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

英语信源,汉语信源的信源熵的研究

吴斌伟2902102020

【摘要】信息是个很抽象的概念。

人们常常说信息很多,或者信息较少,但却很难说清楚信息到底有多少。

比如一本五十万字的中文书到底有多少信息量。

直到1948年,香农提出了“信息熵”的概念,才解决了对信息的量化度量问题。

因此,信源的信息熵是衡量一个信源所含信息多少的度量。

信息的基本作用就是消除人们对事物了解的不确定性。

一个信源所发出的编码的不确定性越大,那么这个信源所含的信息量越大。

若一个信源发出某个码字的概率为一,那么该信源可传达的信息量为零。

美国信息论创始人香农发现任何信息都存在冗余,冗余大小与信息中每个符号(数字、字母或单词)的出现概率或者说不确定性有关。

香农借鉴了热力学的概念,把信息中排除了冗余后的平均信息量称为“信息熵”。

信源熵是信息论中用来衡量信源信息量有序化程度的一个概念,定义为信源各个离散消息的自信息量的数学期望(即概率加权的统计平均值)。

根据定义,信源熵值与信源有序化程度成反比;有序度越高,信源熵值越低,反之亦成立。

不同的语言,如汉语,英语,德语,法语等,所含的信息熵各不相同。

具体数据如下:按字母计算:

英文的平均信息熵是4.03 比特,

法文的平均信息熵是3.98,

西班牙文的平均信息熵是4.01,

德文的平均信息熵是4.10,

俄文的平均信息熵是4.8,

中文的平均信息熵是9.65比特

由上述数据可知,法语的信息熵最小,而中文的信息熵最大。

因此有人说汉语这种语言不如其他语言,汉语是落后的。

显然这样的答案是否定的。

平均信息熵并不是语言文字效率的基本公式,而是在通讯中编码的码长的效率!提出这公式,申农是用以研究信息编码的。

说得通俗一点,就是要(在可能有噪音的情况下)把已方(信息源)的信息进行标准化编码(比如,0-1化),然后传送出去,对方接收,解码,恢复成原来的信息。

研究的重点,是多长的一组码为合理——如果太短,无法正确还原,如果太长,就有冗余。

从上面的数据可以推断,要正确表示英文字符至少需要4.03比特,也就是需要5位二进制字符。

现实中共有26个英文字符,满打满算也需要5位,这与前文的推断相符。

但是通过文本查找可以发现,在26个字符中,有些字符使用频率高,有些字符使用频率低,因此可以通过适当的编码,将所需要的二进制字符(编码长度)压缩至4个多一点的长度。

而中文从上面的数据可以看出,至少需要10个比特,而在现实中,一个中文字符是使用2个字节来表示的。

但是,这样能否看成中文不如英文?例如:英文中的“I”是使用一个字节来表示,但是中文中的“我”则需要两个字节表示。

从这个方面看,平均信息熵越小,使用的比特数越少,这文字越好。

但是事实并非如此。

假设,当年中国的老祖宗创造中文时,仅发明两个文字“是”“不是”,那么中文的信息熵为1比特。

是所有文字中最小的。

但是这样好吗?

造成这样荒谬的结论的原因是并不是每个英文字母组成的词汇都是有用的。

如”aa ,ab ,ac,…”所以,如果有人用汉字对比英文(在同样意义的词汇)的byte数,十有八九汉字要“节约”得多!

若想知道文字的效率的话,可以根据语言中的词汇来计算词汇的熵。

按词汇计算的零阶熵

英语:10.0 bits 汉语:11.46 bits

以上数据说明汉语的词汇丰富。

经过统计不同的语言的冗余度数据如下:

英语:73%;俄语:70%;汉语:63%;文言文更低。

以上这点也可以从联合国收藏的文件中看出。

同一份文件,法译本最厚,中译本最薄。

但是随着时代的发展,语言也在不断地变换。

例如,在中国,以前的文言文和现在的白话文相比,很明显,文言文的信源熵较小,而白话文的信源熵较大。

因为同一段文言文所含的信息量要大于白话文。

从不确定度上分析,文言文的前后字符的不确定性无疑要大于白话文,这也印证了上述结论。

而英文也在发生变化,如新出现的“CSDM,TTL,LAN,”等等。

这无疑是提高了英语的信源熵。

不容忽视的是中文的平均信息熵是9.65比特,在计算机信息作业的时候,汉字的每个字符需要两个字节的空间,因而中文的信息处理和传递的整体效率比英文等拼音文字的效率要低得多。

尽管我们已经说明汉字实际上比英文和其他拼音文字只简不冗(从占用字节数的角度看),语言学上的问题仍然相当复杂,谁简谁繁似乎也还难以成为一种语言优劣的绝对定论。

比如世界语、数学语言、电脑的汇编,显然都极简单而且规范,可是要代替自然的生活语言明显是不行的。

因此,评价一种语言必须从多个方面考虑,仅考虑信息熵明显是不可行的。