如何用MATLAB的神经网络工具箱实现三层BP网络

(完整版)BP神经网络matlab实例(简单而经典)

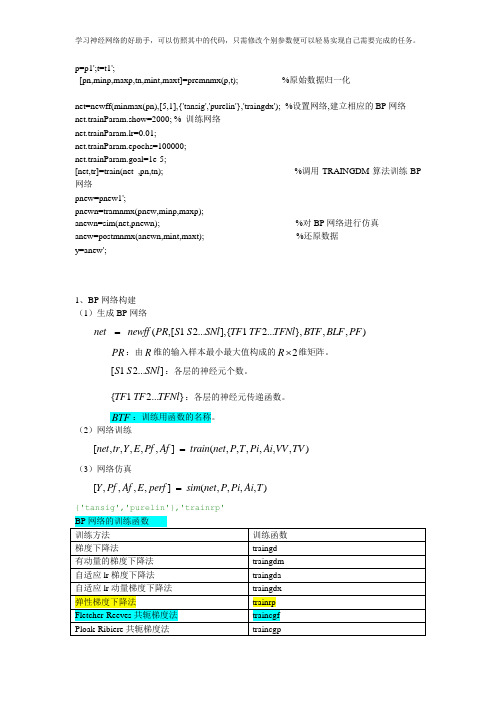

p=p1';t=t1';[pn,minp,maxp,tn,mint,maxt]=premnmx(p,t); %原始数据归一化net=newff(minmax(pn),[5,1],{'tansig','purelin'},'traingdx');%设置网络,建立相应的BP网络net.trainParam.show=2000; % 训练网络net.trainParam.lr=0.01;net.trainParam.epochs=100000;net.trainParam.goal=1e-5;[net,tr]=train(net ,pn,tn); %调用TRAINGDM算法训练BP 网络pnew=pnew1';pnewn=tramnmx(pnew,minp,maxp);anewn=sim(net,pnewn); %对BP网络进行仿真anew=postmnmx(anewn,mint,maxt); %还原数据y=anew';1、BP网络构建(1)生成BP网络=net newff PR S S SNl TF TF TFNl BTF BLF PF(,[1 2...],{ 1 2...},,,)PR:由R维的输入样本最小最大值构成的2R⨯维矩阵。

S S SNl:各层的神经元个数。

[ 1 2...]{ 1 2...}TF TF TFNl:各层的神经元传递函数。

BTF:训练用函数的名称。

(2)网络训练[,,,,,] (,,,,,,)=net tr Y E Pf Af train net P T Pi Ai VV TV(3)网络仿真=[,,,,] (,,,,)Y Pf Af E perf sim net P Pi Ai T{'tansig','purelin'},'trainrp'2、BP网络举例举例1、%traingdclear;clc;P=[-1 -1 2 2 4;0 5 0 5 7];T=[-1 -1 1 1 -1];%利用minmax函数求输入样本范围net = newff(minmax(P),T,[5,1],{'tansig','purelin'},'trainrp');net.trainParam.show=50;%net.trainParam.lr=0.05;net.trainParam.epochs=300;net.trainParam.goal=1e-5;[net,tr]=train(net,P,T);net.iw{1,1}%隐层权值net.b{1}%隐层阈值net.lw{2,1}%输出层权值net.b{2}%输出层阈值sim(net,P)举例2、利用三层BP神经网络来完成非线性函数的逼近任务,其中隐层神经元个数为五个。

BP神经网络原理及其MATLAB应用

BP神经网络原理及其MATLAB应用BP神经网络(Back Propagation Neural Network)是一种基于梯度下降算法的人工神经网络模型,具有较广泛的应用。

它具有模拟人类神经系统的记忆能力和学习能力,可以用来解决函数逼近、分类和模式识别等问题。

本文将介绍BP神经网络的原理及其在MATLAB中的应用。

BP神经网络的原理基于神经元间的权值和偏置进行计算。

一个标准的BP神经网络通常包含三层:输入层、隐藏层和输出层。

输入层负责接收输入信息,其节点数与输入维度相同;隐藏层用于提取输入信息的特征,其节点数可以根据具体问题进行设定;输出层负责输出最终的结果,其节点数根据问题的要求决定。

BP神经网络的训练过程可以分为前向传播和反向传播两个阶段。

前向传播过程中,输入信息逐层传递至输出层,通过对神经元的激活函数进行计算,得到神经网络的输出值。

反向传播过程中,通过最小化损失函数的梯度下降算法,不断调整神经元间的权值和偏置,以减小网络输出与实际输出之间的误差,达到训练网络的目的。

在MATLAB中,可以使用Neural Network Toolbox工具箱来实现BP神经网络。

以下是BP神经网络在MATLAB中的应用示例:首先,需导入BP神经网络所需的样本数据。

可以使用MATLAB中的load函数读取数据文件,并将其分为训练集和测试集:```data = load('dataset.mat');inputs = data(:, 1:end-1);targets = data(:, end);[trainInd, valInd, testInd] = dividerand(size(inputs, 1), 0.6, 0.2, 0.2);trainInputs = inputs(trainInd, :);trainTargets = targets(trainInd, :);valInputs = inputs(valInd, :);valTargets = targets(valInd, :);testInputs = inputs(testInd, :);testTargets = targets(testInd, :);```接下来,可以使用MATLAB的feedforwardnet函数构建BP神经网络模型,并进行网络训练和测试:```hiddenLayerSize = 10;net = feedforwardnet(hiddenLayerSize);net = train(net, trainInputs', trainTargets');outputs = net(testInputs');```最后,可以使用MATLAB提供的performance函数计算网络的性能指标,如均方误差、相关系数等:```performance = perform(net, testTargets', outputs);```通过逐步调整网络模型的参数和拓扑结构,如隐藏层节点数、学习率等,可以进一步优化BP神经网络的性能。

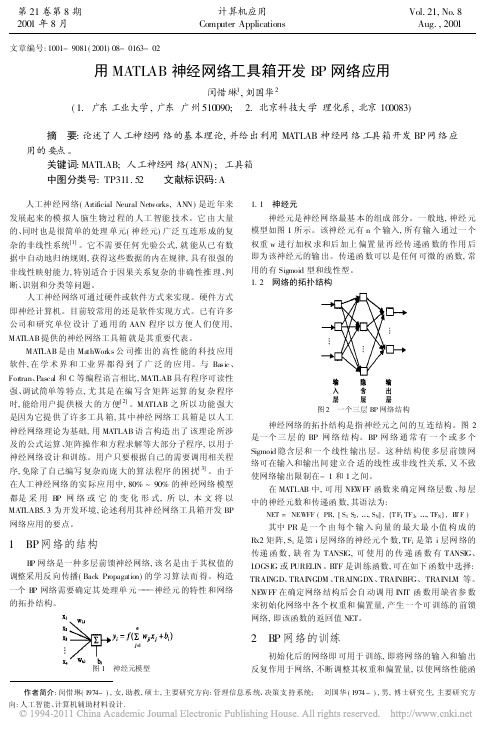

用MATLAB神经网络工具箱开发BP网络应用

作者简介:闵惜琳(1974-),女,助教,硕士,主要研究方向:管理信息系统、决策支持系统; 刘国华(1974-),男,博士研究生,主要研究方向:人工智能、计算机辅助材料设计.文章编号:1001-9081(2001)08-0163-02用MATLAB 神经网络工具箱开发BP 网络应用闵惜琳1,刘国华2(1.广东工业大学,广东广州510090; 2.北京科技大学理化系,北京100083)摘 要:论述了人工神经网络的基本理论,并给出利用MATLAB 神经网络工具箱开发BP 网络应用的要点。

关键词:MATLAB;人工神经网络(ANN);工具箱中图分类号:TP311.52 文献标识码:A人工神经网络(Artificial Neural Networks,ANN )是近年来发展起来的模拟人脑生物过程的人工智能技术。

它由大量的、同时也是很简单的处理单元(神经元)广泛互连形成的复杂的非线性系统[1]。

它不需要任何先验公式,就能从已有数据中自动地归纳规则,获得这些数据的内在规律,具有很强的非线性映射能力,特别适合于因果关系复杂的非确性推理、判断、识别和分类等问题。

人工神经网络可通过硬件或软件方式来实现。

硬件方式即神经计算机。

目前较常用的还是软件实现方式。

已有许多公司和研究单位设计了通用的AAN 程序以方便人们使用,MATLAB 提供的神经网络工具箱就是其重要代表。

MATLAB 是由MathWorks 公司推出的高性能的科技应用软件,在学术界和工业界都得到了广泛的应用。

与Basic 、Fortran 、Pascal 和C 等编程语言相比,MATLAB 具有程序可读性强、调试简单等特点,尤其是在编写含矩阵运算的复杂程序时,能给用户提供极大的方便[2]。

MATLAB 之所以功能强大是因为它提供了许多工具箱,其中神经网络工具箱是以人工神经网络理论为基础,用MATLAB 语言构造出了该理论所涉及的公式运算、矩阵操作和方程求解等大部分子程序,以用于神经网络设计和训练。

用MATLAB的神经网络工具箱实现三层BP网络

用MATLAB的神经网络工具箱实现三层BP网络用MATLAB的神经网络工具箱实现三层BP网络% 读入训练数据和测试数据Input = [];Output = [];str = {'Test','Check'};Data = textread([str{1},'.txt']);% 读训练数据Input = Data(:,1:end-1);% 取数据表的前五列(主从成分)Output = Data(:,end);% 取数据表的最后一列(输出值)Data = textread([str{2},'.txt']);% 读测试数据CheckIn = Data(:,1:end-1);% 取数据表的前五列(主从成分)CheckOut = Data(:,end);% 取数据表的最后一列(输出值)Input = Input';Output = Output';CheckIn = CheckIn';CheckOut = CheckOut';% 矩阵赚置[Input,minp,maxp,Output,mint,maxt] = premnmx(Input,Output);% 标准化数据%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%% 神经网络参数设置%====可以修正处Para.Goal = 0.0001;% 网络训练目标误差Para.Epochs = 800;% 网络训练代数Para.LearnRate = 0.1;% 网络学习速率%====Para.Show = 5;% 网络训练显示间隔Para.InRange = repmat([-1 1],size(Input,1),1);% 网络的输入变量区间Para.Neurons = [size(Input,1)*2+1 1];% 网络后两层神经元配置Para.TransferFcn= {'logsig' 'purelin'};% 各层的阈值函数Para.TrainFcn = 'trainlm';% 网络训练函数赋值% traingd : 梯度下降后向传播法% traingda : 自适应学习速率的梯度下降法% traingdm : 带动量的梯度下降法% traingdx :% 带动量,自适应学习速率的梯度下降法Para.LearnFcn = 'learngdm';% 网络学习函数Para.PerformFcn = 'sse';% 网络的误差函数Para.InNum = size(Input,1);% 输入量维数Para.IWNum = Para.InNum*Para.Neurons(1);% 输入权重个数Para.LWNum = prod(Para.Neurons);% 层权重个数Para.BiasNum = sum(Para.Neurons);% 偏置个数%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%Net = newff(Para.InRange,Para.Neurons,Para.TransferFcn,...Para.TrainFcn,Para.LearnFcn,Para.PerformFcn);% 建立网络%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%Net.trainParam.show = Para.Show;% 训练显示间隔赋值Net.trainParam.goal = Para.Goal;% 训练目标误差赋值Net.trainParam.lr = Para.LearnRate;% 网络学习速率赋值Net.trainParam.epochs = Para.Epochs;% 训练代数赋值Net.trainParam.lr = Para.LearnRate;Net.performFcn = Para.PerformFcn;% 误差函数赋值%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% % 调试Out1 =sim(Net,Input);% 仿真刚建立的网络Sse1 =sse(Output-Out1);% 刚建立的网络误差%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% [Net TR] = train(Net,Input,Output);% 训练网络并返回%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% Out3 =sim(Net,Input);% 对学习训练后的网络仿真。

BP神经网络matlab教程

w

N 1 ho

w o (k )hoh (k )

N ho

2.4.2 BP网络的标准学习算法

第七步,利用隐含层各神经元的 h (k )和 输入层各神经元的输入修正连接权。

e e hih (k ) wih (k ) h (k ) xi (k ) wih hih (k ) wih w

p

i 1

h 1,2,

o 1,2,

,p

q

yio (k ) whohoh (k ) bo

o 1,2,

yoo (k ) f( yio (k ))

h 1

q

2.4.2 BP网络的标准学习算法

第四步,利用网络期望输出和实际输出, 计算误差函数对输出层的各神经元的偏导 o (k ) 数 。 ( w ho (k ) b ) e e yio yi (k )

输入样本---输入层---各隐层---输出层

判断是否转入反向传播阶段:

若输出层的实际输出与期望的输出(教师信号)不 符

误差反传

误差以某种形式在各层表示----修正各层单元 的权值

网络输出的误差减少到可接受的程度 进行到预先设定的学习次数为止

2.4.2 BP网络的标准学习算法

网络结构 输入层有n个神经元,隐含层有p个神经元, 输出层有q个神经元 变量定义 x x1, x2 , , xn 输入向量; 隐含层输入向量; hi hi1 , hi2 , , hi p 隐含层输出向量; ho ho1 , ho2 , , ho p 输出层输入向量; yi yi1 , yi2 , , yiq 输出层输出向量; yo yo1 , yo2 , , yoq 期望输出向量; d o d1 , d 2 , , d q

BP神经网络matlab实现的基本步骤

1、数据归一化2、数据分类,主要包括打乱数据顺序,抽取正常训练用数据、变量数据、测试数据3、建立神经网络,包括设置多少层网络(一般3层以内既可以,每层的节点数(具体节点数,尚无科学的模型和公式方法确定,可采用试凑法,但输出层的节点数应和需要输出的量个数相等),设置隐含层的传输函数等。

关于网络具体建立使用方法,在后几节的例子中将会说到。

4、指定训练参数进行训练,这步非常重要,在例子中,将详细进行说明5、完成训练后,就可以调用训练结果,输入测试数据,进行测试6、数据进行反归一化7、误差分析、结果预测或分类,作图等数据归一化问题归一化的意义:首先说一下,在工程应用领域中,应用BP网络的好坏最关键的仍然是输入特征选择和训练样本集的准备,若样本集代表性差、矛盾样本多、数据归一化存在问题,那么,使用多复杂的综合算法、多精致的网络结构,建立起来的模型预测效果不会多好。

若想取得实际有价值的应用效果,从最基础的数据整理工作做起吧,会少走弯路的。

归一化是为了加快训练网络的收敛性,具体做法是:1 把数变为(0,1)之间的小数主要是为了数据处理方便提出来的,把数据映射到0~1范围之内处理,更加便捷快速,应该归到数字信号处理范畴之内。

2 把有量纲表达式变为无量纲表达式归一化是一种简化计算的方式,即将有量纲的表达式,经过变换,化为无量纲的表达式,成为纯量比如,复数阻抗可以归一化书写:Z = R + jωL = R(1 + jωL/R) ,复数部分变成了纯数量了,没有量纲。

另外,微波之中也就是电路分析、信号系统、电磁波传输等,有很多运算都可以如此处理,既保证了运算的便捷,又能凸现出物理量的本质含义。

神经网络归一化方法:由于采集的各数据单位不一致,因而须对数据进行[-1,1]归一化处理,归一化方法主要有如下几种,供大家参考:1、线性函数转换,表达式如下:复制内容到剪贴板代码:y=(x-MinValue)/(MaxValue-MinValue)说明:x、y分别为转换前、后的值,MaxValue、MinValue分别为样本的最大值和最小值。

智能控制MALAB神经网络BP算法

智能控制MALAB神经网络BP算法智能控制MALAB神经网络BP算法是一种基于MATLAB平台的智能控制算法,用于神经网络的训练和优化。

BP算法,即反向传播算法,是一种常用的神经网络训练算法,通过不断调整网络权值和阈值,使得网络的输出与期望输出之间的误差最小化。

在MATLAB中,可以利用自带的神经网络工具箱来实现BP算法。

具体步骤如下:一、数据准备数据准备是智能控制MALAB神经网络BP算法的第一步,它涉及到准备训练数据集和测试数据集。

以下是数据准备的详细步骤:1.收集和整理数据:首先,需要收集与问题相关的数据,并将其整理成适合神经网络输入的格式。

数据可以来自实验、观测、模拟等途径。

2.数据预处理:对收集到的原始数据进行预处理,以便更好地适应神经网络的训练和优化。

预处理步骤可能包括数据清洗、去噪、归一化、标准化等。

这些步骤有助于提高数据的质量和可靠性。

3.数据划分:将整个数据集划分为训练数据集和测试数据集。

通常,大部分数据用于训练神经网络,而少部分数据用于测试网络的泛化能力。

常见的划分方法包括随机划分、交叉验证等。

4.数据编码:对于非数值型数据,需要进行编码转换成数值型数据。

例如,可以使用独热编码将分类变量转换为二进制向量。

5.数据特征选择:根据问题的需求和特征的相关性,选择合适的特征子集。

这有助于减少数据维度,提高训练效率和模型性能。

6.数据平衡:对于不平衡的数据集,可以采取一些方法来平衡正负样本的比例,例如过采样、欠采样、SMOTE等。

数据准备是神经网络训练的重要环节,对于获得良好的训练结果和模型性能至关重要。

通过合理的数据准备步骤,可以提高神经网络的训练效率和泛化能力,从而实现智能控制任务的优化。

二、网络创建使用MATLAB的神经网络工具箱,可以创建一个BP神经网络模型。

可以选择网络的拓扑结构,包括输入层、隐藏层和输出层的节点数目,以及激活函数等参数。

以下是网络创建的详细步骤:1.确定网络的拓扑结构:首先,需要确定网络的拓扑结构,包括输入层、隐藏层和输出层的节点数目。

BP神经网络预测的MATLAB实现

> > net. trainParam. show = 500; > > net = train ( net, P, T)

显示的数据与所设计的网络模型相符 ,且如图显见网 络学习迭代到 411次时 ,就达到了学习精度 0. 004 996 74, 其学习速度较快 。

(六 )测试 BP神经网络 将测试的输出数据还原 ,与实际人数比较 (见表 1) ,说 明 BP神经网络预测的 MATLAB实现是可行的 。

基于MATLAB神经网络工具箱的BP网络实现

2 BP 网络模型

BP 网 络是一种多层前馈神经 网络 , 由输入 层 、隐层和 输 出层组成 。 层与层之间采用全互连方式 , 同一层 之间不存 在 相互连接 , 隐层可以 有一个 或多 个 。 构造 一个 BP 网 络需 要

收稿日期 :2003 -03 -06

确定其 处 理单 元 ——— — 神 经元 的 特 性和 网 络的 拓 扑结 构 。 神经元是神经网络最基本的处理单元 , 隐层中 的神经元采 用 S 型变换 函数 , 输出层的 神经元可采 用 S 型或线 性型变换 函 数 。 图 1 为一个典型的三层 BP 网络的拓扑结构 。

其中 :PR 是一个 由每 个输 入向 量 的最 大最 小值 构成 的 Rx2 矩阵 , R 为输入神经元数目 。

Si 是第 i 层网络的神经元个 数 , 网络共有 N1 层 。 TFi 是第 i 层网络神经元的变换函数 , 缺省为 tansig . BTF 是 BP 训练算法函数 , 缺省为 trainlm. BLF 是学习函数 , 缺省为 learngdm. PF 是性能函数 , 缺省为 mse . newff 在确定网络结构 后会 自动调 用初 始化 函数 init , 用 缺省参数来初始化网络中各个权值和阈值 , 产生 一个可训 练 的前馈网络 , 即该函数的 返回值 net。 在 MATLAB 中 , 神经 网 络 net 当做对象(object)处理 , 其属性用结构来定义 。 3)初始化函数 init :它是 对网 络的 连接 权值 和阈 值进 行 初始化 。 newff 在 创建 网络 对象 的 同时 , 自 动 调动 初始 化 函 数 , 根据缺省的参数对网络进行连接权值和阈 值初始化 。 4)学习函数 :提供多种学习函数 , 用来修 正权值和 阈值 。 基本的学习函数有 :learngd 、 learngdm。 5)性能函数 :它是用来计算网络 的输出误差 。 为训练 提 供判据 , 包 括 :函 数 mae , 计 算网 络 的 平 均 绝 对 误 差 ;函 数 mse, 计算网络的均方误差 ;函 数 msereg , 计算 均方误差 和权/ 阈值的加权 ;函数 sse , 计算网络的均方误差和 。 6)训练函数 train : BP 网 络的训练初始化后 , 可对 它进行训练 。 在 MATLAB 中训练网络有两类模式 :逐变模式 和批处理 模式 。 在逐变 模 式中 , 每输入一个学习样本就根据网 络性能指标 函数对连 接 权值和阈值更新一次 。 在批处理模式中 , 所有的 学习样本 都 学习完成后 , 连接权值和阈值才被 更新一次 。 使 用批处理 模 式不需要为每一层的连接权值和阈值设定 训练函数 , 而只 需 为整个网络指定 一个 训练 函数 , 使用 起来 相对方 便 , 而且 许 多改进的快速训练算法只能采用批处理模式 。 训练网 络 的 函 数 是 train 按 设 置 的 net.trainFcn 和 net. trainParam 参数来 训练网络 , 采用批处理方式进行网络的权 值 和阈值修正 , 最终达到设定的网络性能指标的 要求 。 7)BP 训练算法函数 :它是 根据网络 的输入 、目 标期望 输 出 , 对由 函数 newff 生成的 BP 网络 进行计 算 , 修正其 权值 和 阈值 , 最终达到设定的网络性能指 标的要求 。 不 同的训练 算 法函数对应不同的训练算法 , 如 traingd 对应最基 本梯度下 降 法 ;traingdm 带有动量 项 的梯 度下 降法 ;traingdx 带有 采用 动

基于MATLAB神经网络工具箱的BP网络设计

基于MATLAB神经网络工具箱的BP网络设计摘要本文介绍了MA TLAB神经网络工具箱及其常用的工具箱函数;在说明BP网络的模型结构和算法的基础上,讨论了BP网络的训练过程及其设计原则,并用一个典型的两层结构的神经网络实现了具有函数逼近功能的BP网络设计。

关键词: MAT LAB神经网络工具箱BP算法BP网络设计函数逼近Abstract Firstly, the MATLAB’s Neural Net works Toolbox and its common toolbox functions are presen2ted . Then, after the model structure and arithmetic of the BP Neural Net work being introduced briefly, its training process and the design principle are analyzed emphatically . At last, with the help of the MATLAB Neural Net work Toolbox, the design of a typical two - layer - structure BP Neural Net work of function approaching is implemented Keywords MAT LAB neural net works toolbox BP arithmetic BP neural net works design Function approaching引言神经网络理论是在20世纪提出的,它从微观结构和功能上模拟人脑的组织机构和运行机制,能够较好地描述非线性系统和不确定系统。

由于神经网络具有可并行计算、分布式信息存储、自适应和学习能力强等优点,在很多领域获得了极其广泛的应用。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

如何用MA TLAB的神经网络工具箱实现三层BP网络?

% 读入训练数据和测试数据

Input = [];

Output = [];

str = {'Test','Check'};

Data = textread([str{1},'.txt']);

% 读训练数据

Input = Data(:,1:end-1);

% 取数据表的前五列(主从成分)

Output = Data(:,end);

% 取数据表的最后一列(输出值)

Data = textread([str{2},'.txt']);

% 读测试数据

CheckIn = Data(:,1:end-1);

% 取数据表的前五列(主从成分)

CheckOut = Data(:,end);

% 取数据表的最后一列(输出值)

Input = Input';

Output = Output';

CheckIn = CheckIn';

CheckOut = CheckOut';

% 矩阵赚置

[Input,minp,maxp,Output,mint,maxt] = premnmx(Input,Output);

% 标准化数据

%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%

% 神经网络参数设置

%====可以修正处

Para.Goal = 0.0001;

% 网络训练目标误差

Para.Epochs = 800;

% 网络训练代数

Para.LearnRate = 0.1;

% 网络学习速率

%====

Para.Show = 5;

% 网络训练显示间隔

Para.InRange = repmat([-1 1],size(Input,1),1);

% 网络的输入变量区间

Para.Neurons = [size(Input,1)*2+1 1];

% 网络后两层神经元配置

Para.TransferFcn= {'logsig' 'purelin'};

% 各层的阈值函数

Para.TrainFcn = 'trainlm';

% 网络训练函数赋值

% traingd : 梯度下降后向传播法

% traingda : 自适应学习速率的梯度下降法

% traingdm : 带动量的梯度下降法

% traingdx :

% 带动量,自适应学习速率的梯度下降法

Para.LearnFcn = 'learngdm';

% 网络学习函数

Para.PerformFcn = 'sse';

% 网络的误差函数

Para.InNum = size(Input,1);

% 输入量维数

Para.IWNum = Para.InNum*Para.Neurons(1);

% 输入权重个数

Para.LWNum = prod(Para.Neurons);

% 层权重个数

Para.BiasNum = sum(Para.Neurons);

% 偏置个数%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%

Net = newff(Para.InRange,Para.Neurons,Para.TransferFcn,...

Para.TrainFcn,Para.LearnFcn,Para.PerformFcn);

% 建立网络%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% %%%%

Net.trainParam.show = Para.Show;

% 训练显示间隔赋值

Net.trainParam.goal = Para.Goal;

% 训练目标误差赋值

Net.trainParam.lr = Para.LearnRate;

% 网络学习速率赋值

Net.trainParam.epochs = Para.Epochs;

% 训练代数赋值

Net.trainParam.lr = Para.LearnRate;

Net.performFcn = Para.PerformFcn;

% 误差函数赋值

%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%

% 调试

Out1 =sim(Net,Input);

% 仿真刚建立的网络

Sse1 =sse(Output-Out1);

% 刚建立的网络误差

%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% [Net TR] = train(Net,Input,Output);

% 训练网络并返回%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% Out3 =sim(Net,Input);

% 对学习训练后的网络仿真。