双目视觉原理

双目视觉定位原理

双目视觉定位原理双目视觉定位原理是一种常见的视觉定位原理,它是通过两个摄像头同时拍摄同一个物体的不同角度,再通过计算机图像处理技术将这些图像进行分析处理,从而确定目标物体的位置、大小、形态等信息。

这种技术被广泛应用于机器人、无人机、自动驾驶汽车等领域,它的基本原理是通过双目视觉模拟人类眼睛的立体视觉效果,以实现对目标物体的快速准确识别和定位。

双目视觉定位原理的基本原理双目视觉定位原理的基本原理是通过两个摄像头同时拍摄同一个物体的不同角度,再通过计算机图像处理技术将这些图像进行分析处理,从而确定目标物体的位置、大小、形态等信息。

双目视觉定位系统主要由两个摄像头、镜头、图像采集卡、图像处理器和计算机组成。

其中,两个摄像头被安装在一定距离的位置上,一般是左右两侧,成为双目视觉系统。

当目标物体出现在两个摄像头的视野中时,它将在两个摄像头的图像中分别呈现出不同的位置和角度。

计算机会对这些图像进行分析处理,通过计算两个图像之间的差异,确定目标物体的位置、大小、形态等信息,从而实现对目标物体的快速准确定位。

双目视觉定位原理的优势双目视觉定位原理相比其他定位原理具有以下优势:1.快速准确:双目视觉定位原理可以在短时间内快速准确地识别和定位目标物体,适用于高速运动物体的定位。

2.适应性强:双目视觉定位原理可以适应不同环境和光照条件下的定位需求,具有较高的灵活性和适应性。

3.精度高:双目视觉定位原理可以实现毫米级别的定位精度,可以满足高精度定位需求。

4.成本低:双目视觉定位原理不需要复杂的设备和技术,成本相对较低,适用于大规模应用。

双目视觉定位原理的应用领域双目视觉定位原理可以广泛应用于机器人、无人机、自动驾驶汽车等领域。

在机器人领域中,双目视觉定位原理可以用于机器人的自主导航、目标跟踪、障碍物避免等方面;在无人机领域中,双目视觉定位原理可以用于无人机的目标搜索、跟踪、拍摄等任务;在自动驾驶汽车领域中,双目视觉定位原理可以用于车辆的自主导航、障碍物检测、停车等方面。

双目相机视觉伺服原理

双目相机视觉伺服原理

嘿,朋友们!今天咱来聊聊双目相机视觉伺服原理,这可真是个神奇又有趣的玩意儿!

你看啊,双目相机就像是人的两只眼睛,它能同时观察到同一个物体。

这就好比我们看东西的时候,两只眼睛一起工作,能让我们对物体的位置和形状有更准确的判断。

那视觉伺服呢,就像是给这个“眼睛”加上了聪明的大脑和灵活的手脚。

它能根据相机看到的东西,迅速做出反应,指挥着其他部分去行动。

比如说,让机器人去抓取一个物体,它就能通过双目相机准确地判断出物体的位置、大小、形状等信息,然后指挥机器人的手臂去准确地抓住它。

这是不是很神奇呢?就好像一个武林高手,眼睛一扫,就能立刻知道对手的弱点在哪里,然后迅速出击,一招制胜!双目相机视觉伺服原理不就是这样嘛,它能让机器像武林高手一样厉害。

想象一下,如果没有这个原理,那机器人不就像个没头苍蝇一样乱撞啦?它们怎么能准确地完成各种任务呢?所以说,双目相机视觉 servo原理可太重要啦!

它就像是给机器注入了灵魂,让它们能真正地“看”到这个世界,理解这个世界,然后在这个世界里自由地行动。

这多了不起啊!

而且啊,这个原理的应用可广泛啦!在工业生产中,它能让机器人准确地进行装配、焊接等工作;在医疗领域,它能帮助医生进行更精准的手术;在日常生活中,说不定哪天你就会看到一个机器人根据双目相机视觉伺服原理在为你服务呢!

这可不是开玩笑的哟!随着科技的不断进步,双目相机视觉伺服原理一定会发挥更大的作用,给我们的生活带来更多的惊喜和便利。

所以啊,朋友们,让我们一起期待这个神奇的原理能给我们带来更多美好的变化吧!不用怀疑,未来一定会因为它而更加精彩!。

双目视觉成像原理

双目视觉成像原理双目视觉成像原理是指人类双眼通过视网膜接收到的图像信息,通过大脑的处理,形成我们对三维物体位置、深度和距离等感知能力。

这种成像原理是基于人类拥有两只眼睛,每只眼睛分别观察同一场景的不同角度所形成的视差来计算图像的深度信息。

首先,我们了解一下人眼的构造。

人眼是由眼球、角膜、晶状体、虹膜、瞳孔、视网膜等组成。

其中,眼球是一个球状的结构,其中包含有视网膜,视网膜上有大量视觉感受器,即视杆细胞和视锥细胞。

当外界的光线通过角膜和晶状体折射后进入眼球,最终在视网膜上形成图像。

当我们观察其中一物体时,双眼分别从不同的位置观察到该物体,这就导致了两只眼睛所观察到的图像中存在一定的视差。

视差是指物体在两只眼睛中的位置差异,也可以理解为左右眼所看到的图像不完全相同,这种不同主要体现在物体的位置上。

根据视差的理论,当物体远离我们看时,两个视点之间的差距较小,视差也较小;而当物体靠近我们时,两个视点之间的差距增大,视差也增大。

通过大脑对所观察到的图像进行处理,我们可以根据视差推断出物体的距离和深度信息。

在图像匹配方面,大脑会将两只眼睛所观察到的图像进行比较,找出两个图像中相似的部分,这个过程被称为视网膜对应。

大脑会将两个图像的每个像素点进行比较,找到相同的点。

这些相同的点可以被视作是两个视点中物体的同一点,在计算深度时非常重要。

在深度计算方面,大脑通过视差来估算物体的深度。

根据视差原理,当物体离我们越近时,它在两个视网膜上的位置差距就越大;反之,当物体离我们越远时,它在两个视网膜上的位置差距就越小。

大脑会根据这个差距来计算物体的距离和深度。

另外,人类在使用双目视觉成像原理时,还会利用一些额外的线索来帮助深度感知,比如大小大小线索、运动感知线索、重合线索等。

这些线索可以帮助我们更准确地感知物体的深度和距离。

通过双目视觉成像原理,人类可以更好地感知和理解三维空间中的物体。

利用这一原理,我们可以进行深度感知、距离判断和物体识别等。

双目立体视觉匹配

双目立体视觉匹配双目立体视觉匹配是一种计算机视觉技术,用于在双目摄像头中获取的图像中,找到对应的目标点,从而实现立体深度感知。

双目立体视觉匹配的原理是基于两个前提假设:一是视差概念,即两个相同的场景在左右两个眼睛中的图像位置差异;二是视差和深度之间的关系。

根据这两个基本假设,我们可以通过比较左右两个图像中的像素值来确定两个图像中的对应关系,从而计算出立体深度信息。

双目视觉匹配的过程通常包括以下几个步骤:1. 图像预处理:双目图像首先需要进行预处理,包括去噪、图像校正、颜色校正等。

这些步骤旨在提高图像质量和减少噪声对匹配结果的影响。

2. 特征提取:在预处理之后,需要从图像中提取出一些能够反映目标结构和纹理信息的特征点。

常用的特征包括角点、边缘、区域等。

3. 特征匹配:在这一步中,通过比较特征点之间的相似性来确定它们之间的对应关系。

常用的匹配算法有最近邻匹配、迭代最近点算法、随机抽样一致性算法等。

4. 视差计算:特征匹配之后,我们可以根据特征点之间的位置差异来计算出视差信息,即目标点在左右图像中的位置差异。

一般来说,视差越大,深度越小。

5. 深度计算:视差和深度之间的具体关系取决于相机的内外参数、基线长度等因素。

通过根据相机标定信息和经验参数,可以将视差转换为具体的深度值。

双目立体视觉匹配在机器人导航、三维重建、虚拟现实等领域具有广泛的应用。

通过获取场景的三维深度信息,可以使机器人在复杂环境中进行精确的定位和避障;在三维重建中,双目立体视觉匹配可以用于获取物体或场景的精确几何结构;在虚拟现实中,双目立体视觉匹配可以为用户提供更加真实的交互体验。

双目立体视觉匹配也面临着一些挑战和限制。

双目视觉匹配对于光照变化、纹理缺失等问题比较敏感,这会导致匹配结果的不稳定性;相机标定是双目视觉匹配中的重要一步,需要准确地测量相机参数和关联参数,否则会影响深度计算结果的精度;双目视觉匹配在处理大场景、纹理一致的区域等情况下会面临困难。

双目鱼眼相机成像原理

双目鱼眼相机成像原理

双目鱼眼相机是通过双目立体视觉技术实现的。

双目立体视觉技术基于视差原理,通过获取同一场景在两个不同位置的像素点阵,然后通过一系列算法处理,获得场景的深度信息。

具体来说,双目立体视觉技术通过模拟人眼在观察物体时视线的交错过程,获取同一场景在不同角度下的图像信息,并通过计算像素点阵之间的差异来获取深度信息。

这种技术可以应用于三维重建、虚拟现实、增强现实等领域。

双目鱼眼相机具有视场角广、体积小巧等优点,可以广泛应用于安防监控、智能驾驶、机器人等领域。

但同时也存在一定的局限性,例如对光线条件要求较高,需要较高的计算资源和算法处理能力等。

总之,双目鱼眼相机通过双目立体视觉技术实现了对场景的三维重建和深度信息获取,为各种应用提供了更加丰富和精准的视觉信息。

双目视觉基本原理

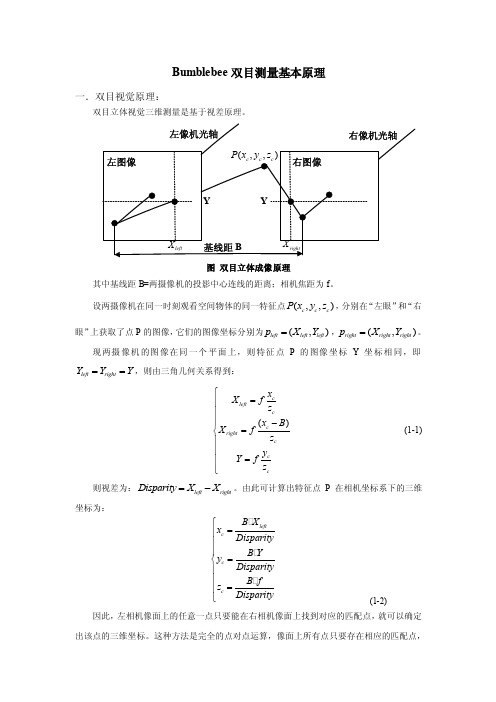

Bumblebee 双目测量基本原理一.双目视觉原理:双目立体视觉三维测量是基于视差原理。

图 双目立体成像原理其中基线距B=两摄像机的投影中心连线的距离;相机焦距为f 。

设两摄像机在同一时刻观看空间物体的同一特征点(,,)c c c P x y z ,分别在“左眼”和“右眼”上获取了点P 的图像,它们的图像坐标分别为(,)left left left p X Y =,(,)right right right p X Y =。

现两摄像机的图像在同一个平面上,则特征点P 的图像坐标Y 坐标相同,即left right Y Y Y ==,则由三角几何关系得到:()c left c c right c c c x X f z x B X f z y Y f z ⎧=⎪⎪⎪-=⎨⎪⎪=⎪⎩ (1-1)则视差为:left right Disparity X X =-。

由此可计算出特征点P 在相机坐标系下的三维坐标为:left c c c B X x Disparity B Y y Disparity B f z Disparity ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩ (1-2)因此,左相机像面上的任意一点只要能在右相机像面上找到对应的匹配点,就可以确定出该点的三维坐标。

这种方法是完全的点对点运算,像面上所有点只要存在相应的匹配点,就可以参与上述运算,从而获取其对应的三维坐标。

二.立体视觉测量过程1.图像获取(1) 单台相机移动获取(2) 双台相机获取:可有不同位置关系(一直线上、一平面上、立体分布)2.相机标定:确定空间坐标系中物体点同它在图像平面上像点之间的对应关系。

(1)内部参数:相机内部几何、光学参数(2)外部参数:相机坐标系与世界坐标系的转换3.图像预处理和特征提取预处理:主要包括图像对比度的增强、随机噪声的去除、滤波和图像的增强、伪彩色处理等;特征提取:常用的匹配特征主要有点状特征、线状特征和区域特征等4.立体匹配:根据对所选特征的计算,建立特征之间的对应关系,将同一个空间物理点在不同图像中的映像点对应起来。

双目视觉系统的原理和设计

双目视觉系统的原理和设计双目视觉系统是一种基于视差原理的三维测量方法。

该系统通过两个摄像机从不同的角度同时获取被测物的两幅数字图像,然后基于视差原理恢复出物体的三维几何信息,重建物体三维轮廓及位置。

双目视觉系统的原理可以概括为以下几个步骤:1. 图像获取:双目视觉系统通常由两个摄像机组成,它们从不同的角度拍摄被测物体。

摄像机获取的图像经过预处理后,进行特征提取和匹配。

2. 特征提取和匹配:这一步是双目视觉系统中的重要环节。

在预处理后,提取出图像中的特征点,并找到对应的特征点对。

特征点匹配是根据特征描述符的相似度来确定特征点之间的对应关系。

3. 立体校正和立体匹配:为了确保左右摄像机获取的图像在同一水平线上,需要进行立体校正。

立体匹配则是确定左右图像中对应像素之间的视差,这一步对于三维重建至关重要。

4. 三维重建:根据视差图和摄像机的参数,通过一系列算法计算出每个像素点的三维坐标,进而得到物体的三维模型。

5. 后期处理:最后,根据需求对重建的三维模型进行进一步的处理,如表面重建、纹理映射等。

双目视觉系统的设计可以根据实际需求进行调整。

影响系统性能的关键因素包括摄像机的分辨率、焦距、基线长度等。

为了获得更准确的三维测量结果,需要选择高分辨率、高精度的摄像机,并确保合适的基线长度和焦距。

此外,还需要进行精确的摄像机标定,以获取准确的摄像机参数。

在系统实现过程中,还需注意算法的优化和稳定性,以确保实时性和准确性。

总之,双目视觉系统是一种基于视差原理的三维测量方法,通过两个摄像机获取被测物的两幅数字图像,然后进行特征提取和匹配、立体校正和立体匹配、三维重建等一系列步骤,最终得到物体的三维模型。

在实际应用中,需要根据具体需求进行系统设计,选择合适的硬件设备和参数设置,并进行算法优化和稳定性测试,以确保双目视觉系统的性能和可靠性。

双目立体视觉原理

双目立体视觉原理双目立体视觉是人类视觉系统利用双眼获取深度信息的一种视觉方式。

在日常生活中,我们常常利用双眼来感知物体的位置、距离和深度,这得益于双目立体视觉原理的作用。

双目立体视觉原理是指人类通过左右两只眼睛同时观察同一物体,由于左右眼之间存在一定的视差,从而产生了深度信息,使我们能够感知到物体的立体形状和位置。

双目立体视觉原理的实现基于人类双眼之间的视差。

当我们观察远处的物体时,左右眼所看到的图像几乎是一样的,视差较小;而当观察近处的物体时,左右眼所看到的图像会有较大的差异,视差较大。

通过比较左右眼的视差,人类大脑能够计算出物体的距离和深度信息。

双目立体视觉原理在人类视觉系统中扮演着重要的角色。

首先,双目立体视觉使我们能够更准确地感知物体的位置和距离,这对于日常生活中的行走、操纵物体等活动至关重要。

其次,双目立体视觉也为我们提供了更加生动和真实的视觉体验,使我们能够感受到物体的立体形状和空间位置,这对于艺术、设计和娱乐等领域具有重要意义。

在工程应用中,双目立体视觉原理也被广泛应用于计算机视觉、机器人技术等领域。

通过模拟人类双目视觉系统,计算机可以实现对物体的三维重建和深度感知,从而实现对环境的理解和感知。

在机器人领域,双目立体视觉也被用于实现机器人的自主导航、避障和抓取等任务,为机器人赋予了更加灵活和智能的能力。

总的来说,双目立体视觉原理是人类视觉系统中一项重要的功能,它使我们能够感知物体的立体形状和位置,为我们的日常生活、艺术创作和工程应用提供了重要的支持。

随着科学技术的不断发展,双目立体视觉原理也将继续发挥着重要的作用,并为人类带来更加丰富和多彩的视觉体验。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

Bumblebee 双目测量基本原理

一.双目视觉原理:

双目立体视觉三维测量是基于视差原理。

图 双目立体成像原理

其中基线距B=两摄像机的投影中心连线的距离;相机焦距为f 。

设两摄像机在同一时刻观看空间物体的同一特征点(,,)c c c P x y z ,分别在“左眼”和“右眼”上获取了点P 的图像,它们的图像坐标分别为(,)left left left p X Y =,(,)right right right p X Y =。

现两摄像机的图像在同一个平面上,则特征点P 的图像坐标Y 坐标相同,即left right Y Y Y ==,则由三角几何关系得到:

()c left c c right c c c x X f z x B X f z y Y f z ⎧=⎪⎪⎪-=⎨⎪⎪=⎪⎩ (1-1)

则视差为:left right Disparity X X =-。

由此可计算出特征点P 在相机坐标系下的三维坐标为: left c c c B X x Disparity B Y y Disparity B f z Disparity ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩

(1-2) 因此,左相机像面上的任意一点只要能在右相机像面上找到对应的匹配点,就可以确定出该点的三维坐标。

这种方法是完全的点对点运算,像面上所有点只要存在相应的匹配点,

就可以参与上述运算,从而获取其对应的三维坐标。

二.立体视觉测量过程

1.图像获取

(1) 单台相机移动获取

(2) 双台相机获取:可有不同位置关系(一直线上、一平面上、立体分布)

2.相机标定:确定空间坐标系中物体点同它在图像平面上像点之间的对应关系。

(1)内部参数:相机内部几何、光学参数

(2)外部参数:相机坐标系与世界坐标系的转换

3.图像预处理和特征提取

预处理:主要包括图像对比度的增强、随机噪声的去除、滤波和图像的增强、伪彩色处理等;

特征提取:常用的匹配特征主要有点状特征、线状特征和区域特征等

4.立体匹配:根据对所选特征的计算,建立特征之间的对应关系,将同一个空间物理点在不同图像中的映像点对应起来。

立体匹配有三个基本的步骤组成:1)从立体图像对中的一幅图像如左图上选择与实际物理结构相应的图像特征;2)在另一幅图像如右图中确定出同一物理结构的对应图像特征;3)确定这两个特征之间的相对位置,得到视差。

其中的步骤2是实现匹配的关键。

5.深度确定

通过立体匹配得到视差图像之后,便可以确定深度图像,并恢复场景3-D信息。

三.Triclops库中的数据流程

Triclops库中的数据流程如下图所示。

系统首先从相机模型中获得raw格式的图像,最终将其处理成深度图像。

在系统中有两个主要的处理模块。

第一个处理模块是一个应用了低通滤波、图像校正和边缘检测的预处理模块。

第二个处理模块用来做立体匹配、结果确认和亚像素插值。

最后的处理结果就是一幅深度图像。

1.预处理(Pre-processing)

为了校正一幅图像,事先对其进行平滑是非常重要的。

所以如果要校正一幅图像,事先将低通滤波器打开是很好的方法。

当然不使用低通滤波器同样可以校正图像,但校正后的图像可能会出现混淆的现象。

如果要提高处理速度,可以将低通滤波器关掉。

2.校正(Rectification )

校正是用来修正镜头所产生的畸变的。

在原始图像中可以看到镜头所带来的这种畸变。

例如,场景中的一条直线在原始图像中会变成一条曲线,这种效果在图像的边角处尤为明显。

校正就是为了修正这种类型的畸变。

进一步来讲,如果没有正确的校正,那么沿着行或者列所做的特征搜索将可能产生错误的结果。

3.边缘检测(Edge detection )

边缘检测为任选特性,它使用亮度的变化来匹配特征。

当系统中的相机具有自动增益功能时,这项功能是非常有用的。

如果每个相机的自动增益的变化是不一致的,那么图像间的绝对亮度是不一致的,而虽然绝对亮度是不一致的,但亮度的变化却是一个常数。

因此边缘检测适用于光照有很大变化的环境当中。

虽然边缘检测可以改善检测的结果,但这相当于又引入了另外的处理步骤,因此要权衡结果的改善状况和速度之间的关系来使用这项功能。

注意,确认功能仅在边缘检测模式下有效。

4.立体处理(Stereo processing )

使用绝对方差相关性计算:

[][][][]22max

min 22min m m m m d right left d d i j I x i y j I x i d y j ==-=-++-+++∑∑

其中:min d 和m ax d 是最小和最大视差(disparity )

m 是模板尺寸(mask size )

right I 和left I 是右边和左边的图像

5.视差范围(Disparity range )

视差范围是立体算法为了在两幅图像中搜寻最佳匹时,所搜寻的像素的范围。

在Triclops 系统中0个像素的视差代表了无穷远处的物体。

最大的视差定义了能被检测到的最近的物体。

我们需要根据实际的任务来设置合适的视差范围。

减小视差范围可以加快系统的运行速度,并降低误匹配的几率。

6.相关模板(Correlation mask )

相关模板是围绕着一个像素的一个正方形邻域,这个像素就是系统想要为其寻找匹配的像素。

我们可以设定这个相关模板的尺寸。

大的模板会产生更密集更平滑的深度图像,然而,在识别不连续深度位置的精度上会有所欠缺。

另一方面,小的模板所产生的图像较为稀疏且会有更多的噪声,但在定位不连续深度的时候会有上佳的表现。

为了生成相同的结果,模板的尺寸要与被处理图像的分辨率成一定的比例。

就是说为了得到具有可比性的结果,对于160x120图像的5x5的模板,对于320x240图像的时候模板要增大到9x9。

模板的尺寸必须是奇数。

3x3,5x5,7x7是有效的模板尺寸,而4x4,6x6,8x8则是无效的模板尺寸。

Triclops提供了最大为15x15和最小为1x1的模板。

另外,Triclops 中提供了一个新的用于实验的函数:troclopsSetAnyStereoMask,这个函数允许用户设置任意尺寸的相关模板。

7.确认(Validation)

在一些情况下,例如封闭的缺乏变化的质地,是无法建立图像之间的相关的。

如果相关建立的不正确,那么测量的结果也就是不正确的了。

为了避免不正确的测量,系统引入了两个确认的方法:

●质地确认(Texture validation)是基于相关模板的质地的水平的,它决定了视差值是否

有效。

如果质地的水平不足以产生一个正确的匹配,这个像素就会被声明为无效。

●唯一性确认(Uniqueness validation)是指对于一个特定像素的最佳匹配和这个相关模板

下的其他匹配比起来是不是足够好。

即使相关模板的质地满足要求,由于封闭的原因,可能还是得不到正确的匹配。

如果相关的结果不足够强,这个像素就会被声明为无效。

用户可以设定两个阈值来控制确认的严格程度—一个是质地另一个是唯一性。