二维粒子群算法的matlab源程序

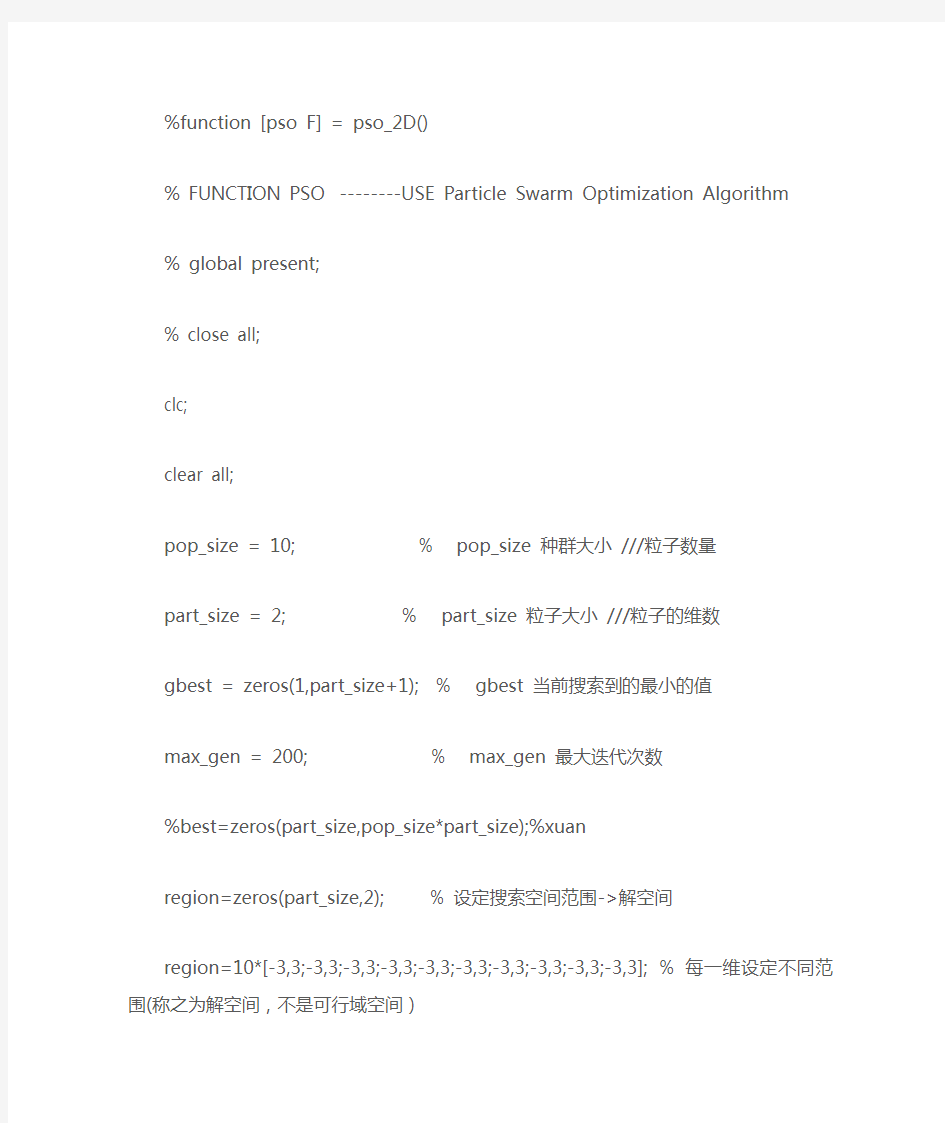

%function [pso F] = pso_2D()

% FUNCTION PSO --------USE Particle Swarm Optimization Algorithm

% global present;

% close all;

clc;

clear all;

pop_size = 10; % pop_size 种群大小///粒子数量

part_size = 2; % part_size 粒子大小///粒子的维数

gbest = zeros(1,part_size+1); % gbest 当前搜索到的最小的值

max_gen = 200; % max_gen 最大迭代次数

%best=zeros(part_size,pop_size*part_size);%xuan

region=zeros(part_size,2); % 设定搜索空间范围->解空间

region=10*[-3,3;-3,3;-3,3;-3,3;-3,3;-3,3;-3,3;-3,3;-3,3;-3,3]; % 每一维设定不同范围(称之为解空间,不是可行域空间)

rand('state',sum(100*clock)); % 重置随机数发生器状态

%当前种群的信息矩阵,逐代进化的群体% 当前位置,随机初始化

% 一个10*3的随机的矩阵(初始化所有粒子的所有维数的位置值),其中最后一列为arr_present = ini_pos(pop_size,part_size);

% 初始化当前速度

% 一个10*2的随机的矩阵(初始化所有粒子的所有维数的速度值)

v=ini_v(pop_size,part_size);

%不是当前种群,可看作是一个外部的记忆体,存储每个粒子历史最优值(2维数值):根据适应度更新!

%注意:pbest数组10*3 最后一列保存的是适应度

pbest = zeros(pop_size,part_size+1); % pbest:粒子以前搜索到的最优值,最后一列包括这些值的适应度

% 1*80 保存每代的最优值

best_record = zeros(part_size+1,max_gen); % best_record数组:记录每一代的最好的粒子的适应度

w_max = 0.9; % w_max权系数最大值

w_min = 0.2; % w_min权系数最小值

v_max = 2; % 最大速度,为粒子的范围宽度

c1 = 2; % 学习因子1

c2 = 2; % 学习因子2

% ————————————————————————

% 计算原始种群的适应度,及初始化

% ————————————————————————

% 注意:传入的第一个参数是当前的粒子群体,ini_fit函数计算每个粒子的适应度

% arr_present(:,end)是最后一列,保存每个粒子的适应值,是这样的!xuan

arr_present(:,end)= ini_fit( arr_present, pop_size, part_size );

% 数组赋值,初始化每个粒子个体的历史最优值,以后会更新的

pbest = arr_present; % 初始化各个粒子最优值

% 找到当前群体中适应度最小的(在最后一列中寻找),best_value

% 改为max,表示关联度最大

[best_value best_index] = max(arr_present(:,end)); %初始化全局最优,即适应度为全局最小的值,根据需要也可以选取为最大值

% 唯一的全局最优值,是当前代所有粒子中最好的一个

gbest = arr_present(best_index,:);

% 因为是多目标,因此这个-----------------

% 只是示意性的画出3维的

%x=[-3:0.01:3];

%y=[-3:0.01:3];

%[X,Y]=meshgrid(x,y);

%Z1=(-10)*exp((-0.2)*sqrt(X^2+Y^2));

%Z2=(abs(X))^0.8+abs(Y)^0.8+5*sin(X^3)+5*sin(Y^3);

%z1=@(x,y)(-10)*exp((-0.2)*sqrt(x^2+y^2));

%z2=@(x,y)(abs(x))^0.8+abs(y)^0.8+5*sin(x^3)+5*sin(y^3);

%ezmeshc(z1);grid on;

%ezmeshc(z2);grid on;

%开始进化,直到最大代数截至

for i=1:max_gen

%grid on;

%三维图象%多维图象是画不出来的

%ezmesh(z),hold on,grid on;

%画出粒子群

%plot3(arr_present(:,1),arr_present(:,2),arr_present(:,3),'*'),hold off; %drawnow

%flush

%pause(0.01);

w = w_max-(w_max-w_min)*i/max_gen; % 线形递减权重

% 当前进化代数:对于每个粒子进行更新和评价----->>>>>>>

for j=1:pop_size

v(j,:) = w.*v(j,:)+c1.*rand.*(pbest(j,1:part_size)-arr_present(j,1:part_size))...

+c2.*rand.*(gbest(1:part_size)-arr_present(j,1:part_size)); % 粒子速度更新(a)

% 判断v的大小,限制v的绝对值小于20———————————————————

for k=1:part_size

if abs(v(j,k))>20

rand('state',sum(100*clock));

v(j,k)=20*rand();

end

end

%前几列是位置信息

arr_present(j,1:part_size) = arr_present(j,1:part_size)+v(j,1:part_size);% 粒子位置更新(b)

%最后一列是适应度

arr_present(j,end) = fitness(part_size,arr_present(j,1:part_size)); % 适应度更新(保存至最后一列)

% 适应度评价与可行域限制

if (arr_present(j,end)>pbest(j,end))&(Region_in(arr_present(j,:),region)) % 根据条件更新pbest,如果是最小的值为小于号,相反则为大于号

pbest(j,:) = arr_present(j,:); % 更新个体的历史极值

end

end

% 以下更新全局的极值

[best best_index] = max(arr_present(:,end)); % 如果是最小的值为min,相反则为max

if best>gbest(end) & ( Region_in(arr_present(best_index,:),region) ) % 如果当前最好的结果比以前的好,则更新最优值gbest,如果是最小的值为小于号,相反则为大于号

gbest = arr_present(best_index,:); % 全局的极值

end

%------------混沌---------------------------------

xlhd = gbest(1:part_size);

if(1)

for p=1:25 %次数

%1生成

cxl=rand(1,part_size);

for j=1:part_size

if cxl(j)==0

cxl(j)=0.1;

end

if cxl(j)==0.25

cxl(j)=0.26;

end

if cxl(j)==0.5

cxl(j)=0.51;

end

if cxl(j)==0.75

cxl(j)=0.76;

end

if cxl(j)==1

cxl(j)=0.9;

end

end

%2映射

al=-30;bl=30;

rxl=al+(bl-al)*cxl;

%3搜索

bate = 0.1;

xlhd=xlhd+bate*rxl;

if fitness(part_size,xlhd)>gbest(end)

gbest(1:part_size)=xlhd;

gbest(end)=fitness(part_size,xlhd);

end

%4更新

for j=1:part_size

cxl(j)=4*cxl(j)*(1-cxl(j));

end

end

end

%-------------混沌--------------------------------

%当前代的最优粒子的适应度(取自)保存

best_record(:,i) = gbest; % gbest:一个行向量end

pso = gbest; % 最优个体

display(gbest);

figure;

plot(best_record(end,:));% 最优解与代数的进化关系图

best=zeros(part_size,max_gen);

for i=1:part_size-1

best(i,:)=best_record(i,:);

end

pareto1= zeros(1,max_gen);

pareto2= zeros(1,max_gen);

for i=1:max_gen

pareto1(i)=f1(part_size, best(:,i) );

pareto2(i)=f2(part_size, best(:,i) );

end

figure;

i=1:max_gen;

%plot(i,pareto1(i),'r*',i,pareto2(i),'g*');

plot(pareto1(i),pareto2(i),'r+');

xlabel('f1');ylabel('f2');

title('Pareto曲线');

%figure;

%plot(,f2(best_record),);

% movie2avi(F,'pso_2D1.avi','compression','MSVC');

%子函数

%-------------------------------------------------------------------------

%-------------------------------------------------------------------------

%返回随机的位置

function ini_present=ini_pos(pop_size,part_size)

ini_present = 10*3*rand(pop_size,part_size+1); %初始化当前粒子位置,使其随机的分布在工作空间

%返回一个随机的矩阵,10*(2+1),最后一列将用来保存适应度

%返回随机的速度

function ini_velocity=ini_v(pop_size,part_size)

ini_velocity =20*(rand(pop_size,part_size)); %初始化当前粒子速度,使其随机的分布在速度范围内

%判断是否处于范围内

function flag = Region_in(pos_present,region)

[m n]=size(pos_present); % 1*11 n返回解的维数10

flag=1;

for j=1:n-1

flag = flag & ( pos_present(1,j)>=region(j,1) ) & ( pos_present(1,j)<=region(j,2) );

end

%初始化适应度

function arr_fitness = ini_fit(pos_present,pop_size,part_size)

for k=1:pop_size

arr_fitness(k,1) = fitness(part_size,pos_present(k,1:part_size)); %计算原

始种群的适应度

end

%************************************************************ ***************

% 计算适应度

%************************************************************ ***************

function fit = fitness(n,xp)

%需要求极值的函数,本例即peaks函数

%y0=[-85.4974,-29.9217]; % 注意:这是基准序列,也就是单个最优的极值

y0=[-9.9907,-7.7507];

%y0=[-39.6162,-18.4561];

% y0=[-86.8312,-29.9217];

y1=[f1(n,xp),f2(n,xp)]; % n为粒子维数

fit=graydegree(2,y0,y1); % 关联度在某种意义上就是适应度

%目标函数1

function r=f1(n,x)

r=0;

for i=1:n-1

r=r+(-10)*exp((-0.2)*sqrt(x(i)^2+x(i+1)^2));

end

%目标函数2

function r=f2(n,x)

r=0;

for i=1:n

r=r+(abs(x(i)))^0.8+5*sin(x(i)^3);

end

%约束函数1

function r=g1(n,x)

r=0;

for i=1:n

r=0;

end

%约束函数2

function r=g2(n,x)

r=0;

for i=1:n

r=0;

end

% 灰色关联度计算函数( 越大相似性越好)

% tn目标函数个数x0基准序列(一组值)x1贷检(一组值)function gama = graydegree( tn,y0,y1 )

gama=0;

rou =0.5;

kesa= zeros(tn,1);

m1= abs(y0(1)-y1(1)) ;

m2= abs(y0(1)-y1(1)) ;

for i=1:tn

if( abs(y0(i)-y1(i))>m2 ) %------------------应该取大于呢还是小于 m2= abs(y0(i)-y1(i));

end

end

for i=1:tn

kesa(i) = ( m1+rou*m2)/( abs(y0(i)-y1(i)) +rou*m2 );

gama = gama + kesa(i);

end

gama = gama/tn;

% 可行解的判决函数 gn为约束条件的个数(暂时未用) n为解(粒子)的维数function bool = feasible( x,n )

r=0;

%for i=1:gn

r=max( 0, g1(n,x), g2(n,x) );%判断约束条件

%end

if(r>0)

bool=0; %不可行解

else

bool=1; %可行解

end

我正在玩搜狐微博,快来“关注”我,了解我的最新动态吧。

https://www.360docs.net/doc/a815999226.html,/u/19878919

(完整word版)基本粒子群算法的原理和matlab程序

基本粒子群算法的原理和matlab程序 作者——niewei120(nuaa) 一、粒子群算法的基本原理 粒子群优化算法源自对鸟群捕食行为的研究,最初由Kennedy和Eberhart提出,是一种通用的启发式搜索技术。一群鸟在区域中随机搜索食物,所有鸟知道自己当前位置离食物多远,那么搜索的最简单有效的策略就是搜寻目前离食物最近的鸟的周围区域。PSO 算法利用这种模型得到启示并应用于解决优化问题。PSO 算法中,每个优化问题的解都是粒子在搜索 空间中的位置,所有的粒子都有一个被优化的目标函数所决定的适应值,粒子还有一个速度值决定它们飞翔的方向和距离,然后粒子群就追随当前的最优粒子在解空间中搜索。 PSO 算法首先在给定的解空间中随机初始化粒子群,待优化问题的变量数决定了解空间的维数。每个粒子有了初始位置与初始速度。然后通过迭代寻优。在每一次迭代中,每个粒子通过跟踪两个“极值”来更新自己在解空间中的空间位置与飞翔速度。第一个极值就是单个粒子本身在迭代过程中找到的最优解粒子,这个粒子叫做个体极值。另一个极值是种群所有粒子在迭代过程中所找到的最优解粒子,这个粒子是全局极值。上述的方法叫全局粒子群算法。如果不用种群所有粒子而只用其中一部分作为该粒子的邻居粒子,那么在所有邻居粒子中的极值就是局部极值,该方法称为局部PSO 算法。 速度、位置的更新方程表示为: 每个粒子自身搜索到的历史最优值p i ,p i=(p i1,p i2,....,p iQ),i=1,2,3,....,n。所有粒子搜索到的最优值p g,p g=(p g1,p g2,....,p gQ),注意这里的p g只有一个。 是保持原来速度的系数,所以叫做惯性权重。 是粒子跟踪自己历史最优值的权重系数,它表示粒子自身的认识,所以叫“认知”。通常设置为2。 是粒子跟踪群体最优值的权重系数,它表示粒子对整个群体知识的认识,所以叫做“社会知识”,经常叫做“社会”。通常设置为2。 是[0,1]区间内均匀分布的随机数。 是对位置更新的时候,在速度前面加的一个系数,这个系数我们叫做约束因子。通常设 置为1 。

基本粒子群算法的matlab源程序

主函数源程序(main.m) %------基本粒子群优化算法(Particle Swarm Optimization)-----------%------名称:基本粒子群优化算法(PSO) %------作用:求解优化问题 %------说明:全局性,并行性,高效的群体智能算法 %------初始格式化--------------------------------------------------clear all; clc; format long; %------给定初始化条件---------------------------------------------- c1=1.4962;%学习因子1 c2=1.4962;%学习因子2 w=0.7298;%惯性权重 MaxDT=1000;%最大迭代次数 D=10;%搜索空间维数(未知数个数) N=40;%初始化群体个体数目 eps=10^(-6);%设置精度(在已知最小值时候用) %------初始化种群的个体(可以在这里限定位置和速度的范围)------------for i=1:N for j=1:D x(i,j)=randn;%随机初始化位置 v(i,j)=randn;%随机初始化速度 end end %------先计算各个粒子的适应度,并初始化Pi和Pg----------------------for i=1:N p(i)=fitness(x(i,:),D); y(i,:)=x(i,:); end pg=x(1,:);%Pg为全局最优 for i=2:N if fitness(x(i,:),D)

(完整word版)基本粒子群算法的原理和matlab程序.doc

基本粒子群算法的原理和matlab 程序 作者—— niewei120 (nuaa) 一、粒子群算法的基本原理 粒子群优化算法源自对鸟群捕食行为的研究,最初由Kennedy 和 Eberhart 提出,是一种通 用的启发式搜索技术。一群鸟在区域中随机搜索食物,所有鸟知道自己当前位置离食物多远, 那么搜索的最简单有效的策略就是搜寻目前离食物最近的鸟的周围区域。PSO 算法利用这种模型得到启示并应用于解决优化问题。PSO 算法中,每个优化问题的解都是粒子在搜索 空间中的位置,所有的粒子都有一个被优化的目标函数所决定的适应值,粒子还有一个速度值决定它们飞翔的方向和距离,然后粒子群就追随当前的最优粒子在解空间中搜索。 PSO 算法首先在给定的解空间中随机初始化粒子群,待优化问题的变量数决定了解空间的维数。每个粒子有了初始位置与初始速度。然后通过迭代寻优。在每一次迭代中,每个粒子通过跟踪两个“极值”来更新自己在解空间中的空间位置与飞翔速度。第一个极值就是单个粒子本身在迭代过程中找到的最优解粒子,这个粒子叫做个体极值。另一个极值是种群所有粒子在迭代过程中所找到的最优解粒子,这个粒子是全局极值。上述的方法叫全局粒子群算法。如果不用种群所有粒子而只用其中一部分作为该粒子的邻居粒子,那么在所有邻居粒子中的极值就是局部极值,该方法称为局部PSO 算法。 速度、位置的更新方程表示为: 每个粒子自身搜索到的历史最优值p i,p i=(p i1 ,p i2 ,....,p iQ ), i=1,2,3,....,n 。所有粒子搜索到的最优值p g, p g=(p g1 ,p g2,....,p gQ ),注意这里的p g只有一个。 是保持原来速度的系数,所以叫做惯性权重。 是粒子跟踪自己历史最优值的权重系数,它表示粒子自身的认识,所以叫“认知”。通常设置为 2 。 是粒子跟踪群体最优值的权重系数,它表示粒子对整个群体知识的认识,所以叫做“社会知识”,经常叫做“社会”。通常设置为2。 是[0,1] 区间内均匀分布的随机数。 是对位置更新的时候,在速度前面加的一个系数,这个系数我们叫做约束因子。通常设 置为 1 。

粒子群优化算法介绍及matlab程序

粒子群优化算法(1)—粒子群优化算法简介 PSO算法就是模拟一群鸟寻找食物的过程,每个鸟就是PSO中的粒子,也就是我们需要求解问题的可能解,这些鸟在寻找食物的过程中,不停改变自己在空中飞行的位置与速度。大家也可以观察一下,鸟群在寻找食物的过程中,开始鸟群比较分散,逐渐这些鸟就会聚成一群,这个群忽高忽低、忽左忽右,直到最后找到食物。这个过程我们转化为一个数学问题。寻找函数y=1-cos(3*x)*exp(-x)的在[0,4]最大值。该函数的图形如下: 当x=0.9350-0.9450,达到最大值y=1.3706。为了得到该函数的最大值,我们在[0, 4]之间随机的洒一些点,为了演示,我们放置两个点,并且计算这两个点的函数值,同时给这两个点设置在[0, 4]之间的一个速度。下面这些点就会按照一定的公式更改自己的位置,到达新位置后,再计算这两个点的值,然后再按照一定的公式更新自己的位置。直到最后在y=1.3706这个点停止自己的更新。这个过程与粒子群算法作为对照如下: 这两个点就是粒子群算法中的粒子。 该函数的最大值就是鸟群中的食物。 计算两个点函数值就是粒子群算法中的适应值,计算用的函数就是粒子群算法中的适应度函数。 更新自己位置的公式就是粒子群算法中的位置速度更新公式。 下面演示一下这个算法运行一次的大概过程: 第一次初始化 第一次更新位置

第二次更新位置 第21次更新 最后的结果(30次迭代) 最后所有的点都集中在最大值的地方。

粒子群优化算法(2)—标准粒子群优化算法 在上一节的叙述中,唯一没有给大家介绍的就是函数的这些随机的点(粒子)是如何运动的,只是说按照一定的公式更新。这个公式就是粒子群算法中的位置速度更新公式。下面就介绍这个公式是什么。在上一节中我们求取函数y=1-cos(3*x)*exp(-x)的在[0, 4]最大值。并在[0,4]之间放置了两个随机的点,这些点的坐标假设为x1=1.5,x2=2.5;这里的点是一个标量,但是我们经常遇到的问题可能是更一般的情况—x 为一个矢量的情况,比如二维z=2*x1+3*x22的情况。这个时候我们的每个粒子均为二维,记粒子P1=(x11,x12),P2=(x21,x22),P3=(x31,x32),......Pn=(xn1,xn2)。这里n 为粒子群群体的规模,也就是这个群中粒子的个数,每个粒子的维数为2。更一般的是粒子的维数为q ,这样在这个种群中有n 个粒子,每个粒子为q 维。 由n 个粒子组成的群体对Q 维(就是每个粒子的维数)空间进行搜索。每个粒子表示为:x i =(x i1,x i2,x i3,...,x iQ ),每个粒子对应的速度可以表示为v i =(v i1,v i2,v i3,....,v iQ ),每个粒子在搜索时要考虑两个因素: 1. 自己搜索到的历史最优值 p i ,p i =(p i1,p i2,....,p iQ ),i=1,2,3,....,n ; 2. 全部粒子搜索到的最优值p g ,p g =(p g1,p g2,....,p gQ ),注意这里的p g 只有一个。 下面给出粒子群算法的位置速度更新公式: 112()()()()k k k k i i i i v v c rand pbest x c rand gbest x ω+=+??-+??-, 11k k k i i i x x av ++=+. 这里有几个重要的参数需要大家记忆,因为在以后的讲解中将会经常用到,它们是: ω是保持原来速度的系数,所以叫做惯性权重。1c 是粒子跟踪自己历史最优值的权重系数,它表示粒子自身的认识,所以叫“认知”。通常设置为2。2c 是粒子跟踪群体最优值的权重系数,它表示粒子对整个群体知识的认识,所以叫做“社会知识”,经常叫做“社会”。通常设置为2。()rand 是[0,1]区间内均匀分布的随机数。a 是对位置更新的时候,在速度前面加的一个系数,这个系数我们叫做约束因子。通常设置为1。这样一个标准的粒子群算法就介绍结束了。下图是对整个基本的粒子群的过程给一个简单的图形表示。 判断终止条件可是设置适应值到达一定的数值或者循环一定的次数。 注意:这里的粒子是同时跟踪自己的历史最优值与全局(群体)最优值来改变自己的位置预速度的,所以又叫做全局版本的标准粒子群优化算法。

标准粒子群算法(PSO)及其Matlab程序和常见改进算法

一、粒子群算法概述 粒子群优化算法(PSO)是一种进化计算技术(evolutionary computation),1995 年由Eberhart 博士和kennedy博士提出,源于对鸟群捕食的行为研究。该算法最初是受到飞鸟集群活动的规律性启发,进而利用群体智能建立的一个简化模型。粒子群算法在对动物集群活动行为观察基础上,利用群体中的个体对信息的共享使整个群体的运动在问题求解空间中产生从无序到有序的演化过程,从而获得最优解。 PSO中,每个优化问题的解都是搜索空间中的一只鸟。我们称之为“粒子”。所有的粒子都有一个由被优化的函数决定的适应值(fitness value),每个粒子还有一个速度决定他们飞翔的方向和距离。然后粒子们就追随当前的最优粒子在解空间中搜索。 PSO 初始化为一群随机粒子(随机解)。然后通过迭代找到最优解。在每一次迭代中,粒子通过跟踪两个”极值”来更新自己。第一个就是粒子本身所找到的最优解,这个解叫做个体极值pBest。另一个极值是整个种群目前找到的最优解,这个极值是全局极值gBest。另外也可以不用整个种群而只是用其中一部分作为粒子的邻居,那么在所有邻居中的极值就是局部极值。 二、算法原理 粒子群算法采用常数学习因子,及惯性权重,粒子根据如下的公式更新自己的速度和位置。 V ki=ωk V i?1i+c1r1(Q bi?Q k?1i)+c2r2(Q bg?Q k?1i)Q ki=Q k?1i+V ki 三、算法步骤 1、随机初始化种群中各微粒的位置和速度; 2、评价个粒子的适应度,将各粒子的位置和适应度储存在各微粒的pbest(Q bi)中,将所有pbest中适应度最优的个体的位置和适应度存储在gbest(Q bg)中。 3、更新粒子的速度和位移。 V ki=ωk V i?1i+c1r1(Q bi?Q k?1i)+c2r2(Q bg?Q k?1i)Q ki=Q k?1i+V ki 4、对每个微粒,与其前一个最优位置比较,如果较好,则将其作为当前的最优位置。 5、比较当前所有的pbest和上一迭代周期的gbest,更新gbest。 6、若满足停止条件(达到要求精度或迭代次数),搜索停止,输出结果,否则,返回2。

c语言实现的粒子群算法代码及解释

//粒子群PSO算法 #include % 优化函数以m文件的形式放在fitness.m里面,对不同的优化函数只要修改fitness.m 就可 %------基本粒子群优化算法(Particle Swarm Optimization, PSO)----------- %------初始格式化-------------------------------------------------- clear all; clc; format long; %------给定初始化条件---------------------------------------------- c1=1.4962; %学习因子1 c2=1.4962; %学习因子2 w=0.7298; %惯性权重 MaxDT=1000; %最大迭代次数 D=4; %搜索空间维数(未知数个数) N=10; %初始化群体个体数目 eps=10^(-6); %设置精度(在已知最小值时候用) %------初始化种群的个体(可以在这里限定位置和速度的范围)------------ x=0:0.1:1,y=[-.447,1.978,3.11,5.25,5.02,4.66,4.01,4.58,3.45,5.35,9.22] %------先计算各个粒子的适应度,并初始化Pi和Pg---------------------- for i=1:N p(i)=fitness(x(i,:),D); y(i,:)=x(i,:); end pg=x(1,:); %Pg为全局最优 for i=2:N if fitness(x(i,:),D) 粒子群算法原理及其在函数优化中的应用 1粒子群优化(PSO)算法基本原理 1.1标准粒子群算法 假设在一个D 维的目标搜索空间中,有 m 个代表问题潜在解的粒子组成一 个种群x [X i ,X 2,...,X m ],第i 个粒子的信息可用D 维向量表示为 X i [X ii , X i2,..., X iD ]T ,其速度为V i [V ii ,V i2,...,V iD ]T 。算法首先初始化m 个随机粒 子,然后通过迭代找到最优解。每一次迭代中,粒子通过跟踪2个极值进行信息 交流,一个是第i 个粒子本身找到的最优解,称之为个体极值,即 P i [P il , P i2,...,厢]丁 ;另一个是所有粒子目前找到的最优解,称之为群体极值, 即P g [P gi ,P g2,..., P gD 「。粒子在更新上述2个极值后,根据式(1)和式(2)更新自 己的速度和位置。 t 1 t t t t t\ V i WV i C 1「1(P i X i ) C 2「2(P g X i ) 式中,t 代表当前迭代次数,「1,「2是在[0,1]之间服从均匀分布的随机数,C 1,C 2 称为学习因子,分别调节粒子向个体极值和群体极值方向飞行的步长, w 为惯性 权重,一般在0.1~0.9之间取值。在标准的PSO 算法中,惯性权重w 被设为常数, 通常取w 0.5。在实际应用中,x 需保证在一定的范围内,即x 的每一维的变化 范围均为[X min ,X max ],这在函数优化问题中相当丁自变量的定义域 1.2算法实现步骤 步骤1:表示出PSO 算法中的适应度函数fitness(x);(编程时最好以函数的 形式保存,便丁多次调用。) 步骤2:初始化PSO 算法中各个参数(如粒子个数,惯性权重,学习因子, 最大迭代次数等),在自变量x 定义域内随机初始化x ,代入fitness(x)求得适应 度值,通过比较确定起始个体极值P i 和全局极值P g 。 步骤3:通过循环迭代更新x 、p i 和p g : ① 确定惯性权重w 的取值(当w 不是常数时)。 ② 根据式(1)更新粒子的速度V :1,若速度中的某一维超过了 V max ,则取为 V max - ③ 根据式(2)更新自变量x ,若x 的取值超过其定义域,则在其定义域内重新 初t 1 X i t t 1 X i V i 粒子群算法(1)----粒子群算法简介 一、粒子群算法的历史 粒子群算法源于复杂适应系统(Complex Adaptive System,CAS)。CAS理论于1994年正式提出,CAS中的成员称为主体。比如研究鸟群系统,每个鸟在这个系统中就称为主体。主体有适应性,它能够与环境及其他的主体进行交流,并且根据交流的过程“学习”或“积累经验”改变自身结构与行为。整个系统的演变或进化包括:新层次的产生(小鸟的出生);分化和多样性的出现(鸟群中的鸟分成许多小的群);新的主题的出现(鸟寻找食物过程中,不断发现新的食物)。 所以CAS系统中的主体具有4个基本特点(这些特点是粒子群算法发展变化的依据): 首先,主体是主动的、活动的。 主体与环境及其他主体是相互影响、相互作用的,这种影响是系统发展变化的主要动力。 环境的影响是宏观的,主体之间的影响是微观的,宏观与微观要有机结合。 最后,整个系统可能还要受一些随机因素的影响。 粒子群算法就是对一个CAS系统---鸟群社会系统的研究得出的。 粒子群算法(Particle Swarm Optimization, PSO)最早是由Eberhart和Kennedy于1995年提出,它的基本概念源于对鸟群觅食行为的研究。设想这样一个场景:一群鸟在随机搜寻食物,在这个区域里只有一块食物,所有的鸟都不知道食物在哪里,但是它们知道当前的位置离食物还有多远。那么找到食物的最优策略是什么呢?最简单有效的就是搜寻目前离食物最近的鸟的周围区域。 PSO算法就从这种生物种群行为特性中得到启发并用于求解优化问题。在PSO中,每个优化问题的潜在解都可以想象成d维搜索空间上的一个点,我们称之为“粒子”(Particle),所有的粒子都有一个被目标函数决定的适应值(Fitness Value ),每个粒子还有一个速度决定他们飞翔的方向和距离,然后粒子们就追随当前的最优粒子在解空间中搜索。Reynolds对鸟群飞行的研究发现。鸟仅仅是追踪它有限数量的邻居但最终的整体结果是整个鸟群好像在一个中心的控制之下.即复杂的全局行为是由简单规则的相互作用引起的。 二、粒子群算法的具体表述 上面罗嗦了半天,那些都是科研工作者写论文的语气,不过,PSO的历史就像上面说的那样。下面通俗的解释PSO算法。 PSO算法就是模拟一群鸟寻找食物的过程,每个鸟就是PSO中的粒子,也就是我们需要求解问题的可能解,这些鸟在寻找食物的过程中,不停改变自己在空中飞行的位置与速度。大家也可以观察一下,鸟群在寻找食物的过程中,开始鸟群比较分散,逐渐这些鸟就会聚成一群,这个群忽高忽低、忽左忽右,直到最后找到食物。这个过程我们转化为一个数学问题。寻找函数y=1-cos(3*x)*exp(-x)的在[0,4]最大值。该函数的图形如下: 二维粒子群matlab源程序 %function [pso F] = pso_2D() % FUNCTION PSO --------USE Particle Swarm Optimization Algorithm % global present; % close all; clc; clear all; pop_size = 10; % pop_size 种群大小 ///粒子数量 part_size = 2; % part_size 粒子大小 ///粒子的维数gbest = zeros(1,part_size+1); % gbest 当前搜索到的最小的值 max_gen = 200; % max_gen 最大迭代次数 %best=zeros(part_size,pop_size*part_size);%xuan region=zeros(part_size,2); % 设定搜索空间范围->解空间 region=10*[-3,3;-3,3;-3,3;-3,3;-3,3;-3,3;-3,3;-3,3;-3,3;-3,3]; % 每一维设定不同范围(称之为解空间,不是可行域空间) rand('state',sum(100*clock)); % 重置随机数发生器状态 %当前种群的信息矩阵,逐代进化的群体 % 当前位置,随机初始化 % 一个10*3的随机的矩阵(初始化所有粒子的所有维数的位置值),其中最后一列为 arr_present = ini_pos(pop_size,part_size); % 初始化当前速度 % 一个10*2的随机的矩阵(初始化所有粒子的所有维数的速度值) v=ini_v(pop_size,part_size); %不是当前种群,可看作是一个外部的记忆体,存储每个粒子历史最优值(2维数值):根据适应度更新! 程序1 当22111==c c ,5.12212==c c ,2.1=w 。 a)%主函数源程序(main.m ) %------基本粒子群算法 (particle swarm optimization ) %------名称: 基本粒子群算法 %------初始格式化 clear all ; %清除所有变量 clc; %清屏 format long ; %将数据显示为长整形科学计数 %------给定初始条条件------------------ N=40; %3初始化群体个数 D=10; %初始化群体维数 T=100; %初始化群体最迭代次数 c11=2; %学习因子1 c21=2; %学习因子2 c12=1.5; c22=1.5; w=1.2; %惯性权重 eps=10^(-6); %设置精度(在已知最小值的时候用) %------初始化种群个体(限定位置和速度)------------ x=zeros(N,D); v=zeros(N,D); for i=1:N for j=1:D x(i,j)=randn; %随机初始化位置 v(i,j)=randn; %随机初始化速度 end end %------显示群位置---------------------- figure(1) for j=1:D if (rem(D,2)>0) subplot((D+1)/2,2,j) else subplot(D/2,2,j) end plot(x(:,j),'b*');grid on xlabel('粒子') ylabel('初始位置') tInfo=strcat('第',char(j+48),'维'); if(j>9) tInfo=strcat('第',char(floor(j/10)+48),char(rem(j,10)+48),'维'); end title(tInfo) end %------显示种群速度 figure(2) for j=1:D if(rem(D,2)>0) subplot((D+1)/2,2,j) else subplot(D/2,2,j) end plot(x(:,j),'b*');grid on xlabel('粒子') ylabel('初始速度') tInfo=strcat('第,char(j+48),'维'); if(j>9) tInfo=strcat('第',char(floor(j/10)+48), char(rem(j,10)+48),'维); end title(tInfo) end figure(3) %第一个图 subplot(1,2,1) %相关参数的设置 UB=600; %函数的上界 LB=300; %函数的下界 PopSize=40; %种群的大小 Dim=10; %微粒的维数 c1=2; %学习因子 c2=2; %学习因子 w_start=0.9;%惯性权重的开始值 w_end=0.4;%惯性权重的最后值 Vmax=100;%微粒的最大速度 MaxIter=1500;%最大迭代次数 Iter=0;%初始迭代次数 %初始化群和速度 X=rand(PopSize,Dim)*(UB-LB)+LB;%微粒位置随机初始化V=rand(PopSize,Dim);%微粒速度随机初始化; %测试函数:Griewank函数 ind=repmat(1:Dim,PopSize,1); FX=sum(((X.^2)/4000)')'- prod(cos(X./sqrt(ind))')'+1; %设定当前位置为粒子的最好位置,并记录其最好值PBest=X; FPBest=FX; %找到初始微粒群体的最好微粒 [Fgbest,r]=min(FX); CF=Fgbest;%记录当前全局最优值 Best=X(r,:);%用于保存最优粒子的位置 FBest=Fgbest; %循环 while(Iter<=MaxIter) Iter=Iter+1; %更新惯性权重的值; w_now=((w_start-w_end)*(MaxIter-Iter)/MaxIter)+w_end; A=repmat(X(r,:),PopSize,1); %生成随机数 R1=rand(PopSize,Dim); R2=rand(PopSize,Dim); %速度更新 V=w_now*V+c1*R1.*(PBest-X)+c2*R2.*(A-X); %对进化后速度大于最大速度的微粒进行处理 changeRows=V>Vmax; VStep(find(changeRows))=Vmax; %对进化后速度小雨最小速度的微粒进行处理 changeRows=V<-Vmax; V(find(changeRows))=-Vmax; %微粒位置进行更新 X=X+1.0*V; %重新计算新位置的适应度值 ind=repmat(1:Dim,PopSize,1); FX=sum(((X.^2)/4000)')'- prod(cos(X./sqrt(ind))')'+1; %更新每个微粒的最好位置 clear all; clc; format long; %------给定初始化条件---------------------------------------------- c1=1.4962; %学习因子1 c2=1.4962; %学习因子2 w=0.7298; %惯性权重 MaxDT=1000; %最大迭代次数 D=10; %搜索空间维数(未知数个数) N=40; %初始化群体个体数目 eps=10^(-6); %设置精度(在已知最小值时候用) %------初始化种群的个体(可以在这里限定位置和速度的范围)------------ for i=1:N for j=1:D x(i,j)=randn; %随机初始化位置 v(i,j)=randn; %随机初始化速度 end end %------先计算各个粒子的适应度,并初始化Pi和Pg---------------------- for i=1:N p(i)=fitness(x(i,:),D); y(i,:)=x(i,:); end pg=x(1,:); %Pg为全局最优 for i=2:N if fitness(x(i,:),D) %%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%% % 改进的多目标粒子群算法,包括多个测试函数 % 对程序中的部分参数进行修改将更好地求解某些函数 % ZDT1NP=cell(1,50); ZDT1FV=cell(1,50); ZDT1T=zeros(1,50); for i=1:50 tic; %[np,nprule,dnp,fv,goals,pbest]=ParticleSwarmOpt('ZDT1',0.1,50,100,2.0,1.0,0.4,200,30,zer os(1,30),ones(1,30));%--ZDT1 elapsedTime=toc; ZDT1NP(i)={np}; ZDT1FV(i)={fv}; ZDT1T(i)=elapsedTime;display(strcat('ZDT1',num2str(i))); end zdt1fv=cell2mat(ZDT1FV'); zdt1fv=GetLeastFunctionValue(zdt1fv); ZDT2NP=cell(1,50); ZDT2FV=cell(1,50); ZDT2T=zeros(1,50); for i=1:50 tic; %[np,nprule,dnp,fv,goals,pbest]=ParticleSwarmOpt('ZDT2',0.1,50,100,2.0,1.0,0.4,200,30,zer os(1,30),ones(1,30),[1,zeros(1,29)]);%--ZDT2 elapsedTime=toc; ZDT2NP(i)={np}; ZDT2FV(i)={fv}; ZDT2T(i)=elapsedTime;display(strcat('ZDT2',num2str(i))); end zdt2fv=cell2mat(ZDT2FV'); zdt2fv=GetLeastFunctionValue(zdt2fv); %%%%%%%%%%%%%%%%%%%%%%%%%%%5 ZDT3NP=cell(1,50); ZDT3FV=cell(1,50); ZDT3T=zeros(1,50); for i=1:50 tic; % [np,nprule,dnp,fv,goals,pbest]=ParticleSwarmOpt('ZDT3',0.1,50,100,2.0,1.0,0.4,400,30,zeros(1,30 ),ones(1,30));%--ZDT3 elapsedTime=toc; . 程序1 当,,。 5.c?c??cc?2121.w?22111221a)%主函数源程序(main.m) %------基本粒子群算法(particle swarm optimization) %------名称:基本粒子群算法 %------初始格式化 clear all; %清除所有变量 clc; %清屏 format long; %将数据显示为长整形科学计数 %------给定初始条条件------------------ N=40; %3初始化群体个数 D=10; %初始化群体维数 T=100; %初始化群体最迭代次数 c11=2; %学习因子1 c21=2; %学习因子2 c12=1.5; c22=1.5; w=1.2; %惯性权重 eps=10^(-6); %设置精度(在已知最小值的时候用)%------初始化种群个体(限定位置和速度)------------ x=zeros(N,D); v=zeros(N,D); for i=1:N for j=1:D x(i,j)=randn; %随机初始化位置 v(i,j)=randn; %随机初始化速度 end end %------显示群位置---------------------- figure(1) for j=1:D if(rem(D,2)>0) . . subplot((D+1)/2,2,j) else subplot(D/2,2,j) end plot(x(:,j),'b*');grid on xlabel('粒子') ylabel('初始位置') tInfo=strcat('第',char(j+48),'维'); if(j>9) tInfo=strcat('第',char(floor(j/10)+48), char(rem(j,10)+48),'维'); end title(tInfo) end %------显示种群速度 figure(2) for j=1:D if(rem(D,2)>0) subplot((D+1)/2,2,j) else subplot(D/2,2,j) end plot(x(:,j),'b*');grid on xlabel('粒子') ylabel('初始速度') tInfo=strcat('第,char(j+48),'维'); if(j>9) tInfo=strcat('第',char(floor(j/10)+48), char(rem(j,10)+48),'维); end title(tInfo) end figure(3) %第一个图 subplot(1,2,1) . . %------初始化种群个体(在此限定速度和位置)------------x1=x; v1=v; %------初始化个体最优位置和最优值--- p1=x1; 基本粒子群算法的matlab源程序 Posted on 2008-05-07 09:09 realghost 阅读(840) 评论(2)收藏 主函数源程序(main.m) %------基本粒子群优化算法(Particle Swarm Optimization)----------- %------名称:基本粒子群优化算法(PSO) %------作用:求解优化问题 %------说明:全局性,并行性,高效的群体智能算法 %------作者:孙明杰(dreamsun2001@https://www.360docs.net/doc/a815999226.html,) %------单位:中国矿业大学理学院计算数学硕2005 %------时间:2006年8月17日 %------------------------------------------------------------------ %------初始格式化-------------------------------------------------- clear all; clc; format long; %------给定初始化条件---------------------------------------------- c1=1.4962; %学习因子1 c2=1.4962; %学习因子2 w=0.7298; %惯性权重 MaxDT=1000; %最大迭代次数 D=10; %搜索空间维数(未知数个数) N=40; %初始化群体个体数目 eps=10^(-6); %设置精度(在已知最小值时候用) %------初始化种群的个体(可以在这里限定位置和速度的范围)------------ for i=1:N for j=1:D x(i,j)=randn; %随机初始化位置 v(i,j)=randn; %随机初始化速度 end end %------先计算各个粒子的适应度,并初始化Pi和Pg---------------------- for i=1:N p(i)=fitness(x(i,:),D); y(i,:)=x(i,:); end pg=x(1,:); %Pg为全局最优 for i=2:N if fitness(x(i,:),D) 粒子群算法原理及其在函数优化中的应用 1 粒子群优化(PSO )算法基本原理 1.1 标准粒子群算法 假设在一个D 维的目标搜索空间中,有m 个代表问题潜在解的粒子组成一个种群12[,,...,]m =x x x x ,第i 个粒子的信息可用D 维向量表示为 12[,,...,]T i i i iD x x x =x ,其速度为12[,,...,]T i i i iD v v v =v 。算法首先初始化m 个随机粒 子,然后通过迭代找到最优解。每一次迭代中,粒子通过跟踪2个极值进行信息交流,一个是第i 个粒子本身找到的最优解,称之为个体极值,即 12[,,...,]T i i i iD p p p =p ;另一个是所有粒子目前找到的最优解,称之为群体极值, 即12[,,...,]T g g g gD p p p =p 。粒子在更新上述2个极值后,根据式(1)和式(2)更新自己的速度和位置。 11122()()t t t t t t i i i i g i w c r c r +=+-+-v v p x p x (1) 11t t t i i i ++=+x x v (2) 式中,t 代表当前迭代次数,12,r r 是在[0,1]之间服从均匀分布的随机数,12 ,c c 称为学习因子,分别调节粒子向个体极值和群体极值方向飞行的步长,w 为惯性权重,一般在0.1~0.9之间取值。在标准的PSO 算法中,惯性权重w 被设为常数,通常取0.5w =。在实际应用中,x 需保证在一定的围,即x 的每一维的变化围均为min max [,]X X ,这在函数优化问题中相当于自变量的定义域。 1.2 算法实现步骤 步骤1:表示出PSO 算法中的适应度函数()fitness x ;(编程时最好以函数的形式保存,便于多次调用。) 步骤2:初始化PSO 算法中各个参数(如粒子个数,惯性权重,学习因子,最大迭代次数等),在自变量x 定义域随机初始化x ,代入()fitness x 求得适应度值,通过比较确定起始个体极值i p 和全局极值g p 。 步骤3:通过循环迭代更新x 、i p 和g p : ①确定惯性权重w 的取值(当w 不是常数时)。 ②根据式(1)更新粒子的速度1k i +v ,若速度中的某一维超过了max V ,则取为 max V 。 ③根据式(2)更新自变量x ,若x 的取值超过其定义域,则在其定义域重新初 粒子群算法(1)----粒子群算法简介 二、粒子群算法的具体表述 上面罗嗦了半天,那些都是科研工作者写论文的语气,不过,PSO的历史就像上面说的那样。下面通俗的解释PSO算法。 PSO算法就是模拟一群鸟寻找食物的过程,每个鸟就是PSO中的粒子,也就是我们需要求解问题的可能解,这些鸟在寻找食物的过程中,不停改变自己在空中飞行的位置与速度。大家也可以观察一下,鸟群在寻找食物的过程中,开始鸟群比较分散,逐渐这些鸟就会聚成一群,这个群忽高忽低、忽左忽右,直到最后找到食物。这个过程我们转化为一个数学问题。寻找函数y=1-cos(3*x)*exp(-x)的在[0,4]最大值。该函数的图形如下: 当x=0.9350-0.9450,达到最大值y=1.3706。为了得到该函数的最大值,我们在[0,4]之间随机的洒一些点,为了演示,我们放置两个点,并且计算这两个点的函数值,同时给这两个点设置在[0,4]之间的一个速度。下面这些点就会按照一定的公式更改自己的位置,到达新位置后,再计算这两个点的值,然后再按照一定的公式更新自己的位置。直到最后在y=1.3706这个点停止自己的更新。这个过程与粒子群算法作为对照如下: 这两个点就是粒子群算法中的粒子。 该函数的最大值就是鸟群中的食物 计算两个点函数值就是粒子群算法中的适应值,计算用的函数就是粒子群算法中的适应度函数。 更新自己位置的一定公式就是粒子群算法中的位置速度更新公式。 下面演示一下这个算法运行一次的大概过程: 第一次初始化 第一次更新位置 第二次更新位置 第21次更新 最后的结果(30次迭代) 最后所有的点都集中在最大值的地方。粒子群算法通用matlab程序

粒子群算法原理及在函数优化中的应用(附程序)

粒子群算法详解-附matlab代码说明

粒子群算法源程序

粒子群算法matlab(算法已经调试)

粒子群算法 matlab源代码

粒子群优化算法Matlab源程序

多目标粒子群matlab代码【精品文档】(完整版)

6种粒子群算法程序

基本粒子群算法的matlab源程序

粒子群算法原理及在函数优化中的应用(附程序)

粒子群算法matlab代码___吐血推荐