隐马尔科夫模型(原理图解)

隐马尔可夫模型原理

隐马尔可夫模型原理

隐马尔可夫模型(Hidden Markov Model, HMM)是一种用来

描述状态序列的概率模型。

它基于马尔可夫链的理论,假设系统的状态是一个没有直接观察到的随机过程,但可以通过观察到的结果来推断。

HMM的原理可以分为三个关键要素:状态集合、转移概率矩

阵和观测概率矩阵。

1. 状态集合:HMM中的状态是不能直接观测到的,但可以从

观测序列中推断出来。

状态集合可以用S={s1, s2, ..., sn}表示,其中si表示第i个状态。

2. 转移概率矩阵:转移概率矩阵A表示在一个时间步从状态

si转移到状态sj的概率。

可以表示为A={aij},其中aij表示从状态si到状态sj的转移概率。

3. 观测概率矩阵:观测概率矩阵B表示在一个时间步观测到

某个输出的概率。

可以表示为B={bj(o)},其中bj(o)表示在状

态sj下观测到输出o的概率。

通过这些要素,HMM可以用来解决三类问题:

1. 评估问题:给定模型参数和观测序列,计算观测序列出现的概率。

可以使用前向算法或后向算法解决。

2. 解码问题:给定模型参数和观测序列,寻找最可能的状态序

列。

可以使用维特比算法解决。

3. 学习问题:给定观测序列,学习模型的参数。

可以使用Baum-Welch算法进行无监督学习,或使用监督学习进行有标注数据的学习。

总之,HMM是一种可以用来描述随机过程的模型,可以用于许多序列预测和模式识别问题中。

它的简洁性和可解释性使其成为机器学习领域中重要的工具之一。

HMM隐马尔可夫模型解析

M

A B

每个状态可能的观察值数 目

与时间无关的状态转移概 率矩阵 给定状态下,观察值概率 分布 初始状态空间的概率分布

彩球颜色数目

在选定某个缸的情况下, 选择另一个缸的概率 每个缸中的颜色分布 初始时选择某口缸的概率

HMM可解决的问题

评估问题:给定观察序列O=O1,O2,…OT,以及模型λ =(π,A, B), 如何计算P(O|λ)? 算法:Forward-Backward算法 解码问题:给定观察序列O=O1,O2,…OT以及模型λ,如何选 择一个对应的状态序列S = q1,q2,…qT,使得S能够最为合理 的解释观察序列O? 算法:Viterbi算法 学习问题:如何调整模型参数λ =(π,A,B),对于给定观测 值序列O=O1,O2,…OT,使得P(O|λ)最大? 算法:Baum-Welch算法

最后得到一个描述球的颜色的序列O1,O2,…,称为 观察值序列O。

HMM实例——约束

在上述实验中,有几个要点需要注意:

不能被直接观察缸间的转移 从缸中所选取的球的颜色和缸并不是一一对应的 每次选取哪个缸由一组转移概率决定

HMM概念

HMM的状态是不确定或不可见的,只有通过观测 序列的随机过程才能表现出来 观察到的事件与状态并不是一一对应,而是通过 一组概率分布相联系 HMM是一个双重随机过程,两个组成部分: 马尔可夫链:描述状态的转移,用转移概率描 述。 一般随机过程:描述状态与观察序列间的关系, 用观察值概率描述。

马尔可夫链

时间和状态都离散的马尔可夫过程称为马尔可夫链 记作{Xn = X(n), n = 0,1,2,…}

一文搞懂HMM(隐马尔可夫模型)

⼀⽂搞懂HMM(隐马尔可夫模型)什么是熵(Entropy)简单来说,熵是表⽰物质系统状态的⼀种度量,⽤它⽼表征系统的⽆序程度。

熵越⼤,系统越⽆序,意味着系统结构和运动的不确定和⽆规则;反之,,熵越⼩,系统越有序,意味着具有确定和有规则的运动状态。

熵的中⽂意思是热量被温度除的商。

负熵是物质系统有序化,组织化,复杂化状态的⼀种度量。

熵最早来原于物理学. 德国物理学家鲁道夫·克劳修斯⾸次提出熵的概念,⽤来表⽰任何⼀种能量在空间中分布的均匀程度,能量分布得越均匀,熵就越⼤。

1. ⼀滴墨⽔滴在清⽔中,部成了⼀杯淡蓝⾊溶液2. 热⽔晾在空⽓中,热量会传到空⽓中,最后使得温度⼀致更多的⼀些⽣活中的例⼦:1. 熵⼒的⼀个例⼦是⽿机线,我们将⽿机线整理好放进⼝袋,下次再拿出来已经乱了。

让⽿机线乱掉的看不见的“⼒”就是熵⼒,⽿机线喜欢变成更混乱。

2. 熵⼒另⼀个具体的例⼦是弹性⼒。

⼀根弹簧的⼒,就是熵⼒。

胡克定律其实也是⼀种熵⼒的表现。

3. 万有引⼒也是熵⼒的⼀种(热烈讨论的话题)。

4. 浑⽔澄清[1]于是从微观看,熵就表现了这个系统所处状态的不确定性程度。

⾹农,描述⼀个信息系统的时候就借⽤了熵的概念,这⾥熵表⽰的是这个信息系统的平均信息量(平均不确定程度)。

最⼤熵模型我们在投资时常常讲不要把所有的鸡蛋放在⼀个篮⼦⾥,这样可以降低风险。

在信息处理中,这个原理同样适⽤。

在数学上,这个原理称为最⼤熵原理(the maximum entropy principle)。

让我们看⼀个拼⾳转汉字的简单的例⼦。

假如输⼊的拼⾳是"wang-xiao-bo",利⽤语⾔模型,根据有限的上下⽂(⽐如前两个词),我们能给出两个最常见的名字“王⼩波”和“王晓波 ”。

⾄于要唯⼀确定是哪个名字就难了,即使利⽤较长的上下⽂也做不到。

当然,我们知道如果通篇⽂章是介绍⽂学的,作家王⼩波的可能性就较⼤;⽽在讨论两岸关系时,台湾学者王晓波的可能性会较⼤。

隐马尔可夫模型.pptx

第28页/共85页

学习问题

• Baum-Welch重估计公式

• 已知X和 的情况下,t时刻为状态i,t+1时刻为状态j的后验概率

θ

ij

(t

)

i

(t

1)aij P(XT

b |

jk

θ)

j

(t

)

向前

向后

T

jl (t)

t 1 l

bˆ v(t )vk

jk

T

jl (t)

t 1 l

第29页/共85页

例如:ML估计

第10页/共85页

估值问题

• 直接计算HMM模型产生可见长度为T的符号序列X的概率

其中,

表示状态 的初始概率

假设HMM中有c个隐状态,则计算复杂度为

!

例如:c=10,T=20,基本运算1021次!

(1)

第11页/共85页

O(cTT )

估值问题

• 解决方案

• 递归计算

t时刻的计算仅涉及上一步的结果,以及

x1和x3统计独立,而 其他特征对不独立

第32页/共85页

相关性例子

• 汽车的状态 • 发动机温度 • 油温 • 油压 • 轮胎内气压

• 相关性 • 油压与轮胎内气压相互独立 • 油温与发动机温度相关

第33页/共85页

贝叶斯置信网

• 用图的形式来表示特征之间的因果依赖性 • 贝叶斯置信网(Bayesian belief net) • 因果网(causal network) • 置信网(belief net)

P(θi )

P(θi | X)

θi P(X | θi )

第20页/共85页

解码问题

马尔科夫模型(转载)

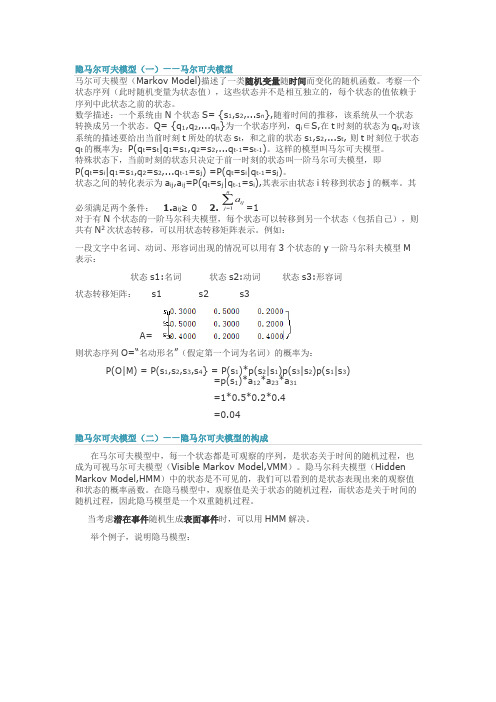

隐马尔可夫模型(一)——马尔可夫模型马尔可夫模型(Markov Model)描述了一类随机变量随时间而变化的随机函数。

考察一个状态序列(此时随机变量为状态值),这些状态并不是相互独立的,每个状态的值依赖于序列中此状态之前的状态。

数学描述:一个系统由N个状态S= {s1,s2,...s n},随着时间的推移,该系统从一个状态转换成另一个状态。

Q= {q1,q2,...q n}为一个状态序列,q i∈S,在t时刻的状态为q t,对该系统的描述要给出当前时刻t所处的状态s t,和之前的状态s1,s2,...s t, 则t时刻位于状态q t的概率为:P(q t=s t|q1=s1,q2=s2,...q t-1=s t-1)。

这样的模型叫马尔可夫模型。

特殊状态下,当前时刻的状态只决定于前一时刻的状态叫一阶马尔可夫模型,即P(q t=s i|q1=s1,q2=s2,...q t-1=s j) =P(q t=s i|q t-1=s j)。

状态之间的转化表示为a ij,a ij=P(q t=s j|q t-1=s i),其表示由状态i转移到状态j的概率。

其必须满足两个条件: 1.a ij≥ 0 2.=1对于有N个状态的一阶马尔科夫模型,每个状态可以转移到另一个状态(包括自己),则共有N2次状态转移,可以用状态转移矩阵表示。

例如:一段文字中名词、动词、形容词出现的情况可以用有3个状态的y一阶马尔科夫模型M 表示:状态s1:名词状态s2:动词状态s3:形容词状态转移矩阵: s1 s2 s3A=则状态序列O=“名动形名”(假定第一个词为名词)的概率为:P(O|M) = P(s1,s2,s3,s4} = P(s1)*p(s2|s1)p(s3|s2)p(s1|s3)=p(s1)*a12*a23*a31=1*0.5*0.2*0.4=0.04在马尔可夫模型中,每一个状态都是可观察的序列,是状态关于时间的随机过程,也成为可视马尔可夫模型(Visible Markov Model,VMM)。

马尔科夫和隐马尔科夫模型

一、Morkov模型

1913年俄国数学家马尔柯夫发现:某些事物的概率变化过程中,

第n次试验的结果常由第n-1次试验的结果决定。在学术研究上

把这种无后效的随机过程称为马尔柯夫过程。

一、Morkov模型

马尔可夫过程:在事件的发展过程中,若每次状态的转移都仅 与前一时刻的状态有关而与过去的状态无关,这样的状态转移 过程就称为马尔可夫过程。

f (0,1) 1, f (1, 0) 0.5 g(0,1) 0, g(1, 0) 0.5

关系式给出了问题的模型。满足条件的f 和g很多, 须确定它们的具体形式。在满足所有条件后,通常 取最简单的方案。如成功,问题就简单解决了;如 失败,可修正。

本题最简单的是假定f 和g都是自变量的 线性函数,即:

qk

1 yk 1

0.5qk 0.5qk

yk

qk 1

0.5qk

0.5qk 1

0.5(qk

qk 0.5qk 10.5qk 2

qk 1 )

0.75qk 1

0.25qk2

yk1 0.25qk1 0.25qk2

qk1 yk1 qk yk 1

1 0.5 0 0.5

1 0

0.75 0.25

0.5 0.5

P3

0.75 0.25

0.5 0.5 0.5 0.5

1 0

0.625 0.375

0.75 0.25

P1

0.5 0.5

1 0

P2

0.75 0.25

时刻t,处在状态i,并且部分 观察序列为o1o2o3…ot的概率。

前向算法

HMM隐马尔可夫模型在自然语言处理中的应用

HMM隐马尔可夫模型在自然语言处理中的应用隐马尔可夫模型(Hidden Markov Model,HMM)是自然语言处理中常用的一种概率统计模型,它广泛应用于语音识别、文本分类、机器翻译等领域。

本文将从HMM的基本原理、应用场景和实现方法三个方面,探讨HMM在自然语言处理中的应用。

一、HMM的基本原理HMM是一种二元组( $λ=(A,B)$),其中$A$是状态转移矩阵,$B$是观测概率矩阵。

在HMM中,状态具有时序关系,每个时刻处于某一状态,所取得的观测值与状态相关。

具体来说,可以用以下参数描述HMM模型:- 隐藏状态集合$S={s_1,s_2,...,s_N}$:表示模型所有可能的状态。

- 观测符号集合$V={v_1,v_2,...,v_M}$:表示模型所有可能的观测符号。

- 初始状态分布$\pi={\pi (i)}$:表示最初处于各个状态的概率集合。

- 状态转移矩阵$A={a_{ij}}$:表示从$i$状态转移到$j$状态的概率矩阵。

- 观测概率矩阵$B={b_j(k)}$:表示处于$j$状态时,观测到$k$符号的概率。

HMM的主要任务是在给定观测符号序列下,求出最有可能的对应状态序列。

这个任务可以通过HMM的三种基本问题求解。

- 状态序列概率问题:已知模型参数和观测符号序列,求得该观测符号序列下各个状态序列的概率。

- 观测符号序列概率问题:已知模型参数和状态序列,求得该状态序列下观测符号序列的概率。

- 状态序列预测问题:已知模型参数和观测符号序列,求得使得观测符号序列概率最大的对应状态序列。

二、HMM的应用场景1. 语音识别语音识别是指将语音信号转化成文字的过程,它是自然语言处理的关键技术之一。

HMM在语音识别领域具有广泛应用,主要用于建立声学模型和语言模型。

其中,声学模型描述语音信号的产生模型,是从语音输入信号中提取特征的模型,而语言模型描述语言的组织方式,是指给定一个句子的前提下,下一个字或单词出现的可能性。

隐马尔科夫(HMM)模型详解及代码实现

机器学习之隐马尔科夫模型(HMM)机器学习之隐马尔科夫模型(HMM)1、隐马尔科夫模型介绍2、隐马尔科夫数学原理3、Python代码实现隐马尔科夫模型4、总结隐马尔可夫模型介绍马尔科夫模型(hidden Markov model,HMM)是关于时序的概率模型,描述由一个隐藏的马尔科夫随机生成不可观测的状态随机序列,再由各个状态生成一个观测从而产生观测随机序列的过程,属于一个生成模型。

下面我们来从概率学角度定义马尔科夫模型,从一个典型例子开始:假设有4个盒子,每个盒子里面有不同数量的红、白两种颜色的球,具体如下表:盒子编号1234红球数5368白球数5742现在从这些盒子中取出T个球,取样规则为每次选择一个盒子取出一个球,记录其颜色,放回。

在这个过程中,我们只能观测到球的颜色的序列,观测不到球是从哪个盒子中取出来的,即观测不到盒子的序列,这里有两个随机序列,一个是盒子的序列(状态序列),一个是球的颜色的观测序列(观测序列),前者是隐藏的,只有后者是可观测的。

这里就构成了一个马尔科夫的例子。

定义是所有的可能的状态集合,V是所有的可能的观测的集合:其中,N是可能的状态数,M是可能的观测数,例如上例中N=4,M=2。

是长度为T的状态序列,是对应的观测序列:A是状态转移概率矩阵:其中, 是指在时刻处于状态的条件下在时刻转移到状态的概率。

B是观测概率矩阵:其中, 是指在时刻处于状态的条件下生成观测的概率。

是初始状态概率向量:其中, 是指在时刻=1处于状态的概率。

由此可得到,隐马尔可夫模型的三元符号表示,即称为隐马尔可夫模型的三要素。

由定义可知隐马尔可夫模型做了两个基本假设:(1)齐次马尔科夫性假设,即假设隐藏的马尔科夫链在任意时刻的状态只和-1状态有关;(2)观测独立性假设,观测只和当前时刻状态有关;仍以上面的盒子取球为例,假设我们定义盒子和球模型:状态集合: = {盒子1,盒子2,盒子3,盒子4}, N=4观测集合: = {红球,白球} M=2初始化概率分布:状态转移矩阵:观测矩阵:(1)转移概率的估计:假设样本中时刻t处于状态i,时刻t+1转移到状态j 的频数为那么转台转移概率的估计是:(2)观测概率的估计:设样本中状态为j并观测为k的频数是那么状态j观测为k的概率, (3)初始状态概率的估计为S个样本中初始状态为的频率。

《隐马尔可夫模型》课件

隐马尔可夫模型在许多领域都有应用,如语音识 别、自然语言处理、生物信息学和金融预测等。

隐马尔可夫模型的应用领域

01

语音识别

用于将语音转换为文本,或识别说 话人的意图。

生物信息学

用于分析基因序列、蛋白质序列和 代谢物序列等。

03 隐马尔可夫模型的建立

观察概率矩阵的确定

总结词

观察概率矩阵描述了在给定状态下,观察到不同状态的概率 分布。

详细描述

观察概率矩阵是隐马尔可夫模型中的重要组成部分,它表示 了在给定状态下,观察到不同状态的概率分布。例如,在语 音识别中,观察概率矩阵可以表示在特定语音状态下发出不 同音素的概率。

状态转移概率矩阵的确定

VS

原理

通过动态规划找到最大概率的路径,该路 径对应于最可能的隐藏状态序列。

05 隐马尔可夫模型的优化与 改进

特征选择与模型参数优化

要点一

特征选择

选择与目标状态和观测结果相关的特征,提高模型预测准 确率。

要点二

模型参数优化

通过调整模型参数,如状态转移概率和观测概率,以改进 模型性能。

高阶隐马尔可夫模型

初始状态概率分布表示了隐马尔可夫模型在初始时刻处于各个状态的概率。这个概率分布是隐马尔可 夫模型的重要参数之一,它决定了模型在初始时刻所处的状态。在某些应用中,初始状态概率分布可 以根据具体问题来确定,也可以通过实验数据来估计。

04 隐马尔可夫模型的训练与 预测

前向-后向算法

前向算法

用于计算给定观察序列和模型参 数下,从初始状态到某个终止状 态的所有可能路径的概率。

《隐马尔可夫模型》 ppt课件

第9章 隐马尔可夫模型(HMM)(-52)

O {O1, O2 , OT }

A 状态转移概率分布

A {aij}, aij P[S j Si ],1 i, j N

B 状态的观测符号概率分布

B {bj (k )}, bj (k ) P[vk | S j ],1 j N ,1 k M

初始状态的概率分布

设观察到的输出符号序列是aab。试求aab的输出概率?

a 0.8 b 0.2

a11 0.3

a22

0.4

a b

0.3 0.7

a12 0.5

S1 a 1

S2

a23 0.6

a 0.5

b 0

b 0.5

S3

a13 0.2

a 1 b 0

从S1到S3,并且输出aab,可能的路径有三种: S1 S1 S2 S3 0.3×0.8×0.5×1×0.6×0.5=0.036

S1 S2 S2 S3 S1 S1 S1 S3

0.5×1×0.4×0.3×0.6×0.5=0.018 0.3×0.8×0.3×0.8×0.2×0=0

由于是隐HMM模型,不知输出aab时,到底 是经过了哪一条不同状态组成的路径,因此,求 aab的输出概率时,将每一种可能路径的的输出概 率相加得到的总的概率值作为aab的输出概率值:

y1

{X1,X2,..XN}

y2

{o1,o2,..oN}

yJ 码本

4. 用这组符号{o1,o2,..oN}计算在每个HMM上 的输出概率,输出概率最大的HMM对应的孤立字, 就是识别结果。

{o1,o2,..oN}

语

S1

S2

文

S1

S2

S3

音

S3

学

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

3

总结

11

山东大学高性能计算与大数据处理学科组

1.隐马尔可夫模型-路径预测

问题2:给定观察序列O=O1,O2, …,OT,以及模型λ,如何推测最可能的状态序列S ?

1 (1)

t=1

Π:初始概率向 量

2 (1)

S1t=3

3 (1)

T (1)

S1 t=2

St=T-1 1

S1t=T

S1

a01 a02

B生成概率矩阵

…

…

…

…

SN

SN

OT

…

HMM模型五元组表示:λ =( N, M, π , A, B)用来描述HMM,或简写为 λ =(π , A, B)

6

…

…

…

…

OM

…

山东大学高性能计算与大数据处理学科组

提 纲

1 2

Hidden Markov Model 隐马尔科夫模型的三个问题

概率计算问题

路径预测问题

参数学习问题

3

总结

7

山东大学高性能计算与大数据处理学科组

1. 隐马尔可夫模型-全概率计算 问题1:给定观察序列O=O1,O2, …,OT,以及模型λ=(π,A,B),计算P(O|λ)?

t=1

Π:初始概率向 量

1 (1)

t=2

2 (1)

t=3

3 (1)

S1

t=T-1

T (1)

t=T

H M M

… … … …

Q Q1 1 Q2

Q1 Q2 一般随机过程 观察状态序列

…

…

QM

t=2

…

QM

t=3

…

QM

t=T-1

…

QM

t=T

…

4

山东大学高性能计算与大数据处理学科组

4. 隐马尔可夫模型(Hidden Markov Models,HMM)

一阶隐马尔可夫模型(Hidden Markov Models)图解

E

A转移概率矩阵

a0N

…

1 (4)

S4S

…

N

2 (4)

S4S

…

3 (4)

S4S

…

T (4)

S4 S

…

B生成概率矩阵

SN a05

N

N

N

a5-0

1 (5)

S5

?S

2 (5)

5

3 (5)

S5

T (5)

9

山东大学高性能计算与大数据处理学科组

3. 概率计算问题:后向算法(Forward Algorithm) 问题1:给定观察序列O=O1,O2, …,OT,以及模型λ=(π,A,B),如何计算P(O|λ)? 结束阶段

1

中间递归阶段(t = T-1,…, 2,1)

t t+1

初始化阶段(t = T)

t (k ) ak l bl (ot 1 )t 1 (l )

l 1

T (k ) ak 0 bk (oT )

10

山东大学高性能计算与大数据处理学科组

提 纲

1 2

Hidden Markov Model 隐马尔科夫模型的三个问题

概率计算问题

路径预测问题

参数学习问题

……

SN

aN ,1

S1

一条马尔可夫链

2

山东大学高性能计算与大数据处理学科组

2. 一阶马尔可夫模型概念

一阶马尔可夫模型(Markov Models)

t=1 系统状态数目(N=3)

t=2

t=3

t=4

t=5

S1

a11 a13 a12

S1

a11 a12

S1

a11 a12

S1

a11 a12

S1

S1 S2 S3

P(O | )

1 (k ) a0k bk (o1 )

8

…

问题本质:计算产生观测序列O的所有可能的状态序列对应的概率之和

QST

…

…

…

…

…

Pr(O,Q | )= Pr(O, 路径Q |)+Pr(O, 路径Q |)++Pr(O, 路径Q

t=1 t=2

1

O1

O2

O3

S1

a11

S1 S1

a11

S1 S1

a01

a (2) a 01 12 1 a13

S2

a12 2 (2)

S2

3 (2)

S1

a11

S1 S1

a01 a 前 02 向 a 0N 算

π

a02

B

aa a21 21 02 S2 a22 (3) S2 a22 2 (3) S2 1 a23 a23 a03 S3 S3

晴

阴

a21 S2 a22 a23 a31

S3

a21 S2 a22 a23

a21 S2 a22 a23

a21 S2 a22 a23

S2

雨

a32 a33

S3

a32 a33

S3

a32 a33

S3

a32 a33

S3

•

从某时刻状态到下时刻的状态按一定概率转移

•

下时期状态只取决于当前时期状态和转移概率

aij P(qt S j | qt 1 Si )

t=3

O4

2

t=4

NT

| )

N

共 N T 个可能路径(指数级计算) N P(O| ) T (k)ak 0 t (k ) t 1 (l )alk bk (ot ) k 1 l 1

N=5, T=100, => 计算量10^72

山东大学高性能计算与大数据处理学科组

…S2

…S 3

S4

a12T (2)

S2

aT1

AN *N

aT2 a21 z S 3 (3) S2 a22 T (3) S 2 2 aT3 a23

S3

a11 a12 a1N a a a 2 N 21 22 a a a NN N 1 N 2

t=1

转移概率

t=2

t=3

t=4

t=5

S1

a11 a13 a12

S1

a11 a12

S S1 1

a11 a12

S1 1

a11 a12

S1

I-隐藏状态

a21 a22 S2 2 a23 a31

S3

a21 S2 a22 a23 a32 a33

a21 S2 a22 a23 a32 a33

a21 S2 a22 a23 a32 a33

S1

隐 藏 状 态

S1 S2

S1 S2

S1 S2 S3

… …

S1 S2 S3

S1 S1 2 S3 马儿科夫过程 隐藏状态序列

S2 S3

a23

S3 S3

a31

… …

Q1

观 测 状 态

Q2

QM QM

t=1

…

SN

aN 1

Q Q1 1 Q2

…

SN

Q1 Q2

…

SN

状态序列≠观测序列

Q1 Q2

…

SN

…ቤተ መጻሕፍቲ ባይዱ

SN

…

SN

隐马尔可夫模型原理图解

Hidden Markov Models

提 纲

1 2

Markov Model Model Hidden Markov

隐马尔科夫模型的三个问题

概率计算问题

路径预测问题

参数学习问题

3

总结

1

山东大学高性能计算与大数据处理学科组

1马尔可夫模型

马尔可夫模型是数学中具有马尔可夫性质的离散时间随机过程,是用于描述随机

1 (2) S

S2

1

2 (2)

S2

S1

3 (2)

a01

…

…

S2

S1 1

T (2) S

S2

1

a1-0 a2-0

AN *N

a01 a π 02 viterbi 算法 a0 N

a02

B

S2

a03

aN1 a04

1 (3)

2 (3)

S5 OT

b11 12 1M b b b2 M 21 22 bNM bN 1 bN 2

后 向 算 B生成概率矩阵 法 b b

2. 概率计算问题:前向算法(Forward Algorithm) 问题1:给定观察序列O=O1,O2, …,OT,以及模型λ=(π,A,B),如何计算P(O|λ)? 初始化阶段(t = 1)

1

中间递归阶段(t = 2,…,T)

t-1 t T

结束阶段

T (1)

a10

S1

1 (1)

…… ……

SN

t (N)

……

bk (ot )

a N 0

SN T (N)

O1

Ot-1

Ot

……

OT

P(O| ) T (k)ak 0

k 1 N

前进

N t (k ) t 1 (l )alk bk (ot ) l 1

前进

N=5, T=100, => 计算量3000

t-1时刻

5

P(qt S j | qt 1 Si , qt 2 Sk ,) P(qt S j | qt 1 Si )