bpnn模型原理

BP神经网络模型分析

BP神经网络模型分析自动化1001 31002369 潘飞摘要:本文介绍了BP网络模型、基本原理、算法以及研究现状。

关键词:BP网络基本原理结构模型1引言BP(Back Propagation)网络是1986年由Rumelhart和McCelland为首的科学家小组提出,是一种按误差逆传播算法训练的多层前馈网络,是目前应用最广泛的神经网络模型之一2BP神经网络的基本原理BP (Back Propagation)神经网络,即误差反传误差反向传播算法的学习过程,由信息的正向传播和误差的反向传播两个过程组成。

输入层各神经元负责接收来自外界的输入信息,并传递给中间层各神经元;中间层是内部信息处理层,负责信息变换,根据信息变化能力的需求,中间层可以设计为单隐层或者多隐层结构;最后一个隐层传递到输出层各神经元的信息,经进一步处理后,完成一次学习的正向传播处理过程,由输出层向外界输出信息处理结果。

当实际输出与期望输出不符时,进入误差的反向传播阶段。

误差通过输出层,按误差梯度下降的方式修正各层权值,向隐层、输入层逐层反传。

周而复始的信息正向传播和误差反向传播过程,是各层权值不断调整的过程,也是神经网络学习训练的过程,此过程一直进行到网络输出的误差减少到可以接受的程度,或者预先设定的学习次数为止。

BP神经网络模型BP网络模型包括其输入输出模型、作用函数模型、误差计算模型和自学习模型。

(1)节点输出模型隐节点输出模型:Oj=f(∑Wij×Xi-qj) (1)输出节点输出模型:Yk=f(∑Tjk×Oj-qk) (2)f-非线形作用函数;q -神经单元阈值。

图1 典型BP网络结构模型图表 1 BP网络结构(2)作用函数模型作用函数是反映下层输入对上层节点刺激脉冲强度的函数又称刺激函数,一般取为(0,1)内连续取值Sigmoid函数: f(x)=1/(1+e) (3)(3)误差计算模型误差计算模型是反映神经网络期望输出与计算输出之间误差大小的函数:Ep=1/2×∑(tpi-Opi) (4)tpi- i节点的期望输出值;Opi-i节点计算输出值。

BP神经网络原理及应用

BP神经网络原理及应用1 人工神经网络简介1.1生物神经元模型神经系统的基本构造是神经元(神经细胞),它是处理人体各部分之间相互信息传递的基本单元。

据神经生物学家研究的结果表明,人的大脑一般有1011个神经元。

每个神经元都由一个细胞体,一个连接其他神经元的轴突1010和一些向外伸出的其它较短分支——树突组成。

轴突的功能是将本神经元的输出信号(兴奋)传递给别的神经元。

其末端的许多神经末梢使得兴奋可以同时送给多个神经元。

树突的功能是接受来自其它神经元的兴奋。

神经元细胞体将接受到的所有信号进行简单地处理后由轴突输出。

神经元的树突与另外的神经元的神经末梢相连的部分称为突触。

1.2人工神经元模型神经网络是由许多相互连接的处理单元组成。

这些处理单元通常线性排列成组,称为层。

每一个处理单元有许多输入量,而对每一个输入量都相应有一个相关联的权重。

处理单元将输入量经过加权求和,并通过传递函数的作用得到输出量,再传给下一层的神经元。

目前人们提出的神经元模型已有很多,其中提出最早且影响最大的是1943年心理学家McCulloch和数学家Pitts在分析总结神经元基本特性的基础上首先提出的M-P 模型,它是大多数神经网络模型的基础。

)()(1∑=-=ni j i ji j x w f t Y θ (1.1)式(1.1)中,j 为神经元单元的偏置(阈值),ji w 为连接权系数(对于激发状态,ji w 取正值,对于抑制状态,ji w 取负值),n 为输入信号数目,j Y 为神经元输出,t 为时间,f()为输出变换函数,有时叫做激发或激励函数,往往采用0和1二值函数或S形函数。

1.3人工神经网络的基本特性人工神经网络由神经元模型构成;这种由许多神经元组成的信息处理网络具有并行分布结构。

每个神经元具有单一输出,并且能够与其它神经元连接;存在许多(多重)输出连接方法,每种连接方法对应一个连接权系数。

严格地说,人工神经网络是一种具有下列特性的有向图:(1)对于每个节点存在一个状态变量xi ;(2)从节点i 至节点j ,存在一个连接权系数wji ; (3)对于每个节点,存在一个阈值j ;(4)对于每个节点,定义一个变换函数(,,),j i ji j f x w i j θ≠,对于最一般的情况,此函数取()j ji i j if w x θ-∑形式。

bp神经网络的原理

bp神经网络的原理BP神经网络(也称为反向传播神经网络)是一种基于多层前馈网络的强大机器学习模型。

它可以用于分类、回归和其他许多任务。

BP神经网络的原理基于反向传播算法,通过反向传播误差来调整神经网络的权重和偏差,从而使网络能够学习和适应输入数据。

BP神经网络的基本结构包括输入层、隐藏层和输出层。

每个层都由神经元组成,每个神经元都与上一层的所有神经元连接,并具有一个权重值。

神经元的输入是上一层的输出,通过加权和和激活函数后得到输出。

通过网络中的连接和权重,每层的输出被传递到下一层,最终得到输出层的结果。

BP神经网络的训练包括两个关键步骤:前向传播和反向传播。

前向传播是指通过网络将输入数据从输入层传递到输出层,计算网络的输出结果。

反向传播是基于网络输出结果与真实标签的误差,从输出层向输入层逆向传播误差,并根据误差调整权重和偏差。

在反向传播过程中,通过计算每个神经元的误差梯度,我们可以使用梯度下降算法更新网络中的权重和偏差。

误差梯度是指误差对权重和偏差的偏导数,衡量了误差对于权重和偏差的影响程度。

利用误差梯度,我们可以将误差从输出层反向传播到隐藏层和输入层,同时更新每层的权重和偏差,从而不断优化网络的性能。

通过多次迭代训练,BP神经网络可以逐渐减少误差,并提高对输入数据的泛化能力。

然而,BP神经网络也存在一些问题,如容易陷入局部最优解、过拟合等。

为了克服这些问题,可以采用一些技巧,如正则化、随机初始权重、早停等方法。

总结而言,BP神经网络的原理是通过前向传播和反向传播算法来训练网络,实现对输入数据的学习和预测。

通过调整权重和偏差,网络可以逐渐减少误差,提高准确性。

BP神经网络与卷积神经网络(CNN)

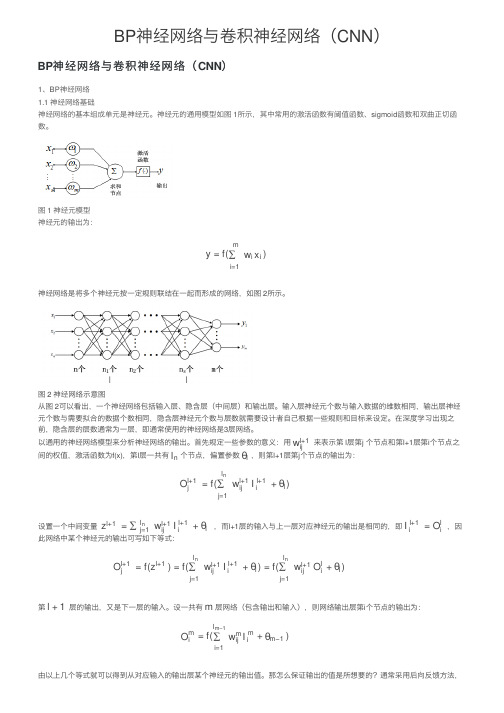

BP 神经⽹络与卷积神经⽹络(CNN )BP 神经⽹络与卷积神经⽹络(CNN )1、BP 神经⽹络 1.1 神经⽹络基础神经⽹络的基本组成单元是神经元。

神经元的通⽤模型如图 1所⽰,其中常⽤的激活函数有阈值函数、sigmoid 函数和双曲正切函数。

图 1 神经元模型 神经元的输出为:神经⽹络是将多个神经元按⼀定规则联结在⼀起⽽形成的⽹络,如图 2所⽰。

图 2 神经⽹络⽰意图从图 2可以看出,⼀个神经⽹络包括输⼊层、隐含层(中间层)和输出层。

输⼊层神经元个数与输⼊数据的维数相同,输出层神经元个数与需要拟合的数据个数相同,隐含层神经元个数与层数就需要设计者⾃⼰根据⼀些规则和⽬标来设定。

在深度学习出现之前,隐含层的层数通常为⼀层,即通常使⽤的神经⽹络是3层⽹络。

以通⽤的神经⽹络模型来分析神经⽹络的输出。

⾸先规定⼀些参数的意义:⽤ 来表⽰第 l 层第j 个节点和第l+1层第i 个节点之间的权值,激活函数为f(x),第l 层⼀共有 个节点,偏置参数 ,则第l+1层第j 个节点的输出为:设置⼀个中间变量 ,⽽l+1层的输⼊与上⼀层对应神经元的输出是相同的,即 ,因此⽹络中某个神经元的输出可写如下等式:第 层的输出,⼜是下⼀层的输⼊。

设⼀共有 层⽹络(包含输出和输⼊),则⽹络输出层第i 个节点的输出为:由以上⼏个等式就可以得到从对应输⼊的输出层某个神经元的输出值。

那怎么保证输出的值是所想要的?通常采⽤后向反馈⽅法,y =f()∑i=1mw i x i w l+1ij l n θl =f(+)O l+1j ∑j=1l nw l+1ij I l+1iθl =+z l+1∑l nj=1w l+1ij I l+1i θl =I l+1i O l i=f()=f(+)=f(+)O l+1jzl+1∑j=1l nw l+1ij I l+1i θl ∑j=1l nw l+1ij O li θl l +1m =f(+)O m i∑i=1l m−1w m ij I mi θm−1将误差层层传递,并利⽤梯度下降法更新每⼀层的参数,这就是BP 神经⽹络。

B-P神经网络算法原理

BP网络模型处理信息的基本原理是:输入信号X i通过中间节点(隐层点)作用于输出节点,经过非线形变换,产生输出信号Y k,网络训练的每个样本包括输入向量X和期望输出量t,网络输出值Y与期望输出值t之间的偏差,通过调整输入节点与隐层节点的联接强度取值W ij和隐层节点与输出节点之间的联接强度T jk以及阈值,使误差沿梯度方向下降,经过反复学习训练,确定与最小误差相对应的网络参数(权值和阈值),训练即告停止。

此时经过训练的神经网络即能对类似样本的输入信息,自行处理输出误差最小的经过非线形转换的信息。

一 BP神经网络模型BP网络模型包括其输入输出模型、作用函数模型、误差计算模型和自学习模型。

(1)节点输出模型隐节点输出模型:O j=f(∑W ij×X i-q j) (1)输出节点输出模型:Y k=f(∑T jk×O j-q k) (2)f-非线形作用函数;q -神经单元阈值。

(2)作用函数模型作用函数是反映下层输入对上层节点刺激脉冲强度的函数又称刺激函数,一般取为(0,1)内连续取值Sigmoid函数: f(x)=1/(1+e-x) (3)(3)误差计算模型误差计算模型是反映神经网络期望输出与计算输出之间误差大小的函数:E p=1/2×∑(t pi-O pi)2 (4)t pi- i节点的期望输出值;O pi-i节点计算输出值。

(4)自学习模型神经网络的学习过程,即连接下层节点和上层节点之间的权重拒阵W ij的设定和误差修正过程。

BP网络有师学习方式-需要设定期望值和无师学习方式-只需输入模式之分。

自学习模型为△W ij(n+1)= h ×Фi×O j+a×△W ij(n) (5)h -学习因子;Фi-输出节点i的计算误差;O j-输出节点j的计算输出;a-动量因子。

二 BP网络模型的缺陷分析及优化策略(1)学习因子h 的优化采用变步长法根据输出误差大小自动调整学习因子,来减少迭代次数和加快收敛速度。

BP神经网络原理研究与实现

BP神经网络原理研究与实现

韩普;周汉辰;周北望

【期刊名称】《广播电视信息》

【年(卷),期】2018(000)010

【摘要】本文介绍了BP神经网络(BPNN)的结构模型及对神经网络进行训练和测试的有关概念,对BPNN向前传播及向后传播的数学原理进行了详细推导,对梯度下降算法进行了深入讨论.作为对BPNN的运用和检验,作者按照BPNN的原理编写了一款软件工具(BPNNsoft),并在MNIST数据集上进行训练和测试,论文最后对训练和测试情况进行了简要说明和分析.

【总页数】5页(P121-125)

【作者】韩普;周汉辰;周北望

【作者单位】陕西广电网络传媒(集团)股份有限公司;上海交通大学;陕西广电网络传媒(集团)股份有限公司

【正文语种】中文

【相关文献】

1.基于Gabor滤波器组与BP神经网络的帘子布疵点检测研究与实现 [J], 张五一;杨扬;林聪;温盛军

2.基于BP神经网络的人体行为识别方法研究与实现 [J], 吴婷;周宇

3.基于BP神经网络和APIT室内定位算法的研究与实现 [J], 闫思锐;汪学明

4.基于BP神经网络虚拟人运动控制方法的研究与实现 [J], 姜艳秋;叶瑰昀;杨爱军

5.基于Spark框架的BP神经网络多分类算法的研究与实现 [J], 王明松

因版权原因,仅展示原文概要,查看原文内容请购买。

BP网络的原理与应用

BP网络的原理与应用1. 简介BP神经网络,即反向传播神经网络(Back Propagation Neural Network),是一种常见的人工神经网络模型,广泛应用于模式识别、分类、预测等领域。

它通过训练数据进行反向传播的方式来调整神经网络的权重和偏置,从而实现对输入数据的学习和预测。

2. 原理BP神经网络由输入层、隐藏层和输出层构成,每层由多个神经元组成。

其中,输入层接收外界输入的数据,隐藏层进行信号的处理和转换,最终输出层给出模型的预测结果。

BP网络的训练过程主要由两个阶段组成:前向传播和反向传播。

2.1 前向传播在前向传播阶段,输入数据经过一次性的计算和传递,从输入层逐层向前,最终记录到输出层的神经元中。

具体步骤如下: 1. 将输入数据传递给输入层神经元,每个神经元计算输入数据与其对应权重和偏置的乘积之和。

2. 将计算结果经过激活函数(如Sigmoid函数)进行处理,得到隐藏层神经元的输出。

3. 重复以上步骤,将隐藏层的输出作为下一层的输入,直到传递到输出层。

2.2 反向传播在反向传播阶段,根据训练数据与实际输出之间的差距,计算输出误差,并根据误差大小调整权重和偏置,以达到提高网络性能的目的。

具体步骤如下: 1. 计算输出层的误差,即实际输出与训练数据的差值。

2. 通过链式法则逐层计算隐藏层的误差,以及权重和偏置的调整值。

3. 更新每个神经元的权重和偏置,通过选择合适的优化算法(如梯度下降法)进行调整。

4. 重复以上步骤,通过多次迭代,不断减小预测误差和损失函数,提高网络的精确度和泛化能力。

3. 应用BP神经网络广泛应用于许多领域,如图像识别、语音识别、文本分类、金融预测等。

下面列举一些常见的应用场景:•图像识别:通过训练大量图像数据,可以实现对不同物体、人脸等的自动识别和分类。

•语音识别:通过训练大量语音数据,可以实现对语音信号的识别和转换,用于语音助手、智能家居等。

•文本分类:通过训练大量文本数据,可以实现对文本内容的分类和情感分析,用于垃圾邮件过滤、情感识别等。

烧结配料过程焦粉最低配比计算方法

烧结配料过程焦粉最低配比计算方法马俊杰;吴敏;李勇【摘要】In actual sintering process, ratios of coal are widely determined by experience. Meanwhile, the consumption models of coal built from many sintering experiments and statistics are too complicated to apply in sintering process. This paper proposed a minimal coke consumption calculating method. Firstly, a BPNN temperature field model of different BTP (burning through point) and thickness is worked out according to isotherm data from actual sintering process. Secondly, the samples of the relationship between BTP, thickness and energy consumption for temperature rising are found and LS-SVM algorithm is applied to build the model due to these characteristics. The energy consumptions of carbonate decomposition and water evaporation are calculated by analyses of physical and chemical changes. Finally, the minimal coke consumption is worked out by coke combustion release process analysis. The simulation and actual sintering data show that the result of this paper reflects the actual need of minimal coke consumption in sintering process and this calculating method can guide the actual production process.%提出了一种烧结过程焦粉最低配比计算方法.首先针对不同烧结终点位置、料层厚度的料层等温线数据建立烧结料层侧面温度场BP神经网络(back propagation neural network,BPNN)模型;然后采用最小二乘支持向量机(least squares support vector machine,LS-SVM)算法建立烧结终点位置、料层厚度等烧结过程状态变量与料层蓄热所需能量之间的关系模型;通过对烧结过程中主要物理、化学反应的分析,计算得到了水分蒸发与碳酸盐分解过程需要热量;最后通过对碳转换形式进行分析,计算得到烧结配料过程焦粉最低配比.仿真实验和工业实际数值算例表明,提出的焦粉最低配比计算方法能有效地反映实际生产所需的最低焦粉配比,从而为烧结过程节能减排提供重要的数值依据.【期刊名称】《化工学报》【年(卷),期】2012(063)009【总页数】9页(P2688-2696)【关键词】烧结配料;焦粉配比;温度场;BP神经网络;最小二乘支持向量机【作者】马俊杰;吴敏;李勇【作者单位】中南大学信息科学与工程学院,湖南长沙410083;先进控制与智能自动化湖南省工程实验室,湖南长沙410083;中南大学信息科学与工程学院,湖南长沙410083;先进控制与智能自动化湖南省工程实验室,湖南长沙410083;中南大学信息科学与工程学院,湖南长沙410083;先进控制与智能自动化湖南省工程实验室,湖南长沙410083【正文语种】中文【中图分类】TF046钢铁工业是我国国民经济的基础产业,在国民经济发展中占据着非常重要的位置。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

bpnn模型原理

概述

BP神经网络(Back Propagation Neural Network)是一种常用的人工神经网络模型,用于解决分类、回归等问题。

它是基于误差反向传播算法(Error Back Propagation)的一种前向反馈神经网络。

神经元模型

神经元是BP神经网络的基本单元,它由输入层、隐含层和输出层组成。

每个神经

元都有多个输入和一个输出。

输入通过加权和的方式传递到激活函数,经过激活函数的处理后得到输出。

前向传播

BP神经网络的前向传播是指输入信号从输入层向输出层传递的过程。

具体步骤如下:

1.初始化权重和偏置:将权重和偏置设定为随机值或者根据经验设定。

2.输入信号传递:将输入信号乘以权重并加上偏置,得到隐含层的输入。

3.隐含层输出计算:将隐含层的输入通过激活函数(如Sigmoid函数)进行非

线性转换,得到隐含层的输出。

4.隐含层输出传递:将隐含层的输出乘以权重并加上偏置,得到输出层的输入。

5.输出层输出计算:将输出层的输入通过激活函数进行非线性转换,得到输出

层的输出。

反向传播

BP神经网络的反向传播是指根据实际输出和期望输出的误差,将误差从输出层向

输入层传递的过程。

具体步骤如下:

1.计算输出层误差:将输出层的输出与期望输出进行比较,得到输出层的误差。

2.计算隐含层误差:将输出层的误差按照权重进行反向传递,得到隐含层的误

差。

3.更新权重和偏置:根据误差大小和学习率,更新权重和偏置。

激活函数

激活函数是BP神经网络中非线性转换的关键。

常用的激活函数有Sigmoid函数、ReLU函数等。

Sigmoid函数将输入映射到0到1之间的范围,ReLU函数将负数映

射为0,正数保持不变。

参数调优

BP神经网络中的参数调优是指通过调整学习率、迭代次数、隐含层数量等参数,

使得网络的性能达到最优。

常用的调优方法有随机梯度下降法、批量梯度下降法等。

优缺点分析

BP神经网络具有以下优点: - 具有较强的非线性拟合能力,可以解决复杂的分类

和回归问题。

- 可以通过调整网络结构和参数来提高网络的性能。

- 可以通过反向传播算法进行自动学习,不需要手动设计特征。

但是BP神经网络也存在一些缺点: - 训练过程中需要大量的计算资源和时间。

- 容易陷入局部最优解,对初始权重和偏置比较敏感。

- 隐含层数量和节点数量的

选择需要经验和试验。

应用领域

BP神经网络在许多领域都有广泛的应用,包括图像识别、语音识别、自然语言处理、金融预测等。

它在处理复杂非线性问题方面具有优势,可以提供较高的预测准确性。

总结

BP神经网络是一种常用的人工神经网络模型,通过前向传播和反向传播实现输入

与输出之间的映射关系。

它具有较强的非线性拟合能力和自动学习能力,但也存在训练时间长、容易陷入局部最优解等缺点。

在实际应用中,需要根据具体问题进行网络结构的设计和参数的调优,以提高网络的性能和预测准确性。