5.双目视觉里程计

基于环境语义信息的同步定位与地图构建方法综述

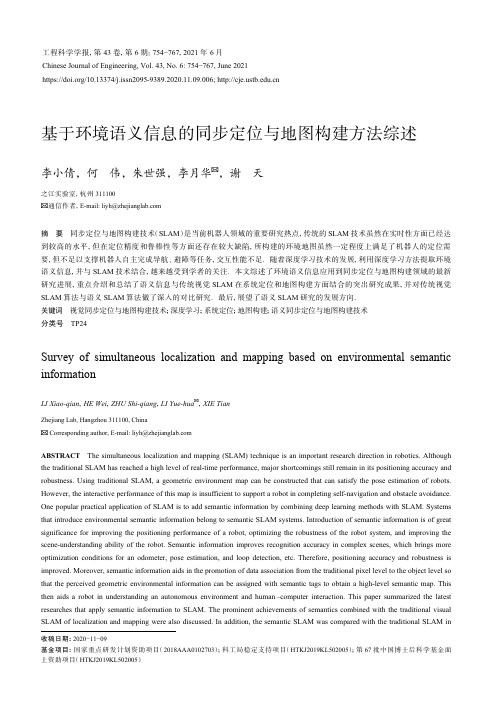

基于环境语义信息的同步定位与地图构建方法综述李小倩,何 伟,朱世强,李月华✉,谢 天之江实验室,杭州 311100✉通信作者,E-mail: ********************摘 要 同步定位与地图构建技术(SLAM )是当前机器人领域的重要研究热点,传统的SLAM 技术虽然在实时性方面已经达到较高的水平,但在定位精度和鲁棒性等方面还存在较大缺陷,所构建的环境地图虽然一定程度上满足了机器人的定位需要,但不足以支撑机器人自主完成导航、避障等任务,交互性能不足. 随着深度学习技术的发展,利用深度学习方法提取环境语义信息,并与SLAM 技术结合,越来越受到学者的关注. 本文综述了环境语义信息应用到同步定位与地图构建领域的最新研究进展,重点介绍和总结了语义信息与传统视觉SLAM 在系统定位和地图构建方面结合的突出研究成果,并对传统视觉SLAM 算法与语义SLAM 算法做了深入的对比研究. 最后,展望了语义SLAM 研究的发展方向.关键词 视觉同步定位与地图构建技术;深度学习;系统定位;地图构建;语义同步定位与地图构建技术分类号 TP24Survey of simultaneous localization and mapping based on environmental semantic informationLI Xiao-qian ,HE Wei ,ZHU Shi-qiang ,LI Yue-hua ✉,XIE TianZhejiang Lab, Hangzhou 311100, China✉Corresponding author, E-mail: ********************ABSTRACT The simultaneous localization and mapping (SLAM) technique is an important research direction in robotics. Althoughthe traditional SLAM has reached a high level of real-time performance, major shortcomings still remain in its positioning accuracy and robustness. Using traditional SLAM, a geometric environment map can be constructed that can satisfy the pose estimation of robots.However, the interactive performance of this map is insufficient to support a robot in completing self-navigation and obstacle avoidance.One popular practical application of SLAM is to add semantic information by combining deep learning methods with SLAM. Systems that introduce environmental semantic information belong to semantic SLAM systems. Introduction of semantic information is of great significance for improving the positioning performance of a robot, optimizing the robustness of the robot system, and improving the scene-understanding ability of the robot. Semantic information improves recognition accuracy in complex scenes, which brings more optimization conditions for an odometer, pose estimation, and loop detection, etc. Therefore, positioning accuracy and robustness is improved. Moreover, semantic information aids in the promotion of data association from the traditional pixel level to the object level so that the perceived geometric environmental information can be assigned with semantic tags to obtain a high-level semantic map. This then aids a robot in understanding an autonomous environment and human –computer interaction. This paper summarized the latest researches that apply semantic information to SLAM. The prominent achievements of semantics combined with the traditional visual SLAM of localization and mapping were also discussed. In addition, the semantic SLAM was compared with the traditional SLAM in收稿日期: 2020−11−09基金项目: 国家重点研发计划资助项目(2018AAA0102703);科工局稳定支持项目(HTKJ2019KL502005);第67批中国博士后科学基金面上资助项目(HTKJ2019KL502005)工程科学学报,第 43 卷,第 6 期:754−767,2021 年 6 月Chinese Journal of Engineering, Vol. 43, No. 6: 754−767, June 2021https:///10.13374/j.issn2095-9389.2020.11.09.006; detail. Finally, future research topics of advanced semantic SLAM were explored. This study aims to serve as a guide for future researchers in applying semantic information to tackle localization and mapping problems.KEY WORDS visual simultaneous localization and mapping;deep learning;localization;mapping;semantic simultaneous localization and mapping同步定位和建图(Simultaneous localization and mapping, SLAM)是机器人利用自身携带的视觉、激光等传感器,在完成自身定位的同时构建环境地图的过程,是提高机器人智能性、自主性的核心环节,也是机器人相关研究中的一个基本问题[1−2].通过相机采集图像信息作为环境感知信息源的SLAM系统称为视觉SLAM[3−4](Visual SLAM,V-SLAM),与其他SLAM系统(如激光SLAM[5−6])相比,V-SLAM可感知更加丰富的色彩、纹理等环境信息[7−8].V-SLAM系统大多将估计相机位姿作为主要任务,通过多视几何理论构建三维地图. 随着机器人的应用范围越来越广,使用者对于机器人的智能程度提出了更高的要求,传统利用环境中点、线、面等低级别几何特征信息的V-SLAM系统在系统定位精度和鲁棒性等方面已表现出明显不足,特别在应对弱纹理环境、光照变化和动态目标等方面依然有很多挑战[9]. 随着深度学习技术的迅速发展,其在计算机视觉(Computer vision,CV)的各个领域都有着非常成功的应用. 在此背景下,近年来,越来越多的SLAM研究者使用基于深度学习的方法提取环境语义信息,以获取高层次的场景感知和理解,并应用在V-SLAM系统中[10],辅助视觉SLAM系统提升定位性能、地图可视化,从而赋予机器人更高效的人机交互能力.本文专注于对语义SLAM方法进行分析和讨论,首先系统地介绍和分析环境语义信息与SLAM 系统结合在定位精度、鲁棒性和地图形式等方面的研究进展,并将语义SLAM技术与传统V-SLAM 技术进行分析和比较. 最后,讨论了语义SLAM技术最新的研究热点和发展方向,进行总结和展望.1 语义SLAM系统概述同步定位与建图的核心研究内容是机器人对自身的状态估计和对环境的感知描述,其中定位可以看作机器人对自身当前状态的估计,而地图可以认为是机器人对环境认识、描述的集合. 从应用层面分析,机器人对于“定位”的需求是相似的,即实现对自身位姿的状态估计;而对于地图构建来说,其需求是广泛的.现代V-SLAM系统主要包括传感器信息读取、前端视觉里程计、后端优化和建图4个部分[11],如图1所示. 视觉里程计[12](Visual odometry, VO)模块接收传感器所提供的数据,其任务包括特征提取,SLAM初始化,特征跟踪,估计相邻图像间相机的运动,构建局部地图,并根据图像间的多视几何关系确定机器人位姿,又可称为V-SLAM 的前端. 后端优化包括位姿优化[13−14]和场景重定位[15],其任务为接收多个时刻视觉里程计估计的相机位姿,并结合回环检测信息,进行优化,从而得到全局一致的轨迹和地图. 回环检测通过计算图像间的相似性判定当前场景与历史某个场景是否一致,并将检测结果输入后端优化,从而解决位置估计随时间漂移的问题. 最后,机器人根据优化后的运动轨迹和三维点云,建立满足任务要求的地图.图 1 V-SLAM系统框架Fig.1 Architecture of the V-SLAM system对SLAM系统而言,引入环境语义信息的SLAM 系统,均属于语义SLAM系统. 语义信息的引入,对于提升机器人的定位性能、优化机器人系统的鲁棒性、提高机器人的场景理解能力等方面具有重李小倩等: 基于环境语义信息的同步定位与地图构建方法综述· 755 ·要意义. 一方面,借助语义信息提升了复杂场景下的识别精度,为视觉里程计、位姿估计、回环检测等带来更多的优化条件,提高了定位精度和鲁棒性;另一方面,借助语义信息将数据关联从传统的像素级别提升到物体级别,将感知的几何环境信息赋以语义标签,进而得到高层次的语义地图,可帮助机器人进行自主环境理解和人机交互.2 语义与SLAM系统定位移动机器人对系统定位的性能要求主要包括3个方面:定位实时性、定位精度和定位鲁棒性.目前SLAM的实时性已达到较高的水平,因此对于SLAM技术真实应用于机器人领域,亟需提高SLAM系统的定位精度和鲁棒性. 本节针对SLAM 系统结合环境语义信息提高系统定位的这两项重要性能展开介绍.2.1 语义与定位精度定位是确定机器人在其工作环境中所处位置的过程,定位精度是SLAM系统中最为基本也是最重要的考核指标,是移动机器人开展导航和路径规划任务的先决条件. 利用语义分割和目标检测等技术将物体划分为更加具体的目标,非常适合SLAM这种需要精确几何约束问题的系统. 结合环境语义信息,可有效改善单目视觉定位过程中的尺度不确定性问题和累积漂移等问题,进而提高系统定位精度.(1)面向单目初始化.由于单目相机存在尺度不确定性问题,单目视觉SLAM系统不可避免地出现尺度模糊和随时间漂移等现象,无法准确估计移动机器人的位姿[16].因此,如何修正尺度模糊和漂移是单目视觉SLAM 系统初始化中的关键问题.Frost等[17]提出基于混合多尺度可变模型的目标检测系统[18]检测物体,并与SLAM系统中的关键帧进行数据关联,然后对物体尺寸进行估计,生成地图地标,最后地标与相机位姿共同参与局部优化,以解决尺度模糊和漂移的问题,保证了全局地图的一致性. Sucar与Hayet[19]在贝叶斯框架内,通过基于深度学习的目标检测算法观测物体,确定其先验高度,然后将局部地图中3D点投影到目标检测的2D图像上,确定目标检测区域的边界点并投影回3D空间,进而确定物体的实际高度,最后将先验高度与实际高度之比设置为尺度因子,用于单目SLAM系统中的尺度矫正,从而准确估计移动机器人位姿. 两项研究共同引入了环境语义信息,充分考虑目标对象的大小,使得单目尺度初始化处理更加高效和简洁. 基于公开数据集的实验结果验证了其在各种场景应用中的有效性.(2)面向数据关联.在V-SLAM框架中,根据更新频率,数据关联可以被分为两类:短期关联(如特征匹配)和长期关联(如回环检测). 基于环境语义信息的SLAM研究提出了一种基于中期数据关联机制的新思路.Bowman等[20]利用目标检测,整合尺度信息与语义信息,用于SLAM系统的位姿估计. 作者在应用时发现,目标对象的不合理数据关联,会严重影响定位与建图的结果. 因此提出了概率数据关联机制,在处理数据关联过程中充分考虑语义信息的不确定性. 通过引入最大期望估计(Expectation maximization,EM),根据语义分类结果计算数据关联的概率,成功地将语义SLAM转换成概率问题,获得了ICRA2017年的最佳论文.Lianos等[21]在此基础上,提出了全新的视觉语义里程计框架(Visual semantic odometry,VSO),利用重投影前后语义标签具有的一致性来实现中期(Medium-term)连续点跟踪. 使用距离变换将分割结果的边缘作为约束,利用重投影误差构造约束条件,整合语义约束到姿态和地图优化中,以改善系统的平移漂移问题. 所提算法可以直接融合进已有的直接法或间接法视觉里程计框架中,并分别在ORB-SLAM2[22](间接法VO代表)和PhotoBundle[23](直接法VO代表)系统中对语义信息引入的效果进行实验对比,结果表明,添加语义约束后有效减少了系统的平移漂移现象.(3)面向位姿优化.在V-SLAM系统中,需要解决的主要问题是机器人的状态估计问题,常见的优化算法为基于粒子滤波的优化算法和基于非线性优化的算法.在基于粒子滤波的优化算法中,可利用环境语义信息更新粒子状态,进而更精准地进行位姿估计. Bavle等[24]提出了一种基于双目视觉里程计和室内环境语义信息的粒子滤波优化方法. 粒子滤波器的预测阶段使用双目视觉里程计估计机器人的三维姿态,并使用惯性和语义信息更新三维姿势,进而对机器人进行无漂移的姿态估计.在基于非线性优化的算法中,可借助目标检测算法,将物体作为路标,融合到一个优化算法中,以提高系统定位精度. Nicholson等[25]提出了面向对象的语义SLAM系统 QuadricSLAM,利用椭圆体(对偶双曲面)对物体进行三维建模,紧凑· 756 ·工程科学学报,第 43 卷,第 6 期地表示物体的大小、位置和方向,并作为路标添加到优化公式中,联合估计相机位姿和对偶二次曲面,以提高系统的定位精度.类似的,卡内基梅隆大学机器人研究所Yang 与Scherer[26]提出了CubeSLAM系统,用单目相机实现了对象级的定位与建图. 作者利用目标检测算法生成2D边界框,通过消失点法(Vanishing points,VP)生成物体三维立方体,并将物体作为路标,结合物体约束信息与几何信息,融合到一个最小二乘公式中,改善相机位姿估计,提高了SLAM的定位精度. 与基于特征点的SLAM系统相比,对象级SLAM系统可以提供更多的几何约束和尺度一致性,所提算法在公开数据集上得到了较好的位姿估计精度,同时还提高了3D物体的检测精度. 同时,Yang与Scherer[27]在此基础上,结合Pop-up SLAM[28]的思想,提出了一个无需先验物体和模型的联合物体和平面估计的单目SLAM 系统. 首先,利用高阶图形模型,结合语义和遮挡等约束[29],推断单张图像中的三维物体和平面,然后将提取的物体和平面,结合相机和特征点位姿,放在统一的框架中进行优化. 实验结果表明,所提算法在ICL NUIM和TUM mono数据集中定位精度准确,并可以在结构化环境中生成稠密地图.(4)面向重定位与回环检测重定位和回环检测的目的不同,但通常可以采用相同的技术. 重定位主要是跟踪丢失时重新找回当前姿态,恢复相机姿态估计;回环检测是识别机器人曾经到过的场景,得到几何一致的映射,从而解决漂移问题,提高全局精度. 传统的SLAM 算法大都依赖于低级别的几何特征,使得重定位和回环检测通常依赖于相机的视角,在特征不明显或重复性的纹理环境中容易检测失败. 语义SLAM系统利用目标识别推测标志物的种类和大小,产生易于识别的标志物,进而提高系统的定位精度.Gawel等[30]提出了一种基于图的语义重定位算法,将具有语义目标位置的关键帧组合成一组三维图,并利用图匹配算法求解相机在全局地图中的位置. Konstantinos等[31]提出了一种基于地点视觉词描述的回环检测算法,通过对输入的图片流进行动态分割,定义一个个“地点”,并通过在线聚类算法,将图像的描述子转化为地图中的相应的视觉词. 系统通过概率函数判断回环检测的候选地点,并通过最近邻投票算法,匹配候选地点中最准确的那一帧图像. 实验表明,算法在精确和召回率上有很好的表现. 此外,所提算法仅通过将查询图像的局部描述子转换为词典的视觉词,就能判断已访问过的地点,不需要任何预训练的步骤,能够满足很好的实时性要求.张括嘉等[32]利用YOLOv3[33]目标检测算法获取环境中关键目标的语义信息,建立目标检测结果之间的相对位置关系,根据连续关键帧的相似度变化情况进行回环判断. 所提算法在公开数据集上取得了较好的效果,与单纯利用传统视觉特征的算法相比,环境语义信息的应用有效提高了室内场景下的闭环检测准确性.2.2 语义与定位鲁棒性定位鲁棒性是机器人安全运行的保证,是移动机器人系统重要的考量指标. 传统的V-SLAM 系统在纹理特征缺失、光照变化较大和高速动态等场景下,非常容易出现定位信息丢失的情况,尤其是在自动驾驶这种对安全性要求较高的应用领域,一旦定位信息丢失,后果将不堪设想. 利用环境语义信息可有效改善传统V-SLAM系统面临的这些问题,有效提升系统定位的鲁棒性.(1)面向弱纹理环境.传统V-SLAM方案中采用的图像特征语义级别低,造成特征的可区别性较弱,在弱纹理等缺少显著特征的环境中,传统基于特征点的方法难以进行准确的运动估计. 借助深度学习的方法提取环境中的立体特征,并用于优化位姿估计,可提升系统定位鲁棒性.Yang等[28]提出的Pop-up SLAM系统,验证了场景理解对弱纹理环境下机器人状态估计改善的有效性. 利用深度学习的方法提取环境中墙‒地的边界信息,并根据单幅图像生成立体平面模型,同时利用平面法线间的差、平面间的距离和平面间的投影重叠3个几何信息进行平面匹配. 然后将Pop-up模型提供的深度估计融合到LSD-SLAM[34]深度图中,提高LSD-SLAM的深度估计质量,以提高系统的鲁棒性. Ganti和Waslander[35]指出从信息熵较低的区域提取特征点,位姿估计的准确性低[36],对这些特征点跟踪,会增加错误数据关联的风险,他们提出了一种基于信息论的特征选取方法,利用语义分割的不确定性概念计算信息交叉熵. 该方法减少了对特征点数量的要求,显著提高了系统实时性和鲁棒性,而在精度上没有任何明显损失.Qin等[37]针对地下停车场自动代客泊车系统,提出了一种基于语义特征的定位方法. 在狭窄拥李小倩等: 基于环境语义信息的同步定位与地图构建方法综述· 757 ·挤且没有GPS信号的停车场环境中,环境结构相似,纹理特征不足,传统V-SLAM方法容易发生跟踪丢失的问题,作者首先利用深度学习将地面上的指路标志、停车线以及减速带等信息分割出来,再根据里程计的信息,将语义特征映射到全局的坐标系下,建立停车场的地图,然后通过将语义特征与先前的构建出来的地图进行匹配来对车辆进行定位,最后采用扩展卡尔曼滤波器将视觉定位结果与里程计融合,保证在缺少纹理信息的停车场环境中,系统能够输出稳定的定位结果.(2)面向光照变化.在传统V-SLAM系统中,特征描述子(如SIFT,ORB等)对于光照变化较敏感,光照的变化容易导致目标表面颜色等特征的变化,对系统定位鲁棒性造成干扰. 而环境中的物体类别与光照和时间变化无关,可利用环境语义信息构造新的特征描述子,从而有效降低由于光照变化对定位鲁棒性造成的不利影响.2018年,瑞典查尔姆斯理工大学信号处理研究小组的Stenborg等[38]提出了一种在已有的3D地图上,将语义类别作为地图点描述子的定位算法,有效解决了长时间跨季度定位系统中环境光照变化等对定位系统的影响. Schönberger等[39]提出了一种基于3D几何和语义信息进行视觉定位的新方法,通过训练语义场景完备化作为辅助任务,学习出鲁棒的局部描述符,以此建立查询和数据库映射之间3D-2D的匹配,将匹配结果用于位姿估计与矫正,成功解决了大范围观测条件下的鲁棒性视觉定位问题. 在KITTI和NCLT数据集上运行结果表明,所提方法在极端视角、照明和几何变化情况下,表现出了系统的高可靠性. 此类方法相较于基于传统描述子的方法节省了大量的存储空间,但语义描述子的应用也有一定的局限性,如在较单一类别的场景中容易产生误差.此外,还可通过优化特征选择策略,结合语义信息进行过滤,使得所关注目标对于光照变化更加鲁棒. Naseer等[40]提出了一种判别整体图像内容的方法,能够根据图像语义信息生成一个密集的场景显著性描述. 通过训练感知环境变化大的数据集学习显著性描述,保证能够在图片上分割出更加稳定的区域,剔除易随时间变化的区域,并将显著区域的特征和现有的整体图像上的特征进行融合,从而得到了一个更加鲁棒的场景描述. Liang等[41]在稀疏直接法里程计(Direct sparse odometry, DSO)[42]基础上,改变了跟踪点的选取策略,通过在图像上的感兴趣区域上选取点(感兴趣区域即显著性图),并利用语义分割的结果对显著性图进行滤波,调整每个像素点的显著性得分,从而降低了无信息区域(例如墙,天花板和地板等)的显著性得分. 实验结果表明显著性区域的点对于光照和视角的变化更加鲁棒.(3)面向动态场景.传统的V-SLAM系统大多基于静态环境假设,在处理动态环境的定位问题时,容易发生错误匹配. 近年来,针对动态场景的语义SLAM系统逐渐受到越来越多的关注[43−44],通过引入环境语义信息有效地对静态和动态特征点进行划分,移除动态特征点,从而减少动态干扰,以提高SLAM系统的鲁棒性.Yu等[45]基于ORB-SLAM2提出了一种动态环境下鲁棒的语义SLAM系统(DS-SLAM),该系统基于光流金字塔算法进行运动一致性校验,并结合语义分割网络获取物体轮廓,剔除位于移动物体上的特征点,减少动态对象对姿态估计的影响,提升了系统定位鲁棒性. 在TUM RGB-D数据集以及真实环境下测试结果表明,该系统的绝对轨迹精度比ORB-SLAM2提高了一个数量级. 但是,该算法能识别的语义类别较少,且只定义人为动态物体,另外,该地图在回环失败时需要重新建图,地图的可移植能力不足. Bescos等[46]也在ORB-SLAM2系统上,提出了一种面向动态物体检测和背景修复的V-SLAM系统(DynaSLAM),通过使用多视几何和深度学习的方法实现移动物体的检测,并通过对动态物体遮挡的背景帧进行修复,生成静态场景地图. 实验结果表明,DynaSLAM提供的单目、双目和RGB-D 3种运行状态在动态场景中均有较好的鲁棒性,并能输出场景的静态地图,更符合机器人长时间运行的使用需要.目前大多数语义信息用于动态场景都是将所有潜在运动的物体直接去除,但如若动态目标物体并没有发生运动,且占据相机视角的大部分,那么将目标物体上的点都去除会对位姿估计产生很严重的影响. Brasch等[47]针对此类现象提出了一种改进方案,其引入对于地图点是否为静态点的概率估计“静态率”(Inlier ratio),实现地图点在动静态之间的平滑过渡. 首先,根据语义分割网络的输出赋予静态率一个先验值,例如车具有较低的静态率,建筑具有较高的静态率等,然后根据不断地引入新的观测数据来更新该地图点的静态率,以在具有挑战性的条件下实现定位鲁棒性. Cui· 758 ·工程科学学报,第 43 卷,第 6 期与Ma[48]提出了一种基于ORB-SLAM2 RGB-D模式的面向动态环境的视觉语义SLAM系统(SOF-SLAM). 该系统采用一种新的语义光流动态特征检测方法,使用SegNet[49]产生像素级的语义分割结果,获取运动先验(静态、潜在动态的和动态),并将运动先验作为掩膜去除动态和潜在动态特征之间的匹配,然后利用语义静态特征的匹配计算基本矩阵,最后利用基本矩阵和对极约束寻找并剔除真正的动态特征,在跟踪和优化模块中保留剩余的静态特征,实现动态环境下相机位姿的精确估计. 在公开的TUM RGB-D数据集和真实环境中的实验结果表明,所提算法可有效应对动态环境.由上可见,利用环境语义信息通过特征选择和优化数据关联等方法可有效提高系统定位的精度,通过对目标物体的跟踪,可以提高弱纹理环境、光照变化和动态场景下SLAM系统的鲁棒性.相较于传统V-SLAM系统,基于语义的SLAM系统直接提取图像特征,无需人工特征提取和匹配,更加简洁直观;基于语义的SLAM系统能够更充分表达环境信息,进而实现高层次的场景感知和理解,保障了系统的定位精度和鲁棒性. 但是,目前对环境理解的算法主要基于深度学习等方法,不同学习算法之间的网络架构设计差异性大,且对训练数据库有较强的依赖性. 同时,系统性能严重依赖于环境目标识别和语义分割结果的准确性. 此外,当前环境语义信息多与SLAM局部的子模块相结合,如位姿优化或回环检测等,部分语义SLAM学者也开始关注如何搭建一个端到端的SLAM系统[50],将深度学习架构应用于整个SLAM 系统,也是未来研究的一个重要方向.3 语义与SLAM地图构建在传统的SLAM研究中,地图构建主要服务于机器人定位,即利用构建的环境地图提高机器人的定位精度,此时地图的表现形式主要是稀疏的点云地图. 而当SLAM技术逐渐应用于机器人和自动驾驶领域,其需要利用环境地图完成导航和避障,因此需要稠密的环境地图,如稠密点云地图、八叉树地图等. 随着机器人和智能化程度提高,机器人逐渐服务于日常生活和工业生产,需要更加利于交互的环境地图. 近年来,深度学习技术快速发展,利用深度学习方法构建具有语义信息的环境地图成为提高机器人交互能力一种可行的方案.基于环境语义信息的SLAM技术不仅提取环境中的几何信息,还能充分利用环境中的语义信息,即环境中个体的属性,从而提高机器人执行任务的智能水平. 21世纪初,Vasudevan等[51]和Galindo等[52]先后提出了机器人语义地图的概念,阐述了构建具有语义信息的环境地图可以提高机器人的感知能力,并且地图中的语义信息使机器人具有一定的推算能力. 得益于SLAM技术的快速发展,研究人员希望将这种含有语义信息的地图形式应用到SLAM系统中,即构建环境语义地图. 早期的语义地图构建算法大多采用离线的方式,基于马尔可夫等方法对几何地图进行语义标注[53−54],这种方法需要离线对地图进行处理,无法在机器人上实际使用. 随着机器学习技术的发展,部分学者使用条件随机场(Conditional random field,CRF)、随机决策森林(Random forest)等算法获取场景中的语义标签[55−56],但是此类算法语义融合的效率较低、精度较差,亦不能将其应用到实际场景. 同时,部分学者针对机器人与环境中实体的交互问题,提出将地图与预先构建的物体模型进行融合,把实体从地图中分割出来[57−58],但是这种方法依赖先验知识,限制了地图的应用场景. 近年来,深度学习技术快速发展,越来越多的研究人员将深度学习方法与SLAM技术结合,利用目标检测、语义分割等算法[59]提取环境的语义信息,并将其融入到环境地图中,以构建环境语义地图.目前针对语义信息与SLAM地图构建融合的研究主要分为两个方向,包括面向场景的语义地图构建和面向对象的语义地图构建,如表1所示. 其中,面向场景的语义地图侧重于机器人对环境的感知,而面向对象的语义地图更侧重于机器人与实体进行交互,接下来本文将围绕这两个方面进行综述.3.1 面向场景的语义地图面向场景的语义地图是指使用语义分割算法对2D图像进行像素级分割,提取图片中的语义信息,并将其与3D点云进行融合,以构建全场景的语义地图. McCorma等[60]基于卷积神经网络提出了SemanticFusion算法,实现了室内环境语义地图构建,是构建像素级语义地图的典型代表. 该算法构建了一个完整的语义SLAM系统,实现了传统SLAM框架与语义分割的结合,解决了传统语义标注算法中语义类别少、需要离线标注等问题,并且引入了一种节点概率更新算法和语义修正方法,在语义地图构建算法精度上具有较高水平. 同李小倩等: 基于环境语义信息的同步定位与地图构建方法综述· 759 ·。

智能语音机器人关键技术指标

智能语音机器人关键技术指标智能语音机器人具备三大核心关键技术指标使:自然语言处理、自主意识及自主导航。

自然语言处理机器人采用基于深度学习算法的自然语言处理技术,设计一个语音识别处理引擎,使机器人可以理解人的语言,并且根据知识库的内容,针对人提出的问题,通过语音的方式回答。

自主意识为使其像人类一样思考,机器人模拟人类的思维模式,接收外界信息后,能够以人类智能相似的方式做出反应,建立机器人的自我意识,与用户进行语音交流,使用户消除人机交互带来的机械感。

机器人能够通过感知系统了解周围情况,并且建立一个初级交流场景。

五大感知系统包括:视觉系统,听觉系统,传感器系统,本地系统,云端大脑系统。

人类感知外界通过各个感官系统,机器人通过拟人的感知系统,促进机器人的感受和收集外界信息的能力。

自主导航机器人的自主导航、自主避障和自主定位功能是服务机器人的基本特征和核心技术,在不需要轨道的前提下,机器人很好的实现了以上功能。

对机器人而言,完成自主导航。

对应的技术问题:建立环境地图,标记机器人在地图中的当前坐标指令目标点与地图坐标的匹配,自主导航算法、实时定位和环境检测。

关键技术描述:A算法基于栅格地图的实时定位和路径规划方法,特点是实时刷新障碍物信息,规划到目标点的最短路径双目测距利用双目视觉,根据同一特征点在不同摄像头的像素坐标差异,求解特征点的三维坐标里程计利用电机编码器,测定轮速和转角,实时估算机器人坐标和方位角运动控制根据编码器返回的速度信息,利用PID算法实现轮速精确控制,进而实现机器人的速度和位置精确控制超声波全局定位机器人上的超声波阵列接收基准声源信号,利用三角定位原理测算机器人相对声源坐标和方位局部障碍物识别利用超声波传感器实时标记近距离环境障碍技术指标头顶触摸:触摸距离,≤5mm。

感应面积,头顶正中心5厘米*5厘米;后部扩展接口:TF卡接口最大支持64G。

USB接口USB2.0 供电最大0.5A;麦克红外感光:MIC双路,灵敏度1.5米max,闪光灯,双路,功率0.5W*2红外发射遥控,波长940nm,功率0.3W;触摸屏:电容5点触摸。

蓝鲸智能机器人ORB_SLAM2包配置手册说明书

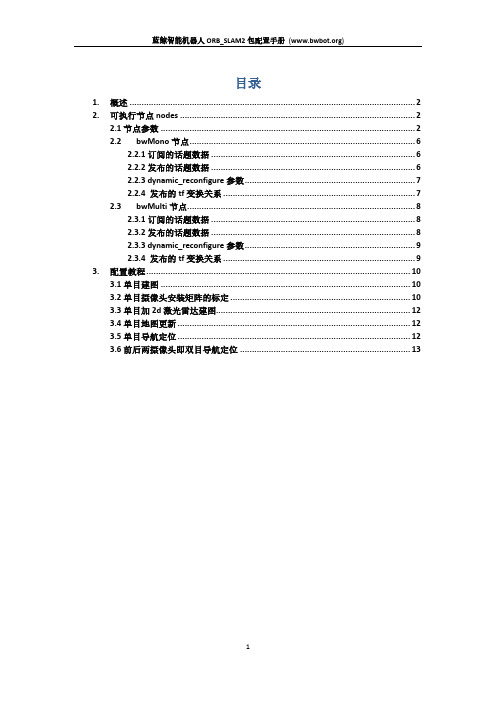

目录1.概述 (2)2.可执行节点nodes (2)2.1节点参数 (2)2.2bwMono节点 (6)2.2.1订阅的话题数据 (6)2.2.2发布的话题数据 (6)2.2.3 dynamic_reconfigure参数 (7)2.2.4 发布的tf变换关系 (7)2.3bwMulti节点 (8)2.3.1订阅的话题数据 (8)2.3.2发布的话题数据 (8)2.3.3 dynamic_reconfigure参数 (9)2.3.4 发布的tf变换关系 (9)3.配置教程 (10)3.1单目建图 (10)3.2单目摄像头安装矩阵的标定 (10)3.3单目加2d激光雷达建图 (12)3.4单目地图更新 (12)3.5单目导航定位 (12)3.6前后两摄像头即双目导航定位 (13)蓝鲸智能机器人ORB_SLAM2包配置手册1.概述ORB_SLAM2属于基于稀疏特征点的视觉slam算法,蓝鲸智能机器人在原始版本的基础上进行了改进和优化。

通过融合惯导里程计和激光雷达,提高了定位精度和定位鲁棒性,解决了单目尺度恢复和漂移问题,同时可以输出2d栅格地图。

增加了地图保存、加载功能,发布相关ROS话题数据,使ORB_SLAM2兼容ROS的navigation框架。

蓝鲸智能机器人ORB_SLAM2包会输出完全兼容gmapping和amcl的ros接口数据,因此可以直接替换gmapping用于建图,替换amcl用于定位。

2.可执行节点nodes共有bwMono、bwMulti两个ROS node,使用方法是一样的。

bwMono可用于建图、定位、更新地图。

bwMulti目前只支持定位。

两个节点都需要传入两个参数,分别是字典文件和配置参数文件。

字典文件相同,配置参数文件里面的参数选项是一样的,参数设置略有区别。

下文将先介绍配置参数文件里面各个参数的意义,然后介绍两个节点特有的参数设置和ros 话题信息。

对于节点的使用,蓝鲸机器人ORB_SLAM2包默认已经配置好了三个launch 文件,unch用于建图,unch用于定位,unch用于地图更新。

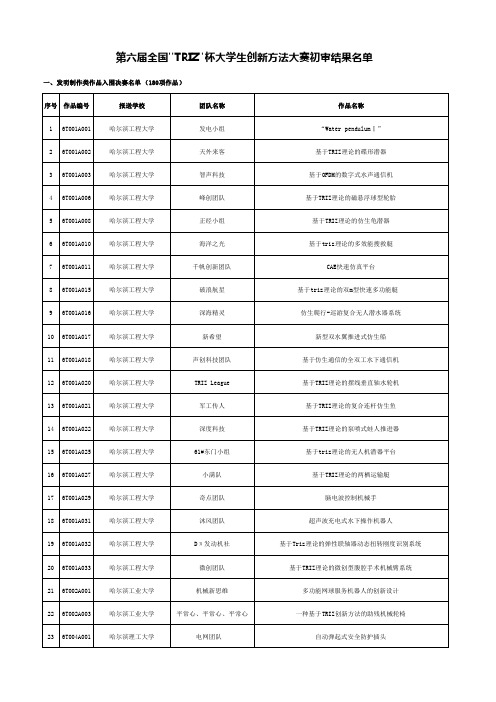

第六届全国TRIZ杯大学生创新方法大赛初审结果名单

开拓者

基于TRIZ理论的远程智能热车装置

69

6T017A007

东北石油大学

井架天空

交变载荷防偏磨泵

70

6T017A008

东北石油大学

创新野狼团

基于自重锁紧式爬管机器人

71

6T017A010

东北石油大学

启智队

基于TRIZ理论的电力巡检无人机

72

6T017A011

东北石油大学

出奇制胜

井下旋转式可循环压裂滑套

基于TRIZ理论的车牌识别交通警察

117

6T043A001

沈阳建筑大学

梦想+

基于TRIZ理论的新型钢筋在线定尺装置

118

6T043A002

沈阳建筑大学

桥梁滴答派

一种双幅T型刚构桥的斜拉加固结构及其施工方法

119

6T044A001

辽宁工程技术大学

筑梦

节能化边缘地带停车装置

120

6T045A002

南京农业大学

哈尔滨理工大学

小中医

手持式便携头针捻针仪

28

6T004A013

哈尔滨理工大学

一路通行

智能交通信号动态控制系统设计

29

6T004A015

哈尔滨理工大学

科莱沃队

棒状原料或成品在线自动整理装置

30

6T004A016

哈尔滨理工大学

江北龙卷风

无缆驱动微型管道检测装置

31

6T004A017

哈尔滨理工大学

雏鹰

汽车防窒息智能报警系统

基于TRIZ理论的线切割两轴数控回转台

77

6T023A009

佳木斯大学

spark团队

基于深度学习的智能车辆视觉里程计技术发展综述

2021年第1期【摘要】针对基于模型的视觉里程计在光照条件恶劣的情况下存在鲁棒性差、回环检测准确率低、动态场景中精度不够、无法对场景进行语义理解等问题,利用深度学习可以弥补其不足。

首先,简略介绍了基于模型的里程计的研究现状,然后对比了常用的智能车数据集,将基于深度学习的视觉里程计分为有监督学习、无监督学习和模型法与深度学习结合3种,从网络结构、输入和输出特征、鲁棒性等方面进行分析,最后,讨论了基于深度学习的智能车辆视觉里程计研究热点,从视觉里程计在动态场景的鲁棒性优化、多传感器融合、场景语义分割3个方面对智能车辆视觉里程计技术的发展趋势进行了展望。

主题词:视觉里程计深度学习智能车辆位置信息中图分类号:U461.99文献标识码:ADOI:10.19620/ki.1000-3703.20200736Review on the Development of Deep Learning-Based Vision OdometerTechnologies for Intelligent VehiclesChen Tao,Fan Linkun,Li Xuchuan,Guo Congshuai(Chang ’an University,Xi ’an 710064)【Abstract 】Visual odometer can,achieve with deep learning,better performance on robustness and accuracy through solving the problems such as the weak robustness under poor illumination,low detection accuracy in close loop and insufficient accuracy in dynamic scenarios,disability in understanding the scenario semantically.Firstly,this paper briefly introduces the research status of the model-based odometer,then compares the commonly-used intelligent vehicle datasets,and then divides the learning-based visual odometer into supervised learning,unsupervised learning and hybrid model which combines model-based with deep learning-based model.Furthermore,it analyzes the learning-based visual odometer from the aspects of network structure,input and output characteristics,robustness and so on.Finally,the research hotspots of learning-based visual odometer for intelligent vehicle are discussed.The development trend of learning-based visual odometer for intelligent vehicle is discussed from 3aspects which respectively are robustness in dynamic scenarios,multi-sensor fusion,and scenario semantic segmentation.Key words:Visual odometer,Deep learning,Intelligent vehicle,Location information陈涛范林坤李旭川郭丛帅(长安大学,西安710064)*基金项目:国家重点研发计划项目(2018YFC0807500);国家自然科学基金面上项目(51978075)。

halcon双目测距原理

halcon双目测距原理摘要:一、引言二、Halcon双目测距原理1.双目视觉基本概念2.双目测距的计算方法3.Halcon软件在双目测距中的应用三、Halcon双目测距的实际应用1.自动驾驶2.机器人视觉3.无人机导航四、Halcon双目测距的发展趋势与挑战1.提高测距精度2.应对复杂环境3.与其他深度估计算法的比较五、总结正文:一、引言随着计算机技术、图像处理技术和人工智能技术的快速发展,双目测距技术在众多领域得到了广泛应用。

Halcon作为一款功能强大的图像处理软件,也在双目测距领域发挥着重要作用。

本文将详细介绍Halcon双目测距的原理及其在实际应用中的表现。

二、Halcon双目测距原理1.双目视觉基本概念双目视觉系统是指通过两个相机从不同的角度拍摄同一场景,然后通过计算机处理这两幅图像来获取场景中物体的三维信息。

2.双目测距的计算方法双目测距主要利用视差原理,通过比较两幅图像中的对应点,计算出物体在空间中的距离。

3.Halcon软件在双目测距中的应用Halcon提供了丰富的图像处理功能,包括图像预处理、特征提取、匹配以及三维重建等,为双目测距提供了强大的支持。

三、Halcon双目测距的实际应用1.自动驾驶Halcon双目测距技术可以实时获取车辆周围环境的三维信息,为自动驾驶提供可靠的安全保障。

2.机器人视觉双目测距技术在机器人领域也有广泛应用,如导航、抓取、避障等任务,都需要准确获取物体的距离信息。

3.无人机导航无人机在执行任务时,需要实时获取地形和障碍物的三维信息,Halcon双目测距技术可以帮助无人机实现这一目标。

四、Halcon双目测距的发展趋势与挑战1.提高测距精度随着深度学习技术的发展,可以通过深度神经网络对双目测距结果进行优化,提高测距精度。

2.应对复杂环境在复杂环境下,如强光照、遮挡、纹理缺失等情况下,双目测距的性能会受到影响,需要研究针对性的解决方案。

3.与其他深度估计算法的比较Halcon双目测距技术需要与其他深度估计算法进行比较,以找到最适合特定应用场景的解决方案。

双目视觉与惯导融合的移动机器人定位方法

A 文章编号:

1001

G

1595(

2021)

11

G

1512

G

10

)

基金项目:中国工程科技发展战略河南研究院战略咨询研究项目(

2020HENZT07

随着 社 会 的 进 步 和 人 工 智 能 技 术 的 快 速 发

展,自主智能 机 器 人 受 到 了 广 泛 关 注.移 动 机 器

ghaccu

da

t

aandIMUda

t

aa

r

ef

u

s

edt

oge

t

h

e

r,ande

r

r

o

rf

u

nc

t

i

on

sa

r

econ

s

t

r

u

c

t

edi

nas

l

i

d

i

ng w

i

ndowi

nanon

G

l

i

nea

rop

t

im

i

za

t

i

onwayt

oop

t

im

i

z

et

h

eaccu

r

acyo

fpo

s

eca

l

cu

l

a

t

i

on.

Th

ea

l

r

i

t

hmp

r

opo

s

edi

nt

h

i

spape

r

go

i

sva

l

基于多传感信息融合的语义词袋SLAM优化算法

基于多传感信息融合的语义词袋SLAM优化算法袁鹏;谷志茹;刘中伟;焦龙飞;毛麒云【期刊名称】《计算机应用研究》【年(卷),期】2024(41)4【摘要】针对室外大范围场景移动机器人建图中,激光雷达里程计位姿计算不准确导致SLAM(simultaneous localization and mapping)算法精度下降的问题,提出一种基于多传感信息融合的SLAM语义词袋优化算法MSW-SLAM(multi-sensor information fusion SLAM based on semantic word bags)。

采用视觉惯性系统引入激光雷达原始观测数据,并通过滑动窗口实现了IMU(inertia measurement unit)量测、视觉特征和激光点云特征的多源数据联合非线性优化;最后算法利用视觉与激光雷达的语义词袋互补特性进行闭环优化,进一步提升了多传感器融合SLAM系统的全局定位和建图精度。

实验结果显示,相比于传统的紧耦合双目视觉惯性里程计和激光雷达里程计定位,MSW-SLAM算法能够有效探测轨迹中的闭环信息,并实现高精度的全局位姿图优化,闭环检测后的点云地图具有良好的分辨率和全局一致性。

【总页数】5页(P1247-1251)【作者】袁鹏;谷志茹;刘中伟;焦龙飞;毛麒云【作者单位】湖南工业大学轨道交通学院【正文语种】中文【中图分类】TP242.6【相关文献】1.基于ORB词袋模型的SLAM回环检测研究2.基于多传感器信息融合的智能交通信息语义描述3.基于多传感器信息融合的智能轮椅SLAM研究4.一种基于改进词袋模型的视觉SLAM算法5.一种融合语义信息的SLAM静态稠密地图构建方法因版权原因,仅展示原文概要,查看原文内容请购买。