多维函数全局寻优的团队进步算法

多元优化算法及其收敛性分析

第41卷第5期自动化学报Vol.41,No.5 2015年5月ACTA AUTOMATICA SINICA May,2015多元优化算法及其收敛性分析李宝磊1施心陵1苟常兴1吕丹桔1安镇宙2张榆锋1摘要提出了一种搜索个体分工明确、协同合作的群智能优化算法,并从理论上证明了其收敛性.由于搜索个体(搜索元)具有分工不同的多元化特点,所以我们称该算法为多元优化算法(Multivariant optimization algorithm,MOA).多元优化算法中,全局搜索元和局部搜索元基于数据表高效的记录和分享信息以协同合作对解空间进行搜索.在一次迭代中,全局搜索元搜索整个解空间以寻找潜在解区域,然后具有不同种群大小的局部搜索元组对潜力不同的历史潜在解区域以及新发现的潜在解区域进行不同粒度的搜索.搜索元找到的较优解按照一定的规则保存在由队列和堆栈组成的结构体中以实现历史信息的高效记忆和共享.结构体中保存的候选解在迭代过程中不断更新逐渐接近最优解,最终找到优化问题的多个全局最优解以及局部次优解.基于马尔科夫过程的理论分析表明:多元优化算法以概率1收敛于全局最优解.为了评估多元优化算法的收敛性,本文利用多元优化算法以及其他五个常用的优化算法对十三个二维及十维标准测试函数进行了寻优测试.实验结果表明,多元优化算法在收敛成功率和收敛精度方面优于其他参与比较的算法.关键词多元优化算法,收敛性,结构体,局部搜索元,全局搜索元,优化引用格式李宝磊,施心陵,苟常兴,吕丹桔,安镇宙,张榆锋.多元优化算法及其收敛性分析.自动化学报,2015,41(5): 949−959DOI10.16383/j.aas.2015.c140585Multivariant Optimization Algorithm and Its Convergence AnalysisLI Bao-Lei1SHI Xin-Ling1GOU Chang-Xing1LV Dan-Ju1AN Zhen-Zhou2ZHANG Yu-Feng1Abstract In this paper,we present a swarm intelligent algorithm and study its convergence property.We name it as multivariant optimization algorithm(MOA)because its multiple searchers(atoms)are variant in responsibilities.The solution space is searched through global-local search iterations which are based on the collaboration and coordination between the local and global search groups in the MOA.In each iteration,the global atoms explore the whole solution space to locate potential areas and then multiple local groups with different numbers of local search atoms are allotted to these potential areas for different levels of refinements.The historical better solutions are recorded in a structure made up of a queue and some stacks,according to a certain rule.The candidate solutions in the structure are improved iteratively and will converge to the optimal solutions.A theoretical convergence analysis based on Markov process shows that MOA converges to more than one global optimal solutions with probability1.To evaluate its convergence property,MOA and otherfive frequently compared algorithms are employed to locate the optimal solutions of thirteen two-dimensional and ten-dimensional benchmark functions.The results show that the MOA has competitive performance to the other algorithms in terms of the convergence success rate and accuracy.Key words Multivariant optimization algorithm(MOA),convergence,structure,local atom,global atom,optimization Citation Li Bao-Lei,Shi Xin-Ling,Gou Chang-Xing,Lv Dan-Ju,An Zhen-Zhou,Zhang Yu-Feng.Multivariant opti-mization algorithm and its convergence analysis.Acta Automatica Sinica,2015,41(5):949−959群智能优化算法如遗传算法(Genetic algo-rithm,GA)和粒子群优化算法(Particle swarm 收稿日期2014-08-11录用日期2014-12-16Manuscript received August11,2014;accepted December16, 2014国家自然科学基金(61261007,61361010,11303094),云南省自然科学基金重点项目(2013FA008)资助Supported by National Natural Science Foundation of China (61261007,61361010,11303094),and Key Program of Yunnan Natural Science Foundation(2013FA008)本文责任编委沈轶Recommended by Associate Editor SHEN Yi1.云南大学信息学院昆明6500912.玉溪师范学院信息技术工程学院玉溪6531001.School of Information,Yunnan University,Kunming6500912.School of Information Technology and Engineering,Yuxi Nor-mal University,Yuxi653100optimization,PSO)及其改进算法由于其具有鲁棒性强、便于并行处理等优点[1],已经被广泛应用于路径规划[2−3]、置换流水车间调度[4]、限量弧路由[5]等工程优化问题中.近年来大部分实际工程优化问题越来越复杂且往往存在多个局部最优解(多模)[6].多模性限制了经典的GA和PSO算法在复杂工程优化问题中的应用[7].这是由于:一方面多个局部最优解(吸引域)很容易使搜索群陷入局部最优解出现早熟停滞,优化精度低[8],另一方面多个局部最优解对种群的吸引会导致算法震荡而无法收敛[9].为了跳出局部最优解以增加收敛于全局最优解的概率,许多学者引入新的搜索策略,提出了改进的950自动化学报41卷GA和PSO算法.这些不同策略可以大致分为四类:重启、均衡全局和局部搜索、混合全局和局部搜索以及多群.基于重启策略的算法通过分析种群的收敛程度决定对部分个体重新初始化.该类方法具有跳出局部最优解的能力,但是由于种群收敛到一定程度才通过重启对全局进行再次勘察且历史信息没有被充分利用,所以其效率不高.在单一种群同时负责全局和局部搜索的算法中,需要均衡全局搜索和局部搜索以获得较好的结果.为了在多个局部最优解中找到全局最优解,Liang等提出了全面学习粒子群算法(Comprehensive learning par-ticle swarm optimizer,CLPSO)[10].CLPSO算法中搜索个体利用所有粒子历史信息更新自己的位置以提高全局搜索能力,逃出局部最优解.模因算法(Memetic algorithm,MA)是一类混合全局和局部搜索算法[6],搜索个体在交流之前首先通过局部学习策略进行局部调整后分享较好的信息.李航等通过首先全局搜索然后局部搜索提出了两阶段遗传算法[11].Wang等提出了一种改进的MA算法以通过全局搜索和局部调整相结合的方式来对解空间进行高效的搜索[12].MA算法通过同时增强全局和局部搜索能力以提高算法的搜索能力.然而选择合适的全局策略和局部策略对算法在不同问题中的表现非常重要.尽管以上改进的算法在复杂测试函数中表现出了较好的全局收敛性,其搜索群体仍然会在受到多个局部最优解的吸引时而振荡.为了解决多模优化问题中多峰的迷惑性,多群算法应运而生.李敏强等通过引入小生境思想提出了协同多群体遗传算法[13].该算法中,多个群体在不同子区域独立搜索,消弱了多峰对群体的影响.受启发于萤火虫之间的相互吸引力与它们各自的亮度成正比而与它们的距离成反比,Yang提出萤火虫算法(Firefly algorithm,FA)[14].FA算法中,每个个体仅与其周围的个体交流,这种策略有助于避免振荡,提高算法的收敛性[15].Liang等把和声算法[16]引入到动态多群粒子群算法[17],提出了动态多群和声粒子群算法(Dynamic multi-swarm particle swarm optimizer with harmony search,DMS-PSO-HS)[18].DMS-PSO-HS算法充分发挥了动态多群粒子群算法的全局搜索能力和和声算法的局部搜索能力.这些改进的算法一定程度上提高了解决复杂工程问题的能力,然而仍然有改进的空间.它们实现的过程中,信息的交流和共享增加了计算复杂度.因此有必要找到一种高效的结构来管理搜索群以及个体之间的信息交流.基于前人的研究成果,考虑到计算机数据结构特点,本文提出了一种基于数据结构的多元化搜索群智能优化算法.由于搜索个体具有分工不同的多元化特点,所以我们以多元优化算法(Multivariant optimization algorithm,MOA)命名该算法.在MOA中,多个搜索个体(元)基于我们称之为结构体的数据结构实现高效的信息共享,按照各自的分工对解空间进行搜索以逼近全局最优解.搜索元按照分工不同可以分为全局搜索元(Global atom)G a 和局部搜索元(Local atom)L a.在每次迭代中,全局搜索元首先在整个解空间中随机生成负责对全局进行搜索并对发现的潜在解区域进行记忆共享,然后不同规模的局部搜索元组在不同潜在解区域内进行局部搜索以找到该局部区域内的更优的解.适应度越好的区域其对应局部搜索元组规模就越大,反之亦然.全局搜索元和局部搜索元搜索到的较优的解分别按照预先设定的规则保存到结构体中,通过结构体高效地共享搜索信息.MOA算法中,全局元在每次迭代中首先对全局进行勘察,一旦发现更具有潜力的潜在解区域立即分享该信息,新的局部元组再对该区域进行细致开采.这种全局勘察策略与重启策略相比具有更大的概率发现多个潜在解区域,并且能够基于历史信息迅速调整搜索策略.MOA算法也具有MA算法的全局–局部搜索交替进行的特点,然而MOA算法的局部搜索是由规模不同的子群相互协作完成而不是单个个体通过单独的学习实现的.多个个体协同搜索以增加单次搜索计算复杂度为代价来减少迭代次数,提高总搜索效率.同时MOA引入了多群算法的多群思想,但是其与大部分多群算法相比,无需额外的计算量计算个体之间的欧氏距离或者判断其所在小生境以实现总群分组[19].收敛性是智能优化算法的一个重要性质,研究算法的收敛性为算法参数选择、改进策略提供了有力的理论基础[20−21].近年学者们从不同角度分析了GA和PSO算法的收敛性[22].许多学者基于随机过程给出了GA和PSO算法收敛的充要条件,从理论上解释了其易陷入局部最优解,丰富了其理论基础[23−25].本文首先介绍了MOA算法.然后对MOA算法的收敛性进行了理论和实验两方面的分析.通过把MOA算法的寻优过程描述为马尔科夫随机过程,从理论上证明了算法以概率1收敛于全局最优解.通过比较多元优化算法和其他五个成熟优化算法对十三个典型二维和十维测试函数的寻优实验,我们验证了多元优化算法较其他方法具有较高的收敛成功率和精度.1多元优化算法多元优化算法通过交替的全局–局部搜索,对解空间进行搜索并逐渐逼近全局最优解.算法基于5期李宝磊等:多元优化算法及其收敛性分析951如图1所示的上三角型结构体完成对历史信息的记忆和共享来指导多元化搜索元分工合作对解空间进行全面和细致的探索.多元优化算法中的结构体是由一个位于顶部的队列和n 个挂接在队列节点上的堆栈所组成.队列负责对全局元的管理,共享全局信息;队列负责局部元的管理,实现局部开采并向全局元汇报其区域内更优解的位置.其中,pPrior 指向前一个队列节点,pNext 指向后一个队列节点,pStack 指向其下挂接的堆栈,pUpper 指向上一个堆栈节点,pUnder 指向下一个堆栈节点,pAtom 指向一个搜索元.图1上三角型结构体Fig.1Upper triangular structure在求目标函数最小值的优化问题中,队列节点中搜索元的适应度值按从左到右依次递增,即队列最左端的搜索元的适应度值始终是最小的.堆栈中节点根据搜索元的适应度值从上到下依次递增,堆栈顶部搜索元的适应度值始终是最小的.队列中G a 在队列中的位置越靠前,在其邻域内生成的L a 个数就越多,这样就能大幅增加找到更优解的概率.结构体是MOA 算法的迭代基础,全局–局部搜索交替迭代进行,直到找到全局最优解.多元优化算法的伪代码(Pseudo-code)如下所示:设置每次迭代中全局元个数m ;第i 个局部内分配的局部元个数m i ;局部半径r ;最大迭代次数I max ;问题的维度d ;解空间第i 维的上、下限min i 和max i .以新生成的全局元、局部元X j,i (i =1,···,m ;j =m i )及其适应度值初始化结构体.While k ≤I maxFor i =1:m //全局搜索G i a ←根据式(1)生成全局元f (G i a )←评价G iaEnd For根据f (X 1,i )≤f (X 1,i +1)的原则,用G i a (i =1,···,n )更新队列.For i =1:mFor j =1:m i //局部搜索L j a ←根据式(2)生成局部元f (L j a )←评价L jaEnd For根据f (X j,i )<f (X j +1,i )的原则,用L j a (j =1,···,m i )更新第i 个堆栈.End For k =k +1End While多元优化算法的一次迭代包括全局搜索和局部搜索两个阶段.在全局搜索阶段,根据式(1)在整个搜索空间中随机生成全局元G a ,实现对全局的搜索.G a =[h 1,···,h d ]h i =unifrnd (min i ,max i )(1)式中,d 是问题的维度;min i 和max i 分别为解空间第i 维的下界和上界;unifrnd (min i ,max i )函数返回一个均匀分布在min i 和max i 之间的随机数.新生成的全局元与全局链表中的元比较,适应度值较好的全局元被作为潜在解区域的中心记录在结构体的全局链表中.在局部搜索阶段,根据式(2)在以全局元G a 为中心、r 为半径的局部邻域内随机生成局部元,实现对各个潜在解区域的局部搜索.L a =G a +r ×[l 1,···,l d ](2)其中,l i (i =1,···,d )是−1到1之间的随机数.新生成的局部元与局部链表中的元比较,较好的元作为历史信息保留下来.如果局部元优于该区域的全局元,则该局部元将取代全局元作为新的潜在解区域中心进入全局链表.由MOA 算法的流程可知:与GA 和PSO 相比,多元化搜索个体的管理增加了算法的计算复杂度.当用上三角形结构体时,m i =m −i +1,则MOA 算法一次迭代的计算复杂度为O(m +m (m +1)/2).2多元优化算法的收敛性分析假设所求解目标问题的状态空间S 是有限集,我们首先证明了当算法的运行过程可以用齐次马尔科夫链来描述,然后基于MOA 寻优过程的状态转移概率,证明了MOA 算法以概率1收敛于全局最优解.定义1.MOA 算法在第t 次迭代时结构体状态集合为X (t )={x t,1,···,x t,n },其中x t,i ∈S,n <952自动化学报41卷∞,x和S分别表示可行解向量和解空间,n为结构体中搜索元的个数.{X(t),t>0}构成一个离散时间的随机过程,其状态空间为E=|S|n.定义2.优化问题的全局最优解集合为E∗={x∗| x=x∗,f(x)≤f(x∗)}(3)令F(X(t))=|X(t)∩E∗|表示结构体中包含的最优解的个数.定义3.如果对于任意初始状态X0均有limt→∞P(F(X(t))>0|X(0)=X0)=1(4)则称算法以概率1收敛于全局最优解.定理1.MOA算法的寻优过程{X(t),t>0}是有限齐次马尔科夫链.证明.当t=0时,结构体的初始状态X(0)= {x0,1,···,x0,n}是随机产生的.在后续的迭代搜索过程中,搜索元基于当前结构体中记忆的信息对解空间搜索,并用搜索过程中获得的有用信息对结构体的状态进行更新.令t时刻结构体的状态为X(t),下一时刻结构体的状态为X(t+1).由多元优化算法的搜索过程可以看出,搜索元搜索解空间使结构体以概率P(X(t+1)|X(t))转移到下一个状态.该概率依赖于当前结构体的状态X(t)且是一个与时间无关的常量:P(X(t+1)=X i|X(t)=X j)=ζ,ζ>0(5)其中,X i,X j是两个任意的状态.可见{X(t),t> 0}具有齐次马尔科夫性质.由于结构体大小是有限的,所以如果搜索空间有限,则结构体的状态有限.这样结构体的状态转移构成的马尔科夫过程的状态空间有限,因此多元优化算法的搜索过程{X(t),t>0}是有限齐次马尔科夫链.定理2.结构体包含最优解的个数序列是单调不递减的,即对于任意∀t≥0,有P(F(X(t+1))<m|F(X(t)=m))=0,m≥0(6)证明.由于表示最优解的搜索元的适应度值总是优于其他搜索元,而多元优化算法的选择策略为保留较优搜索元,因此老一代结构体中的最优解在新一代结构体中不可能被淘汰,即在任意时刻t结构体中最优解的个数为m(m≥0)的条件下,t+1时刻结构体中最优解的个数小于m的概率是0.定理3.多元优化算法在任意时刻都有可能发现全局最优解,即P(F(X(t+1))>0|F(X(t)=0))>0,∀t≥0(7)证明.由多元优化算法的搜索策略可知,全局搜索元组在整个搜索空间中随机生成,故任意时刻全局搜索元为任一可能解的概率不为0.则任意时刻全局搜索元为全局最优解的概率也不为0.故在老一代结构体中最优解的个数为0的条件下,新一代搜索元中最优解的个数不为0的概率大于0.定理4.多元优化算法以概率1收敛于全局最优解.limt→∞P(F(X(t))>0)=1(8)证明.记t时刻结构体中最优解的个数为i的概率为P i(t)=P(F(X(t))=i),由贝叶斯条件概率公式有P0(t+1)=P(F(X(t+1))=0|F(X(t))=0)×P(F(X(t))=0)+P(F(X(t))=0)×P(F(X(t+1))=0|F(X(t))=0)由定理2可得:P(F(X(t+1))=0|F(X(t))=0)= 0,所以P0(t+1)=P(F(X(t+1))=0|F(X(t))=0)×P0(t)又由定理3可知:P(F(X(t+1))>0|F(X(t))= 0)>0,令ξ=min(P(F(X(t+1))>0|F(X(t))= 0),t=0,1,···),即P(F(X(t+1))>0|F(X(t))=0)≥ξ>0(9)由式(9)可得:P(F(X(t+1))=0|F(X(t))=0)=1−P(F(X(t+1))=0|F(X(t))=0)=1−P(F(X(t+1))>0|F(X(t))=0)≤1−ξ<1(t=0,1,···)所以P0(t+1)≤(1−ξ)P0(t)≤···≤(1−ξ)t+1P0(0)因为lim t→∞(1−ξ)t+1=0,且0≤P0(0)≤1,所以当t→∞时0≤P0(t+1)≤(1−ξ)t+1P0(0)=0因此,lim t→∞P0(t+1)=0,综上所述limt→∞P(F(X(t+1))>0)=1−limt→∞P(F(X(t+1)=0)=1−limt→∞P0(t+1)=1由此,lim t→∞P(F(X(t))>0)=1.5期李宝磊等:多元优化算法及其收敛性分析9533实验和结果3.1实验设置为了运用统计分析的方法公平合理地比较6种不同算法的性能,我们对如表1所示的13个2维和10维标准测试函数分别进行了30次寻优测试.表中D表示问题的维度, 为搜索精度阈值,当算法找到的最优解与全局最优解的欧氏距离小于该阈值时,表1测试函数Table1Benchmark functions函数名函数表达式搜索空间维度全局最优解 rMichalewiczdi=1(sin(i·x2iπ))20sin(x i)+1.81−(0,5)D D=2[2.20,1.57]0.10.1Langermann5i=1c i·cos(z iπ)·e−z iπ+5.163(0,10)D D=2[2.00,1.00]0.10.1 z i=(x−a i)2+(y−b i)2a=[3,5,2,1,7]b=[5,2,1,4,9]c=[1,2,5,2,3]YangStandingWave e (−di=1(x i15)6)−2e(−di=1x2i)di=1cos2(x i)(−20,20)D D=2[0.00,0.00]0.10.4Damavandi1−|sin[π(x1−2)]sin[π(x2−2)]π2(x1−2)(x2−2)|5×(0,14)D D=2[2.00,2.00]0.10.15 (2+(x1−7)2+(x2−7)2)+1CF1cf1∼cf10:Sphere function(−5,5)DD=2[−1.94−3.78]0.10.1[δ1,...,δ10]=[1, (1)D=10[−1.94,−3.78,−1.54,1.61,1.340.50.1 [λ1,···,λ10]=[0.05,···,0.05]2.45,1.79,3.75,0.13,−0.08]CF2cf1∼cf10:Griewank s function(−5,5)DD=2[−3.85,3.42]0.10.1[δ1,...,δ10]=[1, (1)D=10[−3.85,3.42,1.71,3.07,0.60.50.1 [λ1,···,λ10]=[0.5,···,0.5]2.58,4.03,4.18,−4.02,3.84]CF3cf1∼cf10:Griewank s function(−5,5)DD=2[1.06,−3.76]0.10.1[δ1,...,δ10]=[1, (1)D=10[1.06,−3.76,3.96,−2.57,3.360.50.1 [λ1,···,λ10]=[1,···,1]0.87,2.34,−3.48,−3.68,0.39]CF4cf1∼cf2:Ackley s function(−5,5)Dcf3∼cf4:Rastrigin s functioncf5∼cf6:Weierstrass function D=2[3.33,−1.28]0.10.1 cf7∼cf8:Griewank s functioncf9∼cf10:Sphere function[δ1,...,δ10]=[1, (1)D=10[3.33,−1.28,1.90,−0.41,0.090.50.1 [λ1,···,λ5]=[532,532,1,1,10] 2.76,0.98,−1.81,−2.50,2.74][λ6,···,λ10]=[10,0.05,0.05,0.05,0.05]CF5cf1∼cf2:Rastrigin s function(−5,5)Dcf3∼cf4:Weierstrass functioncf5∼cf6:Griewank s function D=2[1.60,2.64]0.10.1 cf7∼cf8:Ackley s functioncf9∼cf10:Sphere function[δ1,...,δ10]=[1, (1)D=10[1.60,2.64,1.80,0.94,−3.050.50.1 [λ1,···,λ5]=[15,15,10,10,0.05]−1.16,3.56,2.42,−0.38,4.46][λ6,···,λ10]=[0.05,532,532,0.05,0.05]954自动化学报41卷我们称算法成功收敛于全局最优解.2维和10维优化问题中, 的设置分别与文献[26]和文献[27]保持一致.r为MOA算法中的局部搜索半径,r的选择对算法的性能具有一定的影响,根据经验,r一般设置为搜索空间上下限差值的0.1∼0.2倍较宜,这与小生境算法中小生境半径的设置一致[28].函数CF1∼CF5是Liang等提出的新型合成多峰复杂测试函数[29].Suganthan[30]在其个人主页(.sg/home/EPNSugan/)上提供了这些函数的代码及其所使用的正交矩阵、偏移全局最优解、控制参数.所有参与比较的算法具有相同的种群大小和迭代次数.在2维的优化问题中,种群大小为20,最大迭代次数为200.在10维的优化问题中,种群大小为65,最大迭代次数为450.算法达到最大迭代次数就停止.参与比较的算法以及文献中给出的各自特有最优参数如下:1)精英保留策略的基因算法:每次迭代种群更新率(Generation gap)为0.8;交叉和变异的概率分别设置为0.2和0.01[31].2)自适应惯性权重的粒子群优化算法:惯性权重随着迭代次数的增加从1.4按照指数递减到0.5;加速常数c1和c2均为1.49445[32].3)全面学习粒子群优化算法:惯性权重随着迭代次数的增加从0.9按照指数递减到0.4;加速常数c为1.49445;更新间隔(Refreshing gap)为7[10].4)动态多粒子群和声算法:DMS-PSO-HS算法的提出者建议的最优参数如下[18]:w=0.729,c1=c2=1.49445.在2维的优化问题中,5个子群,每个子群内有4个个体;在10维的优化问题中,13个子群,每个子群内有5个个体.重新分组间隔R=10,和声记忆采取率HMCR=0.98,第t次迭代时微调概率P AR(t)及范围宽度bw(t)由下式决定:P AR(t)=0.01+0.99−0.01max g×tbw(t)=(0.05×(UB−LB))e0.0001(0.05×(UB−LB))×t其中,max g是最大迭代次数,UB和LB是搜索空间的上下限.5)萤火虫算法:随机搜索因子α为0.2;吸引力参数β0为1;亮度吸收参数γ为1[14].6)多元优化算法:结构体为三角形结构.在2维的优化问题中,队列长度为5;在10维的优化问题中,队列长度为10.堆栈深度从左到右依次递减1,左边第一个堆栈栈深与队列长度相等,全局搜索元个数与队列长度相等,局部搜索元组种群大小与其对应的堆栈深度相等.3.2结果分析本文以全局最优解收敛成功率(成功收敛于最优解的测试次数与测试总次数的比率)和算法找到的最优解与全局最优解之间误差的欧氏距离(收敛精度)为评价标准,对6个算法做了统计分析比较,并基于适应度渐近曲线比较了6种算法在欺骗性较强、局部极值较多优化问题中的收敛性能.表2为6种算法分别对13个全局优化测试函数执行30次寻优的收敛成功率统计结果.由表2可知:1)在大部分优化问题中,多元优化算法的收敛成功率大于其他几个算法.在对10维CF3函数寻优中,虽然MOA收敛成功率不是最高,但是其与最高值相差不大.MOA算法仅在2维CF2函数寻优中获得成功收敛率较低.可见,与其他方法相比, MOA算法收敛于全局最优解的概率较高.MOA算法中全局元对全局进行勘察,不仅能够快速发现较优区域,而且保证了种群的多样性不随迭代次数的增加而衰减.这正是MOA算法能够跳出局部最优解逐渐向全局最优解收敛并获得较高收敛成功率的原因.MOA算法具有在多个区域独立搜索以发现多个最优解以及局部次优解的能力,然而当局部最优值与全局最优值非常接近时,由于其很难根据适应度值区分局部陷阱与全局最优解,所以尽管其找到的最优解适应度值很接近全局最优值,然而该最优解与全局最优解的欧氏距离可能很远,这也符合没有免费的午餐定理.CF2函数全局最优解附近有较多的局部最优解且其适应度值与全局最优值非常接近,然而本文以算法找到的最优解距离全局最优解的欧氏距离而非最优解的适应度值为依据来判断算法是否成功收敛于全局最优解.这就解释了为什么MOA算法对CF2函数寻优时具有较低的收敛成功率.2)在大部分优化问题特别是2维优化问题中,改进的算法包括CLPSO、DMS-PSO-HS以及新算法FA获得的收敛成功率较经典的GA和PSO算法高.这一定程度上说明了混合全局–局部策略和多群策略有利于消弱早熟收敛、多峰迷惑现象,从而在多个局部最优解中找到全局最优解.MOA算法较高的收敛成功率也得益于交替的全局–局部搜索和多群分工策略.3)在10维的优化问题中,所有算法的收敛成功5期李宝磊等:多元优化算法及其收敛性分析955表2收敛成功率统计Table2Static of convergence success rate函数维度GA(%)PSO-w CLPSO(%)DMS-PSO-HS(%)FA(%)MOA(%)Michalewicz2100.0100.0100.0100.0100.0100.0 Langermann233.074.0100.081.599.0100.0 YangStandingWave297.5100.0100.0100.0100.0100.0 Damavandi20.00.00.00.028.533.3 CF1281.578.0100.094.0100.0100.0CF22 3.060.094.042.589.047.5CF3219.066.598.082.5100.0100.0CF4213.521.514.022.058.066.5CF5230.549.087.564.0100.0100.0CF11076.746.746.780.00.0100.0CF21010.00.013.330.00.033.3CF310 3.30.00.0 3.30.00.0CF4100.00.00.00.00.00.0CF51030.056.7 3.373.30.0100.0率普遍偏低,特别是对于10维CF3以及CF4函数.尽管如此,MOA算法在其他3个10维测试函数中仍然获得了明显高于其他算法的收敛成功率.与2维优化问题相比,10维优化问题具有局部陷阱数量多、优化变量多的特点.这一方面增加了算法陷入局部最优解的概率,另一方面给算法收敛精度带来了挑战.GA、PSO、CLPSO和FA算法收敛成功率偏低的主要原因是它们容易受多局部陷阱影响,出现早熟收敛或者震荡不收敛现象.MOA和DMS-PSO-HS算法收敛成功率偏低的主要原因是它们的收敛精度没有达到标准.特别是MOA算法的局部搜索方式是以全局元为中心的云状搜索.尽管这种局部搜索方式计算复杂度低,发现隐蔽最优解能力强,然而局部半径大小对算法收敛精度具有较大影响.较小的局部半径会导致较慢的收敛速度和较弱的逃离局部陷阱能力,然而较大的局部半径无法保证较高的收敛进度.收敛精度不达标是MOA 算法在10维优化问题中较低收敛成功率的主要原因.综上所述,MOA算法具有在多个局部最优解中找到全局最优解的能力,并且其全局最优解收敛成功率高于其他5个成熟的算法.表3为6种算法分别对13个测试函数执行30次寻优的收敛误差均值和标准差统计结果.数据格式为:误差均值±标准差.由表3我们可以得到如下结论:1)除了2维CF2和10维CF3、CF4以外,多元优化算法的收敛误差均值小于其他几个算法.在对2维函数CF2寻优中,虽然MOA收敛误差均值不是最低的,但是其与最低值相差不大.MOA算法仅对10维函数CF3和CF4寻优收敛误差较大.尽管如此,MOA算法在其他3个10维测试函数中仍然获得了明显低于其他算法的收敛误差均值.对于大部分优化问题,MOA算法收敛误差低于其他5个方法.MOA算法在对10维CF3、CF4函数寻优测试中收敛误差较大的主要原因是在这两个函数的全局最优解的吸引域相对较小且解空间中存在多个离全局最优解较远而适应度值与全局最优解较接近的局部最优解.MOA算法中的全局元能够快速找到吸引域相对较大的局部最优解所在区域,由于局部最优解适应度值与全局最优解接近,全局解所在区域内优于局部最优解的区域就较小.局部最优解进入队列的速度越快,落入全局解所在区域的全局元进入队列的机会就越少.交替的全局–局部搜索策略加快了算法的收敛速度,也增加了算法忽略吸引域较小、适应度值较局部最优解差距不大的全局最优解的概率.2)在大部分2维以及10维优化问题中,改进的算法包括CLPSO、DMS-PSO-HS以及新算法FA 获得的收敛误差均值较经典的GA和PSO算法低.这是由于一方面经典算法收敛成功率低,另一方面经典算法跳出局部最优解的能力较弱,其陷入离全局最优解较远的局部最优解后早熟收敛.然而改进的算法及新算法由于引入新的搜索策略,具有跳出局部最优解的能力,即使其无法找到全局最优解,其也有可能跳出离全局最优解较远的局部最优解而向离全局最优解较近的局部最优解逼近,这种现象在包络是单峰的多峰优化问题中经常发生.10维测试函数CF1和CF3的实验结果也佐证了这一点.GA 算法的收敛成功率高于CLPSO算法,然而GA的。

多维函数全局寻优的团队进步算法

度逐步缩小改变范围。探索强度 te、tp 最初可以达

到搜索空间的边界, 可选为探索次数的函数

te, p = ( 1- ke /K ) Ae, p

( 7)

式中, K 为算法强制终止时的最大迭代次数; ke 表示

当前累计的探索次数。收缩指数 Ae, p 表示可分别对

精英组和普通组取不同的参数 Ae 和 Ap。普通组的

K ey w ord s: mu lt imodal prob lem; global optim izat ion; evolut ion algorithm; two2group

0引 言

多变量多极值优化在相当广泛的科学研究与工 程应用领域成为解决问题关键。对此人们发展了各 种具有全局搜索能力的算法。以遗传算法 ( GA )为

以遗传算法ga为代表的模拟进化过程的演化类算法提供了解决多极值优化问题的有效工具sga及其简单改进方案的主要问题是参数括适应函数选择不当会导致早熟收敛而陷入局部极值点或者相反因过分避免早熟而导致慢收敛应用中ga参数的选择需要仔细斟酌对此人们对ga的选择交叉和变异3个算子提出了种类繁多的改进迄今能够组合出的ga方案数量庞大

1. 2. 1 新生成员 新生成员可任选一组产生。若从精英组产生,

则新生成员的某个能力因素可从当前精英组成员同

一因素值中继承。记新生成员为 xr, 则

xr = [ xr1, xr2, , , xrn ] T

xej = [xej, 1, xej, 2, , , xej, n ]T

( 2)

xr i = xem i, i, mi 为 1至 N 的随机整数 其中, 随机整数 mi 的 下标 i 表示每个能力 因素 xri

义了学习和探索运算, 并合理设定了成员更新规则。两组成员在搜索过程中出现 了明显分 工, 使算

高中数学丨用12种方法求多元函数的最值,学霸都掌握的解题技巧

高中数学丨用12种方法求多元函数的最值,学霸都掌握的解

题技巧

在高中数学里,多元函数的最值问题就是在多个约束条件下,某一个问题的最大和最小值.在所列的式子之中,有多个未知数.求解多元函数的最值问题技巧性强、难度大、方法多,灵活多变,多元函数的最值问题蕴含着丰富的数学思想和方法.解题办法常有:导数法、消元法、基本不等式法、换元法等

最终得到了12种处理多元函数的最值问题的方法,并通过高考真题来进行详细讲解,普通人和学霸之间差距就是学习方法和解题技巧,今天老师就把这些方法分享给同学们,掌握以后,大大提升了解题速度,你也你能轻松变学霸。

各种群体寻优算法的比较

各种群体寻优算法的⽐较【蚁群优化算法、粒⼦群优化算法、细菌觅⾷算法、萤⽕⾍算法、⼈⼯鱼群算法】计算机技术不断发展,算法技术也在不断更新。

群体智能 (Swarm Intelligent,SI) 算法始于 20 世纪 90 年代初,主要是受⾃然界⽣物群体智能现象的启发,通过模仿社会性动物的⾏为,⽽提出的⼀种随机优化算法。

群体智能是基于种群⾏为对给定的⽬标进⾏寻优的启发式搜索算法,其的核⼼是由众多简单个体组成的群体能够通过相互之间的简单合作来实现某⼀较复杂的功能。

所以群体智能可以在没有集中控制并且缺少全局信息和模型的前提下,为寻找复杂的分布式问题的解决⽅案提供了基础。

作为计算智能的⼀个重要的学科分⽀,群体智能优化算法是⼀类通过模仿⽣物界的遗传进化机理和群体协作⾏为⽽提出的仿⽣类随机搜索算法。

该算法以其⾼效的寻优速度,⽆需考虑问题的过多初始信息等特点⽽受到⼈们的普遍关注。

群体智能优化算法是⼀类基于概率的随机搜索进化算法,各个算法之间存在结构、研究内容、计算⽅法等具有较⼤的相似性。

因此,群体智能优化算法可以建⽴⼀个基本的理论框架模式:Step1:设置参数,初始化种群;Step2:⽣成⼀组解,计算其适应值;Step3:由个体最有适应着,通过⽐较得到群体最优适应值;Step4:判断终⽌条件⽰否满⾜?如果满⾜,结束迭代;否则,转向Step2;各个群体智能算法之间最⼤不同在于算法更新规则上,有基于模拟群居⽣物运动步长更新的(如PSO,AFSA与SFLA),也有根据某种算法机理设置更新规则(如ACO)。

统⼀框架下的群体智能优化算法,可以根据优化对象的特性只能地选择适合的更新规则,进⾏运算得到理想的优化结果。

蚁群算法(Ant Colony, ACO):是模拟真实的蚁群秘觅⾷过程寻求最短路径的原理,由意⼤利学者Dorigo等在20世纪90年代⾸先提出。

最初的蚁群算法成为蚂蚁系统,对于旅⾏商问题(TSP)及⼆次分配问题(QAP)等取得了较好效果,经过改进后成为蚂蚁算法或蚁群算法。

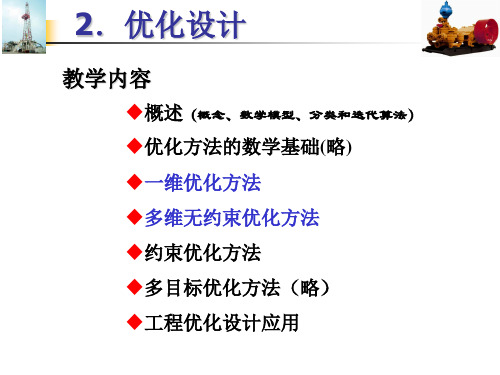

第二章-优化设计

优化数学模型: 设计变量:

X x1 x2

T

x3

目标函数:

min f X x1 x2 2 x1 x3 x2 x3

x2

1 1 x1 x2 10 x x1 2 约束条件:

g1 X 4 x1 0 g 2 X x2 0

设计变量X

设计常 量

设计变量:在优化设计过程中需要调整和优选的参数。

特点:

(1)实际工程设计对象的不同,则选取的设计变量也就不同。 它可以是几何参数:如零件外形尺寸、截面尺寸、机构的运动尺寸 等;也可以是某些物理量:如零部件的重量、体积、力与力矩、惯 性矩等;还可以是代表机器工作性能的导出量:如应力、变形等。 总之,设计变量必须是对该项设计性能指标优劣有影响的参数。 (2)设计变量是一组相互独立的基本参数。它的每一个分量都 是相互独立的。

x1

二、优化设计数学模型

可以看出,优化设计的数学模型需要用设计变量、 目标函数和约束条件等基本概念进行描述,可以写成以 下统一的形式: 设计变量:

X x1 , x2 xn 目标函数:

T

f ( X ) f ( x1 , x2 , xn )

约束条件:

不等式约束条件: 等式约束条件:

综上所述,优化数学模型是对实际问题的数学描述和概括,是进行优 化设计的基础。因此,根据设计问题的具体要求和条件建立完备的数学模 型是关系优化设计成败的关键。数学模型的最优解是否是实际问题的最优 解,完全取决于数学模型和实际问题的符合程度。

三、优化问题的分类

一维无约束优化问题 无约束优化问题 工 程 优 化 问 题 多维无约束优化问题

2

3)函数梯度充分小准则 目标函数在迭代点的梯度已达到充分小,即

现代优化方法

通过控制参数的变化,使得解在寻优过程中不断逼近最优解。

概率突跳策略

在寻优过程中,通过引入一定的随机性,使得算法有可能跳出局部最优解,从而寻找到更好的全局最优解。

模拟退火算法的实现步骤

• 初始化:设定初始解、初始温度、降温系数、终止条件等参数。 • 评估解:计算当前解的目标函数值,以及与最优解的距离。 • 判断是否满足终止条件:如果满足,则终止算法并输出最优解;否则,继续下一步。 • 产生新解:根据当前解和目标函数的梯度信息,产生一个新的可能解。 • 判断是否接受新解:根据新解的目标函数值和当前解的目标函数值进行比较,如果新解更好,则接受新解

明确目标

了解约束

首先需要明确优化的目标,如成本最低化、 时间最短化等。目标不同,选择的优化方法 也会不同。

在选择优化方法时,需要了解各种方法的约 束条件,如变量范围、目标函数的性质等。

考虑问题的复杂性

方法的可行性

根据问题的复杂性和规模,选择合适的优化 方法。对于大规模问题,选择高效的优化方 法更为合适。

遗传算法的应用案例

函数优化问题

如求解一元函数的最小值或多元函数的极值点。

调度优化问题

如作业车间调度、排班优化等。

组合优化问题

如旅行商问题、背包问题等。

图像处理问题

如图像分割、特征提取等。

04

模拟退火算法

模拟退火算法的基本原理

基于固体的退火过程的模拟

将优化问题与固体的退火过程进行类比,将问题的解看作是固体中的粒子,通过控制温度和冷却速度,使得粒子在高温下能 够自由运动,并在冷却过程中达到最平衡的状态。

选择的优化方法应具有可实现性和可操作性 ,同时需要考虑计算时间和计算资源的限制 。

多元函数的极值与最优化问题

多元函数的极值与最优化问题多元函数的极值是数学分析中的重要概念,它与最优化问题密切相关。

在本文中,我们将讨论多元函数的极值及其与最优化问题的关系。

一、多元函数的定义多元函数是指依赖于多个变量的函数。

一般地,我们可以表示为f(x1, x2, ..., xn),其中x1, x2, ..., xn是函数的自变量,而f是函数的因变量。

多元函数在实际问题的建模与求解中具有广泛应用。

二、多元函数的极值多元函数的极值包括极大值和极小值两种情况。

在定义域内,如果存在一个点,使得在该点邻域内的函数值都小于(或大于)该点的函数值,则称该点为极小值点(或极大值点)。

此时,我们说函数在该点取到了极小值(或极大值)。

三、求解多元函数的极值要求解多元函数的极值,通常可以采用以下两种方法:一是利用二阶导数判别法,二是利用约束条件法。

1. 利用二阶导数判别法对于多元函数而言,如果所有的二阶偏导数都存在且连续,可以利用二阶导数判别法来判断该点是否为极值点。

具体地,根据二阶导数的符号来判断:若二阶导数为正,则该点为极小值点;若二阶导数为负,则该点为极大值点;若二阶导数为零,则不能确定该点是否为极值。

2. 利用约束条件法对于带有约束条件的多元函数极值问题,我们需要引入拉格朗日乘子法。

该方法将约束条件与目标函数结合起来,通过构造拉格朗日函数,将多元函数约束问题转化为无约束的极值问题。

进而,我们可以通过对拉格朗日函数求偏导并令其为零,求解出极值点。

四、多元函数极值与最优化问题的关系多元函数的极值问题是最优化问题中的重要内容。

最优化问题是在一定的约束条件下,寻找使目标函数达到最优的自变量取值。

而多元函数的极值点恰好是最优化问题的解。

因此,通过研究多元函数的极值,我们可以求解最优化问题。

最优化问题在实际应用中具有广泛的应用,例如在经济学中的最大化和最小化问题、在工程学中的优化设计问题等。

通过对多元函数的极值进行分析,并结合具体问题的约束条件,可以帮助我们找到最优解,提高问题的解决效率。

介绍一个全局最优化的方法:随机游走算法(RandomWalk)

介绍⼀个全局最优化的⽅法:随机游⾛算法(RandomWalk)介绍⼀个全局最优化的⽅法:随机游⾛算法(Random Walk)2017年08⽉12⽇ 12:13:26 阅读数 184641. 关于全局最优化求解 全局最优化是⼀个⾮常复杂的问题,⽬前还没有⼀个通⽤的办法可以对任意复杂函数求解全局最优值。

上⼀篇⽂章讲解了⼀个求解局部极⼩值的⽅法——梯度下降法。

这种⽅法对于求解精度不⾼的情况是实⽤的,可以⽤局部极⼩值近似替代全局最⼩值点。

但是当要求精确求解全局最⼩值时,梯度下降法就不适⽤了,需要采⽤其他的办法求解。

常见的求解全局最优的办法有拉格朗⽇法、线性规划法、以及⼀些⼈⼯智能算法⽐如遗传算法、粒⼦群算法、模拟退⽕算法等(可以参见我之前的博客)。

⽽今天要讲的是⼀个操作简单但是不易陷⼊局部极⼩值的⽅法:随机游⾛算法。

2. 随机游⾛算法操作步骤设f(x)f(x)是⼀个含有nn个变量的多元函数,x=(x1,x2,...,xn)x=(x1,x2,...,xn)为nn维向量。

1. 给定初始迭代点xx,初次⾏⾛步长λλ,控制精度ϵϵ(ϵϵ是⼀个⾮常⼩的正数,⽤于控制结束算法)。

2. 给定迭代控制次数NN,kk为当前迭代次数,置k=1k=1。

3. 当 k<Nk<N时,随机⽣成⼀个(−1,1)(−1,1)之间的nn维向量u=(u1,u2,⋯,un),(−1<ui<1,i=1,2,⋯,n)u=(u1,u2,⋯,un),(−1<ui<1,i=1,2,⋯,n),并将其标准化得到u′=u∑ni=1u2i√u′=u∑i=1nui2。

令x1=x+λu′x1=x+λu′,完成第⼀步游⾛。

4. 计算函数值,如果 f(x1)<f(x)f(x1)<f(x),即找到了⼀个⽐初始值好的点,那么kk重新置为1,将x1x1变为xx,回到第2步;否则k=k+1k=k+1,回到第3步。

5. 如果连续NN次都找不到更优的值,则认为,最优解就在以当前最优解为中⼼,当前步长为半径的NN维球内(如果是三维,则刚好是空间中的球体)。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

A s atA nvl w -ru vlt na o t w i al a r es l rh ( P , rsne b t c: oe togo peo i l rh hc i cl dt m po s agi m T A) i pee t r u o gi m, h s e e r g ot s d

V0 . 8 No 5 12 . 0c. 2 o t o8

20 0 8年 1 O月

文章编号 : 7 - 3 (0 8 0 - 0 -8 1 35 9 2 0 )50 70 6 4 0

多维 函数 全 局 寻优 的 团队进 步 算 法

薄 亚 明

( 南京邮电大学 通信与信息工程学 院, 江苏 南京 20 0 ) 10 3

i h s p p r y smu a n e me e c in f e r i g e p o n n e me e e e a u e f a I e n t i a e i lt g t mb ra t so a n n , x lr g a d t mb r n w l l so t m. n t b i h o l i h r r ae h a g rtm , et a me e sa ed v d d i t ee i n l i r u sw t err s e t e e i me , ema i u a lo h i t m mb r r i i e o t l e a d p an g o p i t i e p ci p t s t n p l — h e n h t h h v o h t n flan n n x l r t n a ep o el e n d, d t e me e e e l u e e r a o a l sa l h d T e i so r ig a d e p o a o r r p r d f e a mb rr n wa r ls a e s n b y e tb i e . h o e i y i n h r s me e s iiin o cin c l e r e d r g t e s a c r c d r , h c k s t e ag r m o s se e p — mb r ’d vso fa t a me g u n e h p o e u e w ih ma e h o t p se s st o o l i h r l i h h tn ilo l b l l c n i cin l s a c . u r a e ut e f a h e g r m a e p o e t s o e t go a , a a d dr t a e h N me c rs l v r y t tt e n w a o i a f ol e o r i l s i h l h t h s t rp r e f h i smp e i lme t t n, i h s c e s r t o lb p i z t n,a t c n e g n e lw c mp tt n c s , t n o i l mp e n a i h g u c s ae f r go a o t o l miai f s o v r e c ,o o u ai o t s o g r — o o r b sn s n a y d tr n t n o e p a tr , n h ti i v u b e frd f r n p i z t n a p ia in . u t e s a d e s e e mi ai f h a mee s a d ta s a a l i e e to t a i p l t s o t r t l o mi o c o Ke r s mu i d r be ;g o a p i z t n;e o u in ag r h ;t o g o p y wo d : h mo a p o lm l lb lo t a i mi o v lt o tm w — u o l i r

摘

要: 通过模仿 团队进步 需要的学 习、 索行为和成 员更新规则 , 出了一种新颖的 双群 体演化算法 , 探 提 称为 团队进步算法( P 。算法将 一个团队的成 员分 为精英和普通组 , T A) 建立 了两组的学 习样板 , 定 义了学习和探 索运算 , 并合理设 定了成 员更新规则 。两组成员在搜 索过程 中出现 了明显分工 , 算 使

第2 8卷

第 5期

南 京 邮 电 大 学 学 报 (自 然 科 学 版 J

Junl f aj gU i ri f ot adTl o u i tn ( aua Sine ora o N n n nP s c ao l e

(C lg f o u i tnadIfrainE g er g N migU i mt f ot adTlcm n ao sN nig2 00 , hn ) ol eo mm nc i n om t ni ei , a n nv i o P s n e o mui t n , aj 10 3 C i e C ao n o n n e y s e ci n a

中 图分 类 号 : 24 0 2 文献标识码 : A

Te m o rs g rt m o o a tmia in o u t d r be a Pr g e sAlo ih f r Glb lOpi z t fM li o mo a P o lms l

BO — n Ya mi g

法兼备 了全局搜 索、 局部搜 索和定 向搜 索的能力。数值试验结果验证 了新算 法具 有实现 简单 、 全局

寻优成功率 高、 收敛快、 计算量少、 坚韧性强和参数选择相对容 易等特性 , 对解决优化应 用问题 具有

较 大 的价 值 。

关键词 : 多极值 问题 ; 全局优化 ; 演化算法 ; 双群体