第九讲定类或定序因变量回归分析剖析

第九讲定类或定序因变量回归分析

该模型即为logit回归模型。logit回归模型实际上是普通多元

线性回归模型的推广,但它的误差项服从二项分布而非正态分布,

因此,需要采用极大似然估计方法进行参数估计,参数称为 logit回归系数,表示当其他自变量取值保持不变时,该自变量取

值增加一个单位引起的发生比自然对数值的变化量。

2、发生比

g(P)= log (P/1-P)

以对数比率为因变量对自变量X1,X2,X3……做回归称为对数比率 回归(logistic regression),其方程式为:

P log( ) a i X i 1 P

表1 概率、比率和对数比率

概率 0.01 0.10 0.20 0.30 0.40 0.50 0.60 0.70 0.80 0.90 0.99

四、极大似然估计的基本思想

1) 概率问题 例1、假定我们要估计一样本中男性的发生概率。以s表示样本中男性 的数量;N是样本规模;π 是总体中男性的概率( =0.5 )。 根据贝努利公式:

Pr( s / , N ) N! s (1 ) N s s !( N s)!

三、简单对数比率回归

1、模型建立

既然用线性概率回归存在以上两个方面的局限性,我们能否用比率做 因变量呢? 比如用男女比率作因变量,用成功与不成功之比做因变量。用比率做 因变量可以建立估计方程,但存在的问题是,比率是非对称的. 一个简单的解决办法就是取对数,结果就是所谓对数比率(logit)。 若用P代表某事件的概率,则对数比率函数的定义为

其中:P—党员概率, A—年龄, E—受教育年限, U—单位身份

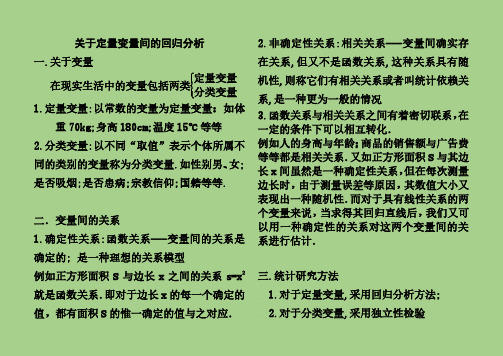

初中数学回归分析课件

(y y

( yn bxn a)2

y ) [2 y1 (bx1 a) 2 y2 (bx2 a) ]

2

2

2

n

2

n

n

n

n

n

i 1

i 1

i 1

i 1

i 1

展开

合并同类项

yi2 2b xi yi 2a yi b2 xi2 2ab xi na 2

×

)

2.判断下列图形中具有相关关系的两个变量

是(

C

)

3.某产品 A 的产量 x 吨与耗电量 y 千瓦的对应

数据如右表.根据右表可求得回归直线方程为

ŷ=b̂x+â,且b̂=0.7,据此模型预测产品产量为 8 吨

时耗电量等于________.

−

−=3.5,点(x

−,y−)

x =4.5,y

x(吨)

3

4 5

2

i

xn2 2nx

2

i

( x1 x2

n

2

xn )

nx

n

i 1

i 1

∴ ( xi x)2 xi2 nx

2

n

xn2 ) xi2 nx

2

i 1

(i 1,

2,

3, ,n) .显然,上面的各个偏差的符号有

正、有负,如果将他们相加会相互抵消一部分,

i 1

整理

i 1

i 1

n

( xi x)( yi y ) n

( yi y ) 2

n[a ( y bx)]2 ( xi x) 2 b i 1 n

七种回归分析方法个个经典

七种回归分析方法个个经典什么是回归分析?回归分析是一种预测性的建模技术,它研究的是因变量(目标)和自变量(预测器)之间的关系。

这种技术通常用于预测分析,时间序列模型以及发现变量之间的因果关系。

例如,司机的鲁莽驾驶与道路交通事故数量之间的关系,最好的研究方法就是回归。

回归分析是建模和分析数据的重要工具。

在这里,我们使用曲线/线来拟合这些数据点,在这种方式下,从曲线或线到数据点的距离差异最小。

我会在接下来的部分详细解释这一点。

我们为什么使用回归分析?如上所述,回归分析估计了两个或多个变量之间的关系。

下面,让我们举一个简单的例子来理解它:比如说,在当前的经济条件下,你要估计一家公司的销售额增长情况。

现在,你有公司最新的数据,这些数据显示出销售额增长大约是经济增长的2.5倍。

那么使用回归分析,我们就可以根据当前和过去的信息来预测未来公司的销售情况。

使用回归分析的好处良多。

具体如下:1.它表明自变量和因变量之间的显著关系;2.它表明多个自变量对一个因变量的影响强度。

回归分析也允许我们去比较那些衡量不同尺度的变量之间的相互影响,如价格变动与促销活动数量之间联系。

这些有利于帮助市场研究人员,数据分析人员以及数据科学家排除并估计出一组最佳的变量,用来构建预测模型。

我们有多少种回归技术?有各种各样的回归技术用于预测。

这些技术主要有三个度量(自变量的个数,因变量的类型以及回归线的形状)。

我们将在下面的部分详细讨论它们。

对于那些有创意的人,如果你觉得有必要使用上面这些参数的一个组合,你甚至可以创造出一个没有被使用过的回归模型。

但在你开始之前,先了解如下最常用的回归方法:1.Linear Regression线性回归它是最为人熟知的建模技术之一。

线性回归通常是人们在学习预测模型时首选的技术之一。

在这种技术中,因变量是连续的,自变量可以是连续的也可以是离散的,回归线的性质是线性的。

线性回归使用最佳的拟合直线(也就是回归线)在因变量(Y)和一个或多个自变量(X)之间建立一种关系。

回归分析法概念及原理

回归分析法概念及原理回归分析法概念及原理回归分析定义:利用数据统计原理,对大量统计数据进行数学处理,并确定因变量与某些自变量的相关关系,建立一个相关性较好的回归方程(函数表达式),并加以外推,用于预测今后的因变量的变化的分析方法。

分类:1.根据因变量和自变量的个数来分类:一元回归分析;多元回归分析;2. 根据因变量和自变量的函数表达式来分类:线性回归分析;非线性回归分析;几点说明:1.通常情况下,线性回归分析是回归分析法中最基本的方法,当遇到非线性回归分析时,可以借助数学手段将其化为线性回归;因此,主要研究线性回归问题,一点线性回归问题得到解决,非线性回归也就迎刃而解了,例如,取对数使得乘法变成加法等;当然,有些非线性回归也可以直接进行,如多项式回归等;2.在社会经济现象中,很难确定因变量和自变量之间的关系,它们大多是随机性的,只有通过大量统计观察才能找出其中的规律。

随机分析是利用统计学原理来描述随机变量相关关系的一种方法;3.由回归分析法的定义知道,回归分析可以简单的理解为信息分析与预测。

信息即统计数据,分析即对信息进行数学处理,预测就是加以外推,也就是适当扩大已有自变量取值范围,并承认该回归方程在该扩大的定义域内成立,然后就可以在该定义域上取值进行“未来预测”。

当然,还可以对回归方程进行有效控制;4.相关关系可以分为确定关系和不确定关系。

但是不论是确定关系或者不确定关系,只要有相关关系,都可以选择一适当的数学关系式,用以说明一个或几个变量变动时,另一变量或几个变量平均变动的情况。

回归分析主要解决的问题:回归分析主要解决方面的问题;1.确定变量之间是否存在相关关系,若存在,则找出数学表达式;2.根据一个或几个变量的值,预测或控制另一个或几个变量的值,且要估计这种控制或预测可以达到何种精确度。

回归模型:回归分析步骤:1. 根据自变量与因变量的现有数据以及关系,初步设定回归方程;2. 求出合理的回归系数;3. 进行相关性检验,确定相关系数;4. 在符合相关性要求后,即可根据已得的回归方程与具体条件相结合,来确定事物的未来状况,并计算预测值的置信区间;回归分析的有效性和注意事项:有效性:用回归分析法进行预测首先要对各个自变量做出预测。

第9章 回归与相关解析

Y a bX

(14 1)

直线回归方程一般表达式:

Yˆ a bX

a:截距(intercept),直线与Y轴交点的纵坐标。

b:斜率(slope),回归系数(regression coefficient)。

意义:X每改变一个单位,Y平均改变b个单位。 b>0,Y随X的增大而增大(减少而减少)—— 斜上;

b=453.7385/3216.950=0.141,a=8.2235-0.141×39.45=2.661 本例计算的回归系数 b=0.141表示年龄每增加1岁,估计胆固

醇平均水平增0.14lmmol/L。将以上计算结果代入式(14-1)得 到由年龄估计胆固醇平均水平的回归方程为:

Y 2.661 0.141X

首先

SS总= (Yi Y )2=lYY

SS回= (Yi Y )2 blXY lX2Y / lXX

(14 7)

SS残 (Yi Yi )2 SS总 SS回

如上例中SS总=lYY=88.8081,按式(14-7)

SS回=blXY=0.141×453.7385=63.9771

所以SS残=88.8081-63.9771=24.8310

2.计算回归系数b与截距a。从表14-1得到下列数据:

n 20,

Xi 789, X 39.45,

X

2 i

34343.00

Yi 164.47,Y 8.2235, Yi2 1441.3271, XiYi 6942.08

利用式(14-4)得到: lXY=6942.08—(789)(164.47)/20=453.7385 lXX=34343.00—(789)2/20=3216.950 lYY=1441.3271—(164.47)2/20=88.8081 代入式(14-2)及式(14-3)得到a、b的估计值为:

回归分析及进阶分析多元回归与结构方程模型

H0:B2=B3=0

等同于零假设H0:R2=0

这个假设表明两个解释变量一起对应变量Y无影响,

这是对估计的总体回归直线的显著性检验。

Note:书上的写反了。

如果分子比分母大,也即Y被回归解释的部分比未被回 归解释的部分大,F值越大,说明解释变量对应变量Y的 变动的解释的比例逐渐增大,就越有理由拒绝零假设。

年龄是否影响智商(IQ)

◦ 定量---定量

年龄是否影响对电脑品牌的选择

◦ 定量---定性

性别是否影响对电脑品牌的选择

◦ 定性---定性

。。。。。。

考虑家庭月可支配收入如何影响消费支出。 可支配收入 X(千元) 消费支出 Y(千元)

假设样本为10,

为了拟合这样一条直线,需要某种准则。准则不同,

能大一些,样本量太小时,估计量的稳定性肯定不 会很好。

拟合优度:

◦ 样本数据聚集在样本回归直线周围的密集程度,从而判断 回归方程对样本数据的代表程度。

◦ 判定系数

回归方程的显著性检验:

◦ F检验

◦ 对因变量与所有自变量之间的线性关系是否显著的一种假 设检验

回归系数的显著性检验

◦ 根据样本估计的结果对总体回归系数的有关假设进行检验 ◦ T检验

用样本回归直线与推断总体回归直线 用一些指标来判断推断的是否合理(接近)

Байду номын сангаас 样本回归方程

求出参数

需要一个公式/准则:

◦ 所有观测点与直线的垂直距离

(称为残差

Residual)都尽可能地小,即让所有的观测点与直线的垂

回归分析线性回归Logistic回归对数线性模型

逻辑回归的模型为 (P(Y=1) = frac{1}{1+e^{-z}}),其中 (z = beta_0 + beta_1X_1 + beta_2X_2 + ... + beta_nX_n)。

逻辑斯蒂函数

பைடு நூலகம்

定义

逻辑斯蒂函数是逻辑回归模型中用来描述自变量与因变量之 间关系的函数,其形式为 (f(x) = frac{1}{1+e^{-x}})。

。

在样本量较小的情况下, logistic回归的预测精度可能高 于线性回归。

线性回归的系数解释较为直观 ,而logistic回归的系数解释相 对较为复杂。

对数线性模型与其他模型的比较

对数线性模型假设因变量和自变量之间存在对 数关系,而其他模型的假设条件各不相同。

对数线性模型的解释性较强,可以用于探索自变量之 间的交互作用和效应大小。

THANKS

感谢您的观看

预测市场细分中的消费者行为等。

对数线性模型还可以用于探索性数据分析,以发现数 据中的模式和关联。

Part

04

比较与选择

线性回归与logistic回归的比较

线性回归适用于因变量和自变 量之间存在线性关系的场景, 而logistic回归适用于因变量为

二分类或多分类的场景。

线性回归的假设条件较为严格 ,要求因变量和自变量之间存 在严格的线性关系,而logistic 回归的假设条件相对较为宽松

最小二乘法

最小二乘法是一种数学优化技术,用于最小化预测值与实际观测值之间的平方误差总和。

通过最小二乘法,可以估计回归系数,使得预测值与实际观测值之间的差距最小化。

最小二乘法的数学公式为:最小化 Σ(Yi - (β0 + β1X1i + β2X2i + ...))^2,其中Yi是实际观 测值,X1i, X2i, ...是自变量的观测值。

因变量是定性变量的回归分析—Logistic回归分析

因变量是定性变量的回归分析—L o g i s t i c回归分析This model paper was revised by the Standardization Office on December 10, 2020因变量是定性变量的回归分析—Logistic 回归分析一、 从多元线性回归到Logistic 回归例 这是200个不同年龄和性别的人对某项服务产品的认可的数据(logi.sav). 其中: 年龄是连续变量,性别是有男和女(分别用1和0表示)两个水平的定性变量,而变量“观点”则为包含认可(用1表示)和不认可(用0表示)两个水平的定性变量。

从这张图可以看出什么呢从这张图又可以看出什么呢这里观点是因变量, 只有两个值;所以可以把它看作成功概率为p 的Bernoulli 试验的结果.但是和单纯的Bernoulli 试验不同,这里的概率p 为年龄和性别的函数. 必须应用Logistic 回归。

二、 多元线性回归不能应用于定性因变量的原因首先,多元线性回归中使用定性因变量严重违反本身假设条件,即:因变量只能取两个值时,对于任何给定的自变量值,e 本身也只能取两个值。

这必然会违背线性回归中关于误差项e 的假设条件。

其次,线性概率概型及其问题:由于因变量只有两个值;所以可以把它看作成功概率p ,取值范围必然限制在0—1的区间中,然而线性回归方程不能做到。

另外概率发生的情况也不是线性的。

三、 Logistic 函数Logistic 的概率函数定义为:我们将多元线性组合表示为:于是,Logistic 概率函数表示为:经过变形,可得到线性函数:这里, 事件发生概率=P (y=1)事件不发生概率=1-P (y=0) 发生比:Ω=-=pp odds 1)( 对数发生比:)(log )1(ln )log(p it p p odds =⎥⎦⎤⎢⎣⎡-= 这样,就可将logistic 曲线线性化为:从P 到logit P 经历了两个步骤变换过程:第一步:将p 转换成发生比,其值域为0到无穷第二步:将发生比换成对数发生比,其值域科为[]∞+∞-经过转换, 将P →logit P,在将其作为回归因变量来解释就不再有任何值域方面的限制了,即可线性化!四、 Logistic 回归系数的意义以logit P 方程的线性表达式来解释回归系数,即:在logistic 回归的实际研究中,通常不是报告自变量对P 的作用,而是报告自变量对logit P 的作用。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

似然函数为:

Li(/yi)

y : e y

y!

假定观察值是独立的,样本的似然函数就是个体似然函数的乘积。

Li(/yi) = L1 * L2 *… Ln

=N Li

i 1

L( / y) e N yi

yi !

LnL = -N+yiln()-ln(yi!) əlnL/ə = -N +yi/ = yi / N

2

i 1

ln L

n

[

1

( xi

)2 ]

0

i1

3

n

xi

ˆ i 1

x

n

n

2

( xi x)

ˆ 2 i1

n

例3、估计logistic回归模型中的参数 由于logistic模型是二项分布,其似然函数为:

n

L=

i1

p yi i

通过三个例子的比较,我们可以看出在线性回归中,似然函数是

通过对似然方程求偏导数得到的,对于未知参数是线性的,容易求解,

但是对于logistic回归,似然函数是α和β的非线性函数,求解比较困

难,需要借助于计算机,通过迭代计算完成。

最大似然估计与OLS估计的统计性质几乎完全相同,即具有一

致性、渐进有效性和渐进正态性。一致性是指当样本规模增大时,模

例3、运用极大似然估计法估计正态分布中的参数

设变量X为具有平均数μ,方差σ 的2 正态变量,这里μ和σ 为2 未知 参数。试由样本观察值X1,X2……Xn估计平均值μ和方差σ。 2

解:由最大似然法得下述似然函数:

n

L

1

( xi )2

e 2 2

i1 2

ln L n ( xi ) 0

)

x K

k 0 k ik

)

(i )

该模型即为logit回归模型。logit回归模型实际上是普通多元 线性回归模型的推广,但它的误差项服从二项分布而非正态分布, 因此,需要采用极大似然估计方法进行参数估计,参数称为 logit回归系数,表示当其他自变量取值保持不变时,该自变量取 值增加一个单位引起的发生比自然对数值的变化量。

对数似然。

通常基本模型以独立模型表示:

log( P ) a

1 P

用L0表示独立模型的似然,L1表示非独立模型的似然,那么对数似 然比定义为:

G2

2 log( L1 L0

)

(2 log

L0 )

(2 log

L1)

遵循卡方分布,其自由度为非独立模型的自变量数目,可用于检验 复杂模型中自变量对似然率的增加是否显著,越大越好。

Wald 统计量实际上就是正态分布Z 统计量的平方。在零假设条件 下,每一个回归系数都等于0。Wald统计量服从卡方分布,其自由 度为n-k-1。

3)无意义的解释

从解释力上看,由于概率的值是有边界的,在0与1之间。但林楠方程

很有可能要超过该限制,因变量的估计值可能是负数,也可能大于1,因

此模型的结果是无意义的。例如,运用林楠方程,我们发现如果年龄为

100岁,受教育程度超过10年,则入党的概率约等于1。

4)非线性关系

三、简单对数比率回归

因此,模型的拟合优度是指预测值与观测值的匹配程度。检验拟合 优度的指标有皮尔逊卡方检验、对数似然比卡方检验等。

1)皮尔逊卡方检验 皮尔逊卡方检验主要用于检验残差项的大小。计算公式:

2 n ( yi pi )2 i1 pi (1 pi )

其中yi是观察值(0或1),pi是估算值的概率, i=1,2…n,分母是估 算值的标准差,自由度为n-J-1,其中J为自变量数目。

2)、Hosmer-Lemeshow 拟合优度检验 该方法通常适用于自变量很多,或自变量为连续变量

的情形。HL方法根据预测概率的大小将所有观察单位十等 分,然后根据每一组中因变量的实际值与理论值计算 Peason卡方,其统计量为:

HL

G g 1

( yg ng µpg ) ng µpg (1 µpg )

型参数估计逐渐向真值收敛,即估计将近似于无偏。所谓渐进有效性

是指当样本规模增大时,参数估计的标准误相应缩小。所谓渐进正态

性是指随着样本规模增大,最大似然估计值的分布渐进于正态分布。

五、logistic回归模型及参数估计的评价

1、Logistic回归模型估计的假设条件

第一、数据来自于随机样本。

第二、因变量Yi被假设为K个自变量Xk(k=1,2,…,K) 的函数。

1、模型建立

既然用线性概率回归存在以上两个方面的局限性,我们能否用比率做

因变量呢?

比如用男女比率作因变量,用成功与不成功之比做因变量。用比率做

因变量可以建立估计方程,但存在的问题是,比率是非对称的.

一个简单的解决办法就是取对数,结果就是所谓对数比率(logit)。

若用P代表某事件的概率,则对数比率函数的定义为

倍。

四、极大似然估计的基本思想

1) 概率问题

例1、假定我们要估计一样本中男性的发生概率。以s表示样本中男性

的数量;N是样本规模;π是总体中男性的概率( =0.5 )。

根据贝努利公式: Pr(s / , N ) N ! s (1 )N s s!(N s)!

其中k!=k(k-1)…2.1 10个样本中有3个男性的概率为:

其中G 代表分组数,且G10;ng为第g组中的观测值数; yg第g组事件的观测数量;pg为第g组的预测事件概率; ngpg为事件的预测值,实际上它等于第g组的观测概率和。

3)对数似然比卡方检验

对数似然比是用较复杂模型的似然与基本模型的似然进行比较。

因为是非常小的数,通常将似然取对数并乘以-2,即-2logL,简称

Pr(s 3 / 0.5, N 10) 10! 0.53(1 0.5)103 0.117 3!(10 3)!

如果我们已知样本中s、N及其概率分布的信息,需要估计总体特征, 则需要借助极大似然估计法来完成。极大似然估计ML就是估计这样一个参 数值,由于该参数的存在可以使得被观察的事件最有可能发生。

2、发生比

发生比是事件的发生频数与不发生频数之间的比,即: Odds=(事件发生频数)/(事件不发生频数)

oddsk [ pk /(1 pk )]

当比值大于1时,表明事件更有可能发生。比如一

个事件发生的概率为0.6,事件不发生的概率为0.4,发

生比等于0.6/0.4=1.5。事件发生的可能性是不发生的1.5

P = a + ∑βiXi + ε

对二项分布线性概率模型的结果解释:

在其他变量不变的情形下,x每增加一个单位,事件发生概率的

期望将变动β个单位。

例如,林楠和谢文(1988)曾用线性概率模型估测入党(政治

资本)的概率,模型为:

P = -0.39 +0.01A +0.04E +0.03U 其中:P—党员概率, A—年龄, E—受教育年限, U—单位身份

第三、正如OLS回归,logistic回归也对多重共线性有所 限制,自变量之间存在多重共线性会导致标准误的膨胀。

Logistic回归模型还有一些与OLS回归不同的假设。

第一,因变量是二分变量;第二,因变量和各自变量之间

的关系是非线性的。

2、拟合优度检验

模型参数估计完成以后,需要评价模型是否能够有效地描述了观测 数据。如果模型的预测值能够与对应的观测值有较高的一致性,就认为 这一模型能够拟合数据。否则将不能接受这一模型,而需要对模型重新 设置。

g(P)= log (P/1-P)

以对数比率为因变量对自变量X1,X2,X3……做回归称为对数比率

回归(logistic regression),其方程式为:

log( P ) a 1 P

i Xi

表1 概率、比率和对数比率

概率 0.01 0.10 0.20 0.30 0.40 0.50 0.60 0.70 0.80 0.90 0.99

3、logit模型回归系数的假设检验

设原假设H0为:βk=0,表示自变量对事件发生的可能性无影响;如果原 假设被拒绝,说明自变量对事件发生的可能性有影响。

Wald检验

在logit模型中,对回归系数进行显著性检验,通常使用Wald检验,其计 算公式为:

W (¶k / SEµk )2

(1

p )(1 yi ) i

n

ln( L)

ln[ i 1

p yi i

(1

pi )(1 yi ) ]

n

[ yi ln( pi ) (1 yi ) ln(1 pi )] i 1

n i 1

[

yi

ln( pi 1 pi

)

ln(1

pБайду номын сангаас )]

n

[ yi ( xi ) ln(1 e xi )] i 1

比率 0.01 0.11 0.25 0.43 0.67 1.00 1.50 2.33 4.00 9.00 99

对数 -4.60 -2.20 -1.39 -0.85 -0.41 0.00 0.41 0.85 1.39 2.20 4.60 比率

exp(

pi

1 exp(

K k 0

k

xik