Matlab里的神经网络参数设置

MATLAB神经网络工具箱的详细使用步奏

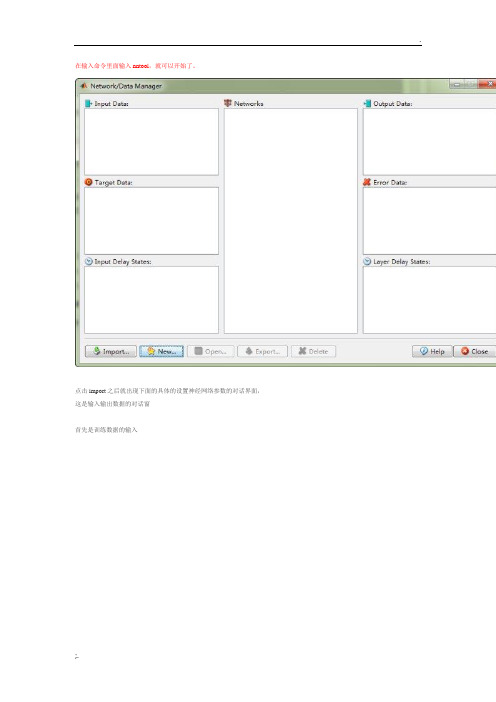

在输入命令里面输入nntool,就可以开始了。

点击import之后就出现下面的具体的设置神经网络参数的对话界面,这是输入输出数据的对话窗

首先是训练数据的输入

然后点击new,创建一个新的神经网络network1,并设置其输入输出数据,包括名称,神经网络的类型以及隐含层的层数和节点数,还有隐含层及输出层的训练函数等

点击view,可以看到这是神经网络的可视化直观表达

创建好了一个network之后,点击open,可以看到一个神经网络训练,优化等的对话框,选择了输入输出数据后,点击train,神经网络开始训练,如右下方的图,可以显示动态结果

下面三个图形则是点击performance,training state以及regression而出现的

下面就是simulate,输入的数据是用来检验这个网络的数据,output改一个名字,这样就把输出数据和误差都存放起来了

在主界面上点击export就能将得到的out结果输入到matlab中并查看

下图就是输出的两个outputs结果。

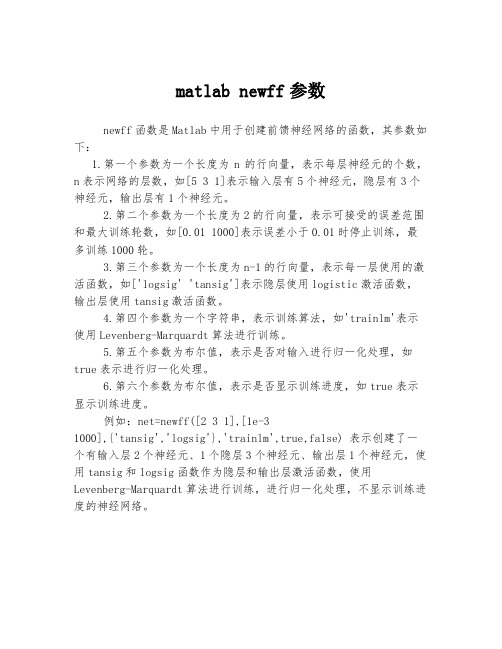

matlab newff参数

matlab newff参数

newff函数是Matlab中用于创建前馈神经网络的函数,其参数如下:

1.第一个参数为一个长度为n的行向量,表示每层神经元的个数,n表示网络的层数,如[5 3 1]表示输入层有5个神经元,隐层有3个神经元,输出层有1个神经元。

2.第二个参数为一个长度为2的行向量,表示可接受的误差范围和最大训练轮数,如[0.01 1000]表示误差小于0.01时停止训练,最多训练1000轮。

3.第三个参数为一个长度为n-1的行向量,表示每一层使用的激活函数,如['logsig' 'tansig']表示隐层使用logistic激活函数,输出层使用tansig激活函数。

4.第四个参数为一个字符串,表示训练算法,如'trainlm'表示使用Levenberg-Marquardt算法进行训练。

5.第五个参数为布尔值,表示是否对输入进行归一化处理,如true表示进行归一化处理。

6.第六个参数为布尔值,表示是否显示训练进度,如true表示显示训练进度。

例如:net=newff([2 3 1],[1e-3

1000],{'tansig','logsig'},'trainlm',true,false) 表示创建了一个有输入层2个神经元、1个隐层3个神经元、输出层1个神经元,使用tansig和logsig函数作为隐层和输出层激活函数,使用Levenberg-Marquardt算法进行训练,进行归一化处理,不显示训练进度的神经网络。

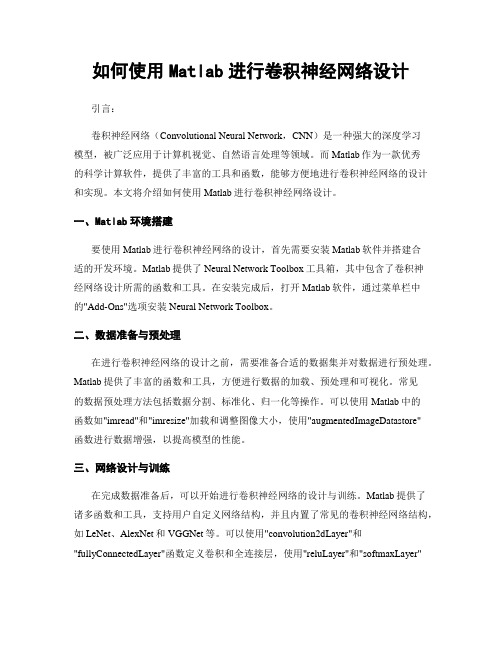

如何使用Matlab进行卷积神经网络设计

如何使用Matlab进行卷积神经网络设计引言:卷积神经网络(Convolutional Neural Network,CNN)是一种强大的深度学习模型,被广泛应用于计算机视觉、自然语言处理等领域。

而Matlab作为一款优秀的科学计算软件,提供了丰富的工具和函数,能够方便地进行卷积神经网络的设计和实现。

本文将介绍如何使用Matlab进行卷积神经网络设计。

一、Matlab环境搭建要使用Matlab进行卷积神经网络的设计,首先需要安装Matlab软件并搭建合适的开发环境。

Matlab提供了Neural Network Toolbox工具箱,其中包含了卷积神经网络设计所需的函数和工具。

在安装完成后,打开Matlab软件,通过菜单栏中的"Add-Ons"选项安装Neural Network Toolbox。

二、数据准备与预处理在进行卷积神经网络的设计之前,需要准备合适的数据集并对数据进行预处理。

Matlab提供了丰富的函数和工具,方便进行数据的加载、预处理和可视化。

常见的数据预处理方法包括数据分割、标准化、归一化等操作。

可以使用Matlab中的函数如"imread"和"imresize"加载和调整图像大小,使用"augmentedImageDatastore"函数进行数据增强,以提高模型的性能。

三、网络设计与训练在完成数据准备后,可以开始进行卷积神经网络的设计与训练。

Matlab提供了诸多函数和工具,支持用户自定义网络结构,并且内置了常见的卷积神经网络结构,如LeNet、AlexNet和VGGNet等。

可以使用"convolution2dLayer"和"fullyConnectedLayer"函数定义卷积和全连接层,使用"reluLayer"和"softmaxLayer"函数添加激活和分类层。

Matlab 中神经网络算法指令newff的使用

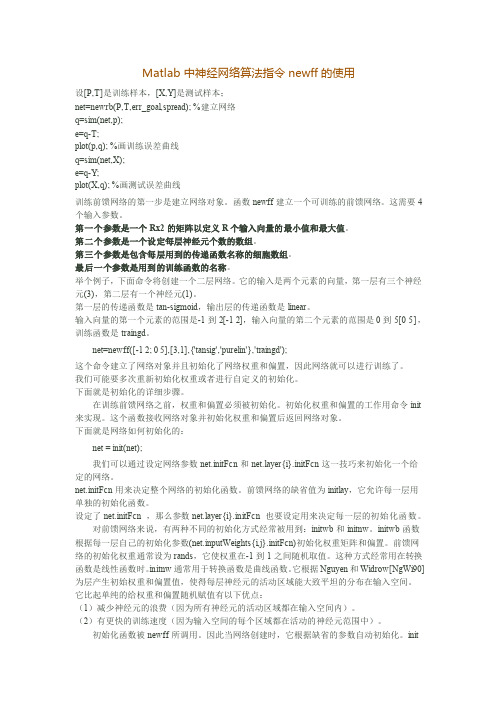

Matlab 中神经网络算法指令newff的使用设[P,T]是训练样本,[X,Y]是测试样本;net=newrb(P,T,err_goal,spread); %建立网络q=sim(net,p);e=q-T;plot(p,q); %画训练误差曲线q=sim(net,X);e=q-Y;plot(X,q); %画测试误差曲线训练前馈网络的第一步是建立网络对象。

函数newff建立一个可训练的前馈网络。

这需要4个输入参数。

第一个参数是一个Rx2的矩阵以定义R个输入向量的最小值和最大值。

第二个参数是一个设定每层神经元个数的数组。

第三个参数是包含每层用到的传递函数名称的细胞数组。

最后一个参数是用到的训练函数的名称。

举个例子,下面命令将创建一个二层网络。

它的输入是两个元素的向量,第一层有三个神经元(3),第二层有一个神经元(1)。

第一层的传递函数是tan-sigmoid,输出层的传递函数是linear。

输入向量的第一个元素的范围是-1到2[-1 2],输入向量的第二个元素的范围是0到5[0 5],训练函数是traingd。

net=newff([-1 2; 0 5],[3,1],{'tansig','purelin'},'traingd');这个命令建立了网络对象并且初始化了网络权重和偏置,因此网络就可以进行训练了。

我们可能要多次重新初始化权重或者进行自定义的初始化。

下面就是初始化的详细步骤。

在训练前馈网络之前,权重和偏置必须被初始化。

初始化权重和偏置的工作用命令init 来实现。

这个函数接收网络对象并初始化权重和偏置后返回网络对象。

下面就是网络如何初始化的:net = init(net);我们可以通过设定网络参数net.initFcn和yer{i}.initFcn这一技巧来初始化一个给定的网络。

net.initFcn用来决定整个网络的初始化函数。

前馈网络的缺省值为initlay,它允许每一层用单独的初始化函数。

matlab神经网络工具箱简介和函数及示例

目前,神经网络工具箱中提供的神经网络模型主 要应用于:

函数逼近和模型拟合 信息处理和预测 神经网络控制 故障诊断

神经网络实现的具体操作过程:

• 确定信息表达方式; • 网络模型的确定; • 网络参数的选择; • 训练模式的确定; • 网络测试

• 确定信息表达方式:

将领域问题抽象为适合于网络求解所能接受的 某种数据形式。

函数类型 输入函数

其它

函数名 称

netsum netprcd concur dotprod

函数用途

输入求和函数 输入求积函数 使权值向量和阈值向量的结构一致 权值求积函数

BP网络的神经网络工具箱函数

函数类型

函数名称 函数用途

前向网络创建 函数

传递函数

学习函数

函数类型 性能函数 显示函数

函数名 函数用途 称

三、BP网络学习函数

learngd 该函数为梯度下降权值/阈值学习函数,通过神经 元的输入和误差,以及权值和阈值的学习速率, 来计算权值或阈值的变化率。

调用格式; [dW,ls]=learngd(W,P,Z,N,A,T,E,gW,gA,D,LP,LS)

二、神经元上的传递函数

传递函数是BP网络的重要组成部分,必须是连续可 微的,BP网络常采用S型的对数或正切函数和线性函数。

• Logsig 传递函数为S型的对数函数。 调用格式为: • A=logsig(N)

N:Q个S维的输入列向量; A:函数返回值,位于区间(0,1) 中

② info=logsig(code)

问题形式的种类:

数据样本已知; 数据样本之间相互关系不明确; 输入/输出模式为连续的或者离散的; 输入数据按照模式进行分类,模式可能会 具有平移、旋转或者伸缩等变化形式; 数据样本的预处理; 将数据样本分为训练样本和测试样本

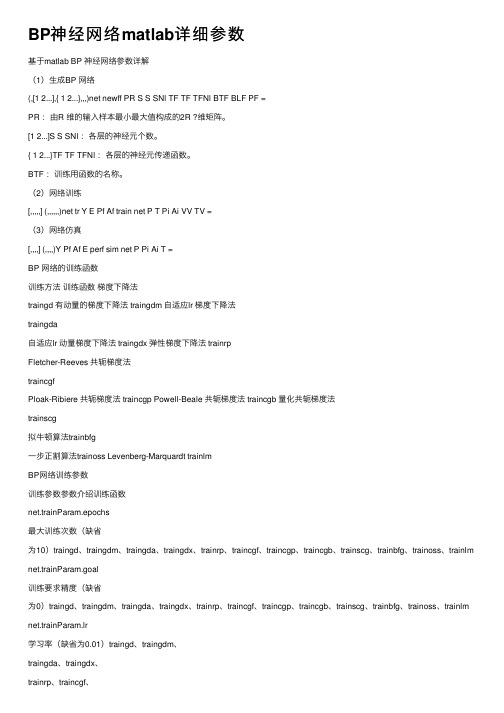

BP神经网络matlab详细参数

BP神经⽹络matlab详细参数基于matlab BP 神经⽹络参数详解(1)⽣成BP ⽹络(,[1 2...],{ 1 2...},,,)net newff PR S S SNl TF TF TFNl BTF BLF PF =PR :由R 维的输⼊样本最⼩最⼤值构成的2R ?维矩阵。

[1 2...]S S SNl :各层的神经元个数。

{ 1 2...}TF TF TFNl :各层的神经元传递函数。

BTF :训练⽤函数的名称。

(2)⽹络训练[,,,,,] (,,,,,,)net tr Y E Pf Af train net P T Pi Ai VV TV =(3)⽹络仿真[,,,,] (,,,,)Y Pf Af E perf sim net P Pi Ai T =BP ⽹络的训练函数训练⽅法训练函数梯度下降法traingd 有动量的梯度下降法 traingdm ⾃适应lr 梯度下降法traingda⾃适应lr 动量梯度下降法 traingdx 弹性梯度下降法 trainrpFletcher-Reeves 共轭梯度法traincgfPloak-Ribiere 共轭梯度法 traincgp Powell-Beale 共轭梯度法 traincgb 量化共轭梯度法trainscg拟⽜顿算法trainbfg⼀步正割算法trainoss Levenberg-Marquardt trainlmBP⽹络训练参数训练参数参数介绍训练函数net.trainParam.epochs最⼤训练次数(缺省为10)traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm net.trainParam.goal训练要求精度(缺省为0)traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm net.trainParam.lr学习率(缺省为0.01)traingd、traingdm、traingda、traingdx、trainrp、traincgf、trainscg、trainbfg、trainoss、trainlmnet.trainParam.max_fail最⼤失败次数(缺省为5)traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm net.trainParam.min_grad最⼩梯度要求(缺省为1e-10)traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlmnet.trainParam.show显⽰训练迭代过程(NaN表⽰不显⽰,缺省为25)traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlmnet.trainParam.time最⼤训练时间(缺省为inf)traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm net.trainParam.mc动量因⼦(缺省0.9)traingdm、traingdxnet.trainParam.lr_inc学习率lr增长⽐(缺省为1.05)traingda、traingdxnet.trainParam.lr_dec学习率lr下降⽐(缺省为0.7)traingda、traingdxnet.trainParam.max_perf_inc表现函数增加最⼤⽐(缺省为1.04)net.trainParam.delt_inc权值变化增加量(缺省为1.2)trainrpnet.trainParam.delt_dec权值变化减⼩量(缺省为0.5)trainrpnet.trainParam.delt0初始权值变化(缺省为0.07)trainrpnet.trainParam.deltamax权值变化最⼤值(缺省为50.0)trainrpnet.trainParam.searchFcn⼀维线性搜索⽅法(缺省为srchcha)traincgf、traincgp、traincgb、trainbfg、trainoss net.trainParam.sigma因为⼆次求导对权值trainscg调整的影响参数(缺省值5.0e-5)/doc/cd3ed4b6f5335a8102d220e4.html mbda trainscgHessian矩阵不确定性调节参数(缺省为5.0e-7)net.trainParam.men_redtrainlm控制计算机内存/速uc度的参量,内存较⼤设为1,否则设为2(缺省为1)net.trainParam.mu trainlmµ的初始值(缺省为0.001)net.trainParam.mu_dec trainlmµ的减⼩率(缺省为0.1)net.trainParam.mu_inc trainlmµ的增长率(缺省为10)net.trainParam.mu_max trainlmµ的最⼤值(缺省为1e10)。

MATLAB神经网络工具箱中的函数属性及其参数定义

3.3 MATLAB神经网络工具箱中的网 络子对象属性

子对象的属性定义了网络的各个子对象:输入向量、 网络层、输出向量、目标向量、权值向量和阈值向量的属 性。 1.输入向量 (1)size属性: net.inputs{i}.size定义了网络各维输入向量 的元素数目,可以被设置为零或正整数。 (2)range属性:net.inputs{i}.range定义了第维输入向量中 每个元素的取值范围,其值是一个 的矩阵。 R2 (3)userdata属性:net.input{i}.userdata和erdata 为用 户提供了关于输入向量的用户信息的地方,它预先只定义 了一个字段,其值为一提示信息。

N N

3.2 MATLAB神经网络工具箱中的网络对 象属性

(6)targetConnect属性:net.targetConnect定义各网络层是 否和目标向量有关,其值为 的布尔型向量(0或1)。 1 N (7)outputConnect属性:net.outputConnect 属性定义各网 络层是否作为输出层,其值为 的布尔型向量(0或 1)。 1 N (8)targetConnect:该属性定义了神经网络的目标层,即 网络哪些层的输出具有目标矢量。其属性值为 维的 布尔量矩阵。 1 N (9)numOutputs:该属性定义了神经网络输出矢量的个数, 属性值为只读变量,其数值为网络中输出层的总数 (sum(net.outputConnect))。

3.2 MATLAB神经网络工具箱中的网络对 象属性

1.结构属性-结构属性决定了网络子对象的数目(包括

输入向量、网络层向量、输出向量、目标向量、阈值 向量和权值向量的数目)以及它们之间的连接关系。 无论何时,结构属性值一旦发生变化,网络就会自动 重新定义,与之相关的其他属性值也会自动更新。 (1)numInputs属性:net.numInputs属性定义了网络的 输入源数,它可以被设置为零或正整数。

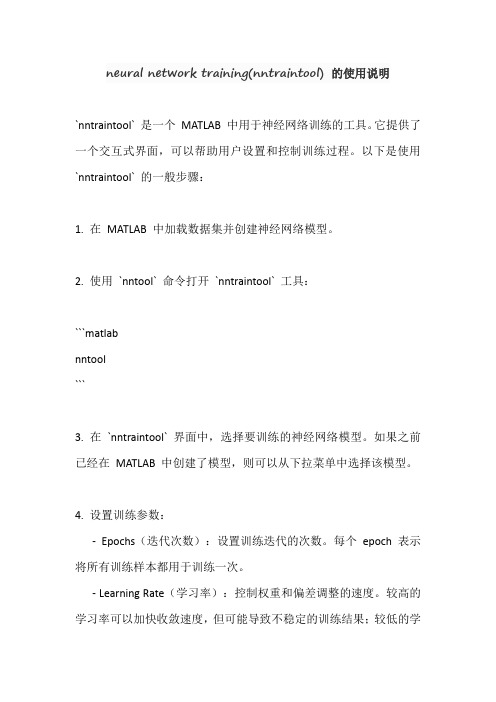

neural network training(nntraintool) 的使用说明

neural network training(nntraintool) 的使用说明`nntraintool` 是一个MATLAB 中用于神经网络训练的工具。

它提供了一个交互式界面,可以帮助用户设置和控制训练过程。

以下是使用`nntraintool` 的一般步骤:1. 在MATLAB 中加载数据集并创建神经网络模型。

2. 使用`nntool` 命令打开`nntraintool` 工具:```matlabnntool```3. 在`nntraintool` 界面中,选择要训练的神经网络模型。

如果之前已经在MATLAB 中创建了模型,则可以从下拉菜单中选择该模型。

4. 设置训练参数:-Epochs(迭代次数):设置训练迭代的次数。

每个epoch 表示将所有训练样本都用于训练一次。

- Learning Rate(学习率):控制权重和偏差调整的速度。

较高的学习率可以加快收敛速度,但可能导致不稳定的训练结果;较低的学习率可以增加稳定性,但可能导致收敛速度变慢。

- Momentum(动量):控制权重更新的惯性,有助于跳出局部最小值。

较高的动量可以加速收敛,但可能导致超调现象。

- Validation Checks(验证检查):设置多少个epoch 进行一次验证,用于监控训练过程的性能。

- Performance Goal(性能目标):设置期望的训练误差。

5. 点击"Train" 按钮开始训练。

`nntraintool` 将显示每个epoch 的训练进度和性能曲线。

6. 在训练过程中,你可以使用`nntraintool` 提供的功能来监视训练进度和性能。

例如,你可以查看误差曲线、性能曲线和权重变化。

7. 训练完成后,你可以保存已训练的神经网络模型,以便后续使用。

以上是使用`nntraintool` 的基本步骤。

请注意,在实际使用中,你可能需要根据你的特定问题和数据集进行适当的调整和优化。

此外,MATLAB 官方文档提供了更详细的说明和示例,可以帮助你更深入地了解如何使用`nntraintool` 进行神经网络训练。

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

net.trainParam.mu_dec

的减小率(缺省为0.1)

trainlm

net.trainParam.mu_inc

的增长率(缺省为10)

trainlm

net.trainParam.mu_max

的最大值(缺省为1e10)

其它的神经网络参数就不贴出了,太多反而会乱.

学习率(缺省为0.01)

traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm

net.trainParam.max_fail

最大失败次数(缺省为5)

Matlab里的神经网络参数设置

摘自

训练函数:

训练函数

训练方法

traingd

梯度下降法

traingdm

有动量的梯度下降法

traingda

自适应lr梯度下降法

traingdx

自适应lr动量梯度下降法

trainrp

弹性梯度下降法

traincgf

Fletcher-Reeves共轭梯度法

traincgp

Ploak-Ribiere共轭梯度法

traingda、traingdx

net.trainParam.delt_inc

权值变化增加量(缺省为1.2)

trainrp

net.trainParam.delt_dec

权值变化减小量(缺省为0.5)

trainrp

net.trainParam.delt0

初始权值变化(缺省为0.07)

trainrp

net.trainParam.deltamax

net.trainParam.lr_inc

学习率lr增长比(缺省为1.05)

traingda、traingdx

net.trainParam.lr_dec

学习率lr下降比(缺省为0.7)

traingda、traingdx

net.trainParam.max_perf_inc

表现函数增加最大比(缺省为1.04)

权值变化最大值(缺省为50.0)

trainrp

net.trainParam.searchFcn

一维线性搜索方法(缺省为srchcha)

traincgf、traincgp、traincgb、trainbfg、trainoss

net.trainParam.sigma

因为二次求导对权值调整的影响参数(缺省值5.0e-5)

logsig

S型传输函数

poslin

正线性传输函数

purelin

线性传输函数

radbas

径向基传输函数

satlin

饱和线性传输函数

satlins

饱和对称线性传输函数

softmax

柔性最大值传输函数

tansig

双曲正切S型传输函数

tribas

三角形径向基传输函数

elliot2sig

?

elliotsig

最大训练时间(缺省为inf)

traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm

net.trainParam.mc

动量因子(缺省0.9)

traingdm、traingdx

net.trainParam.show

显示训练迭代过程(NaN表示不显示,缺省为25)

traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm

net.trainParam.time

traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm

net.trainParam.min_grad

最小梯度要求(缺省为1e-10)

traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm

net.trainParam.goal

训练要求精度(缺省为0)

traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm

net.trainParam.lr

trainscg

mbda

Hessian矩阵不确定性调节参数(缺省为5.0e-7)

trainscg

net.trainParam.men_reduc

控制计算机内存/速度的参量,内存较大设为1,否则设为2(缺省为1)

trainlm

net.trainParam.mu

的初始值(缺省为0.001)

traincgb

Powell-Beale共轭梯度法

trainscg

量化共轭梯度法

trainbfg

拟牛顿算法

trainoss

一步正割算法

trainlm

Levenberg-Marquardt

神网络传递函数名:

函数名

函数解释

compet

竞争型传递函数

hardlim

阈值型传递函数

hardlims

对称阈值型传输函数

?

netinv

?

radbasn

?

神经网络训练设置:

参数名称

解释

适用方法

net.trainParam.epochs

最大训练次数(缺省为10)

traingd、traingdm、traingda、traingdx、trainrp、traincgf、traincgp、traincgb、trainscg、trainbfg、trainoss、trainlm