递推最小二乘辨识-

遗忘因子递推最小二乘法辨识rc电路

遗忘因子递推最小二乘法辨识rc电路遗忘因子递推最小二乘法(Recursive Least Squares,简称RLS)是一种用于参数辨识的方法,主要针对线性时变系统的辨识问题。

在本文中,我们将探讨如何使用RLS方法辨识RC电路。

首先,我们需要了解什么是RC电路。

RC电路由一个电阻和一个电容组成,其工作原理是通过电阻阻碍电流的流动,而电容则储存电荷。

RC电路可以用于滤波器、积分器等应用中。

在辨识RC电路时,我们可以将其视为一个一阶系统,其传递函数可以表示为:H(s) = 1 / (RCs + 1)其中,s是频率,RC是电阻和电容的乘积。

我们的目标是辨识出RC的值。

接下来,我们将介绍如何使用RLS方法辨识RC电路的参数。

首先,我们需要采集一些输入-输出数据对。

我们可以通过施加不同的输入信号,并记录输出信号来获取这些数据对。

这些输入信号可以是脉冲信号、阶跃信号或正弦信号等。

设输入信号为u(t),输出信号为y(t),则我们可以得到如下的离散模型:y(k) = wT(k) · x(k)其中,y(k)是第k个采样点的输出,w(k)是待辨识的参数向量,x(k)是输入-输出数据对构成的特征向量。

在训练过程中,我们需要定义一个递归的更新规则来更新参数向量w(k)。

这里,我们引入遗忘因子λ,用于控制历史数据对参数的影响程度。

遗忘因子的取值范围为0到1之间,较大的值表示较快的遗忘,较小的值表示较慢的遗忘。

参数向量的更新公式如下:w(k) = w(k-1) + P(k-1) · x(k) · e(k)其中,P(k-1)是协方差矩阵,它与遗忘因子有关,可以通过递推方式得到:P(k) = 1/λ · (P(k-1) - P(k-1) · x(k) · x(k)T · P(k-1) / (λ + x(k)T · P(k-1) · x(k)))e(k)是输出误差,可以通过以下方式计算:e(k) = y(k) - wT(k-1) · x(k)以上就是使用遗忘因子递推最小二乘法辨识RC电路的基本原理和公式。

递推阻尼最小二乘法辨识算法公式的详细推导与说明

控制理论与控制工程学位课程《系统辨识》考试报告递推阻尼最小二乘法公式详细推导专业:控制理论与控制工程班级:2011双控(研)学生姓名:江南学号:20110201016任课教师:蔡启仲老师2012年06月29 日摘要在参数辨识中,递推最小二乘法是用得最多的一种算法。

但是,最小二乘法存在一些缺点,如随着协方差矩阵的减小,易产生参数爆发现象;参数向量和协方差矩阵的处置选择不当会使得辨识过程在参数收敛之前结束;在存在随机噪声的情况下,参数易产生漂移,出现不稳定等。

为了防止参数爆发现象,Levenberg 提出在参数优化算法中增加一个阻尼项,以增加算法的稳定性。

本文在一般的最小二乘法中增加了阻尼因子,构成了阻尼最小二乘法。

又根据实时控制的要求,详细推到了递推阻尼最小二乘公式,实现在线辨识。

关键字:系统辨识,最小二乘法,递推算法正文1.题目的基本要求已知单入单出系统的差分方程以及噪声,在应用最小二乘法进行辨识的时候,在性能指标中加入阻尼因子,详细推导阻尼最小二乘法的递推公式。

2.输入辨识信号和系统噪声的产生方法和理论依据 2.1系统辩识信号输入选择准则(1)输入信号的功率或副度不宜过大,以免使系统工作在非线性区,但也不应过小,以致信噪比太小,直接影响辩识精度;(2)输入信号对系统的“净扰动”要小,即应使正负向扰动机会几乎均等; (3)工程上要便于实现,成本低。

2.2白噪声及其产生方法 (1) 白噪声过程(2)白噪声是一种均值为0、谱密度为非0常数的平稳随机过程。

(3)白噪声过程定义:如果随机过程()t ω的均值为0,自相关函数为()()2R t t ωσδ= (2.2.1)式中()t δ 为狄拉克(Dirac) 分布函数,即(){(),00,01t t t dt δδ∞∞=≠∞==⎰-且t (2.2.2)则称该随机过程为白燥声过程。

2.3白噪声序列 (1) 定义 如果随机序列{()}w t 均值为0,并且是两两不相关的,对应的自相关函数为()2,0,1,2w l R l l σδ==±± 式中{1,00,0l l l δ=≠=则称这种随机序列{()}w t 为白噪声序列。

递推最小二乘估计及模型阶次辨识

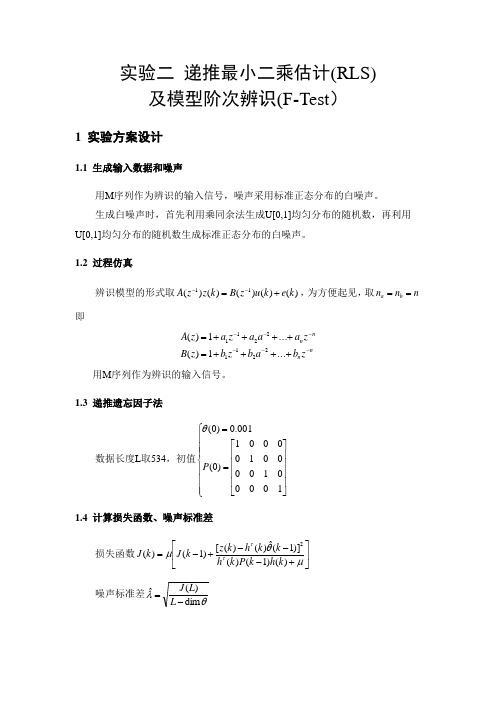

实验二 递推最小二乘估计(RLS)及模型阶次辨识(F-Test )1 实验方案设计1.1 生成输入数据和噪声用M 序列作为辨识的输入信号,噪声采用标准正态分布的白噪声。

生成白噪声时,首先利用乘同余法生成U[0,1]均匀分布的随机数,再利用U[0,1]均匀分布的随机数生成标准正态分布的白噪声。

1.2 过程仿真辨识模型的形式取)()()()()(11k e k u z B k z z A +=--,为方便起见,取n n n b a == 即nn n n zb a b z b z B z a a a z a z A ------++++=++++=...1)(...1)(22112211用M 序列作为辨识的输入信号。

1.3 递推遗忘因子法数据长度L 取534,初值⎪⎪⎪⎩⎪⎪⎪⎨⎧⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡==1000010000100001)0(001.0)0(P θ 1.4 计算损失函数、噪声标准差损失函数⎥⎦⎤⎢⎣⎡+---+-=μθμττ)()1()()]1(ˆ)()([)1()(2k h k P k h k k h k z k J k J噪声标准差θλdim )(ˆ-=L L J1.6 F-Test 定阶法计算模型阶次统计量t)22,2(~222)1()1()()1,(----++-=+n L F n L n J n J n J n n t其中,)(∙J 为相应阶次下的损失函数值,L 为所用的数据长度,n 为模型的估计阶次。

若a t n n t >+)1,(,拒绝00:n n H >,若a t n n t <+)1,(,接受00:n n H >,其中αt 为风险水平α下的阀值。

这时模型的阶次估计值可取1+n 。

1.6 计算噪信比和性能指标噪信比22ye σση= 参数估计平方相对偏差i i i ni i i θθθθθδˆ~,~1221-=⎪⎪⎭⎫ ⎝⎛=∑= 参数估计平方根偏差ii i n i ini iθθθθθδˆ~,)()~(2122122-==∑∑== 2 编程说明M 序列中,M 序列循环周期取15124=-=p N ,时钟节拍t ∆=1Sec ,幅度1=a ,特征多项式为1)(56⊕⊕=s s s F 。

应用最小二乘一次完成法和递推最小二乘法算法地系统辨识

1最小二乘法的理论基础1.1最小二乘法设单输入单输出线性定长系统的差分方程表示为:其中δ(k)为服从N(0,1)的随机噪声,现分别测出n+N 个输出输入值y(1),y(2),…,y(n+N),u(1),u(2),…,u(n+N),则可写出N 个方程,写成向量-矩阵形式()()()()()()()()1201121n n y k a y k a y k a y k n b u k b u k b u k n k ξ=-------++-++-+L L ()()()()()()()()()()()()()()()()()()10111121222112n n y n y n y u n u y n y n y u n u y n N y n N y N u n N u N a n a n b n N b ξξξ+--+⎡⎤⎡⎤⎢⎥⎢⎥+-+-+⎢⎥⎢⎥=⨯⎢⎥⎢⎥⎢⎥⎢⎥+-+--+⎢⎥⎢⎥⎣⎦⎣⎦⎡⎤⎢⎥+⎡⎤⎢⎥⎢⎥⎢⎥+⎢⎥+⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥+⎢⎥⎣⎦⎢⎥⎢⎥⎣⎦LLL L M M MMLL M M M(4.1.1)则式(1.1.1)可写为 (4.1.2)式中:y 为N 维输出向量;ξ为N 为维噪声向量;θ为(2n+1)维参数向量;Φ为N ×(2n+1)测量矩阵。

因此,式(4.1.1)是一个含有(2n+1)个未知参数,由N 个方程组成的联立方程组。

11y θφφξ--=-在给定输出向量y 和测量矩阵Φ的条件下求参数θ的估计,这就是系统辨识问题。

设 表示 θ 的估计值,ŷ表示y 的最优估计,则有 (4.1.3) 式中:()()()10ˆˆ1ˆˆ2ˆˆ,ˆˆˆn n ay n a y n y b y n N b θ⎡⎤⎢⎥+⎡⎤⎢⎥⎢⎥⎢⎥+⎢⎥⎢⎥==⎢⎥⎢⎥⎢⎥⎢⎥+⎢⎥⎣⎦⎢⎥⎢⎥⎣⎦M M M ()()()()()()()()()()()()()()()()()()101122,,11112221n n a y n n y n a n y b y n N n N b y n y u n u y n y u n u y n N y N u n N u N ξξθξξφ⎡⎤⎢⎥++⎡⎤⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥++⎢⎥⎢⎥===⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥++⎢⎥⎢⎥⎣⎦⎣⎦⎢⎥⎢⎥⎣⎦--+⎡⎤⎢⎥-+-+⎢⎥=⎢⎥⎢⎥-+--+⎢⎥⎣⎦M M M M L LL L M MMLL y φθξ=+ˆθˆˆyθ=Φ设e(k)=y(k)- ŷ(k), e(k)称为残差,则有e=y- ŷ=y-Φθ 最小二乘估计要求残差的平方和最小,即按照指数函数(4.1.4)求J对 的偏导数并令其等于0可得:(4.1.5)由式(4.1.5)可得的 θ 最小二乘估计:(4.1.6)J 为极小值的充分条件是:即矩阵ΦT Φ为正定矩阵,或者说是非奇异的。

应用最小二乘一次完成法和递推最小二乘法算法的系统辨识

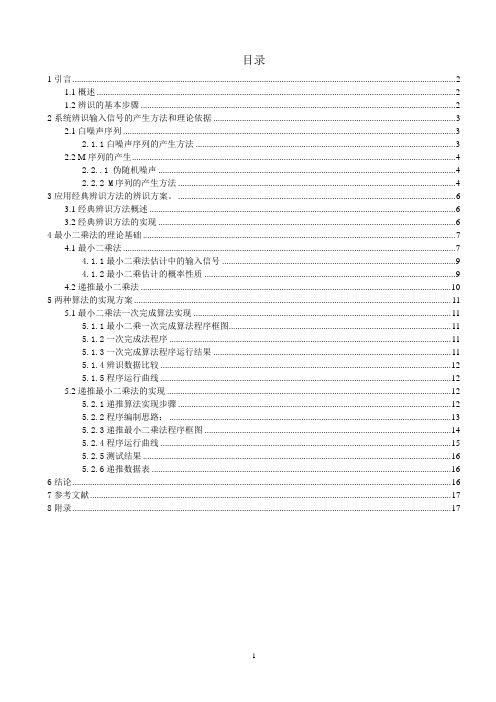

目录1引言 (2)1.1概述 (2)1.2辨识的基本步骤 (2)2系统辨识输入信号的产生方法和理论依据 (3)2.1白噪声序列 (3)2.1.1白噪声序列的产生方法 (3)2.2 M序列的产生 (4)2.2..1 伪随机噪声 (4)2.2.2 M序列的产生方法 (4)3应用经典辨识方法的辨识方案。

(6)3.1经典辨识方法概述 (6)3.2经典辨识方法的实现 (6)4最小二乘法的理论基础 (7)4.1最小二乘法 (7)4.1.1最小二乘法估计中的输入信号 (9)4.1.2最小二乘估计的概率性质 (9)4.2递推最小二乘法 (10)5两种算法的实现方案 (11)5.1最小二乘法一次完成算法实现 (11)5.1.1最小二乘一次完成算法程序框图 (11)5.1.2一次完成法程序 (11)5.1.3一次完成算法程序运行结果 (11)5.1.4辨识数据比较 (12)5.1.5程序运行曲线 (12)5.2递推最小二乘法的实现 (12)5.2.1递推算法实现步骤 (12)5.2.2程序编制思路: (13)5.2.3递推最小二乘法程序框图 (14)5.2.4程序运行曲线 (15)5.2.5测试结果 (16)5.2.6递推数据表 (16)6结论 (16)7参考文献 (17)8附录 (17)应用最小二乘一次完成法和递推最小二乘法算法的系统辨识摘要:本题针对一个单输入单输出系统的便是问题,辨识的输入信号采用的是伪随机二位式序列(M序列),系统噪声为独立同分布高斯随机向量序列(白噪声),辨识的算法是递推最小二乘法和广义最小二乘法,本文简单描述应用经典辨识方法的辨识方案,详细描述了输入信号、噪声的产生方法及matlab程序,阐述了用两种不同算法的辨识原理并对它们的推导过程及辨识程序编制思路做了详细的描述。

最后结合真值与估计值对不同辨识算法的优劣进行了比较。

关键词:系统辨识M序列最小二乘法1引言1.1概述系统辨识是现代控制理论中的一个分支,它是根据系统的输入输出时间函数来确定描述系统行为的数学模型。

递归最小二乘法辨识参数

递归最小二乘法辨识参数递归最小二乘法(Recursive Least Squares, RLS)是一种参数辨识方法,它使用递归算法来求解最小二乘法中的参数。

在许多领域中,例如系统辨识、自适应控制、信号处理等,递归最小二乘法都是一个广泛使用的方法。

递归最小二乘法的基本思想是:通过递归迭代来更新参数估计值,使其逼近最优解。

在递归过程中,每一次迭代时,都会通过当前的测量值来更新参数的估计值,同时保留历史测量值的影响,从而获得更精确的估计值。

具体地说,在递归过程中,首先需要定义一个初始参数向量,然后通过观测数据序列来递归更新参数向量。

假设有一个如下所示的线性关系:y(k) = Φ(k) * θ + v(k)其中,y(k)是被观测到的输出值,Φ(k)是与该输出值相关的输入向量,θ是待辨识的参数向量,v(k)是误差项。

递归最小二乘法的目标就是通过观测数据来估计θ的值。

在递归最小二乘法中,首先需要定义一个初始的参数向量θ0,然后通过数据序列递归地更新θ的值。

每一次迭代时,都会用最新的观测数据来更新参数向量,使得估计值更接近真实值。

具体来说,每次观测到新的数据之后,都会根据当前参数估计值和新的观测值来计算估计误差,并更新参数向量。

具体的迭代步骤如下:1.从数据序列中读取观测值y(k)和输入向量Φ(k);2.计算估计值y(k)hat和估计误差e(k):y(k)hat = Φ(k) * θ(k-1)e(k) = y(k) - y(k)hat3.计算卡尔曼增益K(k)和参数估计值θ(k):K(k) = P(k-1) * Φ(k) / (λ + Φ(k)' * P(k-1) * Φ(k))θ(k) = θ(k-1) + K(k) * e(k)其中,P(k-1)是先前迭代步骤中的误差协方差矩阵,λ是一个小的正数,用于确保逆矩阵的存在性。

需要注意的是,递归最小二乘法的计算量相对较大,因此通常需要对算法进行优化,以提高计算效率和精度。

广义递推最小二乘辨识

广义递推最小二乘辨识一、实验目的1 通过实验掌握广义最小二乘辨识算法;2 运用MATLAB编程,掌握算法实现方法。

二、实验原理广义最小二乘法的基本思想是基于对数据先进行一次滤波预处理,然后利用普通最小二乘法对滤波后的数据进行辨识。

如果滤波模型选择得合适,对数据进行了较好的白色化处理,那么直接利用普通最小二乘法就能获得无偏一致估计。

广义最小二乘法所用的滤波模型实际上就是一种动态模型,在整个迭代过程中不断靠偏差信息来调整这个滤波模型,使它逐渐逼近于一个较好的滤波模型,以便对数据进行较好的白色化处理,使模型参数估计称为无偏一致估计。

理论上说,广义最小二乘法所用的动态模型经过几次迭代调整后,便可对数据进行较好的白化处理,但是,当过程的输出噪信比比较大或模型参数比较多时,这种数据白色化处理的可靠性就会下降。

此时,准则函数可能出现多个局部收敛点,因而辨识结果可能使准则函数收敛于局部极小点上而不是全局极小点上。

这样,最终的辨识结果往往也会是有偏的。

其收敛速度比较慢,需要经过多次迭代计算,才能得到较准确的参数估计值。

一般情况下,经过多次迭代后,估计值便会收敛到稳态值。

但在某些情况下(如噪声比较低时)存在局部极小值,估计值不一定收敛到准则函数的全局极小值上。

为了防止参数估计值收敛到局部极小值,最好选定初值接近最优解,一般可以用最小二乘法的批处理估计值作为初值。

如果系统是时变的,或为了克服数据饱和现象,可以在两次RLS算法中分别引进遗忘因子。

三、实验内容<1> 数据获取:实验数据按照表9-1,为二阶线性离散系统的输入输出数据<2> 数据处理:为了提高辨识精度,实验者必须对原始数据进行剔除坏数据、零均值化、工频滤波等处理。

实验进行了白化滤波处理。

<3> 辨识算法:利用处理过的数据(取适当的数据长度),选择某种辨识方法(如RLS递推最小二乘法、RELS、RIV或RML等参数估计算法及F-检验或AIC定阶法),估计出模型参数和阶次,同时分析辨识结果。

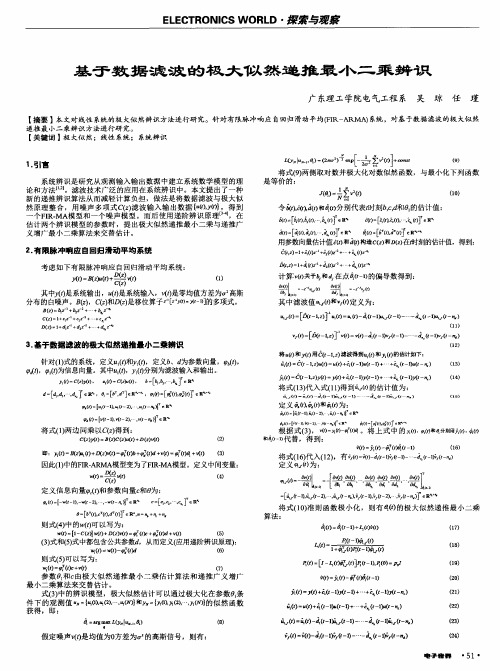

基于数据滤波的极大似然递推最小二乘辨识

( 1 4 )

( 1 5

d = , , … , 丁 e R , q = [ 矿 , d ] t 建 一, 砚 ( f ) = [ ( f ) , ( f 】 丁 r t R

% ( f ) = h( f — l ( f 一 2 ) ,, u d t 一 E R 、

( 1 )

咖( t ) +

¨

计算: v ( r ) 关于 和 在点鼋 ( 1 ) 的偏导数得到:

=- - Z - d ∞ 一

其中 y ( f ) 是系统输 出,u ( O 是系统输入 ,v ( 是零 均值方差 为 高斯 分布 的白噪声 。 ( 2 ) , ) 和D 是移位算 子z - ) = — D ] 的多项式 。

丑 ( 2 ) = z 一 + z 一 + … +b  ̄ z - ’

c0 ) =l + c t z 一 毛 +一 +c z 。 D( = l + d = z -  ̄ + z 卜 + 2 ‘

其 中滤 波值 u ( f ) 和v , o ) 定 义为 :

将 式( 1 3 ) 代 入 式( 1 1 ) 得到 , ( f ) 的估计值 为 :

, )一矗 ( t ) 一 ( r 一1 ) Jo —1 )一 r —j 一I ) o , )

定义

访∞和l 磊 o ) 为:

— 2 x O 一 对 ∈ R

蟊( f ) : 随p — l

反 r ) = [ ( } ( 。 , … , ( 1 e Ⅱ

雄 ) = [ 口 ( … . p ) ] e R

0 ∞ ; ( 晓 < - ( f ) 『 e R

o ) ; [ ∞ , ( 叮e R

用参数向量估计值 ( f ) 和 ( f ) 构造c ( z ) 和D ( 2 ) 在埘 刻的估计值,得到:

- 1、下载文档前请自行甄别文档内容的完整性,平台不提供额外的编辑、内容补充、找答案等附加服务。

- 2、"仅部分预览"的文档,不可在线预览部分如存在完整性等问题,可反馈申请退款(可完整预览的文档不适用该条件!)。

- 3、如文档侵犯您的权益,请联系客服反馈,我们会尽快为您处理(人工客服工作时间:9:00-18:30)。

P ( k ) [ P - 1 ( k - 1 ) ( k - 1 ) ( k - 1 ) - 1 ]

( 3 )

• 由式(3)和矩阵反演公式(4),可得P(k)的如下递推计算式

P (k ) P (k-1-P )(k-1(k )-1 )1 [ (k-1 )P (k-1(k )-1 ) 1 ]

首先,假定在第k-1次递推中,我们已计算好参数估计值 θˆ(k -1)

➢ 在第k次递推时,我们已获得新的观测数据向量(k-1)和

y(k),则记

Φk-1=[(0), (1), ..., (k-2)]T

Φk=[(0),

(1),

...,

(k-1)]T=[

Φ

k 1

φ(k-1)]T

Yk-1=[y(1), y(2), ..., y(k-1)]T

• 本 讲 主 要 讲 授 递 推 最 小 二 乘 (Recursive Least-square, RLS)法的思想及推导过程, 主要内容为:

– 递推算法

– 加权RLS法和渐消记忆RLS法

1 递推算法

• 递推算法就是依时间顺序,每获得一次新的 观测数据就修正一次参数估计值,随着时间 的推移,便能获得满意的辨识结果.

• 设在k-1时刻和k时刻,系统的参数估计结果为

θ ˆ(k-1 ) (Φ k 1 Φ k 1 ) 1 Φ k 1 Y k 1

θ ˆ(k)(Φ kΦ k)1Φ kYk

其中θˆ ( k )和 θˆ(k -1) 分别为根据前k次和前k-1次观测/采样数据得到 的LS参数估计值.

θ ˆ(k-1 ) (Φ k 1 Φ k 1 ) 1 Φ k 1 Y k 1 θ ˆ(k)(Φ kΦ k)1Φ kYk

递推最小二乘法(RLS)

•

上一节中已经给出了LS法的一次成批型算法,即

在获得所有系统输入输出检测数据之后,利用LS估计

式一次性计算出估计值.

– 成批型LS法在具体使用时不仅计算量大,占用内 存多,而且不能很好适用于在线辨识.

– 随着控制科学和系统科学的发展,迫切需要发展 一种递推参数估计算法,以能实现实时在线地进 行辨识系统模型参数以供进行实时控制和预报, 如

Yk=[y(1),

y(2),

...,

y(k)]T=[Y

k

1

y(k)]T

• 仔细考察上述LS法,可以知道,该算法进行递 推化的关键是算法中的矩阵求逆的递推计 算问题.

– 因此,下面先讨论该逆矩阵的递推计算.

1 递推算法(4/12)

•令

P ( k ) ( Φ k Φ k ) - 1

( 2 )

将Φk展开,故有

– RLS法即为上一节的成批型LS算法的递推化, 即将成批型LS算法化成依时间顺序递推计算 即可。

• 该工作是1950年由Plackett完成的。

– 下面讨论无加权因素时的一般LS法的递推算 法的推导.

• 即将成批型算法化

θLS (Φ LΦ L)1Φ LYL 等效变换成如下所示的随时间演变的递推算法.

• 在线估计

• 自适应控制和预报

• 时变参数辨识 • 故障监测与诊断 • 仿真等.

• 递推辨识算法的思想可以概括成 新的参数估计值=旧的参数估计值+修正项

即新的递推参数估计值是在旧的递推估计值 的基础上修正而成,这就是递推的概念.

– 递推算法不仅可减少计算量和存储量,而且能实现 在线实时辨识.

• 递推算法的特性

新的参数估计值=旧的参数估计值+修正项

(1)

– 递推算法具有良好的在线学习、自适应能力,在

• 系统识

• 自适应控制

• 在线学习系统

• 数据挖掘

等方面有广泛的应用。

受控XAR模型:A(z-1)y(k)=B(z-1)u(k)+w(k)

na

A (z1)1 aizi

nb

B (z1) bizi

θLS (Φ LΦ L)1Φ LYL

P ( k ) (Φ k [ - 1( k - 1 )Φ ] k - 1 [( k - 1 ) ) - ] 1

[Φ k-1 Φ k-1(k-1 ) (k-1 )-1 ]

[ P - 1 ( k - 1 ) ( k - 1 ) ( k - 1 ) - 1 ]

( 3 )

• 为便于逆矩阵递推算式的推导,下面引入如 下矩阵反演公式(设A和C为可逆方阵) (A+BCD)-1=A-1-A-1B(C-1+DA-1B)-1DA-1 (4)

• 该公式可以证明如下:由于

(A+BCD)[A-1-A-1B(C-1+DA-1B)-1DA-1]

=I-B(C-1+DA-1B)-1DA-1+BCDA-1 -BCDA-1B(C-1+DA-1B)-1DA-1

=I-B[I-C(C-1+DA-1B)+CDA-1B](C-1+DA-1B)-1DA-1 =I 因此,矩阵反演公式(4)成立.

i1

i1

YL=L+WL YL=[y(1), y(2), ..., y(L)]T

L=[(0), (1), ..., (L-1)]T, L×(na+nb)

(k-1 ) [y(k-1 ) ,,y(k-n a) u (k-1 ) ,,u (k-n b) ]

θ [-a 1 , , -a n a b 1 , ,b n b]

(k-1 )P (k-1)

I-1 P (k (-k 1 - 1 ) () P k( -k 1 )- 1 (k () k -1 -)1 ) P (k-1)

(5

下面讨论参数估计值θˆ ( k ) 的递推计算.

➢ 由上一讲的一般LS估计式

该乘积为标量

θ ˆ(k ) (Φ k Φ k)-1 Φ k Y k P (k )Φ k Y k

P ( k )P [ 1 ( k -1 ) θ ˆ( k -1 )( k -1 )y ( k )]

P ( k )P { 1 ( k ) - [ ( k - 1 ) ( k - 1 ) θ ˆ ( k ] - 1 ) ( k - 1 ) y ( k )}

有

P-1(k)θ ˆ(k)Φ kY(k)

(A+BCD)-1=A-1-A-1B(C-1+DA-1B)-1DA-1

–即

利用公式 P-1(k)θ ˆ(k)Φ kY(k)

θ ˆ ( k ) P ( k )Φ k [ 1( k - 1 )Y ] ( k [ - 1 )y ( k ) ]

P (k )Φ [ k 1 Y (k-1 )(k-1 )y (k )]